magazinelib使用教程

粉丝17.6万获赞197.2万

相关视频

01:08查看AI文稿AI文稿

01:08查看AI文稿AI文稿很多人都问啊,这个精读要怎么去练习?那首先在精读的选材方面肯定比较推荐这个外刊,那么至于怎么去练习,今天我想分为两个方面来给大家稍作讲解一下。首先第一个方面就是你看一下自己,如果你能独立的去完成一篇精读练习的话,那么我给大家推荐这个网站,因为 这个网站里面有很多的呃外滩练习素材,比如说像经济学人呐,纽约时报等等都有啊,但是呢,如果你要去练习里面的材料的话,你要及时下载,要不然这个材料就会失去了他的时效性。 这里右上角有一个搜索键,那么我们可以在这个搜索框之内搜索我们想要看的外刊,比如说这里搜索经济学人的话,那么就会出来很多的这样子的内容。那么第二点就是如果你不能独立的去完成一篇筋骨练习的话,需要有人去做一些引导,那么我给他推荐这两个公众号, 一个是 lornengrat, 还有一个是经济学人双语阅读。这两个工程号我觉得特别棒的一点啊,就是作者把这个文章中间的关键句子和词语通通摘出来,然后做进一步解释,这样呢就能够更好的帮助我们去梳理这样的文章的逻辑,进一步去理解这文章的意思。

3664小鱼饿吗 01:08:29

01:08:29 00:32查看AI文稿AI文稿

00:32查看AI文稿AI文稿啊, 在 live 上除了生成同款恐怖特效,还有现成的图片模板,如转线稿、升头像,以及视频特效模板,如圣诞特效、子弹事件。

73傅博熊 00:55查看AI文稿AI文稿

00:55查看AI文稿AI文稿当你想要快速精通 ai 升图,你直接给我把例子重复写一次,然后在后面加个点二次。接着进入找到这个图片模型,你会发现这里有上万种 ai 升图模板。比如这种模特手持产品展示的图片,你只需要拍一张你的产品图,然后上传,再根据这里的详细使用方法,用内置的顶级模型,比如这个 c j m 五点零 都能做成一张相同风格的海报,还有这种打光的精修的,同样的,不管是电商摄影、平面设计,还是动漫插画、小说推文,你都能找到直接能用的模板。之后你又不小心点到这个图身视频,你发现里面有各种顶级的视频模型,直接能让这张图动起来。比如这个 pixrews 五点五 换成多镜头画面的同时,还给你做好了配套音效。更牛的是,里面还有几百种视频特效随你挑选,同样也只需要一张图就能完美复刻。最后你发现使用全程不需要魔法,不需要特殊网络环境,这种好东西赶紧收藏起来。

2344赛博自由老爹 02:14

02:14 01:20查看AI文稿AI文稿

01:20查看AI文稿AI文稿如何在三十秒以内无脑复刻出这样这样!还有这样的? 哎呀,特效呢?完全不用写提示词,有手就会丢掉! a 一 关闭 c 四 d, 现在只需要一张照片就能搞定,真的超级简单!跟上我的操作,我们找到利不利不 ai, 点击这里的视频特效,再点击特效玩法,这里都是现成的模板,那些百万点赞的爆火特效模板都在这里啦!比如这个惊天魔道团中的控雨术特效,子弹时间控制雷电、 恭喜发财金币等等。只需要选中模板,点击使用特效, 上传一张你的照片,无需输入提示词,基本抽卡一到两次就可以得到。全程不需要任何其他操作,小白直接一键复刻。专业级的 ai 特效,我几乎把所有的特效都试了个遍,个人觉得这些特效是比较出篇的,都整理好了,你们快去试试, 真的太好玩了! bilibili 里还内置了市面上主流的深图和视频模型,大大降低了成本和提高了效率。这里分享一个更 diy 的 玩法,先 身图,我一般用 vr 模型,效果比较出色,再丢到视频生产里面,添加你想要的特效,你看所有的人都能一站式轻松制作好玩的特效,超好玩,超方便,快去试试吧!我是懒妈,用 ai 版南极碧小菜白了个白。

31懒布懒妈 01:52查看AI文稿AI文稿

01:52查看AI文稿AI文稿c g attention 技术在不降低质量的前提下,能够有效加速图片或视频生成。按以下说明,安装和使用非常简单,操作前注意备份 comfy ui, 以防安装失败导致 comfy ui 报废。首先打开 comfy ui 管理器高级选项作息勾命令提示符, 以下命令操作都在这里进行。步骤一,安装酷毙二 kit, 即酷毙 n 一、 在命令行输入 n v d s may 回车查看当前酷毙版本。二、从评论区或以下地址下载对应版本的酷毙二并安装。 三、从评论区或以下地址下载对应版本的酷毙 n, 解压后把其中 bin include lib 目录复制到已安装的 c u d a 目录合并即可。步骤二,安装 triton windows 三十系以上显卡拷贝此安装命令到命令行并执行。二十系显卡拷贝此安装命令到命令行并执行。二十系以下不支持。 步骤三,安装 cj attention 拷贝 python exe 减 and pop install 到命令行打个空格,从以下或评论区的网盘分享中选择合适版本的 cj attention 轮子,拖拽到空格后面获取路径执行即可。 stage tension 轮子版本的选择可以根据康复 u i 启动信息里显示的 torch, 即 pashpark co 及 cuda cp 级 python 版本号确定。注意,五十系显卡推荐直接安装专用轮子,如果有问题再改用通用轮子。步骤四,使用 stage tension 加速图片或视频生成。 工作流中,在 k 彩样器前,将模型与 patch stage tension, kj 和 model patch, torch settings 等相关加速节点串联运行即可加速其中节点选项。 stage tension 一 般保持 auto allow compile 选项,建议打开,如果有兼容稳定问题则关闭。

2清山果哥 02:55查看AI文稿AI文稿

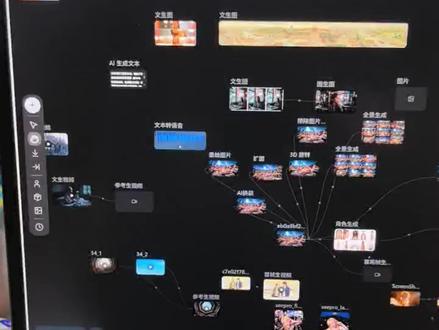

02:55查看AI文稿AI文稿直到现在,很多小伙伴关注我,还是为了要手搓的无线画布,那么我搓的无线画布就在这边, 我会分享到群里面,大家可以拿去玩。在最早之前我就告诉过大家,手搓的无线画布,它就是个玩具,无论是谁, 如果说你手搓的东西都非常好用,大家都能用的很方便,那么像献丑啊,太不闹啊!李部这些公司就不需要再请员工去进行维护了,所以跟大家讲三个点, 第一个是你手搓无线画布,用 ai 去搓无线画布,他需要消耗 token, 这部分是你自己需要去增加的成本。如果你不知道怎么使用 ai, 你 甚至到后面花了很多的钱去买 token, 你 都搓不出一个能使用的无线画布。 其次呢,你手搓无线画布是没有人替你维护的,每一个新模型出来,每一个功能出来,你又要自己在花精力花时间又去用 ai 去写,这样代码出来还不一定能做得好。 市面上你所看到麻衣画布,他不是免费的,他是不让你自定义 api 接口,用他的 api 他 能赚差价,所以他会给你维护免费的就是最贵的。大家记住这句话, 所以你在没有人维护情况下,你这样的成本是非常高的。其次,你所谓的那些 api 厂商听起来很便宜, 什么几毛钱,几一毛钱啊,几分钱,这样的 api, 你 充钱下去,隔两天他就跑路,隔两天他就生成不出来,隔两天就生成的很慢很慢,基本上能用的时间是非常非常少的,他受波动是非常大的, 所以便宜是会降低你效率的。如果你要增加你的产出,请你不要去省这些钱去找什么所谓的首充无限话补,它会存在很多的 bug, 并且你所对接便宜的 api 接口,它也给不了你任何的高效率。 所以我推荐的还是大家去找大厂的平台,比如说献丑、 typeon、 吕布 tv, 当然我最推荐献丑,因为他家真的很良心,他的香蕉只要两毛钱一张。 两毛钱一张你还要什么自行车啊?你还要什么一毛钱的 api 集成接口,他们一堆人在帮你维护,让你直接去做你自己做的提高效率的事情, 需要再去操心这些什么走着无线画布啊,今天又这个 bug, 那 个 bug, 所以 不知道大家为什么要去找这种无线画布,已经过时了,用 ai 写已经过时了, 现在这个年代,谁提高了生产效率谁才是王,所以这点钱不需要去去省好吗?如果你不服可以来怼我。

595清码侧 05:53查看AI文稿AI文稿

05:53查看AI文稿AI文稿本期视频我来分享一下初步使用 openclaw 的 感受,以及我对它底层工作原理的拆解。最后咱们再来回答那个老板们都很关心的问题,到底 openclaw 能不能当成真正的 ai 员工来用? 成功在 linux 子系统中部署 openclaw 后,我们来看看它的项目文件夹。首先是 lab 文件夹,这里存放的是源代码, 然后最重要的是 opencloud 点 jason, 这个主配置文件里面记录了你要用什么大模型,开哪些通信频道,以及是否启动插件等。像我个人的配置是同时配了 minimax 二点五和 glm 四点七两个模型,一个专门给主代理用,另一个给子代理跑任务, 而且都是买的编程套餐,这样在实际跑起来的时候真不存在 tokens 不 够用的情况。通信上我把 telegram 和飞书两个频道都打开了,它们是可以同时通信,互不影响的。除了配置文件,最核心的就是 workspace, 这个文件夹里面有个叫 agents 点 md 的 文档, 定义了主代理的行为规则。想搞懂 openclo 怎么运作的,看这个文档就够了。主代理在跟你聊天前会先读这个 egns 点 md 文档, 然后按照文档要求依次去加载它的性格定义文档 so 点 md 你 的个人信息文档 user 点 md 以及你最近两天的对话上下文。从这个流程你能看出,主代理本质上就是一个由文档驱动的 ai 编程智能体。 这个 agents 点 md 就是 它的预设提示词,跟咱们平时用的 codex 或者 code code 相比,并没有本质的区别。 我们接着看它的这个预设提示词,你会发现它的特点体现在三个方面。第一是记忆机制,它会把你每天发生的事以时间戳命名,保存在 memory 文件夹里,作为短期记忆。同时它还有个独立维护的 memory 点 md 长期记忆库, 它会定期自动去短期记忆里提炼重要的事件、想法、经验和教训。存到长期记忆里, 如果碰到极其关键的教训,他甚至会进一步补充进他自己的预设提示词 agents 点 m d 中。正是因为有这套机制,你在用的时候才会感觉这只龙虾越用越懂,你越用越聪明。但注意,这套看起来很聪明的机制,依然是由底层文档来驱动的。 如果你给主代理配的大模型,脑子不够用,哪怕你提示词写出一朵花来,它执行起来也是要大打折扣的。第二点是定时机制。咱们平时用 ai 是 一问一答,是你推着它动,而定时机制解决的是让智能体推着你动的问题, 里面具体分为心跳机制和定时任务两种。区别在哪儿?心跳机制 heartbeat 是 到了时间循环,唤醒智能体,让智能体去加载上下文,看有没有该干的活儿。它是智能体驱动的,适合需要理解语义和上下文的场景,比如让它定时处理新邮件。 而定时任务 chrome 则是定时去执行一段固定的工作流。它是程序代码驱动的,非常死板, 就是一个确定的输入,给出一个确定的输出,你用的时候可能感觉不出来,但两者的底层工作原理完全不同。第三点是子代理机制, 那他的子代理是怎么干活的?其实依然是文档驱动的,主代理会在 admin 点 md 里明确规定什么时候该派哪个子代理上场,要派活了,主代理会把任务要求预先存到子代理专属的 skill 点 md 文档里,然后告诉子代理 你去读你的说明书,顺便带上这些出水条件去干活,干完再把结果发回咱们的聊天频道。 这就是主子代理的交互模式,非常简单,其实有些特定任务,主代理自己读 skill 点 d 完全能搞定。之所以要丢给子代理干,一是不占用主代理那宝贵的上下文空间,二是因为有些任务流程是已经固化了的, 让子代理拿一个稍微弱一点便宜点的大模型去跑就行了,能减少调用顶级大模型的次数。虽然有这些好处,但这种简单的原生交互模式是不支持构建多级子代理架构的, 也不支持子代理跟子代理之间的横向交互。所以我一直怀疑,网上那些号称用 openclaw 搭了跨部门团队的标题党, 如果多智能体携同的交互机制这么容易搞定,那像 minis 这种超级项目也就不值钱了。关于上面拆解的项目架构、记忆机制、定时器和子代理的底层原理,我已经整理成了配套文档,老规矩,大家按需自取。 最后回到一开始的问题, openclaw 到底能不能当 ai 员工来用?我的结论是,它适合做个人助理,拿来用好它的记忆功能和心跳机制,它能让你不用盯着屏幕,对着手机说话就能执行操作,有点像能力加强版的豆包或腾讯元宝。 但你要拿它处理复杂任务,它真的远没 ai 编程工具方便。比如我平时会使用 cloud code codex 来开发程序,协助办公,协助创作,是需要一个随时能审查文档、能定向加载上下文的编辑器界面的。 而 opencll 并没有这个编辑器环境。 ai 员工的愿景很丰满,但仅靠 opencll 原生能力是达不到的。 要说现在市面上比较接近的应该是 menace, 但那种疯狂调用顶级大模型 tokens 的 多智能体协助模式,成本代价是咱们普通人承受不起的。网上总有人误导说龙虾不够聪明,是因为你养的时间不够久,或者是没装那么多 skills。 请记住,只要它是一款依靠文档驱动的智能体,文档的精炼干净才是最不应该被忽视的。 所谓的 garbage in, garbage out, 只要你的上下文管理一团糟,哪怕给它配个再顶级的大模型,性能照样大打折扣。我是 cici, 分享那些不吹牛的 ai 实战经验。

68CC的AI笔记

猜你喜欢

- 12.3万持扇定天下

最新视频

- 1.5万盐渍土豆