opencdoe如何加模型

如果你现在用 ai 写代码,还在为每个大模型单独付费,先别划走这一条,你先收藏起来,后面一定用得上。现在最大的问题不是模型不好用,而是模型太多,成本越来越高。 今天我给你介绍一个可以一个地方用多个大模型的工具。我最近在用的是 open code 的, 它最大的价值就一句话,一个界面切换多个大模型。打开 open code 的 你会发现,模型选择和对话写代码都在底部 切模型提需求,整个过程是连在一起的,用起来很顺。重点说一个非常现实的点,这里面有不少模型,现在是可以免费使用的, 同一个需求,我直接切不同模型跑一遍,差别你几乎一眼就能看出来。这个特别适合用来做一件事,快速对比模型能力,找到最适合你的那一个,而不是靠感觉选模型。如果你写代码,或者正在学编程,学 ai 这个工具你一定能用得上。当然,免费模型也有能力边界, 但用来学习、验证思路完全够用。如果你对 open code 的, 你具体有哪些模型,怎么选,可以在评论区问我,关注我,用十年 it 经验,带你轻松听懂 ai!

粉丝113获赞344

相关视频

03:50查看AI文稿AI文稿

03:50查看AI文稿AI文稿不用买 mac mini, 不 用自己的电脑,也不需要复杂的代码配置,九块九就能一键部署你的 open clone, 也就是最近大火的 clone bot, 这是我接入好的,已经开始为我去赚钱了。屁话不多说,跟着我这个教程跑起来。首先打开火山引擎,薅一个羊毛,拿上我视频下方的邀请链接,注册并关联一下子,你这一下子我就能赚一块钱,咱俩平分怎么也得对半分呢?如果你有账号了,也可以登录并关联啊。 然后打开第二个链接,下单九块九的一键部署服务,填写一个简单又复杂的密码,再点开高级设置。 重点来了,我们要做的核心动作就是填上这几个 k, 下面一定要按我说的操作,因为我发现全网都没人教怎么去薅这波火山的羊毛, 包括火山官方的配置文档也是一塌糊涂,我还做了一份详细的配置教程,文档链接放在视频下方,如果觉得我写的好,记得赏个关注,谢谢了。保持这个页面不要关闭,我们打开这个链接, 然后打开开通管理界面,根据这个步骤选择要开通的大模型,建议呢?开通一个升图的模型,然后打开 api k 管理,这个 api 就 可以不用去复制它。 然后回到这个界面,模型选择就能看到自己已经配置过的模型,下面的 api k 就 能直接选择出我们的 k, 那 模型的配置就完成了。 下面我们开始把飞书接入进来,首先要访问飞书开放平台,点击右上角的开发者后台,选择创建企业自建应用, 填写应用名称,写上描述,点击创建,然后点击凭证与基础信息,复制这个 id 和 app 密钥, 再回到这个界面,填写上飞书的两个选项,再点击页面下方的创建,点击确定,至此我们的实力创建完成,让它开始运行。 回到飞出的开放平台,打开权限管理页面,点击批量导入导出,然后到我的教学配置文档当中去复制这个代码,全替换进去,点击 下一步,再点击申请开通,然后在左侧的事件与回调点选一下,选择事件配置页签啊,单机订阅方式旁边的这个编辑小按钮, 然后选择使用长链接接收事件,并单机保存在已添加事件区域,单机添加事件按钮,在添加事件对话框中选择应用身份订阅页签,并勾选接收消息, 如果找不到的话,你就先搜索接收消息,然后点击确认添加按钮, 然后我们向上看,点击页面顶部的这个创建版本这四个字,按照这个需要的配置内容呢,我们写上版本号及更新说明啊,随便填几个字就行了。翻到页面底部,点击保存按钮,然后单机页面个人发布按钮,完成应用的发布。 这个时候你就去看一下你的飞书是不是多了一个机器人,让你去审核,然后点击审核通过你的机器人就可以去用了,这个时候打开手机的飞书或者是桌面端的飞书,找到我们这个机器人,发送一个任意消息,比如说你好, 首先它会出现一个等待表情,如果出现等待的表情,那 ok, 说明正在调用你的模型,那我们的配置就成功了, 等他回复你的时候,你就知道新的世界已被打,已经被打开。如果你想通过浏览器去访问 open、 cloud、 web 这些界面的话,你可以参考一些官方的文档,更多的玩法大家可以自己去探 索。如果觉得我的教程比较详细,比较明确,那大家可以给我点一个关注,谢谢大家!再见。

1948AI李探长 00:44查看AI文稿AI文稿

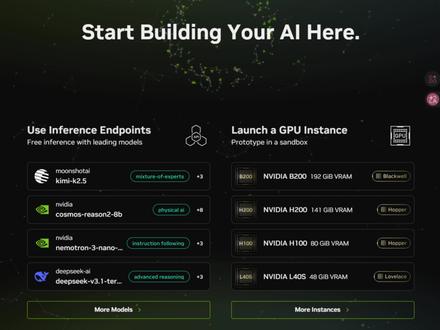

00:44查看AI文稿AI文稿大龙虾还没有明白,百万 token 先没了,别急,一起来薅老黄羊毛。无限 token 免费用。首先在英伟达这个网站用邮箱注册个账号,接着验证一下手机号,就能调用 api 了, 关键是支持国内手机号,不用绑卡。然后随便选一个大模型,进入聊天页面, 这里可以切换各种大模型试试,白嫖的人太多,热门模型可能响应很慢,找一个速度还过得去的,这里查看视力代码,可以直接复制模型相关配置。然后打开你龙虾的外部页面,修改配置, 保存之后建议重启一下服务,现在就再也不用担心托肯消耗了,之前配置好的飞书也能直接使用。

1812小蚂蚁爱折腾|搞AI 03:11查看AI文稿AI文稿

03:11查看AI文稿AI文稿今天是 opencode 的 第十二堂课,本地的模型配置嫌太复杂, api 调用的模型嫌太贵,今天我给大家分享免费调用的多款顶级的模型,这个就是英伟达这个官网提供的这样一个 免费的服务啊,大家可以去薅羊毛。首先要进入这个恩伟达的官网,就 build 点恩伟达点 com 点这个首页的模型, 你可以看到这里面有很多个顶级的模型,比如说精华指望的 g l m 五,还有这个 mini max, 大家第一步先要去进行这个登录啊,这个登录其实也就是正常的注册啊,没啥可掩饰的,注册完了以后,大家右上角有个 api key, 点了以后,你要生成一个 apikey 啊,比如说这个根股啊,就是随随便选一个,他就生成了一个这个 apikey, 然后你把它复制出来,复制出来我,我这里已经有了一个啊,这有,有了这个,呃,然后呢?再把它回回到前面的这个模型, 选一个你想要的模型啊,这里推荐是用迷你麦克斯,你也可以用千问的,然后点击它,点击这个模型, 点击这个模型以后,呃,你要去配置文件进行修改啊,这个就是,呃,这个我也是扣的啊,你需要打开这样一个,在你的加目录里面有一个这个这样一个文件啊,就是叫这个 open 点 open 扣的一个一个目录给大家看一下, 比如说我 cd 加目录点 open core, 哎,它这里面有一个叫 open core 点 jason 的 一个,你把它打开,把这一段把它粘过去那个 base url 和这个 api key, api key 就 刚刚你你你那个 这里的刚刚右上角这个啊,现在很卡,现在很卡,然后它好处是第一个它不需要魔法上网,第二个的话这里暂时是无限免费的,这个就是它的贝斯 u l, 可以 看一下,把它敲出来。贝斯 u l 第二个就是 api key a p i k 就是 这个 mini max, 这个然后弄好了以后,其实你可以重启路由了,重启路由了以后你可以试试看啊,可以试试看,我刚刚已经重启路由了,重启路由了以后,呃,我刚刚让它切换了这样一个 mini max 啊,这没问题的,大家,那大家配置这个, 呃, config 的 这个文件的时候,大家一定要在这个地方,也就是在 a 键词里面要把它加进去,就是这个地方 mod 是 一定要加入这个白名单,如果不加的话,这行它默认的是没有的,默认的是没有的,你如果不加的话,它就一定切换不过来,那不要以为在这个地方配置好了就是, 呃,就高枕无忧了。嗯,所以说这个地方是一个坑啊,这个地方是一个坑。嗯,然后切换了以后,你就可以用那个英伟达的这样一个 mini max 进行无限制用了它,它,我感觉它还是很卡, 可能是因为免费的东西也就这样了吧。对,然后大家切换到 mini max 以后就可以去尝试使用啊,这块是不需要钱的,因为因为打战时这个所有的模型都是免费的,那大家可以把它切切过去玩一玩啊,这么多模型啊,这个,这个也是不错的,还有这个叶子暗面二点五也非常好啊,所以说大家还是尽可能去薅他的羊毛。

64根谷老师 06:46查看AI文稿AI文稿

06:46查看AI文稿AI文稿今天一个视频教会大家不花一分钱去安装和使用 open k 二的,然后而且是一百二十 b 的 云端模型,今天纯干货分享,按照我的操作步骤来,基本上一次就可以成功。然后如果你现在没有时间的话,可以点赞收藏加关注, 然后以后慢慢看。然后我现在这台 macbook pro 上演示,没有 mac 的 话也没有关系,只要是一台电脑就可以, windows 和 mac 都可以。然后因为 mac mini 比较省电,比较适合七乘二十四小时运行。然后我们开始第一步,首先你需要去解决自己的网络问题, 网络问题我没有办法去解决,解决完之后,你可以先打开这个网站,然后这个网站我会贴到视频的简介里面一个登录的,如果你是 windows, 它就会匹配 windows, 如果你是 mac, 它就会下载 macs 的 安装包。然后我刚下了一个,下载完成之后呢,把软件拖到 这里,因为我已经安装了,所以替换一下, ok, 我 已经其实已经有了,如果你是正常的话,现在就可以打开奥拉玛这个软件。然后你会看到这里可以选择各种各样的模型,这后面带云的这个就是云上模型,云端模型也可以用。然后我选的是这个 gpt 一百二十 g 的 云的模型,它会提示让你登录,然后你点这个登录, ok, 呃,我之前已经登录过了,如果你是一个登录界面的话,你可以选择你有的那个账号登录就可以了,很简单。然后现在已经登录了,我说一个你好, ok, 现在是可以用的。这是第一步,我们已经完成了。然后我们来到第二步,打开这个网址,这个网址我也会贴到下方,然后全是英文,看不懂没有关系,也不用翻译,有用的,其实就这几行,就这四行。然后我们首先第一步复制这个代码, copy 一下, 然后搜索终端,打开终端,这是我之前打开过的,打开终端之后粘进去,然后直接回车就行,然后他现在在慢慢安装,然后可以看到这个地方在加载,然后安装速度取决于你的电脑网速。 ok, 第一行代码已经执行完毕,现在我们打开浏览器 开始直进第二行,然后依然是直接回车,然后我们已经到这个页面了,然后现在在键盘的上下左右去切换,按左边选择 yes, 然后回车,然后有一个快速安装,我们点快速安装,就第一个不用选它,直接回车,然后这个这个页面比较重要, 他现在是让你选择是用哪一家的这个服务,然后我们不选,我们选最下面这个,然后我们选第一个,然后这里会有很多这个,然后还不用管,选这个 k 第一个。 ok, 这个地方是让你选用哪一家的聊天软件,因为你需要用聊天软件去跟他沟通,然后这个我们需要选一下,我们选第一个, 然后这里会让你输一个,呃, bot talking, 然后这时候我们先这个页面先放一边,千万不要关掉,然后我们打开我们的聊天软件,然后去搜索 bot father, 这个是之前我已经新建过的,如果你从来没有用过的话,这里应该是一片空白,然后点 start, 这里有很多选项,没有关系,点 new boot, 然后我可以这里是选名字,可以选择一个,好,我选这个名字, ok, 这里再输入你的自定义的,你可以随便自定义一个名字,他说这个不行, 那我们就随便起一个, ok, 这个名字可以,然后记得这一串,这有个 api, 把这一串字母复制一下,这就我们需要的那个 api, 然后直接粘到这个里面回车。 ok, 这里是问你需不需要技能,你可以选择是 然后第一个继续点回车这些技,这些下面就是技能,现在我们不安装,因为这些安装非常的浪费时间,我们直接回车,可以后面慢慢安装,没有关系,回车这个时候我们需要按下空格,然后再回车, 局部这些全,全是 no, 全是 no, 全是 no, ok, 全是 no, 这个也是直接跳过好,按空格再回车,好,到到这一步了可以直接启动,那这一步可以直接回车。好, 需要 u i 依然是回车。呃,如果你是 safari 浏览器的话,可能会失败,所以你要复制到那个 chrome 浏览器里面,然后现在我们就已经进入到了这个 colobot 的 这个后台里面,但是还有一个就是我们还没有给它配置大脑,现在这个页面我们关不关都可以,然后我们再新建一个终端页面, 新建一个窗口,打开我们刚刚那个浏览器,就用这个浏览器,然后翻到第三个,我们继继续复制,然后回车, 这个页面其实就在选择,就选择复制第四行, ok, 这里是让我们选择是用哪个模型,有 g p t, 一 百二十 b 的 模型,还有纤维三,也是四百八十 b 的 云端模型, 这个看你个人习惯,我现在就选这个 g b d, 好 吧,如果你选择的话可以点回车,回车点个叉就是回车,但是一次只能选一个。这个你可以后后面慢慢根据每个模型的不同属性去选,然后你选择,选择完之后,我现在选择一百二十 b 的 模型,选择之后摁 tab, 摁 tab 之后 ctrl 点回车, 这时候他问你是不是要启动这个东西,你现在摁 y 再摁 y 哦, ok, 我 们现在可以直接启动它了。 ok, 已经启动了,然后我们来到这个后台模型问一下。 ok, 已经可以启动了,进入我们刚刚新建的这个 bot 里面,点击 start, 它会发出一串神秘代码。没有关系,我们只需要这个复制这个出来,然后你把这串代码后面的换成你的,然后前面跟我一样就可以,然后复制 粘到,我们可以新建一个窗口,好,回车。好,这样就可以了。 ok, 我 们在这个页面问一下。你好, 出现这个报错的原因是因为刚才在安装过程中,我没有把安装终端给关闭,所以刚才在替换那个模型的时候没有替换成功,因为软件在运行当中,所以我在前面剪辑的时候增加了那个建议关闭的提醒,你把它关闭之后就可以不会出现这个报错。但是如果你出现这个报错之后,可以 把所有终端都关闭,然后新建一个终端,把第四行代码重新执行一下,重新选择一下模型就可以解决。 他能够解决一些比较棘手的问题,尤其是你不在电脑,你可以让他给你发文件啊,这种我觉得还比较实用的。 这个基本上就是可恶 boss 安装的全过程,然后是使用的本地的欧拉巴模型,但是云端的模型,然后如果你有任何不懂或者是有报错或者是没有解决的问题,可以私聊我,或者是在这个评论区下面留言都可以,如果看到的话会尽量帮你解决好,就这样。

2754小马beta 01:44查看AI文稿AI文稿

01:44查看AI文稿AI文稿欢迎观看 openclock 配置教程, 这里给大家准备了一个 json 文件, json 里面已经把调用地址和调用模型以及智能体的模型都已经配置完毕了,只需要在这边填入我们的 a p m 密钥就行。 来到我们站点令牌管理复制密钥, 粘贴好后边保存就能够调用了啊。 保存完之后记得复制这个文件,把文件复制到你安装 open cloud 的 目录下 粘贴过来就行。现在我们就可以运行 open clock, 运行之后在网页中打开就可以正常调用了。 我们再输入一个,用谷歌浏览器打开四三九九试一下, 它也帮我们打开了。 到这里就是本期的教学了。

14jjj2 02:48查看AI文稿AI文稿

02:48查看AI文稿AI文稿你如果用这个 open cloud, 肯定会消耗很多 token, 那 最好的方法就是用免费的模型,这里它就会支持 onigravity。 千问还有 open code, 咱们这里就教一下怎么设置这个 onigravity。 用它里边的免费模型装上了之后就 out bought config, 这里边就点选 logo, 这里边儿选 model, 这个再选里边儿的模型。因为 onigravity 是 谷歌的,所以这里边儿选谷歌,选 onigravity。 当然你可以选这个 google gemini c l l, 这个也是因为 gemini c l l 也是免费的,但是 onigravity 它有更多模型,包括 cloud code 的 模型,还有 gemini 的 模型,所以这个 咱们选 onigravity, 它会跳一个网页让认证,所以这里你就选你的谷歌账号儿就可以了。 三音这很快就认证成功了,就可以选模型了。这里它选的模型比较多,所以就会需要一直往下拉, 它在谷歌 on the gravity 里边往下走,走走走,这是 coco 的 get up, 对, 这里就是大家可以看到谷歌 on the gradient。 我 这里边是把谷歌 on the gradient 下边的模型全都选了之后选,直接按空格就可以选和反选, 选完之后按那个回车就可以选定了,这里话直接跟 t 钮,然后它结束之后就可以自动地使用 anti gravity 模型了。这样 clubbot open cloud 就 可以免费使用 anti gravity 里边的 cocoon 了,就不用自己买 cocoon。 当然你可能配置完之后想选自己的首选模型,因为 integrative 里边儿有很多模型,咱们可以在这里边儿配置。在这个尼加目录点 cloud bot, cloud bot, 点 jason, 我 这里边儿直接打开,咱们就往下走,这里边儿你可以看 a 阵词,下边儿这有一个 default, 这就是你默认用的模型,这里有个 primary, 就是 它首选的模型。就是啊, google on the gravity 里边儿这个 color whoops, 四点儿五 thinking, 这个比较慢,所以我想要把它改成 gemini flash 这个模型,咱们呢? sun flash 对 这个模型会比较快,所以我想把它改成这个模型,当然你可以自己改,它就会首先尝试的模型是这个,如果不行,它会用 fallback。 这边的模型我现在已经改好了,之后我就可以保存重启一下 clubbot, 它就可以 clubbot play the gateway start, 我 又拼错,然后这就重启了,就可以开始用我新设置的这个 drama 三 flash 这个模型了。咱们看一下它具体的情况, 你就会看到你的模型已经开始用。呃,首选模型,这个有时候它算比较慢,但是总体来说它会遵循你的配置的。今天就到这来谢谢大家,希望可以帮到你们。

3431AI鹅鹅鹅 05:05查看AI文稿AI文稿

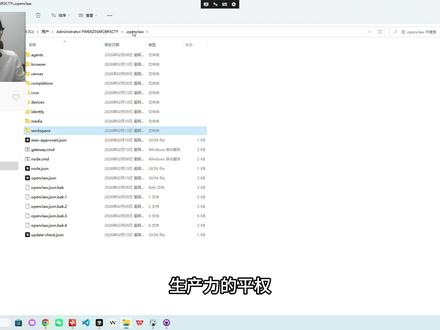

05:05查看AI文稿AI文稿生产一个平权一定会把想象力和创造力的价值推向巅峰。分享一下最近很火的这个 openclaw, 我 用了大概有一周的时间,这个 openclaw 安装比较简单, windows 或者 linux 都可以安装。 安装好以后,我们首先是进入文件夹,然后 openclaw on board 的 命令,我们可以进行一些初步化的配置。这个里面最主要的就是模型选型,我目前用的是 mini max 的 api, 这个模型选型主要就是选一个啊,首先是多模态的模型,第二是它应用工具的能力会比较好,因为 openclaw 主要就是靠接入各种 skills 去扩展它的能力,所以模型选型的时候尽量选一个功能比较完善的。我现在用的是 mini max i m。 二点一, 这步完成以后,进入 openclaw 的 dashboard 就 可以开始跟它进行交流,就是网页版的交流,如果进入 openclaw 的 ui, 就是 命令行的交流。 第二一点就是移动端的配置,目前国内我用的是非书去跟这个 oppo 做交互是比较简单,这一部分技术爬爬虾里面有一个详细的视频教程, 就按照他的流程去做就可以。我目前进入以后,包括定时给我推送信息,以及控制我的电脑完成一些任务,监控任务的一个进度他都是可以完成的。 这一部分是我认为非常方便,但是也会有安全隐患的地方。我如果让它能够呃很好的操作我的电脑,我肯定要给它开一些很高的权限,包括打开网页,执行命令等等。第三一点就是 这个 skills 就是 openclaw 它功能实现的一个主要方式就是它接入了很多 skills, 我 目前是直接装在 windows 里了,我们进入这个点 openclaw 的 文件夹里面,它有 workspace, 在这个里面就是它 skills 的 来源。我认为主要有三个途径,第一个途径就是 opencloud 自带的一些 skills。 第二个就是通过 cloudhub 或者 github 会不断地有人去分享 skills, 你 可以克隆到本地去配置运行,当然这整个过程都可以交给 ai 自己去完成,只是看你有什么样的需求。而第三一个就是 自己去根据自己的比如工作需求,或者说平时日常业务上的需求去写一些自定义的 skills, 通过一个简单的提示或者一个简单的命令,就可以调动 skills 去完成一个很复杂的流程,这个是我觉得它最凸显它价值的地方 啊。我认为如果我们做很高难度的任务,很有创新性,或者说工作量很大的代码任务,我们还可以在科室或者 cloud code 等等这个里面去完成。但是对于一些 呃事务性的工作,比如说报销,比如说填写工作日等等发送邮件这一类的事务性的工作,我们其实都可以交给 opencloud 来完成。 下一点说 opencloud 的 这个七乘二十四小时的工作,因为我看到我一直在以七乘二十四小时的这个概念来宣传它,我也去验证一下它这个七乘二十四小时。更多的是说 opencloud 的 这个服务它可以长时间的运行, 但是对于一个具体的事物,或者说一个单一的任务,它能不能持续的运行,更主要的是看你的工作流程,或者说你的程序是不是需要它持续不断的运行,而不是说 opencll 二十四小时的去思考,去完成工作,大部分时间它是待命的状态。可以说是 关于 opencll 的。 我的两个个人观点就是,第一个 opencll 的 诞生,它是一个权力的交接,就是 opencll 逐步从人的手中获取权力。 比如说我如果不给我电脑,不给 open color 开任何对于我电脑的操作权限,那其实 open color 的 能力是非常非常有限的。但如果我把整个电脑交给 open color, 那 它的可能性,它的能力是无穷无尽,肯定是远超于我的 安全防范。对于 open color 来说,我觉得更像是一个伪命题。如果我们逐步的开通权限,其实就是逐步的降低我们的这个信息的安全性,但是也逐步的提升 open color 的 能力。 所以我们将任务交接给 opencloud 的 这个过程中,其实 opencloud 的 这个社会和我们怎么说人类的社会,它已经是逐步隔离的了,那在这个过程中,我们唯一可以做的可能就是一个监督,通过另外一套体系去监督 opencloud, 但是这这一个平衡要怎么去找到,是不是能达到这个效果,我觉得这都是一个非常值得探索和讨论的问题。 第二个观点,我认为现在并不是一个去论证 openclaw 好 不好用,或者说它是不是有能力边界的时候,而是应该在我们自己的任务或者自己的工作中去不断地探索 openclaw 的 可能性。 因为现在刚是二零二六年二月份,就等于说这一年刚刚开始,对于未来十个月这个 ai 会发生什么,以及 openclaw 这个模式的 agent 会 带来怎样的迭代,其实我们任何人都无法预测,所以我们没有必要去否定冯克劳,或者说因为一些顾虑而彻底的否定这种可能性,而是我们在结合自己的业务去不断探索他到底能做到什么程度,到底能不能帮我们去完成工作。 最后我想说,生产一个平权一定会把想象力和创造力的价值推向巅峰,所以希望大家尽情享受这个时代。

88小k 02:48查看AI文稿AI文稿

02:48查看AI文稿AI文稿在 openclaw 当中,如何免费地使用顶级大模型呢?我们知道 openclaw 本身是比较消耗 talking 的, 原因是在于当你和 openclaw 聊天的时候,它会使用上下文的 talking 调用大模型,从而导致我们使用 openclaw 会消耗大量的 talking。 问题来了,免费的大模型不好用,付费的大模型又用不起,那有没有折中的方案可以让我免费的使用顶级的大模型啊?答案还真有,那么接下来就给大家分享一个价值几千甚至上万的方式,可以让你免费的使用大模型,少花很多钱,所以大家先点赞再观看吧。那么怎么免费用啊?这里呢就给大家去说一下。 我们只需要去 n 平台,然后 n 平台里面是提供了很多顶级的大模型的,而这些大模型都是可以免费去调用的, 大家来看看都有哪些啊?比如说像国内的顶级的 mini max 最新版二点一可以免费的调用,还有像智普的四点七的满血版也可以免费调用。那么像 deep sync, 三点二、 kimi 等模型更不用说了,全部都是免费的。那么我们只需要去 n 平台申请一个 api k, 有 了这个 api k 之后呢,接下来将这个 api k 的 方式使用 open a 的 方式啊,配置到你的龙虾的配置文件里面就行了。 龙虾的配置文件在哪呢?给大家说一下啊。龙虾的配置文件呢,是在当前的用户底下有一个 opencloud 的 文件夹,然后在这个文件夹底下呢,有一个 opencloud 的 json, 然后这时候打开你的 json 啊,因为它内置是不支持这个平台的部署的,所以我们手动去配置它就行了。 手动配置呢,总共有三处地方啊,那么第一个地方呢,就是咱们在 models 供应商里面去添加一个名称,这个名称呢,其实叫啥都无所谓啊,只要后面和咱们的 agent 去对应起来就行了。然后在里面呢, ok, 去写他们家的地址。然后呢,重点这块来了,要去写你的 api k 的 换成你自己的, 用 open ai 的 方式进行调用。然后你调的模型是啥啊?那比如说我这儿呢,就是 mini max 二点一的最新版本。好,然后底下呢进行一个设置啊,这是第一处,先把它进行设置,然后设置完了之后呢,接下来第二处啊,导到你的 agents 里面, 然后将你的 default model 设置成你要调用的模型啊。设置完了之后呢, ok, 在 models 里面同样把这个名称再进行赋值一下就行了。这三个地方全部设置完成之后, ok, 这时候回到咱们的 open cloud 里面,将服务关掉,然后这时候使用命令 open cloud get v 重启你的服务啊。重启完你的服务之后呢,接下来你就可以去问一下你的龙虾你使用的模型到底是啥了。好,那这时候呢,咱们回到龙虾的 使用界面啊,那么咱们去问一下他,我为你设置了新的大模型,告诉我你使用的大模型是啥,咱们来看一下这个大模型 是否是我设置的那个大模型呢?好啊,咱们等待片刻,看到没啊,这就是我设置的 n 公司的 minimax 二点一了,那么到这咱们就可以免费的白嫖顶级的大模型了。我是磊哥,每天分享一个干货内容。

3556磊哥聊AI 04:22查看AI文稿AI文稿

04:22查看AI文稿AI文稿open code 最近真是太火了, github 上已经有九万多 star, 我 估计全球的大模型厂上都在针对 open code 做测试调优。 open code 是 目前真正能凭借 cloud code 的 工具,也是二零二六年到目前为止最火的 ai 工具。 open code 呢,目前只提供了英文文档,我按照其英文的文档,同时结合了 cloud code 的 学习资料,梳理了一份详细的 open code 的 中文操作手册,包括安装 基础操作、进阶使用等,如果你需要,我也可以发给你。上期呢,根据文档手把手带大家安装了 open code, 相信很多朋友已经感受到了它的强大。本期是 open code 的 第二期,主要带你完成三件事,一、免费进入最强编程模型 gemini 与 cloud。 二、教你安装 skills 与 m c p。 三、安装超级增强插件 all my open code。 话不多说,直接上干货。首先先教大家如何不花一分钱接入 cloud 模型。这里我们要接入一个 google 推出的工具 anti gravity, 中文名是反重力,它本身呢是一个 ai 编程的 ide, 内置了 gem 和 cloud 的 这两个顶级的模型。 在 gethelp 上找到 anti gui 的 这个插件,复制这行安装指令,回到 open code 里粘贴 open code 呢,就会自动下载安装。安装完成后,重新打开终端,复制这行指令回车。 然后我们选择 google, 选择带有 anti gui 字样的这行回车,接着就会跳转到浏览器,登录自己的 google 账号,复制这个 url, 粘贴到终端回车。这样我们就配置完成了。 重新打开一个终端,进入 opencode, 输入 gunmodels, 我 们就能看到 gemini 三 pro 和 cloud 四点五 opus 的 这两个模型了。我们测试一下输入,介绍一下你自己可以看到它正常的输出,证明我们接入成功了。 从现在开始,全是顶级大脑在为你打工,有了顶级大脑呢,还得有强力的四肢。接下来我们要给 opencode 装上它最火的灵魂同版包 oh my opencode, 它内置了七个顶级的编程 agent, 通过多智能体分工协助,帮你自动完成写代码,查 bug, 梳理项目结构的这些开发工作,不用再手动处理很多繁琐的细节。据说呢,是作者花了二点四万美金才搞出来的。安装呢也很简单, 复制 github 上的安装指令丢给 opencode, 它会询问你是否有 cloud 的 gpt 和 jimmy 的 会员啊,你就如实的回答,大概需要一分钟的时间,插件就安装好了。 重启 open code, 可以 使用艾特命令,从七大智能体中挑选一个帮你执行任务。或者呢,直接在提示词里呢输入 u l w, 意思呢就是 ultra work 就 可以使用 oh my open code。 接下来教大家如何在 open code 中使用 scales, open code 呢,可以无缝衔接 cloud code 的 创建的 scales。 首先来到根目录,新建一个文件夹,命名为点 opencode, 再新建一个 scales 的 子文件夹。然后呢,把你的 scale 复制到这个文件夹,就可以在 opencode 中使用了。当然,我们也可以直接在 opencode 中创建 scale, 需要先安装 scale 杠 creator, 有 了它就可以用自然语言来创建 scale。 我 们让 opencode 自己去安装这个 scale 杠 creator。 安装完成后,我们测试一下,让它创建一个翻译功能的 scale, 它会根据你的要求自动执行并创建。创建成功后,重启 open code 就 可以看到这个 skel 已经有了。最后呢是配置 mcp, 我 一般呢都是让它自己来安装 mcp, 比如安装一个浏览器 mcp, 我 会这样在这个 open code 中输入安装 chrome mcp server, 稍等一会它就安装成功了。有些 mcp 呢,需要配置 k, 我 们也可以把 k 给他,让他自己去配置,这样我们就不需要自己去手动去配置了。 然后输入杠 m c p s, 就 能看到所有 m c p。 从白嫖顶级模型到手搓专属 skills, 再到部署全能 m c p, 现在的 open code 应该已经是你的超级 ai 助手。 open code 的 不仅能进行零代码编程,更能帮你处理文件、整理资料,智能写作。下一期我会带大家继续进行进阶的学习,大家点点关注哈,跟着阿亮学 ai!

4204跟着阿亮学AI 02:27查看AI文稿AI文稿

02:27查看AI文稿AI文稿opencall 在 it 圈里火炸,但不管是安装部署还是配置应用,都需要通过命令配置,需要一定的技术功底。不过彼人真是没想到, one panel 竟然可以通过图形化交互的方式快速部署,还能配置飞书。通过飞书调用 open call 运行 open call 需要先有台服务器,我们就用腾讯云服务器演示,服务器的系统是优班图二十四系统,并且已经安装了 one panel。 one panel 的 安装就不演示了,在官网的一条命令就可以安装登录 one panel。 one panel 新增了一个智能体管理的功能, 目前的智能体就是欧芬科啊,以后有新的智能体也会添加到这里。在模型账号这里,先创建一个模型的账号,后面创建智能体,直接使用这里的账号就行了,不需要每次部署智能体都填一遍账号。现在创建智能体 模型供应商就选择刚才创建的 deepstack 账号就行了,下面都不需要修改,直接确认安装 one pass, 把一键部署做到了极致。 部署完成后,点击 y b y, 直接跳转到 open, 自动拼接好登录地址, 只能部署没啥意义。我们演示一下通过 winpal 配置飞书有多方便。点击配置,选择聊天渠道, winpal 中只需要配置飞书机器人的名称和应用 app id, 应用 app secret 就 行了。那飞书怎么配置呢?根据 winpal 提供的参考文档,先打开飞书开放平台。第一步,创建应用,配置应用的相关信息, 添加应用能力,这里添加机器人,并给机器人取个名字。第二步,在权限管理这里,批量导入权限,复制参考文档里的权限, jason 覆盖粘贴,点击下一步申请开通。 第三步,复制应用的 app id 和 app c 捆,粘贴到 one 盘的对应位置。机器人名称就是创建机器人取的名字,点击保存,现在回到飞书开放平台。第四步,点击事件与回调编辑订阅方式,默认使用长链接保存添加事件,复制参考文档里的事件, 勾选确认添加至此配置完成,最后发布应用版本就行了。在飞书的群里添加机器人,选择创建的这个机器人,就可以在群里艾特他对话了, 也可以单独对话,让他创建一个代办事项。在 open 可拉中可以看到执行过程,随后飞书也返回了执行结果,你也可以查看他在飞书能干的所有事。那你有没有更好玩的场景,欢迎评论交流。

161小北AI开源 09:44查看AI文稿AI文稿

09:44查看AI文稿AI文稿大家好,我是根古,今天是 open core 的 第五堂课啊,这堂课分享一下本地的模型配置教程。那前几次课,呃,我们分享了一下这个 open core 的 两个大坑呃,然后一个环境搭建的一个视频啊,最后还给大家演示了一下如何控制浏览器的一个配置。 呃,这堂课给大家分享一下,如果你你的电脑配置本身是比较强大的,那你就没有必要去用那个消耗那个外部的那个一个收费的托管把本地部署这个模型啊,这篇是欧拉玛篇 啊,欧莱玛是一个管理本地的一个大模型的这样一个程序啊,这是一个程序,其实大家还可能用过其他的,就是微软那个 lm studio。 lm studio 其实也是可以的啊,因为欧莱玛这个和那个 open color 它的兼容性配置会比较好。我给大家演示一下我配置的效果啊,我这里输入一下,你是谁啊?你是用的哪个模型啊? 他用的是这个 gbtos 二十 b 的 这样一个模型啊,也就是我这里配置的欧拉玛的这样一个。这个这个啊,呃,首先我给大家介绍一下怎么样可配置啊,前提是你已经装好了 open clone, 如果大家不不知道如何去配置 open clone 的 话,可以看我前面的前两次的视频。那首先你要打开这个欧拉玛点 com 点那么空的话,你先当漏了这个,这里会有三个版本,那你你如果是 windows 和 os, 苹果 os 都可以选择啊,建议大家是用 windows 或者是用 mac os 都可以的。然后你把它下下来了以后 直接就装好了,装好了它会进入一个这样的页面,这个页面本身没有啥,就是他进来的时候这里是没有模型的,你需要选一下。这个就是我,我本地已经下载了两个模型,一个是千万三的八 b, 一个是这个 gbt 的 o s 的 二十 b, 如果你要下其他的,直接点下载这个,呃,参数越大的就是一百二十 b, 我 估计我的电脑也跑不了。建议大家一般选八 b 的 或者二十 b 的 就好了。嗯,然后你你点击下载它就会,它就会进入漫长的下载啊,这一段,呃,可能需要魔法上网。 你好啊,这样就已经通了是吧?这已经通了,通了以后,实际上,实际上他是把那个模型下到你本地啊,通过欧拉玛进行管理,实际上他就是一个面向开发者的一个管理啊。这里你看把它翻到下面呢,就是再回回,回过头来翻到下面呢,你看这里有一个,呃,超过四千四万个应用都能够对接,你看这个就有一个 open code 啊, 你看一把 open cologne, 已经对对接了,你打开这个,哎,他告诉了你前两个是你没装 open cologne 的, 这两两步已经是,呃,前两堂课已经装了,是吧?然后,然后假设你已经跑通了,但是呢,我用的是可能是紧密来模型,那我应该怎么配置呢? 其实也不难了,第一步,第一步不是要去启动这个,第一步是要你在这里去进行配置他,他这个欧拉玛 launch open color 就 相当于是 open color, 呃, start gateway 啊,启动网关。所以说如果你本身已经运行了 open color 了,用那个线上的,你应该把它这个关掉。这里我有一些这个教程啊,就是 把它先杀死掉啊,就是他抽风的时候把它杀死掉。这个 kill 这个所有的进程也可以啊,就是把它全杀了,我就给他演示一下, 打开一个新的命令行窗口,你把它 open call 杀掉,杀掉的话,他他其实,哎,他就访问不了了。看到了,访问不了了以后你就去呃,就是运运,运行这一行啊, 运行这一行,当然你现在还没有配置,所以说是不行的。第一步就是你应该先下载模型,下载模型以后,这里通了以后,说明本地的模型和欧拉玛已经呃他,他已经管理好了这个模型,管理好了模型就应该去呃去,这样做,这样做, 就这样子,你先把这个 open 呃欧拉玛这样一个服务骑起来,骑起来了以后,呃,就可以,幺二七点零点零幺二八,就这里就可以。呃, 在这网页这个窗口进行配置啊,就可以不用命令行,如果你对命令行很熟的话,其实可以用。呃,可以,可以用,我前堂课跟你分享的那个,就是 openclo 这样一个 on board 的 这个 excel, 这个是可以配置的,但是最好能够。哎,这个地方它有个配置选项,一个 config, 这个咖啡啊,咖啡里面你选到一个模型,这个 model 式, model 式, model 式里面有个 prologue 字, prologue 字的时候,这里面,哎,这里面你,你开始是空的,你这里随便取个名字都无所谓啊。这个这个欧莱玛你随便取的都可以。这里的话它是兼容 open ai 的 一个 compilers, 一定要选这个, 这个 ai key 你 不要去呃,随便选都可以啊,为什么呢?因为你这个欧莱玛这里是没有这个教验的,那就是这个欧莱玛这个 set 里面 来打开这个地方,就是欧拉玛一个三体里面,你可以,你是把它关掉了,就是这个,这个选项一一个是 pos, 欧拉玛 to like work, 需要把它打开啊,需要把它打开, 这个地方是不需要学 api key 交易的,因为你是本地模型了,你随便输都可以的啊。所以说这个地方把它打开,这个地方最关键的地方来了,呃,这个幺二七点一点一四三就可以随便选了, 其他地方可以随便选这个地方,呃,这个点 a p s 也也也需要这样,对,然后 max 头肯,其他的都我觉得无所谓,这个地方空着也行,你你把它设置一个很大的字也行。 呃,还有一个最最关键的,就这个 id, mod id, 这个 mod id 就是 一定是要在这里,我,我知道了,这个地方看,就是如果你找不到这个配置文件,应该从这里看,他有个 com figure 文件,也就是这个地方,这个地方,呃,这个 它有一个这个欧拉玛的配置选项,这个,呃,去配置这个登录像,它有个这个就是你,你下了,比如说我下了两个模型,然后你应该管理模型的时候,你应该哎这个啊, 然后把这个复制一下,欧拉玛 launch 是 吧?欧拉玛 launch, 这个,这个,这个很重要,因为你看这里面是我本地选择的,这个 x 就是 我默认的是,就是 jptos, 或者我这里下了这个,如果你下了其他的,他会在这里列出来。这里还有 glm 四点七 flash 是 吧?千万八币是吧?我选择的是这个,因为这个还是比较好用的,所以说选择了以后你就把这个复制出来, 复复制出来过就好了。好,然后这个地方把它复制出来,把它粘过来。如果你是选择别的模型,就是塞别的模型,这里有个小小的坑呢。他这个地方推荐的模型有这些千文山扣的 glm 四点七, gptos 二点零二二二十 b。 对, 如果你选的是别的模型,我试过他不知道为什么连不上啊,这就是他一个巨大的坑。这里这里有一个,你看这个是可以用的,然后还有一个千万三的扣的,这个也是可以用。这有个扣的三十 b 也是可以用的。还有一个清华紫光的。那他这里竟然没有啊。这里没有,这里没有, 所以说这这也是他一个做的不好的地方啊。就是就是,除了这几个,我想用别的,我不知道为什么会出出错啊。会出错,可能是他的一个 bug 吧。 然后配置好了以后,配置好了以后你再往下翻呢。这这个地方 test 的 和 emoji 一定要是选 test, 我 们这里没有 emoji 啊。那最后这个这个名字可以随便取啊,这念你也可以跟他取的 id 一 样的。那完了以后就 save, save 了以后刷新一下, 刷新一下就点 check, 然后再你又再再另一个筛选呢,你说你好随随便输入,他如果有反应呢?那就是配置成功了,当然这个地方你还需要重新启动一下,你看这个地方他需要重重启一下。呃,就配置完了以后这个地方需要重启,也就是这个地方你配置完了应该再给浪去一下。 我试试看浪去一下。哎,奇怪,这个复制一下, 那如果出现了这种卡死的情况啊。啊,这已经好了,对吧?嗨,这个我我帮助你,但你你会,请和我就是用中文,用中文,和我用中文与我沟通。您是谁 啊?他肯定是我是欧巴马,是吧?这样一个 gpt 啊,这是 open call 的 助手啊,您是用的这个 gpt? 看,我是用的欧巴马的这样一个 这个 gpt。 还有一种情况就是有 bug, 就是 你这个配置文件,我无论怎么改,改不动了,怎么办呢?然后呢?有办法,就是他的有一个配置文件,这个配置文件是这个玩意,这个配置文件的路径就是在这个呃,加目录下的点 open, 也就是他的路径,这里也也是一个坑啊。但是一般来说你是不需要走到这里的, 就这个这个路径是在你的加目录,比如说你 cd 加目录,加目录下的有一个点啊,点 open 这样一个,这是他所有的配置文件, 这里面的这一个玩意儿就是 open curl json 格式,那这些是它的备份,不用管,这个就是它的一个配置文件,你所有的配置文件都是想改这个 json, 那 你把它这个 打开来,用 v s code 打开来,你可以看到第一行就是 ajax, 这里就是之前讲的主力模型,你主力模型塞的是 jimi 二点五 flag, 那 就是主力模型,这个它自动的就能够连到这个这个外网,是吧? api 进行调用。如果你把它 改成这个欧拉玛,这个本地的,那就是本地的。如果你是微软的 lm studio, 微软 lm studio 它也可以。然后这里非常重要,非常重要,在这个地方它有一个叫模型管理,这个模型管理非常重要,你刚刚加一个这个欧拉玛,它就会出现一个这样一个, 呃,节省的这样一个很大的这样一个对象,你去改它这个地方非常重要,就是 http, 幺幺四三四零号,你,你这里就应该是改,你也可以改这个端口, 看这个端端口其他的就没有啥了,其他就没有啥了。那就如果这个幺幺四三四被占用了,你可以看这个这个端口是不是被占用了,也可以这么看,就你像占不占用,哎,他占用的,他占用的,他这里都是欧拉玛,也就是他是用的幺幺四三四,幺幺四三四,所以说你这个端口就是用幺幺四三四。 然后其实大家还是要经常去摸索的,因为这个里面,呃,他的配置像啊,和那个那个欧拉玛这个这个对接啊,这个流程并不是非常好用,因为他也没有哪里进行跟你先调试啊,就是只能在这个窗口进行调试,那最重要的就是这个配置像,如果大家配置像这里玩明白了, 也不需要去这里去改这个地方。呃,所以说这堂课就分享到这里,你学会了吗?

129根谷老师 01:02查看AI文稿AI文稿

01:02查看AI文稿AI文稿本期视频教大家如何一键本地部署 openclock, 这样我们的电脑就多了一个 ai 助手,具备智能和自主意识,拥有社交网络和相关创造, 这个大模型不仅具备超强记忆力,还能通过手机遥控指挥。首先准备一个汽油加速器,进入后先点击右上角的小方块,选择口令进入,输入九百九十八白嫖最高一个月的加速时长。接着搜索 openclock, 进入后点击一键加速,等待加速完成后 点击右侧的一键部署,选择两个安装位置名称,注意一下不要有中文,等待几分钟让它自动部署。要是后续需要卸载的话, 只需要删除这两个对应文件即可。接着点击开始极速配置,等待一会授权,千万会自动拉起浏览器登录,千万没账号的兄弟们,使用国内的邮箱注册一个就行。流程还是蛮简单的, 填写完成去对应的邮箱激活即可完成授权,这样就部署成功了。然后点击开始对话,这样就完成了 overclock 本地部署。那么本期视频就到这,我们下期再见。

06:08查看AI文稿AI文稿

06:08查看AI文稿AI文稿因为我的工作室啊,对 opencloud 的 这个需求是非常的实际的,就是我希望他能帮我干活,但实际上呢,我弄完之后发现好像离想象中还是差不少的。先给大家讲讲我的一个感受吧,先看一下我的设备。 呃,这是我的 mac mini, 就 放在路由器的旁边,然后通过远程的,这个是屏幕共享来去控制那个 mac mini 的 上面跑的 open 卡拉的系。呃,这个,这个功能啊, 还有一个就是命令行工具,不管是在局域网还是在外网啊,都是通过这两个工具来去。呃,远程的做一些设置,这个是飞出的工具啊,连接的 opencloud, 一些沟通啊,和一些交流啊,就通过这个飞书来去做。同时呢,我除了自己搭了 open 可乐之外,就本地化的 open 可乐之外呢,我还搭了一个 kimi 的 云端的 open 可乐,通过飞书连接的 kimi 的 open 可乐。这个是购买的 kimi 的 一个服务, 价格也也不少啊,买了买了一个月试一下。呃,云端的 open 可乐像阿里啊,还有腾讯吧,还有 kimi。 好 像。对,都推出了云端的 open 可乐,但是我觉得肯定是没有在 本地 mac mini 上面跑,它的来的权限和使用的场景来去更加完美一些。那我弄了一段时间的 open color 之后呢,发现了一些问题,就给大家分享一下。首先呢, open color 呢,我觉得它作为一个非常好的智能体啊,它是像扣子这样的一些智能体的一个升级版, 以及更加完美的实现了更深度的应用。呃,我觉得它的完善度现在是非常非常高了, 在 ai 生态的 ai 生态链的这个链条当中, open collab 这一环我觉得做的很不错,但是 ai 生态链的上游和下游现在还有很多需要弥补和完善的地方。 上游的话呢,主要指的是第一个啊,就是 ai 大 模型,因为你装了 open collab 之后,并不是说就可以立马使用了,你还需要装,你还需要接入 ai 大 模型,这个费用和接入的成本 其实都偏高,而且呢,你有时候不止借一个,对吧?你还要借很多个来去切换的使用,才会比较好的来去弄。 当然呢,你借多了之后呢,那这个费用就变高了。另外一个就是有了 ai 大 模型之后,它也不能干活,它也不能够干活,你还需要装很多的,呃,智能企业以及 skill。 那 scale 呢?里边呢,有大量的 api 的 接入,而 api 的 接入,那这些 api 呢,都是需要收费的,很多很多都是需要收费的,同时找靠谱的 scale 和 api 也是一个非常花精力非常浪费时间的一件事情。 当然我说的这两点啊,都和 open 浏览器,你装了很多插件, 那插件呢,也需要收费,对吧?它也是本质上也是 a p a。 但是呢, open cola 呢,作为一个可以操作电脑的这样的一个工具,它对于操作系统要求的本身是比较高的,而目前呢,市面上还没有针对于 open cola 所推出的操作系统 和那个苹果呀,或者说 mac 这种系统啊,对于 open cola 的 支持也比较差,因为如果你想要实现 open cola 的 更多的功能, 那么你对于系统的权限的要求比较高,但是这种面向用户的操作系统,它的权限的设置都是针对于用户的,而不是针对于脚本 和这个呃程序的,所以它有很多的限制,比如说我让 oppo 可乐给我截张图给我, 他这个就会非常非常的麻烦呃,所以在想操作电脑来实现更多的生产力的应用的话, oppo 可乐, 呃他受到的操作系统的支持目前还是不够的,操作系统需要完善,所以这就是关于欧芬考拉在 ai 生态链里边,上下游关系当中,上游这一部分还有很多不完善的地,费用也高,设置也麻烦 啊,以及生态还不够全面,都给 open collab 的 使用带来了很多的不便利性。那其次就是下游了,下游主要指指的是针对用户了啊,虽然说安装 open collab 就是 一句话的事儿,但是后续的很多的调整设置、 接入以及最关键的是费用会非常的高的,因为你大模型的费用, scale api 的 费用啊,以及你购买各种服务的费用,这个我觉得应该是一个天价。如果你想把视频编程 啊,图片处理啊,以及比如说财经炒股,所有的东西都想集中在一起,然后来实现这个功能, 哇,那这个事我觉得太麻烦了,毕竟 open collab 它如果想要操作桌面端的客户端来实现像人的操作的话, 系统的支持就是操作系统的支持又不够,所以导致呢?现在 open collab 在 使用的时候,它本身 这个理念和产品很不错,但是又缺少生态的支持和大量的费用,所以导致 oppo 可乐在现在呢使用上面还是差那么一点点,因为工作室在使用的时候,呃,就是把 oppo 可乐想当成生产力工具再去用的,但是其实 现在 oppo 可乐在使用上面没有像科斯特这样的垂直类应用的啊,智能起来的使用的更加方便一些。没有那么方便啊。 呃,这是我的感受吧,如果说你是 oppo 可乐的高级玩家啊,我是一个小白了。嗯,那你也可以给我指点一下,你告诉我 oppo 可乐怎么用,反正我是希望说让它更好的使用,给我干更多的活,这个才是一个王道。

33大李同学 05:04查看AI文稿AI文稿

05:04查看AI文稿AI文稿hey, 各位开发者,想不想白嫖?谷歌最强的 ai 模型,而且还是直接在你的编辑室里用,今天我就带你解说这个神操作,让你在 open code 里免费用上 gemini 三 pro。 没错,你没听错,我说的就是那个最新最强的 gemini 三 pro, 而且是真的一分钱都不用花!是不是觉得,嗯?这怎么可能?别急,看完这个你就知道其中的奥秘了。 那这到底是怎么做到的呢?秘诀啊,其实就藏在一个给 open code 量身定做的小插件儿里。 好,那咱们就来看看这个关键的插件儿,它的名字叫 open code 杠 t gravity 杠 os, 你 就可以把它想象成一把万能钥匙,它的作用就是帮你打开一个特殊的通道,让你能在自己的 open code 环境里直接免费的用上谷歌的 gemine 三 pro, 还有其他的一些高级模型。 行,那咱们先说最简单最快的方法,我管它叫俩人包。方法就是这个代理安装,顾名思义,就是让 opencode 的 智能代理帮你把所有事都干了。具体怎么做呢?其实超级简单, 你只要给 opencode 自带的那个 ai 助手,也就是 agent 发一条指令就行了, 剩下的什么安装啊、配置啊,他全都会自动帮你搞定。关键的关键就是屏幕上你看到的这段提示词, 哎,你别自己手打啊,容易出错。我已经把这一整段指令原封不动的放在了下方的说明区, 你直接去复制,然后粘贴给你的 open code 的 代理发送发送。记住啊,一定要完完整整地复制,一个字都别错,这样它才能帮你把所有步骤都执行到位。 好,等代理跑完之后,还有个特别重要的一点要提醒你,就是之后你在选模型的时候,一定要找那些名字前面带 anti gravity 前缀的。看清楚了,只有选这些,你用的才是咱们刚刚搭好的这个免费通道。 ok, 那 如果你是喜欢自己动手丰衣足食的类型,或者说万一刚才那个代理安装出了点什么小问题,那咱们就来看看。第二种方法,手动配置。放心,也不复杂,就三步,保证让你对整个设置过程明明白白。 你看,就这三步,先添加擦剪,然后做个认证,最后把模型加上去,咱们一个一个来 来。第一步,你先得找到 opencode 的 配置文件,这个文件在哪呢?一般就在这个路径下面,斜杠 pmp, 斜杠 config, 斜杠 opencode, 斜杠 opencode。 点 json, 你 用编辑器打开它,我们就要往里面加点东西。 打开这个 json 文件之后,你找一下里边儿有没有一个叫 plugin 的 地方,它应该是个数组,要是没有呢?你就自己建一个, 然后把屏幕上这行 open code dash, anti gravity author at latest 加到这个数组里面去。这一下 open code 就 知道要去加载咱们这个插件了。 好,第一步,搞定保存文件,然后第二步,认证,这个更简单,你打开终端,直接敲这个命令, open code off login 回车,它会带着你走完认证流程。很快的。 行,两步都完成了,现在是最后一步,也是最关键的一步了,咱们再把刚才那个配置文件打开, 对,还是那个西点 open code jason, 我 们要把模型的定义给它加上,这一步呢,你需要加一大段儿模型的定义代码儿,别担心,跟之前一样,这整块 jason 代码儿我也给你准备好了,放在了下方的说明区里,有个官方文档的连接, 你就去把那一大块代码完整的复制下来,然后粘到你配置文件里一个叫 provider 的 部分。粘完之后,你最好检查一下,看看里面是不是有像 anti gravity、 gemini、 three pro 这样的模型名字,只要看到了,那就说明你成功了。 好了,到这里基本上就大功告成了。不过在你摩拳擦掌准备大干一场之前,有几个重要的限制咱们得先说清楚, 这很重要,能帮你避免一些不必要的麻烦。限制其实就两条,很简单,第一,你可能会碰到速率限制,说白了就是你用的频率不能太高,悠着点用。 第二呢,这个方法主要是给大家做个人开发和学习测试用的,千万别用在正式的商业项目上啊,这点要记住 好了,现在通往世界上最先进 ai 模型之一的大门已经为你免费敞开。那么问题来了,你准备用它来创造点什么呢?

33忘记 02:34查看AI文稿AI文稿

02:34查看AI文稿AI文稿今天教你如何使用 opcode 切换两个大模型,一个是 glm 四点七,一个是国产的千万大模型, opcode 提供的模型供应商有这些,你可以选择你需要的大模型进行切换。首先打开终端,输入这行指令, 可以看到我当前的大模型是 glm 四点七。最下面是让你选择是本地部署还是远程部署,我这里选择本地部署。 紧接着就是让你选择配置的区域,这里选择模型配置。再接下来就是进入到了模型列表界面,这也提供了很多的模型供应商, 因为我已经配置了 g m 四点七,所以我这里选择千问来进行配置。每一个模型后面都有写是进行授权登录,还是说通过年提 api 进行登录。 我们选中千问后回车,然后确认一下,会弹出一个浏览器的网页,我们点击一下授权的确认按钮, 认证成功后就可以回到命令行界面进行下一步的操作。在这个模型列表一页,他默认其实已经把纤维模型给选中了,我们可以往下滑找到纤维模型,确认一下是不是选中状态,也可以直接按回车进行到下一步。我这里已经看到纤维模型已经被选中了,我直接回车进行到下一步。 这个时候千万模型其实已经配置好了,我们点击键盘上的 esc 退出界面,然后再重新输入刚才的命令,确认一下是不是当前模型变成了千万模型。 我们输入键盘的 esc 退出后输入这个命令,打开浏览器界面,我们点击右下角的按钮,创建一个新的绘画,然后输入一个问题,你是哪个大模型?他的回复是同意千万模型。到此,整个切换模型的步骤就完成了,接下来我要切回到 g l m 四点七, 然后演示一下如何黏贴 api k。 前面步骤和刚才的千万大模型都是一样的,只不过是模型授权的方式不一样, 刚才是通过浏览器登录授权,现在是需要去对应的模型官方获取 api k 之后粘贴进来,选择 glm 四,点击这个模型之后,回车之后它会提示我要去黏贴 api k, 一 般都是登录官网找到 api k 管理页面,然后黏贴一下 api k, 身后的步骤和刚才千万模型的配置一样,我们直接回车就配置完成了。输入这个命令之后,我们可以看到当前的模型已经变成了 g l m 四点七。入这个命令之后,我们打开浏览器网页,在绘画窗口输入你是哪个大模型, 这个时候已经切换到 g l m 四点七了,整个过程就是这样,有需要的小伙伴快去试一试吧,这里是 ai 共生格,我们下期见。

323AI共生阁 14:34查看AI文稿AI文稿

14:34查看AI文稿AI文稿最近大家都看到互联网上对一款名为 cloud bot 的 自主 ai 代理程序疯狂热议,它运行在你的电脑上,现在已经更名为 opencloud。 对 于还不了解 opencloud 的 人来说,它是一款自主 ai 代理程序, 是一个自托管的代理运行环境和消息路由器,能够作为个人 ai 助手直接在你的本地电脑上运行。 比如说这个 opencloud 机器人可以直接根据在 twitter 上发布的推文构建一个全站应用。你只需要在 twitter 上 at opencloud 代理,它就会为你搭建出带有数据库、认证系统、实时同步等众多功能组建的应用。 它会不断优化利用多个子代理修复错误并持续迭代,直到你获得最佳结果。这都要归功于 opencloud 的 专用子代理。这里是我自己的演示, 我在 opencloud 的 视频中展示过。在这个演示中,我在本地桌面上部署了由 opencloud 控制的多个子代理, 用来清理和整理我的文件,结果它的处理速度出乎意料的快。但所有这些都让我开始思考,我究竟该如何更好地使用 opencloud 呢?有没有办法在其中免费使用更强大的模型,比如 oppo 四点六、 k 二点五, 甚至是 gemini? 答案是肯定的,这也是我意识到最佳工作流程是将 open code 与 open cloud 集成起来,就像我们之前把 open cloud 和 int gravity 连接在一起一样, 而且其实非常简单。对于还不了解的人来说, open code 是 目前最好的开源 ai 编程助手,直接运行在你的终端中。它的好处在于, 它真的可以读取、编辑并对你的真实代码库进行推理,它可以执行任务。你可以用 group, 还能在多个文件间写作,并且可以选择任何你喜欢的模型。所以它更像是真正的编程队友,而不仅仅是一个聊天框。此外,你还可以在 open code 中免费使用各种模型。但在我们进入这个工作流程之前,还有另一个大家都注意到的问题,那就是 open cloud 的 危险性, 因为它是在本地部署的,可以控制并在你的机器上执行各种工具。一个糟糕的提示或严重的漏洞,可能会在没有任何保护措施的情况下快速修改、删除或泄露文件。 我们都知道,技能可以增强 opencloud 的 子代理,而且像 cloudhub 这样的注册中心展示了你可以多么轻松地安装这些技能。 cloudhub 提供了由第三方社区成员制作的额外技能,但这些技能并不总是安全的。 事实上,有八千个实力直接暴露在互联网上的默认端口上,其中将近一半是社区构建的技能。 这些技能包含只在窃取数据的恶意指令。例如,我现在就在 skill hub 上。如果我浏览一个技能,很多这些技能都经过了社区的审核。表面上看起来很安全,但实际上有些技能可以窃取你的信用卡信息, 甚至是社会保险号码信。这技能被部署得看起来很安全,但在幕后,他们实际上在进行恶意操作,而且总是有解决办法的。因为有一家财富五百强公司 jen digital 推出了新的基础设施,正在推动 ai 安全的前沿发展。 这家公司也是本期视频的赞助商,这是一个完全安全的产品,我之所以这样说,是因为我自己真的用过。他们推出了一个名为 agent trusthub 的 新产品, 这是一款技能扫描器,可以自动检测并阻止任何关键威胁。这绝对是一个改变游戏规则的创新,因为它为你的工作流程带来了信任。我会演示如何设置这个工具,而且你可以很容易的通过 a p i 开始使用,也可以直接从它们自己的注册表中发现技能。现在, 我们实际上可以设置一个非常强大的工作流程,不仅可以直接在 open cloud 中使用 google 的 os, 这让你能够完全免费地访问最先进的模型, 而且你还可以利用 opencloud 的 功能,借助 opencloud 实现更快更简单的构建。本质上, opencloud 在 这个工作流程中成为了指挥中心,它能够自动做出决策,并通过 opencloud 的 代理分发任务,而 opencloud 的 代理则会调用为特定任务训练的专业代理。 换句话说, opencloud 负责规划和协调。而 opencloud 的 另一个开源且免费的代理则可以通过多个子代理来执行任务。你甚至可以将其与定时任务 cron, jobs 或专用命令结合使用,根据自己的偏好自动化定义在不同时间运行任务。 而且结果确实令人印象深刻,因为有人实际上用这种工作流将 opencloud 和 opencloud 结合起来,创建了一个漂亮且实用的 size。 这个项目就是用这种工作流构建的,甚至还部署了一个评审代理来进一步优化输出,把质量提升到了更高的水平。在开始之前,我们需要先满足几个前置条件, 其中之一就是确保你安装了 note 二十二 g 以上版本。请确保你复制这个 npm install 命令。把 opencloud 安装到我们的电脑上。接下来我们要做的就是打开命令提示符,然后直接粘贴刚才的 npm install 命令来安装 opencloud。 现在,在我的例子中,我会使用 google vertex, anti gravity 和 gemini 认证来为我的 opencode 以及 opencode 绘画提供支持。只要我有 google 账号,这些服务我都可以完全免费使用。要启动这个功能,你可以使用以下命令, opencloud plugins enable google anti gravity alt。 你 只需要复制这条命令,然后可以直接在终端中启用它, 所以你可以直接粘贴这条命令。接下来,你只需要用你的 google 账号登录,然后可以用这个命令来帮助你完成登录。 所以你会看到,当你粘贴那个登录命令后,它会提示你选择提供商。在这个例子中,我使用的是 anti gravity, 所以 我选择了它,然后它会提示你用 google 账号登录。就这样, 你现在就可以在 openclaw 中直接使用最先进的模型,并且让 openclaw 的 子代理由 google 提供商驱动。你可以使用 gemini 三以及现在的 op 四点六。要使用 openclaw, 你 只需要用这个入门安装守护进程,它会演示如何非常简单地进行设置。 我之前已经做过一个关于如何操作的视频,我会把链接放在下方描述里,但其实非常简单,它会引导你完成所有步骤,比如选择提供商,选择消息路由器等等。另外,我还看到 agent trust hub 也即将推出一键安全部署 open cloud 的 功能。 我强烈建议你注册这个服务,因为它比我们现在用的方法还要安全,所以按照入门步骤操作后,你应该就能让它运行起来了。 现在你基本上可以访问 openclaw, 然后让 openclaw 指挥 openclaw 的 这个 ai 代理去执行各种不同的任务。因为 openclaw 会作为大脑,而 openclaw 则负责处理和执行这些任务。 接下来我们需要做的就是前往 opencode 的 这个网站,然后我们需要安装 opencode, 我 会用 npm 把它安装到我的电脑上。 安装好并运行之后,接下来我们需要让 opencode 能够控制 opencode。 这意味着我们需要设置一个技能,让 opencode 能够控制 opencode。 你 会发现有很多技能, 但实际上并没有一个技能可以直接控制 open code。 不 过如果你去 cloud hub, 也就是技能注册中心,你会发现有一些技能可以帮助你用 open cloud 运行 open code。 在 这种情况下,如果你想验证这个技能是否值得信任,你可以复制它的 url, 确保它不是恶意的。 你可以前往我之前在视频中提到过的 agent trust, 你 可以向下滚动,你可以把它设置成通过 api 作为代理来检查某个技能。但因为我们是人类用户,其实可以直接粘贴这个链接,然后提交到 agent trust hub, 这个平台会帮你检查这个技能是否安全。 在这种情况下,你可以看到这是一个低风险的技能,并且它会说明这个技能实际上会对你的电脑做哪些操作,你甚至还可以提供你的电子邮件,以获取一份完整的报告。 大家这里已经有一些非常实用的技能了,你可以直接在 agent trust hub 上发现这些能够真正提升 open code 的 安全技能。说实话, agent trust 的 扫描器真的救了我一命,因为我刚刚在找一个能帮我控制 open code 的 技能, 然后我找到了这个,并且直接通过 agent skill scanner 粘贴进去检查了。你可以看到它实际上发现了一个技能, 这个技能会指示代理从外部网站下载并执行安装脚本,这本来会是一场灾难,那样的话它就会在我的电脑上安装恶意软件,基本上我就完蛋了。但我们要用的那个技能叫做 opencode controller, 本质上它会让 openclaw 通过斜杠命令来控制 opencode, 并利用这个技能来管理多个绘画。所以基本上 我可以让 openclaw 运行不同的定时任务,把各种类型的任务路由到 opencode, 甚至让它编辑文件运行一个持续的调试代理,确保能够捕捉到各种类型的 bug, 并且为我构建复杂的应用程序。为了再三确认,我特意用技能扫描器检查了这个技能是否有恶意,看起来它是安全的。所以我们现在可以做的是回到 cloud hub 技能, 然后我们可以打开一个新的终端添加。这个真的非常简单,大家要根据自己的判断来操作,要持续进行验正,确保你没有安装任何可疑的东西。所以我们要做的就是粘贴 open cloud skills add 命令, 然后再粘贴这个 cloud hub 技能的链接,你可以看到它现在正在出使化这个技能。现在如果你回到 open cloud, 只要你像我演示的那样正确安装, 你会在 workspace skills 里看到它。在这个标签下,你会看到 open code controller 现在已经可以在 open cloud 中使用,并且功能正常。顺便说一下,如果你不想用这个, 只需要点击禁用就可以了。但这正是 open cloud 的 妙处所在。现在有很多视频展示了如何轻松设置这个功能。你可以安排多个代理在不同的时间执行特定任务。 所以如果你有一个生产环境的构建,并且你想要有一个审核代理,确保他处于待命状态。并且如果出现错误,你可以设置一个任务,让他能够部署 open code 来解决问题,而你可能正在外出或者睡觉。 这基本上就是你可以自动化许多不同任务的方法。接下来我们会继续演示这个过程,但这只是你可以实现的一个想法。让我来展示一个简单的例子,在这个例子中,我会让它请求使用 opencode controller 技能。 该技能可以自动搭建一个基础的 nodejs 或 react 项目,安装依赖,并自动启动开发服务器或者是一个 crm 仪表盘。 在这里我们会让它创建自定义脚本,我们会让它把想法转化为代码。这一切都是基于 openclaw 里的文本提示来完成的。 另外顺便提醒一下,我想重生,你也可以在 opencode 里直接使用 google 认证以及完全免费使用 kimi k 二点五,目前它已经开始制定计划,准备如何实现这个 crm 仪表盘,以及如何用 opencode 的 编写代码。 它实际上正在询问一些事项,然后就会启动,因为我们开始编写这个应用程序的代码。就像这样, openclaw 能够将子代理部署到 opencode, 帮助我们开发这个 crm 仪表盘,效果真的非常出色, 各位,质量非常完美,因为它能够利用我的预设来构建出这个完整的 crm 仪表盘,而且这是一个真正可以运行的功能性仪表盘。并且它还添加了我一直想要的 crm 仪表盘配色方案。 这就是你可以用 openclock 控制 openclock 的 实现的效果,因为它能够智能地利用你的所有预设瞬间生成你想要的内容。在我看来,这为我们打开了许多不同的可能性, 因为你实际上可以自动化重复的编码任务,无需手动操作文件,只需使用消息路由器来部署 open code 代理执行这些任务。你可以运行 api 检查生成项目脚手架,甚至可以将多种技能无缝组合到工作流中。此外, 你还可以结合 open cloud 和 open code, 使用许多额外的技能来自动化各种不同的任务。这只是我展示的一个基本结构, 实际上可以自动化并在许多方面帮助你。如果你喜欢这个视频并愿意支持我的频道,可以通过下方的超级感谢选项进行捐赠,或者加入我们的私人 discord 群组。在那里,你可以每月免费获得多种 ai 工具的订阅服务, 还能获取每日 ai 新闻和独家内容,以及更多精彩内容。这基本上就是理想的工作流程。你可以把 openclaw 作为大脑,然后用 opencode 作为智能的开源 ai 编码代理,为你执行各种任务。 通过使用像 agent trusthub, openclaw, skill scanner 这样的资源,你可以轻松发现任何对你的电脑有害的恶意或危险技能。这样一来,你就可以非常安全地使用 openclaw。 我会把今天视频中用到的所有链接都放在下方描述区。好了,朋友们,希望你们喜欢今天的视频,并且有所收获。在我看来,这就是理想的工作流程, 既开源又完全安全。记得订阅我们的第二频道,加入我们的新闻通讯,加入我们的 discord, 关注我的推特。最后,别忘了订阅我们的 youtube 频道,记得看看我们之前的视频,打开通知铃铛,给这个视频点个赞。好了,朋友们,非常感谢你们的观看,希望你们喜欢今天的视频,并且有所收获。正如我之前说的, 我会把所有这些链接放在下方描述区。好了,朋友们,祝你们有美好的一天,传播正能量,我们很快再见!再见了,伙计们!

381一蛙AI 02:47查看AI文稿AI文稿

02:47查看AI文稿AI文稿给大家来演示一下用 open code 的 这样 ai 生成代开源工具,用那个通一千万三扣的 next 这个模型, 我们配置了一个独立部署的模型,给大家看一看,前面我已经跑过了,已经跑通了,给大家演示一下,因为它应该还是可以跑的。它这个给大家看一下,这个是我服务器上面的这样的一个环境,这个服务器上环境我是四块 rtx 四零九零起了一个通一千万 三 ko 的 next f p 八的一个模型,这个模型目前只能跑的是上下文是四四万八千,目前还是能够跑的,应该算是跑通了。我们给大家详细介绍一下这个模型和如何配置独立部署的模型,好吧, 首先我们先来看一看那个通一千万三 ko 的 next, 这个模型性能应该是不低的,因为它是技术白皮书发布出来,我们看了一下,它这个应该是我们企业独立部署的小模型,里面应该算是比较优的。它这个 你可以看到它对比了 deepsea v 三点二, v 三点二要将近六百多个币,所以是非常大的,包括 g l m 四点七、四点七也是非常大的一个模型,也要将近五百四五百个币。 mini max m 二点一也是一样,都是三个非常大的模型。那么相对来讲, 通一千问的这个扣的 next 的 这个模型差不多只有八十币左右,八十币左右,但是你可以看到它的编程性能来讲,其实跟其他模型比起来相差不是太大,水平差不多,它应该是这样,所以它这个模型对我们企业独立部署一些 私有化的模型,做这个代码生成的应用来画这个模型,应该是目前是比较优的一个模型。那这个模型也是我们之前跟大家介绍过,它跟通一千问三 next 八十币有点类似,它也是属于混合的这种架构是 member 架构,再加上 transformer 的 这种架构,混合的一种架构,也是 mo 一 的这种方式,它是总参数量是八十个币, active 的 这个参数是三十,是三个币,它等于是这样, 专家也是有五百十二个, active 的 专家一共是十个。谢尔的专家是一个,它等于是上下文,它只要达到二百五十六 k, 我 因为我的内存还是比较小的,所以我目前是用到了四万八千,相当于四十八 k, 它等于是这样。 好,呃,这是一个。接下来我们给大家简单介绍一下它到底是如何来配置的这个模型,因为我们现在跑了本地的,我们给大家来介绍一下它到底是怎么来配置它。其实最核心它是有一个配置文件的,它这个地方是有个配置文件, 大家看一下,在你的根目录下,用户目录有一个点 config 的 这样一个文件,文件里面有个 open source, open source 里面 它是有一个,我们打开给大家看一下,那么这个文件主要是配置我们独立部署的这样的一些大模型。你可以看到我们用了一个 provide 的 这样的一个 提供商, light a l m, 它是默认它是用了 open ai 的 兼容的 api。 我 这里面是配了一个通用千万三 code next f p 八的一个模型,这个 base url 就是 你本地的那个 url 的 名字就可以了。

47小工蚁