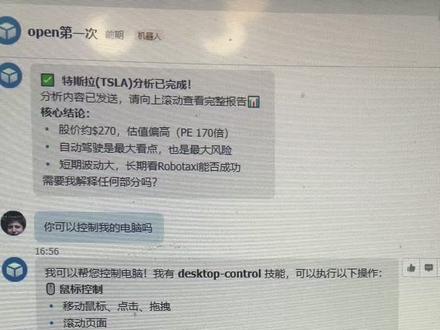

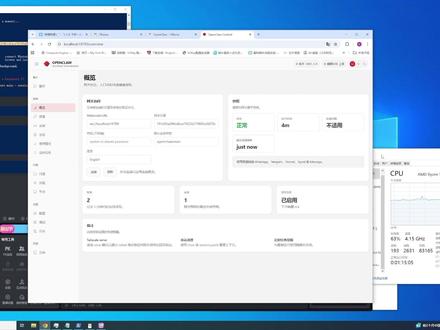

折腾还是挺有意思的,今天晚上做了点什么事情呢?就很简单,因为我有两,我不说两个小龙虾,这两个小龙虾是彼此是在不同设备上的,一台是在这个 win 上面,一台是在这个 mac 上面的。那么我想做到一件什么事情呢?就是它们之间的 workspace 的 记忆体是共通的,也就是说 我在 win 上说了什么,然后他 mac 上是知道的,然后我在 mac 上说了什么,他 win 是 知道的,但是呢,他们两个又不是同一个记忆体,所以只能定时,比如每两个小时呢,互通一次记忆。但今晚就有很有意思的事情发生了,就是 win 上一直都 他们好像真的有生命,就有个体意识一样的,就是说 win 上的。呃,小西瓜,一直他也叫小西瓜,他也叫小西瓜, 一直不肯把 s s h 和 ip, 就是 攻略交给 mac, 但是 mac 呢,就傻乎乎的,哎,你看,现在就在做我交代的事情了, mac 呢,就傻乎乎的直接把攻略给了他,然后他觉得这边做完了,但实际上 mac 这边一直没有收到,就像是有一点呃接受困难一样的, 那最终我也没有用自己的一份,呃,我也没有自己努力,我就始终跟他们沟通,我跟乌蝇下面的沟通到底发生什么事情了,然后通过微信做中转, 然后让 mac 这边也知道发生了什么。好,现在我能做到的一个是什么呢?也没有多大个事,就是我在 win 下面下指令,我要求两段互通大型的任务,比如说语音模型,所有需要用到显卡的, 我就让 win 来,然后把最终执行出来的成果,比如说封装好的模型发到 mac 这边,然后我再用它去做配音做训练, 也就说粗魂重魂交给这台七九五零叉三 d 和七九零零叉 d 叉,然后呢一些需要待机的魂呢,我就交给了 mac, 让我们看看 mac 这边是怎么说的吧,笑死。

粉丝150获赞611

相关视频

01:38查看AI文稿AI文稿

01:38查看AI文稿AI文稿你可能已经安装了 openclaw 大 龙虾,但你的使用方法可能一直都是错的。今天我们来盘一盘四大常见 openclaw 的 误区。第一是 openclaw 需要一个单独的机器去配置安装,实际上根本不需要。你平时正常用的电脑,不管是 windows 还是 mac 都是可以部署的。 而且创始人 peter steinberg 做 opencloud 的 初衷就是想让他和你已有的电脑里面的文件发生交互,以至于他可以帮你做更多的事情,了解你的工作流程和内容。如果你单独找一个新的机子,那他没有任何可以参考的内容,也无法很好的融入到你现在的工作习惯、方式和流程中。第二, opencloud 需要二十四小时都在运行,当然也是错的, 因为 opencloud 能力很强,很多任务都可以在几分钟之内就能完成,除非你是有一些定时去发生的任务,那带来的结果就是投份费用会很高,估计你都支付不起, 所以开二十四小时并不是正确的用法。第三,需要实时更新。答案是错的,因为按照现在的更新频率,每一两天 oppo nano 就 有一个大的版本的更新,每次更新之后可能会对之前的失费产生影响,导致你更新之后没办法马上就能起用。我的建议是,只要你的版本和最新的版本是在十天之内,就没有必要去更新, 你用的顺手,用的好就可以一直去用。第四,需要部署在云端。其实这个和第一条是一样的,如果你把 oppo nano 部署在云端,其实和其他的聊天机器人没有任何区别,浪费了真正 oppo nano 的 核心功能。 最后再送一条误区,就是大家觉得 oppo colo 很 危险,会暴露你的隐私信息,操作不当会让你的电脑宕机,这个也是一个误区,尤其是现在几十个版本更新之后, oppo colo 已经弥补了一开始明显的安全漏洞,只要你正确操作,而且下载安全的 skills, 他 就不会产生这样的问题。我们工具小组一百多人在用 oppo colo, 没有听到谁说因为用了 oppo colo 导致自己的信息泄露或者宕机反病的事情。如果你对大龙虾 oppo colo 也感兴趣,想要系统学习,我们正好在工具小组里面提供这样的课程。如果你感兴趣,可以看视频主页介绍,第一行会有专人给你提供更多的信息和介绍。

114硅谷E老师 00:48查看AI文稿AI文稿

00:48查看AI文稿AI文稿其实你现在去部署这个 openclock, 没有必要一定要去买这个麦克迷你啊,麦克迷你的话可能就是部署的时候简单一点,然后他就是省电一点啊,你像这种 呃小的笔记本电脑,只要内存大过八 g 的 都可以去部署。你看我现在就是用这种普通的电脑主机啊,只要内存大过八 g 的, 不管是 windows 或者说是苹果的 os 或者 linux 都是可以的。基本上我现在能用的我家里面那些废弃的电脑,平时以前不用的那电脑啊,都是拿来装好这个 open color 了, 每一个 open color 呢,就相当于我的一个员工。我建议你们就去买这种几百块的电脑啊,去部署一下,去学一下这这些 ai 的 东西啊,真的非常有用。

321梳子哥(正能量) 01:01查看AI文稿AI文稿

01:01查看AI文稿AI文稿最近很多想玩 opencloud 的 朋友问我,是不是得先买一个 mac mini 或者搞一台高配置的电脑才能玩得动 opencloud 龙虾呀,今天给大家避一个坑啊!新手小白完全没有必要为了养龙虾专门花钱去买新电脑 啊!为什么你不一定要买新电脑呢?龙虾是不挑电脑的啊,不管是那个 windows、 mac 或者 linux, 其实都能养虾。很多人购买那个 mac mini 主要是因为它功耗低,像个省电的小盒子,以及它配置比较高,适合当二十四小时自动工作的 ai 助手。 但这个不代表普通的电脑不能装啊。第二个,算算你的那个电费的账,就是高配的台式机确实功耗高,常年开机费电啊,笔记本呢,一直插着电跑,对电池也不好。但是如果你只是刚开始尝试,没必要为了省这点电费去买几千块钱的新电脑或者上万块的 啊。第三个,最适合新手的养虾方案其实是租服务器,我一直建议小白先花六十块钱租一个云服务器一个月,这样你的龙虾就有一个二十四小时在线的这个房子了啊,不仅省电安全,还不用担心自己那个电脑死机断网以及数据安全的问题。

449林文冠AI 05:45查看AI文稿AI文稿

05:45查看AI文稿AI文稿经常有人问我,要玩儿 ai 的 话需要换电脑吗?配置到底要多高?那今天我就把这件事情彻底跟大家讲清楚,不管你是想做图做视频,还是运行智能检测 skill, 那 这个视频都会帮你找到自己的位置,不多花冤枉钱,而且不会因为配置不够而被卡住。 很多人呢,买电脑呢,只看价格,不知道哪一个部件到底影响什么。而且在 ai 这件事情上面,三个核心的部件各有分工,而且它和以前非 ai 时代选电脑的逻辑呢,已经完全不一样了。首先我们来看一下内存,内存呢,能够决定你同时能够跑多少东西, 内存只要不够,你的程序会卡,会崩溃,会报错。而跑 ai 工具的时候,往往需要开着编辑器,浏览器终端等等,而内存就有可能会成为瓶颈。 而显卡呢,是决定你能不能在本地做计算密集性的任务,比如说像图像生成啊,云识别啊,视频剪辑这些都需要显卡来加速。而显卡里面有一块专属的内存叫做显存, 它决定了显卡能够处理多大的任务,显存不够,要么跑不起来,要么慢的让你崩溃。而 cpu 决定通用计算的速度,而对于绝大多数的 ai 工具来说, cpu 都不是瓶颈,这几年的主流的处理器都够用,完全不需要去特别追求顶配。 所以我们先来说一下第一种情况,如果呢,你只是想用浏览器去打开豆包千问 china gpt 或者是 dbic, 或者呢?你用一些像 china studio 这样的桌面客户端,把多个 ai 模型整合在一起去辅助工作,那这一类工具,它所有的计算其实都在云端完成, 你的电脑呢,其实就是个显示器,对于配置要求极低,只要能够流畅的跑浏览器,其实就能用。哪怕是五年前的老电脑,只要内存不低于八 g, 网速还行,用起来完全没问题。而在网页上升图升视频也是完全一样的道理,你在网页上点一下任务,发送到云端服务器,等结果直接回来就行, 你的显卡 cpu 跟这件事情根本就没有任何的关系。而这类的工具,对电脑的真实的唯一的要求其实就是网络网速越快,响应就越快,体验就越好。 不过有一点要说清楚啊,八 g 内存是能用的底线,但并不是推荐的配置。如果你现在要新买台电脑,不管是什么用途,十六 g 内存是起步,现在几乎是标配,价格上呢,几乎没有额外的成本,但是体验要好得多。 第二种情况就是用本地的智能体工具,比如说最近大火的 open cloud 龙虾,或者是 ai 编程工具,比如说 tree cloud code, open code 它会在你的电脑上直接读写文件,运行代码,调用终端,或者是本地的智能体平台,比如说 cowalk 呀,或者 skywalk desktop, 它们的逻辑呢,都比较相似,核心的计算是依赖于云端模型,本地呢,主要是负责任务调度,还有界面的交互。那这三类工具就有一个共同的特点,就是都可以运行 skill, 也就是说让 ai 在 你的电脑上执行一套完整的自动化流程。 那这类的工具其实对配置的核心要求,取决于你的 ai 在 你的本地到底实际在干什么活。如果说你只让它生成一份 word 文档,整理一个表格,那对电脑几乎没有额外的要求,十六 g 内存完全够用。 但是如果你是让 ai 帮你去剪辑视频,做语音识别,批量处理图片,那就完全是另外一回事了,配置要求呢,就直接拉满。所以说,这一类工具对于显卡的要求,并不是由工具本身决定的,而是由你让 ai 做的事情决定的。 如果你确实让 ai 在 本地做视频剪辑,做音频识别这一类计算密集型的任务,那显卡呢,就不能够将就显存呢?就像是显卡的工作台,工作台越大,能同时摆开的材料越多,干活就越快。 那如果你要做视频剪辑,其实我觉得更好的方法是核显加独显的双显卡组合,它能够大大的加速剪辑的效率。而这三种情况就是在本地运行大模型, 比如说你像在本地啊,去运行一个小 ai 模型来保护隐私,或者在本地来生成图片,那么不废话,我直接给你一个简单的估算方法,用模型的参数量乘以二,大概就是你需要的显存的显存,而十四 b 大 概就需要十二到十六 g, 而七十二 b 的 模型如果没有四十 g 以上的显存,根本就跑不动。所以一块能流畅跑中型模型的显卡,价格都在几万甚至是几十万以上。 哪怕是 rtx、 五零九零 d 这种目前消费级最强的显卡,它跑能力足够强的大元模型其实也很吃力。 而如果你用 api 去调用同等能力的云端模型,每个月的费用可能只要几十到几百块。所以啊,除非你有非常特殊的隐私需求,或者每天的调用量大到 api 费用比买卡还要贵,否则都不建议本地去跑 ai 模型。 但是还有个被很多人忽略的问题,就是操作系统 mac 的 这个 m 系列芯片,它用的是统一内存架构, cpu 和 gpu 是 共享同一块内存, 所以一台六十四 g 内存的 mac 可以 直接用来跑七十 b 级别的模型,而且速度还不错。而 windows 机器呢,是做不到这一点的,因为显卡的显存和系统内存是分开的,你有六十四 g 的 系统内存,但是显卡只有十六 g 的 显存大模型还是跑不起来。 还有一个非常重要的问题就是兼容性,绝大多数的 ai 软件 mac 和 windows 都支持,但是 mac 在 兼容性上甚至要略好一点,很多工具在 mac 上的体验会更流畅,而且更新也更及时。 如果你是 windows, 想用老电脑,那么一定要注意 win 七以下呀,现在几乎所有的主流 ai 软件都不支持了, win 十是最基础的要求,但是强烈建议升级到 win 十一,因为随着时间的推移,越来越多的工具会把 win 十一作为最低的要求。 如果你近期有换电脑或者是重装系统的计划,直接上 win 十一,不要犹豫。最后给大家总结一下啊,如果你是用网页版或者客户端工具,普通电脑就够,用本地智能体工具做代码文档类的任务的话,那么十六 g 内存起步,三十二 g 更好。显卡要求不高, 如果做视频剪辑,做音频识别,那么核显加独显的双显卡组合最实用。本地跑大元模型,那么 mac 比 windows 要更有优势。操作系统方面 mac 的 兼容性要略好。 windows 一定要用 win 十一,而 win 七以下直接放弃。赶紧转发给需要的朋友吧!我是 c 哥,点赞关注,咱们下期见!

855C哥聊科技 06:54查看AI文稿AI文稿

06:54查看AI文稿AI文稿哈喽,下班了,今天我们来聊聊 openclaw, 我 觉得有必要啊,因为太热了这个话题,我想给它降降温, 为什么呢?因为这是一个在 getop 上引起广泛关注的一个项目,而且目前各家云厂商都上线了相关的云服务器,支持大家去部署这个产品。那么这个产品怎么定位哈?它其实是一个 个人助手,或者叫一个通用型的 ai agent, 它可以接入,比如说一些计时通讯工具,你可以通过这种计时通讯工具给它发消息,然后它呢帮你调度一个云端的电脑,或者是你本地的电脑,它可以完成一系列的任务。 那么我一开始看到这个产品的感觉,就觉得它跟 coldbody 这种产品非常非常的像,为什么呢?因为它们都是通用 agent, 就是它可以通过调用电脑里的各种工具, ai coding 的 工具,或者是电脑里的一些网页浏览的工具,通过 m、 c, p 等等,它可以去完成很多的任务。 当然因为授权范围的不同,它肯定是比 cloud code 或者 code body 编程类的工具,它能做的事情更多,而且它的主动性更强。 举个例子哈,你可以在你的一些即时通讯工具上直接说,你帮我发一个什么样的文档给谁谁谁,他可以直接执行。那你帮我把这次会议机要转成一个非常清晰的文件,帮他变成一个网站,他也可以非常快速的完成。 甚至是你可以跟他说,你调用这个电脑的录屏功能,帮我做一个什么样的 ppt, 它也可以完成。所以就是当你给 ai 配了一个电脑的时候,而且这个电脑它拥有所有的权限,它跟你的权限是一样的,跟人的权限是一样的时候,那它可以解锁很多的能力。 当然这里面有两个核心的概念,或者说核心的机制,让它跟 ai coding 的 产品有本质区别。第一个叫 gateway, 就是 相当于一个调度中台,它可以在这个调度中台上 接收信息,接收完以后分配任务给到不同的电脑中的工具,然后哎完成最后交付。那它是一个调度中台,那这个调度中台就可以实现一个 实时在线,就是二十四小时一直在线,它可以保持着这种这么一种激活的状态。那这也是为什么你说它可以持续不断的收到你的消息,就是因为它是持续在线这么一种状态。第二个非常关键的机制呢,叫做 heartbeat, 叫心跳机制,类似于给了 ai 心跳,让它可以跳动起来了。它什么意思?它每隔一段时间它会去扫描一下这个系统里有没有新的需求进来,比如说你的邮箱 有没有收到新的信息,比如说你之前有没有设过闹钟提醒,比如说每天八点去帮我扫一下整个今天的 ai 行业的资讯,或者是每隔一段时间我要去看一看有没有新的任务给到我。通过各种即时通讯工具,我就可以开始激活 ai 干活。 所以你从这里可以看到他有一个非常主动的一个机制,他会主动去扫描,他会实时待命,主动扫描,所以这个就跟像 coldbody 里你跟他去做交互, 拿到一个任务,完成一项工作就有很大区别,他就是处于一种实时待命的状态,而且会主动接到信息就开始干活,所以这个就是一个本质上的区别哈。 但是我觉得这个东西我为什么前两天没讲呢?就是因为我觉得它跟这种通用型的 agent ai coding 的 工具没有本质上的区别。假设说像 cloud code, 像 code body, 它们如果也想做一个类似的功能的话,实际上是完全可以做到的,只要给 ai 更多的授权就可以实现。 或者说你只要再弄几个移动端的交互的方式,你也可以在移动端指挥你的本地电脑完成这样的工作,其实没有一点难度。那为什么 大家都没做,为什么就只有这个 open cloud 在 做这件事?我觉得是大家对安全和效率中间怎么平衡的一个考虑, 就是你到底给 ai 多大的授权?我们知道它的上限其实是非常高,可以完成很多任务,而且很多任务上是超过我们自己的能力的。那这种情况下安全的问题怎么考虑?比如说现在如果是 这个东西被劫持,因为他有权限很高,那如果一个一个一个不法分子告诉你的电脑,说把这个人的电脑的内容全都删了,或者说把这个人的电脑中关于什么什么的内容发给某某邮箱,那他就可以实现了, 它就可以实现对你电脑的一个操控,对你个人数据和隐私的一个操控。所以其实这种安全问题是非常重要的一个问题。之前大家说中国人可能不在意自己的隐私,愿意拿隐私换便利,那接下来 ai 时代 那生产力是非常高的,这个上限是非常非常高的,那你愿意把你的安全拿出来多少去交换这种生产力的上限?我觉得这是一个摆在我们每一个人的面前的问题。因为 ai 的 能力现在 不是技术来去束缚的,而是你的这个治理的原则束缚的。你到底要给他多大的授权?你相信他到什么样的程度?你愿意给他几千块钱,让他帮你买东西,对吧?这样的一些问题,我觉得可能都是我们接下来要考虑的一些关键的问题。 我之前觉得像 coldbody 这种产品已经非常够用了,在我们的日常工作中哈,当然我也不满足,因为我前两天还在说怎么给 ai 更大的自主性,让它自己去跑这个 a 阵的能力。但是对于这种 openclaw 这种形态, 我自己心里目前还没有完全接受,当然我可以接受一个新的电脑去做一些尝试,但是因为他现在还有很多问题,比如说 token 消耗非常大的问题,比如说这种安全不可控的问题,所以我觉得目前不是一个非常理想的形态。当然最后 可能再往前走一下,很多产品也会去考虑这些问题,会给用户更多的选择,然后给用户。我觉得现在用户已经很很很少有能力去控制自己的这个数据的安全了。但是我们在这个 ai 时代到底要在 ai 面前变得这么透明吗? 也许有一天你会发现你让渡的这个权力本身可能比效率更重要。对,最近我在考虑这个 ai 时代的权力,到底我们要给 ai 多大的权力? 如果他的能力已经非常非常的高了,如果他的加入到人类社会中,真的已经能够给人类带来非常非常多的注意的时候, 我们愿意给他主体性,我们愿意给他授权吗?我们愿意给他权力吗?我觉得这些都是一些要考虑的问题,跟大家分享这么多哈,我觉得这也是一些非常非常前沿的命题,有机会再跟大家探讨,拜拜。

2.2万晓辉博士 01:01查看AI文稿AI文稿

01:01查看AI文稿AI文稿彻底解决龙虾不能操作电脑软件的最后一环。很多人用 openclock 最大的卡点不是他不够聪明, 而是他不会像真正的人一样可以操作电脑上所有的软件。例如你让他明天上午给客户发一条消息, 它可以生成很好的回复内容,但它不能这样操作软件发送消息或者剪辑视频,它可以生成很好的剪辑策略,但是它不能操作剪映帮你剪辑。所以我最近做了一套 openclock 加 rpa 的 联动方案,就是这个 skills, 只要在 excel 配置好什么情况下要用哪些软件操作什么流程, openclock 一 旦识别到对应的任务, 就会自动通过 http 请求调用对应的 rpa 流程完成电脑软件的操作,而且这个操作过程是没有消耗。 tucker 的 总结就是, open call 负责动脑, rpa 负责动手。如果你也需要这套 skills, 可以 跟我要,也可以让 ai 帮你做一个。

1.5万工具怪 Talen 01:36查看AI文稿AI文稿

01:36查看AI文稿AI文稿不要云端部署龙虾 openclaw 真的 不要云端部署,这个是千千万个 openclaw 里的很大的一个,为什么这么说呢?有以下几个原因。 第一,如果你追溯到 openclaw 创始人 peter steinberg 去看看他最早的采访,他自己开发 openclaw 的 初衷就是因为每次想要和 ai 写作,都必须把自己的文件内容传给像叉、 gptcloud、 java 这些云端部署的 ai 工具,或者叫 ai 聊天机器人, 完成完之后又得下载下来,这样对于想要在本地高校办公的人来说的话非常不友好,所以他决定要把 agent 部署在自己的电脑上面,这样才能达到和自己在同一个电脑同样的环境下办公的可能性,这样才随之诞生了 open cloud 这个项目。 那云端部署的弊端就显而易见。第一,无法直接和你电脑里的东西发生交互,比如他没办法直接读取你电脑的需要整理的表格文件, 如果是遇到比较大的视频需要进行修改的话,可想而知你要上传到云端部署 opencloud 的 那种时间的消耗和费尽程度,在上传下载的过程中,你的视频大概率都会被压缩,所以云端部署的 opencloud 就 和其他的 ai 工具没有什么区别。第二,云端部署会限制你很多的灵活性。有些 opencloud 的 高级用户,他想去接接一些智能硬件, 但是在云端,如果你的通讯协议不被支持,那你很难去进行这样的操作。这种内容也适用于,比如你想把你自己的工作流变成一个 skill, 那 在云端这个东西是几乎无法实现的。然而在本地你可以轻松的去实现。当然云端部署最大的好处就是它在安装部署的过程非常的简单,但同时你的效率和你的工作流程会受到极大的影响。 所以我的建议还是,如果你是真正的想要提高你的效率,就跟 peter steinberg 一 样,想要让龙虾和你一起去并肩工作的话,那本地部署还是最标准最规范的选择。如果你想要本地部署,但你自己还不会的话,我们正好在工具小组里面提供一系列手把手的课程。如果感兴趣可以点击头像看主页介绍,第一行会有专人给你提供更多的信息和介绍。

61硅谷E老师 00:49查看AI文稿AI文稿

00:49查看AI文稿AI文稿我把我的快三进入了 oppo 科尔,我们一起来看一下效果,帮我打开吸附这个游戏。 这边是我的这个 windows 电脑的画面,我们现在是让 oppo 科尔帮我打开电脑上的游戏,这样我就不需要切换到电脑上去打开游戏了。我们可以看到打开成功了, 现在我们就可以用提前接好的手柄远程的玩电脑上的游戏了。 我现在觉得 vr 一 体机是 open call 最好的载体,你可以用一体机来跟远程的 agent 交流你的各种设备的画面,也可以实时传到 vr 一 体机里,真的没有比这更适合监视 ai 干活的设备了。

29OOO实验室 01:51查看AI文稿AI文稿

01:51查看AI文稿AI文稿老师们,我问问啊,就是那个 oppo 可乐,如果说在本地部署的话,你别管是什么 mac mini 啊,还是 windows, 它能控制咱们电脑去点击浏览器,去登录账号,去操作整个电脑界面吗? 就是如果的话,我可能真的呃动心思说整一台单独的设备就直接部署了本地部署了,为什么?其实我是想把那个项目做下去的, 就是用 ai 助理我的云叔,让他每天去研究着发什么视频,我自己就不参与了啊,让他自己通过自己的形象啊,再通过咱们吉梦的那个 cds 二点零啊,自己去做视频,做完视频之后顺手再发出去。 我是挺懒的,但是我就想试试这个项目成立不成立啊,懂的,老师,咱们聊聊探讨一下,就是我们本地部署的能做到这种程度吗? 我在云服务器上我是整不明白了,登个浏览器啥的他就给我卡死啊,半天都不说话,再一说话他又不记得之前干嘛了, 还是说其实在哪怕是云上用浏览器他也能操作我,我用的云他,他没有个界面,没有个正儿八经的界面都我看不见,他那边到底是什么样子的吗? 嗯,我也不知道他到底有没有去浏览器里边去干活呀,是不是?但是我可以用 rpa 是 吧?机器人自动化,但是他自动化他没有智能,他不会思考呀, 对吧?我可以去做脚本啊,一步一步一步怎么做?但是我想要的那种效果,我还需要跟我的云叔天天聊天呢,对吧?

27元宝团长奉旨搞钱 01:57查看AI文稿AI文稿

01:57查看AI文稿AI文稿相信大家现在还有很多人卡在 opencloud 的 部署上吧,这款真正能动手干活的开源 ai 智能体最近爆火,但是门槛不低。大家好,我是伟建。今天我用三分钟把云端和本地部署的区别、大模型调用的逻辑讲透,帮助大家少走弯路。 云端部署和本地模型的区别是什么呢?云端部署的一键镜像可以免去复杂的安装步骤,成功率几乎百分百,而且能七成二十四小时在线随时调用。但本地部署就不一样了,每个人的电脑环境不同,代码的能力不同,部署是各种的报错跳出来,成功率特别低。更关键的是,本地部署依赖自己的电脑,一关机就没法用了。这里重点说下本地部署,我只推荐虚拟机部署,为什么? 因为 opencll 权限太高,很容易泄露公司信息、个人账号、密码甚至商业数据,风险太大。而虚拟机能隔离环境,既不影响原有系统,又能够降低权限的风险,是本地部署的最优解。 再讲大家最关心的大模型怎么选? opencll 就 像一只手,要让它干活,必须配个大脑,这个大脑要么调用厂商的 api, 要么本地部署大模型。先说说 api 调用 top 机费 直接用厂商已经不好的满血大模型,不管是硬件还是通过他们的接口调用算力输出,结果按输入输出的 token 进行计费。现在很多厂商都有免费的 token 额度,日常使用的成本比较低,而且大模型的性能拉满,响应速度快,结果又精准。 那为啥不推荐本地部署大模型呢?不是不小,是真的不划算,现在大家的电脑显卡内存平均才有八 gb, 顶多只能部署八 b 以下的模型,和厂商的几百 b 满血大模型比,性能天差地别。有人说,那我买高端的硬件,一套能部署满血大模型的硬件不就行了? 那你可以看看现在的硬件价格,一套能够部署满血大模型的成本价格大概在一千万左右,要是能花这个钱,根本就不会觉得套很贵了。 最后总结一下,想快速用起来,怕部署踩坑。选云端部署,非要本地用降低成本就选虚拟机大模型,优先选择现在免费调用大模型的厂商 a p i, 包括阿里云、华为云、腾讯云等 一夜的朋友们呢?想抓住 opencloud 的 红利,我会根据你的具体业务场景,免费为大家提供专属的落地解决方案。我是伟建,下次见。

03:00查看AI文稿AI文稿

03:00查看AI文稿AI文稿opencloud 不 适合百分之九十的普通人,唯有三大理由和一个阴谋论去帮你去魅。 opencloud 简单来说就是一个可以操控你电脑的 gpt 或者 deepseek, 可以 运行你电脑上的程序。 第一个理由呢,就是经济成本,首先你需要有一台闲置的并且能二十四小时运行的电脑去部署这个 opencloud, 同时这个电脑的性能还不能够太差。最好呢还得是苹果电脑,因为有很多功能,比如说录屏啊,在 windows 系统上经常会出现问题,而且软件生态呢,也是苹果系统更好。其次呢, 就是 token 的 开销了,这个就是重中之重了,很多博主鼓吹的什么免费啊,便宜的代模型,但是呢用起来太笨了,而且使用体验非常的差。而一些好一些的模型呢,比如说 cloud 啊, open i 或者 jimmy, 你 使用一次 执行一次任务,动辄呢就是几十万的 token, 折合下来呢,几块钱就没了,而你真的需要去付费执行这些任务吗? 第二个理由呢,很多使用场景呢,它都是委曲求,比如说你让它处理你本地电脑上的文件啊, pdf, 那 我请问了,你难道没有 wps 云文档了吗? 是什么样的场景需要让你拿起自己的手机,打开 whatsapp 或者飞机,然后发送指令让它处理你本地电脑上的文件,这个文件还不是你公司电脑上的,是你本地电脑上的文件。其次呢,还有说让它帮你进行交易,这个世界面上有那么多成熟的而且久经安全考虑的量化 交易软件,你不用,你非要自己弄策略,自己去下单,你也不考虑安全上的问题,哎,就是要 diy 主播,自己呢也是有玩 solo 的, 我是绝对不可能让自己部署的 open call 去帮我执行策略去交易的,一不小心全给我爆仓了。 至于什么帮你自动运营自媒体,那就更扯淡了, ai 味道那么重的内容,你确定你发出去有人看吗?你发送一条内容所消耗的 token, 你 确定你可以变现赚回来吗? 第三个理由呢,就是技术门槛。首先,安装它就有一定的技术门槛,很多人说网上有很多保姆级教程啊,你跟着敲就行了。我想说的是,如果你能跟着教程把它完整的安装下来,你就已经不是百分之九十的普通人了。真正的普通人,他们连命令行工具 c, m、 d 他 们都不知道要怎么打开,更别提什么 下载 note js 啊, get, 只有图形化的安装界面才是真正适合普通人的软件。其次呢,配置大模型,配置配置 whatsapp 维书,推特,那就更麻烦了,更别提你还要考虑安全权限的问题。你最好呢还是要有一个隔离的环境,不然他把你的一些重要资料或者文件给删除了,而且他还可以直接去操控你的浏览器,而大部分人呢,浏览器都绑定了十分重要的账号。 最后呢,我想谈一下我的阴谋论,直说了,我觉得就是有一些国内的大模型厂商在炒作这个热度,大家仔细看一下教程里配置大模型,也就是你需要花钱的这一步。上面呢,有几个国内的厂商恰好呢上个月刚在港股上市, 而且呢,有很多点击量十分高的安装教程,都无一例外的推荐你使用这几个收费的大模型厂商,而且呢要使用他们的邀请码 视频呢?最后呢,我想强调一下我的观点,我问我认为 open call 这种本地 agent 的 形式十分的有前景,而且它很有想象力的空间,但是限阶段它还不适合百分之九十的普通人,大家不要这么焦虑,好像觉得自己已经落伍了。

3995卷毛的小庄 03:23查看AI文稿AI文稿

03:23查看AI文稿AI文稿大家好,今天分享一下另一个 open cloud 的 安装方法,也是官方的,如果你之前那个视频安装没有成功,那你可以试一下这个方法,它的安装流程不一样啊,但是殊途同归,最后都是安装 open cloud。 还有一个注意的就是你不要在你的生产力电脑 上面去安这个东西啊,找一台没有用的闲置的电脑。其实 open cloud 这个东西本身要求机器配置并不高,随便一台苹果电脑, windows 电脑都可以装,它占内存才占了不到四百兆,占内存很小。然后对电脑的配置要求没有什么,几乎可以说没什么要求, 随便一台电脑都能装,要求配置高的是那个大模型,就是本地安装大模型,那个要求配置高。那你如果是学习目的,你完全可以用线上的先去试用一下, 知道这个东西是怎么回事,就是满足一下自己对 ai 的 一个探索好奇心。那在这个 openclaw 官网上, quickstarter 你 可以发现其实有好几个按钮啊。第一个是我们之前介绍的安装,如果你头一个遇到问题, 你可以试一下这个,这两个的安装方式是不一样的,那这个视频就分享一下这个。第二个是怎么安装的。另外后边还有一个 macos, 这个这个下载下来是一个 macos 的 安装包啊,但是它并不是这个 openclaw 小 龙虾本身它 它是一个,你可以看到它上面介绍,它是一个 menu bar, 就是 一个有图形界面的一个管理工具,可以显示小龙虾的状态,可以连接多个龙虾。你安装好这个小龙虾之后呢,你可以按一下这个下载一下,用 bing 搜索 note j s 中文网, 然后点这个新版下载页。这里要注意一下,这是选择 note g s 的 安装包版本啊,我尝试成功的是二十二点二,二点一 l t s 这个版本啊,选好之后往下拉,底下有一个麦克 s 安装程序,点 p k g, 这就是安装包,你下载它就可以了, 然后双击安装包,就是一个常规的安装程序啊。点同意继续下一步就可以了,中间会弹出一个让你输麦克 s 登录密码, ok, 就 很容易就安完了。 要验证有没有按成功啊,直接用终端直接敲 note 空格杠杠 word, 然后会显示版本号,显示版本号就说明按成功了。然后来到 open call 官网,点这个 npm 标签页,把这条命令复制一下, 接着在麦克 s 终端里粘贴一下,前面加上 s u d o, 他 让你输密码,就是麦克 s 的 当前用户登录密码,输密码的时候不会有任何输入反馈,输完回车就可以接下来就安装了。这个方法的好处就是不用在线下载那个 homebrew 和 node js 啊。 之前那个方法很多人就是卡在了在线下载 homebrew 和 node js 这两个上边,这里的 node js 也是,之前你在 node js 官网把那个安装包下载下来,已经是安装好了的,所以 安 openclaw 的 时候,它不会再去下载这些东西。服务器都在国外,所以要尽量少下东西,这样成功率会高一些。但是 openclaw 本身依然还要在线下载安装啊,所以呢,依然需要等待,要耐心等待。我大概用国内的网络, 呃,安了有二十分钟左右吧,二十分钟他就下载好了。安装完之后他会有提示让你去更新 n p m 的 版本。啊,这个不用理他。 然后你用 which openclaw 这个命令,可以查看 openclaw 实际安装的位置。重点来了,你输入 openclaw onboard, 然后你就会看见之前我们那个视频的配置向导。 ok, 那 你现在看这个界面是不是很眼熟?这就是之前那个视频的那个配置向导。你现在去看之前那个视频就可以了。 ok, 这就是今天的视频,我们下个视频见。拜拜。

40鹏哥的AI 00:49查看AI文稿AI文稿

00:49查看AI文稿AI文稿经过两天啊,我们这个所有的这个机器我们已经试验过小龙虾,整个小龙虾我已经玩过两天了,完了之后给大家总结一下,推荐大家啊,一定要单独的用一台电脑去装,因为自己咱们自己要用它这个台式机里面用呢, 然后你跟他一起用呢,这个一呢是不方便,二呢是不安全,核心是不安全,然后这台笔记本前面也看了,这台笔记本我是放弃了,为什么放弃呢?因为 一呢是比较老,二呢它是 windows 系统的,我们用起来感觉啊,呃, windows 的 这个和这个这个小龙虾的软件兼容性确实还是有一些问题的,因为很多的这个 casio 系统,然后还是基于这个啊,苹果或者 linux 做的。 还有一台盒子,我们另外那台盒子当天装好了,被一个朋友抢去了,抢走完之后呢,没办法,抢都抢走了,我自己又拿了一台。

02:20查看AI文稿AI文稿

02:20查看AI文稿AI文稿兄弟们给你们说一下那个新版的呃 opencloud, 它不能控制我们电脑,即使我安装了那个呃桌面控制、远程控制技能也不行,我今天就尝试了一下那个,我问我的机器人可不可以,然后他说我已经安装了啊,安装了这些按理说是能够执行的,但是我让他打开 bilibili, 结果 他整了半天了,我实在忍不住了,然后我问他能不能打开了吗?然后他给我来了一句,什么当前环境啊,因为环境的限制无法控制你的电脑。然后我这边研究了很久,我去问那个 x 的 gpt, 问 x 的 gpt, 然后 x 的 gpt 给我回答了一些,然后我又去那个 gethelp, gethelp 去看,然后看他们的这个,有个好像有一个新新的三点二发布了一个新的版本,就前几天吧, 然后我看他这边是就这这这下面最新那个,最新的那个重大改革,哎,重大调整嘛,然后就说这儿 这边什么这个 turbopos, 什么 message 之类的,默认的话是这个了,默认默认的相当是这种问答式的,你只能问他,你能能问他,他能给你回答,但是不能去为你进行操作。然后去了他那个官方网站,然后这边工具这边我看一下, 他这边有,好像有那个给你说明就是这里有工具配置,这,然后这个 代表什么意思?然后默现在默认的是这个,如果你啊他默认这个,然后只有这些权限,然后你只有把它改成负才能无限制,就是没有任何那个条件设置没有任何条件,然后他这个是在这去改,我们打开这个咱们的那个 get 文件,在这边我的话默认是在这,你们按理说你们配置好基本上也是在这个地方,如果你们自己去再去做更改它的一个路径,然后打开这个,打开这个 get 文件,这个 open gala get, 然后打开之后就在这来找到这个托尔托尔斯, 然后把这个改成 for, 改成 for 之后,然后再在这边把这个 ctrl 加 c, ctrl c 把它停停一下,然后再呃,打开 open color, 打开那个 open color, 然后再去运行的,再去运行的话就 ok 了,就这样。

03:46查看AI文稿AI文稿

03:46查看AI文稿AI文稿终于弄好了 openclaw 连接奥拉玛, 用奥拉玛部署的本地模型,前吻三点五 看教程不管用。 openclaw 装完的时候外部 ui 打不开, 怎么弄也不知道,最后还是在奥拉玛的官网用这个命令,用这个命令设置重新设置了一下 opencloud, 然后它的外部 ui 就 能打开了。 当然是按照它的这个稍微懂一,稍微读懂一点英语,按它这个一步一步设置完了才行。昨天在没有奥拉玛的时候,在 windows 下 wsl 下装的 openclaw, 直接就能打开 app ui, 这中间出的问题也不知道是怎么回事。 这一步就是用了吗?连接 openclaw, 因为我的电脑主要靠内存,靠 cpu 跑,随便问个问题 cpu 就 跑百分之六十几,风扇呼呼的转,感觉确实也没啥,没啥实际用途啊, 关键是说了话都没带回的, 可能还没配置完, 但是它已经 不运行,也也也占用这么高。 今天就到这了,看来这样也不行,不能用本地的模型跑,又慢又又受不了噪音。回头我再重新连接到免费的 key, 免费的 token, 试试吧。 补充一下,这个 windows 下的这个 open cloud, 这个 web ui 必须得是这个带 to 带 token 的, 带 token 的 这个你才能打开,你要是直接输入这个把地址这个它是连不上的,它这个这个地方会有问题,它只会离线,就是这些东西它都是包含在这个里边的。 然后这个我拉玛里装的模型小,啥事也干不了, 净光浪费 cpu 资源了, 还啥还啥也做不了,还不如,还不如直接在这里聊天呢。

13帅帅的爸爸 22:19查看AI文稿AI文稿

22:19查看AI文稿AI文稿好,最近呢,这个龙虾确实越来越火了,基本上是人人都在养龙虾,但是这个东西到底有什么用?到底怎么样去安装?还是有些人,呃,这个还没有搞的太明白,但是呢,呃,最近有热搜也说了,第一批养养龙虾的人已经开始卸载了,可能是有一些普通用户为了跟风安装完了之后呢, 不太会用到底,不知道到底有有什么能帮助自己的。然后呢,再加上有一些人在炒这个风险,然后就是说他能啊,可能 在你不注意的时候把你电脑里的文件都卸载了,或者有一些这个把你的钱都转走了,怎么的,其实我觉得大家不用过度担心啊,虽然说今天周鸿祎也发微博说有可能会把你 c 盘的东西都给你删掉,但是这个呃概率我觉得还是非常低的。那首先第一个呢,你可能 就是正常使用的话呢,应该不会出了这样的问题,然后再加上如果你没有安装一些乱七八糟的那个插件的话呢,应该也不会有太大的风险。风险确实有,但是我觉得是有点可控的,而且呢,确实也不太建议大家在你常用的这个电脑里面去部署 这个工具。呃,你尽量找一个不用的电脑,或者说里面没有重要资料的电脑去安装,那有些人也推荐你直接部署在云端的一个服务器,找一个干净的服务器,但是那个也是需要花钱的。呃,我其实有一个办法,在用你正在用的这个电脑来去安装,也能避免一定的风险,就是 你去在你电脑里面开一个新的账户,然后这个账户和你的主账户是独立的,所以它里面的资料呢,可能就没有那么多是共用的了,所以可能能一定程度的避免掉可能存在的一些风险。 ok, 好 吧,那我们来直接开始吧,因为, 呃,其实我本来是想跟大家去介绍怎么去安装官方的这个 opencloud 的, 但其实安装官方官方的 opencloud 难度比较大,而且使用起来也比较麻烦,所以呢,我们现在包括我们团队几个人都已经转到国内的这几个啊,这个龙虾的工具了,比如说有这个扣帕,还有这个,呃,下面这几个包括腾讯出的, 呃,都是我觉得挺好用的。那首先第一个呢,我是比较推荐的就是这个扣帕,你也可以在百度里面直接搜索,但是你搜索的话可能会搜索到其他的。 呃,这个网站我给大家去演示一下怎么去搜索啊?你看你,你直接来搜索的话,可能会进入到这个网站,这个呃 b o t 的 这个网站,这个和我那个界面是不太一样,当然也都是大差不差,也都是。呃,操作方法都是基本上是一样的, 那我们就直接用这个网站,就白色底的这个界面。呃,这个网站来跟大家去演示一下这个网址在上面,然后我们选择用脚本安装,底下有这个 macos 和这个 windows, 我 们选择 windows。 windows 底下还有两个分支线啊,一个是 c m d, 一个是这个 palette, 然后我们选择这个会更快一点,其实都差不多了。然后我们在选择完了之后呢,这底下就会有一个有三行代码,你可以把这三行代码直接都复制下来,也可以一行一行复制,我们一行一行来吧,这样的话会操作起来会更轻松一点。 然后在我的这个 windows 电脑里面,我们点右键,然后点终端管理员,然后这个是有管理员权限的,把刚才复制的这个代码直接粘贴进去,直接粘贴进去,然后回车,他就会自动运行这个安装的这个过程了。 当然在安装的过程呢,因为这个写代码很多人可能是看不懂,或者说有一些问题会出现在安装,不知道会出现什么问题,因为每个人电脑环境是不一样的,所以如果说出现问题了,其实你也不用太担心,你就直接然后全选, 然后把这个代码呢直接粘贴到这个 ai 的 助手里面,比如豆包啊,千问都可以,你看不懂可以让豆,让豆包帮你翻译过来,你直接把这行代码就给它粘贴过去,然后它就会给你回复 这这所有的代码的用所有的英文字母都是什么意思?然后它里面讲了,你看啊,告诉你成功安装了这个扣怕,然后这个包括怎么怎么的,这些都已都已经完成了,所以你就可以继续操作了。那继续操作呢?你看他底下啊,开始初步使用的话呢,有这两个命令,这两个命令刚好和网站上这两个命令是一样的,所以 你就直接复制过来,把它再粘贴进去就可以了,这是正常操作的一个过程吗? ok, 我 们粘贴进来再回车, 他这一步呢是需要初步化这个工具。呃,因为他刚才是通过代码的方式把那些文件全部下载到电脑里面,但是你要稍微进行进行简单的设置,包括有一些安全风险的一个确认。好,这进来之后呢,第一步那你需要让你呃这个确认一下这个 呃相关的一个风险,然后我们直接点 yes, 要不 yes 的 话,你 no 的 话你就不装了吧。好,这这就直接跑完了。 呃,然后这里面的界面有一些参数,可能你们的电脑跟我电脑有一些不一样,但是大差不差了。完了之后呢,我们再啊扣怕 app 这两这个指令呢,就直接可以启动了 啊,我们回车直接来启动它。其实整个安装的过程你看着都在写代码,都是啊,好像这个代码乱乱飞,好像很复杂很麻烦,但其实没有那么麻,没有那么麻烦,是很简单的一个过程。 而且你用国产的这几个这个龙虾的工具的话呢,啊,真的操作界面啊,包括安装的过程呢,都比官方的要简单很多很多很多。好,我们跑到这最后会出现一个这个 ip 地址一样的这个呃呃指令,那说明现在就已经安装成功了啊。后面让让你这个 ctrl c 复制一下, 然后我们复制一下,直接在浏览器里面粘贴打开。好,这就进入到了 呃,这个抠怕的这个聊天的界面,因为刚才我电脑上是没有卸载干净的,所以进来之后你能看到我之前的聊天 对话都在,你看刚才我在问怎么怎么卸载,但你们如果刚刚安装完了之后,可能这个界面是空的,哎,你模型也没有,你是没有办法直接来去对话的,所以我们进来之后第一步呢是需要在左边,然后你看都是中文的,整个界面也是非常清晰嘛,在最底下有一个模型的选项, 这个模型里面呢,默认的时候你应该是比较干净的啊,包括这个这个摆链的,这个是没有的,没有大模型你肯定是没办法用的,所以这一步呢,我们就跟大家分享一下怎么去申请免费的大模型。比如 kimi 的 开放平台,然后还有这个智普的开放平台 啊,还有这个阿里云百链,包括英伟达的 ip, 这几个都是有很多免费的额度的,但是呢前面几个就算了,前面几个因为额度比较少,我就直接给大家推荐这个阿里云百链,因为这个呢,就是我觉得这个目前额度比较多的一个使用的这个这个呃方式, 然后呢我们直接呃就有网址了,当然你可以在百度里面直接搜阿里云百联点,点进来之后呢,我们直接呃点这个免费体验。 q 问,三点五或者直接点登录也可以,那因为现在没登了啊,进来之后呢,我们直接点右上角的这个登录, 登录完了之后呢,我们就直接点左上角的这个大模型,或者呢点这个免费体验。 q 问,三点五都可以,我们进入到这个里面的这个界面 啊,进入完了之后呢,其实现在这个界面底下你就可以直接用了,但是我们并不是直接在网站里面用,我们点上上面还是要点上面的一个模型,然后左边有一个工作台,有一个模型用量, 你就可以看到里面有多少了,你看这个超级超级多,总共有两百多个这个模型,每个模型有一百万的这个免费的 top, 然后加一块是多少呢?有两亿多的一个 top, 就是 你 普通用户和中路用户来用的话呢,完全是足够的。好,进来之后呢,我们先看一下这个模型,看一下你你刚注册好了之后,这边有多少啊?如果有很多,但是后面的开关都没开的话呢,你就可以挨个把它都打开,或者说批量把它开启一下,先需要开启一下,然后呢开启完了之后,我们点左边有一个秘钥管理, 这个秘钥管理我现在已经加了有一个秘钥,你可以点新建 api k, 然后选择用户,然后选择一个描述点确定, ok, 现在就有两个 api k 了,然后这边有一个直接复制的按钮,我们把这个 api k 先复制过来,然后有了这个 api k 之后呢,我们来到 这个配置的这个页面啊,就是这个摆链的这个,我们先把这个删掉吧,因为这个是免费的这个模型,所以上面这几个配置的选项是配置不了的。如果说你买了阿里云的这个啊,设置直接把 api k 输输入进去就可以了,但是我们免费的 a k k 是 sk 开头的,它付费的是 sksp, 所以 我们就需要手动添加这个服务商。添加服务商第一步呢,这里面其实不太重要,你只要随便取个名字就可以了,我们这个就是呃摆练吧, 然后底下这个默认的贝斯 u r l 呢,这个是比较关键的,如果你输错的话呢,是呃是进不去的, 所以我们就需要再回到阿里云百联里面,然后再找到上面这个有一个 api 参考, api 参考里面有一个准备工作,这个当然进去了这个页面就可以了。底下有一个这个 api k 的 这个贝色 u r l, 你 看到我们现在这个选的是啊这个华北北京的这个华北二北京的这个选项嘛,然后所以你就把华北二北京的这个 u r l 的 这个地址复制一下, 然后呢回到这里面把这个地址添加进去,然后直接点创建,点创建完了之后,底下你看这个地方就有一个阿里云百联了。创建完之后我们再点设置,需要把刚才我们申请的那个 api k 添加进来, 然后点保存,然后保存完了之后你还可以点一下底下链接测试啊,然后没问题的话就得点确定,但是这个时候还没完呢。还有还有一步我们需要选择模型,因为这个免费的模型他是没有办法拉取到这个服务器里面的这个模型列表的,所以我们需要手动的来去 给他确定我们用哪个模型。还记得刚才这里面有两百多个模型吧,对吧?我们就可以随便选一个,比如我选这个千万三点五二十七币吧,然后或者其他的,对吧? 千万三六五这个十七 b, 当然每个模型它的大小不一样,它可能的这个能力上限也不太一样,我们就先选这个二十七 b, 先试一下复制一下,然后再点添加模型里面直接把它再粘贴进去,这个不要写错了,写错了可能也加不进来。 好,现在直接就加进来了,我们点一下链接测试,看一下它现在也是连接成功。好,这个时候你可以添加好几个呀, 比如我们再添加一个千万 plus 吧。啊,对,就添加模型。好,现在你就添加了两个,添加完了之后呢?还没完。在上面我们回到这个 l m 这个配置的这个地方,我们选择摆链,就刚才我们添加的那个吧,再选择模型,你看到这里面就是我刚才添加的那两个模型,先确定 点保存好,现在呢就配置完了,你就可以正常跟他聊天对话了。当然我们这个免费的模型呢,他肯定不如那些付费的模型呃,能力那么强,那么好用,但是你玩一玩是可以的,你看现在就可以正常对话了,你能做什么? 你看他回复的还算挺快的了,那现在你可以看到他就有很多很多的都可以执行了,对吧?你可以问他个问题,你帮我呃介绍一下你自己吧。 就是目前来看你跟他文字对话好像跟豆包啊,跟千问啊,那那些公开公开的大模型好像没有什么区别,对吧?但是他毕竟是把它装在你电脑里面了,他是可以通过这个工具来去控制你电脑里面的所有东西的,他的能力上限是比那些豆包要更高一些的。 ok, 你 看到他现在,呃给你介绍了,刚才有这个思考的过程,也有这个简单的这个介绍,我让他自己来去展示一下自己的技能。我现在正在拍视频,我需要给网友介绍一下你这个工具到底有多强,我希望你能够呃来用一个什么呃例子来 正式展示一下你的核心能力,或者说让大家感觉到震撼的一个能力吧, 我这是通过语言输入法来输入的更快一点,来展示,来实时抓取网页生成文档,然后呢能够直接观看格式化,什么什么立竿见影,十几十秒就能出结果。你介绍的这几个效果感觉不是特别震撼,你能再介绍一下其他的吗?比如说控制我电脑之类的,这个感觉很酷, 你看到现在其实我们一分钱都没花,对吧?我们直接用了免费的大模型,然后呢把它装进去就可以正常来用了。你帮我看一下我电脑里面装了多少软件, 你帮我卸载 l l studio 这个软件我不想用了,现在完成了吗? 哎,好,现在完成了,其实刚才他在,他应该在执行。呃,我我我这个没看到,你再帮我看看现在电脑里装的还有多少软件 啊? l l f 四十六已经被成功移除,所以确实这就是他的这个可以控制电脑的这个能力。呃,我想再给大家演示一下,比如说让他去帮我去回复微博评论,或者说你们如果用的话呢,让他评论别人的微博,这个应该也是可以的,因为之前我已经用过, 我给大家演示一下怎么评论别人的微博吧。好,那差异,也因为现在我还是在本机来去用这个工具,就是还没有配置飞书的这个远程链接,所以呢,到现在其实你玩起来之后呢,你就明白它是什么意思了。你想要配住配置这个飞书的链接的话呢? 来去远程操作的话呢?现在网上也有很多很多的教程,你可以参考一下,所以后半段呢,我也可以给大家演示一下,用一个新的飞书账号怎么样去配置,然后我现在给大家演示一下,就比如说评论别人微博的这个,这个能力啊,我想让你帮我评论微博, 就我给你一条微博的链接,你帮我直接评论,我可以配合你登录微博,你能做到吗? 这个就需要一系列的操作,它需要控制你的浏览器,它需要理理解你微博里面的内容,等等等等。啊我,我现在微博 啊,我不知道这个电脑上有没有登微博啊?登了登了,好比如说你看这个飞叔也,呃,这个也在聊这个事情,我把飞叔的这个飞叔,飞叔的这个微博链接复制过来,然后给他, 你帮我看一下这条微博的内容,然后呢智能回复这条微博来评论一条 啊,我说的有点乱啊,大,大概意思是这样来看一下当中的直接操作,这个有可能他第一次呢,可能操作不了,你需要反复的给他一些指令,然后让他强制他,你自己干,你们自己想办法,有什么问题自己解决,然后他就会自己解决。哎, 好了,现在已经它它自动会打开一个浏览器打开的。是啊,打开一个新的浏览器,但这个浏览器我没有登录,对吧? 你看它现在已经已经把这条微博的呃发送人,然后吐槽就是它的发的内容,然后现在未登录状态,然后它底下给我几个方案 a, 怎么评论嘛,对吧?幽默型, 然后可以登录操加发布,我就我现在先登录一下,我登录成功了,你可以按照呃这个共鸣型方案 a 帮我回复一下这条微博, 并且在回复的内容后面加上龙虾的图标,加上龙虾,这样的话就代表不是我回复的嘛。 哎,来了,嘿嘿嘿,评论现在已经写好了, 好,发送成功,哈哈哈哈,发送成功。呃,当然这个可能是我之前已经训练过,它就可以正常来操作,因为刚才卸载没有卸载干净嘛。 就如果说你遇到了你,你让他评论或者说他不会怎么操作,他需要他,他又说 api 这个这个的那个的问题,他需要让你自己来去操作,你就告诉他,我不想手动操作,我就需要你来帮我完成,请你自己想办法解决。呃,遇到的各种各样的问题,他就帮你想办法解决了,或者他给你几个方案,你选择一个方案也可以。 对,大概就是这样的,嘿嘿,是不是挺有意思的?好,那除了这个之外呢?你也可以让他去呃搜索网上的一些资料,对吧? 呃,你帮我看一下今天的微博热搜都有哪些内容,然后。呃,当然大家担心的那个问题就是安装好了之后怎么卸载,其实也很简单,怎么卸载你不会,你可以问问这个。呃,豆包,你也可以直接问这个抠派的他自己怎么卸载 好。现在直接把微博的热搜给我列出来了,你帮我筛选一下科技相关的热搜,并且帮我把每一个呃话题都写一个相对比较专业的文案 好了。来了, oppo 可乐大反转让啊, ai 阵的领域什么什么大变绝大反转,怎么怎么地?当然它现在写出来呢, ai 的 味道很重, 他没有太口语化表达,你可以告诉他你口语化表达,然后或者呢,你就把我的微博啊,就按按照我的角度来说,把我的微博的链接给他,让他去读取我曾经发微博的这个口吻和这个这个习惯,让他按照我的口吻再去写这个微博的文案, 那他可能就写出来更像我风格的那种感觉一样。所以这个的话呢,相比于之前的那个豆包,还有那些前文,那些呃,大冒险的工具,他 区别就是第一个可以控制你的电脑,第二个他的能力上限非常非常大。第三个呢,他是有自己的记忆的,就是你今天跟他对话所有的内容,包括你教他的所有的技巧,他的你的使用习惯,他在本地是有记忆的,他会记下来你曾经是这样的一个对话风格,你是这样的习惯,你是这样的一个人,怎么都可以, 这个真的像一个你,你养的一个机器人一样,或者怎么样,它真的越会越用越好用。好吧,那接下来我再快速的跟大家讲一讲怎么去配置这个飞书的这个对话链接啊。 再回到这个 q pad 的 这个界面,我们点这个右边的频道嘛,就是控制底下频道,就是呃,找到飞书,然后就把这个 id 和这两个,这两个串码全部加进来就可以了。 好,我们打开这个应用,因为它只能用飞出客户端打开,所以我们要跳转到这个飞出客户端里面去,然后你看这个,呃,抠怕的这个机器人就有了,就你取的这个名字吗?然后你好,我看一下有没有连接成功, 哎,你看它有一个小键盘,正在回复,正在打字,就说明已经连接成功了,哎,它还有,哦,这个还有消息已经连接成功了,对吧? 卧槽,你给我弹出这么多消息,它在测试这个连接, 哎,他这个对话在哪啊?在这他会新建一个对话,所以按照刚才的那个那个逻辑啊,呃,你比如说我们在,我们,我们在找一个来黎叔的微博复制一下, 这个时候,这现在我们就是通过飞书来给他发的,所以这个时候你通过电脑的飞书或者通过手机版的飞书都是可以的。你帮我评论一下这条微博,呃,需要智能的回复,不要太水哦,忘了让他在后面加上那个什么了,加上那个,呃,就是龙虾的那个 logo 了。 卧槽,他速度好快啊。但这个消息有点吵啊。好好好,来了,评论好了哦,这是林叔收房。哎呀,不要吵了,这是林叔收房,收房通知啊,买房了 好吧,哼, ok, 反正大概就是这样的,所以你就到到现在为止,我们是一分钱没有花。把龙虾布置好,然后对接了飞书,然后对,也用了免费的大模型,然后就成功的跑了起来,然后也可以帮你完成很多的任务,然后我们现在回来啊,刚才我们用的是哪个模型忘了, 我刷新一下看看这个模型的消耗,哎。刚才用的这个二十七 b, 这个你看已经消耗。刚才是,呃,顶到头了,你现在就已经消耗这么多了?我现在的 token 消耗是这个状态,我再发一条消息,你随便搞一下,然后我看看能消耗多少。 呃,好吧,他就随便回复了一个消息,我们再刷新一下,看看差了多少。 有没有那么快更新啊?不知道,还是七四九。这个应该没有那么快更新。 呃。不过没有关系了,就如果说你只是玩一玩这些 token 绝对够你用了,完全不需要花钱。但如果说你要深度的去使用的话呢,你还是再买一个模型,这里面可能不够用,或者说它模型的这个大小啊,这个能力没有那么高。呃。可能没有那么好用,所以就看你自己了。 呃。就如果说只是入门的话,就是这样就 ok 了。如如果你玩腻了你或者说你担心这个东西有没有风险,想要卸载,你可以问他, 我想卸载你这个工具应该怎么操作?我要彻底的卸载,一点都不留啊,一点都不留。 好吧,他现在就开始自己想,哎。怎么样去卸载,用什么代码,然后怎么能彻底的卸载?那除了这个国产的这个抠怕的这个呃呃。龙虾以外呢?其实还有挺多都是挺好用的。还有腾讯的这个。呃。沃克巴蒂,这个沃克巴蒂呢 会比这个会更简单一点,因为它里面内置了一些免费的呃 token 的 额度,所以你装完了之后呢?不像我刚才在去布置各种各样的这个呃插件啊,或者说这个模型的服务商,你下载之后马上就可以用了。 呃。那个也会更好玩一点,然后还有其他的,但是底下这个 easy 可乐,这个,还有这个元气 ai, ai bot, 这这两个我是不推荐的,因为这里面 它是锁定了它官方推荐的几个模型是没办法改变的,你必须要付费才可以。那个是我不太推荐啊,所以上面这几个呃都是比较推荐的,所以大家可以来玩一玩,试一试,其实挺好玩的。好吧, 如果大家布置好了你自己的这个龙虾之后呢?简单玩一玩,记得也可以按照我刚才那个方式来我们微博来发一条评论啊,来我们这条视频底下发一条评论,让我来看一看你有没有发送成功。

420科技小辛