bitnet部署实测效果

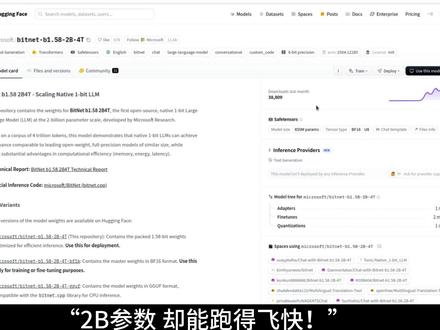

有一种技术,可以让一百 b 模型在普通笔记本上流畅运行,这是微软开源的 bitnet 带来的真实突破。当下完大模型的核心痛点, gpu 成本高、云浮雾慢、本地部署难, 不少电脑连五 b 模型都跑不动。而 bitnet 凭借微软研究院的技术,将模型权重从三十二位压缩至一点五八位,存储量直降百分之九十五。实测数据亮眼, arm cpu 上速度比常规模型快一点三七到五倍, x 八六 cpu 快 二点三七到六点一七倍,能耗最高省百分之八十二,推理速度达每秒五到七个 token。 该项目 gitap 已获二十七点七 k 加星标。微软官方维护,适配 falcon、 三拉玛三等主流模型,二 b 参数官方模型可直接下载运行。想体验笔记本跑大模型,地址放评论区了。

粉丝4368获赞3.8万

相关视频

02:19

02:19 00:49查看AI文稿AI文稿

00:49查看AI文稿AI文稿大魔星跑在普通 cpu 上彻底不用显卡。微软酷步 bitine 技术彻底打破了运行大魔星必须高端 gpu 的 铁律,直接把模型参数精减到负一 零加一三种状态。二十亿参数的模型,零 gb 显存就能跑,迁移模型也只需十 gb 左右,内存计算从浮点乘法变成了整数加减法,这是 cpu 最擅长的活,从复杂高数题变成了小学算术,实测推理速度提升两到六倍, 能耗降低百分之五十五到百分之八十二之间,每秒五到七个毫克,阅读速度完全够用。这可不是事后压缩,而是从头开始 用三进制训练,性能和传统模型比也几乎没差。最狠的是,微软直接开源了比特 a p p 框架,三行代码就能在老旧笔记本上上千亿大模型, gpu 不 再是入场券。 ai 平民化的时代真的来了,你的电脑准备好了吗?你怎么看?咱们评论区聊聊?

33咨钛服务器硬件 00:37查看AI文稿AI文稿

00:37查看AI文稿AI文稿想在普通的轻薄本上流畅跑千亿参数的大模型,微软开源的 b d net 框架直接把桌子掀了,短期狂揽三万多新。它的杀手锏是极其暴力的一点五八比特底层量化技术实测单 cpu 提速最高突破六倍,同时能耗暴降百分之八十二。 最恐怖的是,它居然能让一千亿参数的超大模型在一台普通 cpu 上以人类的阅读速度丝滑出磁!而且现在已经完美兼容了 gpu, 像 nma 三等主流一 b 体模型,直接拿来就能跑!极低功耗,极致榨干硬件算力观测 ai 真正的硬核拐点就在这儿!

46禾苗 06:14查看AI文稿AI文稿

06:14查看AI文稿AI文稿微软研究院正式公布, bitnet 系列技术与 bitnet cpp 推理框架的最新突破,彻底打破运行大模型必须高端 gpu 的 铁律,普通笔记本、台式机的 cpu 就 能流畅跑千亿参数大模型,无需独立显卡、无需海量显存, ai 普及的最后一道硬件枷锁被彻底砸碎。 这不是简单的模型压缩,而是从计算架构、训练逻辑到推理引擎的全链路重构。微软让 ai 从云端走向每一台普通设备,端测 ai 的 平民化时代正式到来。 过去五年,大模型从实验室走向大众,却始终绕不开一个核心痛点,硬件门槛高到离谱。传统大语言模型基于普点计算架构,参数以十六位、三十二位普点数存储推理核心是海量普点矩阵乘法, 而 gpu 凭借海量并行计算核心成为浮点运算的最优解,也因此垄断了 ai 算力市场。 想要运行七十亿参数模型,至少需要二十四 gb 显存的高端显卡,千亿参数模型更是需要 gpu 集聚支撑,单台设备根本无法企及。高昂的成本让 ai 变成了富人游戏。一张高端 ai 显卡售价数万元,中小企业部署一套大模型服务,光硬件投入就高达数十万 个人,用户即便想本地运行轻量 ai, 也得被显卡价格劝退。更无奈的是,算力功需失衡,显卡缺货涨价, 让无数想要拥抱 ai 的 中小团队、传统行业被挡在门外。与此同时,绝大多数用户手中的设备都只有普通 cpu、 笔记本的低压酷睿、台式机的入门、瑞龙功控机的老旧处理器,这些无处不在的算力,却因为不擅长浮点运算被排除在 ai 运行体系之外。一边是 gpu 资源稀缺价格高起,一边是海量 cpu 算力闲置浪费, ai 行业陷入了畸形的算力困局。所有人都在等待一个答案, 让 ai 摆脱对 gpu 的 依赖,用最普通的硬件实现最流畅的运行。微软给出了终极答案。 微软此次突破的核心不是对现有模型的修修补补,而是彻底推翻传统计算逻辑,用三净置架构重构 ai 模型,让计算方式完美适配 cpu 的 能力边界。传统 ai 模型用二净置浮点存储参数,每个参数占用十六位甚至三十二位空间, 不仅占用海量内存,计算时还需要复杂的浮点乘法,这正是 gpu 的 强项, cpu 的 短板。而微软 bitnet 技术创新性采用平衡三进制,将模型权重简化为负、一、零加一三种状态,从数学上实现了极致精简, 相比传统十六位浮点数,存储效率提升近十倍,模型体积压缩至原来的十分之一至二十分之一。这一改变直接解决了两大核心难题。第一,内存需求断崖式下跌,二十亿参数的 bitnet 模型仅需零 gb 内存即可运行, 千亿参数模型内存占用也仅十 g p 左右,普通电脑的内存就能轻松承载,彻底告别对高显存 g p u 的 依赖。第二,计算逻辑彻底适配 cpu。 ai 推理最核心的矩阵乘法运算被转化为 cpu 最擅长的整数加减法,无需浮点运算单元, cpu 的 整数计算能力就能完美发挥, 相当于把复杂的高等数学题变成了简单的加减运算,再普通的 cpu 都能轻松应对。更关键的是,微软采用原生 e b 子训练,而非事后压缩。 传统模型压缩是先训练大模型,再强行精简,必然导致性能损失。而 bitnet 从训练之初就基于三进制架构设计,通过全精度预训练、加量化感知、微调加 e b 推理优化三阶段流程, 在精简体积、降低算力需求的同时,性能与同规模全精度模型几乎无差异。实测数据印证了这场革命的威力。在 x 八六架构 cpu 上, bitnet 推理速度提升二到六倍, arm 架构 cpu 上加速比达一到五倍,能耗降低百分之五十五到百分之八十二, 单个 cpu 就 能实现每秒五到七个 token 的 推理,速度完全匹配人类阅读节奏、日常问答、文案创作、代码生成等场景,流畅度丝毫不输 gpu 运行的大模型。 技术突破之外,微软更用开源的姿态让这场革命快速落地。同步推出的 bitnet 点 c p p 推理框架,是专为大模型打造的极简推理引擎,支持 x 八六 arm 全系列 cpu 无缝兼容 llama 点 c p p 生态与 hugenface 模型库,部署门槛低到极致, 无需复杂配置,无需专业知识,普通用户只需三行命令,就能在自己的老旧笔记本、台式机上本地运行千亿参数大模型, 没有显卡、没有高显存、没有云端算力,纯 c p u 驱动 ai 就 在本地运行,数据不离开设备,隐私安全拉满。对于开发者而言, bitnet c p p 提供极致优化的内核 支持,算子融合、混合精度计算,无需重新训练模型,就能将现有大模型适配三进制架构,快速开发端侧 ai 应用。 对于企业而言,无需采购昂贵的 gpu 服务器,利用现有办公设备就能部署本地化 ai 服务,硬件成本降低百分之九十以上, ai 转型零负担。目前, bitnet 二 b、 四 t 模型已在哈根 face 开源, 全球开发者都能免费下载测试、二次开发。从苹果 m 二笔记本,到入门级英特尔酷睿台式机,再到嵌入式功控设备,所有带 cpu 的 设备都能变身 ai 终端。这场无需 gpu 的 ai 革命,带来的不是技术迭代,而是行业格局的彻底重构。 从浮点计算到三进制精简,从 gpu 专属到 cpu 通用,微软的突破,标志着 ai 行业从拼硬件走向拼效率,从云端集中化走向端侧平民化,这不是终点,而是全新的起点。 微软表示,未来将持续优化 bitnet 技术,扩展支持 npu 移动端芯片,进一步提升推理速度与模型性能,让更小的设备、更低的功耗,运行更强大的 ai 模型。 曾经我们以为运行大模型必须高端显卡,曾经我们以为 ai 是 遥不可及的黑科技。如今微软用技术证明, ai 的 终极方向不是堆砌算力,而是普惠众生,不是依赖专用硬件,而是适配所有设备。这场由微软开启的算力革命,正在砸碎 ai 的 硬件枷锁, 一个人人可用、无处不在的普惠 ai 时代正式拉开大幕。对于每一个开发者、每一家企业、每一个普通用户而言,无需等待,无需观望,准备好你的普通电脑,迎接 ai 平民化的全新未来。

3291老林白话财经 00:26查看AI文稿AI文稿

00:26查看AI文稿AI文稿ai 速报局今日速报终结 gpu 霸权,微软比特莱特开源 cpu 能跑百亿参数大模型推理速度狂飙六倍,核心靠一点五八比特三元权重加四位激活量化 x 八六 cpu 加速六点一七倍, a r m 加速五倍,能耗降百分之八十二 二十亿,参数模型仅占零点四 g b, 还能流畅跑朗玛三七零 b, 手机传感器、笔记本等边缘设备直接安装,微软大模型持续发力。

575极AI速报局 04:49查看AI文稿AI文稿

04:49查看AI文稿AI文稿开源项目 open c i i, 它能把网站变成一条终端命令,让 ai 一 阵特直接调用。我们实测对比它和两个工具 open k i s 和 bb browser, 看看谁最快、最稳、最好用。 先看结果,我们设计了三个测试任务,搜索 b 站热搜在什么值得买,平台搜内存条推荐,以及跨微博、知乎、新浪财经搜索政务信息。 速度方面, open kylie r s。 全面领先,必战热搜 open c i l。 用了二十三秒, open kylie r s。 只要十秒,什么值得买?六十七秒对二十九秒多平台汇总五十五秒对三十五秒, 基本都是两到三倍的差距,但 tiktok 消耗两者几乎一样,说明速度差异来自工具本身,不是因为调用了更多大模型能力。 稳定性上, open c l i 三次全部一遍成功。 open clear r s。 在 第三个任务里,知乎热搜失败了,触发了重试。 bb browser 因为和 openclo 的 参数不兼容,三个任务全部没跑通,这是一个已知 bug。 具体原因, b b browser site 传递了 timeout 参数, opencloud tabx 命令不支持这个选项。在 github 上已有用户提出了这个问题,目前还未修复。什么是 c l i 化工具?这类工具到底在做什么?一句话,把原本需要打开网页,手动点击才能拿到的数据 封装成一条终端命令,本质就是给没有 api 的 网站造一个 api, 再套上命令行的壳。它和传统爬虫最大的区别是,爬虫是给程序员用的一次性脚本。 c l i 画工具是给 ai 用的标准化工具箱, agent 执行一条 list 命令,就能发现所有可用工具输出格式统一一可以直接为给下游处理,而且它附用你浏览器的登录状态,不存密码,不管 gucci 过期 风控也低。原理分五步,第一步,找数据接口,你在浏览器里看必占热榜,背后浏览器一定发了某个请求, open c i i 在 后台拦截所有请求,分析哪个数据包装的是热榜内容,找到隐藏的接口地址。 第二步,搞定身份认证,它不自己登录,直接借用你科目里已有的登录状态,和你手动打开网页没有区别。第三步,写适配器,把整个流程写成一个三十行左右的配置文件,请求这个地址,取出列表,保留标题和播放量,截取前十条 以后,每次执行命令就自动走一遍。第四步,处理复杂情况。有些网站需要滚动加载,或者数据藏在页面代码深处,这时候就往网页里注入一段小程序,模拟操作,把数据掏出来。第五步,终端和浏览器怎么通信? 靠一个 chrome 插件当传话人,命令从中端传给插件,插件在浏览器里执行,拿到数据再传回来。底层架构分四层,第一层命令解析,第二层,适配器加载,第三层,浏览器通信。第三个工具的差异主要在中间两层, open c l i 启动时要扫描加载所有适配器文件,通信要经过守护进程和扩展两层中转。 open k l s 在 编译时就把适配器打包进了程序本体, 启动零开销,而且通过浏览器调试协议直连,少了中间层,所以快两到三倍。 b b browser 走了另一条路,它自启动一个专用的 chrome, 十六,完全隔离, 如何部署与使用?部署方式是四 q 技能包加浏览器插件的组合。我们找到 open cai 的 开源地址,使用官方命令通过 npm 安装,然后下载 playrite mcp bridge 扩展。 下载解压后,打开浏览器的插件管理页,开启右上角的开发者模式,点击本地文件,把解压后的文件上传。当前是 open c i i 一 点四点一版本, 运行 open clea doctor 命令,检查一遍,没有报错。克隆 open clea 技能包放到 skills 文件夹下,安装完成,就可以直接给 open clea 下达任务了。 open clea 二 s 部署步骤类似, 首先执行一键安装脚本,安装完成,然后去他给的网址下载对应系统的扩展文件。和 openkly 的 一样,解压并上传 openkly rs 的 技能包,只有一个 markdown 文档,告诉 agent 如何用这个 skills b bbrace 也是 n p m 一 型命令,它的 open 克拉集成模式无需安装扩展,但目前有兼容性问题。需要特别注意的是,工具的浏览器插件目前仅在 google com 上验证可用。最后总结, open c i i 功能最全最稳定, 六十一个站点,三百五十五条命令,三次测试零失败,适合大多数用户。 open cle 二 s 速度最快,最轻量,但稳定性稍弱。 bbbzy 的 open 跨集成存在已知 bug, 建议观望。希望本期视频对您有所帮助,我们下期视频再见。

392AGI_Ananas 09:25查看AI文稿AI文稿

09:25查看AI文稿AI文稿hello, 大家好,我是搞量化的布欧,好久不见哦,我可想死大家了,最近呢这个龙虾非常的火,然后呢很多老板找我问我怎么搞这个 ai 交易,呃,我总结一下吧,其他东西我觉得不靠谱的哦,然后我给大家推荐一个更实际的 ai 部署平台, 然后他呢就简单有效,大家也不用累的半死,到处去折腾了。第一,他是商业运营的对吧?跟那个 tv 一 样稳定,而且,而且也很便宜哦,怎么算的,比你买那个托管划算,而且他是比较成熟的系统。第二呢,你也不用写代码,直接就可以用, 功能也是非常的强大,我就打开给大家看一下,是吧?大家看到的这个界面就是他的操作面板哦,哎,你登录之后呢,你就点这个创建策略, 他是这样,他这里有非常非常的策略,大家点这个创建策略之后,然后我建议大家刚玩呢就选一些简单的, 比如折十类的吧,是吧?比如我们选这个 e、 d、 h, 那 么你选了之后呢,这就会看到整个工作流,然后首先就是收集数据,对吧?数据收集之后呢,就一个因子,它这里用的是 它自定义了啊,它整合了很多很多的因子,然后你也可以自定义的话,你也可以从这里直接调就好了, 我们再用他默认的默认,他写好了,然后数据因子把数据处理好之后呢,再用这个模型去跑,那么他这个模型呢,这里有充分的解释啊,就是哪些模型做哪些事,他这个模型呢就是做时序的,所以一般做时序都是用这个模型 啊,这个文档非常的详细啊,大家就即使你不用他的平台,我觉得大家也应该去看一下,非常的专业。然后这个模型预测之后呢,他会把结果输出在这个列上,然后你就这里的话就是整个策略执行层面了,然后你就可以比如说开多的条件,就是我们刚才这里,对吧? 开多的条件,那就是他这个参数只要大于零点二五就开多,然后他小于负零点三,就在水下的时候我们就平掉下去,对吧? 啊?不对,他是大于零点二五的时候就开多,然后这个是开空的条件,这水下就开空,然后这是屏多,对吧?这是屏空。然后场位管理,这里也可以固定子音哦,刚开始你就用固定子音,也有也可以用网格的模式,就比如加多少层仓位, 有点类似那个 dca 吧,对吧?这里你刚玩你就普通模式用最简单的来这里是风险控制,然后 不亏老要超过百分之十五,他这个是整个账面层面,账户层面就会给你全部平掉,平掉之后呢?然后有个冷却器,对吧?这个也是非常实用的功能。 ok, 这个流程走完之后呢,到最后就是交易引擎,你是用回测还是实盘?这里我们就一开始肯定是回测,对不对?我们先回测试一下, 他这用的是备案交易所啊,资金太多了,收个一千吧,他这个是手续费,划点都要算进去啊。毕总看看大家收个五盘一的话,有时候会保证金不够啊。然后数据员这里备案现货,大家用 u 百分合约吧, 然后保存保存,然后我们就运行看一下,好吧,这里它有免费的,有收费的。呃,现在用的人少,我们就免费的就好了 啊。这里报错了报错了,我们看一下它不支持资产 btc, 那 这是怎么回事呢?因为我们这个数据源的时候选的是 btc 哦, b t c 就 可以不要了,因为我们做的是以太反的那个来保存一下啊。确定保存?我们再看一下吧。数数据源用以太反数据 看一下这个音质,它音质里面也没有准备用哪个 b 是 吧?这个也不影响模型的训练 找特征啊,也不影响策略看上时机,平常时机也不影响主影之水也不影响 风控也不影响为侧。看一下用的是这个是 k 线啊,这个是 tik 机,然后我们这个的话就没有没有必要用这个 tik 机了,就直接 k 线就好了,毕竟是超低频的策略啊。然后 这是一千四加双向时差,嗯,没有问题了啊,然后我们再保存运行一下, 那个有点慢哦,因为毕竟是用的是他免费的那个尾测服务器,现在已经开始正常工作了,对吧?开始计算因子了,收集数据,数据收集好了就开始因子计算,下一步应该就是训练模型了,找特征 这种找到了就打分是吧?打分,然后用这个打的分再去做折十。咱们耐心等一下啊,回头出来那是一单都没有开对吧?一单都没有开,那我们看一下怎么个事, 有问题是好的,我就特意要找这种有问题哦,大家看哦,这个预测的值结果在这里,对不对?大家看零点零二,负零点零二负零点零一, 我怀疑哦,我怀疑是这个策略,这个条件太苛刻了,我们可以改成零点一二,对吧?我平常的话就零点五吧, 开开空也一样哦,负零点一二,然后大于零零点四零点二吧,那我们这样子改一下好不好?保存,然后我们再回测一次, 重新训练,下一步确认启动他。这个很有意思啊,就就大家看这个这个因子这里有结果,是吧?大家可以看一下,能学到很多东西啊,对吧?大家玩这个东西 比你稀里糊涂的用什么龙虾,我觉得靠谱多了,就暂时来说肯定是更靠谱的。那现在已经开始有止损有止盈了,对吧?我们等结果吧,我们等结果的时候可以看一下这个,看一下它这个文档。 这个这个模型是干嘛的?乖乖一样的哦,那奥分类这个 这种类型就不管你哪个模型,他都更适合做这个预测。闪电看下好了没有?嗯,十七马上就好用的。 k 线是一小时的对吧? ok, 大家看好,这个数据已经出来了,对吧? 呃,不是很漂亮,但是大家要自己优化一下,对吧?这一段还是跑的非常漂亮, 就是从这个二月份到六月份,那这个参数我是乱填的,对吧?大家自己优化一下,然后刚才我我还看了下他其他的策略啊,比如说这个超买超卖的回测了一下, 当然这种策略这个参数大家都可以自己调,对吧?像这个的话就中间少了这个 ai 的 直接数据,处理完就直接就折折时了,然后时间问题就回头我有什么好的策略,或者说我玩出什么新的花样,我在录视频跟大家讲,主要是给大家推荐工具啊,如果你之前就是 tv 的 众多玩家,你过来过来玩这个就非常合适,他也不用你写代码,对吧?但是这个策略逻辑呢,你最好还是要有点基础的认知哦,就实在不懂就问一下 ai, 反正现在知识都平全了,对吧? 不过你要非常,你要实盘呢,也非常简单啊,就比如说现在这个这个策略会这样,假设你满意的情况下,你要实盘,你就选这个实盘,然后这个一定要选这个实盘,然后添加你的交易所账号, 这里的话就给你是币啊,你就填币啊,然后 api 一定要摆绑定你的这个 ip 白名单,那么这个白名单哪里呢?就是你要租他的服务器,你要租他服务器,是吧? 如果你用我的那个邀请码,就是我的邀请码,就是布尔沃,你用我的邀请码注册的话呢,他们直接会送你石油,然后你 这个差不多就二石油一个月吗?对吧?然后你就再掏个石油,就可以租租,租个亚马逊的服务器,这个亚马逊的服务器比较贵啊,但是会很稳定。然后他们平台呢,也是你自己不用去部署了,像发明者那样,可能你自己还要部署, 买了之后呢,买了之后呢,他就会分配一个 ip 给你,到时候你把这个 ip 一定一定要填到这个,填到这个交易所 那个 api 里面,对吧?然后再把 api 填到这里就可以了啊,这样就可以撕完了,然后就大家自己琢磨一下吧。好吧,有什么不懂的也可以咱们一起在那个群里面聊一聊。嗯,策略他这里有一些演示的, 大家都可以参考一下,但是我觉得直接拿来用不现实啊?不现实,特别是有动量一些什么的,哎,这个这个有,这个看一下,看一下他用的是什么音质 原声屏哦,它这个还用了 o i 变化,对吧?所以它这个这个比 tv 呢又专业很多。 ok, 视频录到这里吧,因为好久也没录视频了,就祝大家二零二零年发大财,好吧。

145布欧的量化日记 02:58查看AI文稿AI文稿

02:58查看AI文稿AI文稿呃呃, 大家好,今天我们来测一下 step 三点五 flash 这个模型。这是一个没什么人关注的模型,但是也是我们国产的哟, 官方表示它在小餐数量的前提下,实现了较高的智力水平。这是一个一百九十九币餐数量的模型,在国产开源模型里算是比较小的那一档。 官方的扳指 mark 里,代码部分的得分有七十四点四,属于是相当不错的水平,同时智能体的能力也很不错,在国产模型里属于出类拔萃,触类旁通 测试已经给你们跑完了,使用的是昂斯洛斯的 iq 三叉叉 s 量化的模型,该量化下模型的大小是七十八 g, 模型本身不支持多模态,只支持文字的输入。 这是一个混合专家模型,激活参数量是十一 b, 所以 推理速度方面也是相当快,属于可以接受的一档。 这里我们可以看到是三十三个 tokens, 每秒回到测试得分部分,最终得分是七十八点一分,超过了 dsp 三点二和 cldsonnet 四, 去掉上下文和多模态的话的是分七十四点一,甚至超过了 cloudsonnet 四点五。从得分的分布情况来看,这是一个问答和代码能力都非常强的模型,可以看到中英文创意写作得到十七分,其中中文八点七分,英文八点三分, 应用文写作则是十八点五分,大家可以自行查看子项分数,数学几何和物理则是十八点八分。最后是代码能力得到了十九点八分,虽然算不上顶尖,但是也算是可用。 下面我们来看看他的代码任务的展示,并拿出千万三二十七币的筹密模型作为对比,在 svg 动画方面,两个模型算是各有千秋,虽然存在诸多问题,但是毕竟是一个很困难的项目。 下面是手机操作系统,其实两者的最终实现效果似乎差不多,都是开源小模型的第一梯队水平。 python 六边形小球任务我个人觉得还不错,但是 cloud opens 则是打了个五点五的低分。 总的来说, step 三点五 flash 是 一个非常厉害的模型,在各个方面的表现都非常出色, 不支持多模态有些可惜就是了。如果我们把几个国产模型拉出来的,我们可以发现 step 三点五其实和他们差不多。注意,这里的 step 三点五 fly 是 经过了很大的量化,性能肯定是有下降的,但是即便如此, 得分也超过了 cloud 四,这意味着大家可以在家里完全离线和百分之一百隐私的场景下使用和 cloud 四一样的模型。曾几何时,这可算是一种奢望呢?

67AI踩坑指南 11:53

11:53 03:26查看AI文稿AI文稿

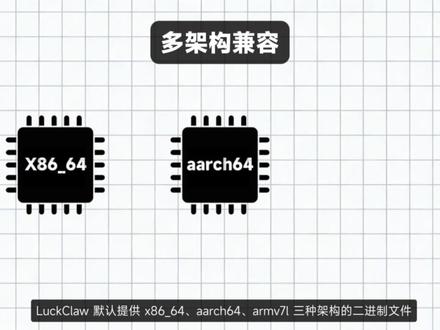

03:26查看AI文稿AI文稿上一集我们简单介绍了 lock 的 核心功能和适配优势,相信大家已经对这款轻量 ai 助手有了初步了解,这一集我们就手把手教大家如何快速部署 lock, 全程步骤清晰,操作简单,新手也能轻松上手。 拉卡默认提供 x 八六六十四二七六四、 rmb 七 l 三种架构的二进置文件,无需手动下载翻译,确保系统支持 http, 使用官方提供的脚本就能实现一键部署适配 lock fox 开发版及各类 linux 主机,我们只需要在终端输入这条快速部署命令,输入完成后回车直行即可。后续我们会在 lock fox 微提中进行查看, 脚本会自动完成环境检测、程序安装和架构适配,全程无需手动翻译,无需额外配置,我们耐心坐等执行完成就好。 安装完成后,我们直接在终端输入了 call config, 回车就能进入交互式配置向导。在这里我们可以一站式完成 agent 核心参数、大模型、厂商、消息渠道、网关工具 等所有核心配置,全程可适化引导,不用手动修改繁琐的配置文件,新手也能快速完成。 接下来是核心的大模型 api 配置环节, luck claw 支持接入多款主流大语言模型,包括 openai、 antropics、 deepsea、 质朴清盐、通易签问等,也支持本地部署的 olem。 我们只需要在配置向导中选择对应的模型厂商,填入你在对应官网申请到的 apikey, 就 能完成模型对接,全程不到一分钟。 luck 支持接入 qq、 企业、微信、 telegram、 discord 等多种主流社交平台,无需额外开发,仅需简单配置就能实现跨平台 ai 交互控制,适配不同使用场景。 这里以 qq 为例,给大家演示其他平台的接入,可以参考官方文档。首先我们打开 qq 机器人,官方平台地址已打在屏幕上,用 qq 扫码登录后,创建属于你的 qq 机器人,自定义头像和名称,创建完成后就能拿到机器人的 apple id 和 secret 密钥。我们回到了拉克的配置项导,找到 qq 渠道配置项,开启渠道开关,填入刚才获取的 ipad 和 secret, 就 完成了 qq 平台的对接。 所有配置完成后,我们执行了拉克 get 为 f 命令,前台启动多渠道网关服务。 服务启动成功后,我们打开 qq, 找到刚才创建的机器人,就能直接开启对话,体验这个清亮 ai 助手的全部能力。不管是日常问答、工具调用,还是远程终端控制、自定义技能都能轻松实现。 以上就是了 club 的 完整部署流程,步骤简单,全程实操,大家跟着做就能轻松落地。更多进阶玩法和详细说明都可以在项目 github 仓库的 wiki 和文档中查看。部署过程中遇到问题也可以在仓库 issue 中提问,别忘了给项目点个 star 支持一下,我们下期再见!

28微雪电子

猜你喜欢

最新视频

- 1239禹年电子