小龙虾配置私有大模型

上个视频已安装成功了 gcloud, 我 们现在开始配置大模型,这里将会是操作,请手动在终端运行,把这一段代码 拷贝,打开终端, windows 可能不是终端, windows 对 应的是 power c 脚本工具,粘贴好点确认,等待安装好,这里有风险提示,选确定这个选择快速可启动啊,这里选择模型,这里千万记得选千万,这快捷,之后 点确认登录,要登录你的账号或者新注册的账号,手机号码都可以。好,这里选择魔镜,这是选择 渠道,我们是先跳过,后续我们可以教大家来连接飞书,这个搜索也不用配置这些 skills 也先别配置,可以跳过这里,注意是空格,选中,然后回车确认,我这里记录过,所以我选的是瑞斯达。大家应该是打开 选择的模式,有外部以外,他就在我们的外部上启动的那个界面,大家就可以可以测试,可以试一试了,这就完成后续跟大家介绍那个飞书,飞书 啊,以后还有更多的技巧去分享,希望大家持续关注。

粉丝174获赞228

相关视频

01:14查看AI文稿AI文稿

01:14查看AI文稿AI文稿给你们介绍一下哈,这个是微软最新出的一个小模型吧,这个模型它只有七 b, 就是 说基本在任何的轻薄本上它都可以正常的去运行,但是它不是那种传统的 那种聊天机器人啊,它是为了去让你的电脑自己操控自己,你看专门为计算机设计使用的代理小语言模型 只有七十亿参数,他的意思就是说你不需要把你的数据上传到云端,然后让那边处理之后再告诉你你的电脑该怎么操作自己,而是他自己就能通过这个小模型运行在本地,然后本地部署,然后就可以帮你啊,去做一些 表单填写啊,以及一些小的任务,比如说打开微信回个消息这类的,应该都是可以的。 然后这个部署的方式也很简单啊,大家在网上应该都能找到教程,包括 github 上 它也自己就有这个教程,你看 windows 的 教程,直接输入这些代码,然后它就会自己帮你运行,怎么样,是不是还挺好的?这个项目微软出品就是不一样啊。

1496哈尔滨辅导一对一 04:31查看AI文稿AI文稿

04:31查看AI文稿AI文稿大家好,今天给大家介绍一下最近很火的 openclaw, 由于 openclaw 下载难度较大,我们给大家找了可以一键安装到电脑中的软件 autoclaw。 我 们先在 autoclaw 官网下载一下这个应用,下载完成后安装即可。我们下载完成后首次登录需要登录一下账号,之后就会进入首页, 首页如视频展示一样,如果使用 autoclaw 是 需要积分的,新用户的话会赠送五百积分或者充值二十九元,有五千积分可以使用。 接下来简单介绍一下它的配置模型,相当于 autoclaw 的 大脑,我们可以切换,如智普、 deepseek、 minimax、 kimi 等多家的大模型, 也帮我们下载了很多 skill 技能,如果自己部署的话,这些都是需要自己一个个再额外下载的。 接下来我们展示 autoclaw 的 功能。第一个可以设置定时任务,如每天给我们推送当天的 ai 新闻,并简单分析 autoclaw 会调用它的技能,告诉我们怎么实现, 如他告诉我们现在的回答只能在当前窗口,无法脱离当前窗口回答。询问我们是否要连接飞书。咱们暂时先不用飞书,先简单演示一下这个功能, 这样我们定时任务就已经创建好了,等到时间我们可以查看一下效果, 到时间了效果就出现了,这次我们简单使用页面来展示,下节课我们来将飞书接入,实现飞书给我们发消息。 接下来展示 auto cloud 的 第二个功能,本地电脑操作,通过对话实现对我们的本地电脑文件进行操作。如让 ai 帮我们寻找一下我们的文件内有多少个视频文件? 现在我们看到他已经帮我们把文件夹中的文件都整理好了,还可以再让他把我们把整理好的文件根据需求放入一个文件夹中, 这里可以看到他已经帮我们把文件整理好,放进一个文件夹里了。接下来来展示一下 ppt 制作功能,我们把想要生成的 ppt 主题发给他,等待片刻, 接下来就已经生成好了 ppt, 我 们来看一下效果。

37二七AI 02:50查看AI文稿AI文稿

02:50查看AI文稿AI文稿最近这个龙虾啊,真的是太火了,前几天腾讯楼下的工作人员免费给大家安装了龙虾,真是人山人海,有两三百人排队,甚至还有很多人没有排上号。所以今天我也来给大家讲讲如何安装部署,不用排队,自己在家就能安装了。当你一不小心突然想配置一个在国内可以用的中文版小龙虾 agent, 聪明的你呢,就打开了编程软件 tree, 非技术背景的你啊,直接可以在对话框里面和 tree 说帮我配置 no 环境, 几秒之后呢,按照小龙虾的前置条件就解决了。然后聪明你呢,这个时候就在 github 里面找到了这个中文版的小龙虾,确认这个版本的小龙虾是在国内也可以用的,而且还能够通过飞书对话给它下指令。于是你就直接在这个网站里找到这三段神秘的代码,先把第一行丢给 tree, 几秒钟之后呢,就搞定了。接着呢,你再回到刚才那个网址,把第二行代码复制后再丢给 tree。 这个时候就进入到了紧张的部署环节。第一个问题,问我们是否理解有风险?回答, yes。 第二个问题,选择引导模式,选快速引导模式。第三个问题,选择配置现有值。第四个问题,选择模型商,因为之前在 deepseek 充了 token 啊,所以我就直接选择了 deepseek。 然后第五个问题是让我们提供 api key, 聪明的你呢,这个时候打开了 deepseek 的 官网,点击开放平台,点击左侧的 api keys, 然后快速创建一个,并且把这个代码复制后丢给 tree。 第六个问题,我们默认模型就选保持当前。 第七个问题,跟我们使用什么与小龙虾沟通,我们选择飞书,然后选择使用本地插件,选飞书国内版。 这个时候聪明的你就搜索飞书开放平台,登录后点击右上角的开发者后台,点击创建企业自建应用,然后随意输入应用的名称和描述,然后就创建好了。 这个时候呢,点击左侧添加应用能力,选添加机器人,然后点击权限管理,再点击批量导入权限,获得对应的接入文档, 这个时候输入第三段神秘代码,然后就开通了所有需要的权限啦。接着呢,我们点击左上角的线上发布,随意输入内容后就完成了发布。那么接下来有毅力的你再坚持一下,把应用 id 的 秘钥呢,分别复制给翠,然后回答最后几个问题,分别选 yes, np 和暂时跳过钩子。好到这里恭喜你,小龙虾的部署完成了,有毅力的你呢,也决定再把最后一步飞书也配置好。 这时候聪明的你呢,就回到了刚刚的飞书应用页面,点击左侧的事件一个回调,选择订阅方式,添加一个长链条并保存,然后点击右下角的添加事件,搜索接收消息,然后点击确认, 这时候再次点击上方的创建新版本,仍然是随意填写内容后完成发布。好了,现在恭喜你,你已经可以在飞书里给小龙虾下指令了。

01:56查看AI文稿AI文稿

01:56查看AI文稿AI文稿打死我也没想到, open curl 最适合的模型是这个,最近出来了一个小龙虾的评测精准, peter 也是为他点了个赞,他是专门用于评估小龙虾在一些实际的场景,到底他的效果怎么样, 今天我们来看一下。首先他的评测任务里面有二十三个,然后基本上都是日常常见的一些任务,然后他就评估了非常多的,我们直接来看一下他的排行榜,打死你也猜不到。 最适合的是这个 jimmy 三 flash 这个模型,它的准确度达到百分之九十五。然后第二个是这个 mini max m 二点一,但是 mini max m 二点五已经出来了,但是它没有评估。可以看到像这个 oppo 的 四点六,四点五,还有 jimmy 三 pro 都排在后面, 还有 kimi, kimi 也排在了第三位。最最重要的是这个 jammy 三 flash 排在了最前面,我不知道它是为什么,最最重要的它的成功率是最高的。还有其他的一些评测榜单,这个就不说了,因为它完全没有考虑成功率,它没有一个综合的榜单,我们直接看它的准确率。但是毫无疑问的, 这个 jammy 三 flash 它的价格也是很便宜的,而且速度也是肯定是很快的。但是有没有 mini max 应该是比 mini max 要稍微快一点的,因为本身不光是模型的问题,还有一些服务器的问题。这个 jammy flash 肯定是更快的,而且它的准确度也高,成本也低, 虽然还是没有这个 mini max 更低,因为它是有一个汇率差存在,所以说 mini max 会更便宜点。这个 kimi k 二点五也是真真是想不到。 其实这个项目还可以拿来做一些什么?这个基本都是开源的,其实还可以拿来做一些模型的评估,评估了之后可以拿来做这种模型的路由, 什么模型适合做什么样的任务,什么模型适合做什么样的任务,同时兼顾准确度的情况下,又兼顾了他的一个成本和速度,这个还是有的做的,有这样的,如果有这样的一个项目,他应该应用场景还是挺大的。

1003jesse 01:41查看AI文稿AI文稿

01:41查看AI文稿AI文稿两分钟教你部署自己的小龙虾。首先打开浏览器搜索扣子,点击扣子二点零进入后下拉,点击扣子编程。进来以后首先注册,然后点击中间最上面一键部署 open call, 再弹出框右上角点击一键部署。 模型有很多,我们直接选择自动版本,选择满写版,然后授权非书,再根据个人喜好给你的小龙虾起个名字。接下来的页面右边是你的小龙虾,左边是扣子对话框, 这样的安排主要是让你能够对你的小龙虾一键纠错,对于我们新手小白来讲简直是福音。 接下来我们和小龙虾对话,开始正式配置他,接着我们可以给小龙虾起个好听的名字,定义他的性格,明确他的工作以及让他知道自己的老板是谁, 然后点击发送,小龙虾就会根据你的定义开始自行配置自己小龙虾。自行配置的过程中,所有配置代码全程自动,无需你再输入什么指令,所有的配置它会自动保存在根目录里。到这里你的小龙虾就已经基本配置好了。 那下一次我们在哪里找到它呢?我们重新回到扣子空间,然后点击扣子编程, 找到项目管理。进来后,我们的小龙虾就在第一个位置,然后我们点击它就能再次回到小龙虾的界面,按照以上步骤,你的小龙虾就已经基本配置完毕。 下期视频教大家如何用飞书打通手机和 pc 端,让你拥有一个可以用手机管理的电脑端小龙虾助手,我们下期再见!

184轨迹AI 05:29查看AI文稿AI文稿

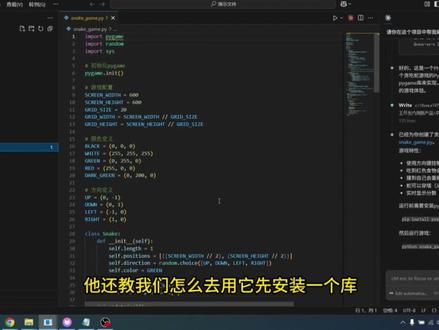

05:29查看AI文稿AI文稿hello, 大家好。呃,今天呢来介绍一下我们星辰自研的中转站啊,可以看一下我们的这个独家专线,是非常的快的,并且呢我们插件支持自动化配置这三个功能, 就是你需要什么模型可以用插件直接自动化配置好就不用手动在那调, 然后可以看到我们这些模型都是可以直接用的,例如我需要用一个 closeony, 四点六的话,我就点它 啊,然后点确认选择啊,然后就配置好了,就非常的简单操作。然后我们来测试看一下这个是 cloud code 的 插件, 呃,在那个 vsco 啊,或者 coser 啊,或者 kiro, 反正就是只要能支持安装插件的 id 里面都可以用啊,可以看一下我们这个项目的话是挺大的啊,这个项目的话它挺大的,它的文件特别的多,可能有一百多个文件吧。 然后这个项目的话,呃,也是一个比较复杂的项目,我们就拿它来测试一下这个模型,就是我们这个中转站它的响应速度以及它能否解决我们的问题。 首先来测试一下它的响应速度怎么样啊?处理一个这么大的文件啊,看一下先啊,可以看到就算是秒响应的,我刚问完他就立马回复我了, 这个速度啊,可以说基本上可以呃碾压绝大部分的中转站啊,他们有些中转站可能思考一下,可能要几十秒,或者说上百秒,我们这基本上就是秒响应。然后呢他看一下,现在他是正在读这个项目啊,我们先等待一下 我们这个项目的话,因为特意拿了一个比较大的项目,有一百多个文件,就是来看一下,演示一下,给大家展示它的这个响应速度,以及它能否解决我们的问题 啊。可以看到它现在这里还在继续读啊,因为整个文件项目的文件非常多,它在一遍的读,可以看到它上面列出了这里有一百零一个文件啊, 然后他现在在读取我们这个项目的内容 啊,然后他现在读取完了告诉我们啊,这个项目是一个什么东西,有什么功能,我们这里可以看到他这里的分析 技术,实现项目定位,然后还有什么安全机制啊,功能啊,然后呢我们这里直接来测试一下,问问,他就是帮我们分析这个项目的缺点 啊,众所周知啊,就是让他说优点的话,他能说一大堆,但是让他说缺点才能真正检测他是否去读了这个项目啊。可以看到这里的话,他的响应速度还是秒响应的 啊,不像就是有些不太好的中转站,他可能是你问个问题,他可能等个上百秒才回你啊,那体验就是非常的差了, 我们这的话就可以看到整体的响应速度特别的快。然后现在呢他就已经分析完了,他说这个项目的缺点啊,是风险,然后还有代码质量 以及性能啊,数据库处理之类的这些缺点,他都给我们一一列出出来了,然后告诉我们要如何规避这个风险 啊,可以看到这里全部的实线都已经出来了,然后他给我们做了个总结,以及各个问题,他都给我们一一列出出来了, 可以看到非常的详细哦,这里的话就不一一去看了,就给大家展示一下这个效果,然后我们来再新开一个对话 啊,我们在新对话来再测试一下,看他是不是每个对话都能这么流畅。我让他帮我写写,写一个东西吧,写一个贪吃蛇脚本,测试一下他的那个写代码的速度 啊。然后我们这里发了我们的问题,可以看到依旧是秒极响应,非常的流畅。 然后他现在就已经在查看这个项目的目录,查看完之后呢,现在就说开始帮我们写了,然后我们这里就等待一下, 嗯,可以看到他这已经写好了,这就是他写完的一个文件。呃,然后呢他还教我们怎么去用它,先安装一个库,然后呢再去运行这个游戏。 然后这里呢我们来介绍一下我们的中转帐,它的倍率是特别的低啊,零点零零九, 零点零九非常的低啊,然后我们可以看一下我们的这个输入,输出都是零点几的,比其他中转帐低特别多的,而且响应速度和质量都是非常的好。呃,强烈推荐大家来使用体验一下啊。好,本期视频就到这里了,谢谢大家。

2星辰大王 01:18查看AI文稿AI文稿

01:18查看AI文稿AI文稿在 openclaw 中接入 deepsea, 用极低成本驱动强大的 ai 智能体。接下来我将手把手教你完成配置。 首先访问 deepsea 开放平台,登录后进入 api key 界面,创建一个新的 api key。 deepsea 提供两种模型, deepsea chat 适合通用对话。 deepsea reason, 也就是 rise, 适合深度推理任务。打开终端,运行 on board 命令,选择 custom api key, 填入你的 api key base url 填 a p id deepsafe 点 com 注意末尾不要加斜杠 f 一 模型 id 填 deepsafe chat 即可。如果你偏好手动配置,也可以直接编辑 config 文件,设置好环境变量 provider 配置。 最后把默认模型指向 deep seek。 deep seek chat 配置完成后,运行 gateway restart 重启服务,然后发送一条测试消息。如果回复中提到 deep seek, 说明链路已通。几个实用建议,需要深度思考时,可以用斜杠 reason 临时切换到 r 模型。 复杂任务建议设置超时时间。 deep seek 的 成本仅为 gpt 四五的十分之一,非常适合二十四小时自动化任务。就这么简单。凭借 open ai 协议的原声兼容 open claw, 让你可以轻松接入 deep seek, 享受高性价比的 ai 能力。

01:02查看AI文稿AI文稿

01:02查看AI文稿AI文稿免 token 配 opencloud 小 龙虾?最近这个 opencloud 非常火,很多人装了这个龙虾,但是这个龙虾最关键的问题就是非常好托肯啊,非常烧这个托肯,但是我装的本地的这个是一个免托肯版本,它这个逻辑是什么逻辑呢?就是说你不需要配自己的那个 apikey, 就是 不是用自己的这个 apikey 去烧这个托肯啊?它配的是什么?它配的是这个网页它的接口啊, 就是说如果你能够访问这些模型网站的这个网页啊,登录上去之后,然后呢去能够访问这些接口的话,相当于把这个接口作为这个模型的能力来配给你的这个小龙虾来用啊,我现在本地的话已经配好了,我现在问他是一个什么模型啊?我这边连的是 deepsea, 就 要登录你的 deepsea 的 这个 这个网页,然后能够访问它的接接口就可以了,它相当于给的我一些回应啊,相当于我这个小龙虾已经配好了,而且是不需要你再去耗费你自己的 apikey 去烧自己的托管的,非常好用。如果你们感兴趣的话,可以在后台私戳我。

10叮当喵喵 07:32查看AI文稿AI文稿

07:32查看AI文稿AI文稿当 autodesk 接入 openclaw, 我 们来看一下效果啊, 这是我给他创立的 openclaw 的 一个工作区 workspace, 他 到时候所有的操作都会在这里面执行,现在这里面的文件是空的,日制这边也是没有的啊。那接下来全权交给 openclaw, 咱们让他来写一个例子,这边是我写的一个工具,他可以对指定的文本进行 rsa 加解密。啊,那我现在就用就让 oppo 去写这样一个工具啊, 用奥拓 gs 开发助手技能,在奥拓 gs 工作区,就是刚刚那个目录写一个 rsa 加解密。对制服创你好,到乌鸦进行加密和解密,包括公钥和私钥,需要这个公钥跟私钥啊,包括这个公钥和私钥的这个生成啊, 然后试药格式就对齐,我这边 pk cs 八随机妙对长度是幺零二四上法选择 pk cs 一 配顶啊,然后就是跟这个一样啊,待会我就是要让他们加密结果和我在这边加密结果是一样的啊。 那接下来就让他来执行啊,现在这个 openclock 给他了他最大的权限,他现在是可以操控我这个 autodesk 进行运行脚本 获取日期跟清空日期之类的一些常规操作。那现在来看他操作 可以看到它的这边刚刚刷新看一下,它已经生成了一个文件啊,并且刚刚已经运行了,可以看到这边它运行报错了,是不是 运行代码报错,它现在会继续根据这个报错继续修改啊,这是它写的第一个版本啊, 第一个版本写错了,这是用 ai 它犯的常规的错误,就像你直接拿着是刚刚我上面的问法去问豆包或者 deepsea 这些它是没有办法一次性就给你写对的, 就是因为它这个 autodesk 并不是像拍摄那样很常见的那种语言, 它一些用法的话 ai 没有完全了解,所以就导致它 ai 生成的代码中有一些 不兼容 auto g s 写法的用法,所以就会导致报错。那如果 ai 的 话,它能读取这个报错的话,它就能够一直根据报错一直去修改,从而最终给我们一份就是没有任何报错的代码。那接下来继续往下看, 刷进看一下可以发现他现在写了第二个版本,根据第一版本的报错写了第二个版本,但可惜也是第二个版本,还是报错了,还是报错了。这个 java 是 unify 的 是不是?所以他现在再会再根据这个第二个报错继续去改第三个版本。 他这边已经说运行了第三个版本,可以看到他这边有微闪了,看一下这个设置输出, 又显示这个模块不可不可用啊。那接下来他会针对第三个版本继续升级啊, 看一下他现在又整了一个测试环境的, 他刚刚这边有检测这个环境环境对象是否存在啊,那接下来他就会继续操作了, 现在刷新可以看到它这边又更新了一个 final 版本了,看一下有没有相关日子。嗯,它这边就显示的结果加解密成功了, 现在它就在读取刚刚运行的这个日子, 像这种它就很好,它是可以根据你的报错一步步去审查,然后再检查环境什么的,最终给你这个可用的版本啊,它现在已经成功运行了,现在整个绘画已经结束了,现在看一下这个它最后的这个版本, 看它写的代码还是很多的,那么接下来我先阅读一下代码,然后看一下它这个加密的结果,对不对啊? 那我直接来验证一下这个加密结果啊。运行看一下,可以看到他这边有给出这个公钥是不是?那直接复制一下这个公钥, 嗯,写在这里面,这是公钥啊,然后再拿一下这个私钥也公钥私钥,然后再拿一下这个, 然后这个算法的话是 pk cs 一 配顶啊。 pk cs 一 配顶,记录一下,然后加密数据,这是加密后的数据啊, 咱们看一下这个加密的流程就行了。就这样啊,那接下来直接回到我原来的这个工具箱。嗯,这边加密的文本是,你好到乌鸦是不是连接进来, 然后这个 r s a 加解密,然后公要,公要的话给它输进来私要, 然后这边的话是 pk 七十一配点加密。没错啊,其他需要密码默认是空的。那接下来进行加密看一下,看一下加密的号,就是这一串,就是跟那个不太一样。 哦哦,我忘记了,我忘记了一件事,那就是说它这个加密的结果不是固定的,加密的结果不不固定,不固定的话,那验证方法很简单了,咱们直接拿它加密的结果去解密不就行了吗? 这是他加密的结果,点击解密看。你好到位啊,就说明完全通过,完全通过说明他这个上法写的很好,完全符合我们所要的这个效果, 然后这就是所有的演示啊,这是一部分关于他写代码效果这个演示啊。

10道无涯i 01:38查看AI文稿AI文稿

01:38查看AI文稿AI文稿上期视频教给大家本地部署 oppo pro, 本期视频让大家的小龙虾接入大门型并连接手机,让你随时随地二十四小时拥有赛博助手。首先大家要明白,一键安装此操作大部分都是云部署,没有权限调动自己电脑内的文件进行办公,大家要区分清楚本地部署和云端部署的区别,我们要的是本地部署,这样才能自 理由操作自己的电脑文件。配置 ai 模型,打开新的命令页面,输入 opencloud comfind, 选 loca 回车,找到 model 回车,这里就有小龙虾支持的 ai 接口了,我自己用的是大模型,以我自己为例,右上角找到控制台点 a p i k, 添加新的密钥,复制备用。回到命令行,把密钥粘贴进去, 选自己 ai g l m 杠四点五杠 a 二模型空格为选择回车确认选择配置部分,直接选择下面选项即可。此时你的小龙虾已经 接入大模型了,接下来重点来了,我选择的是接入福书,打开福书开放平台,找到开发者后台点企业自建应用,给机器人起个名字,这里大家自行发挥,然后去权限管理,批量导入权限,权限详情图记得截图保存。接下来我们回到终端,输入 opencloud chatmail, 我 们选择 yes, 然后找到福书确认安装,这时候需要配置福书的 app 密钥,在凭证页面找到 id 和密钥填进去, 此时就要连接配置了,选 webescape, 连接国内图书端口,继续选择 open, 下一步选择频道最下方选项,回车完成选项即可。最后三个选项都选 no, 不 用复杂配置。回到图书配置世界已回调 创建版本确认发布手机收到消息,点开应用终端,执行授权命令。命令在绘画栏你创建的应用内,你可以点击直接复制即可。现在你的手机就能随时随地召唤小龙虾了,发消息就能操控电脑不关机,还能二十四小时在线。后续我将更新小龙虾实用 skill, 让小龙虾拥有更多技能来帮助你!大家记得跟紧续载玩转 open club!

3826旭仔的cyber 03:08查看AI文稿AI文稿

03:08查看AI文稿AI文稿最近这几天 open close 彻底火了,小龙虾一夜之间成了大家的焦点,各大平台都被刷屏了,线下也是大家闲聊的焦点。昨天琪琪接待了几位上门客户,进来就说是要做本地部署,要安装很多软件,说的非常专业。 这个时候琪琪就感觉我们的知识储备太少了,虽然说是 it 行业的,但是对于这些,这个时候就知道我们还需要学习的地方太多了。好在客户自己说他研究过配置,自身比较专业, cpu 要求核心线程大的客户自己指定的英特酷睿 u 七二六五 k, 台积电三纳米 n 三 b 工艺制成二十核二十线程,还自带核线。 cpu 在 本地大模型部署中基本上是属于兜底的作用,因为一旦显卡能力无法被发挥, cpu 就 要承担起全部的矩阵运行,所以说性能就需要变得非常关键。 一般来说,大模型对 cpu 的 要求主要看两个参数,第一是核心数量,单核性能如果只是跑一些小模型,普通的八核十六线程基本够用,但是如果你想要跑三十倍、七十倍甚至更大的模型,那 cpu 的 线程就是越大越好。英特酷睿 u 七二六五 k 无论是从性能还是价格上来说都是不错的选择, 一百二十五瓦基础功耗最大加速功耗 m p p 二百五十瓦,然后我们给推荐的库里奥 p 六零 t 双塔六热管散热,客户说他们部署的对内存跟显卡显存要求比较高, 内存至少要六十四 g 以上的,考虑到现在内存价格比较高,客户选择了海盗船三十二 g 六千乘二的内存,考虑到后期内存需要升级,我们推荐了四根内存插槽的卫星 b 八六零 m g m plus wifi, 采用十二加一加一加一路智能供电设计,六层服务器级 p c b 扩展型 v r m 散热片七 w m k 导热垫片 m 点二冰霜铠甲,后置接口包含五 g 网口 wifi 七、无线网卡,蓝牙五点四,数据接口丰富。客户说他们要用的软件对显卡的要求特别高,最少都要二十四 g 以上的, 二十四 g 以上的卡恩卡里面就只有五零九零 d 了。大家都知道这个型号的卡价格都在两万左右了,但是客户说预算比较紧张,我们推荐了明轩英特二 pro b 六零四十八 g 算力显卡, 这张卡双 g p u 设计,四十八 g 大 显存,涡轮散热,覆盖制造、交通、医疗、政务等多行业场景。 a i g c 应用需求,对于视频创作、三 d 设计和渲染也是轻松应对。二十四 g 的 价格才六千出头,四十八 g 的是一万两千 多,所以从性能跟价格上是不错的选择。固态硬盘这边本地部署推荐 nvme 固态,我们这边推荐给客户的是雷克沙战神 e t 读速七千四百 m b 每秒,整套配置下来价格两万出头,客户非常满意。 客户说之前预想的是一个显卡的价格可以买到整个电脑,毫不犹豫的下单,让我们安装好系统就是越纯净的越好,客户自己回去写代码, 安装自己需要的软件,通过这个配置让琪琪真的感受特别多,最大的感受还是对于现在最新的 ai 知识储备太少,刚开始我连什么事养龙虾都不知道,看来我们还是要多学习新的知识领域, 因为 ai 毕竟是未来的一个趋势,所以小伙伴们咱们一起学习起来吧!欢迎小伙伴们评论区留言讨论哦,需要大模型本地部署的小伙伴也可以来咨询讨论,琪琪以及咱们团队的小伙伴最近也会针对这个重点学习一下。好啦,以上就是我们今天的视频啦,咱们下期再见啦,拜拜!

05:57查看AI文稿AI文稿

05:57查看AI文稿AI文稿小龙虾啊,小龙虾,玩了两天了。嗯,我的部署方式是在我的飞牛,飞牛这个 nas 主机上部署一个容器,容器里边部署的小龙虾 啊,容器里部署的小龙虾,然后调用了我本地模型,本地模型选择了奥拉玛, 因为我的显卡是五零七零钛显卡,目前是跑了一个旧币的,旧币的前文三点五旧币的模型,十四币的模型也能跑。嗯,像旧币的我能跑到九十多头啃,速度还不错。 但是你如果说你在奥拉玛直接问这个大模型,他有点傻,我问他今天几号,他都不知道,看他的。嗯, 哎,他他他既然给我找出来了,刚才我上午问时他还不知道呢, 上午问的时候他还他还傻不拉几的看。上午问的时候没有查不到日期信息,然后让我查手机和电脑 啊,但这种部署方式呢?有有个问题,就是用多款部署,然后调用本地大模型,如果你在欧拉玛里边直接测这个数据,速度还是还是不错的。还不错。 嗯,但是如果说打开这个龙虾在这里边,在龙虾里边这个对话,他速度反应特别慢,我不知道为啥,是网络原因还是还是配置的问题, 所以说我决定打算放弃这种部署方式。我终于把龙虾部署到我本地和欧拉玛一台电脑上来,看看速度会不会提升起来。但今天这个这龙虾他也很笨, 他在装软件的时候把自己改自己的配置,把自己改死了。应该说他自己改自己的配置,又写的格式还不规范,写的东西不规范,然后配置文件出错,然后自己又挂掉了, 他自己,他自己改,自己把自己改崩溃了,这个龙虾, 完了完了,芭比 q 了。 我本来就想让他改一个问题,把他回答的问题的时候用流势书写的方式就是 一行或者一段一段的出,他现在出现的方式是问完问题等好半天,然后一下子把那所有的问题,所有的文字全部出来,这样等的时间太长,不是那种,嗯,从 一行一行的出那种方式,我就为了让他解决这个问题,我让他自己去解决,他竟然把自己给搞崩溃了。你看看,和用打字的效果和模型显示方式保持一致。 这是我问的,我问的, 让他自己去改变,让他自己去改,他自己改,改改改。 然后我给他一个一个方法,然后去配置他,结果 我把这个都都给他了,他说他明白了,结果,结果呢?结果呢?没搞成, 他让我试一下,一试连接断了,连接断了,这等于是他把自己搞崩溃了。 但我, 嗯,也也换了一种,用用这个 m studio。 m studio, 这个,这个,我下载好多模型,我准备用用这个 m studio 测一下这个各种模型的速度,测一下我,我的五零七零态 能跑到什么程度。嗯,一般我的显卡,这显卡跑二十米以上的怀疑都困难,都跑不动,还是不行。 大家有什么好的本地补水方式或者方案可以交流一下。 能不能推荐一下这种 ai 性能比较好的主机?我现在看就苹果的主机性能比较强。价格很贵啊。

31辉歌 04:09查看AI文稿AI文稿

04:09查看AI文稿AI文稿大家好,我是南哥。我们都知道最近小龙虾概念爆火,这可能是新一代人工智能落地的先驱。 从这期开始,我将介绍大模型赛道的主要公司,并且讲一讲他们的上下游关键厂商, 让我们一起看看哪些公司能抓住这次机会。通过对比独立创业公司和互联网大厂的核心产品,从技术参数、商业调用量到场景落地能力进行一次全面深入的竞争力分析。 这份报告将为您揭示大模型赛道的最新格局与未来趋势。首先,我们来整体看一下纯大模型行业的概括。 目前国内赛道已经形成了四小龙加四巨头的稳定格局,国产模型在全球的话语权也越来越重。 技术上,混合专家架构、轻量化和超长上下文是三大发展方向,这使得模型更高效、更易用。 从数据上看,市场需求呈现爆发式增长,单州 token 掉用量已突破万亿级别。 商业化方面,二 b 和二 c 双轮驱动大厂的生态优势尤为明显。接下来我们看第一家独立大模型公司 minimax, 它是国内全模态大模型的代表,其核心模型 m 二系列参数庞大,但通过创新架构实现了高效运行。 最亮眼的是其商业表现,单州 token 钓用量突破二点四五万亿,是目前全球最火的大模型之一。第二家是智普 ai, 它以技术实力著称,是通用大模型领域的标杆。 其 glm 系列模型不断迭代,最新的 glm 五版本在钓用量上实现了爆发式增长。 智普 ai 的 优势在于其卓越的多语言能力和强大的数学代码能力在行业落地方面做得非常出色。第三家是阶月星辰,他选择了一条差异化的赛道,具身智能,主要服务于机器人和自动驾驶。 它的核心优势在于将 ai 模型与物理世界的硬件紧密结合。最后一家独立公司是百川智能,它以清亮、开源、高效为特色,其医疗大模型在全球测评中排名第一。 最关键的是百川的模型可以在普通消费级显卡上运行,这为其在中小企业和个人开发者中普及了坚实基础。看完独立公司,我们再来看看互联网大厂的布局。首先是百度的文心一言,它是国内最早发布的大模型之一,具有先发优势。 文心一言的最大特点是与百度的搜索生态深度融合,中文理解能力非常强,在商业上,其累计调用量已达千亿级别。第二家是阿里的通易千问, 他以开源和高性能著称,最新的 qw 三模型在多项国际测评中刷新了开源模型的记录,展现了顶尖的技术实力。 通一千万的优势在于阿里的生态支持,无论是电商还是企业服务,都为其提供了丰富的应用场景和海量的数据,使其在商业化落地和技术迭代上都非常迅速。第三家是腾讯的混元大模型,它的最大特点是深度融入了腾讯的社交和游戏生态, 微信的巨大用户基础使得混元大模型在 c 端的落地速度和广度上无人能及,其累计掉用量也已突破五百亿次。 最后一家大厂是字节跳动的豆包,豆包凭借抖音和头条的巨大内容生态后来居上,迅速成为国内用户规模和钓用量的双料冠军,单月钓用量就超过万亿次。 它的核心优势在于与内容、创作、场景的深度结合,无论是写文案、做视频,豆包都能提供高效的 ai g c 工具。最后,从数据上看,各家在不同维度上领先,百川,在轻量化上表现突出。 展望未来,技术上追求更高效率和更强的物理交互能力。商业上, to b 和 to c 将齐头并进,格局上,独立厂商和大厂将形成互补与合作的生态。好了,本期视频就到这里,如果大家觉得视频对您有关注,麻烦点赞、评论加关注,我们下期见!

04:45查看AI文稿AI文稿

04:45查看AI文稿AI文稿大家好,这个小龙虾最近很火,然后这个周末我也折腾了一下这个小龙虾,然后目前为止的话是能够在我电脑上面呃能够跑起来的,而且能够操作我的电脑的文件,然后进行一个文件的读写操作, 然后我讲一下我接入的一个过程以及呃 token 使用的一个情况,然后目前的话, 呃,我之前接入的是呃百炼的呃一个模型,然后百炼的话就接入的是那个呃千问的呃 plus 啊模型嘛, 哦, ok。 但是千问 plus 模型有个问题,它相当于相对来说没那么智能,就比如说我在接入前期的话,会遇到呃这个文件写入没有权限的一个问题, 好,然后我在今天今天上午把它切换到了千问三点五 plus 模型。为什么要切换呢?因为千问 plus 模型的话,它相当于是 呃一个按量收费的,然后千问三点五 plus 在 我们注册这个百炼呃这个平台的时候,它就会给我们呃免费赠送一百万左右的一个呃分期额度,所以我把它切换到了千问三点五 plus 前网。三点五 plus 相对来说要智能很多, ok, 呃,这个说我其实是最开始是寄希望于让小龙虾来帮我进行一个呃切换的,但是他切换的时候应该是有一些呃 有些配置和什么问题,然后导致他没有切换成功, ok, 然后我又去手动修改了, 我去手动修改了这个呃 open cloud 点节省文件,然后修改之后,然后就切切换成功了, 然后这里在十三点十三分的时候,然后我问他使用的是什么模型, ok, 这时候他会回答我,我使用的是纤维三点五 plus 模型, 好,切换到这个模型之后,这个时候按理说我们是有一百万左右的一个托管的免费使用额度的。好,然后这个时候我再呃向他提发起了几个问题吧。 首先我让他在这个目录下面帮我创建一个文件夹,看是否可行,因为我之前一直遇到的是有那个文件权写作权限的一个问题,所以导致文件夹一直创建不成功。 ok, 这个时候他其实告诉我还是有问题的, 但是的话千万三点五 plus, 他 呃告诉我有问题之后,我把我的问题以及遇到的呃一些情况,然后发送给他,发送给他之后他能给出我正确的命令,然后来执行之后 能够让呃这个呃小龙虾能够写入文件到我的那个本地电脑,到这里都是我让他排查问题的一个过程。 好,在这里执行成功之后,然后它来创建文件夹,其实这个时候就已经能够创建成功了。可以看到在 workspace 上面它有一个 test lab 的 这个文件夹已经创建成功了。 创建成功之后,然后我让他帮忙汇总今天新用的 top 十,然后用 word 的 方式输出到这个文件夹里面,然后风格呃简约大气吧。 ok, 然后它这里能够呃输出出来,但是这里有一个网络访问限制的问题 啊,因为他默认访问的应该是一个一些国外的一个呃网络,然后就导致他没法拿到数据,所以这里的话我就指定了去百度那边抓新闻,抓来之后能够正常的写入到这个呃我的这个文件里面去。 ok, 到这里的话,这个托呃这个问答就结束了。好,然后我们来看一下托肯的一个使用情况。呃,托肯的话免费使用,免费的是有呃一百万的,然后但是当我上面几个问题问完之后,他就已经用了七十七十七万多用, 就还剩下十三万两千零四十九个托肯呃,然后再使用。 所以这个 talkin 其实看起来使用是很恐怖的,所以大家如果说只是想要用它来进行一个测试的话,记得把这里的这个批量操作,然后免费额度用完即停,把它给呃开启,不然的话它这个 几个问题很快就把那个头给耗光了,耗光之后他就会继续扣费,然后扣费之后,呃,反正这个扣费应该是比较比较多的吧。嗯,呃,目前是我这边的一个小龙虾的一个使用情况,分享给大家。

20天凉好个秋 01:13查看AI文稿AI文稿

01:13查看AI文稿AI文稿这个就是我们装好的一个 open core 小 龙虾啊,然后这里面的话介绍一下怎么配置它,然后这里呢是它的技能啊,也可以理解为插件,就是它会有非常多的功能,安装好之后它会自带非常多的一些功能, 包括桌面的管理啊,或者写代码等等了。那你给他赋予功能之后,还需要让他有一些大模型的能力,我们就可以给他去接别的大模型,比如说在这里配置, 在代理这边呢,我们就可以给他接上别的模型,这里我们接的是智普的啊 gm, 然后让他调用了所有的技能,那么这个时候他就可以帮我们做很多事了。比如说我直接让他在桌面上给我创建一个贪吃蛇的网页,这个是十五点十七分发的,他在 十五点十八分这里十五点十八分就已经给我做好了,然后该看看下的效果,而且它是自动的就装在这个网页里啊,开始游戏做一个正常的, 然后上面会有得分啊,其他的工作,包括这个桌面,我还让他帮我整理一下桌面,就是非常的整洁啊,然后其他的需求也可以让他去做。

275算力未来 00:48查看AI文稿AI文稿

00:48查看AI文稿AI文稿今天为客人安装了一台小龙虾工作站,他是用小龙虾做视频编辑工作的,我们是通过 windows 的 平台安装了虚拟化工具呃, gpu 直通到虚拟机里面,然后把小龙虾这套软件部署到虚拟机里面,确保小龙虾这样一个平台的安全性。 企业应该肯定是首首选的是安全第一,第二就是说适配性要好,就是完全能解决它的问题。我们这台机器采用的是特的那个工作站,适配的是 r x 五零九零的 gpu, 两根那个三十二 g 的 内存这样的一个平台。我们现在部署了多只小龙虾, 应用于文职开发呃,设计等等。我们这边还提供一站式的从电脑工作站配置到本地部署,如果你也想了解,加关注,后台找我。

01:41查看AI文稿AI文稿

01:41查看AI文稿AI文稿最近 ai 界掀起了养小龙虾热,但是有谁知道养着这个龙虾多费钱? opencall 本身完全免费,收费只来自你接入的大模型 api。 一、 核心收费逻辑,小龙虾本地开源免费,本地部署无任何费用算力 token 收费,小龙虾只是指挥中心, 干活全靠背后大模型,你用什么模型,怎么计费,完全由模型方决定额外成本,本地运行电费,电脑损耗,云服务器部暑月费约六十到三百元。二、主流模型 token 收费,按一百万 token 公算 gpt 四 o 约一百到一百五十元。 wild 三、 opus 约一百二十到一百八十元。工艺千问文心一言约三十到六十元。 deepseek minimax 约十到三十元。免费模型,如 q n 七 b llama 三、本地版零元。 三、小龙虾烧钱有多猛?普通聊天一天几元到几十元,自动任务成文党一天几十到几百元很常见。复杂 a 诊多工具调用,单日上千甚至上万都有可能,隐藏消耗心跳机制,记忆重试机制,闲置也会烧头啃。四、 省钱方案一、优先用免费低价模型,本地开源模型,国内低价 a p i 二、控制任务复杂度,少开记忆,少用多工具缩短任务量。三、按量套餐,选平台包月套餐,如腾讯云 coding plan, 首月约八元,次月约二十元,无限 token 在 线次数。 四、本地部署,用自己电脑跑轻量模型,零 token 费,一句话记,小龙虾免费模型按 token 收费,想省钱就用低价免费模型加本地部署。还有,养小龙虾有安全风险,使用需谨慎。

3穆先生 01:51查看AI文稿AI文稿

01:51查看AI文稿AI文稿现在小龙虾非常火,但是很多人不知道小龙虾跟这个豆包还有那个 a 针的就是智能体有什么区别?这个视频一条给你讲清楚,豆包其实是一 v 一 交互,你想做一张图片,你发给他,你让他给你做出来,你哪里不满意,让他给你修改 智能体,你提出一个要求,他是固定模式,给你出图或者视频或者文案,你告诉他,他给你做就是已经做好的流水线。 而龙虾你布置好之后,可以调用很多大模型,比如说你想制作一个游戏,那你可以做四个机器人,比如机器人 a 用这个 deepsea 的 chart 的 模型, deepsea chart 让它做进行逻辑,比如说去网上搜索,你想制作这个游戏的模式类型有哪些可以玩的点,让 b 用 deepsea coser 的 大模型,让它来写代码当码农, 然后机器人 c 用豆包一点六多模态大模型来给你生成游戏的图片 渲染,三 d 这些 d 可以 进行对整体游戏的这个测试,也就是说用龙虾可以组建一个可以真正干活的团队, 而不是需要一个人一直要跟那个豆包这样一 v 一 的聊天。 a 阵呢?这种智能体你给他一个输入内容,他输出的满不满意还要你看, 但是小龙虾他给你做出来的这个游戏你也可以试玩,哪里不满意,你只需要告诉机器人 a 就 可以,他来修改, 也就是完成了一个把人去除的一个过程,从这里你就能明白小龙虾他到底能做什么,什么人要用小龙虾啊?什么人用豆包就可以。