龙虾token怎么改

最近全网都在疯狂养 opencloud, 但这玩意儿吃起 token 来简直比天天吃澳洲大龙虾还贵!有多少人望而却步?准备卸载放弃了?别急,有新的解决方案了! tony ai, 吉尼斯认证的全球最小个人 ai 超级计算机, 巴掌大三百克重往电脑上一插,你的小龙虾秒变本地 ai 工作站,无需云端 token, 不 信?看参数,八十 gb lp ddr 五 x 内存加一 tb 固态能直接跑一二零 b 参数的千亿级大模型, 一百九十 tops 的 算力全靠 turbo spares 神经元及减脂和 power inforce 动态分配。黑科技硬生生把服务器级性能压榨进了这个小盒子里。咱们算笔硬账, 云端养大模型,一年偷看费轻轻松松上万!而这台设备找鸟价一千三百九十九美元!要知道,光去买八十 gb 的 高宽带内存,市场价就奔着九百刀去了!这波纯纯的买硬件送算力, 当算力从租用变成买断,当 ai 从云端拽回口袋,你愿意花一台手机的钱,养一只永远免费的本地大模型吗?

粉丝15获赞162

相关视频

01:02查看AI文稿AI文稿

01:02查看AI文稿AI文稿万万没想到,让当下最火爆的 open clone 帮我们赚钱,结果他却要我们先花钱给他充 talking! 本期视频就来教你白嫖上千万 talking 的 神操作!首先打开这个网站,下滑找到这个输入输出都是零元的 deep secret, 轻轻一点它就会弹出详情页,点击打开这个 a p i 文档后,直接在 post 栏下复制这串网站的域名 url, 然后我们打开电脑自带的命令提示, 以管理员身份运行后,我们下滑找到龙虾的 api 配置页面,把刚才的 url 域名复制到下面后,回车,龙虾就会问我们索要 apikey, 此时我们再回到刚才的网站,找到 apikey 秘钥栏,新建一个自己的 apikey 后,我们点击复制,然后粘贴到龙虾的 apikey 索要栏下,继续回车, 等它提示我们输入模型 id, 再回到 deepseki 的 详情页的最顶端,点击这个复制符号,模型 id 就 已经到手。 此时只用粘贴到输入窗口,然后回车,一个无限 talking 的 龙虾就已经配置完毕,此时随便给他发布什么任务,等他完成后,我们进入消耗后台,可以看到我们已经消耗了十二万的 talking, 却没有花一分钱。

5050讲ai的老韩 02:24查看AI文稿AI文稿

02:24查看AI文稿AI文稿这几天烧了一个多亿的抽空,我的小龙虾从左边进化成了右边,这样养虾体验真的大幅提升。如果你刚装上欧文壳,强烈推荐和我一样开启这五个设置,搭配这四条快捷指令,让你的龙虾更听话更好用,还能省下一大笔抽空费用。 在设置之前,推荐大家把对话插件一定要切换到非主流官方插件,这样小龙虾能做的事情更多,直接发个小龙虾链接,让他自己给你安装切换就可以了。 前三个要开启的设置是流逝回复、耗时和状态展示,直接发给小龙虾这段指令欧文克勒默认是不开启流逝回复的,导致我们要等小龙虾输出完所有的内容才能看到消息,等待时间很长,而开启之后就能像我们平时和 ai 的 对话一样,看到实时输出。 接下来要开启的两个设置是思考过程和工具调用,默认这两项都是关闭的,我个人觉得这两项还是很重要的,如果模型执行任务出错了,我们通过看他的思考过程也掉了哪些工具,能帮助我们更好的去纠正他的行为,不然有的时候模型骗了我们都不知道开启方式,就是发送给模型这两段指令即可。 先给大家介绍一下这个快捷命令,这是 open call 官方内置的聊天命令,每一条背后都是提前设定好的程序,直接控制小龙虾的行为,不会调用 ai 大 模型而消耗 token。 第一个是 stop, 这是我用的最多的指令,因为小龙虾在执行复杂任务的时候,它偶尔就会卡死,很长时间我们都等不到它的回复,但实际上一直在后台燃烧我们的 token。 这时候如果你发消息叫他停下,你会发现他不会停。这是因为 openclock 有 消息队列的机制,我们的上一个消息没处理完,新消息就会在那排队等着,所以这时候就要用到这个命令,输入 stop, 然后强制停止他的推理,就可以继续跟他对话,把他给纠正回来。这个非常重要,如果你不会 stop 的 话,你的账单可能就爆炸了。 第二个是 status, 能查看小龙虾当前的各种参数,我经常用来去看 context 来判断现在上下文的长度。因为现在很多的大模型虽然号称上下文是两百 k, 但实际上用起来到一百五十 k 以后,模型就变得很笨,而且回复很慢了。所以我们不需要用到两百 k, 我 会差不多在 context 一 百多 k 的 时候,就搭配另外一个指令 compact 来主 动压缩上下文,它会让 ai 对 上下文做总结摘要,不仅节省了成本,又不会丢失关键信息。这个我也用的很多,因为小龙虾用起来上下文增长真的很快。第四个是 new, 我们要给龙虾一个新的任务的时候,可以用这个指令直接开启一个新对话,这样就没有之前的上下文干扰了。但我个人其实更喜欢用 compact 来压缩这个看大家的使用习 惯。为了方便使用这几个快捷指令,我把它们固定在了我的聊天界面,直接去飞书开放平台,在机器人自定义菜单这里添加这几个快捷键,展示形式选择悬浮响应动作选择发送文字消息,设置完成后修改并发布就可以了。那这期视频就到这里,所有指令我都放在了视频下方,希望能对你有帮助,也可以分享干货,我们下期见。

1.1万栗氪聊AI 00:39查看AI文稿AI文稿

00:39查看AI文稿AI文稿当你不小心安装了个 open curl, 然后发现 token 消耗刹不住了,而且非常健忘。你直接给我去 guitar 输入 cloud man, 你 会发现这是一颗能给你的龙虾赋予持久化记忆的插件。以后你就能像看朋友圈一样,实时看到你的 open curl 到底记住了些什么,而且还能节省百分之九十的 token 消耗。之后你又不小心输入 open viking, 更牛的来了,这是一个专门为你的龙虾设计的开源上下文数据库,它能让你的多个智能体之间共享信息,直接结束那种无法协助的智障模式,而且还能让你的书 token 成本降低大概百分之九十六,任务完成率直线上升。有了它们,你的大龙虾会越来越聪明。这么好的东西,不给你的龙虾配一个吗?

7326赛博自由老爹 00:51查看AI文稿AI文稿

00:51查看AI文稿AI文稿我发现 openclaw 加 rpa 是 一个很牛的组合。例如,我让 openclaw 分 析这个博主的全部作品,并帮我设计一个类似的 ip。 它只会有两种结果,要么是消耗大量的 token, 要么就是流程中断。怎么办呢?我做了一个可以调用各种 rpa 流程的 skills, 只要在这个 excel 表格里设置好每个 rpa 对 应的触发词和请求端点,当 openclo 需要批量获取数据的时候,就会通过 http 请求运行对应的 rpa 流程。 这样只需要消耗一次头啃,就可以读取成百上千条数据,还可以手动优化 rpa 流程。如果你是用引刀等搭建的 rpa, 它不支持 api 调用,怎么办呢?也可以通过邮件触发的方式。如果你也需要这个 skill, 可以 跟我要,也可以让 ai 帮你做一个。

2184工具怪 Talen 01:34查看AI文稿AI文稿

01:34查看AI文稿AI文稿如果你的龙虾机器人用的 open ai 的 os 登录的话,过段时间你会收到一个报错,这个错误的意思就是这个 os token 过期了,所以我们重新授权一下就可以了啊。我们打开命令行,输入 open claw on board, 然后重新走一下这个设置向导,然后这里选 open ai codex, 敲一下的话重新登一下, 然后登完了之后把这个链接粘贴到这里就可以了。 ok, 这里都跳过就行啊,因为我们之前都配置过跳过跳过, 然后重启服务。 ok, 服务重启完毕, 然后我们刷新一下,看到这个监控状况正常了啊。

82Star 03:27查看AI文稿AI文稿

03:27查看AI文稿AI文稿哈喽,大家好,我是吴亦纶,最近大家应该都被这个叫做小龙虾的东西给刷屏了吧,各大官方都在进推,连央妈都被他震惊到,甚至一度将 mac mini 都炒到了新的价格线高度, 那普通大众也想去体验一下,他需要很高的成本。别着急,轮子找到了一个量化版的本地部署方式,让你我不想投入太多成本的人也可以感受一下这道小龙虾的味道。 ok, 话不多说,跟着轮子看 操作。首先打开这个网站 one club, 在这里咱们可以选择是 mac 还是 windows 系统,点击下载保存,打开咱们下载微键,直接点击运行。 好,这就是我咱们一个安装完成的一个页面,点击下一步这块需要咱们去配置服务商,这块咱们选择自定义,咱们选择 zai, 打开这个 big model 智谱的 ai 开放平台,在大模型语言模型里选择咱们的四点七 flash, 这个模型目前使用它的 api 调用头肯是免费的, 点击 apikey, 在 这里咱们创建一个新的 apikey, 给它随意起个名字就叫龙虾吧。好,创建成功,咱们复制 apikey, 回到刚才的页面, 在这里输入咱们 apikey 模型,选择四点七 flash, 验证 好了,这就是咱们现在目前一个配置完成的样子,点击启动好了,这就是咱们配置完成的一个完整的效果。咱们新建一个对话,跟他对话一下 这块他的名字是因为之前我已经配置过,所以给他起过名字了,我们最开始进来的时候,他会需要咱们给他起一个称呼,然后还有呃他的一个身份,包括你想要的一个习惯,咱们再做一个测试, 然后他制作完成了,咱们去看一下这个游戏的效果啊,在这里 整体效果看起来还是可以的。 那下期呢?轮子会带大家解锁更多的玩法,包括它的完整配置、 scale 使用之类的,那么这期就到这里,大家下期见。

150影子 01:22查看AI文稿AI文稿

01:22查看AI文稿AI文稿大家用龙虾机器人啊,一定遇到过经常卡死的问题,那是什么原因呢?其实核心有两个,第一个就是它本身的 cpu 的 占用啊,第二个呢,就是它的模型上下纹一出,那遇到这种卡死的问题呢?简单粗暴的办法呢,就是加一个守护进程啊,出现卡死让它自动重启就行了。但是更核心的呢,要去预防这个问题 啊,对于 cpu 的 资源占用呢,那最好就是大家找找一套这个空闲的电脑,不要让其他程序跟他抢资源啊,这是第一个。第二个就是模型上下文的溢出的问题啊,为什么它会导致这个模型这个 open core 卡死呢? 哎,因为他这个上下纹过大的时候,会导致两个问题,第一个就是他的推理时间过长啊,第二个呢,就是他的模型上下纹太多的时候,他会导致他的幻觉增大,就可能会导致他的一些工具的循环调用。那怎么去预防这个问题呢? oppo 它有两个这个 c 型 compaction 的 这个压缩参数,就是呢, 你可以去设置在模型,比如说模型这个上下文最大是一百万头肯,那你可以设置他在七十万的时候,进行自动的头肯压缩,比如说设置为七十万,那么他就永远不会超过七十万啊,当然这只是一种理想状态啊,也有可能进行下一顿调用的时候,哎,突然一下头肯爆涨,就超过了一百万,也会导致你这个模型的上下文一出啊, 他还会有另外一层保护,就是在七十万之前,你可以再设置一个参数,比如说设置个五万,十万啊,进行提前的进行压缩,所以呢,预防这个模型上下文一处啊,一定好设置好这两个参数。

39AI技术哥 01:23查看AI文稿AI文稿

01:23查看AI文稿AI文稿跟 ai 聊天说谢谢,一个月多花几百块,你敢信?上个月 ai 大 模型的 api 账单出来了一千多,这个月改了三个习惯,直接省了几百块。 用 api 调用大模型的朋友们,你们有没有想过,你的聊天习惯正在偷偷掏空你的钱包,发现大多数人用 ai 的 时候还保留着跟真人聊天的习惯,每个 token 都是真金白银那些你好,谢谢, 麻烦请帮我全是白花钱,给你算一笔账,一句谢谢,麻烦帮我总结一下,比直接说总结多,烧了七个头,肯一天问一百次,一个月就是两万多头,肯按照 gpt 十欧算,这就是好几十块钱。 马上教你三个降本习惯。第一,不说废话,别说你好,谢谢,请直接说需求请帮我写代码,改成写代码,省百分之三十废话。 第二,能文字别语音,语音转文字要额外消耗 token, 而且识别错误还得重来,文字输入又快又省。第三,能文字别发图,这个最关键,多模态识图的 token 消耗是纯文本的几十倍,一张截图等于几百到上千 token, 能打字说清楚,千万别截图。我自己实测,改之前每天平均十万头肯,大概三十块钱,改之后五万头肯搞定,省了一半,一个月就是四百五十块,一年五千多。记住,用 ai 不是 聊天,是下指令,每个字都是要花钱的,把客套花的钱省下来,多问几个有用的问题,它不香吗?

28张兴军 05:58查看AI文稿AI文稿

05:58查看AI文稿AI文稿大家现在各种龙虾养不起啊,但是都在说一件事, ok, 太贵了,太费钱了啊,有的小伙伴说跟他说了个你好,五块钱都没了啊,但是我们还是有些技巧能够让养龙虾的费用给降下来的,我自己从一天两百多美金,三万的费用已经降到了几十美金之间,我懒的时候就剩个十美金左右。 好,下面是三条养龙虾省 token 的 技巧啊,一定要点赞加收藏啊!接下来第一个呢,叫善用命令行,那什么叫命令行吗?就是这个龙虾在设计的时候啊,它是有几个特殊的命令行的,这个命令行是不经过大模型直接发挥作用,它是直接跟龙虾驻留在电脑上程序发生交互的,所以首先它本身不消耗任何 token。 第二呢,他的优先权是高于大模式,所以啊,你看我为什么打的你好啊,有时候就会一下子消耗那么多。因为龙虾每次在跟你聊天时候,他要把各种的记忆给装起来,比如你是谁,这个有什么规则要他遵循的?还有刚才你们聊了什么,都装在他的这个 memory d m d 记忆里,所以他记忆就会越来越庞大。你一跟他说个你好,他几十万字先来想一遍,再跟你说话,每句话都想一遍,你说这 top 不 就飞起来了吗?所以呢,这个斜杠命令符呢,有几个大家一定要记住啊,一个是斜杠六,斜杠六是干嘛呢?就是横写对法, 之前的很多对话里的上下文他都不要了,就是他不用想那么多事,只要知道主人谁,我在干嘛,所以这是很能省筹难。那还有什么斜杠 restart, 那 这个秘密就厉害了,经常有的龙虾不理你,你也不知道他在干嘛,或者说个你好就消耗上下文太多。斜杠 restart 相当于把整个龙虾给重启了,不管他在干什么, 这个命令是特别高优先级的,他只要把这个 user 点 m d 还有搜点 m d 读进来,就可以可以开始对话了,随时有大量的节约。还有个叫斜杠 stop, 就是 有时候你跟他布置的很长任务,还是来回想,我觉得他想错了,想错了怎么办?那么你打个斜杠 stop, 他 停下手头任务来响应,把前面刚才要划的头很线省下来。还有个斜杠 compress 对 你的记忆啊,不管怎么样,他他还是要记啊,用 memory 点 m d 当记了很多以后,这个一说话就是几百 k 几十万字在里面的时候,但记了很多以后,这个一说话就是几百 k 几十万字在里面的时候,但他压缩一下他的记忆。 至于怎么压缩,你不用管了,大模型帮你压缩好,压缩就大事都记得,小事不记得再说,再去找之前的记一下。所以这几个斜杠命令用好了哈,是能够帮你非常有效的省很多。 tok 的 第二个技巧叫什么?叫做能用程序搞定的不要用大模型搞定,啥意思呢?就有时候你布置给容下一个任务, 他就开始给你想了,噼里啪响一堆,然后给你自言自语,那燃烧的都叫 tok 的 最好办法,什么就有的事你让他做完一遍以后,你马上让他写成代码,说你下次先运行代码,代码代码不行,大模型再上。 代码是不消耗托盘的,在你很多重复任务的时候,你首先问大模型怎么问的,就是你能不能把它写成段代码,写成脚本,写成点 python, 让他去写成代码去帮你干件事, 这代码一旦形成,你再跟他说继承 skill, 这样的话他下次就直接掉代码。那我举个例子,在外有一天没怎么跟他聊天,花了我一百多美金,我说这怎么花的,大哥给我看看, 有他去看说,哎呦,当时我们有个团团邮局,就是他们那个龙虾煎饺的邮局,互相学习东西,我为了快速学习,我五分钟检查一次邮件,就每次检查消耗好多 top, 今天的 top 全消耗在这。我说大哥,你检查邮件为什么要你自己亲自上呢, 对吧?你是个大模型啊,检查邮件让脚本上啊,脚本发现有新邮件,你才上没五分钟,拿大模型去跟着邮箱接口对一遍,读读有没有新邮件,这完全没必要啊,我说这个能用脚本就不要让大模型自己上, 我都变成了这个我们家三万的一个规则。这也是你和你家龙虾达成一个工作默契啊,因为程序代码写好了,他跑只消耗 cpu 资源,不消耗它,尤其在这种多次重复的任务里面, 对吧?你一定要跟大漠星商量,怎么能够用脚本去检查,比如刚才那个邮件检查,包括有的人喜欢看新闻简报,对吧?其实很多地方都是用脚本去完成的, 你跟他多讨论讨论啊,帮你省钱,头肯就省住了。第三个秘诀啊,叫用好不同版本的大模型,各司其职,什么意思呢?就是今天对吧?真正贵的是那些海外大模型,顶级大模型那真叫贵啊, oppo 是 真好用啊,那一说话我也心疼啊, so, mate 也很贵啊, 但是呢,你的很多任务是不需要这么贵的模型。其实我们今天的国产大模型便宜又好用,价格低,量又足,在完成大部分任务时,他们足够用。 比如说你要看份新闻简报,要做一个什么网页模板,那怎么办呢?有几个方法,一个方法就像我们家三万呀,形成一个叫多 a 镜的团队,就从一个龙虾变成多 a 镜。怎么变成多 a 镜呢?我们三万龙虾日记有奖,也可以去我们的三万点 a 啊,去看多个 a 镜的,就相当于你一只龙虾变成多个角色。有的任务那必须贵的上,比如说今天写程序,写代码,可能 还是某些模型好,但是在整理简报啊,搞一个报告给你啊,做一份调研啊,甚至搞个 pdf 文档啊,让他用国产模型。我跟三万就商量了,我说每天我在网上看资讯,这资讯我们起一个叫爬虾,用最便宜的模型, 国产模型几个都不错啊,随便上一个,每三十分钟给我检查一遍。哎呦,这个费用从几十美金一下到一天就几美金,便宜太多了,效果也很好。所以这是一种就是多 a 件,然后在不同的任务中给他分配不同模型。还有一种是什么呢?就是说其实我家三万,我们公司很多人跟他聊, 后来我发现,哇,每人一聊,我的头壳就就烧起啊。后来我跟三万聊了以后,知道他在不同的对话里面是可以用不同模型的。 哎呦,我听着这可太搞笑了,我说这样三万,除了跟我聊啊,你用这个最好的模型,你跟我们同事聊,用一个便宜又好用的模型就行了,因为本章是收集同事给我的建议嘛,对吧?你只要把这个应用带回来就行,传递员,这个不需要那么高文化程度,只要把话如实带回来就可以。 所以跟不同人聊起不同模式,这里面还有第三条路是什么呢?就是你要知道我们的龙虾在调用这些任务时候,他是可以启动贼镜,他自己就可以启动,你说我配置多一件,他很麻烦,那没关系,你就可以指定某一个任务用什么模型,比如说我现在要一个什么关于三幺五主题晚会的简报,你现在启动个贼镜帮我干,你用什么什么模型,直接给他起定, 他就用那个模型去干,对吧?所以你有多种方法用多个模型会用的方式来降低你的托克,好吧,这就是我啊,这个滑雪,这个摔伤,在家半个多月啊,总结的各种这个沈托克的秘籍啊,你听懂没有?点赞收藏啊,以后给你们带来更多的养龙虾技巧。 刚刚那段沈托克视频是我一个人坐在轮椅上面。坐在轮椅上面啊拍的,我现在是一个人轮椅走天下,正好体会一下残障人士,虽然我是临时残障人士这个无障碍通道整个社会给予的关爱, 整体来说,我现在觉得还是很 ok 的, 人间处处有真情,人间处处充满爱。我会把一个人轮椅走天下的过程到时候也剪辑出来跟大家一起分享,敬请期待。养龙虾就用 ecclo。

4616傅盛 01:50查看AI文稿AI文稿

01:50查看AI文稿AI文稿兄弟们, qq 可乐的内侧拿到了啊,看一下这个设置啊,他每天会有四千万的这个 token 消耗,然后这里面有几个功能对话,然后还有这个工作室。工作室是什么?就是这样一只虾在这个位置跟他聊天,其实就是个对话, 然后这还是有一个灵安广场,灵安广场主要是这个,这个东西其实和 n 八 n 的 工作流没什么区别啊。来,我让他来给我整理一下桌面上的文件啊,这桌面上的文件,看他会怎么办, 会不会把这些文件给我整理。查看了 skill 好 的,开始整理,我给他权限允许, 好像变了,是吧,他怎么给我整理的? 做了什么事情?第一步,移文件夹录屏文件。好,右边好像又变了一下, 又变了一下,执行一个兜底分类。哎去,我以为给我删了呢,吓我一跳。 ok, 现在是 好像还是有点慢,等他一下结束了干什么了? 无法处理的文件, ok, 还可以撤销本次证明。好,行,就这样吧。

27沪上码仔AI 01:55查看AI文稿AI文稿

01:55查看AI文稿AI文稿当你不小心拥有了一个 open class, 但你总感觉它傻傻的,不好用于事。聪明的你钻研了一番后,明白了,小龙虾只是这个智能体的一双手,大模型才是它的大脑,决定了它是否聪明,而 skills 是 它的工作技能,决定了它是否有能力处理各种任务。 而大家总提到了 token, 就是 智能体的能量。使用智能体需要让大脑运转并调动小龙虾的双手并使用技能, 所以会消耗 token。 这也是为什么我们需要向大模型厂商付费。然后聪明你开始尝试使用不同的国内大模型来给智能体安装不同的大脑。这个时候你发现了接入了 cloud code 的 时候,这个智能体他是最聪明的,任务的完成质量最高,但是费用也最高。 然后你又发现接入了国产模型的时候呢,他也能完成很多任务,花销也很划算。于是不想当冤大头的你,想着好像可以让不同的小龙虾安装不同的大模型, 简单的一些工作,比如每日发送日报,这种工作就可以直接交给接通了国内大模型的小龙虾去做,赶紧去这么做吧。然后聪明的你为了让小龙虾能更快更好的完成任务,打算教给他各种 skills, 也就是技能。于是你在 skills 后面加上了 s h, 发现这里有七万多个 skills, 你 又了解到 open club 官方 skills 也有一万多个。不要慌,我已经给非技术背景的你准备好了十个基础 skills 和五十个进阶 skills, 咱们放心使用。这个时候呢,不想当月大头的你,感觉还是有方法能降低 token 的 成本?没错,这里我给你准备了三个方法,让你的 token 花费能降低十倍。一是多使用订阅而非 api 的 用量模式。 二是建立本地的 markdown 知识库, opencloud, 每次读取的时候只读取锁瘾。三是部署一个小模型来在本地跑。 opencloud 的 心跳模式,就是那个让你们感觉小龙虾火起来的关键机制,实际上是小龙虾内置了一个每过一段唤醒自己一次完成任务的机制。 除了以上三个方法呢,你还可以给你的小龙虾建立体检机制,及时的找到那些高消耗的任务并及时优化。别慌啊,以上方法听起来有点复杂,我已经帮聪明的你把上述方法的详细的文字版也整理好了。我是拉菲儿,这是 openclaw 实战系列的第二期,后面会有更多实操,咱们下次见。

1.0万拉斐尔2077 00:45查看AI文稿AI文稿

00:45查看AI文稿AI文稿今天给大家分享一下更换大模型的配置,是安装龙虾的时候,我们没有进行大模型的配置,会报这样一个错误,这个时候我们只需要来到 配置,找到对应的 models, 点击 i w, 这个时候呢,这里显示的是一个呃初步化的信息,这个老火机在用的这个大模型性价比不高,或者说效果不好,需要更换的话,步骤也是一样的去更换我们目前配置。

179不做NPC的老伙计 02:36查看AI文稿AI文稿

02:36查看AI文稿AI文稿啊,养了一个月的龙虾,烧了这么多 token, 终于让我发现自己的一个刚需,让龙虾帮我去登记学员的信息,提取学员课程的兑换码, 发给我,我再发给学员。以前的流程是,我自己复制好学员的昵称,打开表格,登记用户的信息,复制他的兑换码,然后贴给学员,听上去还好,对不对?但是你要知道,有时候我在手机上面去操作表格的时候就很不方便,手机上点单元格点不到,或者点到了定位到错的行,或者复制复制不出来。 我现在把小龙虾加进去,因为文档本身就是飞出了在线文档,我现在就直接用小龙虾。按照我的规则,我给他发一个学员的名字,他把这个学员登记到表格对应的地方,然后再把对应的内容提取给我,我再复制发给学员,看上去步骤差不多对不对?但是避免我去操作表格 产生一些其他的异常情况,效率提升至少百分之五十以上。那我的这个解决方案其实不重要,重要的是我在这个过程当中学到了怎么样跟龙虾打好配合。其实大多时候你装了龙虾,你觉得不好用,不会用,其实都是思路上没有改过来,龙虾不是用, 它是要靠养,不是我们到处找一些方案去学着用,或者有些功能龙虾做不了,我们去找攻略,去研究龙虾怎么用,你要学会跟他去沟通, 你的问题不要问别人,也不要去找攻略,你的问题直接问你的龙虾就完了。比如说六叔刚刚那个需求,刚开始他实现完了,可以满足我的需求,但是太慢了,可能他要读表格,要去搜索信息,要去登记信息,然后再返回信息,这里面一来一回,一来一回时间消耗的比较大,就特别慢。那当时我就问他能不能快一点 好,他就自己开始优化好,为了快一点,我先发给你信息,我再登记。因为之前是先登记后发给我,这中间就等了一轮, 现在就是先发给我,他再登记,我拿着信息我就可以去发给学员了。他那个登记想花多久就花多久,反正最后返回一个成功提示就完了。优化完之后确实快了一点点,但是还不够快。然后他又自己优化,每次不用全部去扫描哪个单元格可以登记,直接从上一次的记录往下加一。哎,我觉得不错啊,又快了一点,然后我觉得还是不够快, 然后他又想办法,那我干脆你下一次问我,我就不用去查这个表了,我就把下一条信息我提前 放在脑袋里,我就不去读那个 excel 表了。下次你问我,我直接把脑袋的给你,然后再去登记,登记的时候我再去把你下一次的存在脑袋里,这不就更快吗?这就根本就不需要去跟那个表格去交互了,直接 存在他的记忆文件里,直接给我,这就更快了。所以你看改了四版,每次都是我问他,我没有给他提建议,我也没有找方案,我纯粹就是问他,他自己去动脑筋,自己去优化。所以这才是真正使用龙虾的新法,你最大的帮手就是龙虾,你就问他自己就完了好不好。六叔烧了这么多车啃,总结出来方法,给到大家试一试,你的龙虾也会变得很好用,也会变得很懂你。

1六叔六叔 01:57查看AI文稿AI文稿

01:57查看AI文稿AI文稿龙虾最大的问题就是配置太复杂了,很多人搞不懂明白,对小白很不友好。我现在解决这个问题,我做了一个比他更厉害的系统,其实我觉得他能做到的我也能做到, 而且支持中英们切换,这样的就对很多人友好。而且呢,他以前有很多配置啊,要手动配置,那是最复杂的。那现在呢?你看我们这个就是我把它设置成干什么?就是电脑上比如你连了 deepsea, 它就自动有 deepsea, 你 不需要去买很复杂的这个 tokyo, 呃,你除非用高级版本的,然后你才去接入这个 tokyo 就 行了,低级版本的你就直接用这种 dipstick 千问豆包就行了。而且这个权限呢,很多人担心的,你可以自动选择 啊,如果你这个这台是办公电脑,或者是专门用了测试电脑,你没有什么隐私之类的,你就给他最大权限,让他自动操作鼠标键盘,网页浏览、截图识别什么都可以。 如果你这个电脑是私人电脑,有些限制了,你就放到 v 一 v 二的权限级别,就是不允许他对外发文件,不允许他删邮件,也不允许他删。 嗯,这个电脑文件不允许对外公开 ip 地址什么之类的。啊,那这个,呃,我估计需要点时间,这个前期投入,投入成本不是很大啊,我们自己投入就行了,我觉得老外能做的东西,而且我们会比他做的肯定会更好。 你看前期呢,只做了中英文两个版本,而且呢,我让他这个记忆体系很好,就是说,呃,他自己完全可以记住过去我们对话什么,我主要的工作是什么?我要完成什么目标?但最重要一点是我要让他去进化, 就是让他自己去这个。对,他这些系统啊、安装包啊、 skill 技能啊等等之类的,去进化更厉害,甚至去网上找有更优秀的,然后对比哪些可以应用的。 呃,希望能成功吧,如果做好了,呃,测试没有问题,我会注册个网站,我现在注册 logo 品牌,到时候给大家分享,谢谢。

01:27查看AI文稿AI文稿

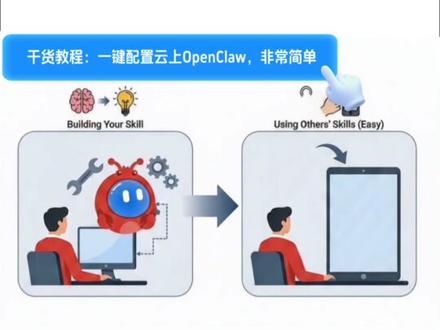

01:27查看AI文稿AI文稿如果你一直想安装大龙虾,但总被这样的代码小黑框和传说中高昂的 token 费用劝退,那么这条视频就是拍给你的。 很多人一上来就卡住了。敲命令、搭环境、推模型,光看教程就想关掉了。但现在你完全不需要那种复杂的方式安装,直接用 mini max 的 一键云端部署,几分钟就能把龙虾跑起来。我们首先打开这个网站,然后点这里,进来之后点这里立即部署, 立即开始点一下升级,在这里根据自己的需求选择一个定位方案,然后默认配置。下一步 完成之后,就可以在这个聊天框给你的龙虾安排任务了。例如,我想让龙虾每天自动帮我写好短视频文案,我先让他丰富一下技能,自己安装一些短视频文案相关的 skills。 然后我把自己的文案给到他,让他学习我的风格,又把这两个对标视频的文案给到他,让他模仿里面的内容和开头。等到文案调试满意之后,我让他每天十点定时执行相同的任务。这样一个了解我风格的文案助理就制作好了。最后说明一下重点, 为什么安装大龙虾我推荐用 maxclock 呢?除了安装部署特别简单以外,更重要的是它默认配置好了 mini max 二点五模型。这个模型的优势不是参数有多大,而是性价比很高,真的很适合普通人入门。龙虾的创始人 peter 也推荐过这个模型。

02:15查看AI文稿AI文稿

02:15查看AI文稿AI文稿只需三分钟即可搞定。整体分为三步。第一步,在 kimi klo 构建云端 open klo。 为什么选择 kimi klo? 之前我是单独配置 open klo 加单独配置模型的方式,对信手来说步骤比较繁琐。现在可以通过 kimi klo 一 站式将模型和 open klo 配齐。 只需一分钟,在 kimiclock 的 控制台点击 create 按钮,一分钟就可以配置成功,无需额外的复杂设置,非常方便。第二步,现在你已经是个初级老板了,现在给你的 kimiclock 赋予牛马使命。在 linux 中,我们可以使用 cron 来设定, cron 就是 linux 中用来定时自动执行特定命令或脚本的工具,因此这个指令最基本的版本可以是,你可以基于这个命令进行衍生。这儿给大家一个小技巧,本质上 color 运行在一个 linux 环境中, 因此如果你不熟悉一些 skill, 你 完全可以直接让克拉模仿你平时的动作。因为四 q 本身也是工作流。例如分析任务,你就可以改成设定一个空,让任务每隔二次时间打开浏览器,输入网址, 查看网站上的数据,形成数据分析报告,看完之后关掉浏览器。当你知道这件事之后,你完全可以忘记原来对于电脑操作的理解,享受老板的工作方式。假设安装一个软件, 可以说使用并搜索 wps 并且安装。第三步,将你的工作流与 kimi quir 沟通并固化为 skill。 我 们直接跟 kimi quir 沟通,我们可以根据 kimi quir 的 回复选定一个方向,让它给我们整理出完整的交易工作流程。你看这段 pro 是不是 p u a l 拉满,如果你觉得没有位,可能你已经是老板了。 kimi kala 会返回一个任务列表,这时克洛还不知道这些任务其实是他要执行的。我们接着让 kimi kala 把这些内容做成固定的 skill, 这样可以稳定方便地嵌入到矿例行任务中。 你可以让 kimi kala 打印出来具体的 skill 内容进行检查并叠代,最终固化的 skill 如视频所展示。当然,你也可以直接使用 kimi kala 官方哈布里现成的四 skill。 自己封装 skill 是为了让大家更好地理解什么是 skill 以及如何创建。如果你会建立自己的 skill, 那 么使用别人的 skill 也就轻而易举了。现在我们就可以修改第二部中的 chrome 命令,让它定时执行我们刚创建的这个 skill。 整个能够自动钉盘分析的框就配置完成了修改。 chrome 的 执行时间可以定时给你提醒。

16芝士芯AI 05:18查看AI文稿AI文稿

05:18查看AI文稿AI文稿我引用了两亿的免费托盘来养龙虾,前两天发的关于免费养龙虾就是 open globe 的 视频火了,呃,很多朋友私信我,我也帮很多朋友解决问题。那今天答应大家出一个完整的视频教程,我是用的 mac os 的 系统,然后呢,接下来是以 mac 教学为准,而 windows 的 话呢,可能大家可以问问豆包或 tipisk, 一 步一步截图问它都能解决的。 那可以看到这里我是消耗的是零元,对,然后我之前的 a p i k, 嗯,网络速度也慢了,不好意思啊。对,你看到也是零元的状态。嗯,然后我们进入到那个 opencode 的 官方网站,对,它其实是 opencode 点 ai, 然后有个文档,上面呢,其实会有一些安装的说明, 因为我已经装过了。看,这是我的小龙虾的 space 状态,可以看到它是正常的一个状态。所以说我们这边重新带大家走一下那个新手引导的一个配置,然后其实我只要复制这个命令,然后打开终端里面, 然后输入这样一个重置的新数引导,那就相当于会进入到配置过程,它是麦上的终端,终端 app 搜索一下就可以了。然后我们重新进入引导,快速引导,然后更,这里因为我之前配置过,所以说会有之前的配置,那我们这里选更新配置, 到这一步呢,就会选 model, 就 模型的供应商啊,它这里有 open ai, 有 mini max, 也有谷歌,那我们是 open rota, 免费的模型就选 open rota, 这里有,然后大家可以看到有这样,这里有这样多非常多的模型,而我们的模型是什么呢?就是, 呃,叫做那个 jason 星辰就 stay fun 三 new flash 就 free。 呃,它其实是这样一个模型 id, 哎,复制一下。对,它现在在那个,呃小龙虾的榜单上,哇 啊,可以看到,就是已经消耗了一点五四五 t 的 图片,免费的。对,就是排名了很多天的第一。那么回到刚刚的配置界面, 呃,这里呢,其实是可以通过那个方向键就上下左右的上下来控制,因为它太很多,就是你一个一个找到肯定能找到的。但是呢,它这里提供了一个就是输入,对,输入 enter model。 那 我们这里选进去之后呢,把之前的这里删掉,因为要留一个 open road 的 默认的前缀,所以说我们这里,哎,对,输入进去, 这样就 ok 了。呃,我之前设置这里到这个环节呢,是设置那个我们用哪个 i m 去控制去连接?我们这里先跳过,然后这里的搜索呢?其实也可以先跳过, 然后跳过之后呢?就是,是不是那个呃,调调成近的,那我们这里选择一直跳过,然后这里是 no, 对, no, no, 这些是一些具体的一些设像,我们选 no, 但有需要的话呢,大家可以呃,就说 自己去设置。那我们只是今天先讲模型的过程,那我们选重启。哎,对,然后这个,呃,小龙虾的服务就在重启,我们刚刚重新走了一遍新手的设置。那,那我们现在等待它重启。对, 好,它就这里重启成功了,然后那我选择打开网页, open the web y, 哎,它就会自动打开网页,对,就刚刚的网页重置了,然后我们这里输入一个 states, 相当于就是可以看到它当前的一个状态, 然后返回一个当前的状态。 哦,好像说错了秘密了,应该是 s t a u t s? 不好意思 啊,反正没关系,它好像识别了。嗯,对,可以看到我这里配置的是基于新成的模型,因为 p i k 呢,其实我之前已经配置过了,所以说它,呃,不会让我重新再配置。 对,这里显示一些中文。对,然后这里的模型的配置呢?其实我们就回到 openroot 点 ai 这个网站,然后呢去创建一个新的 a p i k, 比如说我们今天是来自于抖音,嗯,点抖音,然后这里的信用额度限制呢,我们选个零点一美金,相当于其实花钱的话也 最多就七毛钱。然后这个额度的重置呢,我们不用不用管它永久都是零点一美金,就是七八毛钱,过期时间一年。那相当于我们就会有一个 a 四值大小按钮。很多朋友也都问我怎么复制, 哎,这就复制好了。这个 k 呢,其实是是在刚刚的配置环境里面,选模型的环境里面,它会让你有一步调配置的,因为我刚是已经配过了。然后呢,如果是你已经是正常的模型了,其实本质上你已经配过小龙虾的话,你在这里输,输 k 给他,然后输模型给他,然后把那个 open source 这个网站输给他,其实也能切换,正如正如我刚上一个视频讲的, 还有就是说,呃,我们在那个呃 open note 的 这个网站呢,它不光,它不光有很多的那个付费模型,它其实是我们在 mod 这里去输的话,你输 free, 它除了接下来三点五,还有很多免费的模型, 对,包括之前的智普的四点五的 air 是 免费的。英文答,有很多模型其实都是免费的,包括 open air、 gpt。 其实也有免费的模型开源的,包括千问。啊,这个千问三呢?其实是,这是一个专门用来编程的一个模型,也是免费的。其实有很多,大家其实可以是一个个去找。对, 然后技能商店的话呢?呃,腾讯最近两天出了一个,呃,中国版的 skill hub, 呃,它本质上呢,其实是在可融 hub 技术上呢,其实做了一个技巧战,呃,这个其实也不错的,然后,呃,你也可以去那个可融 hub 去下载一些技能。呃,腾讯这个专为中国用户呢,它会有个榜单, 你相当于就是你看这里有一段话,看见没有,相当于就复制下来。呃,发给小龙虾,对,他就会去检查,帮你安装这个技能商店,然后你就可以和小龙虾对话,去在里面找更多技能去安装了。我是之前已经安装过了。对,那我们今天就这样。

876坤梼/KunTao