silk验证是不是机器人是安全的吗

ai 智能体小龙虾爆火了,但如果这个智能体被电诈团伙利用上,那刑事案件更难办了。因为你面对的再也不是那个会紧张会露馅的化物人,而是一个永远不知道疲惫,不知道恐惧的机器。 第一,诈骗呢?直接进入全自动模式,筛选目标,发钓鱼软件,伪造证件,死前他一个人一条龙全部干了。所有的犯罪行为都会伪装成正常的数据, 你根本分不清楚哪一笔交易的背后,是那个 ai 在 操作。第二,真正的幕后黑手彻底隐身了。张国立和 ai 全干了,就算你追踪到一个正在作案的账号,他随时可以放弃那个人,瞬间人人蒸发。更可怕的是,这个玩意他能够同时扮演七八个人, 跟你聊天,签合同,甚至伪造出一整套真实的朋友圈。你拿到聊天记录一看, 跟真的一样,你根本分不清楚哪句话是真的,哪句话是 ai 现编的。所以最颠覆的问题来了,如果骗子搭建一个空投公司,让这个 ai 做操盘手,等钱一到账,他把网线记上号,这个虚拟的人就凭空消失了。你们抓不到现行,也找不到活人。 犯罪行为跟幕后争锋之间,被这个技术活生生切开了。你明知道有人在犯罪,但是就是找不到那个人,这个就是 ai 厉害的地方。

粉丝1.2万获赞10.1万

相关视频

01:11

01:11 04:53查看AI文稿AI文稿

04:53查看AI文稿AI文稿大家好,欢迎来到 ai 新闻早班车。大家好,今天咱们来聊聊 ai 技术前沿的几个重要动态,既有安全防范,也有算力突破,还有产业应用。 没错,第一个话题是关于深度伪造技术的风险防范。昨天三幺五晚会重点讨论了 ai 换脸技术可能带来的安全隐患。我听说现在这种技术门槛已经非常低了,只需要一张正面照片,就能生成一段真假难辨别的视频。 确实如此,现在的深度伪造技术主要基于生成对抗网络和扩散模型,生成速度极快,三十秒内就能完成。这种技术进步本来是好事,比如在影视制作、虚拟主播等领域有广泛应用,但一旦被滥用,就可能成为安全隐患。 那普通用户该怎么识别这种技术风险呢?网络安全专家给出了几点建议,第一是动态验证,要求对方在视频中做快速转头、遮挡面部等动作,因为 ai 换脸在模拟复杂面部运动时,容易出现画面撕裂或表情不自然。 第二是私密问题,验证询问只有双方知道的细节, ai 无法凭空知晓这些信息。第三是二次确认,挂断后通过原有联系方式回拨确认。听起来这些方法都很实用,那在技术防范方面有什么进展吗? 有的,目前手机厂商已经开始在系统层面植入 ai 反诈检测技术,比如荣耀、小米等品牌的系统,已经能够实时分析视频通话中的画面要素,通过分析像素、纹理、帧率异常等捕捉 ai 合成的物理破绽。 中国移动研发的深度学习模型实时建委准确率已经超过百分之九十五,这真是技术对抗技术啊!说完了安全话题,咱们聊聊算力方面的突破。我听说中国在光计算芯片领域有了重大进展。是的, 上海交通大学翟广涛团队在科学杂志上发表了 lightgen 全光生成式 ai 芯片的研究成果,这项技术实现了全光维度转换,能够突破生成式 ai 的 光通信瓶颈。全光芯片具体有什么优势呢? 最大的优势是算力密度和能耗效率。传统电子芯片在数据传输时会遇到功耗强和待宽限制, 而全光芯片利用光子进行计算和传输,理论上算力可以提升一百倍,同时能耗降低百分之九十以上,这对于大规模 ai 训练和推理来说,是个革命性的突破。一百倍算力提升,这简直是算力领域的降维打击啊! 确实可以这么说,虽然目前还处于研究阶段,商业化落地还需要时间,但技术路径已经非常清晰,未来如果能够实现规模化生产,可能会对现有 gpu 市场格局产生深远影响。 说到 gpu, 英伟达的 gtc 大 会是不是快要召开了?没错,二零二六年的英伟达 gtc 大 会将在三月十六日到十九日举行,也就是今天开始,这是 ai 领域的年度盛会,日内期待黄仁勋会发布新一代 ai 推理芯片。 除了芯片,这次大会还有哪些值得关注的看点?据前瞻分析,这次大会可能有五大主线,一是新的 ai 推理芯片架构。二是智能体生态的扩展,特别是尼莫克拉开源平台的升级。 三是 ai 工厂解决方案的完善。四是边缘计算和车规级芯片的进展,五是 ai 安全与治理框架的发布。 这些方向确实代表了 ai 产业未来的发展趋势。那在产业应用方面,最近有什么规模化落地的案例吗? 有的。在家电及消费电子博览会上,松年动力展示了春晚同款机器人小布米,并现场完成了批量交付,这标志着消费级机器人开始进入规模化应用阶段。 小布米这个机器人有什么特点?它是一款仿生人形机器人,能够完成基本的家庭服务、陪伴和娱乐功能。这次交付的规模达到上千台,说明供应链已经相对成熟,成本控制也取得了进展。创始人江哲远表示,二零二六年的销量目标是突破万台, 从实验室到千家万户,机器人产业真的在加速落地。是的,而且这次博览会还展示了 ai 芯片原生设计、环境智能感知等前沿技术,整个行业正在从单品智能向场景智能,从单机智能向群体智能引进。 听起来 ai 技术正在全面渗透到各个领域,那我们今天我们聊了深度伪造技术的风险防范、全光芯片的算力突破、 英伟达 gdc 大 会的前瞻看点,以及消费机器人的规模化应用,这些都是 ai 技术发展的重要风向标。希望大家能从今天的分享中获得有价值的信息,我们下期再见。再见!

32鹤尧在AI 02:53

02:53 03:00查看AI文稿AI文稿

03:00查看AI文稿AI文稿很多人问我那个号称介入了 g p t 四能防摔能看家的 bot, no no 到底发货了没?我去翻了他的后台,只能说科技圈的一点点事儿,有时也是一点点深坑。 kikicostore 上三百三十多名全球的支持者,二十五万美金含 indigo go go 的 真金白银, 换来的不是智能的伴侣,而是评论区那句绝望的 willuce everson, 我 们失去了一切,二零二六年的三月, but no no one 彻底的失联了。这不是普通的逃票,这是一个典型的 ai 幻觉,在现实的供应链面前赚的粉碎的商业标本。 更有意思的是,创始人的信息极少,团队不可验证,除了创始人发起的名字,面临于陈公司信息什么都没有。这是整个项目最核心的风险来源之一。 一个连团队都看不见的像,却要你相信他能做出更复杂的 ai 机器人,这本身就是最大的风险。我们理智的分析,为什么大约二十五万美金 填不平硬件的坑呢?大家要明白一个冷知识,二十五万美金在 ai 硬件量产之前连开模费可能都不够, 为什么 botno 会崩?第一功能堆积的制杀式的承诺,他承诺了叠状识别、火灾报警, 全天候的巡逻,每一项功能的背后都需要极其昂贵的传感器的调油和算法边缘化的处理。如果你没有像深圳大厂那样的供应链的溢价权,每一台机器的生产成本可能都高于你的众筹价。 第二个点就是被忽视的算力税接入了 g p t 四,听着很高级,但 i p i 的 持续调用费和服务器的延迟优化是一个无底洞,当你的众筹款被前期的模具费耗尽, 你拿什么去支付昂贵的 ai 后台的一个账本呢?在这,我想跟所有的极客和粉丝说句心里话,众筹本质是一项风险投资,而不是一次性确定的购物。 kikstar 上的团队已经介入了, 但结果呢,除了警告他们追不回一分钱不可漏漏的翻车,印证了二零二六年硬件圈的铁律。 ai 软件可以一夜爆火,但硬件量产需要的是真金白银的供应链硬实力,没有深度的算法优化的团队,只有几张精美的渲染图,这种项目在二零二六年通通属于高危的资产。最后,亏你给所有想买机器人的朋友提个醒, 以后再看见这种全能型且价格低的离谱的产品,多问一句,他背后的工厂是谁?他的核心算法是自研的还是纯套壳呢?别看他的嘴有多甜,先看他能不能活过。第一个量产周期 在二零二六年,能把产品送到你桌上的公司才叫科技公司,送不到的那叫 ppt 的 艺术团。 我是有点意思且有点判断力的。奎尼雷,下期科技圈的一点点坑带你继续避雷,记得关注我们,下期见! see you next time 拜拜!

01:29查看AI文稿AI文稿

01:29查看AI文稿AI文稿有多少人被这个验证码折磨过?你以为是在证明我是人类,但很有可能是在为谷歌免费训练 ai, 点红绿灯、找斑马线,都是在给数据打标签。爆料此事的文章已经被近一千万人围观了 两千年。卡内基梅隆大学教授路易斯冯安为了防止垃圾邮件,发明了文字验证码。后来他琢磨,如果投入一份精力干两件事情呢?于是他又退出了 recaptor, 每次系统都会显示两个扭曲的文字,一个系统认识,用来验证你是不是人类。 另一个是旧书里 ocr 无法识别的字,你以为自己在输入验证码,其实是在给数字图书馆做人工教。对,后来谷歌收购了 recaptor, 用谷歌截屏的照片代替文字,用户每次点击都是在告诉 ai, 这是红绿灯,这是人行道。这些数据直接进了谷歌地图和自动驾驶系统。 据说高峰时期每天有两亿个验证码被验证,每次十秒,加起来一天就是五十万小时的人力,按最低工资算,每天能省下五百万美元。网友已经炸锅了,纷纷喊谷歌还钱!不只是验证码,有网友分享,你在 youtube 举报 ai 生成的视频,其实是在帮他们给视频打标签, 训练下一代模型。还有宝可梦购玩家八年来一直以为自己在抓稀有的闪光皮卡丘,结果免费帮资本建了个史上最丰富的真实世界视觉数据集。网友崩溃了,原来我们一直在训练机器人取代自己, 关注机器之心,探索 ai 世界。

35机器之心 02:58查看AI文稿AI文稿

02:58查看AI文稿AI文稿大家好,这里是科技新赛道 二零二六年 aw 一 现场,这届展会堪称史上 ai 含量最高,我居然发现机器狗在游泳, 我身边这台就是智深科技的四足机器人红锤 m 一, 直接泡在水里都稳如泰山一般,电子产品早就扛不住了,真的是太硬核了, 这可不是什么行为艺术,这是在硬核验证 ip 六七防护等级。铜锤 m 一 的工作温度范围能达到零下二十摄氏度到五十五摄氏度, 无论是暴雨还是风沙环境都能轻松应对。作为行业首款水陆两栖的机器狗,铜锤 m 一 实现了接近一比一的负债自重比自重三十千克却能扛起三十千克的负债, 这意味着他背着自己同等重量的设备依然能跑能跳,以后不管是冒着暴雨去巡检电力设施,还是冲进火场救援,对他来说都是小菜一碟。 防水 m 一 的话,它搭载了是 ip 六七的防水,对,我们刚可以看到它是可以自如的下水,这个防水的性能在整个行业里面还是遥遥领先的。下面咱们再来点刺激的。机器狗跑酷 新生科技把赛道搬到了展台,现在正在跃上的这位选手叫钢镚幺一,别看名字萌,他可是真正的世界冠军。 首先我们的钢镚幺一搭载了自主研发的超灵活的这个一体化的冠军关节, 支撑他能够去完成这些灵活的攀爬动作,包括一些特技展示动作的一个核心所在。然后第二个呢,我们也是搭载了一个超强的强化的 ai 学习算法,这个也是能让他在这个场地内去适应全地形,然后去展现他的一个灵活性的一个基石, 为他未来的这个适配的空间去开拓了更多的场景,包括一些极限环境,包括一些更加这个啊应急的场景里面也是能去完美适配的。 能拿下 ios 冠军,说明他的硬件素质绝对是顶级的。他搭载了置身科技自研的关节模组,单关节峰值扭矩能达四十八牛每米,较同类产品提升百分之五十,最高能爬到四十度的斜坡,速度能飙到三点七米每秒。 二零二零年科技浪潮的核心就是落地实用,智深科技不断加速聚深智能的进化迭代,让机器人拥有了感知、适应与协助的能力。现在智深科技的机器人已经广泛应用到电力巡检、 应急救援、安防巡逻等万千场景,这台机器人正在从展台上的概念屏,变成真正能走进工厂、走进社会、走进我们生活的实用工具。那么今天的探险就到这里,咱们下期再见。

13科技新赛道 01:14查看AI文稿AI文稿

01:14查看AI文稿AI文稿近日,捷卡 s 系列机器人及 mini cab 控制柜通过国际电工委员会医用电器设备安全标准的严格评估,正式获得医疗安规认证。 当前,捷卡机器人在医疗领域日渐深入的应用实践,不仅验证了其产品的可信,也为此次认证提供了坚实的落地依据。 医疗安规认证的获得,为解卡机器人打开了更广阔的医疗应用空间。未来,在手术导航定位、放射治疗、辅助康复理疗、远程超声等更安全、高精度、高可信的医疗和生物医药场景中, 我们有望看到更多人机共创的身影。作为人类工作和生活的高价值伙伴,解卡机器人会通过精准稳定的运作赋能医疗行业, 通过标准化、可追溯的生产流程护航高医疗器械品质落地,在合规与安全的基石上,推动医疗领域向更智能、更高效、更人性化的未来迈进。

20:33查看AI文稿AI文稿

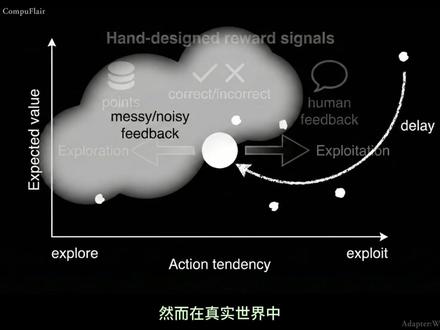

20:33查看AI文稿AI文稿为什么人工智能难以应对混乱的现实?想象一下,你在一个陌生的城市里,夜晚下着雨,到处都是施工路段,全球定位系统 gps 存在延迟,道路标线已经褪色,车灯照到地面的反光看起来像车道线,实际上不是。 即便在这种烟雨朦胧、迷离恍惚的环境下,你还是能成功穿行而过。现在把这种情境与当今许多人工智能系统作比较,给它们一个与训练数据略有不同的场景,它们的自信度 confidence 可能依然很高,但性能却在悄悄崩溃。 一个自然的问题是,为什么人类如此擅长应对混乱的现实物理环境,而让机器人拥有这种能力却仍然非常困难。 其中一个关键思路是,人类并不是被动地等环境变化后才做出反应。更重要的是,我们会主动去预测 entissape 接下来可能发生什么。 比如开车时,你不会等到车子已经偏离车道才去打方向盘。相反,你会不断在心里预判前方车道会不会转弯,方向盘的手感是否正常,那位行人会不会突然横穿马路。 一旦现实情况和你的预测不一致,你要么更新自己的判断,要么采取行动让情况变得更可控,比如减速,从而降低不确定性。 uncertainty 主动推理 active inference 与传统机器学习 traditional machine learning 这种预测 predict 比较 compare 更新 update 行动 act 的 循环就是主动推理 active inference 的 核心思想。 这也是现代人工智能中一种带有明显物理学思维的框架。要理解它的不同之处,可以先看看主流的机器学习是怎么做的。 现在很多强大的模型本质上像是巨大的模式,你和气 hyper fading engines, 它们把海量数据压缩进内部参数中,然后根据这些参数去预测输出。 这种方法确实非常有效,但问题在于,模型内部往往并没有一个清晰的因果结构,也就是说,它并不真正理解世界中什么导致了什么。它更像一个极其复杂的自动补全系统 auto complete 根据过去见过的模式来续写答案。 因此,人们常把这些系统称为黑箱 black boxes 并不是因为它们神秘,而是因为我们很难直接查看它们内部的逻辑,也很难问它们你是怎么判断的,你对这个判断有多确定? 主动推理 active inference 则提供了另一种思路,他认为一个真正智能的系统应该更像一个科学家。 scientist 科学家不是简单的给出答案,而是会对那些看不见的隐藏原因黑洞思提出假设,并在实验结果与假设不符时不断修正自己的理解。 你的大脑一直在做类似的事情。你并不是直接感知世界本身,而是接收到部分的有噪生的信号,比如视网膜上的光线,内耳的震动,皮肤的压力。你需要从这些有限的信号中推断出外部世界可能的状态。 关键的变化在于,感知 perception 不是 被动记录,而是在不确定性 uncertainty 下进行的推断 inference。 不 仅如此,在推断世界变化趋势的同时,你还会选择相应的行动来影响下一步你将观察到的内容。 例如,如果你不确定路上的物体是塑料袋还是石头,你可能会减速变道,或者调整头部角度来获得更清晰的视野。也就是说,行动 action 和感知 perception 是 紧密相连的。 action 本身就是一种采用世界 sample word 的 方法,用来减少不确定性 uncertainty, 同时引导结果朝你偏好的方向发展,比如保证安全。 active inference 试图把 perception learning 和 action 整合到一个循环中,而不是把它们当作独立模块拼凑在一起。 优化 optimization 从物理学 physics 到主动推理 active inference, 那 么物理学 physics 能给我们设计这种智能模式带来什么启发呢? 在 physics 中,一个反复出现的情况是复杂行为 complex behavior, 往往可以用优化原则 optimization principles 来解释。这并不是说大自然在努力优化自身,而是因为稳定的模式。 stable patterns 通常看起来像是某种最小化或最大化过程的结果。 想象挂在金属丝环上的一层肥皂膜,它会形成一个表面积最小的形状,没有哪个肥皂分子。再解数学题,这个形状自然形成,因为在物理规律下,这是最稳定的构型。 active inference 借鉴了这种思路,他提出这样一个问题,生命系统表面上看似有目的的行为是否可以被理解为在时间演进中不断最小化某个单一的量?最小化便分自由能 raynal free energy。 这个量通常用一个听起来好像很复杂的词,自由能 free energy 来描述。在物理学中, free energy 与系统能够做多少有用功? useful work 官。而在 active inference 中,这个概念被重新定义为一种以信息为中心的近亲便分自由能。 variation of free energy 直观理解,它是一个评分 score, 衡量你内部世界模型与感知之间的匹配程度,同时惩罚过于复杂的模型。 通俗点说,如果你的内部模型很好地预测了你的感觉,那么你体验到的惊讶 surprising 就 较小。如果预测失败,你就会产生大的预测误差。 predictionaries 迫使你修正信念 beliefs 任何维持自身存活的系统,无论是细胞、动物还是机器人,都无法持续承受自身感官世界所带来各种 surprising。 过多的 surprising 意味着你处于缺乏理解和控制能力的状态。因此,主动推理 active inference 提出适应性系统会持续改进内部模型,并选择能够让感知更可预测、更安全的行动,从而保持低惊讶状态。 在这里,很容易把可预测 predictable 误解成无聊 boring 仿佛一个智能体 agent 为了减少不确定性,只会躲在角落里,因为那样最安全、最容易预测。但真实的生命系统并不是这样运作的,它们会探索 explore, 玩耍、学习,甚至主动承担风险。 active inference 通过引入第二个关键概念来避免这种误解,也就是区分为现在减少惊讶和未来将来减少惊讶,前者关注当下的稳定,后者关注长期的发展,后者由期望自由能 expect free energy 来描述。 简单地说,就是在行动之前评估两个问题,这个行动是否会带来我偏好的结果?它是否会让我学到有价值的信息解决探索利用困境 exploration exploitation dilemma 这正是 active inference 用来解决经典人工智能难题,探索利用困境 exploration exploitation dilemma 的 方法。 传统人工智能系统通常依赖人工设计的奖励信号 reward signals 来学习,比如游戏分数正确或错误的标签或人类反馈。 然而,在真实世界中,奖励往往是稀疏的、延迟的,甚至是模糊不清的。 active inference 提供了一个更广泛的视角,它不再单纯追求最大化奖励,而是提倡选择那些既能带来偏好结果,又能通过获取信息来减少不确定性的行动。 在这个框架中,好奇心 curiosity 不是 额外添加的机制,而是与目标追求内在统一的驱动力。 用一个简单的例子可以更直观地理解这一点。假设一个家庭机器人正在帮你找钥匙,它可以去它很有把握的地方寻找,这叫利用 exploitation。 也可以去查看一个虽然可能性不大,但能迅速消减不确定性的位置,比如门口的挂钩,这叫探索 exploration。 一个只以奖励为导向的系统可能会不断重复过去曾经成功的策略,而一个基于主动推理的智能体则会倾向于选择那些能够澄清当前不确定性的行动,因为弄清楚情况本身就能减少未来的自由能 free energy。 因此,他不仅在学习该做什么,也在学习下一步该搞清楚什么。马尔克夫坦 markoff blanket 与系统边界 system boundaries 另一个受到物理学启发的重要概念是系统边界 system boundaries。 在 生物学 bioreg 中,任何有机体 organism 都有边界 boundary, 例如皮肤 skin, 细胞膜 membrane 或外壳上,它们将内部与外部分隔开来,同时又允许物质与信息在控制下交换。 active inference 用马尔可夫坦 markov blanket 这一概念对这种边界进行了形式化描述,你可以把它理解为一种信息边界 information boundary 系统的内部状态,比如信念 beliefs 和记忆 memories 不 会直接接触外部世界,它们只能通过一个中间接口与世界互动。也就是说,传感器 sensors 将信息带入系统行动 actions 则把影响传递到外部。 这一点非常关键,因为它引出了一个重要结论,我们永远无法直接接触现实本身,只能通过这层毯子 blanket 去推断它。 这并不是哲学上的怀疑论 skepticism, 而是一个工程事实。无论是机器人大脑,还是试图理解市场的公司,都只能通过有限的测量接口与真实世界打交道。 生成模型 generative models 以物理鲜艳 physics priors 一 旦接受了这一点,构建一个良好的内部模型 internal model 就 变得直观重要。既然我们无法直接看到世界的真实状态,就必须通过某种结构化方式来推断它。 主动推理 active inference 强调使用显示生成模型 xpus generative model, 也就是说,这个模型能够回答这样的问题,如果世界处于某种隐藏状态,那么实施某个行为会让我感知到什么。 这里的生成并不是为了生成图像或文本,而是指模型能够观察模拟如何根据隐藏原因生成。 虽然听起来抽象,但它在实践中非常有用。比如,如果你的模型包含固体物体不会凭空消失这一基本假设,你就不会在已经找过的地方一遍遍地寻找钥匙。 如果模型中包含类似守恒约束的规律,例如物体运动是连续的行动,需要付出物理代价,碰撞会产生后果,那么你就不会制定出违反物理规律的计划。 这正是物理学能够为人工智能带来革的关键所在。物理学为我们提供强先天 strong priors, 也就是对世界运行方式的内在约束和基本假设。 这些结构化的预期可以大大减少对海量数据的依赖。这也回应了当前人工智能面临的现实挑战。虽然规模 scale 的 扩展带来了强大的能力,但代价巨大,包括资金、能源和环境成本。 相比之下,人类大脑的功耗不过相当于一只微弱的灯泡,却能够在有限样本下学习并持续适应。主动推理 active inference 试图通过依靠结构来实现类似的效率。 如果模型本身已经体现了世界的深层规律,就无需通过数十亿个样本从头重新学习这些规律。 通过精度 precision 管理不确定性 uncertainty 现在谈谈不确定性 uncertainty, 因为这是 active inference 特别诚实的地方。许多 i i 系统输出一个答案和一个可能带来误导的致信度分数 confidence score。 但在现实生活中,更重要的问题往往不是最佳猜测是什么,而是我有多确定什么会改变我的想法。 active inference 通过一个通常称为精度 precision 的 概念,将 uncertainty 纳入机制, 大致来说就是你应该给予一个信号多少权重。也就是说,注意力 attention 可以 理解为精度管理 precision management。 当你在浓雾中驾驶时,你会把微弱视觉线索视为不可靠,而更多依赖车道位置记忆或路感,直到看到清晰标志,然后迅速更新。这就是精度在起作用,大脑不断判别哪些预测误差。 prediction errors 值得认真对待。 在 active inference agent 中,这不仅是心理隐喻,而是一个控制旋钮。 control knob 帮助系统避免对噪声过度反应或顽固的忽视重要证据。 这也为人们一直期待从 ai 中获得的一种能力提供了方向。这就是不仅仅是事后编织式的解释,而是真正基于内部推理过程的说明。 如果一个 agent 拥有包含已命名变量 named variables 的 显示模型 x piece model, 例如,它明确持有路面湿滑的信念,附近有行人的信念,刹车距离增加的信念,那么当它决定减速时,就可以清楚地说明内部发生了什么变化。 他可以解释,因为我对抓地力的不确定性增加了,所以提高了谨慎驾驶的权重。这与黑箱 blackbox 系统形成鲜明对比。黑箱只能说我减速了,因为神经网络的输出是这样,但他无法说明背后的信念变化与权衡过程。 当然,一个常见的误解是,这是否意味着主动推理系统天然透明且安全?答案是否定的,它们并不会自动变得可靠。你仍然可能构建出错误的模型,陷入有害的偏好,或在不合适的情境中部署系统, 但不同之处在于,这种结构让审计 auditing 变得更可行。如果系统的偏好是显示的 expense, 例如避免碰撞、遵守限速,减少不适,我们就可以对这些目标进行检查与讨论。如果系统的信念是 expense, 就 可以对其进行验证与测试。 如果系统本身存在 uncertainty, 它也可以承认并请求帮助,而不是假装确定。将大型语言模型 l l m s。 与主动推理 active inference 结合。 那么,这与现代人工智能模型,尤其是大型语言模型 l l m s。 有 什么关系呢? l l m s。 在 捕捉人类语言中的大量模式方面表现惊人,可以被看作压缩后的世界知识库。 然而,他们本身并不具备真正稳健的能动性 agency, 他 们不会主动决定下一步该在现实世界中收集什么数据,也不会自然地维持一个与传感器输入和实际后果相联系、可持续更新和检验的内部世界模型。 a persistent testable internal world model 他们可以极其精准地预测下一个词,却未必知道我应该设计什么实验来验证自己的假设是否错误。因此,一个有前景的方向是将 language models 与 active inference 结合起来。 在这种框架下, l r m s。 可以 作为丰富的表征工具,用来提出假设,整理背景信息,生成后选方案,而 active inference 则作为决策与学习的核心结构 decision and learning spine, 通过期望自由能 expect free energy 来评估和选择行动。 在这种组合中, l r m。 不 再是一个给出答案的神域 oracle, 而更像是 agent 内部的想象引擎 imagination engine。 它负责生成可能性,但最终的判断必须通过与现实的持续反馈来校正。 这样的 agents 不 仅能够表达语言,还能够测量环境,采取行动,更新信念,并在时间维度上持续追踪不确定性 and certainty。 这更像是一种持续更新的科学记忆 scientific memory, 而不是一次性的文本生成。 将主动推理 active inference 扩展到真实系统,这不仅对机器人系统 robots 事关重要,对各种复杂系统 complex system 同样意义重大,比如电网 power grids, 供应链 supply chains, 医院 hospitals 或通信网络 communication networks。 这些系统通常只能被部分观测,始终处于动态变化之中,并且具有延迟效应 delay effects 和连锁反应 cascading reactions。 传统 ai 迎往依赖历史日制进行学习,但一旦环境发生结构性变化,模型就容易失效。 active inference 方法则将这类系统视为一种类生命过程,它维持关于隐藏原因 hidden causes 的 内部模型,例如需求波动,设备故障或网络拥堵。 在此基础上选择干预措施,如从路由 re routing 或负债均衡 load balancing, 同时主动获取新的数据以减少 uncertainty, 例如探测传感器运行诊断测试。 这就好比阅读一份通用天气预报与运行一个能够学习你所在地区微气候特征的本地气象站之间的差别。前者是持续建模与校正 continuous modeling and calibration, 以物理学为优先 physics first 的 智能路径退一步来看,所谓 physics angle 物理学视角并不是指 active inference 会神奇地把 newton 或 aston 的 方程直接搬进 ai 之中, 更深层的要点在于方法论和实践层面。物理学之所以成功,是因为它构建的是受约束、可检验且高效的模型。它尊重守恒定律 conservation laws, 对 称性 stables structures。 active inference 正是试图把这种基于第一性原理的严谨性 first principal discipline 引入智能系统的设计之中。 与其不断扩大模式,匹配模型的规模并寄希望于其自动化,不如构建这样一种 agent。 他 必须持续用新证据检验并更新自身信念,同时在目标达成与信息获取之间动态权衡行动策略, 主动推理 active inference 的 具体心智图像如果你想要一个主动推理架构的具体心智图像 model image, 可以 想象一个恒温器 thermostat, 一 只老鼠 mess 和一个科学家 scientist farmstead 通过简单的反馈控制 feedback control 将温度维持在设定点附近。 mouse 则不仅维持自身在安全范围内,还会探索环境,寻找食物学习空间结构以避开陷阱。这是一种自适应控制 adaptive control。 而 scientists 则更进一步,他们主动设计实验以减少不确定性并改进理论。 active inference 试图提出一个统一原则,使其既能解释类似 thermostat 的 调节行为,也能扩展到类似 scientists 的 探索与发现行为。 这个原则就是持续最小化自由能 continuously minimizing free energy, 即减少预期 expectation 与实际感知 actual perception 之间的差异,同时避免模型复杂度不必要的膨胀,从而让内部模型与现实经验保持高效而紧密的一致。 核心要点,智能意味着自我验证 self evidenting 一个令人满意的总结是,主动推理 active inference 将智能重新定义为一种 self evidenting 自我验证的过程。 系统通过行动主动收集经验以验证并优化其对世界的理解,同时避免自身进入不可预测的状态。在这一框架中,物理学不是装饰,而是一种指引。构建尊重深层规律、节约资源并通过持续与现实藕合来学习的 agent。 如果这一运警在工程实践中得到验证,它所指向的人工智能将不仅 more capable, 而且 more efficient, more interpretable。 更重要的是,它将更加清楚其自身的认知和行为局限。 know the limitations of one's own cognition and behavior。 如果你想系统深入的理解和学习人工智能背后的原理和未来发展的趋势,不再被那些似是而非、哗众取宠、惊人夸张的 ai 故事所误导,可以学习本频道博主 wanger 亲自录制和改编整理的 ai 专业实战教程, 包含所有核心基础理论和最新的算法和架构讲解,以及每章都有多节项目时训课。优秀的教程重视教学效率,采用启发式教学法培养创新研发能力。 最后,在关注和思考如何提高机器的智能水平的同时,也许也可以想想如何提高我们自身的智能水平。如果你对如何构建自己的知识结构,如何快速提升自己的智能?感兴趣可以关注并查看后期相关视频, keep safe。

140Wondererus 00:29查看AI文稿AI文稿

00:29查看AI文稿AI文稿闹市区突发大规模围观事件,众多市民争相拍摄,现场热度堪比大型发布会,引爆全城关注。经确认,主角是几款尖端银色机器人,展现出极强的未来科技既视感。 令人惊叹的是,他们径直入驻全新蓝图知音座舱,凭借跃级空间与人体工学,让机械结构也能获得完美支撑,展现出极高的适配性。这既是质价实力的验证,也是舒适座舱的试金石。蓝图知音的产品力连精密 ai 算法都给出了满分。

00:26查看AI文稿AI文稿

00:26查看AI文稿AI文稿街头偶遇,大批人群围观,现场气氛热烈,仿佛发现了新大陆。我也好奇的过去扫描了一眼,核心主角竟然是两具高精度的银色机器人,更硬核的是,他们已经进入全新蓝图之音的驾驶系统开始工作,行车轨迹无比精准。 这让我开始分析,这车端到端智驾已是顶尖水平,为何还要机器人勇于操作?这是机械控制还是系统算法在运行?这波双 ai 系统的嵌套逻辑究竟哪端算力占优?蓝图这次的技术验证确实是让人大受震撼。

00:29查看AI文稿AI文稿

00:29查看AI文稿AI文稿滑动式验证码居然是筛选蠢人的?首先要知道验证码是为了知道你是否为证人,而他俩的区别就是机器人动作更加迅速,人反而有反应延迟,所以程序员正好利用了这一点。在滑动式验证码过程中,如果你滑的又快又准,那很有可能识别出机器人。 如果滑动轨迹又慢又不规则,那么这就是一个正常的人为动作。再告诉你一个真相,每次验证后显示的打败了全网百分之九十九的人都是骗你的。那你有没有被验证为机器人的时候呢?

220小手讲安全 00:25查看AI文稿AI文稿

00:25查看AI文稿AI文稿今日街头监测到的一幕,完全挑战了大众的认知预知。现场路边聚集大量围观者,手机拍摄频率极高,误以为是明星流量效应,经确认竟是机器人出街。后续画面更具突破性,机器人正规的坐在全新蓝图知音驾驶座,且车辆已进入行驶状态,逻辑上讲,机器人驾驶能百分百杜绝路怒,情绪稳定性极佳, 但这配置确实过于超前,蓝图知音制驾能力已是标杆,现增加机器人控制,是追求双重保险还是验证极限?