opus哪个版本接openclaw

粉丝120获赞484

相关视频

02:53查看AI文稿AI文稿

02:53查看AI文稿AI文稿昨晚,智普突然扔了个大招,距离 glm 负五发布才一个多月, glm 负五点一直接杀到编码能力暴涨百分之三十,得分从三十五点四直接跳到四十五点三。 cloud op 四四点六,才四十七点九,差距已经肉眼可见地在缩小。六个月前,这个差距还是十几分,现在只差二点六分,达到 cloud op 四四点六的百分之九十四点六。在实际编码场景中,这个差距几乎可以忽略, 有人甚至说应该直接叫 g l m 负五点五。还有用户测试发现, g p t 负五点三都没搞定的问题, g l m 负五点一直接解决了。看数据, s 大 愈减, bench verified 得分七十七点八,开元模型最高 turmnobench 二点零,得分五十六点二,超过詹姆奈三点零。 pro 擅长复杂系统工程和长城 agent 任务使用体感逼境 cloud opus 四点五,这是目前国产编程模型的天花板。说价格, cloud opus 按量计费每百万 token 大 概十五到七十五美元。 g l m 负五点一,通过 coding plan 使用 light 套餐,三美元起步,按量计费每百万 token 只要一元, 用 cloud 十分之一的价格,获得百分之九十四点六的体验。使用方式超级简单。如果你已经在用 g l m coding plan, 只需要找到配置文件,比如 cloud code 的 sighting store js, 把模型名改成 g l m 负五点一就行了。 一行配置无缝切换,支持 cloud code、 cursor、 open cloud 等主流。 coding agent 质朴也很坦诚,说了两个现实问题,第一,高峰期可能限流, 每天下午两点到六点,系统负债最高,编程任务会被优先保障,非编程场景可能会排队第二。高峰期消耗三倍额度,非高峰期只按一倍抵扣,建议错峰使用,体验会好很多。重点来了,现在到四月底, g l m 负五点一 在非高峰期只按一倍抵扣,这个福利期间用起来超级划算。三美元的 lite 套餐,日常开发完全够用。 pro 和 max 套餐适合重度用户,发布几小时内已经大量用户上手体验, x 上好评不断。 有人说稳定性比 g r m 负五好很多。有人说长链路 a 阵这任务终于不崩了,从三十五点四到四十五点三的百分之三十暴涨,不是吹的,是实打实的工程能力提升。如果你是国内开发者,不想翻墙用 cloud, 又想要接近 opus 的 编码能力, g l m 负五点一目前是最佳选择,尤其适合复杂工程任务和长城 a 阵开发。 g l m 负五点一国产编程模型的天花板编码能力直逼 cloud, opus 价格只要十分之一。邀请码在评论区点赞加关注,赛博杨千焕明天见!

00:38查看AI文稿AI文稿

00:38查看AI文稿AI文稿到这周有一个模型是在通一千问三点五基础上,他们蒸馏了那个 cloud 四点六 os 的 那个模型,告诉他怎么推理。这个模型很火,目前在哈根菲斯上非常火的, 它是冲,它是通一千问三点五二十七币的一个模型,但是它蒸馏了这 cloud 四点六 os 的 推理的能力, 所以我看国外这个模型很火,当然他会把他视觉能力就关掉了,但是他写代码跑小龙虾,他这个能力就很强。有有兴趣可以到哈根菲斯上去看一下,这个不需要太大的模型,用一个小模型你也可以跑小龙虾,也可以跑的很好,他属于这种。

381小工蚁 00:49查看AI文稿AI文稿

00:49查看AI文稿AI文稿大家好呀,今天是我重启人生第十六天,我今天已经完全实现了小红书的自动化运营,通过欧通套调用 mcp 去实现。前面用国产的模型处理了很久都没解决问题,但是 今天的话突然切换到可拉的 oppo, 四四点六一下就给我解决了,这模型是真强,你给他一个需求,他客户就是干。下面来演示一下我们小时候的这个意义, 大家如果有类似需求的话,可以后台私信我一下,那么今天我们就到这,明天见。

00:43查看AI文稿AI文稿

00:43查看AI文稿AI文稿gpt 五点四上周发布了官方说 token 效率提升百分之四十七。我用 openclaw 做了硬核测试,和 cloud opus 正面 pk 代码深层测试 gpt 五点四,快百分之二十,但 opus 代码质量更高。工具调用测试两家打平都能正确完成业务推理测试 opus 略胜, 输出结构更清晰。 computer use 测试 gpt 五点四只用二十四秒, opus 要五十四秒,但 opus 上下文只有 gpt 的 百分之四十,更省 token。 所以结论是什么?编码任务走 gpt 五点四审前分析任务走 opus 保质量。没有一个模型能打全场,组合起来才是无敌的。用 openclaw 可以 按任务类型自动路由到不同模型。关注大卫 ai 实验室,每天一分钟看懂 ai。

03:08查看AI文稿AI文稿

03:08查看AI文稿AI文稿cloud bot 究极进化, open cloud。 听说你把 cloud bot 装在了 mac 上,平时就专门买了个 mac mini。 这样的好处是啊,极致省电,自带 skills, 直接用。缺点就是苹果的设备太贵了,最新的丐版也要快四千,这价格都能直接买个新手机了。没必要。你要是实在心痒要忍不住。记住要买最新的 m 四 芯片,别买英特尔。听我这么一劝,你可能就把谷歌当成了 a p p, 开箱即用,而且还有傻瓜式文档,并支持各大主流聊天软件。但这里有个硬伤,云厂商默认提供的都是自家的模型, 你想切模型?不好意思, model set a field。 不 过别担心,我后面会提供解决方案。云服务器不是白给的,你要为存储为流量掏钱,而且数据都在云端,全靠文件,还要受限于服务器的公网贷宽。我强烈推荐的方式是用虚机或者吃灰的旧电脑 操作系统选误班图,好处是充分利旧,不用为设备额外花钱。除了应用模型啊,数据都在本地,本地配置和云端配置是通吃的。哪怕你买了云服务器,我也可以教你任意切 款模型安装过程就不用我教了吧,一句客命令,三分钟完事,重点是选哪个 provider。 阿图强烈推荐 openroot 最省心省力,不用瞎折腾。没有 openroot 的, 直接去注册个账户,再充个五到二,支持国内的支付工具。模型的话首推 mini max 二点一国产模型速度快,比 sunet 四点五便宜十倍,效果还不错, 重度氪金玩家请勿呢。选择地表最强 offs, 四点五聊天的话没必要开浏览器哈,无论你装的系统有没有桌面,你就 call the bot t u i m 的 就可以直接开聊。你说廉价模型玩腻了,想切个 offs 四点五奢侈一下,可 model 就是 切不动。恭喜你,踩到了他的大坑,我来把你拽出来。想自由切模型,得盯住 call the bot 点 jason 这个 文件,只需要关注一个配置,像 agent 点 models, 这是个白名单,只要你切的模型不在这里面,就会报错。解决方案很简单,要么把 agent 点 models 直 删除,要么把你的目标模型加到这个白名单里就好了。以 kimi 刚发布的 k 二点五为例,前几天 cloud bot 还没更新,但我已经通过添加自定义模型的方式提现,在 cloud bot 里用上了有可能的配置,在下方记得截图,按照我的格式配就行了。 添加完毕后,不需要重启 get 位服务,只需要在对话框中先创建新对话,再选择我们刚配的模型就好了。这里还有一个坑,那就是 cloud bot 中模型的命名,它用的是 provider 正斜杠 model id 这样的方式。前面我选的 provider 是 open loder, 那 么在选模型的时候就要以 open loder 开头,比如你要切到 open 四点五,就要用 open loder astropic cloud ops 点五。我刚才配 k 二点五的时候, proverb 写的是 custom, 就 要用 custom motion ai k me k 二点五搞完模型啊,配聊天软件是最简单的,直接让 clubbot 帮你就行了。最后来看见 clubbot 的 star 数已经从周一的二十 k 涨到了现在的一百二十 k, 这应该是打破多个记录了。项目的创始人 ps 也是个传奇,他早年写了个 ps pdf 软件,然后直接爆火了,你说这是偶然运气?可在 clubbot 之前,他已经写过 n 多个软件了。那句话叫啥嘞? 发起对生命的撞击,你得多撞击一下才能撞出来东西。很多人说这是一场 hype, 是 营销炒作,但各个大厂的收入是实打实的,为何 mini 的 销量再创新高?各大云厂商的 koop 专用服务器光速上线,各家模型的 koop 消耗量必将迎来一波上涨。巨神智能还未到来,但我们首先通过 koop 看到了 agent 操作电脑的另一种可能,后续肯定会有更好玩的东西出来,我们拭目以待。关注我,下期讲解二月六日,人类重返月球,一个星际文明五十四年的等待。

15阿图同学 10:29查看AI文稿AI文稿

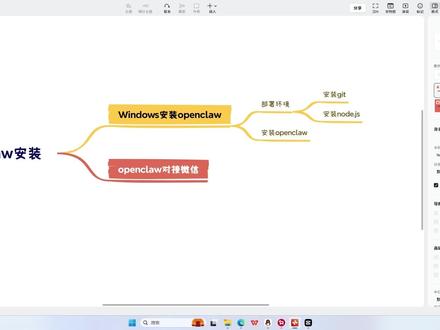

10:29查看AI文稿AI文稿哎,大家好,昨天的时候 open core 发布了三点二四版本,也就是在三月二十六号发布了三点二四版本,三点二四版本呢,又支持了微信的接入,那么今天我将带领大家在 windows 安装 open core 并接入到微信里面去。 这里我是在我局域网电脑上进行安装的,我直接远程到我局域网电脑, 我们打开浏览器,先安装两个,先部署 windows 需要的环境,一个是安装 get, 另外是安装 l d g s。 我 们先进入 get 的 官网下载 get, 点这个地方,点这个地方 install windows, set up 这个安装包, 这边就可以开始下载了。我这边就不下载了,因为我已经安装好了哦,我已经下载好了这个地。还有一个就下载 l d 点 g s 百度搜索 l d, 点 g s, 然后进入它的官网第一个 l d e g s 官网,然后点这个 get l d e g s 然后选择 windows 安装包,点击就可以下载。这边我也已经下载好了, 需要说明的一下就是如果大家在安装 get 的 时候,这个位置 get 的 安装会呃, get 的 下载会很慢,如果遇到很慢的情况下,大家可以把它安装地址复制到迅雷里面去。下载好,这里我已经下载好了,我就不再下载了。 我们这里先安装一定要有个先后顺序,先安装 get, 再去安装先先安装 get, 再去安装 l d e g s 这里我们选择是 直接也保持默认下一步就可以了, 这个地方不用展示,我再安装 l d g s 样的,我这边选择同意全部默认选择下一步就可以选择是 完成,我来确认一下,输入 c m d 这地方我选择右键以管理员身份运行,还是一样的选择。是 来确认一下我们安装好没有,先是 get get 杠 v 问题,然后选择 n p m 杠 v 啊,这样的环境就配置好了。下一步我们直接用 npm 直接安装 cloud, 直接输入命令好,这里我们就直接输入 npm i 杠 g opencloud 要直接回车。这里说明一下,必须要用管理员的身份来运行这个 cmd 的 窗口的原因就是 在 an open color 安装过程中,它会涉及到一些权限问题,如果这个窗口不是以管理员身份运行的话,那么这个权限问题将导致有些插件会安装失败的。好了,我们就等它安装结束。稍等一下 好了,这里 open color 已经安装结束。下面就我们就要运行运行配置了。在配置之前呢,我们先 我先进入 minimax 的 网站,在网站上登录好。 minimax 我 们登录好,因为等一下我们要进行连接的,需要这个外部进行认证, 用这条 mini。 这样子我们就开始配置 open call 了。这里地方选择 yes, 这里选择快速开始, 然后这个位置模型配置,我们选择 mini max。 这个地方我们选择第三个 mini max 页面认证的功能,使用浏览器好,它会自动打开这个网页,我们点击授权 好,授权结束,回到这个地方来选择默认设位置就可以了。第一个选项, 这地方是配置聊天工具,我选择跳过,等会儿我们会安装微信,这里一样的选择,通过选择跳过, 我们是否配置 skills, 选择 no, 这地方也选择跳过, 是 git 位。已经安装结束,稍等一下,这个地方对话窗口,我们选择 web ui 好 了,这就配置好了,我们给他一个对话,看一下是否配置成功,发送一个消息,你是谁 啊?看到了,他给我们回了消息, open color 就 配置好了。配置好过后,我们下一步在手机进行操作,这个地方我把我将手机投屏上来, 这是我的手机投屏,我这地方选择,我设置,选择插件, 选择详情,将这条命令复制发送到我们电脑端去, 发给了我这条微信,发给了我这个微信,这个微信在电脑登录了的, 将这条 mini 复制下来,复制下来过后,这个位置粘贴,直接回车 这里等一下,等它安装结束, 这里已经安装好,我们到微信里面去进行扫码,微信还是选择我的设置,然后插件里面去详情,点击开始扫一扫, 再看这个地方扫码会经常扫不上,扫不上的时候呢?没关系,我们就手机退出去,退出去过后退到这个界面呢,我们将这个链接复制一下, 这个链接在浏览器打开, 然后我们使用微信扫一扫, 点击这个继续连接 好了,这里就连接成功了,我可以给他发条消息,试一下 你是谁? 发送,我看一下是哪里有问题, 我们直接重启一下网关,它提示我们也要重启网关。重启一下,试一下。 好了,我们再发条信息试一下你是谁。 好了,可以了,那么这里也就说明了,我们在微信连接上过后,我们需要重启一下网关,网关重启好了过后就可以了。好了,这样子我们的 open color 和微信就连接起来了, 看,这是他给我回复的消息。 好了,今天的内容就这么多。嗯,如果大家在安装途中遇到什么问题的话,可以关注,然后私信我。

39何止于静 01:52查看AI文稿AI文稿

01:52查看AI文稿AI文稿装了 openclaw, 但发现它什么也干不了,甚至有点蠢。除了需要配置各种插件和 skill 之外,它最需要的是一颗足够聪明的大脑。今天来分享我的配置方案,用 mini max m 二点五驱动 openclaw, 性能逼近 cloud 的 up 四点六,但成本只有它的十分之一。走订阅制,每个月一杯奶茶钱,非常适合在 openclaw 中使用。 接下来给大家展示我是如何用 opencll 来提升我的工作效率的。第一个,接入飞书,通过手机帮我剪辑口播视频,现在我直接在手机上发给 opencll, 一 句话就搞定了。帮我剪掉所有停顿重复的地方,然后导出发给我。它会自动调用语音识别,定位无效片段精准剪切。 以前剪一条口播至少要两个小时,现在三分钟出片。装了 opencll, 但发现它什么也干不了,甚至有点蠢。 除了需要配置各种插件和 skill 之外,它最需要的是一颗足够聪明的大脑。第二个,帮我整理文档,自动上传到飞书知识库 ai 时代,每个人都应该建立一套属于自己的知识库,有了 openclaw, 就 可以实现知识文档自动分类,自动入库。 我设定了一个定时任务,每天生成的文档自动识别内容,并根据分类上传到对应的知识库中。比如我今天写了一篇关于 openclaw 闭装 skill 的 笔记,它会自动识别内容,归档到 ai 开发知识库的 openclaw 分 类一下。第三个,帮我打开浏览器,注册各种账号,获取 api k。 当时我需要一个文本转语音的 api k, 正常流程是我自己打开浏览器注册登录,找到 k 页面,然后复制,但我就跟他说了一句,帮我注册 eleven lives, 拿个 api k, 他 就真的自己打开浏览器填表注册成功拿到了 k。 那一刻我是真的被他的执行力震惊到了,为什么每个都能这么顺?两个原因,一, mini max 二点五,自带的任务拆解和工具调用能力,他能真正理解你的意图,拆解有逐步执行。二,题词给的足够清晰,你不需要会写代码,但你需要学会把需求说明白。

4061LIGHT 01:22查看AI文稿AI文稿

01:22查看AI文稿AI文稿三月二十七日晚上,智普突然甩出大招,发布了 g l m 五点一。距离上个版本 g l m 五点零才过去一个多月, 这个模型强到什么程度?官方评测从三十五点四分飙升到四十五点三分,暴涨超过百分之三十。 对比一下,当前全球最强编程模型 clopus 四点六,得分四十七点九, g l m 五点一之差两点六分。 在编程能力上,国产大模型已经占上了世界第一梯队。更关键的是价格, opus 四点六是最强也是最贵的,很多程序员用不起 g l m, 只要它的零头便宜好几倍。 当然,跑分好看不代表一切,还得看实际开发体验。国产模型在工程实践上还有进步空间, 不过一个多月提升百分之三十,这个速度确实恐怖。开源之后会怎样,值得期待。

13七七超爱玩 01:50查看AI文稿AI文稿

01:50查看AI文稿AI文稿有人用 open klo 跟他聊了二十多次,收到账单两百块没了啊,换了个强一点的模型,一天六百块,还没干什么正经事,你要正经的用欧帕斯四点六五分钟烧掉你二十美金不是梦啊,这是真实发生的踩坑, 今天把原因说清楚。 open klo 呢,本身是免费的开源,不收钱,但他干活需要调动 ai 模型,你调用一次 就在消耗, talk 就是 计费单位,坑就在这里。第一点呢,就是大家会默认接最贵最好的模型,或者是相对好的模型。当 openclot 装好后,国人就直接装 clot, 也不改配置就开始使用 啊,这是最强的模型啊,也是最贵的。哪怕你只是让他帮你把文件改个名字,他也在调用顶配的算力,就像你买了辆跑车,每天只用来买菜,明白吗?第二点呢,就是他做一件事情,背后调用了很多次。很多人以为发一条消息等于调用一次。不是的, open 可乐接了一个任务,会自己拆解步骤,每个步骤都单独的调用模型,帮你整理十封邮件,背后可能调用了三十次,每一次都在计费,而且没有设置上线的时候,这就是无底洞。第三个呢,就是解决方案,其实不是很复杂,核心思路就是一个让贵的模型只做贵的事情, 简单重复的任务,读文件格式,转换,整理列表,换到便宜的小模型来做,成本能节省百分之九十以上。 复杂的判断,写方案,做分析,再交给强模型人做了一套路由配置之后,原来一个月的九十美金的账单,现在压到了八美金,同样的事情,同样的量,节省了百分之九十一。 oppo pro 烧钱不是工具的问题,是配置的问题, 工具本身逻辑是对的。坑在于说没有人告诉你怎么配,你用过吗?踩过这个坑吗?评论区聊一聊大家都卡在哪一步。

43数字爱神 01:15查看AI文稿AI文稿

01:15查看AI文稿AI文稿再看一下我最新尝鲜的这个 g p d 四五点四的这个版本,大家都网传说它可以直接去操控网网页什么的,实际上是不可以的 啊,它需要有两个前提,一个前提是你要去是美区,然后去下载一个叫 check gbd windows a a p p 的 一个功能,它这个东西它只通过微软商店分发,而且大陆这边目前是无法下载的,包括你用题什么的。 其次啊,这个是它的回答啊 啊,他推荐说,实际上如果你真的要使用 它进行一些电脑网页的操作的话,还是用 oppo core, 至少到目前为止,虽然 oppo core 的 老大加入了 oppo ai, 但是 目前还是 oppo oppo core 的 整个啊操作电脑端的这种能力会远远远远领先。

13依凡 06:40查看AI文稿AI文稿

06:40查看AI文稿AI文稿大家好,今天我们来聊一下最近社区讨论非常多的话题, oppo 为什么变笨了?我们会从 iphone 和带门两个层面深度分析二零二六点三点二到二零二六点三点一三这几个版本到底发生了什么? 这里要特别感谢一下小克同学,凭借他尊贵的 max 版本订阅以及欧帕斯四点六模型强大的推理能力和 one mini 的 升降弯长度,让我能够在短时间内顺利完成这次深度分析。 今天内容分为五个部分,先看看社区在说什么,然后了解背后的安全危机。接着从代码层面分析变笨的真正原因,再看看这几个版本新增的哪些能力,最后给出修复方案。整个分析涉及两千三百三十三个 chemist, 三十多个安全漏洞修复,以及三十一万行新增代码。 首先来看一下发生了什么,升级到三点以后,社区炸锅了。 x 上有人说最新版本的 omcoro 变笨了,知乎上有人发帖说小龙虾变傻了,光聊天不干活怎么救? github 上也有 discussion, 标题直接就是 omcoro useless now update, 核心现象就是 agent 不 再执行命令,不读文件,不写代码,只会纯的文本聊天。而这背后是一组触目惊心的数字,百分之九十三点四的暴露实力存在认证,绕过四万多个实力暴露,在公网可乐 have 上发现了八百二十四个恶意 skills。 为什么会这样?我们来看一下安全危机的背景。二零二六年一月,欧盟克隆爆发式增长,公开实力从一千个飙升到了两万一千多个。 二月,安全研究员发现四万两千六百六十五个暴露失利,其中五千一百九十四个可以被直接攻击。 同月, kolhup 金融市场被审计出有八百二十四个恶意 sukus, 全部来自一个叫做 kolhork 的 攻击组织。更严重的是,欧盟官方机器人的 api k 都被泄露了。 csi 点 run 的 远程代码执行漏洞被实际利用, 于是三月二号二零二六点三点二版本紧急发布,大幅收紧了默认权限。三点一重建了执行审批框架。四点一二达到安全加固高峰。单个版本修复了十七个安全漏洞。来看看被利用的关键漏洞, 最严重的是 ctrl u i 的 k to v u l 参数输入 c v s s 评分。八点八可以直接窃取用户的认证 token。 还有 six 点 run 的 环境变量注入工具者通过注入 shell ops 和 ps 四就容易实现远程代码执行。工作区插件可以通过克隆一个仓库自动加载恶意代码。脚 本运行器可以绕过审批 shell, 续航符可以绕过允许列表设备, token 可以 被提全。每一个漏洞都是真实被利用过的。了解了背景,现在来看看变笨的真正原因。最大的原因非常简单, to store profile 的 默认值从负改成了 message。 在 message 模式下, agent 不 能执行系统命令,不能读写文件,不能搜索网页,不能生成图片,不能管理记忆,什么都不能做,只能聊天。为什么要这么改?因为百分之九十三点四的暴露实力根本没有认证。如果 agent 默认,就有执行权限,公记者可以直接执行任何命令,读取你的 ssh 密钥窃取凭证 merchanting 即使被入侵了也什么都做不了,这就是最小权限原则。第二个原因是执行审批的 fileclose 的 分支从四个暴增到了三十二个,增长了百分之七百。 审批相关代码从两百五十三行暴涨到了一千零八十七行。每一个新增的 fileclose 分 支都对应一个真实被利用或可被利用的绕过路径。 ruby 的 杠 r 杠 m pearl shell 杠 file p n p m e x e c 解包人为 rapper。 深度限制是要悬浮检测内存替换闪二五六,文件绑定用力扣的凌宽字体 posix 大 小系。 结果就是 a 阵执行时之前能自动通过的操作,现在可能被拒绝,多部任务频繁中断。除了这两个原因,还有几个次要因素, 三点一三版本有一个 breaking change 记忆引导文件只加载了一个,之前大写的 memory, 一 点 m d 和小写的 memory m d 都会注,现在只保留一个,同时维护两个文件的用户直接丢失了一半上下文。 三点七改了压缩域值,配置了 ctrl 四头等的用户会更早触发压缩信息,损失更多。三点一二,禁用了工作却插件自动加载,修改了启动指令措辞,限制了子弹里杀伤权限。三点一三还把奥拉玛的推理内容隐藏了。 本地推理模型的回复看起来更短了。但是 open core 不 只是变安全了,它也变强了。从三点二到三点一三,总共两千三百三十三个 complex, 新增了三十一万行代码儿,删除了八万行,净增了二十三万行。三点二到三点七是一个最大的跳跃。 八百九十三个康密斯建立了安全基础和上下文引擎架构。四点一是一个功能驱动的版本,带来了欧拉玛一等公民支持和 ios 大 更新。四点一二是安全高峰,十七个 g h s a 加上全新的达斯波罗 v 二 agent 的 核心方面,新增了可叉八上门引擎 g p d 五点四和可洛的 fast mode。 三十一耳的协助是轮次结束压缩,摘了语言和人设保持,还有多模态记忆锁影模型。生态方面,欧拉玛成为了一等公民。 欧拉玛 v i m s g line 全部插件化,新增了 open code 构提供商和 jimmy。 一 百零二, preview 平台方面大势爆了。 v 二,全新重构 bug 修复数量也很可观,一百九十多个 bug 修复,三十多个安全漏洞修复三十四个新功能,二十多项优化重构修复。最密集的是 a 件的代理核心,有三百八十六个 com miss, 然后就是扩展插件 c r i 命令网关和 discard。 最后也是大家最关心的怎么来修。其实修复非常简单,一分钟就能搞定。第一步,检查当前的配置,运行 omglow config get to store profile, 如果返回的是 message 或者是空,那就是问题所在。 第二步,修改配置文件,在 openclip 点 json 中把 twos 点 profile 设置为 full。 第三部,重启网关。如果你想要更完整的恢复,可以参考这个配置模板,这里你可以攒成视频截图,对照着这个配置模板去修改你的 openclip。 根据你的使用场景,我整理了四个配置方案。方案 a 适合个人开发者, profileful ask on miss, 安全风险低到中 agent 能力是完整的。方案 b, 适合团队环境, profile code ask on miss, 安全风险低。方案 c 适合非数据的无交互通道 profile for ask off, 安全风险中道高,但这些通道没有交互式审批外,不是 off, 会卡住命令。方案 d 是 公开服务最高安全方案, prefer message exe c deny 只能聊天,大多数个人用户选择方案 a 就 够了。最后总结一下,模型没变,是 toaster prefire 默认改为了 message, 背后是四万多个暴露视力,加上八百二十四个恶意 kill 的 安全危机执行审批, fairclose 从四个增长到了三十二个,每一个都对应真实的攻击向量。二零二六,三点一,三比三点二更强,更安全,更稳定, 前提是你知道怎么配置修复方法。 tos profile 是 为负重新往关,一分钟搞定。我们可乐的设计哲学,从默认信任转向到默认限制,变笨是安全的代价,正确做法是理解风险后有意识的放开你需要的权限。这里是荣同学,如果你也喜欢我的视频,记得点赞双击关注,我们下期再见!

81野生刘同学

猜你喜欢

最新视频

- 2171灵鲸科技袁亮