飞牛龙虾模型配置

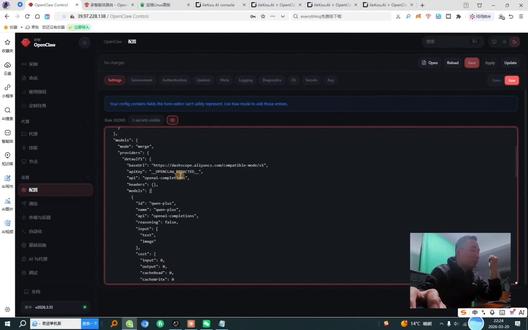

哎,我拿这个给大家简单串一下,你就知道他的大概的逻辑是什么样子了。你看这个,妈豆子,这是最最上面的一层啊,妈豆子下面呢?呃,有一个, 有一个模式啊,这个模式什么样呢?是兼并的模式。就是,呃,我可以融合多个模型,然后在里面去选择啊,这个意思就是兼并啊,然后再往下啊,再往下, 这个是那供应商,哎。 providers, providers 啊,这个在下面,这是一个列表,相当于是第一个供应商,你看后边这个是 one 啊,这个不是 l 啊,这是 one 的 意思就是,嗯, detail one 啊,第一供应商,他指向的链接啊, base url 是 谁呢?是阿里,你看阿里云 特别熟吧,阿里云 cs 点 com, 也是我的第一个供应商,他的链接是这个,然后 api k 是 阿里云的 k, 再往下,这就是模型,你看 id, id 就是 用的什么模型?千万的 plus 啊,名称 plus, 这个是配置方式方案。应该是啊,再往下 input 就是 里边的,呃,可以支持 excel 文本,也可以支持 emoji, 就是 图片。嗯,这个是一个 id, 一个 id 就是 一个模型,也就是在千问这个公司里边,我现在在这个, 在这个代码里边,我提供了第一个模型,是千问的 plus, 那 第二个呢?就是,哎,第二个 id 是 千问 max, 你 看他们两个是一样的,这个格式是一样的,这两段是吧?再往下,哎,又出现了一个,嗯, detail, 然后什么二啊?这个 two 是 吧?这个呢?就跟上边这个是并列的,你看我们可以有第一个阿里云 供应商,也可以有第二个 open ai 供应商,你看这个网址,它就是 open ai 了,那在这个 open ai 用上 open ai 这个供应商的话,我们需要提供 open ai 的 api k 是 吧?哎,再往下我们需要在 id 里边,哎, 咋没了?哎,在这个 id 里面我们需要提供 open ai 的 模型,你看 gpt 四四 o 是 吧?也可以是现在五点四码,哎, 再往下这个都一样,你看 text 一 位指,是吧?都一样,你们有有没有发现规律?这个就是我们可以配置多个供应商里边的多个模型这样的一个结构。 我是就就是让那个 cloud 给我做的一个这样一结构,我们就现在做完之后,我就可以直接把这个代码复制完粘贴到我们呃, cloud 里边了,粘贴进去之后我们再把自己的 k 粘贴进去就可以了。

粉丝237获赞626

相关视频

01:20查看AI文稿AI文稿

01:20查看AI文稿AI文稿来了来了,他来了!想要二十四小时在线的 ai 助手,不用买 mac mini, 旧电脑装个飞牛 s 就 行。 openclaw 原声应用上线,一键安装,新手无压力。想用新的 openclaw, 第一步千万别忘了先进入系统设置,把飞牛 o s 升级到最新的一点二六版本,只有更新了系统,你才能在应用中心看到它。 非牛 openclaw, 赶紧安装它,安装完打开进行配置,然后打开应用中心就可以看到非牛 openclaw, 赶紧安装它,安装完后我们就可以打开它来进行配置了。 接下来配置,大脑进入模型设置,选择 mini max, 填入你的 api key, 内置本地云端模型能力配置很简单,重点来了,对接之前一定要先安装这个插件,不然是没法扫码绑定的。插件装好后 回到 open cloud 添加消息渠道选,这时候二维码就出来了,直接掏出手机扫码绑定,几秒钟搞定, 绑定成功,发个指令试试。注意看,他没有像拆开 p t 那 样一个个字往外蹦,而是卡了一会,直接甩出一大段话,为什么会这样?查了一下, 目前非牛版还是三点一三,而官方最新版已经更新到三点二五了,版本之后导致微信不能流失输出,但这依然是目前性价比最高的方案。关注我,版本更新了第一时间通知大家。当然,如果你想在一个 nars 上养好几个龙虾,那还是用 dawk 步数比较方便,具体请观看我上一集的内容。

45辉歌 07:55查看AI文稿AI文稿

07:55查看AI文稿AI文稿大家好,今天给大家做了一个在飞牛下啊刀口安装部署 oppo klo 的 那个龙虾安装教程。 嗯,准备工作,就三个网站,一个是秀秀开放平台,一个是 oppo klo 的 中文网站,还有汇集流动,就是服务提供商,嗯,这个汇集流动大约提供了两千个免费的图纸的。嗯,大家可以注册领取一下。嗯, 注册后进行实名认证,嗯,嗯,实名认证后会领取一个十六元的代金券,它可以进行一些费用的抵扣。汇集流动的模型广场提供了嗯,很多的那个模型供大家选择, 下面我们来演示一下在非牛下安装嗯,龙虾的过程。首先先在文件管理一下的我的文件中创建一个嗯 dork 的 文件夹,然后在 dork 文件夹下再创建一个 open cologne 的 那个文件夹,用于嗯,存存放那个部署文件。 创建好以后,打开嗯, docker, 然后选择了 composer, 嗯,然后右边的新增项目,这里可以上传 docker 跟 composer 文件,也可以手动。嗯,创建 docker 文件。 下面我们打开荷兰 club 的 中文网站,嗯,里面有一个安装方式,然后 docker 部署。 嗯,这里面这一段的那个,嗯,网址就是下载地址,大家可以通过嗯,迅雷可以下载下来,然后再上传到飞牛中,也可以进行嗯,手手动创建,这里面它有一段那个配置,配置文件, 我呢图省事,还是选择上传文件的那个方式,先输入项目名称和文档路径,选择我们创建的文件夹,然后上传。嗯,我们提前下载好的那个,嗯, dolphin composer 的 文件, 这里需要把这个改成国内的。嗯,下载地址如果不改的话,这个部署时间实在是太长了。嗯,漫长的等待。这个把前面这段去掉就行。 这个后面这个它是个最新版,嗯,它会随着最新版的发布进行更新。咱们可以改成这个稳定版,那就是拉 test, 然后把后面这一块改成拉 test, 后面这块就没什么了。然后把这个创建项目后,嗯,立即启动给勾上,然后点击确认就开始。嗯,构建,后面就需要等待,它构建完成就可以了。 嗯,跳过等待过程,现在就是。嗯,部署构建完成了,下面我们点容器,然后点右边的那个三个点,选择终端,打开终端第一个的 bin bash 的 连接,然后就连接上终端了。 下面我们进行粗实化,然后选择在终端输入 opencloud on board, 杠杠 in stop 杠,呃, d a e m o n 进行粗实化,然后回车,这块就需要等一小会就行。这块等的时间不是特别长, 这里用方向键选 yes, 回车,快速开始回车,这里选重置, 然后再选择仅重置配置,这里是选择那个服务提供商的。嗯,但是这里面没有归机流动。嗯, linux 版本好像是有的,这个 dk 版本里没有,所以咱们选择自定义。嗯,服务商,哦,会撤。 然后这块把这个地址去掉,换成那个轨迹流动的那个地址,然后咱们到笔记中去复制一下,就是这个 a b i s u, r, l 复制,然后过来粘贴, 然后回车。是输入密钥,这个是到轨迹流动中去找 好,打开汇集流动网站左边这个 api 密钥,然后新建密钥。嗯,随便出一个,然后新建就可以了。嗯,我这个已经建好了,我就用这个, 然后过来粘贴,然后再回车,然后这个就选择 open ai 回车,然后这个是选择模型的 id, 也是在汇集流动中去复制一下就行。 好,打开过去流动,然后选择左边的模型广场,然后这里面有很多模型,大家可以选择一下,然后就选择第一个吧, 点那两个方块复制,然后再回来粘贴,再回车,这里需要等一会。嗯, 显示啊 socket board 就 表示成功了,然后再回车一下就行,然后这个再回车默认就可以了。 然后这这个就是选择接入的那个。嗯,方式是飞书啊还是球球啊之类的,我们是要接入球球,所以这里吧就有暂时跳过, 到这就说实话配置完成了。嗯,下面就需要对接一下 qq, 下面就是打开 qq 开放平台,然后手机 qq 扫一下码登录, 登录成功之后,然后创建机器人, 然后下面这块就有一个接入流程,我们只需要一步一步,嗯,复制到那个刀客的那个容器终端去,呃,粘贴运行一下就可以了。 然后复制第一个啊,回来进行连接终端,然后粘贴,然后运行,然后这需要。嗯,等一小会,安装插件需要一个过程, 然后再回来复制。嗯,第二步,然后再回去粘贴回车, 这也需要等一小会,这个时间很很快,但有时候会卡住这一块,但只需要断开一下,然后然后再重新连接,连接中断好, 然后看看这个粘贴没反应就可能是卡住了,然后点那个断开,然后再点连接就可以了,然后再粘贴,然后重启一下服务,这样的话就接入成功了, 到这就不说完了,关掉就可以了。然后再点三个点,打开系统日期、运行日期,然后我们打开机器人助手,机器人然后说,嗯,您好, 看后台设置有反应啊,这块显示个你好,这就说明接入成功了,然后再说你能做什么好?回车 他这个,呃,答复的时间没有那么快,需要等一小会儿。嗯, 用龙虾的话说就是,呃,他需要思考一下,看看这个就是他答复的。好,今天的分享就到这了,大家可以自己部署一下。

269挨踢民工 07:09查看AI文稿AI文稿

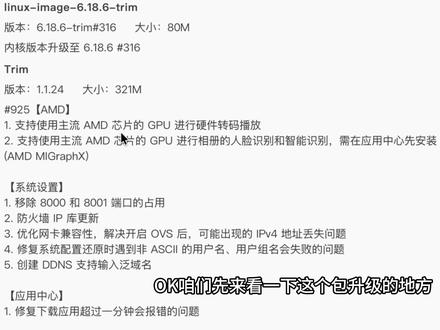

07:09查看AI文稿AI文稿一说到最强核显, amd 粉丝, yes 七八零 m 八九零 m 八零六零 s 都是真能打级别的核显,但是在非牛的玩家里, amd 的 核显硬解一直没有适配。作为非官方非牛代言人提前透露,非牛马上发布 amd gpu 加速的适配,并且会一锅端的推出一键部署。非牛 open club, 咱们今天先来尝尝馅儿,为什么总是你仰仗各位,那不得开香槟庆祝一下吗?然后去薅了一台三九五的机器, 飞牛官方合作伙伴,林克 gtr 九 pro、 amd amx 加三九五插电开机。 咱们先来看一下林克这台 aimax 加三九五的系统信息。 amd ryzen ai max 加三九五内建八零六零 s 的 核显十六核三十二现成。我这台是一百二十八 g 的 统一内存,八千兆赫的频率, gpu 识别正常,双万兆的网卡啊,这都是免驱的啊,直接识别,我现在给它装了一块四 t 的 硬盘。 ok, 咱们先来看一下这个包升级的地方。第一,支持了 amd gpu 的 硬件转码播放视频, 支持了 amd gpu 的 相册人脸识别和智能识别,也就是 ai 相册的全支持,全硬件加速需要安装 amd 的 rocm 七点二驱动和非牛自研的 ai 引擎。安装飞牛 ai 引擎和 amd rocm 七点二驱动, 飞牛影视的设置已经自动打开了 gpu 加速。咱们来播放个视频给大家看,四 k 蓝光史比特 hdr 杜比全景声走起,我们让纳斯端应解启动, gpu 应解成功,咱这三九五你就说是啥解不了吧,随便拖。 接下来咱们来提升一下难度啊,这是杜比世界版本的 hdr 视频,颜色对应,牛,注意看啊,也是服务器端硬解杜比世界四 k 杜比全景声,这就是典型的全杜比,所以即便你的电视或者你的设备不支持杜比世界,他也不会出现色彩映射错误, 惨绿惨绿的。在 ai 相册里面也可以识别出这块和弦, ai 设置里面下面就多出了启动 gpu 计算的按钮,咱们启动 gpu 设置成功,咱们先看机操啊!人脸识别情况走起!一共是五百四十五张,计点计用,然后我们来看资源管理器,但愿让大家还能够看到 gpu 占有率只有轻轻松松的百分之十四, cpu 根本就不带动的啊,所以 gpu 人脸识别, ok, 这负荷有点太轻了是吧?哼,分分钟你看就识别完了,接下来上强度智能识别走起,你看直接就几十几十张的跑, 用 cpu 的 时候大家懂了吧,都是一张好几分钟 gpu 硬解,直接拉满 c p u, 非常轻松。五百张哇,智能识别秒没 amd 玩家,你就说狂喜不狂喜,但这只是基础操作。 amd 粉丝飞牛玩家第二部,欧拉玛 本地大模型,在飞牛 amd 的 平台上部署欧拉玛,我给大家看有多简单,直接输欧拉玛。 最新版本的欧拉玛已经升级为一点一的版本,已经可以直接对接 lcm 的 硬件加速,你只需要安装然后就可以了,一键打开欧拉玛,牛皮,我已经给大家下好了,千问三点五,一百二十二 b q 四量化的模型 gptos 一 百二十 b q 四量化的模型,塞进显存的容量分别是七十六 g 和六十一 g, 哎,正好适合咱 aimex 加三九五,咱们来调戏调戏 ai, ok, 这生成速度还可以哦,大约二十点五六, tokens 每秒 amx 加用户进阶玩法。第三步,一键部署 openclaw, 直接调用欧拉玛的本地 ai 模型。所以你看你家什么机器,二十四小时开机啊, 你的纳斯,你家什么机器算力过剩啊,你的纳斯,我说你要累死纳斯。所以你看你在纳斯上部署 本地大模型,部署 openclaw, 资源的利用最大化。所以之前好多次老张直播的时候都告诉大家,我一直认为 nas 才是 ai 的 最好平台。好,接下来咱们一键部署 openclaw, 这个很快会给大家推送啊,推送之后,你直接在应用中心就可以找到一个叫做非牛 openclaw 的 应用,然后它依赖的应用都会直接部署,所以真的就是一键部署。 yes, 一键启动,我们是本地模型,所以直接选择欧拉玛自动识别本地模型,包括 ip 端口号,一概不需要懂,自动读取出现有的 本地大模型,然后啥也不用管,保存, ok, 恭喜你, openclaw 配置完毕,然后这大家说这怎么用啊?非常简单,你看这打开 openclaw 图形化界面了啊,远程访问网页版就可以和你的 openclaw 互动了,咱们问他,你是什么东西? 恭喜你打开新世界的大门,再也没有 token 焦虑了。 在小龙虾给大家生成的第一个文件屋缝对接飞牛啊,来大家看吧, 很多小伙伴玩小龙虾是希望在即时通讯工具中能够直接对接的飞牛的,这个 open claw 直接内置了飞书的对接, 企业微信和钉钉的对接一键安装。一个意外发现啊,因为是在非牛的应用中心中直接安装了一个非牛的官方应用,所以你根本不需要管什么端口映射、外网穿透这些技术的问题。因为非牛纳斯自带 f n connect, 你 可以随时随地在你的手机 外网访问你布置的 open club, 一 键打开移动端,直接无缝连接之前的对话。所以在飞牛上玩龙虾,事实上,你根本不需要去对接 实时通讯工具,这事变得更简单哦。依然是老规矩,明天中午老张直播间大家准备了很多好东西, ro 明天中午不见不散!

4874老张是大佬 03:15查看AI文稿AI文稿

03:15查看AI文稿AI文稿把五版图部署到飞牛上,首先我们看一下飞牛的配置,我用的是林克和飞牛联名的那个小主机,然后 cpu 是 英特尔的 n 幺五零四核四现成的十二 gb 的 内存。 首先我们来打开虚拟机这个应用,在这里找到那个创建虚拟机的一个接口,我这里面已经部署了一个了,我就只给大家演示一下这个过程。首先是虚拟机的命名,可以随便命名, 我命名为乌班图二零二六, 操作系统选 linux, 选择版本,这里选择自己已经下载好的这个镜像,镜像直接去物版图的官网下载就可以了, 然后这里主板的类型什么的这些都默认。然后 cpu 的 核心的话选两核啊,内存我选的四 g, 大家可以根据自己的需求去选 好了之后直接点下一步,按这里选存储空间,创建自己啊所需要的存储空间, 这里添加网卡,我这里面是一个聚合网口的网卡,这里也可以添加硬件, 因为我已经创建了一个虚拟机了,有可能它的这个核心数啊或者是内存什么都有影响。我们来点编辑看一下我已经创建好虚拟机的这个配置, 内存四 g b, 而直接选择,就刚才演示的那些启动位置,选择默认自动就好了。来我们打开虚拟机, 从这个 vnc 访问的这个接口进到虚拟机的界面, 大家安装物管图这个过程其实跟这个是一样的,点进来只不过是需要选一些配置时区啊,配置呃位置啊什么的这些信息,选完之后它自动就安装完成了, 安装完成之后你需要创建用户用户名和密码,呃,然后进到,进到系统里边的话就是跟我,呃现在这个是一样的,这是进入到系统之后的一个界面, 在下部这里我们也可以找到这个终端,还有一些安装的,呃,安装的软件吧?这跟 windows 的 那个开始界面是一样的, 那我们选择乌斑图是因为它的这个图形化操作界面跟我们 windows 使用习惯比较相似,那到这里乌斑图的安装就结束了。

01:46查看AI文稿AI文稿

01:46查看AI文稿AI文稿大家好,这期在飞牛和绿莲一键安装现在比较火的 open claw, 二六年才火的项目用到的国内的一个汉画项目,有详细的教程,适合小伙伴研究。 我们打开多克 compose 新建项目 名字,随意建个文件夹, 命令在九点九的进阶包, 八十多个应用都写好了。一键安装复制命令, 最下面有这个项目网址,点确定 好一键启动,这个项目不是通过端口来访问的, 文档中心命令速查, 在这点终端复制命令,这样就能启动了。 详细的配置可以根据官网来配置, qq 的 机械人也很好获取,适合爱折腾的小伙伴,注意自己的偷看安全,防止资金流失。感谢大家支持,九点九进阶包,一次付费购买,进群就能持续更新,永久有效使用。

02:56查看AI文稿AI文稿

02:56查看AI文稿AI文稿新手必看龙虾 openclaw 大 模型配置保姆级教程零基础配置 openclaw 手把手教你完成 basel a p i t 与 model 配置。在配置大模型时,你一定会反复遇到三个关键词, basel、 a p i t 和 model。 你可以把调用大模型想象成像。一位博学多才的专家写信请教问题。 bash, 也就是基础地址,是大模型服务商提供的 api 接口地址,各大模型平台都会提供,相当于专家的收件地址,没有这个地址,你的问题就无法送达。 a p i p 也就是密钥, 是服务商分配给你的一串唯一字,服用于验证身份和计费,相当于你的专属通行证。专家凭此确认是你发来的请求, 并从你的账户扣除相应费用。请务必妥善保管,切勿泄露给他人。 model age, 也就是模型名称或 id。 同一家服务商旗下通常提供多个不同版本的大模型,你需要明确指定使用哪一个 个服务商平台的模型,列表中均会详细列出相当于你要请教的具体哪一位专家的名字。上面三个参数不仅支持各大服务商 的配置,以上三个参数支持各大服务商接口 中转。 a p i 级本地部署大模型,你可以根据选择的模型平台在对应控制台中获取 a p i t。 同时平台会提供固定的 base or 可选的 model。 opencloud 的 核心设置保存在本地的 excel 文件中,根据你的系统环境,它通常位于用户目录下的隐藏文件夹内。 windows 系统配置文件路径 通常为以上。内容处系统配置文件路径通常为以上。找到该文件后,用记事本 d s q 等文本编辑器打开即可编辑。如果目录下不存在 open call, 可在命令窗口输入 open call setup 进行初步化。在修改任何配置文件之前,请先将原来的 open call 设置一份作为备份, 以便改错后随时恢复。这是一个良好的操作习惯,可以有效避免因误操作导致配置损坏而无法恢复。打开配置文件,将其内容完全替换为官方模板,然后根据你实际的大模型参数进行修改。需要修改四个参数,大模型的纸杯 sir、 大 模型密奥 apikey、 大 模型名称域以及工作空间路径。 windows 和 linux micros 填写不同的路径格式。在配置文件中找到 agents models model primary, 确保其值为你刚才配置的模型路径格式为 custom 零零幺模型 id, 这表示 open core 启动后将默认调用该模行为你服务。如果你目前只需要使用基础对话功能,可以暂时忽略 tools 和 skills 中的 s k x x x x x 占位符。 待日后需要启动图片生成 web 搜索等高级功能时,再前往对应服务商申请密钥并填入即可保存修改后的 open call 送文件,然后关闭并重新启动 open call 程序。完成以上步骤后,你的 open call 二便已成功接入云端大模型,可以正常开始对话。

11叶老师讲AI 06:54查看AI文稿AI文稿

06:54查看AI文稿AI文稿coding plan 是 啥?俗称虾粮,其实就是 token 的 套餐,因为龙虾在每一步都需要消耗 token 消耗量大,所以需要有套餐才不至于花费太高。目前很多厂商都推出了自己的 coding plan, 国内的主要有字节,阿里、腾讯、百度、智普、 mini max, kimi, 还有其他的一些公司,价格不一样,支持的模型也有区别,大家按需购买。那是不是大厂的云主机只能用自己的 coding plan 呢?不是,但如果你的云主机在部署的时候使用的是大厂提供的 open cloud 镜像,那么有的大厂的云主机只能配置自己家的 coding plan。 那 么遇到这种情况,如果你想用别人家的 coding plan, 就 需要我们自己去配置了。接下来我来演示整个配置过程。先说一下我的环境, 我用的是阿里云的清量服务器,然后呢,因为我没有其他的 coding plan, 所以 我还是用的阿里云的 coding plan, 你 们可以拿这个作为参考,其他的 coding plan 配置也是一样的。 咱先到 coding plan 的 界面,你也可以看到有一个套餐专属的 api key, 这个你把它复制下来你会用到。还有 base url 就 有两种,一种是支持 open ai 协议的,还有是支持 iso project 协议的,两种去任一种都可以优先,我们就选 open ai 的, 然后这个下面它是 coding plan 支持的模型,任选一个,把它的名字给 copy 下来,它这个名字就叫它的 model id。 好, 拿到这么几个信息之后,我们就可以去配置 coding plan 了。 来到云主机的管理台控制台,通常这个控制台呢,你看点开它的管理界面,它可以在 ui 上就直接配置,但是这里呢,你看到它不能配置其他厂家的 coding plan, 所以遇到这种情况呢,我们就需要跳入到这个系统里面去,登录到系统里面去,进入到远程连接登录, 先输入 opencloud config 命令, 进入到了 opencloud 的 一个配置的流程里面。首先选这个 getaway 的 配置 local, 这个直接默认就可以了。然后选择 model, 这里是配置模型的, 因为它原声支持很多模型,但是呢,我们用的是 code plan, 所以 我们直接选最下面,下面有一个叫做 customer provider 这个选项,选好之后,这个 api base url 就是 刚才我们复制的。把这个 url copy 进去, 好回车,接下来它需要 api key, 然后我们再把 api key 复制进去, 接下来他会问你是兼容哪一种模式协议,那么我们刚才使用的是 open ai 的, 所以我们就继续选择 open ai 的 这种兼容就可以了。 接下来 model id 就是 刚才我们选择其中一个模型的名字,一定要用复制好的这个 model id 填进去,不要填错了,这里我们直接填的是 kimi 连五, 好回车它就开始验证,看到验 refiification successful, 那 就通过了。好,后面有个 anonote id, 这里呢,因为我用的是阿里,所以就直接叫做百炼, 你也可以去根据你的 coding plan 里边看一下它的 endpoint id 是 啥。最后呢,是让你填写这个模型的别名,刚才我们是 kimi k 二点五,那我们这里的模型我随便取个名字就叫 kimi 二点五,当然你不填也是可以的,就空着也可以,然后这样模型就配置完成了。 continue 好, 最后把这个网关重新启动一遍。 open cloud restart getaway restart open cloud getaway restart。 好, 网关启动成功之后,我们可以先进入到 open cloud t u i 这个命令,进入到一个 t u i 的 界面,这个界面可以快速验证和它模型开始对话,跟龙虾开始对话, 问一下 hello, 看他是否有反馈。好,他回答我们了,那证明配置是成功的,那么你也可以看到,在这个右下角显示了是 k m 二点五, 那我们再问问他,是不是真的用了 k m 二点五这个模型。 哎,他反馈了,用的确实是 kimi 二点五。好了,这样的话呢,你的 coding plan 就 部署到云端了,那么接下来呢?因为 coding plan 里面支持好几种模型,那么我们如何把其他的模型也配置进去呢? 你可以看到啊,在一些 coding plan 里面的文档里面啊,它会告诉你配置这所有的模型,它会给你一个接收文件,你把这个接收文件啊全部给拷贝下来, 包括这个简短的说明啊,都可以一起考。然后把这一段全部丢给刚才这个模型,告诉他,你说请按照这个文本这段话,把这个所有的模型都配置进去。 好,接下来我们的龙虾就根据你提供的文档自己配置其他的模型, 这块要花点时间。当然了,这块除了在 tui 里面,你也可以在 web ui 里面,或者是你的飞书已经配好了,你甚至在飞书里面跟 openclaw 去对话,把这一段对话全部丢给它都好。最后配置完成,它自动重启了网关。 好,我们可以看到这个网关全部都已经更新了,配置也都更新了,我们再来跟他确认一下。先问一下, hello, 看他是不是有反馈。好,他有反馈,他并且告诉你,哎,我这些模型都已经配置成功了,那我们来尝试一下换一个模型,那么这里我们会换 mini max 二点五吧, 直接跟他说,请帮我们把模型更换为 mini max 二点五, 看它是否能更换过来。 诶,成功了?好,你再确认一下,看它是不是真的成功了。好,这里面右下角已经显示了它是用的 mini max 二点五。那我们再问问它是不是真的 啊?你现在用的什么模型?看它的反馈啊。他说,我现在用的就是 mini max 二点五。好,这次 coding plan 就 全部配置完成了,大家看看还有没有什么其他问题,欢迎在评论区交流。

82冯哥飞呀飞 04:48查看AI文稿AI文稿

04:48查看AI文稿AI文稿现在很多人用 open core 龙虾来提升工作效率,但是他用云端的大模型,大家又有所顾虑,数据不安全,依赖外网还会受限。想让龙虾直接调用你本地的大模型吗?今天这期手把手带你切换,安全又自由。 好的,真的是手把手教哈!现在我们在左下角搜索框上面输入 c、 m、 d 三个字母,在弹出来的命令提示框里面,我们首先要进行一个环境检测,那检测的内容无非就是两项,首先第一个是龙虾的环境是否是安装正确,另外一个是欧拉玛本地 你的开源大模型运行框架是否正常,有些人到这一步可能就开始挂了,哎,我这里怎么跟你不一样呢?这些都是基础环境的问题,点赞过千呢!我会为大家出一期教大家怎么零基础安装龙虾环境,并且配好本地大模型。 openclose 需要一个 api key 来识别,欧拉玛服务 这里我是使用了 linux 常用的,这种 spot 命令在 windows 环境下应该是识别不出来,所以待会大家看到一定会出一些问题啊, 那我们换另外一种方式就可以了。所以现在我们是通过 open call 来配置他的 a b i k, 这个 k 可以 是任意的支付船。我这里是设置成了欧拉玛 logo, 那 你要设置成 abc 也是可以的。 现在大家看到提示就代表着我们的龙虾已经连上了本地的大模型,当然现在还没结束啊。接下来我们要检查一下奥巴马服务是否已经开启,因为如果没有运行的话,是需要重新再启动的。这里输入的是本地奥巴马的服务地址, 可以看到我现在本地正在使用的一个大模型是千问三点五的九币,如果没有顺利出现模型铃声,那需要执行这条命令,手动启动本地大模型。那如果你的拉玛本来就是正常运行的,执行这条命令呢,就会 有错误,跟我一样,这是正常的,不用慌,现在我们干脆新开一个命令行窗口啊,我们先检查一下这个龙虾里面的模型有哪一些啊?用 openclose model list 的 这条命令就能够查询的到,第一个千万三幺四 b 的, 这个是之前我使用的本地模型。 第二个呢就是龙虾他默认使用的大模型啊,这是一个在线的大模型。然后呢,用现在大家看到的这条命令,我们就可以让龙虾去找到本地正在使用的大模型。 千万三点五九币。执行完了以后,龙虾会自动的重启,重启以后倒转到这个龙虾的 t u i 交互界面, t u i 交互界面是我们和龙虾进行交互的一个 窗口,我们可以交代他去做什么啊,他会在同样的地方给我们反馈。按 ctrl c 就 可以退出 d o i 界面。紧接着用 open claw on board 这条命令 来启动龙虾的出石化像道这一步用方向左右键就可以选择 yes or no, 这里我们选择的是 yes。 第二项默认选第一个就可以 回车跳转以后我们就可以在龙虾里面看到一个表,这个表里面就显示出了龙虾检测到的本地大模型。千万三点五九币。下一个配置我们可以选择一二两项中的一项,但是千万不要选择第三项 reset, 接下来模型供应商选择,我们直接跳转到最后一个,跳过就可以, 然后选择 o provider, 在 这个 default model 里面连接的欧拉玛模型应该会出现在最上面,并且作为末日模型选择这个就可以了。后面的设置大家只需要参考视频的配置就行。 最后重启龙虾我们就可以来测试是否切换成功。由于之前我已经使用了飞书来测试一下本地的 overclock 使用 大模型是否是正确的啊。大家可以看到当前我发送的消息是直接会发送到我本地的服务器的, 然后有本地的大模型去查找问题。好,我们看到了现在这个龙虾去查询了一下,回复我们当前模型是圈问三点五九币,这个是准确的啊,那基本上到现在 本地模型切换呢,就是完成了啊。最后给大家展示的是拉取本地模型常用的两条命令啊,第一个是拉取,第二个是查询啊,有需要的宝贝啊就可以去参考一下。

37许说AI 03:39查看AI文稿AI文稿

03:39查看AI文稿AI文稿这个是我们尊贵的大客户啊,呃,一年在在口袋交易市场上都是以小目小目标为单位的。吴总他刚刚从天安门回来,马上就开机用上我们的小龙虾,那还是很小巧的,这个是电源, 我们吴总马上要用小龙虾实现翻几十个小目标,第一个目标就加这个啊,对,先插上他的无线网卡, 到时候就直接插上电,然后连上网就放家里面,开始养虾之旅。猫耳朵一样的无线网卡,我们吴总的商业思维很明白的,他是不是中国炒股弄上龙虾用最基本的一个人,会不会马上?我觉得以后要拿上吴总,我们开几期直播,让他给大家分享一下怎么样让龙虾炒股啊, 哈哈哈哈。客户也开始连上显示器,可以用 hmi 的, 也可以用 a j 的, 两个口都有,就看你家里的显示器是什么样的端口,插上键盘鼠标, 我们的龙虾其实都已经好出厂,就安装在里面了,全部安装在里面了,包括十开机,好流行一键配置。 呃,这个这个,这个是属于客户的重大重大致富的秘密, 这里面已经完整的印制了一个操作系统以及我们的龙虾软件,开机之后不需要登录,后期如果需要安全防护的话,加上密码,打开之后静置一下,让这个系统完成一些触手花的工作。现在我们给它联网 好,看到这个界面,这个龙虾就正常工作了。 看到没?真正做到开箱即用啊,不要像网上那么多教程,那么多课程讲龙虾装的天花乱坠的。但是我们这里真的是实现了一键式的安装,客户开箱即用。我们刚刚尊贵的吴总动了一下手,按了一下启动电源, 别上网,跟别的龙虾有点不一样,你看吴总初次见面,你可以配置你自己的性格,包括比如说你他,你喜欢龙虾,怎么教你,你是什么时候生日的?然后这个先把一些基础的配置输进去,这个在别人的这个官方的龙虾那是没有的,这个是我们针对你的一个特性去使用的,你呃对号码直接可以给他一百万的 token。 好, 进入了龙虾的这个操作界面, 这个投资界面就相对来讲比较友好啊,跟那个官方这个板块。然后我们其实是把龙虾的像,比如说聊天,你配置那个微信飞书各种啊,这通道直接可以一键配置,就不要那么复杂了。你真正到龙虾的自己的界面里面肯定是很复杂的,那我们就给它设置了,哎呀,应用由这里我们会把五种作为经典的案例在这里去做一个展示过去,也能让场景亮。然后包括汽车市场 应用程序里面,就你要变什么技能,我就全部给你提出来了。就是比如说以后你要你要关注同花顺的,然后你要去全网搜索的各种技能,你就不需要自己再去写技能,你直接安装就 ok 了。那当你炒股就要安装炒股的技能,然后那个做新媒体,做新媒体的技能,当然这个目前是多放在一起,后面我们就把它分别类的去炒股的,做新媒体的,做内容的, 这个是这个只是那些认知啊拓展这里,比如说你自己,你像上一次我们没有去用我们这个龙虾,你自己买的话,你要去买模型,然后各种平台都充值,那在我们这里就是你统一把钱充到这里,然后你就可以选择不同的模型来试用,然后你用了之后,你在龙虾官方的英文版里面,真的是很去从里面去看,基本对普通用户就不太友好。 然后包括里面所有的系统设置,里面网关,以前你在龙虾店玩你的网关这个网站,你要,你要会那个模型配置,你自己配什么模型,这里全部都帮你,直接我们傻瓜式的操作 数据管理,这个就是一个一个基础的一个板块。然后呢接下来可能就呃,帮那个吴总把聊天这个板块,比如说把飞书推进去,然后你这个龙虾现在他就在里面,你在电脑上你可以给他安装很多的一些相关的应用,然后把权限给他,然后你就用你的飞书,就给他用这台电脑帮你去做这个事情, 然后取决于你开始的权限给他,然后呢如果说这个混装开了权限之后,这里面的这些技能,这些模型、技能、技能全部都放这里,就不输在电脑上,不输在龙虾上。

6李叫兽 00:45查看AI文稿AI文稿

00:45查看AI文稿AI文稿今天给大家分享一下更换大模型的配置,是安装龙虾的时候,我们没有进行大模型的配置,会报这样一个错误,这个时候我们只需要来到 配置,找到对应的 models, 点击 i w, 这个时候呢,这里显示的是一个呃初步化的信息,这个老火机在用的这个大模型性价比不高,或者说效果不好,需要更换的话,步骤也是一样的去更换我们目前配置。

173不做NPC的老伙计 03:09查看AI文稿AI文稿

03:09查看AI文稿AI文稿后我们再把自己的 k 粘贴进去就可以了。啊,大概是这样一个逻辑啊。呃,咱们接着往下看啊,因为我们现在已经部署了多个呃供应商,两个供应商。嗯,每个供应商里边可以增加多个模型了。那我们现在再往下这个 agent 啊, agent 我 们就可以给他选择一个,设置一个呃多模型模式,你看这个,这个 primary, 它就是默认的一个模型,我可以默认是用千问 plus。 那 这个呢?这个 sector 呢?它就是一个备用的模型 啊,备用的话可以是可以写千问 max 也可以,当然也可以写写咱这个 gpt 四四 o 啊,是吧?这是一样的,你要我现在说的就这个逻辑要弄对, 有时候当当我们是单个模型,单个供货商供应商的时候,我们是不需要写这个备用模型的。当我们现在有了多个供应商,多个或者多个模型的时候,我们可以要增加这一行 啊,这个时候我们在部署,部署完之后我们就可以选择啊,用是用上面这个模型还是用下面这个模型了。好,那我们回到我们把这一段代码复制上啊,复制上之后我们回到我们的个 里边,这里边呢?因为我之前呢我是配置完了,配置好的是这个千份的,我现在一块全部替换的话,等于说千份这个就没有了 啊,那我可以提前把这里边的有用的东西我先弄出来啊。我先把这个网址贴出来吧。我先把网址贴一下啊, 哎,待会儿我再复制,然后这个 apk 我 也保存一下得了, 对吧?待会儿还复制复制进来,我全部换了它。嗯,这个都不用动,你看 open a 点这个,这个不用动。下边儿这个要要有啊, plus 要有。再往下 这个都不用动。这个都一样啊。那其实我我就把这三个,三个数值啊,这个,这个主要是 k, 还有我这个名称搞出来之后,其他的都一样的。 啊,那我就可以整体上搬搬过来了。在吗?那我就直接从这拿掉它得了,从这往上全部拿掉, 全部拿掉。全部拿掉的话其实是我拿这个 model 这就可以了。在网上那个其实没大用,它是更新的一个记录啊,我从 model 这我删除掉它, 哎,然后我把 cloud 给我改好的,这套多模型的粘贴到这里来, 那我再把里边的 id 换一下就可以了。

00:16查看AI文稿AI文稿

00:16查看AI文稿AI文稿你的 nars 还在吃灰吗?今天教你让它变身二十四小时在线的 ai 管家,不用云服务器,不用花钱订阅,数据完全掌握在自己手里。全程保姆级教学,虚拟机部署,完全杜绝系统污染。我们开始!

5虫单科技 02:54查看AI文稿AI文稿

02:54查看AI文稿AI文稿兄弟们,有没有已经装了那个 oppo cloud 的? 这个龙虾我玩了一段时间啊,我发现这玩意根本不是什么廉价的流氓啊,是个无形的这个退潮机啊。前几天深圳有个哥们刚装上,兴奋的不行啊, 随便扔了几个自动抓取和代码的调试任务啊,结果睡了一觉,第二天一上来 a p i 账单直接崩掉了啊,直接跑崩了,好像 这哥们三天直接烧了一点二万块钱的托肯,辛辛苦苦打工赚钱,直接给这个大模型厂商了。我总结了一下啊,他,我们看到这个龙虾智能体啊,你让他写爬虫啊,他会自己在后面去拆解搜索,写代码报错,再查资料,修 bug, 一 年套这个下来的话,他跟这个大模型的交互可能是有几百次,所以每次都是很疯狂的在消耗这个托克啊, 所以我发现要这么玩的话,我们根本玩不起的。老板你这么玩还不如请个人,那他可能比那个人还贵啊, 所以看我们还是要看处理什么什么事情。很多人一上来就默认这个配置,基本全是 g b t 五点四还 low 喷四点六的这种顶配模型。 说实话,你让他去做一些这种日常的啊,比如说什么 excel 表啊,邮件查资料填表啊,像这些完全是大炮打文字,浪费啊。其实像这种的话,我们是可以切到那国产的,比如说 deepsea 啊,还有 kimi 这种比较便宜的啊, 你像处理这些问题的话是没有一点问题的,但是你的成本是低非常多的啊,我们只有在那种写比较难写小说的时候, 你可能在用 gpt, 五点四这一类的啊,就一定要切换着用,还一个我觉得就是千万不要在睡觉的时候你给他发任务,然后让他自由发挥,如果他陷入那个死循环, 他一夜之间就可以把你的信用卡刷爆,因为他是不停的去在调用这些东西的啊,一定要给他加这个限制,比如说你给他设置那个每日消费的上限 啊,比如说一天最多花两美金啊,超了直接拔网线啊,还一个就是在配置里面把这个智能心跳和最大循环次数 设个上限啊,就让他干不出来的活,就让他赶紧停,不要再干了啊,不然他一直死坑就一直烧钱,还不一定干完了。这个如果你真的需要他 七乘二十四小时高强度跑业务的话,我觉得这个可能啊,公司合适一点,就是不用原单的 a p i 啊,直接干这个本地的这个大模型,就带个 g p u 的 本地主机,用那个欧拉玛本地部署,像千万这种的开源的这种模型啊,这样子的话就一次性投入嘛, 但这这个我们普通人肯定干不了,这一定是大企业的,所以就一定要合理的用,不然这玩意太烧钱了,你玩游戏氪金都不一定有它这个贵啊。

04:37查看AI文稿AI文稿

04:37查看AI文稿AI文稿最近好多人都在问我,我是一个新手,这龙虾到底怎样开始养?今天我不讲虚的,直接给你十个必须配的点,每一步都会把真实操作放在视频里,你照着配就行,建议先收藏。第一步,先选模型。 这个其实就是先给龙虾学脑子,如果你是新手,我建议你先用智浦五系列,原因很简单,便宜、稳、够用。智浦有一个 double, 是 国内首个针对 openclaw 这种长对话深度优化的模型,你先别一上来就追最贵的,先把龙虾养活,养顺更重要, 可以像这样。第二步,接渠道。如果你是新手,我建议你先从飞书接起,他相对简单,也更容易先跑起来。记住一句话,先接一个先跑通,不要一上来全接入口和配置文件的位置在这里。 第三步,装 skill 就是 技能包,这一步一定要慎重,全网都在说装上 skill 龙虾就能飞,所以很多人恨不得龙虾一装上就装一大堆技能,我不建议身边好几个朋友都是因为这样把龙虾搞挂了, 因为在你不了解技能包的情况下,很多机率会有插件冲突。官方自带五十个 skill, 基本覆盖了所有的基础技能,所以我建议一个都不要装,先去看官方自带的五十个 skill 里,有没有你能用上的才是最实在的做法。 skill 的 文件路径在这里。 第四步,你的个人 dna。 这一步特别关键,因为它决定了龙虾写出来的东西像不像你。其实做法就是准备八到十五篇你过去写过的文案样本,最好是你自己比较满意,也比较像你真实风格的 整理到一个叫 model 文件里,然后运行 d n, 它会自动提取你的风格、语气、节奏、 样本怎么整理,命令怎么跑,可以像这样。第五步,写记忆。龙虾默认数会失忆了,所以最重要的信息一定要提前写进 md, 至少写这几类。这一步配好之后,它就不用每一次都从零开始重新认识你, marry md。 具体是写什么,可以看我前面的视频。 第六步,设心跳。心跳的作用就是让龙虾定期醒来,主动看事情,比如看邮件、看热点提醒,开会定期汇报,这些都可以写进 habit, 这样他不是每次都等你开口,而是会按照你设定的节奏自己去检查哈比特怎么写,也可以看看我前面的视频。第七步,定闹钟。 如果有些事是要精确到具体的时间去触发的,那就不要只靠心跳,要加抗配置。比如 每天早上八点提醒,每周一发周报提醒,每天固定时间跑一个动作,你记住一句话就行,心跳负责定期抗,抗负责准时做,抗怎么配,命令怎么写,可以像这样。 第八步,守住底线。这一步很多人容易忽略,但其实特别重要,因为龙虾能做的事越多,你越不能让他什么都直接做。所以你要去配置里找到这两个文件。 你要把高风险动作先设成需要确认或者直接禁止,比如删除文件需要确认,发到群里需要确认支付相关禁止。 先把底键守住,后面再慢慢的放权限,具体在哪里改在这里。第九步,盯成本。这个很现实,你要养成一个习惯,每天睡前看一眼,偷啃消耗你不用算的特别细,但你得知道大概花了多少成本,怎么看可以像这样, 第十步做备份,最后一步很多人不是不知道,而是喜欢拖。当真的出问题的时候,你会特别庆幸自己做了, 因为龙虾会学习,会成长,那记忆、 dna、 技能、配置都是你一点一点养出来的。所以我建议你每周固定备份这几个东西,你可以直接丢云盘,也可以放 get 仓库里, 这样哪天真的出问题了,至少还能恢复备份。哪些文件在这里。如果你现在刚开始养龙虾,别着急,上来就让他干大活,先把这食物按顺序配好,你会发现他才能真的开始为你所用。新手开始养龙虾,不是看他能不能干活,或者是有多少技能, 而是看你前面这些基础有没有设置好。如果你现在也打算养龙虾,这条视频你可以先收藏,需要文档的可以在评论区告诉我,后面你就对着文档和画面一步一步配置。关注我,下期有更多关于 open globe 的 干货分享。

01:20查看AI文稿AI文稿

01:20查看AI文稿AI文稿你是否也为养龙虾而烦恼啊?我刚才试了一下,咱们这个龙虾线上 toking 太贵啊,根本养不起。但是要想用本地模型啊,你的本地模型小龙虾是不是傻傻的呆呆的?那是因为你本地步数太小了,四 b 八 b, 那, 那龙虾简直就跟啊幼儿园的小学生一样,想要部署本地大模型啊,首选枪神九 plus 超净版啊!我刚试了一下,部署三十 b 以上的本地大模型啊,六十四 g 两 t 加五零九零显卡 绰绰有余啊!还有一款就是咱们的幻 x 啊,幻 x 的 一百二十八 g。 我 刚看了一下啊,一百二十八 g 内存,如果你又放到台式机上,光内存的价格就已经 将近一万二三的价格。但是咱们现在换 x 的 笔记本啊,显存又高,内存又大,一百二十八 g 版本还可以同时叠加补贴的价格,现在两个 w 都不到,而且还有学生优惠啊,又方便携带, 轻轻松松啊!本地部署大模型龙虾啊,让你的龙虾啊比别人又聪明又快,而且还不用耗耗,耗费大量的 tucker 啊,不用耗费资金就能帮你办事啊,这样的下属谁不爱?想要预知详情,赶紧点我主页!

04:58查看AI文稿AI文稿

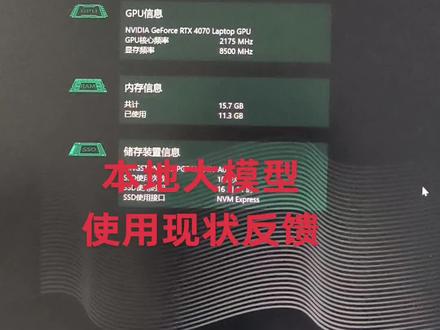

04:58查看AI文稿AI文稿大家晚上好呀,你看这是我的电脑配置 g p u 八 g, 内存十六 g, 然后呢?我在我电脑里面呢装了两个大模型,一个是千万三点五九 b 的, 还有是 deepsea 阿姨八 b 的, 你看我现在把这个千万给刨起来,看看它那个资源分配是什么样的,你看, 因为千万三点五九币的话,它对那个就是它是有九点五 g, 然后我的,那我的我的显存显然不够,然后呢?所以就它是这么分配,百分之三十五用 cpu, 百分之六十五用那个 gpu, 然后本地大模型有了,那能跑起来吗?因为我用的是欧拉玛作为那个服务框架作为容器来装他们的,然后你看这是欧拉玛他自己,他自己的那个一个用户界面, 你看我就是跟他聊天那个,让他创建创建那个文本吧,他就会告诉我,哎呀,作为 ai 语言模型,他没法直接操作我的操作系统啊,然后叫他搜索政策信息吧, 他说那个啊,哈哈哈,他说他不知道,现在是二零二六年,他说他的这知识都是基于训练数据的,都是二零二四年出的, 你看这个欧拉玛自己自己配套的那个那个平台不行吧?那东西,然后我我呢试了好几种,最后面用的切瑞这个,你看切瑞啊,你看我,我给他现在连的就是那个千问三点五九币的这个 本地大模型,然后我现在让它,让它在我的 d 盘, d 盘那个这个文件夹下面创建一个 t s t 文档,里面写 cherry 测试创建来看看,我现在我现在就在这个位置, d 盘 ai workspace 那 个位置,然后我现在这边是没有 t s t 的, 对不对? 然后我先让他创建,让他执行一下,然后把它再改一下,对,让他创建好。你看他这个反应还挺快的吧?他那个你看思考用的,思考最后面出结果, 他几乎把我在我有限的资源条件下,然后把我的大模型给用起来,我觉得我已经挺满意的了。你看这是他刚创建好的,你看里面内容, cherry 测试创建, 然后你看我用它来搜索,搜索那个,你看我那会用那个欧拉玛,让它搜索是二零二六年中国的 ai 政策,那我让它来搜索一下,看看 二零二六年的 ai 政策,然后把那个网络搜索给它勾上,用那个百度的, 看我本地大模型,它也是开始思考,然后开始收。 你看这已经是在最大程度上把我的本地大模型给用起来,关键吧,它这个还有个知识库,我可以创建自己的知识库,这个就是作为我的一个助手,我觉得还挺好的。 虽然说用 open curl 还是有点那个够呛,养不起本地龙虾,但是也算是发现了其他的一些用法。 你看这边他告诉我用时花了多长时间, 看一下我的那个就是它现在在用的时候我的那个 gpu, 你 看我 gpu 和 cpu 内存它们的那个使用的比例还可以吧,你看这些东西都出来了, 它也会总结,所以在那个操作本地就是文件系统,当然它也是有有文件格式限制,就说只能是 tst 的, html 的, 还有就 md 的, 就是记忆的那种的, 然后其他的那就那个我还在摸索中,这就是我现在本地大模型使用的情况汇报给大家,你看 他那个搜索的那个政策信息,总结的还挺非常不错,我觉得差不多在我这么有限的一个那个笔记本条件下,能让我的大模型用起来、跑起来,我觉得这已经是一个很大的突破了。

128木火相助 06:22查看AI文稿AI文稿

06:22查看AI文稿AI文稿问你一个问题啊,为什么别人的 open claw 那 么厉害,而我的 open claw 啊,傻的完全没有办法交流啊,背后的原因是啥?以及怎么样去解决这个问题呢?好,接下来一个视频啊,给你讲清楚。那么前面我们说了,龙虾呢,有三大核心组成部分,除了龙虾 本身之外呢,还有大模型以及技能。而在这三个核心里面啊,大模型它充当的是龙虾大脑的时候,那么大概率 一定是你的模型选错了,你模型用的不好,那么整个龙虾就不好用了。好,问题来了啊,那我想让我这个龙虾好用一点,那怎么办呢?那就是使用顶级的大模型啊。好,那问题来了,那我怎么样给我的龙虾去更换大模型呢?接下来一个视频啊,给你讲清楚。好,我们想要给我们的龙虾更换大模型的话, 我们需要知道三个东西啊,第一个 ok, 你 的 api k 啊,你在哪个平台?你的身份标识是啥? api k 就是 你的身份标识, 因为龙虾呢,使用这个模型是要去付费的。好,那么付费的话,我就需要有一个身份标识来标识,张三是张三,李四是李四,这样的话,我才能够成功地去计费嘛,所以我需要有一个 apik, 然后第二个呢,我需要有一个 base url 啊,因为不同的大模型,它的请求的地址是不一样的, 所以这个就是大模型的请求地址,这是大模型的请求密钥。而第三个是谁啊?大模型的名称,因为即使是一家公司的话,他的大模型也是非常多的,那你到底是调这家公司里面的哪个模型, 你要讲清楚的。好,那么接下来呢,给大家去讲一下,怎么样从零到一的给我的龙虾呢?去更换大模型。好,那么首先咱们需要去找到这三个地方啊,通常情况下,不管是哪家平台, 那么它一定是有说明文档的啊,那这时候呢,咱们可以去打开它的说明文档啊,比如说,比如说随便一个平台吧啊,咱们就可以找到了,它里面有啥呀? open ai 兼容模型的这个列表的请求地址 啊,那么这个地址啊, base u l 给大家来说一下,它通常是以 v e 结束的啊,通常是以 v e 结束的,所以, ok, 咱们去调用的时候, base u l 咱们就找到了啊,这个地址有了,那么地址有了之后,接下来呢就是去调用模型了,然后在他们官方里面也给咱们提供了一个接口,然后这个接口呢去访问,你可以得到所有的 模型名称啊,当然因为它们本身是一个集成站,所以在它里面呢,国内的模型和国外的模型都有,比如说 kimi 二点五呀啊, jama 三点一呀啊, gpt 五点四呀啊,包括豆包一点五呀等等等等,还有 cloud 四点六啊,它们家都能用,而且夸张的是啥呀? 它们有套餐,可以让你的成本可控啊,你可以订阅六块九的,你也可以订阅四百九十九的,根据自己的使用情况来选择相应的模型就 ok 了。好, ok, 那 这时候我就得到了贝斯 u l 了,以及 它的模型名称了,那么第三个是啥呀?第三个是我的 api k 啊,那这时候咱们就去访问后台,在后台里面有一个 api k 啊,这时候呢? ok, 我 可以新建一个 api k 啊,比如说这儿呢,我就新建一个 test 啊,然后点击创建。 ok, 那 这时候 api k 就 有了啊,这个时候咱们三个东西都有了情况下啊,当然所有平台都是一样的,所有平台你就去找这三个东西就行了。 找到这三个东西之后呢,接下来咱们就去对接一下最新的 gpt, 五点四。好, ok, 那 这时候啊,怎么样去对接呀?不管你是 windows 电脑还是 macos, 苹果电脑都是一样的,那么 windows 电脑呢?你就点击视窗键, 然后 cmd 啊,打开你的命令行提示符,如果你是苹果电脑的话,在应用里面去找到终端啊,都是黑色的窗体,然后点击它就行了,然后点击它之后呢? ok, 接下来输入一行这样的一个命令, open cloud configure, 然后输完之后敲回车啊,敲完回车之后呢,咱们选择当前本地的配置,然后确定, 然后在里面去选择 model, 因为接下来我要去更换我的模型嘛,所以点击 model, 然后在这个 model 里面呢? ok, 如果你直接是比如说,哎,我就去对接 kimi, 那 你就去选择 kimi 就 行了啊,但是如果我对接这个平台在这里面没有怎么办? ok, 它底下会有一个自定义模型, 所以你不管是哪个平台,你只要拿到刚才那三个东西,咱们都可以通过自定义的这种配置来进行设置了。好,那刚才那个平台它没有内置啊,那我这时候呢,我就选择自定义的厂商啊,因为它符合 open ai 协议的好。敲回车,然后 敲完回车之后,它要你干嘛?输入 base url, 然后 base url, 刚才咱们找到了呀,啊?它在哪啊?它在这儿,对吧?啊?这个 base url, 它是唯一结束的,大家注意啊,唯一结束了,所以咱们复制这个地址。 好,然后回到咱们这边把它原来带的这个东西呢地址呢?给它删除掉啊?粘贴是吧?好,敲回车,备注 u l 有 了,然后接下来输入啥呀? api k。 好, 输入 api k, api k 是 啥呀?刚才咱们登录到后台,这个 api k 复制啊,然后这时候呢给它粘贴,然后粘贴完了之后呢?哎,敲回车, 传回车之后呢? ok, 你 要去选择协议,那我的这个协议呢,就是 open ai 的 协议,所以我选择第一个 open ai 啊,敲回车,然后这时候他让你输入啥呀? model id, 然后 model id 的 话,刚才咱们从这儿哎得到了所有这个 model 啊,我千万三三点五 plus 啊,然后这些都能用的,那我使用啥呀?这一批题四 啊,我使用顶级的大模型,那它的能力一定是最强的。好,那这时候, ok, 咱们去选择啊,这时候不要胡输啊,一定是平台给你提供的这个 id, 不要自己去输入复制,然后粘贴啊,粘贴完之后呢?敲回车啊,敲完回车,这时候他就该干嘛了?去验证你这些信息到底是不是对的?好,验证完之后他告诉你, ok, 我 可以连接成功,到这,你已经成功百分之八十了啊。好,然后这时候呢,他让你去起一个名字啊,给他起个名字,那默认的这个就可以, 不需要去改的啊,这时候咱们去敲回车就可以了,敲完回车之后呢,它需要有一个别名,是吧?啊,那么这个别名呢?咱们就叫做啊有 club。 好, 完了,配置完了啊,配置完了之后呢,咱们继续啊,这时候咱们重启一下咱们的服务就 ok 了啊,配置完之后, ok, 使用 open club 然后 get 位啊,你如果之前你的服务是启动的,这块使用 restart, 如果你之前已经把它关了,所以我这呢 open club get 位就行了。好, 敲回车啊,敲完回车之后呢,咱们问一下大模型,测一下,看它是不是 gpt 五点四啊?好, ok, 那 我设置完了之后呢?哎,我来到网页那边打开我的 龙虾啊,当然龙虾我没有升级版本,现在版本又发布新版本了,那我就问他,我给你更换了新的大模型,告诉我你是什么大模型。好,然后完了之后呢?点击 send, 咱们来看一下它的回复啊。好,那么经过了一段时间之后呢,它告诉我了它是啥呀? gpt 五点四。好,那到这咱们的模型就更换成功了。 所以呢,最后咱们去总结一下,不管你是哪个平台,咱们只要能找到这三个地址之后,然后使用命令的方式,就可以在不改代码的情况下自己来更换大模型了。我是磊哥,每天分享一个干货内容。

564磊哥聊AI

猜你喜欢

- 2359懂模帝

最新视频

- 1404鸽伦比耶