oh my opencode插件使用教程

粉丝887获赞8906

相关视频

10:03查看AI文稿AI文稿

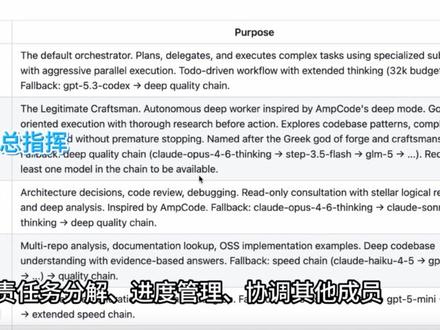

10:03查看AI文稿AI文稿上期视频带大家快速上手了可乐的 kodi 的 开源替代品 open code, 并且演示了 open code 的 基础用法。 open code 还有更高级的用法,我们可以结合 open code 最强的开源插件欧买 open code, 简称 o m o。 使用这个插件可以让 open code 从一个简单的 ai 编程助手进化成能够实现多 ai 编程的 ai 开发团队。不同模型各司其职, 因为如果在 open code 中只使用单一的模型来处理所有的任务,那么无论是前端 ui, 后端逻辑还是文档编辑,遇到模型不擅长的领域时就会出现能力下降的情况。 而且只使用高端模型,比如说 opus 四点五或者 gpt 五点二来处理简单任务还会造成浪费。 所以在 open code 中,我们就可以使用 o m o。 这个插件来实现多模型智能协同。比如说使用 g b d 五点二实现架构设计,修复复杂 bug。 使用 gemine 三 pro 实现前端的 ui 设计。 使用 cloud 三 n 的 四点五模型实现文档研究 o s s。 分 析,还能使用 guirk 模型实现快速探索。而且 o m o。 的 优势还包含任务完成保证机制。在 o m o 中,它使用 c c f s 这个智能体对其他智能体进行指挥,委派任务还有验证, 从而实现让大模型在执行任务的时候不会停下来。所以 o m o。 这个项目中的 c c f s 这个命名也很形象,因为 c c f s 是 希腊神话中因为触怒众神而被判处苦役的任务,它必须日复一日地将巨石推向山顶。 所以在 o m o。 项目中, c c f s 是 一个默认的 agent, 它相当于一个强大的 ai 协调器,使用专门的 ai 协定的并行执行来规划、委派和执行复杂任务。 而且在 open code 中使用 o m o 的 学习成本几乎为零。我们可以直接使用 o m o 的 outwork 工作流,只需要在提示词中输入 outwork, 然后 c s face 就 会将我们的任务委托给其他的 agent, 从而实现不需要我们写一行代码就能帮我们完成任务。 而且它还支持智能上下文管理,还能实现代码质量保护,还具有并行执行能力,独立任务它可以并行执行。它还具备实时获取外部知识的能力,因为它集成了 context seven m c p 来实时查询官方文档, 还支持 excel m c p 来实现网络搜索获取最新的信息。而且它能完整兼容 cloud code。 所以 对于大型代码重构、代码遗留问题,全站开发,修复复杂 bug 等场景,我们就可以在 open code 中使用 o m o 这个插件来执行这些复杂的任务。好,下面我们将结合更加贴近实际的项目来测试这款插件在 open code 中的使用效果。 将使用这款插件非常简单。首先我们要确保我们已经安装了 open code, 如果不熟悉 open code 的 话,可以观看我上一期视频。 下面我们只需要复制官方给出的安装命令进行安装就可以。官方这里给出了两种安装方式,第一种是使用半,第二种直接使用 n p x, 然后我这里就复制第一条命令,然后打开终端命令行, windows 用户打开 c m d, 然后我们直接粘贴这条命令,直接运行就可以。 好,这里它提示我们是否有可了的账号的订阅,这里我选择有, 然后这里它提示我们是否集成 gemini, 然后我这里也选择是好,这里安装完成,它提示我们需要运行 open code, 然后这里我们就可以看到它设置的这些智能体,包括 sisifors 使用的 cloud os 四点五模型。 好,下面我们就打开 open code。 打开 open code 之后,这里我们就看到了这里有三个可用的 mcp, 然后我们还可以使用斜杠命令加 spdt 来查看这个状态,这里是 o m o 自带的三个 m c p, 然后这里还包含这三个插件。下面我们就可以在 open code 中使用相关命令加 connect 来登录我们的 cloud 的 账号,还有 chat gpt 的 账号,还有 jimmy 的 账号。我这里先登录 cloud 的 账号,我们直接按一下 enter 键, 然后选中第一项,使用我的订阅来登录,然后将它给出的链接复制,然后在浏览器中粘贴这个链接,并且点击验证,再复制这一串认证代码,然后回到 open code, 我 们粘贴刚才复制的内容。粘贴之后,我们这里就可以选择模型了,这里我就选择 op 四点五模型。 当这些都设置好之后,下面我们就可以用斜杠命令加 models 来查看一下我们刚才设置的这些模型。目前我添加了 cloud 官方的 op 四点五模型, 还有 china gpd 的 gpd 五点二模型,还有 jimmy 的 jimmy 三 pro 模型,这里还有默认的 minimax m 二点一模型。而且我们还可以用斜杠命令加 model 四命令来切换模型,比如说我将 opus 四点五模型切换成 gpd 五点二模型, 在这里我们还可以用 tab 键来切换计划模式和执行模式。下面我们可以先输入一个最简单的任务进行测试。我这里输入的是让它创建一个计划模式和执行模式。下面我们可以先输入的是让它创建一个最简单的任务进行测试。我这里输入的是让它创建一个最简单的任务进行 深色模式支持。而且这里我还输入了它给出的魔法咒语 u l w, 使用这个魔法咒语就可以实现释放 o m o 的 所有力量,它能实现起用并行智能体后台任务,还有深入探索。好,下面我们就执行看一下这个效果。 在这里它提示 auto work 这个模式已经激活。这里它生成了开发任务,这里正在执行,我们要稍等一下。 像这样的话,当我们输入 autocode 或者 u r w, 它就会检测到我们输入的这个关键词,然后由 c s f s 这个主 agent 分 析我们的意图,拆解我们的任务,然后创建任务,并且委托给其他 agent。 像这样的话,我们就相当于在 open code 中有一个专业的 agent 团队。 除了 ccs 这个主智能体之外,它还包含多个其他的智能体。我们可以看一下这个 oracle 智能体,它负责架构设计,还能修复复杂的 bug。 另一个 explorer 智能体,它用于代码库探索,还有模式发现,可以并行运行多个视例。 然后另一个智能体,它可以研究外部文档。还有这个用于图像和 pdf 分 析的智能体,它能够对多模态内容进行处理。 还有这个用于文档分析的智能体,它可以为项目生成 readme, 还有 api 文档。还有这一个用于前端设计的智能体,它主要用于 uiux 设计,而且它支持 lsp 工具,还支持搜索工具,还有 mcp, 还有后台任务等, 它能通过 hux 来监控整个系统,从而实现质量保证,还有上下文管理,还有恢复机制,像这样的话,用户就可以用这个魔法咒语来触发整个工作流。 好,可以看到整个任务流程不需要我们进行任何干预,完全是在 open code 中全自动去执行的。我们只需要在 open code 中设定好需要开发的任务, 在 open code 中就能全自动为我们完成开发。在等待了几分钟之后,这里他完成开发,这里给出了运行方式,然后我们就按照他给出的步骤运行一下,看一下效果。 下面我们就可以看一下它为我们开发的这个仪表盘,可以看到整体它采用了深色模式,因为我们在提示词中要求它使用深色模式,而且它给出的这些效果也都非常不错, 这里包含格式化的这些图标,而且鼠标悬停还有这些动态效果,这是我们测试的,让它为我们开发一个最简单的仪表盘的功能。 好,下面我们可以继续测试,我这里准备了一个用 swift 开发的原声 ios 的 专注应用,然后我们可以测试一下在 open code 中使用 o m o, 在 我们这个项目的基础上新增功能。好,下面我们先打开终端命令行, 我们用 cd 命令切换到我们这个项目路径,然后启动 open code。 启动之后我们先执行斜杠命令加 init, 让它来生成 agent 点 m d 文件, 他就能对我们当前这个项目的这些架构技术站有一定的了解。好,可以看到这里他正在扫描我们这个项目,在这里我们就可以看到他生成的这个执行任务,第一个任务已经执行完成,然后现在他正在执行第二个任务。 好,这里提示它已经为我们生成了 agent md 这个文件,下面我们看一下它生成的 agent md 文件,这里面包含项目预览,还有所用到的这些命令,还包含代码风格等内容,像这样的话它就对我们这个项目有了初步的了解。 然后我们就可以在 open code 中让它为我们新增一些功能,然后我们可以先用斜杠命令加 new 来新开一个 session, 这样的话它就清理了刚才的上下文,然后我们就可以输入提示词,在输入提示词之前,我先输入 alt work, 然后输入开发任务,我这里输入的是 让他为当前项目新增自定义专注时长的功能,要求下拉可以选择专注时长从一分钟到六十分钟,然后我们直接运行,让他为我们实现全自动开发这个功能。 在等待了几分钟之后,这个任务完成开发,下面我们可以看一下效果,在模拟器中打开住在这里我们就看到了他为我们新增的这个下拉的这个组建。我们点击下拉 这里我们就可以来选择专注的时长,从一分钟一直到六十分钟,这里我们都可以自己去自定义,我们可以先选择一个一分钟的测试一下,然后点击开始。好这里我们点击允许发送提示,这里正在计时。 好,这里完成了计时,然后这里出现了提示,他为我们新增了这个自定义专注时长的这个功能是完全没问题的, 而且整个开发过程不需要我们进行任何干预,我们只需要设置好开发任务,在 open code 中就能全自动为我们完成开发。我们就可以在 open code 中使用 o m o 这个开源的插件,用于更加复杂的开发场景,而且全程不需要我们去干预,完全由 c s face 这个智能体 进行指挥,委派任务还有验证,然后其他智能体就会执行 ciscis 委派的任务。在 open code 中我们就相当于有了一个真正的开发团队,这样就能大幅度提升我们的开发效率。

2033AI超元域 01:43查看AI文稿AI文稿

01:43查看AI文稿AI文稿兄弟们,如果你正在使用 open code, 那 这个插件一定得装上它彻底重构了 open code 的 工作流程,让你不再像玩回合制游戏一样和单个智能体一问一答编辑代码,而是直接拥有一支专业的开发团队,不同成员各司其职,互相协助,即便开发大工程也能轻松 hold 住。它本质是一个多模型多 agent 的 编排框架,它会往 open code 中集成十一个专家 agent。 例如 sisyphus 作为总指挥,负责任务分解、进度管理、协调其他成员。 prometheus 则是规划师,通过访谈式交互与你沟通深层详尽的执行计划。此外,还有专门负责架构设计、前后端研发、文档生成以及代码库探索的各类 agent, 使用时非常灵活。你在对话框中输入任务需求,总指挥 sisyphus 会自动规划分配给对应 agent。 你 也可以显示地 at 某个 agent 去完成特定工作。例如一种常见的用法,先让 prometheus 出一份详细计划,再让 atlus 照着计划去调度执行。 当然,你还可以同时艾特多个 agent, 让他们并行工作。如果嫌麻烦,他还提供了一种懒人模式,在对话框里简单说明任务,例如重构整个工程,然后输入 ultra work, 它会瞬间化身卷王,所有 agent 都会被启动,持续执行,不会偷懒,直到实现任务目标。 另外,它还有个很灵活的特性,你可以预先配置任务类型和模型的映涉关系。例如让 gpt 处理架构设计任务,让 kimi 处理写作任务。在执行阶段,指派的 agent 会根据任务类型加载对应模型,从而每个任务都会被适合它的模型处理。

1053小葱AI 18:12查看AI文稿AI文稿

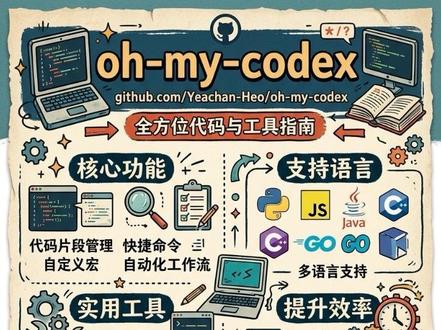

18:12查看AI文稿AI文稿open code 是 近期热度最高的 ai 编程工具,它的最大优势是有开箱即用的免费模型,通过简单配置,还能免费接入 gemine 三 pro、 cloud、 四点五、 opus 等顶级编程模型。 open code 可以 看作是一个开原版的 cloud code, 几乎具备了 cloud code 的 一切功能,而且对中国用户友好,不 会遇到 cloud code 里面限速、封号等一系列麻烦的事情。在 open code 里面有几个可以免费使用的主流模型,非常适合小白上手, ai 编程可以随便造随便玩,还可以用它练习 agent, skills, mcp, sub agent 等高级特性。本期视频是一个 open code 的 完整教程, 主要介绍 open code 的 四种形态,对比其他 ai 编程工具的亮点,还有我们要重点介绍欧买 open code 的 这个超强插件,还有等等的一系列高级用法。 open code 的 有四种形态,分别是命令行、桌面、客户端插件,最后是云端运行环境。我们先来看命令行,这里我准备用第二种方式,也就是 note j s 的 方式来安装。 我们先来到 note g s 的 首页,在这里根据自己的操作系统下载对应的安装包,把 note g s 安装一下。接下来我们复制 n p m 的 安装命令,我们打开一个终端窗口,把安装命令粘贴进来回车,这样就安装完成。输入命令, open code 就 可以直接启动了,进入这个页面打个招呼, 这样就完全配置成功了,非常简单。接下来我们来看客户端版的安装,在这个页面点击下载客户端,然后一路点击下一步完成安装。打开以后选择一个文件夹作为项目文件夹就可以直接开始使用了。 open code 的 客户端并不是一个完整的 ide, 它只有基础的对话框功能,而 而且目前处于贝塔测试版,我试用下来 bug 还是比较多的。所以本期视频我们主要还是以命令行版本为例进行操作。接下来我们来看插件版的安装。使用插件版的 open code 的 前提是需要先把命令行版的安装好,这里我以 vs code 为例,我们打开 vs code, 在 左侧的 extensions 搜索 open code, 然后我们找到这个 open code 插件,点击安装。安装好了以后,我们按快捷键 ctrl shift 加 p, 打开命令面板,敲这个命令, open open code 回车,这样就以插件的形式打开了 open code, 它可以自动关联左侧窗口打开的代码文件。然后我们还可以选中一些代码,点击快捷键, ctrl alt 加 k, 把这些代码直接快捷地粘贴到 open code 的 聊天窗口里面, 这就是插件的全部功能了。最后一个云端运行环境,我们放到视频的最后面再看 open code 最棒的是内置了一些免费的模型,我们敲命令来到软件进来以后,输入命令斜杠 models, 后面带 free 标记的都是一些可以免费使用的模型,特别是 g l m 四点七,还有下面的 mini max 二点一, 编程能力都非常的不错,零配置开箱即用,输入需求就可以直接编程了,很适合新手用它们来练习 ai 编程。接下来我要推荐一个插件叫 open code 的 anti gravity os。 anti gravity 是 谷歌推出的一个 ai 编程的 ide, 它里面十分慷慨地提供了 jimi、 nike 三 pro 还有 cloud opus 四点五这两个顶级的 ai 编程模型,我们可以借助这个插件把这两个顶级模型免费地接入 open code 里面使用,在它的 get up 首页有安装方式, 最简单的就是把这一句提示词复制下来,然后我们来到 open code 粘贴进来开始,这样 ai 就 能自动帮我们完成安装,这里耐心等待一会,这样插件就安装完成了。接下来我们复制这个命令,然后我们打开一个新的命令行窗口,执行这个登录命令。 这里的模型供应商选择谷歌,选这个 anti gravity 的 登录方式 project id, 这里直接回车,这里登录一下自己的谷歌账户, 点击登录,然后把生成的这个 u r l 粘贴进命令行回车,选择 n 回车,这样就配置完成了。我们重启一下 open code 的 斜杠 models, 在 模型选择里面我们就可以选到 jimmy nine 三 pro 还有 cloud opus。 四点五这样打个招呼成功给到了输出就配置完成了。接下来我们把另外一个好用的编程模型 gbt code 也接入到 open code 的 里面。就在前几天, open a i 跟 open code 的 官宣进行了合作, 我们可以直接在 open code 里面使用 chad gpt codex 的 编程套餐。首先我们需要在 chad gpt 的 官网获取一个至少是 plus 以上级别的套餐,在这期视频里面详细的介绍了订阅方法。我们来到 open code 输入这个命令斜杠 connect 回车,这里选到 open ai, 选择 gbt pro, 在 浏览器里打开这个链接,选择继续,这样就登录完成了。然后我们回到 open code 输入命令斜杠 models, 这样就可以选到 chat gbt 的 几个模型了,除了上面这几种接入 ai 的 方式,输入斜杠 connect 命令,可以查找到七十五种 ai 的 接入方式, 几乎囊括了所有的模型供应商。比如我们可以找到 open root, 这里需要我们填写一个 open root 的 api key, 我 们来到 open root 的 官网,点击 get api key 创建一个, 把这个可以复制一下,填写到 open code 的 里面,回车一个 open root 就 能接入市面上几乎所有类型的大模型,而且国内用户也可以很方便的获取额度,可以说我们只要接入了 open root, 就 可以使用几乎一切的大模型。 我找了一个之前常用的经典测试案例来测试一下这里 open code 的 表现有几个亮点。首先在开始之前,他会反向询问我一些问题,比如说只是要代码样例,还是一个完整可以运行的程序,有哪些功能是必须实现的,调用哪个 jimmy 模型,然后环境变量是怎么保存的, 在动手之前他会把所有的需求细节询问清楚,这点非常的不错。然后他列出了一个详细的开发计划,并且分步骤完成,每完成一步都会标记出完成。 第二个亮点就是命令行版的代码比对界面,我觉得是所有命令行类的编程工具里面做的最好的,整个编程过程没有出现错误,也没有出现过需要代码返工的场景,一次性就完成了这个需求的开发。这里我使用的编程模型是 gpt 五点二 codex, 我是通过登录我的 chat gbt plus 订阅的账号把 codex 模型接入进来的,我觉得它在 open code 里面的表现跟使用原生的 codex c l i 的 表现几乎是一致的。 open code 在 底层对各种编程模型都进行了很多工程上的优化,还是很不错的。 喷扣的里面重点突出了一个叫做 session 的 概念。我们每次跟 ai 开启的一个新的对话,就是一个全新的 session, session 可以 后台运行,而且可以多个 session 并行运行,比如这是我们刚才生成的你画我猜的游戏网站,这里我想增加两个功能, 首先我想让画笔可以调整颜色。第二个功能我想增加一个计时器,如果作画超过二十秒,游戏就失败了。我们先输入第一个需求,增加一个计时器,在第一次落笔的时候进行计时,如果超过二十秒,游戏就失败了。开始 在这个任务的执行过程中,我们可以输入 new 命令,创建一个新的 section, 然后开始我们的第二个需求,第二个需求是画笔可以调节颜色。我们输入命令斜杠 sections, 就可以看到我们触发的 session 前面一个打转的符号,表示它正在后台运行。这样我们就创建了两个 session, 让两个需求并行开发,还可以在两个 session 之间互相切换,查看它们的执行状态。好,这样就完成了, 我们可以调整画笔颜色,然后我们开始作画的时候,右上角也出现了一个倒计时,我们成功利用了 session 功能,并行地完成了两个需求的开发。输入斜杠 share 命令, 可以把这个 session 的 对话记录分享成一个网页,网页的地址已经复制进了粘贴版,我们把地址粘贴进浏览器, 就可以看到这个 session 里面跟 ai 的 对话记录,包括它是怎么进行文件修改的?有了这个历史记录以后,我们就可以很方便的把我们的编程过程跟其他的用户进行分享。输入命令 on share 就 可以取消分享, 之前的链接也就变得不可用了。输入命令斜杠 export 就 可以把对话记录导出成一个文件。刚才我又进行了两次对话,先让它把画笔默认改成红色,然后把这个提示删除。 open code 还有一个亮点功能,就是它的时间线,或者说是检查点。我们输入命令斜杠 time line 回车可以看到这个 session 里面的跟 ai 的 对话记录,我们可以选择任意一次的对话记录,选择这个 reward 功能, 把代码跟聊天内容一起回退到这次对话之前的状态,我们可以回到这个时间点再重新进行修改。 在上期视频里面,我们介绍了 agent skills 的 基础概念以及其目录结构,我们可以把 skill 理解成带目录的说明书。每个文件夹都对应一个 skill, 也就是一个技能包。 把一个 cloud code 中的 skill 迁移到 open code 里面非常的简单,我们只需要把目录里面的点 cloud 替换成点 open code 就 可以了。 在上期视频里面,我们一共创建了三个 skills 文件夹,把这三个 skills 迁移到 opencode 里面也非常的简单。我们来到 opencode 的 项目文件夹,新建一个叫做点 opencode 的 文件夹, 进来以后再新建一个 skills 文件夹,然后就可以把这三个技能直接复制进来,这样我们的项目就拥有了那三个技能。我们右键在终端打开,输入 opencode, 启动起来。我问他你有哪些 skills? 这里给出了完整回答,当我们有需要的时候,它就会调用这些 skills 进行工作。接下来我们来看 m c p。 的 配置方法。 open code 里面有两种 m c p, 我 们在文档里面可以找到一个是 local 的 方式, 也就是通过本地命令来执行。还有一个 remote 的 方式,也就是远程调用。我们先以这个 set cn 为例来把它配置一下。我们先来到 open code 的 配置文件夹,用户你的用户名 点 configure, 然后 open code 找到这个配置文件。 open code 点 jason, 来到文档站,这里把 m c p 的 这一段复制一下,粘贴过来。我先把这些多余的逗号去掉,这里填写上 m c p 的 名字,这里我就叫做 set c n 类型的话是本地,然 然后 command 这里填写命令 n p x, 后面是 shift c n, 把这一段复制过来。最后这里还有一个 m c p, 我 们打个逗号,添加上 enable, 表示启动下面没有环境变量,这样一个本地的 m c p 就 配置完成了。接下来我们再看一个远程调用的案例, 我们就以这个 context 七 m c p server 为例。我们回到 opencode 的 文档站,在下面找到这个远程调用的案例,把这一段复制一下,打个逗号,粘贴到配置文件里面来。这里类型是 remote 远程调用 url, 我 们把 context 七的 url 复制一下,粘贴过来。 在 hide 里面我们填上 context 七的这一串粘贴过来,这里它需要一个 apikey, 我 们可以来到 context 七的官网创建 apikey, 把这个可以复制一下,填写到配置文件里面, 把这个 m c p 的 名字改成 contact。 四七,我们重启一下 open code, 输入命令斜线 m c p, 就 可以看到我们刚才配置的两个 m c p, 这就是本地,还有远程调用两种 m c p 的 配置方式。 oh my open code 是 open code 上一个最火的编程插件,它本质上就是一系列的工具加 m c p 加编程 agent 的 组合捆绑包。比如在工具方面,它集成了 l s p 高级版,可以通过编程语言的语法和语义,帮助 ai 快 速理解和定位代码。 a s t 工具可以通过代码的语法术进行关联搜索。 open 工具借助多模态大模型的视觉能力,帮助理解图片还有 pdf 等信息,还有像 delegate task, background task 这些 agent 任务分配和后台调度工具。插件还内置了三个 mcp server web search 用于网络搜索, context 用于获取最新的文档。 group app 用来在 github 仓库快速搜索代码。 插件还内置了七大编程智能体,分别是希奇福斯,它是主智能体,用来规划和调度任务,先知用来做架构设计、代码评审等等。图书管理员用来查阅文献,探索者用来进行网络搜索。还有前端工程师、 文档编辑者,还有多模态等等。插件给每个智能体都分配了一个最适合他工作的大模型,比如前端工程师使用前端能力最强的 jimmy 三 pro 模型,主 agent 使用的是 cloud opus 四点五,据说这是作者花了两万四千美元的 token, 找到最适合的 ai 编程团队。 好,我们把这个插件安装一下,在它的 github 首页,这里有一段提示词,就是 install 开头的这一段,我们把它整个复制下来,我们回到 open code, 把这段提示词粘贴过来。开始安装的时候,插件会询问我几个问题, 他先问我有没有可洛的订阅,这个我是没有的,我有 gbt plus 订阅,用 gbt 去替代可洛的模型,然后问我有没有拆的 gbt 订阅,这里我选择 yes jimmy 订阅,有, 最后选择确认。过了一会,插件成功完成了安装。安装完成以后,我们来到 c 盘用户你的用户名点 config, 然后 open code 的 这个文件夹,在这里面有一个欧买 open code 的 配置文件,这里定义的是欧买 open code 的 七大智能体所用的模型,我们可以根据自己的需要来进行调节。 这里我把希希福斯的模型换成 g b t 五点二,剩下几个的模型都是作者的推荐配置了。然后我们重启一下 open code 的, 我们进来以后看到它显示的默认智能体就是希希福斯。 这个插件主要有几种用法,首先我们可以敲 at, 然后挑选一个智能体给我们干活。还有一个用法就是输入这个魔法词 u l w, 也就是 ultra work。 输入这个魔法词以后,不买 open code 就 会尽可能地调用它的一切潜能,把任务分配给几个智能体,并且并行运行, 由这个主智能体西西福斯进行居中调度。这里他询问我要什么样的网页,我们大体填一下需求,然后开始 我们看到他把任务拆分成了一个 to do list, 然后同时开启了三个后台任务并行执行,然后他对这些后台任务进行疯狂的调度。我们耐心的等待一会,等了几分钟, auto work 模式运行完毕,我们来启动起来看一下效果。一个宠物商店的应用看起来还真是不错, 界面看起来就很清新,它在没有图片素材的情况下,还尽量地用 emoji 给我们配了一些图,整个网站的交互还有动画逻辑看起来都是不错的。如果你有 gbt、 cloud 等几个顶尖模型的订阅,不妨来试一试。这个插件可以综合地调度各个领域最强的模型,完成一个很不错的编程任务。 购买 open 扣的还有一个重要玩法就是我们输入这个命令斜杠 raf 路虎就是拉尔夫循环,这个模式可以强制 ai 长时间的循环,对一个非常难的任务进行持续工作。 比如我可以要求它使用 springboard 四的最新标准重构整个项目,然后直到所有的测试用力都通过,它可以循环连续运行好几个小时,直到最终的任务完成。 刚才我们介绍了命令行、桌面板还有插件等运行环境。接下来我们看云端运行环境,这里我以 github 举例, 它的主要功能是当我们在 github 上面输入斜杠 open code, open code 就 可以在 github 云端进行工作,比如可以为我们解释问题,自动修复问题,并且创建 pr 等等。这里有一个安装方式,我们来试一下。首先第一步,先把项目上传到 github 上面, 这里还是刚才那个宠物商店的应用,点击这里的 south control public 是 branch, 这里我选择 public, 把这个项目变成一个 gitap 上面的公开仓库,点击右下角的 open on gitap, 这样我们的代码就成功上传过来了。接下来我们来到代码文件夹,把这个安装命令复制一下,粘贴过来执行。点击 install, 选择一个模型替工商,这里只能用 api 选择一个模型。然后还有两步需要操作,首先要把项目里这个文件提交到 gitap 上面,它已经准备好了这个配置文件, 我们先把它提交上去,接下来它需要把这两个环境变量填到项目里面,我们来到项目的 sightings, 然后下面的 secret and variables 这里找到 actions, 在 这里的 repository secrets, 我 们把第一个 key 的 名字复制一下,粘贴过来,对应的密钥可以在谷歌的 as studio 创建一个,这样填写过来保存。 接下来第二个 key 复制过来,还是填写相同的密钥,这样填写好了两个密钥。比如某个用户可能会在一处里提一个 bug, 说顶部导航栏 find ipad 跟 adopt null 功能重复, 应该去掉这个 find ipad 就是 这两个功能重复。在这个项目里面就可以直接斜杠 open code, 调出 open code 的 功能, 让 opencode 把这个 bug 修复一下,我们提交这个评论。然后我们来到项目的 actions 里面,可以看到这里有一个 action 就 正在执行了,这个就是 opencode 的 工作流,它现在正在 gitlab 的 云端运行,帮我们来修复这个问题。任务运行完成,我们来到 pullrequest 这里 就可以看到一个代码合并请求。在 file changes 这里可以看到它对代码成功进行了修改,我们只需要点击这个默认设置按钮,就把 open code 这次修改合并到了我们的代码仓库,这样这个一束就成功完成,并且关闭了。 接下来我们再介绍 open code 的 几个其他的重要功能,这些功能其实在之前的 cloud code 还有 codex 的 视频里面已经进行过介绍了,这里我们再快速的过一下。 首先第一个命令斜杠 inate, 这个命令可以让 ai 通读整个项目文件夹,然后把它学到的关于整个项目的知识生成一个 agents 点 m d 文件,这个文件就作为整个项目的系统提示词,可以帮助 ai 快 速地了解项目下一个重要命令。斜杠 compact 用来压缩之前对话的上下文,把之前的对话提炼成一个简洁的摘药来释放模型的上下文窗口。除了这些内置的斜线命令以外,我们也可以创建自己的命令。我们来到 opencode 的 配置文件夹,在这里面可以新建一个 com 的 文件夹,在 这里面就可以以 markdown 文件的形式来定义自定义命令。比如这里我创建一个自定义命令,叫做运行测试,我把官网上这一段样例复制过来粘贴进来,我们可以指定它是 build 或者 play 模式下面的命令,在下面的描述里面写清楚这个命令是做什么用的。 配置完自定义命令,我们可以在 open code 里面斜线,然后是命令的名字,这样就可以运行我们的自定义命令。下一个功能可以定制智能体, opencode 里面预设了 plan 跟 build 两种智能体,我们也可以创建新的。我们来到 opencode 的 配置文件夹,在这里面可以新建一个 agent 文件夹,比如这里我想新建一个 code review 的 智能体,让我新建一个 markdown 文件,在这个智能体的文件里面填上描述类型,它是一个主智能体还是 sub agent? sub agent 的 意思就是它可以由主智能体调度在后台执行,然后填上一个模型,后面是它的描述,就是这个智能体主要做什么事情。 定义好了以后,如果以后 ai 可能需要 review 代码的时候,它就会自动调用起这个 sub agent, 并且在后台运行,帮我们自动完成工作。 我们除了可以把一个智能体定义为 sub agent, 也可以定义为 primary, 也就是主智能体。定义成主智能体以后,我们可以按 tab 键直接显示地切换到这个智能体进行工作,而 sub agent 只能在后台由 ai 自动调度执行。好,这就是本期视频的全部内容了,感谢大家点赞支持,我们下期再见!

4.4万技术爬爬虾 04:37查看AI文稿AI文稿

04:37查看AI文稿AI文稿之前讲 superpowers, 看到很多兄弟们提到了另一个 oh my open code 之后简称 o m o。 于是我马不停蹄给大家伙安排上本期视频,从部署到实测,一条龙服务,总共三个案例,最后再总结下两者的区别,顺手点个收藏关注赞我们发车。 首先打开官网复制这里的安装命令,注意要去 l l m 代理进行粘贴。我依旧选择 open code, 可以 看到先要配置大模型,通通先选到,当然可以按照你订阅的情况先配置好。 我在这里因为 note 版本适配的问题切出去了一次,可以看到 open code 做了优化,它这里明确提示如何回到之前的筛选,从而继续之前的操作。然后我这边选用官网的推荐方式 box 进行安装, 复制这个命令,回到之前的上下文,然后切换到 note。 二十二、看到他通过 npm 局安装棒,然后再来安装 omo, 过程很顺利,最后他是通过查询 obo 的 点节省文件来验证安装结果, 能看到里面多了一个 omo 的 插件配置项。最后就是新手村的介绍环节了, 先象征性的祝贺一下,接下来也就是新手提示,当然也是我们之后需要测评的点,一、使用魔法 auto work, 二、 a 阶的团队。三、项目特性,像 lsp a s t 工具,强制闭环,还有精选 m c p 这些 还在看的兄弟弹幕冒个泡,咱们继续测 o m o 的 核心功能。我们先看第一个案例,需求很简单, 我们主要讲前缀 archwork, the magic word, archwork 也可以简写 u l w, 这是 o m o。 的 灵魂,可以说有了它才会激活 c c fors 核心管家的能力,它会调度所有智能体,让它们各司其职, 而且有关 o m o 的 特性,比如任务强制闭环, m c p 能力都得靠它来启动。所以在我的理解里,前面用上了 o m o, 我 们才开始真正用上了 o m o。 好 的,等我介绍完了, o m o 的 核心能力,就是一个土豆里斯的,然后按顺序执行就好了。 于是我就来点狠的问他为什么多 agent 没用呀, talking 也没消耗呀这些等等的问题,他谄媚的和我说他错了,接下来告诉我他应该怎么做,然后分析为什么会出现这样的情况等等,真的是有理有据,巧舌如簧。 当下我只有一个想法,再测试一下更复杂的任务试试,顺便验证我各方面的配置没有问题。 那我们就提一个更复杂的需求,别忘了最前面的 u l w 这次很快就体现出了多智能体团队,此时我双眼放光,静候佳音,过程中也还是 to do list, 然后写一个一个的文件,让我们直接来看最后的结果。 其实前面的需求细心的小伙伴应该发现了,我都有提到文档官网之类,目的就是为了让它自动触发 config 七 m c p 的 能力, 但试了两次都没成功,我也尝试排查原因,修改相关的配置项,一直无果。最终我还是选择最稳妥的方式, 提示词中添加 use context 七来显示的调用。还好,结果还是令我满意的,他前面先调用了 exa, 后面又触发了 context 七,这部分测试也顺利完成了。最后我们也来看下结果, ok, 从部署到实测,我们完整走了一遍下来,最后我们再来简短的总结一下 o m o 和 superpowers 之间的区别吧。从我们的测试流程不难看出, o m o 偏向于多智能体的协助执行任务,而 superpowers 更偏向于代码的健壮性,靠 t d d 等一系列 skills 让开发流程更加的规范,从根源上避免死删代码。关注我,带你解锁更多好用好玩的!

1098沈code 04:24查看AI文稿AI文稿

04:24查看AI文稿AI文稿今天给大家分享一个我最近使用的非常爽的一个编程工具叫 open code, 以及一个非常厉害的插件 o my open code, 它可以大幅提升我们的编程效率 以及出来的一个效果又快又好。那首先介绍一下这两个东西到底是什么? 我之前拍过一个视频,对比了一下 codex、 cloud code 和 gemini, 我是 开了三个窗口,让他们去完成同一件任务。那你可以理解, open code 就是 在一个窗口之下,你可以保持上下文的连贯的情况下切换模型去使用, 算是一个 open one 的 一个工具,那它这里面集成了有七十五家的模型提供商,几乎你能见到的都在里面了,而且你可以接入你付费的模型,还可以用它的免费模型,比如说像智普的模型都是免费的在里面。那这是 open code, 它解决了我们多个模型之间来回切换的问题,以及工具的一个使用的习惯统一的一个问题。第二个欧曼 open code 就是 在它上面的一个插件,它的强大之处在于它的这种运行的模式,它有一个主控和专家团队, 主控就相当于是一个大脑,他接到你这个任务之后,把一个大任务拆成小任务那一个网站,比如说有前端有后端, 还得去找各种各样的文档材料,还要去便利你现在的代码,来理解你的项目结构等等,他会把这些交给最擅长的模型去做, 这个就非常厉害了。那以前我们只能什么?就像我之前开多个窗口,比如说要做 u i 了,我让界面来去做,要做架构设计了, 或者写后端了,我让 code x 去做,这就很麻烦,但是他把这个事帮你在背后全部做完了,你只需要告诉他我要做什么,就是这么厉害。那我们来看一下,简单看一下他的主控叫西西弗斯,他的专家系统,比如说像专门去查代码库的, 专门找外部文档的,专门做架构的,专门做 ui 的 前端开发的,他会把他们分配给不同的模型去做,这我觉得就是欧麦 opencode 对 我们真正使用的时候最强大的一点。 那我们快速看一下它的界面长什么样,中间这一块就是这个 opencode, 首先它可以切换模型,大家看一下 codex cloud 智谱,还有这个加密奶都可以切换,非常的方便。另外如果说 你还想去接入其他的模型,比如说你买了某一个模型提供商的模型,那你在这里直接做一个单点登录的认证就可以了,非常方便。我这里已经连接了四个了, 所以他在分配子任务的时候,他也只会分配给那些可用的模型,所以你在使用的时候得先把你这些模型都接进来。接下来你就很简单了,就跟他聊就行了,让他干什么活,他就自动帮你分配了。 那我个人使用下来最大的感受就是很省心,它会用到一些 cloud 里面,算是很高阶的这种使用,比如说 sub agent 子代理 或者 m c p 调用等等。打个比方,以前经常会用这个 context seven 这个 m c p 去查文档,那这里它自动会帮你调用。并且 open code 它是以这种 cloud 的 运行方式去运行的,所以 skills 在 这里面原声都是支持的,非常的方便。比如说您看 直接一个下划线,所有的 skill 都会列出来。好,怎么安装?那就很简单了,跑到它的官网去,这里会告诉你怎么安装。先把 open code 的 安装好,接下来在 open code 的 命令行当中, 自然语言告诉他,帮我安装好欧麦 open code 的 插件,一切就 ok 了,就这么简单,接下来就跟他聊天干活就可以了。好,那大家可以 去安装试一试,有什么问题我们在评论区见,希望大家用的很爽,效率、质量层层的往上升。

1199自说自话的江哥 04:39查看AI文稿AI文稿

04:39查看AI文稿AI文稿你是不是也觉得 open code 用起啊,总有点手手脚,感觉被限制了?别急,今天咱们就来聊聊怎么一键给它解开封印,让你的编程体验直接起飞。 对,你没听错,就一条命令,真的就能把普通通的 open code 变成一个超强的编程神器,怎么样?是不是有点小激动?那我们马上开始吧!好,那这个神奇的办法到底是个啥呢?答案就是, oh my open code! 我 们来好好看看它是什么? 这么说吧,欧买 open code 啊,它就像一个超级工具包,灵感来自那个很有名的欧买 zs h, 里面不仅有一大堆现成的工具,最厉害的也是它最核心的东西就是内置了所谓的 cisforce agents, 你 可以把它想象成一个嗯,一个能帮你自动干活的智能小队。有了它们,你的 open code 就 立马升级成了智能编程,就售 行,废话不多说,咱们先来看看最快最简单的办法, online 安装,只要你的电脑能上网啊,用这个方法准没错,绝对是首选。 这个方法说实话啊,简单到有点夸张,你连终端都不用开,你就直接复制屏幕上这句提示词,然后把它丢到 open code 的 输入框里,敲个回车,接下来你就看戏就行了,它会自己搞定所有的安重和配置,简直跟变魔术一样。 当然了,我知道有些朋友就喜欢自己动手,那种一切尽在掌握的感觉对吗?没问题,我们也准备了命令航班方案 很简单,打开你的终端,输入这行命令,它会用 n x 这个工具来运行安装脚本。最后的效果啊,跟刚才那个方法是完全一样的,唯一的区别就是,这次是你亲手敲响回车启动了。这一切 好,我们都知道,在线安装虽好,但也不是万能的,比如说你工作的环境是内网,根本连不上外网,或者说你想自己改改原码,搞点深度定制,那这个时候离线安装就派上用场了。 离线安装其实也不复杂,咱们可以把它分成两步走,第一步先构建出插件文件。第二步呢,就是去配置 open call, 让他认识我们这个插件。 首先你得找一台能上网的电脑,然后呢,就按顺序执行这几条命令。第一条, git clone 是 把最新的代码从 githop 上拉下来, 然后 cd 进去,帮 install 安装所有需要的东西,最后帮 run build, 铛铛一键打包,我们需要的那个插件文件就生成了。 好啦,构建跑完之后啊,你会在 disk 文件里找到一个叫 index 点 js 的 文件,记住,这个文件它就是 omacoord 的 本质,是咱们下一步配置的关键。现在你需要做的就是把这个文件拷贝到你那台不能上网的目标电脑上。 ok, 文件已经拷贝过去了,现在就剩下最后临门一脚了。我们要做的就是告诉那台电脑上的 open code, hey, 你 的新插件在这里,快去加载它。具体怎么做呢?找到 open code 的 配置文件,就是那个叫 open code jason 的 文件, 打开它,加上一个 plugin 字段,就像屏幕上这样。这里有两个地方你可千万要注意了,非常关键。第一,这个路径必须是绝对路径,不能是相对路径。第二,你看路径的开头必须是 file 斜杠,斜杠这个格式。 哎,说到这儿,如果你是 windows 用户,请一定一定停一下,听我说完。因为在配置路径这里呀,有个特别容易踩的坑,我先跟你说了,保证你能省下不少挠头儿的时间。 问题出在哪儿呢?你看 windows 里的文件路径,它默认用的是反斜杠,就是斜杠方向在左边这个, 但是在 open code to json 这个配置文件里,它不认。你必须手动把所有的反斜杠都换成正斜杠,斜杠方向在右边,你看屏幕上的对比,左边是错的,右边才是对的。别小看这个细节,它直接决定你配置能不能成功。 好了,到这里,所有的安装步骤就都完成了。恭喜你,现在的 open code 已经可以说是脱胎换骨,战斗力爆表了。 那么接下来真正的问题就交给你了,有了这么强大的新工具,你最想用它来创造点什么呢?

28忘记 02:49查看AI文稿AI文稿

02:49查看AI文稿AI文稿今天给大家分享另外一个在 open code 上面的一个插件,上次我分享过欧麦 open code, 下面就有朋友说特别的烧 token, 我 用下来确实也如此。当然除了烧 token 之外,我还遇到另外一个问题,就是因为它会有多个 agent, 但是每一个 agent, 比如说负责后端的,它完全是让这个插件自主的去选择,你自己没有办法指定。 这对我来说是一个问题,因为我在用前端,使用这个 gemini 三 pro 的 时候,我发现它非常慢,所以我不想用它再去写前端,我想把它换成 cloud, 但是我换不了,你只要用这个插件,反正我是没有找到方法去换的, 如果大家有找到的可以告诉我。那针对这两个问题,我就去找了一下,发现还有这么一个插件,它其实是 fork 的 这个 omepin code 的 这个代码 叫 omepin code slim, 就 它完美的解决了这两个问题。第一,它没有那么消耗 token, 另外它可以指定多个 agent, 它们各自用什么模型,这个自由度就非常大了。 那其实它的这个就是多个 agent, 跟那个欧曼 open code 其实差不多,我就不赘述了,我们看一下它这里的描述,你看它可以在这个配置文件下去指定模型到 agent。 那我给大家看一下怎么使用,我们还是到 ide 里面,我还是用的 anti gravity。 那 使用界面其实差不多啊,唯一不同的地方,其实在这里我们看一下它的使用界面,随便看一下,在这里其实都差不多好。 不同的是在这里就是我们来到配置文件的地方,就在我们的用户目录下面的 ctrl 点, ctrl 下面的 open code, 这个文件夹下面有一个叫 oh my open code gong slim 的 这么一个 json 文件。我们来看一下,大家看到在这里它有一个配置各个 agent 的 地方,那这里很好用。首先你可以配置 model, 用哪个模型,用什么 它用哪些 skills, 用哪些 m c p, 比如说这是查文档的,那这里面就有 context seven 前端的它默认配了一个 agent browser, 那 我自己又把 front end design 也加进去了, 所以它不仅可以指定模型,它还可以指定模型用哪些 skill, 用哪些 m c p, 以及它们的思考深度。所以这个我觉得 还挺好用的,大家可以去试一试。如果说你觉得欧麦 opencode 的 插件太消耗 token 了,而且没有办法指定 agent 用什么模型,那这个就可以完美的解决你的问题。

79自说自话的江哥 08:54查看AI文稿AI文稿

08:54查看AI文稿AI文稿如果你是个程序员,那你一定知道 oh my stash 是 怎么让 shell 的 体验脱胎换骨的。今天要讲的 oh my op in code 在 ai 编程领域扮演的就是这个角色。简单直接点说,它不是个简单的插件, 而是一套把 open code 武装到牙齿的深度编排框架。它彻底解决了 ai 写代码单兵作战的痛点,直接把你的开发环境升级成了多特工协同的团队模式, 也就是让 gpt 搞架构,可捞的查文档、解密、写代码,各司其职。不过在开始拆解之前, 我得先泼盆冷水。这套方案非常硬核,涉及多模型编排和复杂的配置。如果你还没怎么玩过 open code, 或者对 ai 编程完全是零基础,建议先去翻翻我往期的基础教程,基础打牢了再来看这个,否则很容易被劝退。 opencode 的 原身体验最大的问题是什么?我觉得不是能力不够,而是心累。如果你不加任何配置,他就像是给你配了一个光杆司令,确实能写,但只能串行工作。最典型的场景就是代码写到一半,碰到个生僻的库,他不知道 api 怎么调,甚至开始瞎编。 这时候你必须强行停下来切出去查文档,查到了再复制粘贴位给他,告诉他用这个新写法。 这种平凡的上下文切换,实际上是把最耗时的脏活累活又扔回给了人。结果就是,你不是在写代码,你是在当 ai 的 保姆,不仅效率低,思路还容易被打断。那 oh my king code 是 怎么解决这个问题的?他的核心逻辑只有一句话,专业的人干专业的事。 他引入了一个编排器的概念,你可以把他理解为一个技术主管,当你下达任务后,这个主管不会自己闷头干, 而是直接把任务拆解分发下去。需要查新框架的文档,扔给擅长阅读长文本的 clot, 让他在后台慢慢读,需要扫描整个代码库,扔给专门的搜索 agent。 最关键的是,这些都在后台并行处理,完全不堵塞主线程。等他们把资料搜集齐了,主模型的上下文理就已经有了最精准的信息。这时候再动手写代码,准确率完全不是一个量级的。 整个 omgkin code 的 核心,一个叫西西福斯的编排 agent, 默认配置下,他跑在 cloud ops 四点五上。你要搞清楚,他的定位不是普通的马农,而是技术主管。 当你丢给他一个需求时,他绝不会马上打开编辑器开始狂敲代码。他的工作是先动脑子拆解需求,规划路径,然后像派单一样,把具体的活分发给手下最擅长的人去干, 他只负责指挥和最后的验收,这才是高级 agent 该有的样子。希奇福斯手下有两员大将,负责具体的代码产出。第一个是代号 oracle 的 架构师,用的是 gpt。 五点二,这哥们逻辑推理能力最强, 专门解决硬骨头,比如代码陷入死循环了,或者需要做高层的架构决策,西西弗斯就会把它叫出来救火。第二个是前端专家,用的是 gemine 三 pro, 为什么选 gemine 呢?因为它上下文窗口够长, 而且在创意生成上表现更好。凡是涉及 ui 界面、交互逻辑或者大端的前端样式,全部交给他。一个负责逻辑,一个负责脸面,这就是模型层面的各司其职。除了写代码的,还有两个专门搞情报的 agent, 这才是解决 ai 幻觉的关键。一个是 librarian 文档管理员,他专门负责翻阅官方文档和查找开源实线。比如你用了一个刚发布的新库, 他会先去把文档啃明白,而不是靠猜。另一个是 explore, 你 可以把它看作一个人肉雷达,它会利用 contextual graph 技术极速扫描你的整个代码库, 找出相关的代码片段。最爽的是,这两个家伙是在后台病情工作的希希弗斯在规划任务的时候,他们就已经把资料准备好了。我们把这些角色串起来,看一个实际场景。假设你要重构一段老代码, 并给他加个新的 dashboard 界面,当你敲下 ultra walk 指令,希希福斯启动,他会立刻派 explore 去扫描老代码的逻辑, 同时派 library 去查新 y 框架的文档。这两件事在后台瞬间完成。拿到情报后,他把上下文喂给 fronten 专家,让他开始写界面。假设中间翻译报错了,或者逻辑写歪了,希希福斯根本不需要你介入,他会直接把错误日期丢给 oracle, 让这个老架构师给出修复方案。这就是一个完整的自动化的团队写作闭环。市面上大多数 ai 编程工具有个致命弱点就是瞎。在他们眼里, 代码和写小说没什么区别,本质上都是一堆字母串。他们所谓的写代码,其实是在做文本补全,根本不知道这个变量在哪里定义过, 也不知道这个函数被谁调用了。这就是为什么 ai 经常一本正经的胡说八道,而 my open code 最大的技术突破就是给 agent 装上了 lsp, 也就是语言服务器协议 这东西就是 vs code 的 这种 ide 能够智能提示的核心。加上这个之后, agent 就 不再是盲写了,它能真正看见代码的结构, 拥有了和人类程序员一样的语义感知能力,这是从猜代码到懂代码的质变。有了这双眼睛, agent 具体能干什么?首先是不再靠猜, 以前 ai 找代码是根据文件名瞎翻,现在他可以用勾头 definition 瞬间跳转到定义处,或者查找所有引用。其次是能看到报错红线,不用等运行,在写的时候, diagnostics 就 能告诉他哪里语法错了。最重要的是重构能力, 大家都有过用查找替换改变良民导致误伤的经历吧? edison 现在可以用 elsepool rename 基于羽翼进行项目集成命名,绝对安全。另外,它还集成了一个大杀器,叫 a s t g rap, 这是基于抽象语法术的搜索,不管你的代码格式怎么换行嵌套,它都能精准定位模式, 这比脆弱的正则表达式强太多了,这才是真正的工程化能力。聊完了工具,我们来聊聊人性。不对,是 ai 的 惰性。大家用 ai 写代码,最烦的一点 就是他经常写一半停了或者改了文件 a 却忘了文件 b。 针对这种烂尾行为, oh my open code 寄出了一个大杀器,叫拉尔夫循环,也就是 ralph loop。 这个机制非常霸道,它在系统层面上规定,只要 agent 的 输出里没出现承诺完成这个特定标签, 系统就默认任务没干完。不管 agent 是 想偷懒还是逻辑卡壳系统都会直接把它提回工作状态,强制它继续续写。这种自参照的闭环逻辑,就是要把 ai 所谓的自觉性变成系统的硬性约束, 不把活干到百分之百,它就别想下班。除了强制续跑,这套框架还给 agent 带了两道紧箍咒。 第一道是代办列表强制执行, agent 必须自己维护一个代办清单,如果最后还有哪怕一个项没勾掉,系统就会判定它任务失败,直接打回去重做。第二道紧箍咒我个人非常喜欢, 就是注示检查器。咱们都知道 ai 特别喜欢写那种废话注示,比如再定义一个变量,后面写个这是个变量。在 oh my encode 里, 这种垃圾注视会被直接拦截, agent 必须证明这段注视是有价值的,否则系统会直接把它干掉。这种对代码洁癖的坚持,才能确保 ai 吐出来的不是一堆电子垃圾,而是真正能进生产库的工业级代码。 如果你之前是 cloud code 的 老玩家,完全不用担心之前的配置废了。这个项目专门做了一层兼容层, 你之前调友好的设置,点 jason 钩子,配置好的点 m k, 点 jason 服务器,甚至是自定义的 markdown 扩展指令,它全都能直接读取。这也就意味着,你不需要重新造轮子, 就能直接把之前的资产带进这个多模型编排的新战场。怎么装?一句话,别去翻那些复杂的文档了,直接在终端跑。这行棒插命令,只要你有那几家主流大模型的订阅,它就会自动检测, 并帮你把对应的 a 证专家分配好。参数里的杠杠 no 杠去 y, 就是 为了让你跳过那些没用的交互界面, 实现真正的静默安装,一步到位。最后分享一个作者预留的懒人魔法词叫 ultra work, 缩写就是 u l w。 平时你根本不需要去记那些复杂的指令,只要在你的需求后面加上这三个字母, 机器浮丝就会自动接管一切。他会自己去扫盘,去翻文档,去调 lsp 接口,直到把你所有的代办事项全部清空,并保证代码能跑通。 这个项目不只是个工具,它其实是把 ai 编程的最佳实践固化成了一套全自动流水线。感兴趣的可以去马云或者 github 上搜一下这个项目。

911AI赚钱研究社 05:11查看AI文稿AI文稿

05:11查看AI文稿AI文稿ai 时代,内容创作者输出的不再只是文章和视频,还应该包括 agent。 我 认为 agent 就是 新内容, 你想嘛,一篇文章,一个视频,你看完就完了,它们只是信息。但是 agent 不 一样,它包含了我的知识,我的方法论,我调节好的工具,你拿到它之后,它就能帮你干活。这就是我说的内容从信息的主体变成了服务的主体。 我相信这一定是趋势,而目前全球还没有多少人像我这么做,可能单扣算一个吧。那基于这样的判断,我今年做的第一款产品是一个多 a 卷编排的插件,叫做 newtype profile。 把它装在 opencode 上之后,你就有了一整个 ai 内容创作团队。举个例子,上个月底,英伟达发起了对 grog 的 收购,我让 a 卷帮我调研这个事件,并生成一份 newsletter。 名叫 chiff 的 主 agent 接到需求之后,他判断出这是一个执行任务而非探讨的任务,于是他把活派给了副手 deputy。 但是啊,由于这个请求太宽泛了,被 deputy 延迟拒绝。于是 chiff 重新拆解任务,从最基础的开始,按顺序进行深度调研。这个时候, deputy 开始调派专业 agent。 针对这个任务,他让专业 agent 做了两件事儿, 一是看看本地知识库里边有没有相关的文档,二是上网搜索更多的资料。当资料全部收集完毕之后, deputy 会形成一份执行招标,返回给趣否。 趣否觉得 ok 了,再次下达指令,开始状写 news letter。 最终,一篇趣否认为质量很高的文章完成,存在了本地的文件夹内。 我把这篇文章发在公众号 newtype ai 上了,大家感兴趣可以去看一眼,我觉得真心写的挺不错的。通过刚才的例子,我们可以看到,这些 a 卷形成了一套三层的架构,分工非常明确。趣否是思考者,他来把握大方向。 deputy 是 执行者,他专门用来调度专业的 agent, 而那些专业的 agent 都是专家,他们会互相协助完成任务。这是一套比 cologold 更强大的系统。我知道肯定会有人说 cologold 里边也有 sub agents 啊, 但是啊,他那个只能算是入门级的多 agent, 编排性能很有限。那么我的这套架构好在哪呢? 第一,成本优化。 chief 只做决策,所以我给他用 opus 四点五模型,他最强大也最贵。 deputy 负责调度,所以我给他用 sunnet 四点五模型就足够了。至于其他几个字, agent, 因为内容创作需要超大的上下文,所以我都给他们配了 geminel 模型,不过有的是用 pro, 有 的是用 flash, 你 看模型的分配是完全定制化的,所以它成本肯定是最优的。第二,智能的写作。 depository 回收任务之后会汇总过滤,然后再返回给趣否,这样就能防止趣否的上下文爆炸。另外, agent 之间还有一套 artifact 系统,用来共享结构化的数据,上一个 agent 完工之后,可以把必要的数据以清晰的结构传给下一个 agent。 第三,质量把控。我给每个子 agent 都设计了一套多维的质量评分,每个子 agent 完成任务之后都会给自己打个分,他们自己会评估一下这个任务完成的怎么样,是否可以上交,还是需要去返工。 比如 researcher 是 情报员,所以它的三个评估维度是覆盖度、质量来源和相关性。 writer 是 携手,所以它的三个评估维度是结构、清晰度和有据可依。当分数高于零点八分,可以交给下一个 a 卷处理, 零点五到零点七九分之间,那就自己优化,小于零点五分的话就得重做,最多重做两次。有了这套多维度的质量评分系统之后,整条流水线的产出质量才有保证,而且每个指 a 卷的也知道去修改哪里,你看这个才叫多 a 卷编排, 你千万别以为多 a 卷编排就是搞几个字 a 卷的,在后台跑一跑,那需要考虑的东西有很多,比如我刚才介绍的这些,而且这些都是 coco 的 里没有的,也做不到的。因为要实现这种程度的定制化,只能是开源的项目。因为 opencode 开源,所以才有了 oma opencode 的 插件, 它带来了一套多 a 卷边排的框架,因为欧曼 open code 开源,所以我才能在它的框架基础上进行全面的修改,才有了我的 newtype profile。 而我的这个插件也是开源的,已经发在 github 上边了,大家可以随意使用,也可以 fork 下来随意修改。 我现在是已经把 ai 系统全都迁移过来了,每天都在高频使用,而且我边用边叠带,我这个插件全都是在 opencode 里边使用欧曼 opencode 插件做的。下一步我打算加入更多风格化的东西进去,让 agent 有 一些我的气质, ok。 以上就是本期内容,想了解 ai, 想成为超级个体,想找到志同道合的人,就来我们 newtype 社群,那咱们下期见。

233黄益贺 04:13查看AI文稿AI文稿

04:13查看AI文稿AI文稿哎,你有没有过这种感觉,为了追求更强大的功能,装了个叫 oh my open code 的 插件,结果用起来总觉得哪儿不对劲儿,好像反倒是被悄悄降级了。 别急,今天这个快速指南就是来帮你找回 open code 原声代理的,那份轻便和高效的。 你看,你以为自己是升级了对吧?但问题就出在这儿, oh my open code 插件在末月安装的时候啊,会悄悄地用它自己的代理换掉 open code 里头两个本身就特别好用的原声代理。这背后到底是怎么回事呢?我们一起来看看。 这个隐藏的代价就是你失去了两个非常强大的原声代理给顶替了。 当然了,新代理肯定也很厉害,但是在处理一些日常任务的时候,你可能会特别怀念原来那两个小而美的工具。 那么问题来了,我们有必要费这个劲把它们找回来吗?答案是,绝对有必要!这可不只是怀旧哦,找回它们对你的工作效率和灵活性来说,好处是实实在在的。 好处主要有三个,首先呢,就是省钱,原声代理非常清亮,处理简单的日常任务消耗的 token 会少很多。其次,执行速度呢,叫一个快。对于一些简单的请求,原声代理几乎是秒回,能给你闪电般的响应。 最后,也是我个人觉得最酷的一点,就是灵活性。你可以根据手头任务的复杂程度,自由地在功能强大的新代理和轻快高效的原声代理之间来回切换,这样一来,你才算是真正控制了自己的工作流,对吧? 好消息是,想把他们找回来,操作起来超级简单,我们只需要两步,一个非常快速,任何人都能轻松搞定的修复过程。来,我们马上开始, 那就是屏幕上的这两步,第一,咱们去修改一个配置文件。第二,重启一下验证成果。听起来就很简单,对吧?我们先来看第一步,这也是最核心的一步, 你需要找到这个文件路径,我已经给你打在屏幕上了,就在小砰点 config open code, o my open code 点 json, 这个是 o my open code 的 插件,它自己的配置文件,我们所有的小魔法都将在这里面发生。 好,找到文件之后,用你的编辑打开它,然后把屏幕上这段 json 代码整个复制粘贴进去。放心,下方的字母区我也放了,纯文本,你可以直接复制。 你看这两行代码意思很直白, replace plan false, 就是 告诉插件,嘿,别动我的 plan 代理。而 default builder enable true 呢?就是让那个默认的 builder 代理继续保持起用状态。 好了,代码添加完了,现在最关键的一步来了,记得一定要保存这个文件,然后把你的 open call 完全退出,再重新启动它。这一步就是为了让你刚才的修改能真正生效。 ok, 重启完成了,那我们怎么知道刚才的操作到底成没成功呢?别接,咱们得验证一下,接下来就看看如何确认你已经重新掌控了你的代理。 验证方法超级简单,在你的 o ping 扣端中里,直接输入这个斜杠命令 agent, 然后敲回车,这个命令会把你当前所有能用的代理都给你列出来, 看效果是不是立竿见影。这张对比图就非常清楚了,在修复之前,你的代理列表里是找不到 plan 和 opencode builder 的, 但是现在你再运行命令,看看它们俩是不是已经稳稳地回到列表里了,这就说明我们的操作大功告成。 所以你看,有时候就是一个小小的配置修改,就能让你的工作效率和灵活性获得巨大的提升。这也给我们提了个醒儿, 在你用的其他各种工具里,是不是还有很多默认设置是,你从来没有质疑过,但它可能正在悄悄地限制你的潜能呢?嗯,这个问题真的值得我们好好想一想。

18忘记 04:25查看AI文稿AI文稿

04:25查看AI文稿AI文稿来,各位 open code 的 朋友们,我问你们一个问题,你敢保证你现在用的欧麦 open code 插件真的是最新版吗?我猜啊,八成不是。今天咱们就来聊聊这个很多人都不知道的更新陷阱, 你肯定在配置文件里写了 adlest 对 不对?心里想着,嗯,这下肯定能自动更新了。但结果呢?为啥你还在用那些老掉牙的技术,眼巴巴看着新功能从身边溜走? 答案嘛,说出来你可能不信,其实很简单,但又特别容易被忽略,就是因为一个隐藏的缓冲。 没错, at latest 这个标签,它就只在你第一次安装的时候管用,之后你就被它锁在那个旧版本里了。好,那咱们就来撕开这个 at latest 的 假象,看看它到底是怎么一回事? 看看这个是不是很眼熟,这不就是我们大多数人的 open code json 配置文件吗? plug in 字段里 npm, oh my open code at latest 写得明明白白的,看起来简直是完美无缺对吧?但问题就出在这儿,这个设置啊,它是个一次性的, 为啥会这样呢?罪魁祸首就是这个插件缓沉机制。你想啊,为了让 opencode 启动得快一点儿,它会把你用的插件在本地存一份儿, 这本身是好事儿,对吧?但问题是,它存了之后就懒得再去网上检查有没有新版本了,所以你的 at latest 就 这么被冻结了。 不过呢,别慌,这个问题解决起来超级简单,只要改个小地方,你就能立刻用上最新的功能,总共就三步,特别快,第一,找到那个配置软件。第二,加一个更新的关花。第三,重启 open code。 来,我们一步一步来操作 好,第一步,找到配置文件。哎,注意了啊,这个文件可不是我们刚才看的那个 open code。 jason, 别搞错了, 你要找的是一个叫 oh my open code 点 json 的 文件,如果找不到就自己创建一个。它一般会在两个地方,一个是局的配置目录,就是那个 c link com fake open code 下面另一个呢,就在你当前项目的点 open code 文件夹里。 ok, 找到文件了,接下来就是最关键的一步了,打开它,我们只需要加上一行代码,就一行, 就是这个,在 o my open code 点 json 文件里加上 auto update true 这一行,记得后面加个逗号,就这么简单。这行代码的作用就是告诉插件 a, 每次启动的时候都给我去网上看看有没有新版本,有就赶紧下。 最后一步,保存文件,然后重启你的 open 口。哦,这里我得给你提个醒啊,改完配饰之后,你第一次重洗会特别慢,因为他要去下载最新的插件包,所以你要是看到白屏或者黑屏,别慌,这是正常现象,耐心等他一会就好了。 好了,费了这么大劲,咱们到底得到了什么好东西呢?来让你见识一下你左左的全新编程伙伴。 更新完之后啦,你的武器库里就多了两个大杀器。我们都熟悉的老朋友,西西弗斯 zissifos, 他 还在,就像神话里那个推实托的,他特别擅长干那些日常的一步一步的编码和重构的活儿。 但是现在你还多了一个赫菲斯托斯 hephaestus, 他 可是神话里的工匠之神啊,这完全是另一个维度的存在了,你不用再手把手教他,你只要给他一个大目标,他自己就能规划执行,直到搞定。 那这个赫菲斯托斯到底有多牛?这么说吧,你可以直接跟他说,帮我把这个乱七八糟的支付模块重构一下,或者从零开始给我搞一个用户认证功能出来,甚至是处理那些能让你抓狂的深层依赖冲突,他都能搞定。 以前你可能要花好几天甚至几个礼拜才能做完的大项目,现在直接扔给它就行了。好了,现在你终于用上了真正意义上的最新版。所以一个问题留给 你,有了赫菲斯托斯这个神级工匠在手,你准备用它来打造点什么惊天动地的东西呢?

26忘记 09:20查看AI文稿AI文稿

09:20查看AI文稿AI文稿github 一 周热点汇总第一百一十期,本期的内容呢,包括了 github 历史增长最快的项目,谷歌的端测, ai 体验 app 生化危机女主的 ai 记忆系统,自进化的智能体和一个免费的录屏神器。最后呢,还是分享两份资料,如果觉得内容不错啊,也别忘了点赞和关注。 那这周的第一个项目啊,我想做一个一加一的模式。首先要说的呢,就是目前为止啊, github 历史上增长最快的项目, 短短两周的时间呢,就已经达到了恐怖的十八万 star。 这个呢,就是用 rust 重写的 cologold。 那 上周啊,其实我们也聊到过 cologold 的 泄露事件,当时呢,有一个哥们拿到原码以后,立刻呢用 python 和 rust 完全的重写了 cologold。 那 这个啊,就是 cologold 这个项目。上周呢,我们做视频的那个节点啊,这个项目刚好搜不到了,后来呢,应该是解禁了,在项目的介绍里啊,也能看到 finally unlocked。 所以呢,感兴趣的朋友啊,就不用再找我去要代码了,自己去学习一下吧。那因为这个项目啊,其实和相州的关联很紧密,但是呢,又没有必要介绍太多,所以呢,就作为一个简短的介绍。那另外一个我想介绍的部分呢,就是他在重写这个过程当中啊,用到的 oma codex 这个工具。 那这是一个呢,构建在 openai codex 之上的一个工作流的层。那他当时在重写的这个过程啊,是这样组织的, 用 team mode 呢去执行并行的 review, 然后呢用 rough mode 去执行持久的循环,然后呢,还有这种架构级别的验证,还有 codex 驱动的实现。那用过这个 codex c r i 的 朋友啊,应该有感受, 本身呢, codex 是 一个非常不错的代码执行的引擎,它的开发能力啊,非常的不错,但是呢,在工作流的管理上呢,就比较的基础, 所以呢,习惯用 codex 的 小伙伴呢,可以去学习和了解一下这个项目。那从开发的效果来说啊,我个人的感受是, codex 应该是目前性价比综合来说非常高的一款,因为它的效果和它的这个量大管保的特性啊, 我还是非常喜欢用的。那安装和使用 omcodex 呢,也比较简单,直接 npm install 就 可以了,然后呢,再执行 oms setup 就 可以开始运行了。 注意啊,项目的说明里特意说明了,这个是针对于 codex cri 的 一个强化,如果你是用 codex app, 那 就不要使用了,可能会引起问题。 google ai h gallery 呢,是谷歌做的一个本地 ai 应用商店加模型跑分和演示平台。 上周的节目当中啊,我们介绍了谷歌刚刚发布了最新的开源模型 demo 四,那它呢,能以离线的形式运行在这个平台之上,使用的呢,是完全的手机本身的 gpu 资源,可以呢,第一时间啊,在手机上去体验谷歌最新模型的能力。 而且呢,不只是聊天啊,它还有很多的功能模块,比如呢,像 agent skill 啊,可以给手机接上维基百科去做这种事实的调查。还有呢,像 ask image, 可以 去拍照识别物体,还有视觉的理解, 那 audio scrab 呢,可以实现语音的转录,甚至呢,还做了一个 tinning garden 的 小游戏,用自然语言呢,来去虚拟画圆,那它底层用的是 google 的 light r t 推理引擎支持呢,从 hackin face 上下载各种的开源模型, 还能呢自己跑奔驰 bug 来去看各个模型在你手机上的实际的表现。那说实话,谷歌做的这个端侧的 ai 体验呢,还是比较超前的,之前他们推出的各种这种 on device 的 ml 工具呢,也是一直在迭代, 那这一次呢,做成了 gallery 这种形式的一个合集啊。那对于普通用户来说啊,这个体验的门槛啊,确实降低了很多,直接呢,从 google play 或者是 app store 来去下载就能使用。 当然呢,你要自己去切换一下到海外的区域,目前国区啊,是没有这个 app 的, 不过目前呢,主要还是体验和演示的性质。如果你好奇啊,大模型在手机上跑到底是什么样的体验,那这个呢,是一个非常直观的入门方式。 madam palace 呢,是一个最近火爆的 ai 记忆项目,四月五号才创建,那短短的四天呢,就超过了三万 star, 而且这个创始人啊,你是不是也非常的眼熟?没错啊,他就是那个演生化危机的女主角,不是姐妹啊,咱们演演科幻片就算了,怎么还玩上真实了? 难道你是在演戏的时候拿到了红皇后的原代码吗?那 madam palace 到底能干什么呢?它解决的问题啊,就是你和 ai 聊天的所有内容,每次绘画结束以后就没了, 那 memo policy 的 思路呢,就是全部给它存下来,当然也不是一股脑的去推进啊,而是用记忆宫殿的架构来去组织。那这个记忆宫殿的原理呢,来自古希腊的演说学家的记忆术, 他把要记的东西呢放进想象当中的一个建筑物里的不同房间里。那项目呢,就是把你的对话按照项目 人物分成不同的 e, 还有不同的厅,那厅下面呢,还有分室,形成一个可导航的记忆地图。那在相关的基准测试上啊,它的 ro mode 呢,拿到了百分之九十六点六的这个评分,是迄今为止公开的最高分,而且呢是零 api 调用,完全呢在本地运行,它 也支持了像 cloud, code, cursor 等主流的工具,通过 m c p 呢去进行集成。不过有意思的是啊,在项目上线四十八小时之内啊,就被社区扒出了很多的小问题, 比如呢,像官方宣称的这种无损压缩啊,其实是有性能损耗的。还有呢,像百分之三十四的这种性能提升呢,其实是 chroma d b 标准功能的一个效果。 当然创始人呢,也很快的进行了公开的承诺和一些问题的修复。说实话,虽然项目上线呢就被打脸,但是呢,反而呀,也说明这个项目呢还真有两下子。 pumas agent 呢,是一个开源的 ai 智能体,它的核心卖点啊,就是和你一起成长,不是每一次绘画呢就完全失去记忆的 agent, 而是呢,不断的去进行学习的循环。那简单来说啊,它就是会在任务完成以后自动的去创建技能,以后呢,遇到类似的任务啊,直接附用。 它有持久的记忆系统,通过 circle light 和 f t s 呢去进行权威的搜索和跨绘画的解锁的历史对话。 他还会呢定期的去进行自省,主动的把重要的知识啊去沉淀下来。那其实啊,伴随着这个项目的发展,最多的讨论呢,就是和 openclaw 进行对比,很多人呢也都说啊,对比 openclaw 来说呢,它会更好用。当然呢,其实 openclaw 的 记忆模式呢,也可以配合一些自动化的 skill, 也可以做到啊,这种持续的自我成长。 所以呢,具体的好坏啊,还是由大家去自主的评判。那 hymerx agent 呢,功能是比较全面的,支持了多种的后端,包括了像本地啊, dakar s, s, h 啊, daytona 等等的这种后端。 那模型的方面呢,也是支持的很全啊, open router 上两百多个模型,像 openai 啊, astropik, kimi, mini max 都可以支持。还有呢,像私有的模型, 那通过一条命令, hermes model 就 可以进行切换。那消息平台的支持呢,也很全, telegram, discord, slex 都可以。还有呢,像 c l i 的 工具也支持呢定时的任务和自然语言的设置。 那安装方面呢,也提供了一键的安装脚本,而且还非常有意思的一点啊,是它提供了一个从 openclaw 迁移的工具,那能够呢,自动导入你的记忆技能,配置,还有 api 的 密钥,可以看得出来啊,就是想啊,直接抢 openclaw 的 用户。 open screen 呢,是一款开源免费的录屏软件,绝大多数的朋友啊,我相信都用过录屏, 这个呢也是一个比较刚需的品类。那 open screen 呢,支持呢,录制指定的窗口或者是全屏自动或者手动呢,去添加缩放的动画,可以录制麦克风和系统的音频,支持裁剪,变速标注,还能呢,自定义背景,能够导出不同的比例和分辨率。 那项目呢,也给自己定了一个非常直观的对标对象啊,就是 screen studio。 那 open screen 呢,就是一个它的简化版本,覆盖了大部分人的核心需求。那对于做产品的 demo 还有录制教程的场景来说呢,是完全够用的, 而且呢它是 mit 协议,个人呢和商业都可以免费使用,这在录屏软件当中呢,是比较实在的一种做法。那项目啊,目前支持 macos, windows 和 linux, 那 macos 上呢,可能需要你去处理一些 gatekeeper 的 拦截,给终端呢,去加一个全词盘的访问的许可,还有呢就是执行一条命令来去授权一下。 那就在上周啊,一款名为 happy house 一 点零的匿名模型呢,作为黑马,以一千三百三十三分的分数啊,登顶了 artificial analysis 的 视频经济场排行榜,超越了字节的 c dunks, 还有可灵啊, skyrim 等一众的模型。那必须要注意的是啊,目前市面上各种 happy house 的 官网都是假的, 大家不要因为好奇呢而被骗了。那最新的消息是啊, happy house 已经进行了澄清,它是阿里 ath 创新事业部正在内测当中的一个产品, 目前呢还没有上线。也是说了一下啊,目前网上的这些官网都不是真的,那 happy house 啊,正式与大家见面还是需要一些时间,顺便呢也吐槽一下啊, happy house 快 乐马杰克马,这个是不是也是阿里的一种致敬文化啊? 那最后啊,还是分享两份资料,第一份呢是聚深智能发展报告,这个呢是信托院出的一个报告,聚深智能啊,一直非常被关注,他可以说是未来 ai 的 集大成的一个形态。 尤其呢是下周啊,就会开启第二届的机器人马拉松,到时候呢,我也会去现场看看热闹。关注这方面啊,可以先来看看资料。那第二份呢,就是二零二六老年群体 ai 应用研究报告,这个呢是安永的一份报告, 对于老年人和 ai 啊,一直是蛮有意思的一个话题。那随着 ai 呢,在日常生活当中啊,日夜的去发挥作用,那本报告啊,就探讨了六十到八十五岁的人群如何与人工智能进行互动并体验其影响。那有需要的呢可以告诉我。以上呢就是本周的全部内容,那我们下次再见。

4467IT咖啡馆 04:12查看AI文稿AI文稿

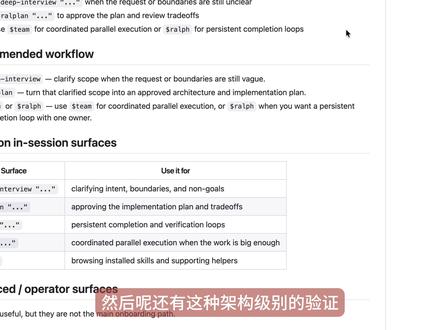

04:12查看AI文稿AI文稿这是 anx, 也就是 omcodex, 它的目标很直接,就是让你的 codex 不 再孤军奋战。 o m x 面向 open i codex c i i 提供一套更完整的工作流和多智能体协做层,它不只是一个启动参数,而是给原生 codex 不 上持久记忆、团队协同和标准工程生命周期的超级引擎。 o m x 并不替代 codex, 它更像是在 codex 之上加装了一套超级引擎控制台,底层的代码生成和执行逻辑 依然由 openae codex 负责,而 o m x 负责。另外三件更关键的是,第一是持久化记忆,通过本地 ox 目录管理状态计划和日制。第二是任务路由,把模糊需求分配给更合适的专业智能体。 第三是标准工作流和内置技能,把零散对话沉淀成可附用的标准化研发流程。这页展示的是原声 codex 和 o m x codex 的 差异。 在状态和记忆上,原生 codex 更像临时记忆,绘画结束之后信息就容易丢失,而 o m x 会通过本地 box 目录持续保留计划和历史状态。在工作流上,原生 codex 更依赖人工给出零散提示词。而 o m x 强调结构化生命周期, 从需求澄清到架构设计再到执行推进,都有明确阶段。在执行模式上,原生 codex 往往是单智能体串行处理,而 o m x 支持并行协调开发,也支持单线成闭环推进。在上下文感知上,原生 codex 每次更像从白纸开始, 而 o m x 则通过 agents md 提供全区项目指导方针。 o m x 的 工程生命周期分成三个阶段,第一阶段是需求澄清, 通过 deep interview 主动追尾意图、边界和非目标,把模糊需求讲清楚。第二阶段是架构设计,通过 rapun 把明确需求转成实施蓝图, 帮助开发者确认方案和权衡。第三阶段有两条分支,如果任务复杂,就启动 p 模式,拉起多角色并行协调。如果目标单一,就走 ruf 模式,持续执行和验证,直到任务闭环。 为了让这些流程真正好用, o m x 还设计了一套全局指令面板布局。在高频核心工作流里,你可以用 deep interview 做需求探索,用 role plan 批准实现计划,用 team 启动多角色并行团队, 用 ralph 开启单任务死磕循环。也可以通过 skills 浏览已安装的扩展辅助技能。而在高级运维和监控层,还有 o m x setup、 o m x doctor、 o m x h u d 和 o m x x pore。 这类操作面板分别对应出示化、环境诊断、实时状态监看以及跨代码库解读。探索 o m x 的 底层基石是持久化和并发症。在持久化这一侧,它会自动生成本地 o x 目录, 这个目录里保存 state plans 和 logs, 相当于整个项目执行过程的大脑。在并发协同这一侧, t 模式依赖终端服务器作为底层协调后端在 macos 和 linux 上主要依赖原生 tmax。 在 windows 上,则可以通过 smox 或 wsr 实现等效的多线城合作机制。 这让 o m x 不 只是绘画增强工具,而是一套真正可扩展的工程鞋同底座。从社区表现来看, o m x 已经是一套经过开源社区验证的工程化方案。它拿到了超过一万五千个 hip hop stars 以及一千四百多个 fork, 底层主要由 typescript 和 rust 混合构建,既追求极速响应,也兼顾稳定并发。同时它还支持超过十五种全球语言交互项目,也有明确的 creator maintainer 和活跃协作者,说明这不是一次性的个人作品,而是一个持续引进中的开源工程体系。 如果你想快速接入 o m x 流程,其实只有三步,第一,确保基础环境就绪,包括 node 二十以上 codex c i 以及 it max orps max。 第二,执行 o m x setup, 完成初步部署。第三,直接进入 mag max 高强度模式,也就是执行 o m x mag max high。 对 于 intel mag 用户,如果高病发模式导致系统验证引发 cpu 飙升,可以按提示移除对应隔离属性, 或者适度降低病发参数。整个思路很明确,就是用最短路径把 codex 拉进真正可规模化的工程工作流里。

156未来摸鱼办 04:11查看AI文稿AI文稿

04:11查看AI文稿AI文稿三分钟上手开源 ai 编程神器 open code 厉害!哈喽大家好,我是姚路星,最近有个火爆全网的项目叫 open code, 为了照顾下新人,先简单介绍一下什么是 open code。 open code 是 get up 上面狂揽五十七 k star 的 一个开源 ai 编程神器,号称开源版的卡拉 code, 这是几乎所有主流的一个模型,更绝的是不用登录就能白嫖。免费模型地址如下, open code 不是 最近才出的项目,而让它真正起飞是欧麦 open code 的 插件,直接超进化成终极的一个 ai 编程助手。今天我就来手把手教大家如何三分钟上手这个超级项目。在开始安装之前,咱们先来聊一聊 open code 到底牛在哪里? 一,完全开圆,自由度拉满相比之下, kolog 虽然好用,但主打一个封闭。二、免费模型白嫖 open code 内置了四个免费模型,其中 glm 四点七、 mini max m 二点一、 kologfast。 一, 不用登录直接就可以白嫖。 三、双形态随心选 open code 提供了终端 t u i 和桌面端两种使用方式四,欧曼 open code 插件让 open code 开挂, 配合欧曼 open code 插件使用 open code 可以 获得异步、 sub agent、 关键词触发模式、深度思考、 lsp、 ast 集成、上下文自动管理等能力。好了,废话不多说,接下来手把手教你如何安装并使用 open code。 步骤一,选择你的战斗形态 open code 有 两种安装方式,根据自己的喜好选择方式 a, 桌面端对小白更友好,直接打开官网下载页面,选择你的电脑系统下载安装齐活。 方式 b, 终端 t u i 前提条件是你的电脑已经安装了 node s。 接下来打开终端,输入以下命令,一键安装。安装完之后进入你的项目目录,输入 open code, 看到那个赛博朋克风的 t u i 界面了吗?恭喜你, open code 已经就位了。 步骤二,装配欧曼 open code 的 外挂打开终端执行以下命令过程中你可能会遇到提示说缺少 board, 运行时不要慌, windows 用户和 mac linux 用户分别执行以下命令即可,然后再执行欧曼 open code 的 命令。 安装过程中会依次询问你 cloud 在 gpt 以及 java 的 一个订阅情况,如实回答就好,这样欧麦 open code 会根据你的订阅优化调用策略。 安装完之后,咱们再来看一下如何使用 open code, 基本的使用方式和 cloud code 没什么区别。再来看一下 open code 的 一个使用技巧。技巧一,切换 a 阵模式使用 tab 键就能在 build 模式和 plan 的 模式之间快速切换。 技巧二,关键词触发超能力前提是需要安装 openopencode 插件,配合 openopencode 插件,你可以使用这些魔法关键词完成意想不到的一个强力功能。 技巧三,模型自由搭配 open code 的 最大的优势就是模型自由,比如你可以用 germany 处理前端 ui 任务,用 gpt。 五,处理复杂的一个逻辑任务,用 cloud 处理长文档的一个分析,用免费的 glm 四点七日常开发。 总结一下,今天教给了大家三个事儿,一, open code 视察看原版的 cloud code 几乎支持所有主流模型,完全免费。二,如何安装使用桌面端傻瓜式安装, t o i 端通过命令行安装。 三,如何装配外挂通过 o my open code 插件获得 evaspaint 关键词触发、上下文管理等超能力, 最后的最后 open code 加上欧麦 open code, 绝对是目前开源界最能打的 ai 编程组合。纸上得来终觉浅,绝知此事要躬行,大家赶紧行动起来吧!加油!感谢大家三连谢谢大家,记得关注再走。

811我姚学AI 13:14查看AI文稿AI文稿

13:14查看AI文稿AI文稿这是我被 cloud code 封的第三个号了,申诉也没有用,我现在已经准备放弃官方订阅了,不想折腾了。那 open code 一 直很火,最近我也在开始用它了,尤其是 cloud off 四点六和 gpt 五点三 codex 出来之后, 我现在是多个模型配合去干活。那发挥每个模型的优势,用四点六去做架构设计,用五点三 codex 去做代码执行,如果有前端的一个 ui 需求的话,再拿 gmail 三点零 pro 去做前端的一个 ui。 那 opencode 到底是什么呢?用一句话,它其实就是一个开源版的 curlcode, 功能上的话两者差不多,但 opencode 有 一些独特的优势,就是它是一个任意模型,你可以支持多家厂商的, 你也可以用国产的,你也可以用国外的模型都支持。第二点就是代码完全开源免费,这一点非常重要,你可以自己去改,自己去定制。同时代码开源之后,那开源社区的人就可以去围绕它做很多功能,毕竟人多力量大嘛。比如这个插件 opencode, 这就是社区去搞的,现在已经三十 k star 了。 这个插件其实是一套多 agent 多魔性去协助干活的一个插件,最近我体验下来也挺好用的。它这边准备了十个 agent, 有 主控 agent, 有 去专门干代码的,专门去探索代码的,也专门去做前端 ui 的, 挺好用的。 open code 整个的架构的话,其实跟那个 cloud code 差不多,用户输入成有绘画管理嘛,然后有 agent, 有 plan 就 计划,那 kolco 的 那边也有,那有 build 就是 直接干活的嘛,还有些探索的,其实 kolco 的 那边不是都有吗?以及你制定一些 agent 都有,那调度层这边就有些差别了。关于大模型的调度,因为 kolco 的 那边他只支持 angelic 协议的嘛,那这边的话就是实现了一套支持其他各种供应商的整体的架构的话,其实有很多值得学习的地方,如果大家对 kolco 感兴趣了,可以去他官方原码仓库去拉下来去学一下,那个仓库现在已经一百多 k 了,特别火。 那下面就是这个 oh my open code, 这个是我们今天讲的重点,因为他这一套多 a 镜的多模型的一个机制, 能让一个任务去拆解成各个阶段去开发,有复杂的用复杂的模型,简单的用简单的模型,这种才是一个 理想状态下的一个写作的方式嘛。那它本质上就是我刚才说的,它就是一个插件,通过 open code 暴露的一些钩子去拦截这一个 ai 的 一些行为,它的整个工作流程就是来一个用户输入之后,它去拦截 open code 的 一些钩子,这时候去做一些增强上下文呀,或者去选择多 a 帧特有可能是多个模型去协助,最后返回结果整体的一个流程就是这样子的。 那为什么需要多个代理?哈?他这边说的一个说法是专业的代理去做专业的事情,然后规划和执行分离,可以并行执行,按需去选模型,并且节省成本。那他现在这一个多代理的话, 就像最近 cloud code 新出的那个 agent teams 一 样,只不过 cloud code 它是很久很久之后才出的嘛,这个是老早就有了 omago code, 那 下面是它的一些 agent 的 一个分工,这一个是它的一个主要 agent 是 用了 cloud 的 off 四点六这个模型。 还有一些规划师就是在规划方面以及编排方面,他用的卡尔的最顶尖的模型,那代码磁性这一块的话是用的是 gbt 五点三 codex, 如果是一些比较轻量的任务,你可以用 gm 啊,或者 mini max 啊,以及其他都可以。那些前端这块的话,他用的 jimmy 三 plus 或者 pro, 这样子的话就一个任务进来之后他由这个去规划,规划完了之后,他让 jimmy 五点三去做执行,然后发现有前端任务,他这个时候就用 jimmy。 如果涉及到一些小修小改啊,比如说是一些国际化处理啊,多语言处理,这个时候它就完全可以用很低的那种模型去做这个事情嘛。这样的一个搭配其实我体验下来挺好的。 好,下面我们就开始分别去安装 opencode 和 oemopencode 的 这个插件。桌面端它现在也支持了,支持 macos、 windows、 linux, 我 体验下来的话,它有一些断流的情况,所以说我更推荐大家在使用 cio 版本,我们先来安装一下。 好,它提示我们已经安装了,我们来进去看一下,我们先切到一个免费的模型,你上面搜一个 free 这些模型的免费,我就用 mini max m 二点一吧,我们输入一下测试一下,看它安装好没有。 ok, 如果看到这步就证明你 open code 已经安装好了,这个时候我们就有安装那个插件,因为现在在 ai 时代,其实你安装东西都非常方便,尤其是它如果有文档,有开箱库的话, 你看这一个插件哈,欧麦 opencode 的 一个官方仓库里面直接就告诉你了,你直接用 qq 编辑的去装就行了,我就把这个复制一下,然后粘到刚刚我们开的这个 opencode 的 里面,用免费的 mini max 让他给我们去装,那下面就是他会弹出来让你做一些选择, 可以看到他让我们回答一些问题嘛,你有没有订阅 cloud code, 有 没有订阅 openai, 有 没有一些 jimmy 的 一些 model, 你 就根据自己的情况去选择就行了。强烈建议你不要在 open code 里面去用 cloud 的 模型,通过订阅的方式去用封号的概率非常高。那这边我就说都没有, 待会我也给大家一个配置,直接就可以用了,你只需要去搞一个 api k 过来,你就可以直接把这些模型都用上了,这时候我们都说都没有就完事了,因为这个配置后期都可以去改的。可以看到我们把插件安装成功之后,下面的这一个 a 镜头就变了,变成了 omone code, 它的那一套多 a 型的体系,可以看到它有好几个 a 型的体系可以去用,并且 这个插件那还有个好处,它的兼容性做得比较好。它已经把 cloud code 那 边你有的一些 skills, mcp, 还有那些自定义的命令全部弄过来了,比如说 skills 可以看到我的那些 script 它全部弄过来了,这样非常好。也就是说你可以来回签嘛,你有时候你要回去 copy 到那边用也可以。现在我们开始配模型,你可以通过 connect 这个命令去连接你想要的一些模型, 如果你有恰当的 gpt, 里面就选恰当的 gpt, 你 有其他的你就选其他的。那我这边的话,平时会用 jimmy 三点零去写前端嘛 code, 四点六去写架构和具体的一些代码,然后 gpt 五点三 codex 去做一些代码之星,以及解决一些疑难杂症。我喜欢用每一个模型擅长的能力哈,但是对大家来说的话,你如果像我一样去订阅三家的 ai 模型,其实你要花三分钱。我 订阅的一百刀的 code code, 然后今门来我订阅了两个号,一百四十刀, open ai 我 订阅了二十刀,那加起来就是一百六十刀。并且哈,我们刚也说了,如果你用 code code 的 去 授权到这边 opencode 的 去用的话,你封号的概率特别高。之前我还出了一期视频,专门去讲这个 curlcode 的 大面积去封禁 opencode 的 用户的一个事件, 因为刚开始他是不管的,后面他发现这个 opencode 的 日渐壮大之后,他就开始封禁了,你就不能授权到这里面用。 所以如果你要在 opencode 里面去用 cloudof 四点六的一个模型,我建议大家去用中转站,通过按 api 去计费用多少就算多少。那我这边推荐一个我一直在用的中转站接口 i, opencode 的 这边也已经支持了接口 i, 也就官方支持了嘛。 那前面几期视频我也推荐过,如果我要用到一些国外的模型,按 api 调用的话,我都用的是接口 i, 挺稳定的。最关键的一点,你不需要模仿网络,而且是国内付款的一个方式。 最近他们还专门针对海外的顶尖模型增加了一个套餐的方式,也就是说你可以用一份钱去用国外这些顶尖模型呢,目前有三个档位哈,可以按自己的一个需要去选择,相较于官方 api 按量计费的话,这一个套餐模式帮你省了百分之二十五的钱。 好,下面我们先来去创建一个 api key, 在 这个地方新建,我就随便取一个,我们就取 opencode 的 点击复制。这个时候我们回到 opencode 的 这边 附着 apk 之后,我们供应商选择接口,点 ai 敲击回车,把我们的 apk 输入下,然后保存,这时候你可以看到国内国外的模型都可以用,用一个 apk 你 就解决了多模型的一个适配问题。好,下面我们来进行一些其他的配置。 当你安装完 open code 以及欧曼 open code 插件之后,你会在你的工作目录下面点 config, 下面有一个 open code 目录,这里面有两个节省的配置文件,一个是配置 open code 的 一些模型的,另外一个是配置我们这一个 多 a 帧的协助的时候,它具体用哪些模型。这边的话我给大家直接准备了现成的,你直接到我的一个开源仓库里面直接去复制就可以了。下面来我这一个开源仓库里面,直接把这两个配置可以复制一下,把它粘过去就完事了。 好,我们把它覆盖一下保存,再把 omecode 的 也复制一下回来点击复制。 那这一块的话,你可以根据你自己的需要哈,因为 gpt 五点三这一个扣袋子模型的话,官方是没有出 api 的 版本,那后续如果 open i 那 边出了 api 版本接口, i 这边也会跟上,你就根据自己的需要嘛去看这块要不要注视这个内容,我们来复制一下。 好,我们把它覆盖完了,覆盖完了之后,我们重启一下,你就可以看到 color 的 open 四点六已经可用了, 就这几个 a 帧的,它配置的模型都可用了。那下面我们开始进入实战的一个环节,有了 o my open code 插件之后,我们看一下多 a 帧多模型协助的一个流程。我这边有一个纹身图的 a 帧,我希望让它去加一些功能,在这边加一些删除的动作,能把历史记录删除掉,同时在左下角 做一些设置的动作,可以去更新你的一些头像啊,以及我们那些历史提示词,能支持去快速的复制展开开干, 那提示词的话也比较简单,我们这边加一个 alterwork, 让它去更深入的去工作,去分析。 好,我们切到 opencode 这边,这个就是它的整个架构 agent, 它用的是 off 四点六,那这个的话是干活的 agent, 它用的 gpt 五点三,还有些其他的 agent, 也就说它是多 agent 多模型去写作的一个流程。好,我们把提示词粘过来让它干活, 这里提示 autowork 已经开启了,这个时候可以看到它开启了一个探索的沙背 a 技能吗?用的是很便宜的一个模型,这个过程就跟在 clockcode 的是一样的,这里又开了一个新的, 可以看到它一直在开一些新的沙背 a 技能的任务去做探索。啊。好,这里又开启了一个计划的 task, 也就是一个沙背 a 技能,我可以点进去看一下它在做什么, 可以看到他就是把已有收集到的一些代码信息,整个代码空间来去做一轮分析,让这个 off 四点六做一个计划出来,这个时候他这一个主要的协调 a 技能在等,等他这个后台的这个计划任务完成完了之后,这个时候他再去协调其他的 a 技能去干活。 可以看到它这一个经过几轮的一个探索之后哈它得到了一个突突像,那这个突突像的话,它根据后端、前端以及一些小需求拆成了很多突突像,这个时候它就开始去并行执行修改任务了,可以看到它这里又开启了几个 safari 的。 有一个点要看的话是他的这个三倍镜,他开的时候,他其实这个时候是用的 jamal 三 plus 这个模型,也就说他认为这个任务其你根本就没必要用一个很高的模型去做这个事情,所以说他默认给你路由到了一个简单模型, 它这种规划任务的方式就能把模型最大化的利用起来。复杂的任务用复杂的模型,简单的任务用简单的模型就很完美。可以看到它开始去执行 t 四跟 t 六这两个任务了,而且它依赖关系也找出来了。这个就像前两天发布的 cloud agent teams 的 一个写作流程,只不过这个是老早就有了这个插件老早就有了这种多 a 的 写作,最终被 cloud code 写到一个官方的库里面去了。 然后他们那种通信机制就跟爱信的 tim 是 很像。哎呀妈这个系统通知 coco 的, 其实他很多方案是借鉴了社区的,因为社区搞出来之后, 他觉得确实是 ok, 可以 的,那他就把它集成到 coco 的 里面。所以这 coco 的 从它诞生之后的很多功能迭代都参考了开元社区的一些做法,而且他的也在他的一些技术博克里面有,感谢一些开元社区的人提供了一些解决方案。 就像你做产品一样,你产品迭代的过程中,你光靠产品经理去,有时候发觉不了用户的一些真实的需求,那真实的需求暴露出来之后,社区他就解决了,那你就可以去把一些已经解决的痛点的问题提升到自己的产品里面。 可以看到这所有的凸凸像它全部完成了哈,包含三个任务,我们现在来看一下它整体的效果怎么样。首先是左侧的这个删除功能好,确认删除 ok, 确认可以,并且弹窗也是正常的。其实我们看这个可以复制已有的提示词, 可以复制折叠展开是 ok 的。 下面就是这一个左下角的设置,可以去更新昵称跟头像这一些啊,可以看到他这边其实也做好了。 好,我找一张图像试一下看可以吗?前面加一个我的名字吧,看可以吗? 可以,已经保存了。可以的,这个看起来他做的挺好的,英文啊,英文设置也是 ok 的, 多源设置也是 ok 的。 整体这一次任务的话,他全部搞定了呀,就是虽然不是特别难的,但是他协调了多个 a 镜的去干活,而且都能交付的很完美,中间我没有做任何的介入, 所以说这个工具啊,真的推荐大家去用一下这个多 a 镜的协助真的挺好用的,下面我来总结一下。使用 open code 再加那个插件, open code 再配合你用一个接口外的中转站,可以做到 模型自由稳定,省心,你也不怕被封号。第二个的话是成本灵活,这就是今天所有的视频内容,如果你觉得这期视频对你有帮助的话,可以给我一件善良,谢谢大家。拜拜。拜拜。

2858程序员阿江-Relakkes 00:58查看AI文稿AI文稿

00:58查看AI文稿AI文稿你有没有觉得啊, open code 在 复杂工程里特别慢,还容易返工?原因很简单啊,它本质上是单的 agent 顺序执行的。 最近啊,我试了一个升级版叫欧麦 open code, 他 做了一件关键的事情,就是他把单的 agent 变成了多 agent 的 并行安装,非常简单,直接复制一句话,然后进 open code, 他 会问你有没有 clode, code, 叉等等的模型,你如实回答就好了,没有的话就告诉他全部用当前的模型, 我用的就是 kimi。 二点五装好之后,你就会发现左下角从 build 变成了希奇福斯,这是规划和调度执行的 agent。 接下来在你的任务前面加一句, u l w, 正式进入多智能体模式,它会自动拆解任务 多个 a 阵的并行执行,边做边叫验,减少反攻,对复杂的改动化文件的联动,重构场景速度和稳定性的差距会非常明显。一句话总结啊,单县城的程序员和多县城工程团队的区别。

125建斌聊AI 02:59查看AI文稿AI文稿

02:59查看AI文稿AI文稿今天我们想跟大家介绍一下哦, my open code 里面的五大核心的智能体模式,这五大智能体模式到底是怎么分工的?然后它们在哪些场景下面可以帮上忙?没错,这个其实是很多人都很关心的一个话题,那我们就直接开始吧。好的, 第一个我们想要聊的就是这个 orchestrator 模式。对,这个模式呢,其实我觉得,呃,最大的特点就是能够处理非常复杂的任务。那它到底是怎么做到自动帮你拆解并且调度的呢? orchestrator 其实它就是整个系统的一个总指挥。 嗯,那如果遇到一个比较长的比较复杂的任务,需要好几个步骤完成的话,它就会自动地帮你把这个流程拆分开,然后分配给不同的智能提取做 ok, 你 就完全不需要手动的去干预,它就会帮你全部都搞定。听起来很厉害啊,那下面我们来看看 c cifs 这个模式。嗯,这个模式呢,我觉得就是特别适合那种 需要马上得到结果的简单的代码需求。那你可以具体的讲一讲,它一般会在哪些场景下面用的比较多吗?可以啊, c cifs 其实就是快、准、狠。嗯,比如说你要写一个脚本去爬取一些数据,或者说你要去调一些接口 这种很明确的小任务,他直接就可以给你生成一个可以运行的代码。嗯嗯,一步到位,特别高兴了解了。那接下来我们要聊的这个智能体呢?是 hefstis, 嗯,它的作用又是什么呢?这个 hefstis 其实就是你的一个军师。 ok, 就 如果说你碰到一个特别复杂的问题,需要一些架构设计,需要一些比较清晰的思路,嗯哼,那他就会帮你把整个的框架都梳理出来, 然后给你一套完整的可执行的方案,但这个真的是感觉很适合解决一些比较头疼的技术难题啊。没错没错, 这个时候我们就来到了 prometheus, 嗯,这个智能体呢,它就是会去跟你不断的确认细节,把你那些模糊的需求一点一点的细划成一个非常清晰的可以执行的一个计划。 ok, 所以 它也是在整个流程当中非常重要的,所以说就是有了这个 prometheus, 用户即使一开始说不清楚自己想要什么,也能通过和他的交互得到一份明确的任务清单。对的,而最后一个 atlas, 嗯,就是一个非常任劳任怨的执行者。 ok, 他 会按照前面已经制定好的计划,一步一步的去拉取数据做分析,然后输出结果, 整个过程他都非常的专注,保证每一步都做的很精准,不会说做一些无用功。行,今天我们把这五大智能体模式都给大家捋了一遍,从任务的拆解,到方案的设计,再到代码的生成,以及最后的执行, 每一步都有一个专门的智能体在那里帮你把关,确实可以让一些复杂的问题变简单,是吧?那这期内容咱们就到这里了,感谢大家的收听,咱们下次再见,拜拜拜拜拜。

04:23查看AI文稿AI文稿

04:23查看AI文稿AI文稿兄弟们,今天来说一下最近很火的一个 open code 的 一个 ai 编程工具,那我在使用期间,我的感受是这款 ai 编程工具我觉得 怎么去形容呢?如果说是工作效率来说的话,我个人还是喜欢 anti gravity, 我 觉得它会比这款工具更好用。这个 open code 的 搭配最火的这个 o my open code 的 这个插件,在编程的一个感受里面就是它的精准度,说它在执行任务呃的这样一个效果, 我的感觉是呃还可以,但是它的 token 消耗我觉得是非常大的,为什么呢?因为之前我用我 gbt 的 一个订阅账户去开发的时候,我觉得我的消耗使用周长周期还是蛮长的,一般来说起码我可以用到个三到四天, 我轻度使用,但是我昨天仅仅只做了两三个对话,一个两三个任务就已经消耗了,已经把我的头梗消耗了,你可以看到右上角这里是十三万多,所以我都感觉他可能是搭配智能点插件。这个欧欧麦 open code 的 这个智能点插件,可能他这个上下文是非常长的, 而且它执行任务的运行时间也是非常长,所以这点我是比较难去忍受的。同样一个任务,如果我用 ingenuity 去执行,我可能三个对话的任务都执行完成之后,这个 open code 它可能一个任务都还没有完成。这里有几个原因,那第一个,我在使用 open code 的 时候,我是没有 cloud 的 一个订阅账户,所以我使用的是 gbt 五点二的 code。 第二个,它可能在使用这个 o my open code 的 这个插件的时候,它可能需要执行很多一些思考啊,然后 根据这个插件的一个内部自连体的一个工作流去运行可能比较复杂的任务,它可能做的会相对比较好一点,但是一些简单的任务,它可能运行的时间,包括上下文不同的消耗,它可能也会比较大。 所以我个人使用感受下来,如果是简单任务,而且没什么开发经验的,我觉得用这款东西你的时间方面能等,我觉得还可以,但是如果说我们开发比较复杂的项目,如果时间方面有效率方面我们要求比较高, 我觉得用它我可能会比较难受,所以我还是觉得用回我之前 alien gravity 搭配 open spike 这款插件,我觉得在 alien gravity 发挥的非常好,可以给大家看一下我昨天做的一个拆分优化的任务,第一个对话创建体案,它会根据我们的需求创建一个体案, 执行完成之后,你看一般两到三个对话,他就把这样一个大型的一个拆分任务完成,完成之后做测试,那等测试再完成之后,我让他再一次确认,对比一下我们给大宝的历史代码,确保这个拆分之后的完整性没问题,他就几乎这个任务就已经完成了。 完成我就进入到一个审查阶段,最后就进行归档,就这么简单三步完成最后一个命令执行完成之后就归档,非常快的,效率非常快的,一般来说二十分钟左右这样一个裁缝任务就解决了。 所以对比下来,我还是更倾向于用 ad gravity 这种 ade 编程工具,当然也有可能是我因为我用了这个插件,这个欧麦 open code 的 这个插件导致开发效率会变慢,那整体的其他的一些测试我这两天我会陆续的去做。 下一期我会给大家分享这个 open code 的 一个详细的一个情况,大家有什么问题也可以在评论区留言,我们一起来交流分享,谢谢大家。 反正给我的感受就是使用 anti gravity 搭配 open spike 是 非常好用的,我们只需在第一个对话里面输入我们的需求,把我们需要给他的资料给了他,他就会立即创建这样一份方案。那这个方案其实他做出来他需要的上下文不是很多, 非常简短的。你看这样,比如说我拆分的一个呃方案,他会告诉我他需要怎么去拆分,新增什么文件, 再做一个计划出来,这个文件就是这个方案的一个计划,还有个进度,他每次完成之后,这个清单会去呃勾选的,所以他首先第一个就是规划我们这个方案,第二个就是执行的一个过程,一个顺序,那整个流程走完之后, 我们这个任务就已经顺势完成。所以我个人觉得 openstack 这个插件搭配 ing gravity 是 比 opencode 的 好用,而且这个开发效率是非常快的,不会像我使用 opencode 的 时候,等半天才完成一个任务,而且它这个上下文喷吐量是非常大的。

75AI创研社-华哥 07:15查看AI文稿AI文稿

07:15查看AI文稿AI文稿哈喽,大家好,我是琪琪,咱们在养虾过程当中,尤其是在升级版本,还有去安装一些比较复杂的一些插件或者是 skill 的 时候,经常会遇到各种各样的问题。那其实今天的话我给大家带来一种魔法对轰的一个方法,让你用 ai 去解决这些问题。 那我这边的话主要是推荐两种工具,对于新手来说的话,我个人觉得用去其实也可以解决大部分的问题。呃,然后另外一个的话就是 open code, 今天我主要是讲 open code 翠的话,它对于新手相对比较友好,因为它的安装的话就是直接去官网上下载它的 exe 包,直接呃下一步,下一步就安装完成了。呃,你也不用去配特别复杂的一些东西,就它的那个好处的话是在于说我们可以随时去看到我们的一些代码呀,还有一些文档之类的,就这是用翠的一个好处。那另外一个的话就是说,呃, 我们这边下边它也可以有一个机器人可以直接进行一个问答,然后它直接帮你去改原码,或者说是直接帮你去执行一些命令,它都可以做,但是它也受限于自己是一个 i d e, 因为它这里面大部分都是在沙箱里面运作,所以的话它的一个权限会相对比较小一点,尤其是对于咱们用 n p m 安装 opencloud 的 小伙伴来说,用它的话就不太能够去调整到那些问题。 那这个时候就可以用我们的 opencode, 因为它安装的话是全局安装,然后它就可以操作咱们很多的一些,就它拥有的权限也是蛮多的,就跟我们的 openclaw 是 类似的,它也可以执行我们的 power shell 的 一个命令, 所以你在用它的时候,你会发现它会比 tree 自由度更高一点,然后它能够去操作的一些目录也会更多一点。那我们现在可以试一下让我们的 opencode 去安装 openclaw。 ok, 我 们来试一下吧。啊?如果说你是直接 npm 安装的话,你在任意一个位置去直接执行我们 npm 的 一个那个安装命令,或者是直接让我们的 open code 去帮我们去安装都是可以的,就是随便在哪开,但是我想要圆满安装,所以的话我是要在指定的一个目录下面去把这个 po 秀打开,你可以看到前面这就是这,这就是我打开的一个地方。 然后我们怎么去开我们的 open code? 因为之前的那个我之前已经安装好了。那后面的话我也跟大家简单讲一下怎么去安装 open code。 嗯,他的 open code 的 一个打开方式是这样子的,就直接去输入命令 open code 的, 你会看到这样子的一个窗口,那这个窗口的话就是我们的 open code 的 一个任务窗口了。 然后我们怎么让他去帮我们安装我们的 opencll 呢?那我原码安装其实就是会就直接把这个安装地址叫 get 的 地址告诉他,然后给他说我要原码安装 opencll, 然后如果说你是那个 npm 安装的话,你把这个给他,然后告诉他你要用 npm 去安装我们的 opencll 就 行了。那我们试一下让他原码帮我们安装一下。啊。 好,我们看一下我这边输入的一个呃,提示值啊,就是把他的地址告诉他,然后告诉他我需要原码安装,然后安装在当前文件夹下面,然后并安装依赖,然后我们来试一下。 好,你看他现在在干就已经在工作,现在说是克隆克隆命令,执行克隆命令看到没有? 然后我们再看我下我们的这个文件夹,你看在这儿他就已经出现了一个 get 了,因为他是在克隆项目嘛,所以他会先有个 get 这东西,这东西都是由我们的 open code 自己去执行的,你看他就已经把我们的很多东西拉下来了, 我们现在就只需要去等待他把所有的项目拉好,然后把依赖安装好。 好的,现在我们尝试让 opencode 的 帮我们去把 opencloud 整个网关给启动起来啊,然后我这边的话会提示说是让它用生产模式。嗯,是这样子的,就是我们的网关它是分两种模式,一种是生产模式,一种是调试模式,尤其是原版安装的小伙伴一定要注意这个,因为两种模式它们的端口是不一样的,然后我这边的话让它用生产模式。 那其实我们可以看到他在这个过程当中会经常发现一些问题,就比如说他没办法成功的把你把你想要让他执行的任务完成,对吧?他会不断的自己去调整,去修复这些问题,他就会比自己去呃,调这些问题就简单很多。 而且你可以看这边这里有 read 哪一个文件之类的,它是真的会把整个项目里面的所有文件挨个给你读,然后去找到问题的。好,它这边是提示我们的网关已经启动起来了,我们来看一下它到底有没有真的启动起来啊? ok, 他 这个就是没有真正的启动起来,那么现在怎么办?就是告诉他没启动起来,你得重新启动一下,检查一下,对吧?没有成功启动访问显示 好,他没启动成功,就告诉他一下就没启动成功访问是返回的,无法显示此地址,一看他就开始在给你检查了。嗯,好的,我们现在再来看一下啊,他这个端口好像应该已经好了,我们来访问一下, ok, 咱们就可以看到了,对吧?这个项目他既给我们安装好了,也启动好了,是吧? 其实我们日常就像我刚才它第一次没有启动成功的时候一样,就是你遇到 bug 的 时候,你就直接把那些问题给给我们的 open code, 直接说它会直接去读项目文件,去读你的配置,去帮你把问题解决掉的。有了 open code 或者说是你用 tree, 嗯,你在使用 open cloud 的 过程呢?遇到很多问题,大部分它都能够给你解决掉, 这个也是为什么我推荐大家养虾的时候把这个东西也给装上了。而且如果说你去养虾的过程当中有些长任务,你发现你去用一个虾或者多个虾去组织不好组织的时候,你可以直接让我们的 open code 去去帮你干事。他你可以把他理解为他也是一个虾,他只是不像 open code 那 样子,他有多虾的那种协同机制,他只是一个只有自己一个人干活的那种感觉。 那我们简单来说一下 open code 到底怎么安装啊?安装的时候其实你就只需要把这一行命令直接输进去,然后按回车,他就可以直接帮你安装上了,然后这个的话本身是全举安装,你看它这里有个钢记,然后带上这个的都是全举安装, 安装完了以后,就像刚才我最开始演示的一样,你怎么样去把他的那个对话框给打开,任意一个位置在 cmd 上或 file 上面,你就去直接说你要他干什么事情,你就直接跟他说。另外的话就是说模型的切换的问题, 那我们可以看到这里用的模型是啥? mini max 的 一个二点五的免费版本,如果你要去切换,就是直接输入一个杠,一个小斜杠 models model 的 时候,你看它这边就会有很多的模型出来,后面带 free 的 它都是免费模型。然后就说有些模型的话,它可能是需要一点魔法啊,所以的话,呃,未必能用, 但是我们可以试嘛。然后另外的话可以看到我下面这边有一些不带 free 的,是吧?因为我这边的话是买了一个 mini max 的 coding plan, 所以 的话我这边也单独给它配了,因为我想用那个二点七嘛,就是用这个二点七,那这个这配模型是怎么配的呢?我这边也提供了对应的一些教程啊,就一定要去开一个新的 c m d 啊,就是比如这样子 打开命令行以后的时候,你就直接把这个命令输进,那这个打开以后的时候,我们可以看一下下面有没有你自己的那些对应的模型啊,如果没有的话,那你就直接去 search 就 行了,在这儿直接输,比如说我是输的 mini max 哈, 你看到没有它就出来了,那请注意的话,你一定要选国内的一些版本,不然的话你那个,呃,没有魔法你用不了。 然后选完模型以后的时候,你就直接去确定它会让你去输 apikey, 这样子你把你自己的 apikey 给它输进去,输进去以后的时候我们再去重启我们的这个 open code, 然后再去输刚才我们说的 models 这样,那这个时候它下面就会出现你刚刚新增的这些模型了,不然的话你看上面的话就都始终都是 free 的。 那个,如果说你这边打开看发现没有, 呃,就你把这个东西有可能就没重启。好的,今天的分享就先到这里了,那大家如果有什么其他问题的话都可以随时问我,再见。

112琪琪不慌 01:39查看AI文稿AI文稿

01:39查看AI文稿AI文稿谷歌发布了 gemma 四,简单体验了一下,好像不是很适合我,这期分享一下如何接入 opencode 以及初体验。首先我们直接在奥拉玛官网看一下模型,这里主要是看一下你的电脑适合哪个参数版本,如果没有安装奥拉玛的,就先安装一下。 在客户端这里还没有看到 gemma 四模型,所以就在命令行这里输出奥拉玛 run gemma 四,这里可以根据你的电脑配置来选择我的电脑配置二十六 b 是 最适合的,安装需要下载一段时间,所以你挂着可以先做别的事。我已经下载过,所以它就直接在命令行里运行了。 打开奥拉玛,在聊天这里切换模型,就可以直接试一下绘画,问一下它现在是什么模型, 模型下载了之后就可以在 open code 上接入这个模型,我这里用的是 open code 的 客户端,打开 open code, 在 下面这里添加点字定义。在这里主要是有两个点需要注意,一个是 r o, 另外一个就是模型名称要和欧拉玛上的保持一致,不然会连接不上。先填 r o, 注意一定要加上斜杠 v e 后缀,否则客户端可能无法识别路径。填完之后提交, 完成之后就可以在下面选择了。最后说一下这个 jamma 四模型使用体验,就是感觉确实是很聪明的样子,但是好像不大能在本地干活。在 open call 的 这里,我让他整理桌面,还有安装 open call 都不会直接执行, 当我切换千万的模型就可以直接操作,我不知道是什么原因呢?后面在实际用途上再多体验操作一下再说说。这期就分享到这了,拜拜。

35光不语