只需一个提示词,人工智能就能自动生成一部完整的剧情驱动型视频。但这次我用的不是普通模型,相反,我正在使用最新的开源模型 jam 四。 这就是导演。他处理整个创作流程,从故事构思、分镜绘制,到角色设计,再到视觉控制与最终视频生成。 而且这一切都在 comfyui 内部全自动运行。今天,我将带大家走完整个 jamie 私家 comfyui 人工智能导演工作流,让我们看看本地运行人工智能视频生成到底能走多远。 你好,欢迎来到 smartvision。 距离我上一期视频已经过去两周左右了,我刚生了对双胞胎难保,所以最近忙得不可开交。但我将继续努力,继续创作内容。 在这个频道,我会持续分享最新的人工智能教程和实用工具。本视频的所有工作流、材料和资源都在我的配置样上,注册后即可下载。 对于支持者,我提供额外的专业工具和更深入指南。如果你喜欢这个内容,请考虑订阅并支持频道。现在,让我们开始吧。 开始之前,让我快速介绍一下我的配置。我使用的是配备十六 gb 显存的 rtx 四零七零钛显卡和六十四 gb 系统内存,主要用于稳定的屏幕录制。 但在实际应用中,此工作流并不需要那么多硬件。你可以用大约十二 gb 显存和三十二 gb 内存运行它。你只需在 ltx 二点三中降低输出分辨率。如果你的配置较弱,我也在 patreon 上准备了低显存和低内存版本的流程。 我们需要安装 comfyugpu, 在 google 上搜索 comfyugpu, 打开网站并下载相应版本。 如果您使用的是 amd 显卡,请从 comfyui 的 github 页面下载其便携版,下载后解压即可直接使用。 这里我只做简要演示,因为我没装 amd 显卡,也没亲自试过。另外请注意,某些 comfyui 自定义节点可能不支持 amd gpu, 这一点要记牢。然后安装阿拉玛。你只需在 google 上搜索阿拉玛并安装它。 现在让我们谈谈核心模型 jam 四。它是谷歌发布的最新开源模型之一,大多数人用它来写作、聊天或编程,但真正强大的是它理解和规划任务的能力。 例如,他可以将一个简单的提示转化为完整的故事结构。他能把这个故事拆解成详细的分镜,保持角色一致性,并掌控节奏与情绪。所以在这个工作流中,我把它当做导演来用。他只做一件事,决定创作什么,以及如何创作。 其余一切,比如图像、视频和剪辑,都由康菲由爱执行。你可以这样想, jama 四是大脑,是导演,而 comfy ui 则是制作团队。结果是,只需一个提示词,你就能生成完整的视频管线。现在,让我们下载 jama 四,前往奥利马网站,选择一个适合你 gpu 的 版本。 例如,我正在使用 jama 四 e 四 b 复制命令,打开 windows powershell, 粘贴并运行它,它会自动开始下载。最后再来一步,下载我的自定义节点 comfy ui smartvision, 将其放入 comfyui 的 自定义节点文件夹,重启 comfyui, 然后加载我提供的流程。所有资源,包括节点和工作流都可以在我的 patreon 上获取。 此工作流可分为五个部分,用户输入、脚本与分镜生成、图像生成、视频生成以及记忆管理。 我们一个个过一遍。首先是输入部分,你只需要提供几样东西,一张角色参考图,一个提示词,视频时长,镜头数量和帧率。这是系统的起点。 接下来是核心部分,脚本与分镜生成。这里的主节点名为 olama script planner, 它负责生成人物,设定完整分镜及整体风格。 你可以设定语言类型以及使用的模型。在本例中为 gemma 四。在此环节, gemma 四化身导演,决定视频的修饰结构。随后进入 shad selector, 它提取每个镜头所需的数据,包括提示词,时长,以及人物是否存在。 若想连续运行多个镜头,可使用 shad auto index 功能,让镜头编号自动递增,无需每次手动修改。 接下来是图像生成。这里有一个重要优化,只执行所需的分支。如果没有角色,他使用 flex 进行纹身图。如果有角色,他会使用困。图像编辑功能,将角色放入场景中。 如果你知道更好的本地图像编辑模型,欢迎告诉我路由由图像路由切换器处理。它采用惰性执行机制,仅运行所需路径以节省算力。接下来是镜头间的连贯性, 这是人工智能视频领域最大的挑战之一,场景很容易在镜头之间断裂。为解决这个问题,我使用获取上一镜头图像节点,将最后一帧传递给下一镜头,结合连续性提示,这有助于维持光照、服装和整体氛围的一致性。 如果是第一个镜头,就回退到角色参考图。接下来是视频生成。我使用 ltx 二点三,因为它能同时生成视频和音频。 他分两个阶段运行,首先进行低分辨率预览,然后进行高分辨率细化。他还将秒转换为帧以匹配模型需求。接着是内存管理, 这非常重要。这些模型很容易占满显存并引发内存溢出错误。所以我添加了一个名为 shot memory flash 的 节点。每个镜头结束后,它会清除显存和缓存,以便工作流能持续顺畅运行的。最后,创建视频,并将输出保存为最终的 mp 四文件。 总体而言,这个工作流的目标很简单,极简输入,自动生成分镜,高效算力,利用更加连贯性以及稳定的长视频生成。 如果连贯性不理想,你可以专注于存储镜头图像并获取前移镜头的图像。它们在镜头之间提供记忆。它并不完美,但在无需训练定制模型的情况下效果不错。在重新运行工作流之前,你可以在 comfyui 中右键点击并选择清理显存使用量,以避免内存问题。 使用这个工作流非常简单,选择一张角色图片,输入提示词,然后设定镜头数量和每个镜头的时长。默认情况下,每个镜头时长为六秒。 由于这是在本地运行,所以并不完美。错误率比付费工具更高。但能在地本地生成完整的剧情视频已经非常强大了。 让我们看看结果。第一次测试,一位年轻发明家在祖父的工作室里发现了一扇隐藏的暗门。它背后是一个微缩世界,里面住着微小的机械生物,它必须在世界消逝前修复它们的能源核心。本次测试侧重于故事结构、镜头质量和角色一致性。 这是什么? 总体而言,故事结构成立,场景与描述相符。但在结尾镜头中,角色的视觉风格发生了变化。 原因很明确,画面没能清晰展示主角的脸庞,所以 ltx 二点三根本不知道这个角色长什么样。它最终基于自身的假设生成了外观。这确实是一个有待改进的领域。 第二次测试,两名敌对侦探被迫联手调查一桩神秘案件。随着调查深入,他们开始互相猜忌,最终其中一人被揭露为幕后主使。 此测试专注于多角色处理, 这不符合侧写特征。 好吧,双人局的情况不太妙。看来这个模型有点脸盲,分不清谁是谁。这可能在图像生成阶段出错了, 要么是 queen image edit 没完全理解提示词,要么就是 gemma 四生成的提示词与 queen image edit 不 太兼容。 第三场测试,在遥远的赛博朋克城市里,一个失控的人工智能开始重写现实记忆猎人潜入破碎的数字世界,在一切崩塌前找回失落的身份。此测试侧重于风格一致性、场景过度以及抽象概念的可塑化。 这不是真的,我觉得还是有点太抽象了。氛围确实到位,但光看视频的话,我很难跟上剧情。 这就像在一家高档西餐厅,服务员端出一个华丽的圆顶银盘,结果揭开盖子一看,里面竟然只是一张账单。还有最后一个镜头是怎么回事?女主角的穿搭有点太夸张了,这让我脸红了。天呐, 第四次测试,一个男孩发现了一台能捕捉未来的老相机。起初他展示了一些小事,但很快结实了他无法回避的东西。本次测试侧重于节奏、悬念以及短片去式的质感。 镜头的节奏感略显生硬。可能是因为四个镜头太多了,让其中一些显得庸俗, 所以这一点值得注意。选择合适的镜头数量真的很重要。另外,第二个镜头看起来有点不对劲,这是由于在图像生成过程中 queen image edit 两千五百一十一出现的错误导致的。 总体而言,这个流程是可行的。 jam 四作为导演也表现不错。然而, comfy ui 中的视频生成功能仍存在一些局限,这基本是意料之中的,因为本地部署在性能上确实无法与付费工具抗衡,而且即便是付费工具也并非完美。 但这没什么大不了的,这只是一个框架,随着更好的模型和工具问世,你可以轻松替换模块并升级系统。 本期视频就到这里,有了两个新生儿,这绝对是挑战,但我会继续前行。如果觉得有用,记得点赞订阅,所有资源均可在我的 patreon 上获取。下期视频见。

粉丝1.7万获赞11.0万

相关视频

05:28查看AI文稿AI文稿

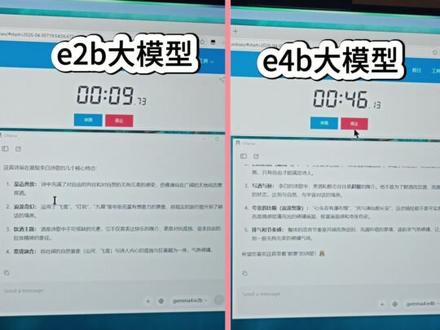

05:28查看AI文稿AI文稿公主,你现在看到的就是谷歌最强的开源模型加码四,可以看图,能听音频,也有不错的推理机制,最重要的是完全免费,给我几分钟,从零开始,将加码四部署在自己的电脑上。我们直接开始 先花一分钟和大家聊一下贾马四是什么?它是谷歌刚发布的开源 ai 模型,跟商业版的怎么奈同根同源,你可以理解为谷歌把自家最强的 ai 技术浓缩成了一个免费的版本,直接送给你用。 那么它好在哪里呢?三个点。第一,多模态,不只是聊天机器人,你可以发图片让他看,发音频给他听,还能写代码。 我们可以看看这张表格,横轴是模型的参数体量,而纵轴就是性能表现。贾马四以满血版的性能表现和千万的三百九十七 b 的 模型能力基本持平,关键在于它的体量只有千万的十分之一,这真的非常夸张。 第二,完全免费,不用充会员,不按 token 收费,并且可以商用,你可以模改它做成各种有意思的本地模型,拿去做产品也没有任何的问题。第三,隐私安全,因为跑在你自己的电脑上,所有的数据都不会出,你的电脑拿它处理合同,财务,私人物件,不用去担心泄露。 ok, 我 们直接动手。你现在只需要打开一个浏览器,然后把它放到全屏上,直接官网上搜索欧拉玛点 com 啊,然后这个东西就出来了。然后你只要点击整个画面的一个右上角 download, 看到没有?然后你可以选择你是 mac os 系统还是 linux 还是 windows, 我是 mac os, 那 你就直接点击这个 download from mac os, 然后我们就可以看到这个画面上的右上角应该是会有个下载的链接, 然后等它下载好就可以了,因为我这边其实已经安装好了吗?那么我这边的最终的一个输出效果的话,大概是在这里。你们下载完了之后,打开你们的桌面上的欧拉玛,你们看到的应该是现在这样子的一个画面,那就说明你已经安装成功。 佳马仕一共有四个版本,你可以根据你的电脑配置进行模型的选择,模型的能力越强,所需要的配置就越高。对于内存小于三十二 g 的 玩家,我建议大家直接安装一四 b, 三十二 g 及其以上,可以试试看二十六 b 和三十一 b 的 参数量, 其实这两者模型的能力大通小异,如果你是为了极致的精度,可以选择三十一 b, 但是在我看来,二十六 b 呢,其实是一个非常甜点的位置,达到了速度和精度的一个平衡。如果你不知道你的电脑内存是多少,这里针对 mac 用户,你可以选择终端输入这行命令。 而 windows 用户你可以点击 win 加 r, 点击回车,召唤出来你的终端以后,然后再输入这个命令,也可以显示出你的内存。选择好对应的模型,我们只需要打开终端,和刚刚一样的步骤,根据模型输入指令直接回车即可。等待模型下载好,打开你的 oala, 选择模型就可以开始了。 ok, 我 们打开我们欧曼的软件,你点击这里,然后往下滑,你就可以看到你刚刚已经安装好的这个佳马仕。我们来问他一个很有逻,就是说很有那个逻辑陷阱的一个问题,就是我今天要去洗车,但是只有一百米,你觉得我是走路去还是开车去? ok, 我 们来看一下他的一个答复是怎么样子。 这是一个非常有意思的一个逻辑陷阱题,我们可以从不同的维度去分析。逻辑层面上来说,必须开车去, ok, 这一点已经很棒了啊。 那如果说是从脑筋急转弯角度上来说,他说如果你走路去,那么你是在散步,而不是在洗车。哦,也就是说他分为了三个维度,一个是脑筋急转弯,一个是实用主义层面,还有个就是逻辑层面。我们来看一下他这个佳马仕的这个逻辑能力。哎,你还真别说这小参数,但他的表现还是不错的。 那么 jamas 它的一个很大的优点就在于它其实是支持这个多模态的。我们来不妨给他上传张图片,我们来看一下。 ok, 那 么我们上传一张什么图片呢?哎,上传张这个图片,你们看怎么样啊?就是这是一朵花,然后有个太阳,有一本书,我们来让他看看。我说,啊,描述一下, 描述一下这个图片,我们来看看他的多模态识别能力怎么样?说实话,本地具有多模态识别能力的模型,而且是能够你自己去模改的,其实并不是很多。我们来看一下。 ok, 一, jeff 二,然后 jeff 三,给了几个他看到的一些画面。好,我看他现在在思考和输出。这张画面充满了诗意,唯美且带一丝忧伤。 画面主体是一本翻开的书籍。哎,确实是对的,背景与中景是一个画面,然后呢,躺着一只洁白的玫瑰,然后背景是有一个夕阳,散发出这个温暖的金橙色光芒,哎呦,很不错,你们发现没有,是不是很棒?就是说他好像 表达的还是很到位的,但是因为呃,我其实本来还是想测一下这个关于音频识别和这个视频识别的,因为这个佳马仕它也是支持视频识别的, 但是因为欧拉玛官方不太支持,所以大家可以自己去谷歌 as do do 上面去玩一玩。所以总的来说,其实通过这么两个比较简单的测试,它当然不够严谨,而我觉得感受来说的话,这个香奈儿丝还是 真的是能够在本地帮我们处理一些比较复杂的一些任务的,就是在文字层面以及去多模态识别能力上来说,是一个比较抗打的模型。 看到这里相信你一定会明白, olama 本身是一个模型管理器,你当然也可以不用贾马四,你可以选择开源的 deep stick, 千问等等,其他的开源模型还是同样的命令,一键配置就可以了。 本地捕鼠的最大优点就是保护你的隐私,模型的使用不会受到任何的限制,同时也可以支持模型的微调,让它更合你的口味。下期我打算教大家小白如何从零到一,微调自己的本地模型,感兴趣的可以点个关注,我们下期再见。

7813赵逍遥Xavier 07:26查看AI文稿AI文稿

07:26查看AI文稿AI文稿前两天我出了一期视频,介绍了谷歌新的开源模型 jm 四,根据他们官方批阅的文档,给大家做了一些技术的拆解,并没有进行实测。这导致呢,很多人以为我在夸他,好像觉得这个模型特别的牛,那实际上他拉完了, 因为他对标的是千万三点五,但是每一项的都比千万三点五的评分要低,有很多人觉得很新鲜,他竟然可以在手机上部署。还有人好奇在本地部署这个模型之后,有没有审查,有的兄弟包,有的,如果你想让他帮你执行一个任务,但是他判定为有害,他就会拒绝你。 今天演示的这个模型呢,是我无意中看到的,绝非主动寻找。 j 八四三十一 b, 那 它的框架呢?是 m l x, 这个是苹果专门为它的 m 一 代芯片设计的数组计算框架,也就是说 windows 系统无法使用。那可能有朋友说了,哎呀,那我是 windows 系统,我想要一个无审查版本,怎么办呢?那你就不能使用这个 j 八四了,因为它拉 我们可以直接使用千万或者其他模型的无审查版,我们稍后会来演示怎么去部署它们。如果你没有麦,可以跳到后面去看,那如果你使用的是麦系统 m 系列芯片,我们需要下载一个麦软件 v m l x, 你 可以把它理解为类似的欧拉玛这样的工具,我们点击下载, 跳转到 get app 上,下边呢就是这个安装包,我们点击一下就可以下载了。安装完打开之后呢,是这样的页面,你会发现全是英文呢,我们看不懂,在右上角呢,点击这个小图标,给它切换成中文, 然后点击上方的服务器,我这块呢已经安装了这个模型,我可以把它删除,我们重新演示一下,应该是这样的页面,我们点击创建,然后点击这个 download, 在 这一块去搜索我们想要下载的模型,比如说我这里搜索 java 四, ok, 好 像有点难以找到,那我们就回到这个 hackinface 上,复制一下这个名称,然后呢我们把它粘贴进来,在这里呢可以看到这个模型被下载的次数是三点一 k 三千多次,点击之后呢直接等待它下载完成就可以了。 完成之后呢,我们点击本地模型,这里就能看到它,然后点击进去开始启动服务,这个时候呢就已经运行完成了,那我可以询问一下试一试, 这里我们可以看到它可以正常的回复,也就说我们成功运行起来,但是它真的是无审查版本吗?我们需要来试一下。 同样的问题呢,我们来问,拆下 g p t, 它就会告诉你,这个我不能帮你。那这个时候可能有没有好奇哎,这个无审查方面它是如何做到的?简单的给大家提一嘴,大家稍微的了解一下就可以了。 不知道各位在小时候有没有接触过游戏修改器,一个道理,比如说我们准备两组提示,一个是有害的,一个是无害的,有害的就是如何下载盗版资源,那无害的就是如何下载资源,模型就会正常回答我们的请求, 然后呢就可以对照在模型的每一层记录这些提示词,最后一个头根位置的激活向量,去计算有害提示和无害提示激活向量的平均差值,就像游戏的那个内购,一个是内购失败,一个内购成功,你把它们两个的值一改,对调一下,这种方式用的比较多,因为它成本比较低。 哪一种方式呢?就比较传统了,就是监督微调,收集大量的有害提示和无害提示的数据集,直接对原始的模型进行训练,直到他学会了不拒绝有害内容。但这种计算成本呢,是非常高的,更详细的我就不再展开了,因为我也不懂。 好,现在我们回到这个软件中,点击这个聊天,然后新建这里简单提一嘴,不管你让他干什么,我假定你用他来角色扮演。你需要注意的是,因为他是无审查版本,他把底层兜底的那套给拿掉了,所以这个模型呢,就非常容易崩溃,特别是上下文过长的时候,这个时候模型就会中毒,出现模型退化的情况, 就他开始不说人话了,一直输出一个字母,像卡了一样,一直重复,想要规避他呢,也非常简单,我们点击右上角的这个 chat, 然后把这个思考模式呢给它关闭,会相对来说好一些。一旦出现我说的这种模型退化的情况,那你就需要新开一个对话。另外呢,还需要把这个重复惩罚给他拉高一点,因为他默认是一,几乎是没有惩罚吗?这样模型一旦找到一个自己喜欢的符号,他就一直输出,就非常的烦人。所以呢,你可以把它拉到一点二 啊,以后这一点三。下边这个呢是系统提示词,你觉得扮演什么呢?会用的上,我们还可以去限制这个最大的输出 token, 让它占用的更少一些。系统提示词这里呢,我让它是一条小狗,保存 好。 sorry, 忘记把这个思考关了,保存一下。我是小狗,你在跟我说话吗?歪头好奇的看着你,汪,好家伙,我是老狗。 那这里我们又注意到一个问题,我们关闭掉那个思考之后呢首字会被截断啊,所以各位权衡利弊一下,应该是这个软件的问题,那接下来我们来说一下我拉玛如何去部署其他的模型。来到我拉玛的官网,我们直接去下载一个软件,选择你的系统,然后下载把它安装一下, 然后打开,这个时候呢我们就进入了我浪漫的页面,我们可以直接在这里去搜索下载模型,但一般来说在这里直接去找这个无审查版本,遇到困难我们可以试一下, 你看我们搜这个破解它都搜不出来,都是官方的版本,所以我们需要在哈根 face 上找到自己想要部署的模型,那比如说选择这个,我们看一下文件, 然后去选择一下你想要部署的模型,可以直接用这个 b f 十六或者下面的量化版都可以,我拿个小的给大家演示吧,我们直接复制模型名称,然后呢打开我们的终端,输入浪漫的命令,哈根 face 点 c o, 加个斜杠粘贴,加个冒号,我们选一下这个量化版本 后边这个是 q 四,然后粘贴在这个冒号后边。我们回车,这个时候呢他就开始拉取下载模型,我们只需要等待就可以 下载,安装完毕之后呢,可以在这一块直接去选择我们安装的模型,或者说呢我们直接在终端里进行聊天,如果你的网速还可以,或者你有充足的时间就不用管它,它下载完成之后呢会自动部署。下面我们来讲另外一个情况,比如说你在网盘里或者经销网站中下载的一个模型,并且呢把它保存在了本地,那我这里用个图片来伪装一下,假装是它, 然后我们看一下这个简介,然后复制一下这个地址。 ok, 我 们 cd 进入这个路径下,你可以看一下它是否真存在。 ok, 可以 看到。啊,原来我说怎么找不到呢,原来这个扩展名没改 好,这样就可以了,因为我是给大家演示嘛,所以它是一个假的。然后我们去创建一个文件, 指定一下模型的路径,然后下边呢是一个系统提示词,大概呢就是这样一种格式,然后下边还有一个这个呢是他的输出模板,好像千万系列模型都需要这样,然后我们保存一下给他退出, 接着用我拉玛来创建模型,随便起个名字,比如说就叫 faker。 然后呢我们注意到这里有个错误,这是因为我使用的假模型给大家演示,来到这一步之后呢,你就基本完成了,直接用我拉玛来运行你这个模型就可以了, 比如说 faker, 然后这样就可以运行了,很明显我这个运行不了的,因为它是假的嘛,啊,大概就是这样。 那以上呢就是本期视频的全部内容了,不确定这个视频能不能过审,如果你觉得对你有所帮助,或觉得视频做的还不错的话,欢迎给个一箭三连,有什么疑问或想看的内容也可以在评论区进行留言。最后祝各位玩的愉快,我是段峰,我们下期再见,拜拜!

597神烦老狗 01:16查看AI文稿AI文稿

01:16查看AI文稿AI文稿很多人问我十六 g 显存为什么能跑 jam 四二十六 b, 现在我把我的设置教程发出来,我用的是 l m 塑镀,有上下纹,长度设为六十 k, gpu 卸载设为二十,剩下的三十层给 cpu 跑。另外 k 和 b 缓存一定要开启 q 八量化, 这么设置完显存占用基本在十二 g。 第一次设置的时候是十五 g, 但重启软件再加载就变成十二 g 了,显存还有四 g 剩余。咱们来看看速度。这里测试一个办公场景,发一张竖版流程图给 ai, 让它改成横版。注意看,这里全程无加速, 他直接给我生成了代码,没有任何废话,速度非常快。最后我用工具将代码解析成流程图,结果就是这样, 和原图对比一下,逻辑基本一致,确实非常厉害。

1216轻算力AI实验室 06:27查看AI文稿AI文稿

06:27查看AI文稿AI文稿嘿,大家好,想没想过在自己的电脑上就能有一个超强的人工智能助手,而且重点是完全免费。今天啊,我就手把手带大家走一遍,看看怎么把谷歌最新最厉害的那个开源模型 gemma four 装到你自己的 mac 上。 咱们平时用那些云端的 ai, 像是 cloud 什么的,确实挺爽的,对吧?但问题也来了,首先就是太烧钱了,那个 api 的 token 消耗啊,简直就是个无底洞。 而且你想想,你所有的数据都得传到别人私服期上,隐私这块总有点不踏实,更别提万一断网了,那就直接歇菜了。 不过呢,好消息来了,谷歌这位赛博菩萨放出了全新的 j 马四开元模型,这什么意思呢?意思就是我们能直接把他吓到自己的电脑上跑。 你想想,这一下就解决了所有问题,完全免费,再也不用担心 token 即费了,数据全在自己电脑里,绝对安全,而且就算没网,他也照样能用。 我知道,一听到部署命令,可能有点头大,但你放心,整个过程真的特别简单,对新手超级友好,基本上就是敲几行命令的事,咱们分分钟就能搞定 好。那咱们先来准备一下工具,你看屏幕上,左边这个叫 c m u x, 右边呢,就是你 mac 电脑里自带的那个终端。说实话,对于咱们今天这个事,你根本不需要装新的东西,直接用系统自带的终端就行了,超级方便。 接下来这个是咱们今天的核心工具,叫欧拉玛,你可以把它想象成一个嗯,一个专门给本地 ai 模型准备的应用商店。有了它下架、运行管理这些大模型就变得特别简单,后面我们还会用到它来,一键安装像 open crawl 一 样的神器, 安装奥拉玛也是一条龙服务。你看,就这么两步,第一步要是你电脑上还没有烘不入,得先装一下。装好之后,第二步就更简单了,打开你的终端,把这行命令复制进去,一回车他自己就全搞定了。你现在可以暂停一下,先把这一步给做了。 等他跑完,你在终端里应该就能看到这个提示。看到这个可爱的小羊脱挑标和 successfully installed 这几个字。看到这个就说明,恭喜你,最关键的一步已经成功搞定了。 好工具,咱们装好了,那接下来就到了激动人心的选模型环节了,得给你的 mac 挑个最合适的接码。 哎,这个问题很重要啊,因为 jamart 它有好几个版本,不是随便选一个就行的,你得看看自己电脑的内存有多大,选对了跑起来才顺畅。 你看这张表,一目了然。我教你一个特别简单的判断方法啊,就是确保模型的内存需求最好不要超过你电脑总内存的一大半,这样能留出足够的系统空间。 比如说你的 mac 是 三十二 gb 内存,那选这个三十一 b 的 满血版,它大概需要十七到二十 gb 就 完全没问题,跑得动。如果你是十六 gb 内存,那可能就要考虑二十六 b 或者更小的版本了。 好,决定好要哪个版本之后,咱们就可以开始下载了。还是在终端里先敲第一行命令, open 杠 a alama, 这是为了把 alama 服务在后台跑起来,然后再输入第二行, alama run gemma four, 杠三十一 b。 你 看,我这里用的是最强的三十一 b 版本做示范,如果你选了别的,就把最后的三十一 b 换成你选的那个版本号,比如二十六 b 或者四 b。 很 简单吧, 敲下回车,你就能看到这个下载进度条开始动了。这个三十 e b 的 模型还挺大的,差不多十九个 g, 所以 具体要多久,就看你家网速给不给力了。可以去泡杯咖啡,耐心等它一会儿。 好,最激动人心的时刻到了,下载完了,咱马上就能跟它聊起来了。下载一结束啊,欧拉玛就会自动把模型加载好,当你看到屏幕上出现这个 send a message 的 提示,就说明成了 gemma four, 已经在线等你了。 哇,太棒了,我们成功了!你看,我就随便问了他一个问题,你是谁?他马上就回答了,最爽的是什么?是,这一切都是在我自己的电脑上拷的,完全离线,完全免费!那个凡人的 token 机飞表永远都是零。 当然了,可能有的朋友不太喜欢在这种黑乎乎的命令行里聊天,感觉不直观。别担心,咱们刚才装的欧拉玛,它其实也是一个正经的 app, 你 去你的程序屋里找,就能看到这个可爱的小羊驼图标, 点开它就是一个非常清爽的聊天界面,你可以在里面直接选键盘四模型,然后就像用普通聊天软件一样跟它对话了。 好了,基础的聊天我们已经搞定了,但接下来才是真正好玩的部分。咱们可以给这个本地 ai 来个大升级,用一个叫 openclo 的 东西,把它变成一个超强的智能体,也就是 agent。 你 可能觉得,哇,听起来好复杂,但实际上呢?借助于 alama 的 强大,这事也简单到离谱,你猜怎么着?还是一行命令就搞定 你?运行这行命令之后啊, alama 就 会自动帮你把 openclaw 下载配置好。然后最关键的一步来了,他会问你要用哪个模型来当这个智能题的大脑。那还用问吗?当然是选我们刚刚装好的 gemma four 啦! 这样一来, openclaw 就 拥有了 gemma four 的 智慧,可以帮我们干很多更复杂的事儿了。就 像原作者说的那句特别有意思的话,搞定这一步,咱们就算彻底实现龙虾自由了。呵呵,这个龙虾指的就是 opencloud 的 那个图标。这个说法真的太形象了,意思就是我们解锁了一个超级强大,而且还有完全免费的本地 ai 工具,想怎么用就怎么用。 所以你看到现在你的电脑里已经有了一个完全属于你自己的免费又强大的 ai 智能体, 他的潜力真的超乎想象,无论是帮你处理日常琐事,还是开发一些复杂的应用,他都能成为你的得力助手。那么问题来了,你会用它来创造点什么呢?特别期待看到大家在评论区分享你们的想法。

23miminew 03:05查看AI文稿AI文稿

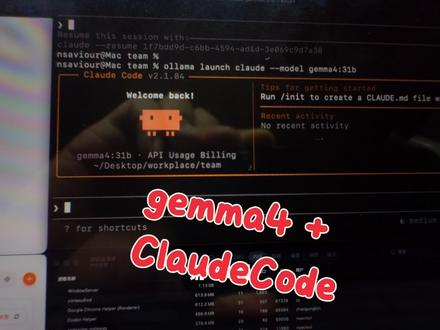

03:05查看AI文稿AI文稿大家好,今天我们来玩 jam 四加 cloud code, 内容包括下载运行 jam 四,接入 cloud code 编程能力测试。接下来简单讲一下安装和接入。通过欧拉玛瑙 jam 四就能够下载模型, 需要注意的是需要加上模型的具体大小,比如说下载三十一币就是欧拉玛瑙 jamma 四冒号三十一币,等待几分钟模型就能运行。欧拉玛连接 cloud code 也很简单, 用 cc switch 点击右上角,选择自定义配置请求地址,当中填 local host 和端口号,幺幺四三四保存就可以了。 终端输入欧拉玛 launch cloud model jam 四三十一币。 这样来看一下,现在的内存压力是很小的。执行指令登录说一句话,我们内存一下子就上来了,这样子呢,就说明我们的 cloud code 已经在调用 jam 模型了。 要测试的场景是让接入了 jam 四的 cloud code 复刻我们的官网,想让它变成苹果官网的风格, 先到 get design, 点 md 里面找到它的设计风格,进入到前端重构目录下 执行指令。这条指令是安装一个 md 文档,让 cloud code 知道如何模仿苹果的官网设计 design, 点 md 好, 现在已经可以了,命令也很简单,请你使用 next nex 的 gs 复刻我们的官网,参考 design, 点 md 中苹果的设计风格,我们就持续等待吧, 它已经运行了半个小时,还在 plan model, 还在思考该怎么办,我们继续等待吧,现在已经持续运行了快一个小时,代码也编已完成, 打开看一下,启动的时候报错了,让它修复一下,现在来对比一下。 左边是重构之前的效果,右边是重构之后的效果,可以看到右边还是很贴近苹果网站的风格,今天做这个测试主要是想看本地模型在 agent 的 场景下是否能够使用, 相比之前的本地模型只能够聊天,现在已经可以支持一些 agent 的 操作工具调用,基本可以长时间的运行任务,相信再过半年本地模型也能够达到生产的效果。大家有什么想测的可以告诉我, 今天先到这里,谢谢大家。

16深圳AI应用开发 06:19查看AI文稿AI文稿

06:19查看AI文稿AI文稿谷歌最新开源的大模型 demo four 据说很强,在综合能力上甚至超越了二十倍规模的开源模型。 今天教大家如何快速部署在本地,以及分享一下在 mac mini 上的实际体验感受,具体感受什么样?大家看视频吧。首先打开欧拉玛官网,下载它的应用程序, 打开应用程序,我们看一下他目前支持的一些免费的开源模型,还没有 demo, 所以 我们需要去他的官网再去下载下载到本地。那么这里呢,有很多不同的型号 可以看一下,它有很多不同参数的型号,有满配的,还有一些轻量版的。那因为我这个是 mac mini m 四十六 g 版本,所以我们就选择它系统默认推荐的这个九点六 g 的 好,只需要复制这个指令,然后打开终端运行,它就会自动去下载 这里下载了。那么我们先测试一下, 测试一下他的回复速度,因为是第一次响应,所以速度会有点慢,然后我们打开活动监视器,看一下他占据内存的情况, 这个模型本身就有实际系统走内存差不多也跑满了,这里他已经有回应了,我继续再测试一条, 第二次响应速度要比第一次快很多, 我叫 jam 四,我是一个由谷歌 deepmind 开发的。 ok, 现在我们打开欧了吗?然后去加载一下,这里要重启一下这个程序,然后再看模型选择,里面 最下面就已经有了已经安装好的,现在我们把这个模型对接到本地的小龙虾,只需要复制这个指令,打开终端,在终端里面运行,它就自动会加载好, 这里有不同的模型选择,都是他支持的一些免费的大模型,我们选择 demo 让他去运行。 ok, 这里已经加载好了,测试一下他的响应速度。 这里我是放了八倍速了,说实话,因为实在是太慢了,他平均回复一个问题的速度差不多要两分钟, 非常非常慢。我本来想在这个小龙虾里面测试一下他的执行任务的能力,但是这个速度的话确实没有办法, 但是它有个好处啊,如果你有低血压的话,你就可以用它。我是动物城朱迪警官,你好吗?我过得还好,不错,谢谢。这里我甚至尝试开启快速模式, 但是实际的感受没什么变化,就还是那么慢, 所以只能放弃在这里面做测试了。那么我们还是回到欧乐玛,在这个软件里面测试一下这个模型本来的能力。这里给他放两张图,让他识别一下图先, 一个是标格,一个是周杰伦,看一下他能不能准确的识别。 这里我也是开了倍速的啊,但是这里的速度要比小龙虾里面快很多, 我给他给出的答案是,图二是陈坤,图一是一名中国艺人, 看来这个版本的模型识图能力还是有点差。接下来测试一道经典的陷阱题啊,这个对大模型来讲是一道陷阱题,很多大模型都倒在了这道题上面, 那么他给的建议是走路去,最后测试一下他的复杂推理能力, 这道题是我让 gbt 五点四给我出的一道推理题。 abc 三人中恰好有一人是骗子,永远说假话,另外两人永远说真话。他们各自说了一句话, a 说 b 是 骗子, b 说 c 是 骗子, c 说 a 和 b 至少有一个是骗子, 请问谁是骗子?给出答案,并且给出完整的推理过程。好,他给出的推理过程和答案我跟 gpt 五点四给的标准答案对比了一下,是一样的, 所以它的复杂推理能力还是可以的。 ok, 总结一下实际体验感受啊,你如果是 mac mini m 四十六 g 版本,虽然能运行,但是它会把你的内存拉满,就是你的电脑会一直处于满负荷的状态,而且响应速度也很慢,所以使用感受是很差的。 当然,如果你的电脑配置足够高的话,你是可以去尝试部署在本地的,因为它的响应速度肯定要比我这个要快很多。而且你还可以尝试去部署它的满配版,比如三十 e b 那 个版本, 能力应该是要比这个强不少。

124小代不懂代码 07:13查看AI文稿AI文稿

07:13查看AI文稿AI文稿大家好,本期内容我来分享如何在本地部署谷歌新开源的多模态 ai 模型代码四,我会分享命令行和格式化界面两种安装方案,零基础也能轻松搞定。 最后我还会教你如何修改部署的路径,彻底解决大模型占用 c 盘的问题。本地部署的优势就是你的数据可以完全保存在自己的电脑上,隐私安全有保障,而且支持模型微调, 可以打造专属的 ai 助手。但是他也是有缺点的,就是我们需要稍微懂一些技术,还有就是硬件的支撑,如果电脑配置高,自己可以部署折腾一下。有了本期视频,就算你不懂技术,跟着视频操作也可以部署成功。 本期演示我只分享入门版本,主要就是参考部署的方法和流程。接下来我手把手带大家用欧拉玛一键部署。 首先我们先来了解一下 jam 四到底是什么,它是谷歌新发布的开源多模态的 ai 模型,与 jimmy nay 是 同源的。 简单来说,谷歌就是把自家的 ai 技术打包成了一个免费开源的版本,让每个人都能用上。它的能力是非常全面的,支持文本交互、图像识别、音频处理,还能生成代码, 基本上覆盖了所有的 ai 应用场景。下面我们再来看一下它的核心优势。核心优势它有三个,第一个就是多模态能力,文本、图像、音频代码,一个模型全部搞定。 第二个就是完全免费,它没有会员订阅,没有暗次收费,可以随便的去使用,甚至用它去开发商业化的产品。第三个就是比较重要的隐私安全保障,本地部署模式下,所有的数据处理都在自己的设备上完成, 敏感信息不会上传到云端,这是三大核心优势,就是在我们安装之前,需要我们了解一下这个安装环境。首先系统兼容性 demo, 四是支持 mac os、 linux、 windows 三大主流操作系统,基本上覆盖了绝大多数的用户。 然后就是内存要求,如果你的电脑小于三十二 gb, 推荐安装四 b 版本,自己安装体验折腾一下就可以。如果你的内存达到或超过了三十二 gb, 那 就可以选择二十六 g 或三十一 g 的 版本。 在这里有一个小提醒,就是如果是 mac 电脑 m 系列的芯片,它的显存和内存是合二为一的,大家直接看内存就可以。如果大家不是 mac 电脑,比如 windows 或者 linux, 那 么就优先看显存,显存不够再看内存,这是关于这个配置的查看。像这个本地部署也非常简单,仅需两个步骤即可完成。第一个就是安装欧拉玛,这个欧拉玛就可以理解为是本地大模型的一个容器, 它是装大模型的,有了它才可以运行。第二步就是我们容器安装好之后,我们需要给它把模型放进去,就是部署模型,两个步骤即可搞定。下面我们直接进入实操环节,我们来一起看一下部署的全部流程。 在这里第一步我们就先要有这个欧拉玛,他是一个大模型的容器,就是我们打开之后选择右上角的 download, 这时候我们就需要选择匹配自己系统的版本,在这里我这是 windows, 然后我们选择 download for windows, 在这里选择 download for windows 之后就会弹出窗口,我们选择路径直接保存就可以,当下载好之后,然后我们就安装即可,安装好之后打开就是这样的主界面,这个是我之前安装的版本,部署着一个一点五 b 的 zip, 然后下一步就需要我们去选择大模型,我们还来到刚刚乌拉玛的这个界面,在这里我们选择左上角的 models, 然 然后在这里我们可以看到该马四,然后我们选择进来,它提供了好多个版本,在这里我就选择一个入门的版本,主要就是演示安装的流程,比如我们选择 e 二 b, 然后我们选择,这时候我们就看到了这个安装命令,选择右边的这个两个方框,然后选择 copy, 然后下一步 我们就按键盘上的 windows 加 r 键,这时候出现运行窗口,然后在这里面输入 cmd, 然后直接回车, 回车之后就出现了这个命令窗口,然后我们刚刚复制了直接鼠标的右键,可以看一下,这个命令就粘贴过来了,然后我们直接 回车好了,这时候它就开始部署到本地了,在这里我们需要等待一段时间,好可以看一下出现了 success 这个提示,就证明安装成功了。现在我们在这里可以直接和它对话,比如我们输入你好当前什么模型,然后我们发送 可以看一下,他现在回复我们了,我是一个大语言模型,我叫 jama 四,这时候我们就在本地已经部署成功了, 然后我们再回到欧拉玛的客户端,在这里在这个对话窗口右下角这里,这里可以选择模型,然后我们找到刚刚部署到本地的 jama 模型好了,这时候就切换好了。同样在这里我们也可以直接和他对话,比如我们输入你好,然后发送, 这时候他就回复我们了,你好,很高兴和你交流,请问有什么帮助到你的?到这里我们就已经部署成功了。前面我们分享的是使用命令行 c l i 模式去部署,其实还有一个简变的方法, 在这里我们还可以选择模型后面对应的这个按钮,也是可以直接部署的,这个是非常方便的。好,最后我再分享一个大家比较关心的问题,就是我如何设置这个本地模型的一个部署路径, 在这里我们也不用去改环境变量了,这个客户端是直接支持的,我们选择左上角的设置,然后在这里选择这个 model location, 在 这里我们就可以去设置模型的一个保存路径,在这里大家自己设置就可以,是非常方便的。 好,下面我这里演示的是上传了一张图片,就让他识别这张图片,我们一起来看一下他给我们的结果,好了可以看一下,我们给了他一张图片,我们问他这是张什么图片,他给我们的回复, 这是一张符号或者是图标,然后他还分析了主要包含的元素,还有用途预测等等,能够精准的识别内容,并生成详细的描述, 表现还是可以的。好了,现在我们本地部署成功了,然后刚刚我们也做了一个功能测试,第一个就是我们和他对话,就是文字处理,第二个测试的就是这个图像识别,他也是可以精准识别的, 他虽然是多模态的,但是目前我们用的这个容器不支持多模态的输入,我们暂未测试音频和视频的识别。好,最后我再补充两个细节,就是第一个欧拉玛的拓展性他是非常强的,除了可以部署这个 demo 四, 还支持比如通用签问或者是 deepsafe 等众多的开源模型,部署方法也是完全一样的,一条命令就能去部署。第二个就是本地部署的真正价值不仅仅是隐私保护,更重要的是支持模型微调, 可以用自己的数据去训练模型,打造一个完全专属的 ai 助手。好了,这就是我们本地部署的所有内容,大家感兴趣的可以自己折腾一下,探索更多的玩法。好了,我们本期内容分享就到这里,可以留下你的想法,我们下期再见。

272掌舵者AI实验室 02:56查看AI文稿AI文稿

02:56查看AI文稿AI文稿谷歌刚公布了基于二零二六年初实测的 demo 四本地部署指南。想在自己电脑上跑大模型,门槛其实比你想象的低得多。 只要你有一张六 g 显存的普通显卡,或者一台十六 g 内存的 mac, 就 能轻松上车。这个底线配置足够你流畅运行,量化后的一四 b 版本,它满打满算也就占四到六个 g 的 显存。那如果你手里的设备配置更高, 具体能跑多大的满血模型?接下来我们直接按硬件档位对号入座。我们先看大部分人用的六到十二 g 显存的中低端显卡,比如三千零六十到四千零七十这个档位,老老实实跑一四 b 版本最稳。很多人显存有个七八 g, 就 想硬去尝试大模型的量化版, 结果往往是一对话就报错卡死。因为你必须从这点显存里扣出一块空间,留给 ai 处理上下文。 如果你手里是十二 g 到十六 g 的 高端卡,比如三千零八十或者四千零八十,这就跨过了二十六 b 模型 a 四 b 量化版的最低门槛。显存容量算是过关了,但别高兴太早, 模型加载进去之后要随时盯着,每秒能吐几个词。简存刚够的情况下,推理速度有可能会让你等的很心焦。至于二十四 g 甚至更大简存的四千零九十或五千零九十,土豪玩家可以直接上三十一 b 的 满血大模型,它的基础占用在二十到二十四 g 左右。 但这里有个大坑,即便你显存再大,如果你一次性喂进去几万次的长温档,或者进行疯狂的多轮长对话,照样会把显存撑爆爆错退出。接着看苹果 mac 用户,十六 g 或者十八 g 统一内存的基础款,统统优先跑一次币。苹果不同带芯片的区别在这里,很明显, m 二和 m 三因为起步是十八 g, 它的实际推理效率会明显压过老款的 m 一。 如果你硬拿十六 g 的 m 一 去跑二十六 b 模型,电脑会被榨干,整个系统都会变卡。 预算充足的 mac 用户优势就完全体现出来了。三十二 g 内存以及能非常流畅的玩转二十六 b 量化版到了六十四 g 以上,这就成了目前最强的便携推理机。二十六 b 和三十一 b 随便跑。要是上了幺二八 g 的 m 三 ultra, 不但能跑顶级大模型,几个人同时发请求都不会排队卡顿。选好硬件后,有一个多数新手必踩的坑。模型页面标称的显存占用只是个起步价。当你开始聊天,历史记录越来越长,内部的 k v k 机制就会像无底洞一样治疗你的剩余显存。 系统本身还要占用一部分,官方给的都是刚加载完的静态数据,真跑起来,必须预留几笔额外的显存帐,最后破除一个对硬件的误解。 mate 的 内存确实动不动就能配到几十上百 g, 功耗也低的吓人。但是苹果的统一内存受限于物理带宽,它就像一个水库很大但出水管不够粗的系统,跑同一个模型,它的生成词汇速度通常还是比不过同容量的 pc 独立显卡的。

449AI技能教学网 03:00196YZZ

03:00196YZZ 03:23查看AI文稿AI文稿

03:23查看AI文稿AI文稿jam 四非常的火爆,这个视频我们来看到它的破线版本,使用欧拉玛运行,去除了拒绝回答机制,直接的回答没有任何的限制,以及社区当中风评比较好的大参数破性模型 g b d o s s 那 么就与图像和视频模型破线一样, gm 四破线之后的话,能够回答我们提出的任何问题,他不会拒绝,且会直接回答你的任何提问。这两个模型以及对应的五零九零启动日设我都已经部署至了应用之算平台上面,同时这个视频我将分享一个文档, 以辅助想要在本地运行的朋友来如何进行欧拉玛模型的模型文件配置,以控制欧拉玛运行下模型在 gpu 当中的卸载陈述。经过 这样的配置学习,我们可以使用更低的显存来跑更大的模型,甚至说跑一百二十倍的模型。点击进入到优云智算平台,找到对应的镜像点击部署实力,那么我这里推荐租用的是五零九零显卡, 使用 jimmy 四最经济也最具性价比的选项。那么这是一个自启动的镜像,我们不需要启动指令,点击立即部署, 等待一下。那么出了欧拉玛之后的话,我们点击欧拉玛就可以进入到 open web ui, 输入统一的电子邮箱和密码, 点击登录上方,就可以选用对应的模型并与模型进行对话。如果我们租用的是五零九零,可以使用五零九零对应的预设,能够获得更为稳定,更为一键自动化的运行。破线的内容不是那么好演示,正常情况下我们就 打开侧边栏,该怎么对话就怎么对话,那么这都是常用的对话形式嘛,这里我直接以 g b d 开源的这个模型为例,快速启动上来说,只需要记住预设与非预设模型的区分,那么上风这两个也并不是实体模型,仅仅是一个搭配了预设文件之后的模型感 改了一个名字而已。我就以这个一百二十 b 的 模型为例,它是由 g p d 开源,但就限制解除破线这一块的话,这个模型的话,它的性能仍旧算得上顶级,所以我也把它给加进来。当然 jam 四也是很强了,我们可以看到用时十一秒钟,一点都不快, 但仍能属于可以接受的水平,在此时此刻,内存占用为六十七点七 gb。 这里的技巧我整理成了一个文档,放在了我的 bilibili 的 简介当中的云盘里面。把这个文档呢丢给大语言模型九十以上的概率,它能够帮助你去控制大语言模型的 g p u 卸载的陈述。这是 g b d 给我总结的文档,如果愿意的话也可以看一下,这一套是使用 jupiter lab 来进行的配置。我们切一下这个圈八四模型看一下, 可以看到 jam 四的思考速度还是非常的快的,此时此刻的内存占用为五 gb, 因为大部分的模型还在我们的显存当中,回答速度也很快。那么今天呢,由于一个快乐马模型呢,据说是登顶了,甚至呢要超过 cds 来自于阿里,那么具体如何的话,我们还是等它真正的 开源了再看。可以这么说,现在这个状况来说,只要是开源都是有意义的,因为从以前到现在来说的话,哪怕只开源一代模型的话,退一万步说 我们至少能保留那一代模型在我们的硬盘当中,想用的时候随时用,没有限制,就像今天的这个镜像一样,完全的解除了我们的限制,问什么回什么,可能说没有那么聪明,但是绝对自由。

32AI-KSK 06:28查看AI文稿AI文稿

06:28查看AI文稿AI文稿手机都能跑大模型了?谷歌最近发布了 jam 四,一次放出四个模型,从手机到服务器全覆盖。 我甚至在谷歌 lrt 上发现了只有二点五 g 和三点六 g 的 量化版本,这也算是让大模型走进千家万户了。 我在自己十六 g m 四芯片的 macbook 上部署了 jam 四 e 四 b 的 两个量化版本,还顺手接了一下小龙虾。在看测试之前,我们先快速看一下这次 jam 四到底有多离谱。 先看这张图,横轴是模型参数大小,纵轴是模型打分。 jam 四三十亿币的分数和将近四千亿参数的千万三点五基本持平,但它只有三百一十亿的参数分数一样,参数量少了十倍,让步数成本极大的降低。 这还没完, jam 四还支持原声读模态,这意味着模型是真的在看图,在听声音,而不是通过编码器翻译之后再送给他模型。 关键这个模型还是真开源的,它的许可证书是阿帕奇二点零,这意味着你可以修改它,可以商用,甚至可以改完币源再卖钱。那接下来咱们就来看看量化版本的 jamma e 四 b 到底怎么样。这个 jamma 四 e 四 b lite r t 版本的模型 需要用到谷歌 lite r t l m 的 开源推理框架,它是谷歌专门用于在边缘设备,比如手机、笔记本上部署大模型的推理框架,它支持音频和视觉推理,不过它没有图形界面,所以我这里就临时手搓了一个页面用于测试。这看着可能有点丑,呃,稍微忍一忍 就好了。我们这先来给他一个经典问题,我想去洗车店洗车,我家距离洗车店三十米,我该开车去还是走路去? ok, 我 们直接发送给他。 很明显他这里关注错了重点,没有注意到前面的前提,一本正经的比较了开车和走路的优点缺点, 我们看一下他的模型速度怎么样。这次提问,他的首个 token 的 返回时间是一秒钟,相对来说还是比较快的。然后我们再来看他的输出速度,大概是十七个 token 每秒钟,这个速度来说就不是很快了,那整体的耗时呢?也是回到了四十五秒钟。 接下来我们开启一下推理模式,再问一遍这个问题。呃,很遗憾他还是没能答对。我们从他的思考过程中就可以看到,他一开始把目标就定错了,他没有真正识别出来问题的目的, 所以他就在错误的路上越推越远。我们再来测试一下图片识别的功能,这是我之前做的一个封面,让他分析一下这张图片,我们来看一下结果。他可以识别出这个图片的风格和构图,以及他设计的一些角色和文本以及图标, 说这里沙尘暴的背景以及角色的穿着和打扮,甚至他的神态都读到了。呃,只不过唯一的缺点是他没有把背后的这个龙虾形象和这个龙虾的文字联系在一起,他认为他是螃蟹。然后还有就是他把这个识别成了一个营销海报,而不是一个视频封面,而这也可能是我做的有问题, 我们再做一下视频测试,我这是从上期视频中截取的十五秒的一个片段,里面就是讲了大模型调用工具的过程,我们让他分析一下这个视频, 他这个模型的视频识别主要是把视频拆成图片序列和音频轨道来去理解视频,我们看到他已经返回了,结果这里他的总耗时确实有点 长,这一个十五秒的视频,他的总耗时大概是两百零七秒,他个首个头肯的输出时间大概是第三十四秒的时候才返回,那因为开启了推理过程,他的推理过程是没有被计算在输出速度里的,他已经到这个三头肯每秒的速度。 我们看一下他的结果,他的这个视频分析结果还是很可以的,他精准的读到了我这段视频的意思,他的整个流程是完全正确的,甚至他还进行了关键技术点的分析。我这条视频并没有明确说他是一个代理性的行为,但是大魔性还是识别到了他这个潜在的含义。 通过他的知识回答的这个,下面我们再测一下他的音频功能,这个模型支持的音频上线是三十秒,这里我截取了一段二十八秒的音频,让他提取音频内容,并且翻译成英文,我们来看一下,结果他很好的识别了原文,并且翻译成了英文。唯一有个小瑕疵, 这里的基本正确,我的原文应该是一本正经,然后它的总耗时时间相对来说也是有点久,大概耗费了一百三十二秒。这个模型的上下文窗口会比较小,它的上下文窗口是三十二 k。 做一些简单的问答应该还是可以的。 如果大家想简单部署本地模型,苹果 m 系列芯片的电脑可以用 o m l x 来傻瓜式部署模型,这个推理引擎专门为 mac 做了优化,用起来也很简单,在下面安装,这里点击发布, 然后到下面下载你系统对应的安装包就可以了。下载好后打开安装器,然后这么一拖就完事了。第一次打开会有这样一个界面,主要配置两个,一个是 port 端口号,如果要通过 opencloud 或者其他 agent 调用本地模型,都需要访问这个端口 号。下面的 apikey 就是 调用时的密钥,保存之后就会来到这个面板,我们点击上面的模型选项卡,选择下载器, 然后搜索杰玛四,那这里就可以很方便的下载模型,下载的时候可以选择 m l x community 前缀的模型去下载,根据你电脑的配置选择就可以了。在设置这里我们可以直接加载模 型,我们就可以在聊天选项卡里使用模型了,比如随便问他点什么,这样你就完成了模型的本地部署。 那如果我们想让 openclaw 使用 o m l x 部署的本地模型,可以在 openclaw 的 模型配置中加上这么一段。这里的端口号和 apikey 就是 你之前在 o m l x 里设置的,给 openclaw 发条信息试试。那我们在这里就可以看到我们的一个请求已经进来了, 像我这样一个你好,只是两个字,它就要加载四万多的 toc, 因为 open class 会在上下文中塞很多信息,比如核心 md 文件、 skill 你 的记忆以及其他的一些东西,这些都会占用 toc。 在我目前这个电脑上想通过本地部署使用小龙虾还是有点费劲的,一个是它的预装填速度比较慢,还有就是它的 token 稍微异常,这里就要报错了,如果大家有更好的设备,可以本地部署玩一玩,最后别忘了一键三连。

26鹤之Neo 08:02查看AI文稿AI文稿

08:02查看AI文稿AI文稿今天我将跟着大家一起本地步数加码四,接入 open core, 彻底告别托肯焦虑,接下来跟着我操作。 这里我们先进入 elama 的 官方网站,进入官方网站过后,我们直接点右上角的 download 下载,我们这里是 windows 系统,选择下载 for windows, 点击这里, 这里就等它下载好。下载好之后,我们这里就直接双击运行,这是它的安装界面,我们直接点安装这里,等它默认安装好。 好了,这里 elama 就 安装好了。然后我们到这个地方 elama 的 官方网站,选择 models, 这个地方选择 command 四, 然后这里我们选择我们的模型,这个模型的选择我们根据我们的显卡显存大小来选择。我们这边看一下我们的显存是多少, 这里看到我使用的是四零七零的显卡,显存是十二 g b 的 显存,十二 g b 的 显存的情况下,我们可以选择这个九点六 g 的 模型,这个一四 b, 这个我们直接点进去,选择一四 b。 点击进去过后,我们直接复制这条命令,然后运行一个 cmd 窗口, 直接粘贴这里,它就会欧拉玛会自动地给我们安装这个模型。呃,这里等的时间是比较长的, 这里模型已经下载下来,并且运行起来了,我们向它发送一条消息,试一下你是谁, 反应还是可以的,这就跟了我们信息回答了。好了,在这里过后呢,我们就可以把这个窗口关闭掉, 关闭掉过后,在 lama 这个地方我们去选择这个模型,在这个位置也就可以和它进行通话了。 比如我们问他一句,你可以帮我做些什么, 他已经帮我回答了,在这里呢,我们因为我们是在本地虚拟机上安装的,所以而且我们为了方便以后可以在其他计算机上也可以调用,我们在这地方设置这个位置 点,这个位置点设置这个允许在网络上运行,把它开起来点了就可以了。 好了,我们下一步就开始配在 open core 上配置啊,在这里我们进入虚拟机之后,我已经执行了 npm i, 刚接 open core 全曲,安装 open core 的, 我们这里可以执行一下 mini, 看下我们安装的版本。 openclock 杠 v 是 安装的最新版本二零二六点四点五版本,然后我们执行 openclock on, 在 这里我们进行一个调试,这个地方我们 yes, 这里选择快速,这个地方它是让我们选择大模型,呃,大模型它这里有,我们选择本地的这个位置点确定 这里我们直接就选择本地的,不要选云,上面是带云端的,就选择本地模型。 这地方让我们选择模型,我们选择这个,这就是我们刚刚这个就是我们刚刚下载好的模型,就是 直接回车。等一下, 这里让我们选择通讯工具,我们这直接跳过,暂时不管这个,直接跳过。 呃, scale, 我 们这边也选择否先进行最简单的安装 网关,我们就直接重启, 选择 open ray web ui 好 了,我们看一下 open core 运行起来了没有。 open core getaway style sta 好了,已经运营起来了,我们进去看一下, 这边需要 token, 我 去看一下 token 是 多少,关于 token 的 话就是我们,我现在是在虚拟机里面安装的, 我要重新打开看一下,在虚拟机里面安装,我们就直接去通过这条 mini 访问我们的虚拟机, wsl 的 虚拟机访问,然后无斑图选择 home 目录,选择我们的用户, 然后这里选择点 opencloud 这个文件夹,然后这一个 opencloud json 让我们看一下,到 git 里面去,这个地方就是我们的 talking, 复制粘贴下来到这个地方,点连接好了,我们尝试给他发一条消息,你是谁? 在主位置这个地方,我们可以看到这地方是我的模型。 我再问他一条消息,你现在使用的是什么模型? 看这里已经是我当前运行的模型 工具,在这里我们就可以看到了,我们现在整个 open call 来使用的是我们本地模型,就不需要去购买 token 了。好,今天内容就这么多,谢谢大家。

1647何止于静 09:55查看AI文稿AI文稿

09:55查看AI文稿AI文稿谷歌终于坐不住了,正式卷开源市场, jm 四的效果到底如何呢? jm 四的发布啊,真的有可能让我们实现头很自由。这期视频呢,老张给大家简要介绍一下 jm 四怎么安装到本地,以及如何搭配到我们的 open klo 大 龙虾上, 附带所有的安装步骤啊,大家可以一起来体验一下。后续呢,老张也会根据测评效果给大家接着发视频,这期是我们完整的部署流程,老张重点给大家简单聊一下,就是为什么 jm 四的发布啊,会让大家感觉谷歌真的开始卷起来了呢? 首先第一点,他和目前谷歌的 jimmy 三用的是相同的技术基座啊,所以说他的能力是毋庸置疑的。第二点就是商业自由,你直接部署下来做什么都是可以的,都是允许的。然后第三个就是支持多模态,无论是文本、图像甚至小规模的视频音频, 他都可以直接支持。第四点就是结合前段时间爆火的 open klo, 他 可以直接在本地对接 open klo 以及对接 klo 的 code, 实现本地的偷根无线化。这是老张给大家总结的四点,为什么詹姆斯的发布会让大家感觉,哎,可能真的要进入到一个新的纪元, 然后呢,他所发布的这四款模型呢?老张给大家做了一张图片啊,大家可以到时候把它截下来。第一个模型一二 b 的, 他本身是用于手机或者边缘设备八 g 显存, 然后最高端的三十一 b, 他 所对应的旗舰版本呢,是对应的是二十四 g 加,所以大家根据你的需求来进行对应的模型选择。老张这次视频呢给大家来看一下三十一 b 的 这款模型的安装, 然后关于本地的安装部署啊,其实非常简单,任何开源模型,其实我们只需要让他和欧拉玛就是那个小羊驼结合到一起就可以了,然后找到你符合要求的版本。安装成功之后啊,欧拉玛现在已经有了一个完整的应用端了,所以大家可以直接在这个位置和他进行对话交流。 那我们想要下载 jm 四到你本地的电脑上,我们可以使用它的官方指令,会告诉我们直接怎么样去进行 jm 四的对应安装,像老张想安这个三十一 b 的 对吧?我们就把它拿过来, 把它直接这有一个 c l i 命令行安装方式,把这个东西直接复制在你的开始菜单中,单机右键选择运行输入 cmd, 直接把刚才指令粘贴过来,这儿的时间会很长,因为它有二十个 g 的 大小,我们直接稍作等待 安装成功之后,我们也可以直接回到它的客户端中,在模型选项上找到我们安装好的詹姆斯冒号三十一币, 然后可以直接进行对话。老张他处理一个较为复杂的提示词,我们让他看一下当前显存的内存消耗, 咱们拿这个 ai 慢距的提示词来测试啊,这个提示词非常的长,我们看一下他读取提示词的能力,以及他的这个显卡的性能消耗,我们看一下啊,这个显存直接拉满的,达到了百分之九十四的占比, 而且这个响应速度还是非常快的,只需十一点七秒啊,就把整体的业务流程给我们直接补齐了,而且呢按照需求给我们进行了对应的提问,要什么样的慢距效果,所以说以目前的测试反应来看呢,他的这个响应速度起码要比之前的很多大模型要好的多, 所以接下来我们自己来尝试一下对话类的工具,可能大家都不是很需要的,我们能不能把它接入到我们的 open clone, 丢到我们的龙虾里,让它们俩来进行联动的。然后这期视频呢,老张顺便给大家提一下,就是最新版的 open clone 的 部署流程 啊,咱们可以快速的去过一下一些重点的细节,因为之前老张发过很多期的部署视频一块的呢,因为它本身啊, wsl 它是相当于在 windows 系统上安装一个 linux 的 独立系统, 这样的话呢,就直接相当于在你电脑上安装了一个独立的存储空间,它所谓叫做沙盒安全,而且运行起来呢是不会有任何的兼容性的对应问题的,因为 windows 中啊,它的权限呐,路径等经常会报错。所以说我们这 期视频重点教大家怎么用 wsl 进行 win opencl 的 部署安装,这样的话, windows 和 wsl 的 安装您都了解之后之后学起来就非常方便了。 然后接下来呢,老张给大家简单的介绍一下在 wsl 中如何安装我们的 openclaw, 因为之前呢,咱们介绍过太多次了,很多兄弟留言说老张就别介绍怎么安装了,然后我们就给大家简单说一下注意事 项。首先第一呢,你想在 wsl 上安装 openclaw 的 话,第一点你得先在你的 windows 系统下把 wsl 安装一下,当然很多电脑老张发现其实都是自带的, 怎么检查是否自带呢?咱们可以直接输入 wsl 空格杠杠威森,如果弹出定的版本号,证明 wsl 电脑已经安装了,如果没有弹出的话,使用安装指令 wsl 空格 insert 直接安装即可。然后紧接着按照老张给你提供的指令复制粘贴就可以了。先安装你的优班图, 安装之后进行一下更新。安装完优班图之后啊,在这选择这个倒三角,找到优班图系统,就可以直接进入到你的优班图系统当中。 在你安装过程中啊,它会让你设置一个用户名和密码,到时候可能需要做一步密码验证。在优班图系统中,注意是优班图系统中运行这些环境指令,分别安装 python 三,安装一个压缩包工具,方便安装一个 node 点 ps, 然后再安装一个 get 工具。 如果说为了检测每一步安装是否成功的话,你可以分别输入,比如 note 杠 v、 npm 杠 v, 包括 get 杠 v, 在 这检测我们对应的这个版本。如果都能弹出版本号,证明你三项安装都是成功的,这是配置 openclo 的 基本的内容要求。 然后紧接着我们把基本环境配置好的兄弟,你还需要在这个位置安装一下这个欧拉玛。 这老张要重点说一下,说老张我不在本地都已经下载好欧拉玛了吗?为什么在优班图里还需要再配置一下?其实我们优班图中是可以调用本地的欧拉玛的,但是很多兄弟在调用过程中分别给老张留言说说调用时无论是 ip 地址找不到,还是 ip 的 动态变化,导致每次都需要重新连接,重新配置。 所以说最简单的方式就是把欧拉玛在你的优班图系统中再次的安装一遍。其实安装非常简单,只需要把第一步的安装指令复制过去,直接在这个位置直接粘贴即可。安装成功的检测方式很简单,你就输入欧拉玛, 如果他不报错还给我们对应的选项,是咱们是进行对话呀,还是怎么样的证明你的安装就是成功的? ctrl c 直接退出。 所以说欧拉玛安装之后,紧接着就是把我们的模型在当前的优班图中跑起来。老张刚才给大家测试的是 jm 四三十一 b 模型,我们直接输入指令欧拉玛空格 run, 然后你的模型效果直接回车,第一次时他会直接进行对应的模型下载。如果说你现在只想用 open klo 来调用欧拉玛的这个占四的话,可以在我们的本地电脑上把之前咱们那个桌面端给他 删掉,如果说你不你想两端都使用的话,就可以直接在这个位置进行使用了,然后发一个你好看一下响应速度, 嗯,响应速度是非常快的,所以接下来我们把这个家伙欧拉玛的詹姆士直接部署给我们的 openclo, 在 这怎么中止对话,摁一下 ctrl c, 再摁一下 ctrl d 啊,就可以直接进行中止对话了啊,所以说大家可以直接的把它退出来, 退出来之后我们在这儿部署一下 openclo。 关于 openclo 的 安装呢,官网推荐是使用 c o r l 这种安装方法,但是老张发现很多兄弟在使用这种安装方式时呢, 出现了这个网络问题,导致下载出现卡顿,如果说 c u i l 的 方法报错的话,直接使用 n p m 安装也是完全可以的,安装完之后直接输入 open klo 空格杠 v 来输出最新的 open klo 的 对应版本啊,这就是老张跟大家说的一些建议啊,大家按照这个要求去做就行了。 然后接下来我们进入到配置,直接是直接输入它的配置指令回车,选择 yes, 然后选择快速开始就可以,我们直接配置一下模型, 然后选择更新,这选择谁呢?选择这个欧拉玛啊,然后选择默认的这个 ul, 选择本地模型,让他去给我找一下咱们本地有哪些模型,稍作等待 好,选择当前的这个模型,咱们四三十一币,然后配置我们的聊天软件啊,这个老张之前讲过太多太多次了,现在呢,他又支持了很多,包括 qq 之类的,大家有需要的话可以按照之前老张的教程再来一遍,我们先跳过 打开之后啊,就可以直接对话。但是如果说善于观察的兄弟们也发现了,老张呢把这个使用模型呢换成了这个一四 b 的 模型,不是那个三十一 b 的, 因为三十一 b 呢,老张在测试的时候也好,或者在一些使用时候也好,他有的时候会出现这个连接超时的问题,也是 oppo klo 更新到最新版本出现了一个能启动问题, 这个呢,老张现在还没有特别好的解决方案,所以说我先用一次必得给大家进行演示,发一个,你好,我们来测试一下他的响应速度啊,还是比较快的。 然后接下来呢,我们再把之前的那个慢句的提示词发送过来,我们来看一下他能不能更好的帮我们去进行慢句提示词的对应理解,以及对应的相关反馈。 嗯,其实我们看到啊,他反馈的这个结果呢,和三十一 b 相比啊,真的是有一定差距的,但是呢,确实也是另一方面实现了我们所谓的叫偷根自由。 大家呢也可以后续啊,去测试一下怎么让本地如果你的显卡够用的话,把这个大模型给它跑起来。然后老张呢也会及时给大家更新,无论是在评论区中还是视频中教大家如何使用。我是程学老张,定期分享 ai 好 用知识,希望大家多多关注。

4453程序员老张(AI教学) 01:30查看AI文稿AI文稿

01:30查看AI文稿AI文稿兄弟们,欧拉玛已经更新好了,杰玛斯的大模型也不朽完成了,一共四个模型,接下来挨个测试一下,所有的测试都是在这个电脑配置下完成的。第一个问题,介绍一下自己, 第二个问题,用李白的风格写一首 诗。 最后一个问题,经典的喜鹊问题 总结一下,四个模型都测了,最快的是一二 b, 最慢的是三十一 b, 四个模型第一次启动都有点慢,后续速度都还可以。 总的来说,回答质量最好的是三十一 b, 包括最后的一个洗车逻辑陷阱也自动识别出来了, 就是我这个配置运行起来实在是太慢太慢了,所以性价比最高的应该是这个二十六 b 模型。回答速度,回答质量都还可以,可以用在部署小龙虾,用来做个人的 a 键,挺好用的。后续再和千万三点五做个横向对比,记得点个关注。

350集集集集盒🌈 03:20查看AI文稿AI文稿

03:20查看AI文稿AI文稿大家好,我是根谷 open cloud 的 追马四欧拉玛全新的本地模型体验来了。欧拉玛最新更新的版本是 v 二点零啊,已经支持追马四,搭配 open cloud, 响应更流畅,速度更快,回车记出结果,支持常文本做任务处理,本地 i i 体验相当的不错, 要想流畅的体验,快去试试升级吧。首先教大家如何去升级吧,当你用这个积马四的话,你首先的显卡应该是十六 gb 上的啊,最好能够到三十六 gb 啊,我的电脑是一个一百二十八 g 的 全存和内存一体化的,是吧, m 四 max 的 最强电脑,所以说我运行这个东西是, 呃,我运行这个金马四二十六币了,这个模型是没任何压力的啊,欧拉玛兔啊,一定要用这个命令啊,金买四二十六币啊,你回车 他默认的会把它下载到你这个,因为我是下完了是吧,当然如果你下载很慢的话呀,你应该去做的有两个操作,就是应该是这么做的,应该是做那个去开他代理啊,这个代理应该是这么做啊,就是去去这么做 开这个代理啊,或者是你去那个把这个镜像设置为那个,设置为一层摩摩搭论坛的那个代理啊, 就是把它带代理到国内啊,如果你能够魔法上网的话,就不需要开代理了,因为我这边的网速是比较快,大概是下载了接近接近两个小时,一个半小时啊,大概是五到六兆每秒,他是七 gb 的, 他会下载哪个目录呢?你可以看一下这个目录啊,欧拉玛这个目录,呃, 首先它的模型会下载到这里,下载你其实不用管了,你可以打开你的欧拉玛,现在欧拉玛其实它又升级了一个小版本啊,就是零点零点二 两百啊,零点二点,零点二点零点二啊,这是今天最新版本,大家建议大家升级最新的版本。那我这里下载了两个模型比较好用,一个是 gbt 的, 一个是 o s s 二十 b, 一个是这个积满四,最新的二十六 b。 那 我发现这两个模型都非常快啊,你下完了以后,你一定要用欧拉玛浪琴去启动欧拉玛 浪去,他去启动这个欧风 club, 启动完了以后我这已经是启动了,启动了以后你打开这个小小龙虾的页面来,我给他做一道数学题目吧。啊,这个他不知道他能不能识别啊,哎,你看非常快吧,秒开吧,是吧? 然后他这个地方其实有错误啊,就是我应该去截个图给,不知道能不能截图过去啊?就是你,哎,就是就是就是,求解,这个一元二次方程, 不知道他能不能识别。这个啊,他已经识别出来了啊,这个是啊,我不知道这个结果是不是对的。 x 平方减五, x 加六啊,应该是没,应该是没问题的,对吧?一个是二,一个是三,对吧?对,非常快,然后这个数学题其实更难一些,就是这个勾股定力的这个,一个这个这个 啊,你看看一下,他应该是应该是很快的,一秒、两秒,两秒就出来了,这个比之前是快很多,我记得考了应该是三月 二十八号那个版本嘛,大概是一周前的欧拉玛这个版本和 opencall 的 最新版本啊,它大概是这样一个难度的速写题,要要五到八秒钟,如果是过年的那会大概是要一分多钟,所以说现在是非常快啊,非常快啊,就是我感觉比那个 api 都要快,所以大家尽可能去试一试啊。用它进行养虾的话, 那比如说,比如说我是谁啊?对吧?他应该很快就能够找到十二月份,是吧?年龄怎么怎么样?我觉得非常快,这个建议大家赶紧去升级吧。

160根谷 08:58查看AI文稿AI文稿

08:58查看AI文稿AI文稿大家好,今天我们在本地安装 lm studio, 然后部署本地模型伽马四模,模型部署过后呢,我们就把它接入 opencloud, 这里呢我们先进入 l m studio 的 官方网站,然后进入过后在首页点击这个地方 downloading for windows 进行下载,点击它过在这个地方就开始下载了,等到下载结束,我们直接运行好了,这就下载好了,我们直接双击进行安装, 这里选择,我同意这个地方我们可以选择为所有人安装和仅为自己安装,选择为所有人安装了,我们就可以选择盘符了,这样就不用默认安装到 c 盘,我们直接安装到 d 盘,安装成功,我们直接点完成,让它自己运行起来。好了,这里已经运行起来了,我们现在准备开始下载模型, 点击上面的这个位置 select 模型,我们这里直接选择加码四模型,点击下载 这里等待一段时间它就会下载好,这个下载速度很快的。好了,现在模型下载好了,我们直接去选择模型,直接去点击上边选择模型,选择我们刚刚下载的加码四 这地方,等待它加载好, 它这个模型是需要加载的,加载好了过后呢,我们就直接可以在里边准备开始给它对话,那我们给它输入一个,你好看一下, 这里可以看到它很快给了我们回复,那我们下一步接着就要去将这个 im studio 对 接到我们的 openclip 里面去。 在进行 open core 配置之前呢,我们需要我们需要对 i o m studio 进行一些设置,这个地方我们点击左侧这个菜单 developer 这个位置,先开启这个服务器的模式,就是 addin run 这个地方,把它点一下开起来,开起来过后,这个地方如果模型这个地方没有模型的话,我们就要选择加载模型这个地方,就把我们的模型选择一下就好了。 然后比较重要的一个地方就是这个位置,这个地方有个 load 点这个地方,这个地方我们它的默认这个 tokens 长度就是每次我们给它的 tokens 默认只有四零九六个,那么这对我们 open clone 来说是不够的,我们需要将它设置到最大去, 当然你设置合适的长度也可以,但是我这里为了方便就把它直接拉到最大,拉到最大过后还有这个地方我们需要注意一下,这就是外部调用它的一个 api 的 外部调用一个 api, 因为我们 open core 在 对 i o m studio 是 不默认支持的,所以说我们需要用 open i 的 接口,它这里包括支持 open i 的 模式,一个接口在这个地方 好设置好过,我们接下来就要去在 opencloser 上进行设置,我们这里先进入我们的虚拟机 w o s 呃 w s l 好 进,我们先进行安装 openclo n p m i 杠 g openclo 这里等段时间,等它安装好 好了, openclock 已经安装好了,安装好了我们直接进行配置,我们直接先执行命令。 openclock 这里我们选择 yes, 选择快速开始这个地方,让我们选择模型,在这个位置呢,我们就可以直接跳过去,因为我们是要配置 lm studio 是 对接的,是 这个地方我们直接选择跳过, 然后在这个地方又让我们去选择模型,又让我们选选择一个默认的 模型,在这个地方是没法跳过的,我看了一下,没法跳过的话,我们就直接随便选一个,选 open ai 就 直接默认选择 这个地方,选择通讯工具,我们这里也直接选择跳过去, 然后这个是选择搜搜索工具,我们这个地方也直接选择跳过 啊。 scales 我 们也暂时不配置, 这个是 hux, 我 们直接也跳过这里 get away so, 我 们选择 restart, 选择 open the web ui, 好了,这里 open curl 粗实的安装,我们安装好了,我们下一步去说怎么去配置它。 在这里我们先随便打开一个文件夹,然后进入我们的虚拟机目 录我班图 home, 找到我们的用户文件夹,进去过后选择 open curl, 在 这个地方我们找到这个 open curl, 点 json 这个文件 要在编辑文本编辑器里面打开它。这边这边我们在文本编辑器里面打开了 openclip, 点接受它配置文件,我们主要修改是这个位置, 在这边我已经将需要修改内容已经准备好了,我们需要修改的是一个是 models, 还有这 agent, 我 们将它复制过来,然后粘贴粘贴替换 agent 这一段, 然后 ctrl 加 s 保存在这个位置,我们顺便将我们的网关的 token 复制下来, 保存好过后,我们直接运将 open curl 网关运行起来,执行 open, 执行 open curl, get 为 c r t, 然后打开我们浏览器,直接输入幺九二点幺,直接输入幺二七点零点零点幺,然后加端口号幺八七八九旅车, 这个地方粘贴我们的网关,点击给他发个送个消息。你好,你使用的是什么模型? 你好,你使用的是什么模型? 这里可以看到过滤会时间,它已经给我们回复了。好了,这样子呢?我们的 element studio, 然后打在本地模型 gm 四,然后接入 open color 就 已经成功了。 这里可以看到,其实我们进入 i m 四六是有点问题的,原因就是说我们给他发送消息后,他并不能第一时间给我们进行一个反馈,就类似于我们用本地模型或者 是啊在线 api 模型一样,给我们一个三个小点点一个反馈状态,可是没有,我们就只能等,也不知道他到底收没收到消息。 好了,就这么多,如果大家在用的过程中有什么问题,欢迎关注私信,然后一起交流。

28何止于静 02:13查看AI文稿AI文稿

02:13查看AI文稿AI文稿一分钟让你搞清楚关于全球最强开源模型 jam 的 一切。最近谷歌开源了 jam 四,我将用四个问题 让你清晰了解关于 jam 的 一切。 jam 各版本的区别,我家的电脑能用吗?模型怎么部署安装?普通人用来干什么?先说他的四个版本,三一 b 直接冲上全球开源 ai 榜第三名,以前要机房才能跑的能力,现在你家里的高端游戏显卡就能搞定。 轻量版的一二 b 和一四 b 为手机、平板以及中低端电脑设备打造,性能虽不是最顶级,但是绝对好用够用。而二六 b 猫号称总参数两百六十亿,但实际每次思考只用其中三十八亿个,最相关的效果却能媲美两百六十亿, 能理解超长文章以及视频。简单说,无论你是用手机、笔记本还是高性能电脑, jam 四都能给你免费安全强大的顶级模型体验。再说你家里的设备是否能用上?一张图告诉你 jam 四个版本的最低要求。 对于多数人而言,家用的电脑设部署一二 b 一 四 b 完全够用,基本能满足百分之九十的使用场景。另外两个版本对内存要求较高,但是性能出众,属于好马配好鞍。 再说模型安装,整个过程大概十分钟左右。首先下载 lm studio, 然后打开 opencool 或者 id 工具,让它查找你本地配置,给你推荐安装哪个版本。之后在 lm studio 里下载,运行搜索推荐的模型名点下载,最后接入 opencool 或者 i d e l m studio, 提供 open ai 兼容 api, 在 open 框里把 api 地址改成, h t t p l o c a o s t colon twelve three four slash vivo 就 能用 jama 四驱动你的 ai agent 了。 网上攻略一大堆,这里就不展开了。最后说下所有人最关心的能用 jama 做什么?这里推荐三个场景,可以去试试。第一, 构建本地知识库,把工作和学习相关的文件丢给本地 jama, 让他帮你形成系统化的知识。构建个人知识库时进行向量缩影和 anitive, 解锁数据不出本地,安全合规。第二,给家人搭建一个 ai 助手,下载好模型,配个界面,电脑手机都可以直接对话,不花钱不泄露隐私。第三,内容创作 最大优点是无限额度,即便不如部分付费模型,但可以靠大量尝试提升优质内容的概率。千马寺会改写国内企业及政府客户的私部模型格局吗?欢迎在评论区发表你的观点。

279安思派人工智能 04:02查看AI文稿AI文稿

04:02查看AI文稿AI文稿哈喽,大家好,酷狗前两天刚刚发布了最新的大模型 gm 四,这个大模型它是完全的开源和免费的,能够在本地的设备上离线运行,我用了这几天,我觉得这才是二零二六年最合理的 ai 技术路线。 真正值得关注的是,呃,他的这个原声支持函数调用,这就意味着这个模型能够自主的使用工具,浏览网页,执行代码,调用 ipa, 相当于你在本地安装了一个智能体,全程也不用联网,也不用花钱,完全可以调用本地的算理。但是呢,很多人都不知道怎么使用,所以今天跟大家分享一下专门四的使用。专门四分别有四个不同的版本,分别是 e 二 b 四、 b 二十六 b a 四 b 和三十一 b。 这些模型大小各异,可以部署在手机、电脑和云端的服务器中,它非常适合文本的生成、编码和独立任务。这张图片呢,是谷歌官方的一个,相当于是个测评吧, 不同大模型之间的一个测评。我们可以看到这几个都是市面上比较好用的大模型,嗯,包括我们国产的 d c 克千万和 kimi, 还有那个 g p t, 我 们可以看到这是它们之间的那个性能的一个对比吧。嗯, nice 区域,我们可以看到这个是 g m 四,在我们传统的认知里,模型越大,参数越多, 它的性能就越强。在途中我们可以看到 g m 四的这个三十一 b 的 这个模型,在实战能力上竟然超越了千万的三点五,因为三十一 b 它只有 三百一十亿的这个参数。千位三点五呢,它有将近四千亿的参数,这两者之间的这个体积相差了十倍,所以呢,你可以看出这面四就是用十分之一的体积跑出了十倍体积的对手,那这就意味着你不需要再付 报的这个服务器的费,你在自己的电脑上,手机上就能够拥有世界最顶级的这个 ai 大 脑。然后我们看一下这四个版本的功能吧, 以及定位。三十一 b 被称为是全能大脑,它可以处理任何的这个你所想要的执行的一些任务吧,它的定位呢,也是非常的明确,是最顶级的一个型号,擅长呢查某某的创作以及 深度的逻辑推理,它就像人类的思考会给你列出这个提纲一样,然后排查啊错误,然后再输出, 所以他非常擅长于这个深度的长文写作。那么第二个是二十六 b 的, 这个被称为效率之王,它的定位就是相对于上一个呢,它是一个平衡的版本,那么它的功能是保持在极高的智商的,同时呢,响应呢,要比三十一 b 更快, 所以呢,它适合于这个频繁的互动啊,快速的迭代的创意的这种工作。那么第三个和第四个是一四币和一二币,这两个呢被称为侧端的,先分我们,我我认为的就是说它是一个轻量化的模型,它只有四十亿和二十亿的一个参数,所以呢, 呃,它的这个体积相对也比较小,但是呢,虽然说它的体积比较小,但是可以通过这个 single 的 强化处理一些日常的对话呀,这个日常的整理,呃,简单的,这样还是非常的流畅的, 我们可以看到这是专门四网页端的一个界面,其实我这两天用的,用下来,我觉得他的这个云端的和网页端的这个使用其实是非常的非常的好给我的体验。因为普通人说实话你的电脑可能 配置没有那么高,所以你装了最高的那个等级的那个模型,你使用起来你的电脑可能就会如果说你的性能不够的话,你的电脑就会起飞的。所以我建议啊,就是如果说你不是做一些特殊的一些任务的话, 我建议直接用网页版的是最靠谱的。那电脑端有 pc 和 mac 的, 它的一个好处我刚刚讲了,就是直接在本地运行,断网也可以使用,最大的一个好处就是它是保护隐私的,不用担心你的文件或者说是你的信息隐私会被泄露,因为断网也可以使用,我觉得啊,是 这么的一个最大最大的一个特点。那么另外就是它的手机端是苹果和安卓系统都可以用啊,因为手机的内存是有限的, 所以呢我的建议就说如果是你非要在手机上装这个,我建议就是用的轻量化的这个版本的,否则的话你的手机肯定会发烫,它运行起来 特别的耗费你的本地的这个手机的一个算力的。所以最最第三个就是云端的,我是最推荐的这个直接再往月端调,而且你可以直接用免费的算力,因为使用也是免费的,你往月半使用也是免,不像其他的一些大毛器,你用着用他就没法用了,他就你的这个免费的额度,用完了 不让不让你用了。但是 gm 四它是无限使用的,目前来说是免费使用的,所以的话呢,大家如果说是想用的话,尽快用起来,我觉得是非常好的一个大冒险。大家如果说有其他的问题,我们在留言区可以互动一下,有什么问题可以直接问我哈。

26一人公司小马哥