comfyui安装使用api是收费的么

粉丝20获赞231

相关视频

55:22查看AI文稿AI文稿

55:22查看AI文稿AI文稿一款软件彻底玩转所有 ai 功能,官方正版还免费,这还不够用?我已经帮你把它内置的五十六个 ai 功能全调通了,全程不用你动手,你只需要三步就搞定一下载。二解压缩,三双击打开,不用装插件,不用配环境,连模型我都帮你提前放好了,直接就能用。 哪怕你完全不懂 ai 是 啥也没关系,照样能轻松玩起来。想画图点一下就行,想做视频再点一下就好, 就算要搞三 d 建模,也只是点一下的功夫呀。 ai 浪潮汹涌,与其担心被它替代,不如去主动的掌握它市场,最终会选择善用工具的人。 那么我们将教你如何榨干 ai 的 潜能,玩出最多的花样。一套丝滑连招,彻底颠覆传统工作流是两万加 ai 绘画、关键词词库,以及数十万字独家变现秘籍。 同时还享有训练营的所有工程文件,包括课程录屏、素材打包赠送,供您反复练习。这过程中我也会在群里和大家多多互动,随时解答疑问。 ai 就是 生产力的加速器,也是创意的催化剂,它让无数曾只在梦里的场景成真, 给创意插上翅膀。唯一限制我们的就是咱们的想象力,世界还在狂奔,我们顶峰相见。 那么我们打开今天的主角康复以外之后,就可以看到这样一个界面,第一眼看起来也是非常的复杂。比如说像这套工作流,他的直能很简单, 就是可以把我们的模特进行服装换装,可以看到他原先穿着的是黄色衣服,经过我们的产品图上传以及工作流的运行,最终被替换成了灰色卫衣, 这就是康复 ui 的 作用。当然,如果咱们是第一次接触这款软件,我们还是从最简单的开始学起吧,先点击工作流,接着点击浏览模板,点击图像生成,这就是康复 ui 最最最基本的工作流,看起来比起之前的那一个来说,简单了非常多, 其中啊,一共有一二三四五六七,一共有七个节点构成。大家也注意到了,像这一个一个的,我们就是称之为节点,那么节点与节点之间由线连接,可以看到 有紫的线,黄的线,红的线,蓝的线,各式各样,那么节点与节点之间通过线就连接成了最终的完整工作流。那么咱们先点击运行,来看一下会给我们带来什么样的图像,哎,可以看到短短几秒钟就生成了这一个 紫色的星云屏。好,关于这个瓶子的内容,它究竟是怎么得来的? 是怎么知道我们要生成的是这个东西?左边呢,有两个文本编码器,大家看到了吗?分别是上边的正面提数字文本编码器,以及下边的反面提数字文本编码器。那么什么是正面提数字文本编码器?很简单,就是我们想要什么就输入什么, 比如说我们来一个 one girl, 一个女孩,哎,接着点击运行,可以看到此时一位女生的形象就这么成功跑出。当然啊,像这一幅图像,它的细节非常的粗糙,具体该如何优化, 我们待会会讲。又比如说想把画面内容替换成花园,那么就在刚刚的文本编码器输入 one garden 一座花园这边呢,可以发现咱们输入的是英文,如果是中文的话, ai 将无法识别,最终图像也会错乱。好的,同样也是经过短短数秒钟,一座花园就被我们成功跑出,可以看到花园中是不是有各式各样的花, 红的、粉的、黄的、白的,那现在比如我们不想要这些花朵了,想让它们消失,该怎么做?这就得请出我们的下一个文本编码器, 下边的这个叫做负面提书词,文本编码器,咱们不想要什么,就在这边输入什么,比如说输入花朵 flower, 点击运行,可以看到现在画面中是不是 花朵几乎看不见了,非常神奇啊,我们可以再跑多几张来看看综合效果。那么这张也是一样,画面中几乎看不到花朵的身影。如果我们继续生成, 咱们就有可能会看到一些光怪陆离的画面,比如像这张,这张图片很明显有一些文字,并且并不是我们想要的内容, 关于这一点,该如何规避呢?好,接下来我们要讲第二个概念,叫做质量词汇。刚刚我也说了,正面提示词是我们想要的内容,负面提示词是输入我们不想要的内容。 那么如果我们在正面解释词输入的是像高清、高质量,丰富的细节,类似于这些词汇,系统是不是就知道,哦,原来啊,我们想要高质量的图片,从而改变我们最终生图的质量,但关于负面解释词也是同理, 只不过稍微反转一下。比如啊,我们在负面提示词输入扭曲的,变形的、模糊的,类似这样的词汇,那 ai 就 知道,哦,原来我们不想要扭曲的图片,换言之,就是我们想要 清晰正常的图片,这就是质量提示词的作用。我们可以请出翻译器,比如说像有道翻译输入清晰、高质量丰富的细节杰作,接着再把翻译的译文 给粘贴到正面提示词的句首,可以看到每一个词汇与词汇之间都是由逗号进行隔开。关于负面提示词,我们也是同样在繁源器里面输入,扭曲、变形、低质量 模糊。咱们还可以输入文字,比如说像刚刚这张图片就出现了我们并不想要的文字内容。 ok, 把这一串中文进行翻译之后,再把译文给粘贴到负面提示词文本框内,随后点击运行。现在整体画面质量是不是 直接上了个档次?但有的小伙伴可能会说,哎呀,这张图片我怎么感觉看起来不够清晰, 哎,细节还是不够丰富,怎么办?我们看到下一边有个叫空阶的东西,那空阶就是可以控制我们画面分辨率的一个小节点,它里面一共有三个参数,分别是宽度、高度以及 p 四大小。 如果我们把宽度设置为幺零二四,高度也设置为幺零二四,再点击运行,会出现什么样的图像? 现在怎么说?这张图像是不是质感比刚刚的要好,非常非常多,比如像植物的细节,树干乃至光影、石头的纹理,相较于之前都得到了巨大的提升。现在,比如我想让这张图片变成竖屏比例 行不行?当然可以啊,来到 konlayton, 我 们可以把宽度设置为七百六十八,高度呢?还是保持幺零二四不变,点击运行。那么一张竖屏比例的花园图像就这么成功生成了, 横屏比例很简单,只需要把刚刚的宽高反过来,又或者设置其他参数即可,比如说高度,这次我们就来一个五百一十二吧,点击运行,哎,现在一幅宽高比二比一的横版图像立刻跑出来了, 操作非常非常简单,这就是关于纹身图最最最基本的操作,也是关于 ai 绘画里面万丈高楼的地级。那么现在咱们就正式进入到今天的第一个案例 啊,终于把咱们的序章给讲完了,我们双击界面就可以添加节点,那么咱们就添加一个节点,叫做 controlnet, 旧版高级选择这一个,那这个节点 它的作用很简单,就是可以非常非常详细并且有效的控制我们想修改的细节。刚才咱们应该也注意到了,每一次点击生成 我们最终得到的图像都是不一样的,但是有了 ctrl 键之后,这一点会得到极大程度的改善,比如说啊,我们先把 ctrl 键应用的正负面条件 给连到 k 彩阳七上,接下来呢,他的正负面条件输入,哎,在这里连接在两个文本编码器上,连完了之后,看到下边有一个 ctrl n, 输入绿色点点的,这里拖出来选择 ctrl n 加在一起。在这边 我们用到了一个模型,叫做 instant x union ctrl n, 这是一个组合 ctrl n 的 模型,不理解没关系,目的我们待会讲双击界面搜索加载图像,随后上传我们想要进行效果生成的建筑线稿图, 那么可以看到这个加载图像一共有两个输出,分别是图像与遮罩。我们在图像这边拖出来,摁住 shift 键搜索 line on, 看到 line on 艺术线预处理器, 然后再把这个预处理器的图像输出连接在刚刚的 control 内,应用旧版高级上。 ok, 至此咱们的工作流就算是搭建完毕了。好, 我们来点击运行,看一下最终的出图效果。在我们生成完图片之后,可以看到最终图像与我们的原图差异很大呀。咱们的原图很明显是一个竖屏比例的图片,而最终图像呢,上半部分以及下半部分都有缺失, 该如何解决这个问题?很简单,回到空内存,在这边我们要调整他的宽高,我们可以看到加载图像的最底下有一个五百一十二乘七百六十八,我们只要将这一组数字 给输入进来即可。宽度五百一十二,高度七百六十八,点击运行。好的,那么现在可以看到图像算是优化的差不多哎,至少在尺寸上没问题,但是关于内容上 还是与我们的原图线条不太相符。回到之前的关键词部分,那之前我们关键词输的是一座花园,这很明显并不是我们 现稿图应该呈现的内容,那这时候咱们就请出翻译器,输入一栋别墅,现代简约风格游泳池,草坪,显示质感自然光照,接着把它的英文 粘贴到正面提示词中,再次点击运行。 ok, 可以 看到现在的图像相比于之前有了极大的改观, 那么有小伙伴可能会说,这张图像的线条关系并不是严格参考我们的上传图像的,这该如何解决?同样很简单,来到 ctrl 应用的 强度,我们把强度设置为一点五,再次点击运行,怎么样?现在是不是比刚才关于线条遵循这一点好了很多? ok, 那 么这又是今天的第一个案例,整体流程也不复杂,学会了之后一套下来只需要短短两分钟即可完成。 接着咱们来看第二个案例人物写真,我们呢先点击运行,可以看到黄色区块内给我们生成了一张人像图片,那么现在有一天有位客户找到了我们,比如说泰勒斯维福特,那么我们只需要起用第二个蓝色的 react 换脸节点,把 客户的图像上传到这个加载图像节点中,再次点击运行,那么经过了十来秒,最终图像也是成功跑出来了,可以看到人物的五官特征与我们的参考图像或者说我们的客户非常的接近,这就实现了 ai 人物换脸效果。 如果说现在我们换另外一位客户,比如说特朗普,那么这张图像我们可以看到效果也是还原的还不错,这就是康复 u i 的 强大之处。在我们更换参考图片或者说物料的时候, 不需要把整套流程重新搭一遍,重新跑一遍,只需要简简单单的在一个小节点里面上传,再点击运行, 我们就可以无数次的重复利用当前所用的工作流。关于刚才演示的这一个 ai 人物写真工作流我会放在评论区里,那么关于这款软件康复以外,我也会放在评论区里,大家可以自行领取。接下来我们就一起来看一下 三个案例, ip 三式图,点击文件夹按钮,可以看到这边有各式各样的工作流,当我们需要调用某个工作流的时候,只需要轻轻点击一下即可。 ok, 那 么这就是 ip 三式图的相关节点,点击运行。先来看一下 大体效果, ok, 经过短短的半分钟,可以看到三式图成功生成,咱们比如说来看一下这张图片吧,那么怎么分辨一张三式图的好与坏呢?我们就一起来画直线,比如说在下巴这边来一条线,来看一下每一张仕图 下巴位置与直线的距离是不是一样的,比如说测试图,可以看到距离是这么多,而正视图呢,也是这么多,证明还可以背视图看不见,那先不用管,接下来我们来看手指的位置, 同样的也是拉一条直线,那么这一次我们可以发现呢,正视图有点距离吧,测试图呢,正好是挨在线上,证明关于手部部分,可能需要进行后期的调整,接着我们再拉膝盖,这边 也是同样突出一条线,不过呢,正视图的膝盖在这个位置还是有点偏差,可能需要重新生成,又或者是后期调整, 那我们再来看一下脚踝,同样的也是正视图啊,有一些细微的偏差。好,那么这又是关于 ip 三式图鉴别的一个方式,咱们再看一下其他的,比如说像这一个 d 章,分别是有两张测试图和一张倍数很明显不合格,然后再看一下他旁边的这一个还行, 但是这边有些多余的元素需要进行后期的删除,但我们可以发现呢,他还是缺少了正视图。当然如果说这一组咱们不满意,我们可以在这边调整一下种子值,也就是这个 seed 值,比如说设置为 六六六六,接着点击运行,那么图像成功跑出来之后,一起来鉴赏一下。首先是看这张吧,可以看到这个头部明显是错位了,直接 pass。 咱们再来看一下第一张,那这张的话,两张测试图效果也不够好,也是同样 pass。 再来看第三张, 哎,这张感觉还行,那么我们就一起来画线吧,比如说在下巴画一条线怎么样?位置关系还算明确,但是这个 背式图有一点偏差。接着我们再来看一下关于手部位置测试图,拉出一条线,可以发现正视图以及背视图与测试图的手部 指尖位置还是有一些些偏差的,并且呢,测试图的手部也是发生了扭曲错乱,可以看到一整个直接反过来了, 也是不能使用的,所以这张图片直接 pass。 那 么要想生成一张符合大家心意的 ip 三式图, 我们可能需要重复的进行抽卡生成,大概经过个两三轮,筛选出一张能够达到自己百分之八十满意度的图片,然后我们再单拎出来丢到 ps 里 进行后期修改,虽然说可能不能完全代替以往的全流程,但是仍然省下了百分之八十的时间,不是吗?那么这条工作流啊,我也同样会放在评论区里。好,接下来我们再来看一下关于 ai 视频, 我们来到可灵 ai 的 官网里,那么首页这边会展示各式各样的 ai 小 视频,那么它们都是各位 ai 玩家所生成的,比如说像这个切蛋糕,或者说旁边的切雪梨。那么最近这种 ai 切割视频非常火爆,它究竟是如何创作的? 来我们直接点击一键同款我们就可以看到,哎,这边呢会弹出一个生成框,首先呢,我们需要在手针上传我们想要切割的图片,比如说啊,可以用刚才所介绍的康复 y 中 进行生成,那么生成完手针图片之后就丢到这个区块中,然后我们在创意描述这边书写咱们的关键词, 其实这边和以往的正向提示词非常像,就是我们想要什么就输入什么,比如让他缓慢的切果冻,那最终再点击 以下的立即生成,就可以跑出一段像这样切割梨形果冻的视频,那比如说像下边的这一个切割梵高星空的也是同理来,不信的话,我们一起点击一键同款来看看,也是在手抷图这边上传我们想要切割的图像, 那么有的小伙伴可能会说,哎呀,我该如何创作出像这样的 ai 图像呢?关键词也很简单,我们可以这么书写杰作,高清极致的细节, 由梵高星空组成的果冻方块,人手拿着一把刀放在方块的上方,接下来我们再书写一下关于背景的提示词嘛,那像这张图的话,我们就可以说在海洋里,并且水里有各式各样的鱼在游动着,自然光光,光影斑驳 类似的词汇。好的,那么接下来在导入完手阵图之后,还是和刚刚那个案例一样,书写修饰词,写完点击立即生成,就可以生成一段像这样的 ai 视频, 操作也是非常的简单。那么关于 ai 视频还有其他各式各样的应用,我们都可以在可令 ai 或者极梦 ai 等 ai 视频相关网站内进行进一步了解,比如说啊,我们可用 ai 视频来进行宣传片的制作,广告制作, 增强脚本,视觉特效,智能配音调色等等等等。咱们来看一段商业级 ai 视频广告, 咱们不难发现,像这段广告的产品细节还原度非常的高,同时呢画面流畅不卡顿,没有扭曲变形这种 ai 视频 传统的症状。那这就是现在 ai 视频的实力。除了 ai 视频,我们还可以用 ai 来生成一段音乐,一个叫做 solo ai 的 ai 音乐生成网站,可以根据咱们的提示词生成相关内容。 你想要爵士乐,你想要纯音乐,你想要大提琴,你想要索风情,想要什么?输入即可。那好,刚刚听完老师吧啦吧啦一大堆,咱们来扯点实际的,关于就业方向, ai 能为我们做什么?或者说 ai 怎么去变现,掌握了它 啥用呢?哎,作用非常多。一个方面是我们可以用 a i g c 来提升自己的竞争力,为我们以往的工作带来效率上的提生,产出更多的价值。第二方面,咱们啊可以从事 a i g c 有 关的岗位, 因为 ai 目前处于风口,专职的 ai 岗位薪资还是非常可观的,我们可以看到平均基本都在十 k 以上。当然如果能把 ai 结合在你原先的技能之上,我相信最终你所收获的远远不止这月薪十 k。 其实我们学会了 ai 之后,还有其他变现的方式, 或者说非常多种。第一种兼职,我们可以上各大接单网站上,通过接单的方式来赚钱, 单少则一百,多则几千,根据自己的个人能力而定,但是在接单的过程中,这边老师要提醒大家一点,如果说有需要预付款或者说交保证金的, 咱们就得提高警惕了,因为这样的单子往往都是有点问题的。当然,市面上大把大把的单,为什么要去接那几个有嫌疑的呢?那这就是规避风险的一个小技巧。 接着第二种变现方式,收卖工作流。一套工作流如果说找人专门定制的话,少则几百,多则几千, 比如说像企业私人订制的那种,上百个节点,效果非常不错,又很稳定,这种工作流是具备五千左右价值的。当然了,如果说是工作流的单子,记得工作流不可外传。咱们再来谈谈第三种用 ai 变现的方式,就 是做自媒体。在本期视频的开头,为何大家提到了现在已经有非常多的博主在各大平台上用 ai 来武装自己,用 ai 来赋能,产出的内容由 ai 全权负责。那么我们可以用 人工智能,比如像康复 ui、 gpt、 web ui 类似的软件,达到别人可能需要两三个星期才能合成的效果。这一点对于自媒体人而言 无疑是一个巨大的便利,毕竟做自媒体内容才是王道嘛。那除了刚才所谈到的三种变现方式之外,我们还可以用人工智能透过一些案例来实现变现,比如说像老照片修复,像 ai 写真,又或者售卖咱们生成的美图 做壁纸号。总之啊,变现的方式千千万万,变现的思路才是最重要的,毕竟授人以鱼不如授人以鱼嘛。接下来我们来看一下如何才能提升咱们个人的能力?怎么样才能在 a i g c 这条路上继续深耕? 我们来看一下什么人适合学习 ai gc。 那 首先啊,是热爱人工智能以及 ai 相关行业的人,比如说对大元模型很感兴趣,对模型的炼制很感兴趣哎,或者说 对 ai 绘画,对 stability fusion, 对 康复 ui 这几款软件很感兴趣,那第二就是思维开阔灵活,喜欢新鲜事物的,毕竟我们知道 ai 毋庸置疑就是这个时代的风口。我们每隔几天就能从新闻上看到某某公司又开发了最新的 ai 大 模型, 我们公司运用 ai 去完成了各式各样的内容,比如脑机接口、生物工程、机械化学等等产业。第三就是希望透过 ai 来提升自己个人技能的人群, 从而实现更高的收入。比如像设计师,以往我们可能需要一两天的工作量,现在我们一个下午就能完成, 产出的越多,所收获的自然而然也会越多。这里指的不一定是说拿工资,我们提升了技能之后,可以遵循刚才我所提到的变现思路,用咱们的技能为自己创造额外的收入,相当于副业收入嘛。那么接下来我们就来探讨一下,自学真的可以成才吗? 当然可以,虽说不行,但是很难啊,自学我们可能需要非常多的时间哎,上各大网站搜索各个博主的教学视频,并且教学视频往往不够深入,而真东西往往很难找到。并且在我们学习的过程中会遇到各式各样的问题, 没有人替我们解答,自己解答又非常的费时间,比如一个康复月的报错,可能需要研究一天才能研究明白,但有个好处啊,自学可以省钱了。如果说大家觉得自己的时间充足,那确实是可以自学,但提前说好,可能学习的周期会长达半年到一年, 并且最终的效果没有人可以保证。学习的质量是一方面,另一方面是自我监督。我们知道为什么要有学校,为什么要有老师? 有老师以及学校的存在,能够提供良好的学习环境,并且老师作为过来人,老师知道该如何传授知识, 同时在这样的环境里,我们可以更有效率的学习知识。而培训班就有点像刚才我所说的学校这么一个定位,但是培训班费钱, 不过省时间,因为在培训班内,有老师辅导,有辅导员答疑解惑,并且还有规范的学习时间。当你再度当你懒下来的时候,也有人可以督促你,监督你,帮助你真正的学会 a i g c 这件事情。 比如有的小伙伴可能会说,哎呀,我的需求没这么高,我只是想简单生图来玩玩哎,用 kufui 跑几张 one girl, 跑几个动漫美女,那确实自学完全 ok, 因为它的难度也不高。但如果说我们想要往 ai 就 业发展,或者说接单变现的话, 单凭自学,这并不容易,换算下来成本还会更高。因为咱们知道啊,每个人时间是有限的,时间是有成本的,利用同样的时间,我们去做另外一件事情, 可能可以创造更多的价值。比如我学习 ai g t 这件事情,自学花了我一年时间,但本来我可能三个月就能学会,那多出了九个月,相当于用余的。而如果我用这九个月去创造其他价值, 我相信你会得到的更多,并且最终效果还会更为专业。那接下来我们来看一下月入过万的 ai 人该如何学习。第一种也就是自学嘛,费时间省钱。 刚才我也提到了,你想通过自学的方式达到精英的水准。注意,这边说的是精英,并不是普通就业水准,可能需要三到五年,没有人引导的情况下,效率是非常低的。就比如大家可以想想, 如果在中学阶段,没有老师的引导,让学生自己去自习,最终的高考成绩能好看吗?我相信大概率是一塌糊涂。 当然,如果你说我就是那千分之一万分之一超级自律的人才,哎,那你确实可以自学,无师自通,但是这样的人才,我相信绝大多数普通人都不具备类似的品质。我们需要认清一点,认清自己的不足, 通过其他方式去弥补自己的不足,就能够达到和刚才所说的天才同一起跑线,甚至最终效果 比天才自学还要好得多。这就是方法的不同,造就的最终成果的不同。接着咱们来看一下报班,那报班当然就是费钱省时间了。比如说啊,我们现在 准备毕业了,大四需要一项技能,使自己更有含金量,使自己更有竞争优势。但是自学所带来的专业程度往往是不够的。大家应该明白我意思。比如说在招聘的时候, hr 问你,哎,你的这个 a i g c 技能是怎么来的呀? 你是自学的吗?你说啊,我是,没错,我是自学的,我是从这个 a up 主、这个 b up 主、这个 c up 主中,把他们的知识融汇贯通,变成了我自己的知识。但很明显,这其实是没有系统性的,并且专业程度上难以得到保障。但如果 hr 问你, a 同学,你 a、 h、 c 方面的知识是如何获得的呢?接着你说,哎,我是通过系统性训练,通过什么什么框架,其中涉及到了什么什么案例,然后再把作品集往 hr 脸上一甩,我相信经过系统性学习的人,被招录的概率要远远大于 一种。又或者说你是一位设计类从业者,我们知道像现在 ai 已经渗透到各行各业,其中设计类渗透的尤为严重,比如像和图像有关的领域, 哎,省成一张产品底图,几秒钟就能完事。或者说一幅插画、一幅原画,都是可以用 ai 来省下百分之八十的时间, 就是提升了百分之五百的工作效率。又或者说,哎呀,我现在从事的这个行业环境不好,比如像传统的夕阳产业、四大天坑,我这边就不指名道姓了,你想转型, 你想投入到 ai 时代的 ai 这个风口中,当然可以啊。这个时候你就需要,一是专业的知识,比如刚才我所演示的,但那只是皮毛。第二,你需要相关的背书,在这其中,报班就是一个性价比较为不错的背书。 同时,报了班之后,我们还可以考证,比如说像工信部的 ai 提示词工程师、 ai 设计师类似的职业证书,提升自己在 ai 领域的建树。那么接下来我们来谈论下一个问题,咱们报班啊, 是选择线上还是线下?咱们知道线下培训会涉及到店面费以及各式各样的人工费,在这方面,线下培训的起点已经很高了,所以最终给到的费用当然也 会较高,两三万是非常常见的,而学习周期在三到六个月左右,不过需要到店培训,有时候可能需要全天的学习, 所以不太适合工作党或者学生党。当然比如你说,哎呀,我很有钱,并且我现在不需要工作,也不需要去上学,那么线下培训可以选择,不过我刚才所说的不上学也不需要工作,并且经济条件还不错的人,在人群中的占比 可能连百分之一都不到。咱们再来看一下关于线上培训,那么线上培训相比于线下培训,其中费用必然就少了很多,因为我们不需要店面了,并且管理成本也会更低,从而导致科单价也会随之降低,一般一万以内,有时候 三千五千就能搞定。而学习的时间比较灵活,可以根据学员们的自身情况进行个性化的安排,毕竟是线上吧,更方便调整。 同时我们不需要搭半个小时的公交,搭一个小时的地铁,开三十分钟的车到线下店,然后在线下店学完四个小时 又搭地铁坐公交开车回家,节省了非常多的通行时间。而线上培训还有个好处,那就是随时随地 都能学习,我们可以躺在床上看,我们可以在电脑前端正的看,我们可以在坐地铁通勤的时候回看路播,又或者可以在安静的图书馆内戴上耳机看直播都行,场地时间完全不设限。那现在咱们又面临一个新的问题,比如说我从事的是设计领域, 而我想做的是自媒体或者说 ai 影视领域。很明显,刚才所提到的两大领域之间联系并不多。当然可能还有小伙伴说,哎呀,我想学习的是 ai 绘画专项,这又和设计领域区分开来了。 对此,咱们一共分了三大专项班,能够更好地针对拥有不同需求的学员。那么我们该如何提升自己在 ai gc 这一块的认知, 如何抓住 ai 这个风口呢?现在咱们不妨看一下和它有关的课程。咱们这边推出了三大专项班,分别是视觉实战班以及绘画实战班,还有视频媒体商业实战班。每一个班型皆由软件基础班、家中级班以及高级班构成, 具体他们是什么,咱们接着往下看。首先是关于我们的视觉商业就业版,一共二十二个核心教学模块,平均三点五个月即可学完,那这就是我们的课程大纲。其中初级班的目的在于教会我们 什么是 ai 绘画工具,以及它能做些什么。而中级班在于帮助我们巩固工具的使用。高级班我们将把工具与案例相结合,最大程度的发挥个人价值。 除此之外,咱们还有接单以及就业辅导。好,那接下来我们来看一下绘画商业就业班,也是同样的,由初级班、中级班 以及高级班构成,像商业插画、游戏、道具设计、场景设计、小说推文、视频等等等等,咱们都可以在绘画商业就业班中学到。同样的,凡是报名的同学均享有一年的学 学习期限,小伙伴们一般在三点五个月之内即可学会。咱们再来看一下视频媒体商业就业班,那这一个就是关于 ai 视频类的。 提到 ai 视频,不得不说它的发展速度实在是过于迅猛了,是一个非常有发展前景的就业方向。比如刚刚所介绍的各种各样 ai 视频软件的详细使用方法,包括剪辑思路、后期调色、商业广告制作,甚至是 ai 自媒体的运营, 咱们都可以在 ai 视频媒体商业就业班中学到。最后个班型叫做全能商业就业班,它包含了之前三个班型的 所有课程,总共两年学习时长,什么时候不懂了都可以回头看往节课的录播。这个班型比较适合想全方面了解 ai 的 同学,并且无论是哪种班型,咱们每周都有至少两节直播课。同时呢,我们还会为每位同学专门拉个群, 其中会有数名老师在其中进行答疑解惑,解决您在 ai 学习进步上的每一个问题。接下来是课程表,当我们完成了中级班的内容之后,就可以开始高级班的学习。接下来咱们来看一下每一个班型的价格。 首先是 ai g c 绘画商业就业班,关于这个班型,我们享有一年的学习期限,并且在本视频底下预定的小伙伴均享有一百定金抵 幺五八零的优惠,最终到头价格为三五六零,换算下来每天还不到十块钱,但是为咱们创造的价值,那可就远远超过三五六零这个数字了。因为在我们学成了之后, 可以去接单,可以去兼职,就获得职业转型,直接从事 ai 有 关的工作。接下来看到视觉商业就业班,这个班型适合设计类、美术相关的小伙伴,最终到头价格为三七六零,如果说官网购买的话,需要花费五千三百四十, 反在本视频底下咨询预定的小伙伴均享有一百抵幺五八零,相当于直接省了一千五百块左右。那之后就是 ai 视频媒体商业就业班, 这个班型因为会涉及到一些 ai 视频工具,而 ai 视频工具所需的算力较为昂贵,课程打造费用也是较高,所以到手价位 三九六零。当然,如果说我们全都要,无论是绘画、视觉设计以及视频媒体都想了解的小伙伴,想全方位学习 ai, 在 这个时代中各行各业应用的小伙伴, 那不妨选择咱们的 ai gc 全能商业就业班,这个的折扣力度也会更大。凡是在本视频底下预定的小伙伴,均享有两百抵四五八零,相当于直接省了四千多块,而到手价是六千一百二十, 囊括前三种班型,总价值一万两千加,但是现在只花一半的价格即可学到所有内容。如果你说,哎呀,现在我的经济方面可能确实拿不出这笔钱,那么我们还可以通过十二期免息支付, 比如说像绘画商业就业班,咱们月付啊,仅需两百九十六,一天十块不到。而全能班呢,月付五百一十,一天也就一杯奶茶钱。 有小伙伴可能会觉得,哎,这个福利还是不够诱人,有没有什么其他额外赠送的东西?那当然是有的,首先啊, 对于本地硬件较为普通的小伙伴,那么我们是享有赠送云算力,可以支持你直接在浏览器上在线运行,同时我们还能提供免费的魔法软件,助力小伙伴们上网无忧, 想下什么模型就下什么模型,想下什么插件就下什么插件,接着我们还能提供全网的商业模型,要知道 有些模型是需要付费的,咱们都为大家准备好了。第四,商搞,优先派发。咱们作为一个十多年的老牌机构,要知道是有非常多合作渠道的,其中老师的手里也有非常多的商单,要是你觉得你有实力,欢迎随时联系老师,随后给您优先派发。第五,一年的 学习期限,在这一年中,随时可以回看录播,随时可以观看直播,随时可以提出问题,最终都能得到解答。接着是第六点,精品课程十送五,具体是哪些课程咱们待会看。先来看一下下边的另外这五项,那这五项是全能班的小伙伴才能享有的。首先就是 海量的提示词课间,比如说啊,像动画有关的,电商有关的,设计相关的,又或是某某艺术风格,某某运镜,某某镜头参数类似的提示词咱们都能给到你。 第八点,精品课程直接全送,咱们来看看这十项,就是刚才所提到的精品课程,如果说你是报名专项班的小伙伴,可以在这十项中 任选五项,而如果说咱们报的是全能班,那么全都给到你。回到刚才的板块来看看。第十点,优质企业就业内推。作为一个十多年的老牌机构,我们会和各式各样的公司企业合作,同时就给到了我们一些珍贵的内推名额,如果报名全能班的小伙伴是可以享有这一项福利的。 此外,在我们用 ai 技能去变现的时候,比如说像接单兼职,都是可以给到大家专项接单项目的协助指导。比如说你所接的商单需要注意哪些细节,某个模块该怎么去完成?全流程应该怎么规划。 记住刚才所说的精品课,目的也是为了丰富咱们的个人技能,提升个人竞争力。如果你只会 a i g c, 那 么你可能可以打败百分之六十的人,但如果你既会 a i g c, 又会其他工具,那么你将打败百分之八九十的人。 接下来咱们来看一下往期的学长学姐的课后作业,我们可以看到完成的效果非常的不错,最后还拿不定主意咨询咨询,看一下自己 适不适合,然后再做决定。我也非常感谢各位小伙伴观看到这里,同时我也祝愿大家抓住 ai 这个机遇,让我们一起拥抱美好的明天。哈喽大家好,欢迎来到本期的康复 ui 教学,那么这节课是第二节,咱们一起来学习康复 ui 最基本的框架以及最基础的生图工作流。 在开始之前,关于如何安装康复 ui 这一点咱们提一下,至于现在网上已经有非常多的安装教程,那我这边也就不再过多赘述了,咱们待会直接切入主题。 不过呢,想要本套课程安装不了,小伙伴可以在评论区内获取。 ok, 在 咱们安装并打开康复 ui 之后,我相信大家跟我看到的都是一样哎,都是这个默认的工作流界面, 咱们现在滑动鼠标的滚轮,哎,就可以发现,咱可以利用滚轮进行放大或缩小,对吧?接着现在我们按住鼠标滚轮, 哎,按下去我们就可以发现了,咱们是不是可以拖动屏幕了?好,那么恭喜你掌握了两种最基本的操作方式。接着咱们看到这工作流,它是不是由一个一个的节点构成的, 它是节点的这一个咱们称为节点,那这一个呢?我们也称为节点,这一个也是节点,这一个也是,对吧?而节点与节点之间它能通过线连接,咱们细心观察可以发现,哎,这个粉色的按钮要连哪啊? 连的是另外一个节点的粉色按钮。继续看,比方说像这个什么 ve 结码的 这个图像啊,蓝色按钮,那它连接的也是,哎,这个保存图像的蓝色按钮。好的,那么现在我们最基本的节点与节点之间是如何连接的? 稍微参透了一点点,再继续深入之前,我们先看到右上角有一个直行点击一下,那么这个东西就好像咱们的升图按钮,点击了之后 等待个几秒到数十秒啊,这个等待时间就会有小伙伴们的设备来决定。我们可以看到现在生成了一张图像,对吧?那么生成这张图像的速度和大家的显卡性能有关,我这边还是比较推荐大家, 至少要三零六零级以上啊。当然如果说你没有这么好的硬件设备,我们也可以用云端嘛,对吧?比方说现在什么 libai, 什么端脑之类的, 有很多可以在线生图的平台,那这个我们放在第五节课中会提到,接着我们重新回到这张图片,咱们可以看到啊,它是一个 装着星云,装着紫色森林的瓶子,以及它的背景是树林,对吧?问题来了,凭什么它生成的内容是这一些,而不是一头大象护着做一只小猫呢?那这边呢,咱们就要看到正向提示词, 啥是正向提示词啊?细心观察可以发现这边有一个正面条件,那正面条件这根线连出去的这个框框,哎,这个叫做什么? c l i p 文本编码器,咱们称之为颗粒文本编码器, 那么在这边输入的内容就被称为正向提示词,内容,也就是我们想要什么就在这边输入什么。 咱们可以来做个简单的小实验,大家看我们把这些词汇啊给删去,然后输入一座花园。注意啊,这边一定要输入的是英文, 如果是中文的话,那么电脑将无法识别,从而生成错乱的图片。好,那么在我们输入完一座花园之后,就点击直行,现在我们可以看到生成的图像是不是成功变成了花园呢?简直是像魔法一般神奇。 当然现在我们称之为魔法,是因为不懂背后的运行逻辑吗?等到我们学完第三第四节课,也就是 ai 生图背后的运行原理之后,我们就知道这一切不是魔法,而是科学的结晶。 好的,那么在我们说完正向提示词之后,我们来说一说,他的对角叫做反向提示词,也称为负向提示词,想想在哪输入啊?看到正面条件的下面有一个负面条件, 当然就是在这所连线的框框,也就是这个 clip 文本编码器,输入咱们的副象提示词。 ok, 那 么新的问题又来了,正向提示词非常好理解嘛,咱们刚才这个就是想要什么就输入什么, 那副象提示词呢?该怎么理解?哎,其实和刚刚说的相反,就是我们不想要什么,就在副象提示词文本框内输入什么。 哎呀,堡主,我还是不懂啊。好,我这边来举个小例子,比方咱们看到刚才生成这张图像吧,怎么样啊?是不是有非常多的花哎,有粉的,红的、紫的,各式各样。那如果我们现在不想要 图片中的花占比这么多的话,那么我们就在复相提示词中输入花朵,那花朵怎么拼啊?就 flower 嘛,当然做,小伙伴们在圆上遇到任何问题,我们都可以用翻译嘛,对吧?比方这个 有刀翻译我就挺喜欢的,非常便捷啊。 ok, 这边是纯推荐,还不是广告?好,我们接下来就点击执行。哎,现在咱发现了没有, 图片中花朵的元素是不是降低了很多?比方我们再次点击执行来看一下,对吧?经过两次实验,图片中的花朵确实是比例明显变少了,但是并不是说完全消除。 那这也正如我刚才所说,负面提示词啊,他所做的更多是消除我们输入的东西在画面中的比例,而在画面中的权重, 是吧?但是完全根除的话,这需要其他操作,我们接下来的课程中会提到。 ok, 那 么现在学习完正负向提示词, 我们再来看一下连接正负相提示词的这一个叫 k 彩样器,那么他呀,我们可以理解成就好像人体的大脑,他控制的整个工作流, 哎,不难发现,基本上所有的节点都会集到了 k 彩样器里,然后这些所有的数据啊,参数啊汇聚到这之后,经过 k 彩样器内部的运算,然后最终才得出了我们的 ai 图像, 至于背后的生图逻辑,哎,我们下一节第三节在纹身图以及背后的运行原理中会详细展开,那么这边我们先大概了解一下就好。接着我们来看到这个 k 采样器啊, 它有个叫做 layton 的 东西啊,这个 layton 我 们顺着粉色的线往下看,连到了一个叫空 layton 的 节点,大家看看这空 layton 它是干啥用的呀? 我相信关于这个名词不能说百分百吧,百分之九十九的小伙伴应该都是非常的困惑的。好,那么我们在学习一个新东西的时候, 我们可以看一下它的参数,咱们一起来研究一下。首先它共有三个参数嘛,分别是宽度,高度还有皮尺大小,对吧?那现在是不是豁然开朗,这个节点呢, 就是控制我们最终生成图像尺寸呢,比例啊,图片整体像素的一个节点,比如我们把这宽度给改成七百六十八,相当于此时的宽高比为二比三嘛, 然后咱们点击直行怎么样啊?最终升图是不是非常简单的就被修改成了竖屏比例,那么同样的比方,我们把这个宽度给改成七百六十八,然后把高度改成五百一十二, 此时咱们再点击执行,就可以看到图片也是非常顺利的变成了横屏比例。而关于最后一个参数,也就是空列腾的 p 次大小,这一个我们是不是还有点疑虑?好, 那么咱们就来尝试一下嘛,比方把它给改成个四吧,具体会发生什么我们待会才知道,咱们只管点击执行就好。 ok, 我 们来看一下发生了什么变化吗?咱们看到这个保存图像节点的右下方出现了一个四分之一,对吧? 并且这边有个交叉按钮,咱们点击一下。哦,发现原来呀,刚才的批次大小代表着一次性出多少张图片,对吧? 像刚才我们设置成四,那么此时呢,也就是一次性出了四张图片。比方说我们在需要进行大批量生图的时候,或者说在测试某一个参数的影响,那么我们就可以把这个空内存的批次给调高一些。不过如果说批次大小过高,比方说三十、四十甚至是一百, 那么就有可能会出现报显存的情况,如果大家不幸遇到了报显存,那么我们重启一下 comfuly 就 好。好的,我们来看一下。现在啊,咱们已经把正向提示词还有反向提示词的文本编码器都讲了嘛,以及 k 太阳器 coin 也讲了,还有哪个没讲呢? 那就是 checkpoint 加载器嘛,咱们把目光看到这可以发现啊,它是不是有点像一切的源头, 非常多的线都连到了这个节点上,这代表着他有非常重要的地位。也确实我们在 qq 缓存器里面加载的就是大模型啊,我相信这个名词大家或多或少都听说过,那么啥是大模型呢? 咱们可以这么简单的去理解,大模型可以控制整体的出图基调,比方说有了大模型是真实系,有了大模型是动漫系, 咱们现在把大模型给换成一个动漫类大模型,接着什么参数都不用调,直接点击执行。 来看一下单单修改一个大模型,会对我们最终出图效果发生什么样的变化。好的,现在我们不难发现,图片呢,是不是整体风格都变成了偏动漫或者说非写实的风格? 那么我们现在重新看到大模型,咱现在再换一个真实的大模型吧,然后再点击执行,是不是感觉到画风一转呢,瞬间变成了写实风格, ok, 这又是大模型的威力,非要比喻的话,可以把它想象成人体的意识, 啥意思呢?如果我整天哎只想着色色的事情,那么我最终出图啊,咱们最终的成品必然也是和色色有关。 那如果说我整天想的是非常正能量,积极向上的事情,那咱们的最终成品也必然会啊,你懂吧? ok, 之后我们来看到这个 v e 解码, 它呀,就好像一个转换接头,可以把咱们的 latent 图像变成像素空间图像,那具体是啥意思,我们放在下节课去讲。接下来,比方说啊,我们不小心把这个 v e 解码给删去了,哎,对吧?删去了之后我们该如何去添加呢?一共有多种方法,一个就是摁 ctrl z, 哎,那么就可以回到上一步的操作。好的,现在我们再把它给删去。还有种方法就是我们在 k 采集器的后边 laten, 哎,咱们把它给拖出来,然后松开鼠标,看到这个 v a e decode 怎么样啊?他是不是又重新出现了?接着我们只需要把它的图像 与原来的保存图像相连,然后这个 v a e 又是个新名词,把这个 v e 连接在哪,咱们可以找一找, 哪有红色的输出呢?那就是 checkpoint 加载器嘛。我知道小伙伴们现在可能有非常多困惑,但是都不用着急,因为我们本节课主要教的是基础的操作嘛,至于接下来的,比方说参数啊,或者说他们背后的逻辑,我们会在后边揭晓。好的,那么刚才我们讲完了第二种添加这个 ve 解码的方法, 那么还有第三种方法是啥呢?我们可以双击界面,哎,此时啊,出现了一个搜索节点栏,那么我们可以在这边输入,想要查找节点的名字,那咱们就搜 v a e 解码,可以看到这边也是有非常多的选项,对吧?咱们选择第一个啊, 可以看到 v a e 解码,点击一下,它就这么出现在了我们画面之中,接下来也是与其他节点相连,即可恢复成原来的样子。 好的,那么第三种方法讲完了之后啊,我们来看一下第四种方法,我们同样的把鼠标放在空白处,摁一下右键, 接着看到这一个添加节点按钮,点击一下,随后我们找到 laten, 同样的点击一下后,就可以发现咱们的 v a e 解码在这边出现了,对吧?接下来只需要再次点击,那么他就重新出现在了工作流之中。 不过我们也能发现这第四种方法非常的繁琐,一般情况下我们都是直接搜索即可。那当然啊,其实还有第五种方法 啊,我这边也说了,因为这节课是基础操作课嘛,咱们就把这些最基础的给讲透,我们把目光看到左边有一个像字典一样的东西啊,点击一下,那么这个东西啊,它是存放所有节点的地方,我们同样的可以在这边搜索节点 输入 ve, 然后就可以看到各个节点包里面和 ve, 也就是咱们相关输入的词汇有关的节点, 那么我们也不难发现 ve 节点码在最上边,对吧?同样的点击一下就可以看到它又再次出现在了工作流之中。那么以上啊,就是五种常见的加载节点的方式, 而正如我刚才所说,咱们平时啊最方便最实用的方法就直接双击界面,然后搜索 v a e 即可,这是一种,还有一种就是直接来到,比方说像这个 laten 吧,拖出来可以看到在这个默认的加载节点里面有 v a e 解码的话, 点击一下,那么他是不是也非常快速的就被加载出来了?那么以上两种方法是最常用的,大家稍微记一下即可。好,既然我们看到了左边,我们就继续顺着左边来看一下这些东西都代表了什么吧。 首先上面这一个像时钟一样的点击一下,可以发现了咱们之前生成的队列,哎,也就是咱们所执行的任务都在这边出现了,比方啊,像这一个下面有个四的角标,代表着一次性出了四张图,对吧?咱们可以点击一下, 这一次任务所生成的四张图就会被展开。好,我们在队列的返回按钮点击一下,咱们就可以回到刚才的队列预览界面。那接着我们来看一下这个小小的立方体啊,它代表什么?这一个是我们存放模型的地方, 比方说像什么大模型啊, laura 呀,什么 control, 那 模型都可以在这边显示,那具体像我刚才说那些名词,它们代表了什么,也是在之后的课程中咱们会逐一揭晓。那顺着这个立方体往下看,有个文件夹对吧?那这个文件夹 就是我们存放工作流的地方,这边又要隐身出个问题了,比如说吧,我们现在这一套工作流想把它给保存下来,怎么保存呢?我们同样的也是看到左上角有一个工作流,点击一下,随后咱们可以点击保存后的另存为, 咱们先点一下保存吧,接着编辑一下工作的名字,比方说第二节课点击确认怎么样啊?咱们刚才保存的工作流是不是就到了这,对吧?下次想要调用的时候,我们只需要双击或者说哎,把它给拖出来,拖到空白处,就可以重新加载咱们保存的工作流。 好的,我们顺着文件夹往下看,有一个月亮按钮,点击一下,那么整体的风格就会变白,变得明亮,对吧?再点击一下,又会回到刚才的深色风格。 ok, 那 现在重要的来了,看到这个齿轮,也就是设置嘛,我们可以在这边来调整咱们的界面语言, 我们看到这个 comfy 的 区域设置,在这里就可以调整相关语言了,当然你想要英语或中文,或者说什么其他语言都行,那我这边也是选择了中文。好的,接下来我们看到 这个 comfy 下面的画面,点击一下,随后我们看到连线渲染样式,那这边我们可以选择曲线或者说其他的线型, 比方说直线吧,咱们点击一下,接着就可以看到,辞职啊,怎么样?界面的所有连线都变成了直线,对吧?直来直去的, 那这一个就根据大家的个人喜好来进行调整了吗? ok, 我 们重新回到刚才的画面,那我这边也是先保持直线吧,我觉得直线会更为直观一点, 更方便大家去辨认哪一个节点连接的哪个地方。 ok, 接下来我们看到画面下边的外观,那么在这边我们可以调整色彩主题, 也就是美化咱们的界面吧,那么我相信大家刚和我进来的时候都是这个 duck, 也就是默认选项, 我们可以调成明亮的风格,也可以调成这个蓝色调或者黑色调。 ok, 我 还是调回默认模式,接着可以看到下面有一个节点不透明度,那这个参数比较重要,因为啊,比方说我们看到这套工作流吧,如果我们把 v e 结吗 不小心放在了这个 k 采暖器的后面,我们就压根看不见了,对吧?而节点一多,就有可能会出现这种节点之间相互遮挡的情况,从而增加我们构建工作流的难度, 那么我们就可以回到刚才的节点不透明度,把它给设置成零点四,当然更低也行,那么此时我们就可以看到,哎,可以透过 k 采集器看到下边的 ve 解码节点了,对吧?这样我们在构建工作流的时候会更加的 轻松愉快。 ok, 咱们再讲一个小知识点,比方说吧,像我们刚才是不是新添了这一堆节点了,咱现在不想要了怎么办?我们当然可以一个一个节点的这样去删除, 我们也可以摁住 ctrl 键,然后再摁住鼠标左键,哎,这样子就可以框选节点,接着再摁键盘上的 delete 键,就可以做到区选删除。 而同时比方说我们现在需选这一套工作流,我想同时拖动这么多节点的话,直接摁住鼠标左键就可以进行整体拖动了。而如果说我们想升图的时候,我们除了直接点击执行, 我们也可以摁 ctrl 加 enter 键,这样就可以做到快捷的图片生成。好的,那么以上啊就是关于本期的全部内容了,知识点比较碎,比较杂,可能需要吸收一段时间,那么我们就在下节课文身图以及深层原理,再见吧!拜拜!

110秋秋葉aki 11:57查看AI文稿AI文稿

11:57查看AI文稿AI文稿电脑上必备的 ai 软件它来了,那就是 comfy ui, 无论生成视频又或者生成图片都不在话下,而且最近又上线了它的最新版本,无论你是高配五十系显卡的大佬,还是三十四十系的家庭用户,都可以畅享生成视频的乐趣。 因为现在的生成加速技术,比如 sage g g、 u f 加速、 laura 等层出不穷,而且不断在更新,大大降低了生成门槛。这里我用四零系的电脑展示一下效果,无论是图声、视频、 视频首尾帧, 又或者是视频高清放大、 视频动作迁移都是完全没有问题的。当然生图功能就更不必说了,最新出的 c m g 模型更是王炸级别了,效果达到以假乱真的地步了。 你要问我这款软件用起来收费吗?或者说分享资料收费吗?我可以肯定的跟你说一句,完全免费!无论是使用软件收费的, 或者是翻你资料还要收费的,都要擦亮双眼。那么这款软件的安装包和模型工作的文件在评论区里面自己去拿就行了。说了这么多它的功能,那么到底要该怎么使用呢? 很多人觉得这个软件用起来难度很大,不知道从哪下载模型和工作流,不用怕,我已经通通为你下载好了,并且预制成一个文件夹了,真正做到了开箱即用。同时我知道现在大家对于这个软件可能不那么熟悉,我翻遍了市面上的很多教程,有几百几千播放的,几万几十万播放的都有, 我可以说里面的教程内容是鱼龙混杂的,对我们的新手小白并不是很友好,因此我特意花费了三个月的时间专心制作了一套面对于新手小白的教程,里面的内容包含了从安装下载 再到使用各种模型出图,生成炫酷的 ai 绘画等等。这些内容可以说是帮助我们新手小白变成 ai 大 神的最快捷径, 大家可以在我后面的教程里面继续深入探索 ai 绘画的无限可能。那么欢迎来到我的 comfort ui 系列课程的第二课。上节课我们讲到了我们纹身图的工作的底层逻辑, 那么这节课呢,我们就即将讲到我们的图身图跟局部重绘。我们上节课有说到我们的纹身图,图身图和局部重绘是共列为我们 comfort ui 工作流里面的 b g 对 吧?那么这节课用到的所有的工作流,还有我们的整合包资源,我都会放在我们的置顶评论区,有需要的小伙伴们直接去领取哦!我们话不多说,直接开始讲解,那么我们先来看一下我们的 图身图工作流。图身图工作流其实也是非常的简单,它跟我们纹身图工作流不一样的地方是它少了一个空闲腾对吧?它多了一个 v a e 编码以及我们的加载图像,当然了,这里还有一个图像按像素缩放,这一个我们待会再讲。那么这个 v a e 编码 这个节点它是什么东西呢?我们上节课有讲到我们大模型在训练的时候是不是注入了非常多人类看得懂的图片,那是人类的语言,那计算机能不能看得懂? 当然是看不懂的,那既然计算机看不懂我们的图片,那么我们的图片就需要经过我们这一个 chip 加载器里面的 ve 去进行怎么样进行编码,对吧?最后传输给我们的 k 长进行使用, 这样子我们的计算机,也就是我们这个 ai 的 流程才能够跑得动,才能够跑出我们想要的图片。那么既然是图深图的工作流,也就是说我们是需要用图片去生成图片的,而不是像我们纹身图工作流一样, 直接是无中生有。那么既然我们是需要用图片生成图片,那我们是不是需要上传一张图片?所以我们需要一个新的节点,叫做加载图像节点。但是我们上传这张图片之后呢,你会发现这个图片它是什么?什么图片?是不是我们人类看得懂的语言这个图片,那么我们也同样需要对这张图片进行 一个编码,把人类看得懂的语言变成计算机所看得懂的语言。所以我们就会问了,我们为什么不能直接用 pip 加载器里面的这一个 v a e? 这就要讲到我们去训练这个模型的时候,这张图片它不一定存在于我们这个大模型里面,就是训练的时候,那么我们在不一定的情况下,我们就需要保证它在接下来的工作流的过程中呢,是能被编码到的,所以我们需要加载一个 ve 编码进来, 我们直接把图片,我们可以先把这个图像按像素缩放给它删掉,我们可以直接把图片给到我们的 v a e 编码这么一个节点,然后给到它之后呢,你会发现它编码完的信息是通过 lunton 点传给我们的 k 传感器的,那么我们上节课纹身图的时候,我们的空 lunton 是 不是传到这个 lunton 点,那么现在变成了 v a e 编码的这个 lunton 传到了 k 彩虹器这里面,那么我们上节课有说到我们的空 lincoln 相当于一张白色画布,对不对?那么我们进行作画的时候,是不是需要一张白色画布进行使用?那么我们图深图也是一样的,我们也需要一张画布,但是这张画布不再是空白画布,而是我们这张上传的图像,它把我们上传的图像当成了一张画布去使用, 所以这个 lincoln 点上传到 k 彩虹器,那么我们就可以知道我们上传的这张图像的大小跟我们的画布大小应该是一致的,对不对? 那么还有一点我们需要注意的是,那既然是用图像生成图像,那么我们这一个上传的图像它是不是具有一定的参考性?那么待会我们进行图生图的时候, 我们要达到的目的应该是我们生成的图像跟我们的原图具有一定的相似度,但是又跟原图有不一样的地方,所以我们这个降噪我们能不能调到一不行?为什么不行?因为我们上节课纹身图的时候,我们用的是空人腾完全的白色画布, 我们的降噪需要为一,对吧?如果降噪不为一的话,他会有降噪不完全的一个效果,这是对于空画布来说的,但是现在是我们的图身图,对吧?现在 是我们的图身图,那么画布里面已经有了内容了,我们需不需要再把降噪调为一?是不需要的,如果我们把降噪调为一的话,那么他就会把我们上传的这张图像当做一张白色画布来使用,只不过这张白色画布的尺寸是跟我们上传的图像是一样的。 那么如果我们把降噪调到零点五,也就是说我们待会让他画画的时候,不要完全去改变我们画面的一个内容,也就是说你要有百分之五十的参考到我这个画面,所以这个降噪我们就不能调到一,然后这里的降噪也会变成我们所说的重绘幅度, 也就是说你这里的降噪的指数越低,那么它跟我们原图的样子越不像最后的出图效果。 那么知道了里面的一些逻辑之后,我们就可以尝试的去跑一下这个工作流,比如说我自己的模型换成动漫的一个模型,但是呢,我这个上传的人物是一个真人,那么他会发生什么效果呢?我提示词只输入一个女孩子提示词,然后去跑一下这工作流。 five minutes later, 好, 我们发现刚刚我们去进行跑图的时候,它的速度非常的慢,这是为什么?是因为我们上传的图像它的大小具有两千乘以两千的分辨率,那么也就是说呢,我们这个画布大小它是两千乘两千的一个宽高比, 那么两千乘以两千呢,也就是差不多达到我们的二 k 图片了,它的大小是非常的大的,对于我们 ai 这个工作来说呢,它的负荷也需要非常的大,那么我的本电脑用的是三零六零的显卡,所以说对我的本电脑显卡的负担是比较大的,所以它跑的是比较慢的,那么我有什么方法可以解决这个问题呢? 就是我们刚刚说的像素按系数缩放那么一个节点,我们可以先把图像 给他连过来,连到这个节点上,然后我们再把这一个输出的图像连到我们的 v a 编码,然后这里有个像素数量,我们可以把它调成零点二五,也就是说我们的两千乘以两千,经过这个节点的时候,要再乘以零点二五,那就会变成多少,大家可以自己去思考一下。 然后我们把它降到零点二五的大小。之后呢,我们再来跑一下,看一下它的速度。 好,现在的速度是不是非常的快了?好,我们可以看到最后跑出来的图像呢,跟我们的原图是非常相似的,只不过他的画风改变了,对吧?为什么他的画风改变了?因为画风现在是由我们的大模型去掌控的,但是我们上传了一张图像,对他进行图深图,最后的结果就是他会在参考我们原图的基础上, 就去配合这个大模型的画风进行一个深图,就得到了我们一个风格转会的效果。我们可以继续尝试调节一下我们的降噪,比如说我们把降噪调到零点八,看一下效果, 有没有发现这一个图片跟我们原图就变得不那么相像了,但是构图什么的都还是比较一致的,是因为我们的降噪调高了,那么他需要重绘的部分也就越多,那么我们再把它调到零点三, 好,调到零点三的时候是不是更加的贴近我们的原图,现在我们可以把它调到零点一, 好,有没有发现基本上就跟我们这个原图比较相似啊,只不过还带着大模型的一些风格在里面,也就是偏向于动漫的那一种质感,对吧? 那么我们的图生图就是这么的简单。当然了,讲完了图生图,我们需要讲一个局部重绘,那么局部重绘的工作流我们该怎么去搭建呢?其实局部重绘也是要让我们上传一张图像,然后在这张图像的基础上进行部分的修改,因为我们的图生图跟局部重绘来对比的话,图生图是不是对整张图片的风格进行修改? 但是我们需要用到一个新的节点,叫做设置 unfold 照波遮罩,我们需要对我们这一张图片的局部进行修改,那么我们就需要让 ai 知道我们这个局部到底是在什么地方,比如说他的眼睛,或者说他的头发部分,对吧?所以我们需要设置 unfold 照波遮罩这么一个节点,去输入遮罩部分,这个遮罩部分也就是我们加载图像这里有的遮罩部分,我们可以给它连进来, 连进来之后呢,这里的 v a e 编码我们不能直接上传给 k 档期,我们应该先把这个编码完的 lincoln 给到我们这个设置 lincoln 照波遮罩这里。为什么? 因为我们这个 lincoln 编码对我们这整张图像进行编码完之后,他有我们整张图像的信息,我们把整张图像的信息给到我们的设置 lincoln 照波遮罩之后,然后跟我们的遮罩进行匹配,两两重合之下,他就知道需要重绘的部分应该是哪里,然后最后我们再把 lincoln 上传, 就达到我们局部重绘的一个效果。然后呢我们需要对这个遮罩进行一定的处理,我们怎么样处理出来这个遮罩呢?我们左键点击选中这个加载图像这么一个节点,然后右键右键之后在遮罩编辑器中打开,可以看到吧,选择选择一下,我们把他的头发简单的进行一下涂抹 好,涂抹完之后呢,我们简单在提示词这里写一下,比如说我想让他头发变成红色的,我就打红色头发这么一个提示词给他,然后点击生成就可以。 我们可以看到效果是不是非常的不明显,为什么?因为我们刚刚的降噪这里还是零点一,那么他会急剧的去参考我这个原图,基本上不发生变化,如果我把它调零点五,我们看下效果 好红色的部分是不是已经出来了?只不过我们这个模型用的是什么模型?用的是我们一点五的模型的动漫模型,对吧?所以他有一点点这种动漫质感很正常,如果你想让他变得更红一点,我们就可以再往上调调零点八, 好,可以看到现在效果已经变得非常的不错了,对吧?只不过我们看一下这个边边的地方,他可能融合的不是很好,为什么呢?是因为我们这个遮罩部分啊,涂的有点太过于潦草了,其实你可以涂的更加的精细一点,可能效果会更好一点,或者说你降一下这个降噪的数量,比如说把降到零点七, 好,这样子就更贴近原图了,对吧?跟我们的原图融合的更好,那么这个就是我们的局部重绘,那么这节课呢?不要忘记一剪三剪哦,我们下节课再见。

279AI绘画-君君 05:46查看AI文稿AI文稿

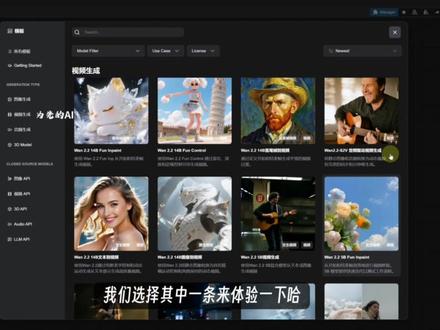

05:46查看AI文稿AI文稿一款软件彻底玩转所有 ai 功能,官方正版还免费,你只需要三步就搞定!已下载二、解压三、双击打开,不用装插件,不用配环境,直接就能用!支持 windows、 mac 和 linux 多种系统和硬件环境。 这还不够哟,我已经帮你把它内置的五十六个 ai 功能全调通了,全程不用你动手,哪怕你完全不懂 ai 是 啥也没关系,照样能轻松玩起来。想画图点一下就行,想做视频再点一下就好,想创作音乐还是点一下的事, 就算要搞三 d 建模,也只是点一下的功夫呀!这可不是什么野鸡套盒网站,而是全球公认最丰富还最贴近生产力的免费开源 ai 软件 comui 哦! 你用它就能玩遍所有叫得上名的国内外最新最前沿的 ai 功能!或许呢,你早就听过它的名字,但今天真的绝对值得重新认识它,因为它变了,变得比以前有好多了!它就是 comui 官方新推出的全新版本, 其中有三点尤其利好咱们中国用户朋友,特别贴心。首先,全中文官方界面,大家注意哦,这可不是第三方翻译插件,是官方正版,原声就支持中文多了,性能还稳,可能性也更高。 连做翻译插件的大佬都直呼有救了,英文不好的朋友,入门的第一道坎,官方直接就帮你摆平了,是不是超省心? 第二呢,新版 comfyui 官方直接筛选了五十六个在 ai 史上留下过浓墨重彩的经典 ai 功能,做成模板,放进了工作流域栏那里了。 从 ai 绘画的纹声图扩图高清放大,局部重绘区域控制到 ai 视频的纹声视频、图声视频 首尾帧过度动画,甚至连三 d 建模音乐音效创作都有,真的应有尽有,你以为这就完了,官方还直接提供了一键安装包,点一下运行直接就能用。 那接下来的话呢,我就带着大家来从康菲尔最初始的部署开始,来部署到我们的本地电脑,那我已经把咱们需要用到的安装包和操作文档都已经打包好了,同时的话呢,有一些主要的电脑配置要求也会给到大家,那如果你是第一次接触到康菲尔的话,那就可以跟着我的视频一步一步来进行。 那么在我们部署 comui 之前呢,首先我们还需要去检查一下咱们系统的配置啊,我们可以通过右键点击 windows 的 菜单栏,然后的话呢,点击我们的任务管理器, 打开任务管理器之后,我们点击到性能的这一个列表当中,我们就可以看到自己设备的整个的一个情况啊,包括 gpu 的 显存,然后包括的话自己的内存 ok, 好 的,那么这个的话呢,是第一步我们要检查一下咱们的一个设备,这是 comfyui 的 推荐配置啊,那当然如果你想要跑的更好一些的话,内存的数量要更高,或者是显存的数量更高才可以, 同时的话呢,硬盘最好能够空余有三百 gb 以上的这样的一个空间啊。那么在检查完了系统配置之后,我们就来安装一下必要的软件啊,我这边推荐的是 comfyui 官方的一键安装包,打开我给大家准备好的 comfyui 官方安装包文件夹,鼠标双击一下这个程序图标,接着按照提示一步一步的安装就可以, 它会弹出一个选定安装程序位置的弹窗,在这里我们选择一个宽裕一点的磁盘进行安装就可以,以我这里为例,我就安装在 d 盘了。安装路径选好了之后,我们接着点击这里的安装,它就会显示 comfyui 正在安装,请稍等。最后等待它安装完毕,我们点击完成就可以了。 这个时候呢,我们来到电脑桌面,双击一下 comfyui 的 这个图标,它就会跳出一个 comfyui get started, 接着会出现这么一个窗口,我们选择 nvidia cuba, 接着点击下一步, 这个时候我们还是选择刚刚安装 configui 程序的那个的位置路径。到这里很多小伙伴们会疑惑,这是要安装什么呢?其实这一步就是要部署 configui 真正运行下来的环境依赖,接着我们点击下一步,这里我们直接保持默认就可以, 它就是一个保持程序自动更新和反馈你在使用软件过程中遇到的问题,方便 configui 官方改进产品,其实就是对新手习惯的功能自动帮助更新。 我们点击下一步,到这里, ctrl u i 就 会自动帮你安装运行程序所要所有环境依赖,等待它安装完成就可以。在这里我要做个提醒一下哈,就是你的电脑全程要有魔法哈,这样在安装过程中,软件要用到的环境依赖才能顺利下载到你的电脑本地,否则可能会遇到下载失败或者卡住等问题。 最后安装完成之后会出现这么一个界面,这些都是 comfyui 官方在里面内置的一百多条经过社区和广大用户验证,拿到过巨大成果的工作流,其中包括图像、视频、音频、三 d 模型等等等等。那么到这里恭喜你,你已经把 comfyui 成功部署到你的本地电脑了,是不是很简单, cosui 部署成功之后,我们该怎么用起来呢?接着我们来到这边,点击一下这个模板的图标,也就是一开始安装成功时弹出来的界面,我们点击视频生成,这里面很多都是通用万象视频开源模型的一些好用的经过广大社区大佬验证过的工作流, 我们选择其中一条来体验一下。这里我们找到万象二点二图生视频来带大家来体验一下。找到这个 one 二点二十四 b 图像到视频工作流点击一下,这时我们会看到一个缺失模型的一个提示弹窗,小伙伴们不要慌哈,我们挨个挨个的点击下载就可以了,你 不用管它具体放置在哪里,直接点击下载就可以了,等待模型下载完成之后,我们就可以愉快的玩耍了。怎么样,小伙伴们是不是 so easy? 这还没完哈,这次 comfyui 还有个重大功能,升级官方签约 api, 简单说,你只需要注册一个 comfyui 官方账号,再充点值,就能在 comfyui 里直接调用所有付费 api 了。而且 comfyui 还承诺所有 api 费用和 openai、 nano、 banana 等各大官方平台的报价完全一致, 没有任何中间商赚差价,用起来特方便,一点不麻烦。时间有限,更多细节我就不展开说了哈。本期视频用到的安装包、电脑配置说明和操作文档我放在了评论区了,绝无套路,点进去就能下,要是实在找不到的话就在评论区发。六六六,我看到了就直接发给你。

07:15查看AI文稿AI文稿

07:15查看AI文稿AI文稿一款软件彻底玩转所有 ai 功能,官方正版还免费?这还不够呦!官方他还帮你把他的两百三十个 ai 功能内置进去了,全程不用你动手,你只需要三步就搞定一,下载。二,解压三双击打开,不用装插件,不用配环境, 连模型也就是一键自动下载,完全就是点开就能用,哪怕你完全不懂 ai 是 啥也没关系,照样能轻松玩起来。想画图点一下就行,想做视频再点一下就好,想创作音乐还是点一下的事, 就算要搞三 d 建模,也只是点一下的功夫呀!这可不是什么野鸡套壳网站,而是全球公认功能最全面、生态最丰富,还最贴近生产力的免费开源 ai 软件 kufui 哦! 你用它就能玩遍所有叫了上名的国内外最新最前沿的 ai 功能!或许呢,你早就听过它的名字,但今天真的绝对值得重新认识它,因为它变了,变得比以前有好多了,它就是 comfy 官方十二月份新推出的全新版本,变动大到超出预期, 其中有三点尤其利好咱们中国用户朋友,特别贴心。首先,全中文官方界面,大家注意哦,这可不是第三方翻译插件,是官方正版原声就支持中文的,比第三方插件权威多了,性能稳可能性也更高。连做翻译插件的大佬都直呼有救了, 英文不好的朋友,入门的第一道坎,官方直接就帮你摆平了,是不是超省心?第二呢,内置了两百三十个开箱即用的模板,完全不用学 新版 comui, 官方直接筛选了两百三十多个在 ai 史上留下过浓墨重彩的经典 ai 功能,做成模板放进工作流预览那里了, 从 ai 绘画的纹身图、图声图扩图、高清放大,局部重绘区域控制到 ai 视频的纹身视频,图声视频首尾帧过度动画,甚至连 3 d 建模音乐音效创作都有,真的应有尽有, 这些全是 comui 官方精选的,新手入门尝鲜,快速掌握时下最流行的 ai 技术,你以为这就完了? 第三呀,官方还直接提供了一键安装包,点一下运行直接就能用。那接下来的话呢,我就带着大家来从 comui 最初始的部署开始,来部署到我们的本地电脑,那我已经把咱们需要用到的安装包和操作为档都已经打包好了, 同时的话呢,有一些主要的电脑配置要求也会给到大家,那如果你是第一次接触到 cfui 的 话,那就可以跟着我的视频一步一步来进行。那么在我们部署 cfui 之前呢,首先我们还需要去检查一下咱们系统的配置啊, 我们可以通过右键点击 windows 的 菜单栏,然后的话呢,点击我们的任务管理器, 打开任务管理器之后,我们点击到性能的这一个列表当中,我们就可以看到自己设备的整个的一个情况啊,包括 gpu 的 显存,然后包括的话自己的内存 ok, 好 的,那么这个的话呢,是第一步我们要检查一下咱们的一个设备,这是 comfui 的 推荐配置啊,那当然,如果你想要跑的更好一些的话,内存的数量要更高,或者是显存的数量更高才可以, 同时的话呢,硬盘最好能够控于有三百 gb 以上的这样的一个空间啊,那么在检查完了系统配置之后,我们就来安装一下必要的软件哈。我这边推荐的是 comui 官方的一键安装包,它是一款用拖拽节点的方式轻松创建图像、视频等生成工作流的 ai 工具, 支持 windows、 mac 和 linux 多种系统和硬件环境。我这边就以最简单的桌面版为例,带大家一步一步的安装到自己的本地电脑上。这里我就以 windows 电脑安装为例,给大家演示一下安装过程,非常适合新手朋友。 打开我给大家准备好的 comui 官方安装包文件夹,鼠标双击一下这个程序图标,接着按照提示一步一步的安装就可以,他会弹出一个选定安装程序位置的弹窗,在这里我们选择一个宽裕一点的磁盘进行安装就可以, 以我这里为例,我就安装在 d 盘了。安装路径选好了之后,我们接着点击这里的安装,他就会显示 comui 正在安装,请稍等,最后等待他安装完毕,我们点击完成就可以了。 这个时候呢,我们来到电脑桌面,双击一下 configui 的 这个图标,它就会跳出一个 configui get started 的 界面,这时我们点击一下 get started, 接着会出现这么一个窗口,我们选择 nvidia cuda, 接着点击下一步,这个时候我们还是选择刚刚安装 configui 程序的那个的位置路径。 到这里很多小伙伴们会疑惑,这是要安装什么呢?其实这一步就是要部署 configui 真正运行起来的环境依赖, 接着我们点击下一步,这里我们直接保持默认就可以,它就是一个保持程序自动更新和反馈你在使用软件过程中遇到的问题,方便 comfyui 官方改进产品,其实就是对新手习惯的功能自动帮助更新, 我们点击下一步到这里, comfyui 就 会自动帮你安装运行程序所要所有环境依赖,等待它安装完成就可以。 在这里我要做个提醒一下哈,就是你的电脑全程要有魔法哈,这样在安装过程中软件要用到的环境依赖才能顺利下载到你的电脑本地,否则可能会遇到下载失败或者卡住等问题。 最后安装完成之后会出现这么一个界面,这些都是 comfyui 官方在里面内置的一百多条经过社区和广大用户验证,拿到过巨大成果的工作流,其中包括图像、视频、音频、三 d 模型等等等等。那么到这里恭喜你,你已经把 comfyui 成功部署到你的本地电脑了, 是不是很简单, comui 部署成功之后,我们该怎么用起来呢?接着我们来到这边点击一下这个模板的图标,也就是一开始安装成功时弹出来的界面,我们点击视频生成,这里面很多都是通用万象视频开源模型的一些好用的经过广大社区大佬验证过的工作流, 我们选择其中一条来体验一下哈,这里我们找到外向二点二图声视频来带大家来体验一下。找到这个 one 二点二十四 b 图像到视频工作流点击一下,这时我们会看到一个缺失模型的一个提示弹窗, 小伙伴们不要慌哈,我们挨个挨个的点击下载就可以了,你不用管它具体放置在哪里,直接点击下载就可以了。等待模型下载完成之后,我们就可以愉快的玩耍了。怎么样,小伙伴们是不是 so easy? 这还没完哈,这次 comfyui 还有个重大功能,升级官方签约 api。 简单说,你只需要注册一个 comfyui 官方账号, 再充点值,就能在 comfyui 里直接调用所有付费 api 了。而且 comfyui 还承诺所有 api 费用和 openai、 nano、 banana 等各大官方平台的报价完全一致,没有任何中间商赚差价,用起来特方便一点不麻烦。 时间有限,更多细节我就不展开说了哈。本期视频用到的安装包、电脑配置说明和操作文档我放在了评论区了,绝无套路,点进去就能下,要是实在找不到的话就在评论区发。六六六,我看到了就直接发给你。

2360AI视频制作教程 02:59查看AI文稿AI文稿

02:59查看AI文稿AI文稿最近有挺多粉丝问我这个康复 u i 怎么安装,现在我出一个教程,首先你要准备一个康复 u i 的 秋叶整合包,没有的在评论区扣六六六。 其次你就要准备这四样东西,第一个是解压工具,因为这个康复 u i 的 整合包它的容量还是蛮大的,所以需要用到这个工具去解压, 解压完之后他就是这个文件夹,接着就依次安装这三个环境依赖,没有环境依赖的也在评论区扣六六六。然后打开解压出来的整合包,在里面你会找到一个启动器,双击打开, 那么你就会进到这个启动器的页面。打开启动器之后,第一件事先点击设置, 再找到代理设置,右边有几个开关,如果你是没有魔法的,那你就不用设置了,这下面默认开着就可以了,如果你是有魔法的,那这下面就关掉,上面开了, 简单的说就是魔法用上面,没有魔法用下面。接着找到版本设置, 在右边这里选择最新日期的版本,点击切换,再点击确认,可以把 ctrl y 更新到最新版本, 然后来到左上角点一键启动,再点击右下角的一键启动,启动过程中会在启动器这里显示这一些启动的过程, 等到完全启动之后,他就会弹出这一个最基本的纹身图。工作流,那么你可以尝试运行,会发现报错了, 所以在这里给大家提个醒,你的康复 u i 安装成功了,并不代表你就可以运行所有的工作流,接下来你要做的是学习最基本的工作流的使用方法,比如查看报错,刚才报错之后,这里显示了红框,说明这里出了问题, 其实就是没有选择模型,现在我随便选择一个模型再尝试去运行,你会发现,哎,就可以了。 在后续的 com 加使用当中,其实还会遇到其他的问题,比较常见的就是显存不足,那对应的方法就是设置虚拟显存。 还有环境冲突,这个冲突一般是指环境依赖的版本冲突,那你就要去学会怎么看他们的环境依赖版本, 以及如何去安装和卸载相关的依赖环境。最后就是各种不同模型在不同工作流当中的运行逻辑以及搭建思路, 入门相对痛苦,但也因为痛苦入门之后你相比其他人会有更大的优势,特别是在未来 ai 时代。

141杠精强哥 40:16查看AI文稿AI文稿

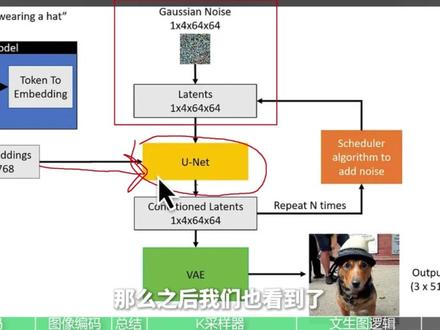

40:16查看AI文稿AI文稿一款软件彻底玩转所有 ai 功能,官方正版还免费?这还不够呦!官方还帮你把它的两百三十个 ai 功能内置进去了,全程不用你动手,你只需要三步就搞定一、下载。二,解压三、双击打开,不用装插件,不用配环境,连模型也就是一键自动下载,完全就是点开就能用。 哪怕你完全不懂 ai 是 啥也没关系,照样能轻松玩起来。想画图点一下就行,想做视频再点一下就好,想创作音乐还是点一下的事, 就算要搞三 d 建模,也只是点一下的功夫呀!这可不是什么野鸡 top 网站,而是全球公认功能最全面、生态最丰富,还最贴近生产力的免费开源 ai 软件 top ui 哦! 厉害!新版 comui 官方直接筛选了两百三十多个在 ai 史上留下过浓墨重彩的经典 ai 功能,做成模板放进工作流预览那里了。 从 ai 绘画的纹身图、图、声图、扩图、高清放大、局部重绘区域控制到 ai 视频的纹身视频、图声视频、首尾帧、过度动画,甚至连 3 d 建模、音乐、音效创作都有,真的应有尽有! 这些全是 comui 官方精选的新手入门尝鲜,快速掌握时下最流行的 ai 技术,你以为这就完了?第三呀,官方还直接提供了一键安装包,点一下运行直接就能用。 那接下来的话呢,我就带着大家来从 comfuly 最初始的部署开始,来部署到我们的本地电脑,那我已经把咱们需要用到的安装包和操作文档都已经打包好了。同时的话呢,有一些主要的电脑配置要求也会给到大家。那如果你是第一次接触到 comfuly 的 话,那就可以跟着我的视频一步一步来进行。 那么在我们部署 comfuly 之前呢,首先我们还需要去检查一下咱们系统的配置啊,我们可以通过右键点击 windows 的 菜单栏,然后的话呢,点击我们的任务管理器, 打开任务管理器之后,我们点击到性能的这一个列表当中,我们就可以看到自己设备的整个的一个情况啊,包括 gpu 的 显存,然后包括的话自己的内存 ok, 好 的,那么这个的话呢是第一步我们要检查一下咱们的一个设备,这是 comfui 的 推荐配置啊,那当然如果你想要跑的更好一些的话,内存的数量要更高,或者是显存的数量更高才可以, 同时的话呢,硬盘最好能够空余有三百 gb 以上的这样的一个空间啊。那么在检查完了系统配置之后,我们就来安装一下必要的软件哈。我这边推荐的是 comfyui 官方的一键安装包,它是一款用拖拽节点的方式轻松创建图像、视频等生成工作流的 ai 工具,支持 windows、 mac 和 linux 多种系统和硬件环境。 我这边就以最简单的桌面版为例,带大家一步一步地安装到自己的本地电脑上。这里我就以 windows 电脑安装为例,给大家演示一下安装过程,非常适合新手朋友。 打开我给大家准备好的 ctrl u i 官方安装包文件夹,鼠标双击一下这个程序图标,接着按照提示一步一步的安装就可以,它会弹出一个选定安装程序位置的弹窗,在这里我们选择一个宽裕一点的磁盘进行安装就可以,以 我这里为例,我就安装在 d 盘了。安装路径选好了之后,我们接着点击这里的安装,它就会显示 ctrl u i 正在安装,请稍等,最后等待它安装完毕,我们点击完成就可以了。 这个时候呢,我们来到电脑桌面,双击一下 configui 的 这个图标,它就会跳出一个 configui get started 的 界面,这时我们点击一下 get started, 接着会出现这么一个窗口,我们选择 nvidia quda, 接着点击下一步, 这个时候我们还是选择刚刚安装 configui 程序的那个的位置路径。到这里很多小伙伴们会疑惑,这是要安装什么呢?其实这一步就是要部署 configui 真正运行下来的环境依赖, 接着我们点击下一步,这里我们直接保持默认就可以,它就是一个保持程序自动更新和反馈你在使用软件过程中遇到的问题,方便 cf ui 官方改进产品, 其实就是对新手习惯的功能自动帮助更新。我们点击下一步到这里, cf ui 就 会自动帮你安装运行程序所要所有环境依赖,等待它安装完成就可以。在这里我要做个提醒一下哈, 就是你的电脑全程要有魔法哈,这样在安装过程中软件要用到的环境依赖才能顺利下载到你的电脑本地,否则可能会遇到下载失败或者卡住等问题。 最后安装完成之后会出现这么一个界面,这些都是 comfyui 官方在里面内置的一百多条经过社区和广大用户验证,拿到过巨大成果的工作流,其中包括图像、视频、音频、三 d 模型等等等等。那么到这里恭喜你,你已经把 comfyui 成功部署到你的本地电脑了,是不是很简单, ctrl u i 部署成功之后,我们该怎么用起来呢?接着我们来到这边,点击一下这个模板的图标,也就是一开始安装成功时弹出来的界面,我们点击视频生成,这里面很多都是通用万象视频开源模型的一些好用的,经过广大社区大佬验证过的工作流, 我们选择其中一条来体验一下。这里我们找到万象二点二图升视频来带大家来体验一下。找到这个 one 二点二十四 b 图像到视频工作流点击一下,这时我们会看到一个缺失模型的一个提示弹窗,小伙伴们不要慌哈,我们挨个挨个的点击下载就可以了,你不用管它具体放置在哪里,直接点击下载就可以了,等待模型下载完成之后, 我们就可以愉快的玩耍了,怎么样,小伙伴们是不是 so easy? 这还没完哈,这次 com 还有个重大功能,升级官方签约 api, 简单说,你只需要注册一个 comfyui 官方账号,再充点值,就能在 comfyui 里直接调用所有付费 api 了。而且 comfyui 还承诺所有 api 费用和 openai、 nano、 banana 等各大官方平台的报价完全一致,没有任何中间商赚差价,用起来特方便,一点不麻烦。 时间有限,更多细节我就不展开说了哈。本期视频用到的安装包,电脑配置说明和操作文档我放在了评论区,就在评论区发六六六, 我看到了就直接发给你好喽,大家好,欢迎来到本期的康复 ui 教,一起来学习康复 ui 最基本的框架以及最基础的生图工作流。 在开始之前,关于如何安装康复 ui 这一点咱们提一下,既然现在网上已经有非常多的安装教程,那我这边也就不再过多赘述了,咱们待会直接切入主题。不过呢,想要本套课程安装过来,小伙伴可以在评论区内获取。 ok, 在 咱们安装并打开康复 ui 之后,我相信大家跟我看到的都是一样哎,都是这个默认的工作流界面,咱们现在滑动鼠标的滚轮哎,就可以 发现,咱可以利用滚轮进行放大和缩小,对吧?接着现在我们按住鼠标滚轮哎,按下去我们就可以发现了,咱们是不是可以拖动屏幕了。好,那么恭喜你掌握了两种最基本的操作方式。接着咱们看到这工作流,它是不是由一个一个的节点构成的?啥 是节点呢?这一个呢,我们也称为节点,这一个也是节点,这个也是,对吧?而节点与节点之间它能通过线连接,咱们细心观察可以发现,这个什么 v e 结码的这个 图像啊,蓝色按钮,它连接的也是哎,这个保存图像的蓝色按钮。好的,那么现在我们最基本的节点与节点之间是如何连接的?稍微参透了一点点,再继续深入之前,我们先看到右上角有一个直行点击一下,那么这个东西就好像咱们的松图按钮,点击了之后等待个几秒到数十秒啊,这个等待时间就会由小伙伴们的设备来决定, 可以看到现在生成了一张图像,对吧?那么生成这张图像的速度和大家的显卡性能有关,我这边还是比较推荐大家,至少要三零六零级以上。当然如果说你没有这么好的硬件设备,我们也可以用云端嘛,对 吧?比方说现在什么里不里啊,什么端脑之类的,有很多可以在线生图的平台,那这个我们放在第五节课中会提到。接着我们重新回到这张图片,咱们可以看到它是一个装着星云,装着紫色森林,对吧?问题来了,凭什么它生成的内容是这一些,而不是一头大象或者一只小猫呢? 这边呢,咱们就要看到正向提示词,啥是正向提示词啊?细心观察可以发现这边有一个正面条件,那正面条件这根线连出去的这个框框,诶,这个叫做什么? c l i p 文本编码器,咱们称之为可以文本编码器,那么在这边输入的内容就被称为正向提示词,内容 就是我们想要什么就在这边输入什么。咱们再来做个简单的小实验,大家看我们把这些词汇啊给删去,然后输入一座花园。注意啊,这边一定要输入的是英文,如果是中文的话,那么电脑将无法识别,从而生成错乱的图片。好,那么在我们输入完一座花园之后,就点击执行,现在我们可以看到生成的图像是不是成功变成了花园呢? 简直是像魔法一般神奇。那当然,现在我们称之为魔法,是因为不懂背后的运行逻辑吗?等到我们学完第三第四节课,也就是 ai 生图背后的运行原理之后,我们就知道这一切不是魔法,而是科学的捷径。好的,那么在我们说完正向提示词之后,我们来说一说他的对角叫做反向提示词,也称为负向提示词,想想在哪输入吧, 看到正面条件的下面有一个负面条件,那当然就是在这所连线的框框,也就是这个克里普顿的编码器输入咱们的负向提示词。 ok, 那 么新的问题又来了,正向提示词非常好理解嘛,咱们刚才这个就是想要什么就输入什么,那副向提示词呢?该怎么理解?哎,其实和刚刚说的相反,就是我们不想要什么,就在副向提示词文本框内输入什么。哎呀,不如我还是不懂啊。好,我这边来举个小例子, 比方咱们看到刚才生成这张图像吧,怎么样啊?是不是有非常多的花?哎,有粉的,红的、紫的,各式各样。那如果我们现在不想要图片中的花占比这么多的话,那么我们就在副向提示词中 输入花朵,那花朵怎么拼啊?就 flower 嘛。当然,如果小伙伴们在园上遇到任何问题,我们都可以用翻译嘛,对吧?比方这个有道翻译我就挺喜欢的,非常便捷。 ok, 这边是纯推荐,不是广告。好,我们接下来就点击执行。哎,现在咱们发现了没有, 图片中花朵的元素是不是降低了很多?比方我们再次点击执行来看一下,对吧?经过两次实验,图片中的花朵确实是比例明显变少了,但是并不是说完全消除 这正负刚才所说负面提示词啊,他所做的更多是消除我们输入的东西在画面中的比例,还在画面中的权重是吧?但是完全根除的话,这需要其他操作,我们接下来的课程中会提到, ok, 那 么现在学习完正负向提示词, 我们再来看一下连接正负相提示词的这个叫 k 彩样器,那么它呀,我们可以理解成就好像人体的大脑,它控制的整个工作流。哎,不但发现基本上所有的节点都汇集到了 k 彩样器里,然后这些所有的数据啊,参数啊,汇聚到这之后,经过 k 彩样器内部的运算,然后最终才得出了我们的 ai 图像 于背后的生图逻辑。哎,我们下一节第三节在纹身图以及背后的运行原理中会详细展开,那么这边我们先大概了解一下就好。接着我们来看到这个 k 测量器啊,它有个叫做 layton 的 东西啊,这个 layton 我 们顺着粉色的线往下看,连到了一个叫空 layton 的 节点,大家看看这空 layton 它是干啥用的呀?我相信关于这个名词不能说百分百吧,百分之九十九的小伙伴应该都是非常的困惑的。好,那么我们在学习一个新东西的时候,我们可以看一下它的参数,咱们一起来研究一下。首先它共有三个参数嘛,分别是宽度,高度,还有皮尺大小,对吧?那现在是不是豁然开朗这个节点呢,就是控制我们最终生成图像尺寸啊,比例啊,图片整体像素的一个节点, 比如我们把这宽度给改成七百六十八,相当于此时的宽高比为二比三嘛,然后咱们点击直行怎么样啊?最终生图是不是非常简单的就被修改成了竖屏比例,那么同样的比方,我们把这个宽度给改成七百六十八,然后把高度改成五百一十二,此时咱们再点击直行,就可以看到图片也是非常顺利的变成了横平比例。 关于最后一个参数,也就是空来等的 p 四大小,这一个我们是不是还有点疑虑?好,那么咱们就来尝试一下吧,比方把它给改成个四吧,具体发生什么我们待会才知道,咱们只管点击直行就好。 ok, 我 们来看一下发生了什么变化吧,咱们看到这个保存图像节点的右下方出现了一个四分之一,对吧?并且这边有个敲叉按钮,咱们点击一下,哦,发现 原来呀,刚才的 p 四大小代表着一次性出多少张图片,对吧?像刚才我们折成四,那么此时呢,也就是一次性出了四张图片,比方说我们在需要进行大批量生图的时候,或者说在测试某个参数的影响,那么我们就可以把这个空阶的 p 四给调高一些。不过如果说 p 四大小过高,比方说三十、四十甚至是一百,那么就可能会出现报险存的情况, 如果大家不幸遇到报险存,那么我们重启一下,康复以外就好。好的,我们来看一下,现在咱们已经把正向提示词还有反向提示词的文案也讲了,还有哪个没讲呢? 就是 jpeg 加载器嘛,咱们把目光看到这可以发现啊,它是不是有点像一切的源头,非常多的线都连到了这个节点上,这代表着它有非常重要的地位。也确实我们在 jpeg 加载器里面加载的就是大模型,我相信这个名词大家或多或少都听说过。那么啥是大模型呢?咱们可以这么简单的去理解,大模型可以控制整体的出图基调, 方说有了大模型是全能系,有了大模型是真实系,有了大模型是动漫系。咱们现在把大模型给换成一个动漫类大模型,接着什么参数都不用调,直接点击执行来看一下单单修改一个大模型,会对我们最终出图效果发生什么样的变化。好的,现在我们不难发现图片了,是不是整体风格都变成了偏动漫或者说非写实的风格? 那么我们现在重新看到大模型,咱们现在再换一个真实的大模型吧,然后再点击执行,就是感觉到画风一转的瞬间变成了写实风格。 ok, 这就是大模型的威力,非要比喻的话,可以把它想象成人体的意识,啥意思呢?如果我整天哎只想着私自的事情,那么我最终出图啊,咱们最终的成品 必然也是和色色有关。那如果说我整天想的是非常正能量,积极向上的事情,那咱们的最终成品也必然会啊,你懂吧? ok, 之后我们来看到这个 v e 解码,他呀,就好像一个转换接头,可以把咱们的 latent 图像变成像素空间图像,那具体是啥意思?我们放在下节课去讲。接下来,比方说啊,我们不小心把这个 v e 解码给删去了,哎,对吧? 删去了之后我们该如何去添加呢?一共有多种方法,一个就是摁 ctrl z, 哎,那么就可以回到上一步的操作。好的,现在我们再把它给删去, 这个方法就是我们在 k 采集器的后边 laten, 哎,咱们把它给拖出来,然后松开鼠标,看到这个 v a e d code 怎么样了,他是不是又重新出现了?接着我们只需要把它的图像与原来的保存图像相连,然后这个 v e 又是个新名词,把这个 v e 链接在哪,咱们可以找一找,哪有红色的输出呢?那 就是空接在寄码。我知道小伙伴们现在可能有非常多困惑,但是都不用着急,因为我们本节课主要教的是基础的操作吗?至于接下来的比方说参数啊,或者说他们背后的逻辑,我们会在后边揭晓。好的,那么刚才我们讲完了第二种添加这个 v e 解码的方法, 那么还有第三种方法是啥呢?我们可以双击界面,哎,此时啊出现了一个搜索节点栏,那么我们可以在这边输入,想要查找节点的名字,那咱们就搜 v a e 解码,可以看到这边也是有非常多的选项,对吧?咱们选择第一个啊,可以看到 v a e 解码,点击一下, 它就这么出现在了我们画面之中,接下来也是与其他节点相连,即可恢复成原来的样子。好的,那么第三种方法讲完了之后,我们来看一下第四种方法, 我们同样的把鼠标放在空白处,摁一下右键,接着看到这一个添加节点按钮,点击一下,随后我们找到 laten, 同样的点击一下后,就可以发现咱们的 v a e 解码在这边出现了,对吧?接下来只需要再次点击,那么它就重新出现在了工作游之中。不过我们也能发现这第四种方法非常的繁琐,一般情况下我们都是直接搜索即可。那当然其实还有第五种方法, 我这边也说了,因为这节课是基础操作课嘛,咱们就把这些最基础的给讲透。我们把目光看到左边有一个像字典一样的东西啊,点击一下,那么这个东西啊,它是存放所有节点的地方,我们同样的可以在这边搜索节点, 输入 v a e, 然后就可以看到各个节点包里面和 v a e, 也就是咱们相关输入的词汇有关的节点,那么我们也不能发现 v a e 节点码在最上边,对吧?同样的,点击一下,就可以看到它又再次出现在了工作流之中。那么以上啊,就是五种常见的加载节点的方式。 正如我刚才所说,咱们平时啊,最方便最实用的方法就直接双击界面,然后搜索 v a e 即可,这是一种。还有一种就是直接来到,比方说像这个 lincoln 把拖出来,可以看到在这个默认的加载节点里面有 v a e。 解码的话,哎,点击一下,那么它是不是也非常快速的就被加载出来了?那么以上两种方法是最常用的,大家稍微记一下即可。 好,既然我们看到左边,我们就继续顺着左边来看一下,可以发现了咱们之前生成的队列,哎, 也就是咱们所执行的任务都在这边出现了,比方啊,像这一个下面有个四的角标,代表着一次性出了四张图,对吧?咱们可以点击一下,这一次任务所生成四张图就会被展开。好,我们在队列的返回按钮点击一下,咱们就可以回到刚才的队列预览界面。 接着我们来看一下这个小小的立方体啊,它代表什么?这个是我们存放模型的地方,比方说像什么大模型啊, laura 啊,什么 cosine 模型都可以在这边显示。那具体像我刚才说那些名词,他们代表了什么,也 是在之后的课程中咱们会逐一揭晓。那顺着这个立方体往下看,有个文件夹对吧?那这个文件夹就是我们存放工作流的地方。这边又要隐身出个问题了,比如说吧,我们现在这一套工作流,想把它给保存下来,怎么保存呢?我们同样的也是看到左上角有一个工作流,点击一下,随后咱们可以点击保存或者另存文,咱们先点下保存吧,接着编辑一下工作的名字, 方说第二节课点击确认怎么样了,咱们刚才保存的工作流是不是就到了?这,对吧?下次想调用的时候,我们只需要双击或者说哎,把它给拖出来,拖到空白处,就可以重新加载咱们保存的工作流。好的,我们顺着文件夹往下看,有个月亮按钮, 点击一下,那么整体的风格就会变白,变得明亮,对吧?再点击一下,又会回到刚才的深色风格, ok, 那 现在重要的来了,看到这个齿轮,也就是设置嘛,我们可以在这边来调整咱们的界面语言, 我们看到这个 comfy 的 区域设置,在这里就可以调整相关语言了,当然你想要英语或中文,或者说什么其他语言都行,那我这边也是选择了中文。好的,接下来我们看到这个 comfy 下面的画面,点击一下,随后我们看到连线渲染样式,那这边我们可以选择曲线或者说其他的线型,比方说直线吧,咱们点击一下,接着就可以看到,此时啊,怎么样界面的所有连线都变成了直线,对吧?直来直去的,那这一个就根据大家的个人喜好来进行调整了吧。 ok, 我 们重新回到刚才的画面,那我这边也是先保持直线吧, 直线会更为直观一点,更方便大家去辨认哪一个节点连接的哪个地方。 ok, 接下来我们看到画面下边的外观,那么在这边我们可以调整色彩主题, 也就是美化咱们界面吧,那么我相信大家刚和我进来的时候都是这个 duck, 也就是默认选项,我们可以调成明亮的风格,也可以调成这个蓝色调, 黑色调。 ok, 我 还是调回默认模式,接着可以看到下面有个节点不透明度,那这个参数比较重要,因为啊,比方说我们看到这套工作流吧,如果我们把 v e 解码不小心放在了这个可以采暖器的后面,我们就压根看不见了,对吧?而节点一多,就有可能会出现这种节点之间相互遮挡的情况, 从而增加我们构建工作流的难度,那么我们就可以回到刚才的节点不透明度,把它给设置成零点四,当然更低也行。那么此时我们就可以回到刚才的节点不透明度,把它给设置成零点四,当然更低也行,那么这样我们在构建工作流的时候会更加的 轻松愉快。 ok, 咱们再讲一个小知识点,比方说吧,像我们刚才是不是新添了这一堆节点了,咱现在不想要了怎么办?我们当然可以一个一个节点的这样去删除, 我们也可以摁住 ctrl 键,然后再摁住鼠标左键,哎,这样子就可以框选节点,接着再摁键盘上的 delete 键,就可以做到趋选删除。 同时比方说我们现在去选这一套工作流,我想同时拖动这么多节点的话,直接摁住鼠标左键就可以进行整体拖动了。而如果说我们想升图的时候,我们除了直接点击执行,我们也可以摁 ctrl 加 enter 键,这样就可以做到快捷的图片生成。大家好,欢迎来到本期的康复语言教学,那这节课我们一起来学习一下纹身图以及它背后的升图逻辑。 首先我们来到 comui 的 界面,那么印度演员呢,就是我们上节课的默认工作流,咱们之前啊就是已经了解了这套工作流里面每一个节点的大概值能究竟是啥,那么接下来我们就一起看看他们究竟是如何完成他们这些智能的。 比方说像这个 click 文本编码器,它是怎么做到把这个文字哎,最终可以通过 k 采集器转换成相应图片。 ok, 首先我们看到这一张,他呀是 ai 生图的最基本框架,从左边开始看起,分别有 prompt 以及 negative。 prompt 啥意思呢?正向提示词以及负向提示词嘛?接着这两个东西会被传入到 ai 模型中,也就是 ai model, 在 这里经过运算,最终生成了咱们想要的图像,好完结哈,那这个确实是大体上正确的,非常笼统的概括咱们 ai 生图的逻辑, 那接下来我们就从这个正负向提示词看起吧。回到刚才的工作流,咱们可以看到正负向提示词书在哪呢? click, 它到底是什么意思?为了能够弄清楚这一点,我们再来看看这张图, 这张图里我们可以看到有一堆英文啊, ok, 不 用害怕,我们一起来看看它们代表的是什么意思。好吧,首先我们看到左上角这边啊,有咱们稍微熟悉一点的东西,啥呢?可以看到分别有什么 mountain landscape, 什么 external, riding horse, 什么 integral, goldfish, 那 这些东西不就是我们的正向题词词吗?对吧?比方说像第一个就是与山有关的景观,那第二个就是宇航员骑着一匹马吗? 接着我们顺着后面的箭头,看到它们被送往了哪呢?它们被送往了一个叫做 transformer 的 东西,而这个 transformer 它出自于二零一七年的一篇论文,而 attention is all unique。 那 么这篇论文也是 ai 史上重要的里程碑。不过我们这边先不展开来讲,回到刚才的图片,具体它是干啥用的呢?这个 transform, 哎,在弄懂这个之前,我们可以来看看 transform 后面这个箭头输出了个啥,输出了一堆数字,还有中括号,对吧?那这些,哎,咱们看到它们呢,代表的是叫做特征向量,所以我们 transform 的 作用就是把我们输入的文本 通过特定的方式给转变成了这个特征向量。有小伙伴可能会说,啊,这一步有什么意义吗?当然有,咱们计算机啊,在处理文本的时候其实是比较费劲的,就好比我现在让你翻译一大段英文, 就好比我现在对你说,哎,你长得真的是跟一个姓彭于晏的人很像啊,他的名字叫彭于晏。对啊,没错,你长得和彭于晏很像。或者我直接说,哇,你长得真帅。我问你哪一个更简洁明了,更容易让你 瞬间就懂?那肯定是第二句话嘛,其实夸你帅,虽然可能第一句话听起来更好听,但是对于电脑也是这样的,你是觉得让电脑去识别并处理一大段英文或中文容易,还是让他处理一段蕴涵着这些文本信息的数字容易?那毋庸置疑,绝对是处理数字对电脑来说更容易一些。 ok, 那 么我们这个 transformer 在 其中就扮演着类似于转换器一样的作用, 它识别文本,并把它能转换成特征向量,这就是它最重要的作用。而在这一套流程中,这些哎,就是属于 clip 模型所包含的内容。 接下来我们回到刚才的图片,还记得刚才的流程吧,咱们在文本编码器内输入完文字后,会由 transform 转换成什么呢?转换成特征向量,而特征向量就好像一个蕴涵着非常多信息的浓缩小盒子啊,他就像个小压缩包。那这个压缩包呢?他被传入到哪?他被传入到了这个 k 测量器里, 最终在 k 测量器内进行相关计算。具体的流程我们待会也会提到。好的,我们回到刚才这张图片,那么之前讲了,上半部分叫做文本转化成特征向量,也就是把它给简化,那下半部分叫做图像编码, 哎,咱们看到左下角是不是有一堆图片呢?那这些图片呢?咱们称他们为训练级,大家可以想想看,咱们康复一个工作流中哪里会包含着训练级呢? 哎,那必然就是咱们大模型了吗? future model, 扩散模型,比方说有大模型是二次元风格,那必然他的训练级大部分内容都是用的二次元图片来进行训练。如果说大模型是写实风格,那必然他的训练级中包含着大量的真实系图片。好的, 接下来我们顺着这个训练集,哎,往后看,可以看到它一共连了两个箭头,对吧?分别是什么? v i t 和 risknet, 那 这两个呢?并不是同时进行的。注意,这边代表的意思是,有的 clip 模型啊,用的是 v i t 架构,有的 clip 模型用的是 risknet 架构。但是不管 clip 包含的是 vip 或者 recent, 他 们的目的都只有一个,就是为了把我们的训练级干嘛呀?转化成特征向量,哎,和刚才的文本编码是不是有点像?目的呢?都是为了简化咱们的信息,让信息更好的去进行处理匹配嘛。好,那么现在问题又来了,为什么可以把模型要做两个部分呢?对吧?上边的处理完文本之后,那下面的这个图像,哎,该怎么进行配合啊? 接下来我们来讲一下这个文本编码和图像编码是怎么进行配合的。比方说我现在画一个 x y 轴,好吧,然后这个位置代表的就是与猫有关的特征,但是我们还是不知道为什么,有了这些特征向量之后,就可以让 ai 知道猫是猫,狗是狗啊,在这个位置代表的是人, 此时啊,如果我想生成一张猫粮的图片,对吧?那么这个猫粮的位置应该在哪呢?大家可以思考一下,那必然就是在这个猫与人之间的范围,对吧?我们可以想象一下,比方这个猫的影响范围是这么大,然后这个人呢?影响范围是这么大,那么我们的目标也就是猫粮,那必然就是在他们这两个的交集范围内,对吧?而刚才我们的图片编码作用就是 铆定这一个猫,还有人他们在特征向量的位置,从而让文本编码器编码之后的特征向量套用到图 图片编码之后特征向量的框架内。 ok, 我 们还是回到这张图片,现在一起来总结一下。咱们的 clip 模型一共包含着就是这一部分的内容,那肯定有一个 transform 模型以及 v i t 或者 reset 模型啊,这两个是二者其一, a clip 模型的主要职能就是为了干嘛?识别文字,让文字转化成特征向量,对吧?方便咱们电脑去理解, 同时呢,他又用图像编码,哎,干嘛呀?制定了一个有关特征向量的框架,让电脑知道猫是猫,狗是狗。我知道,这么说可能还是有些小伙伴比较萌,那么我们还是回到刚才的工作流, 咱们来看一下。首先呢,咱们的训练级也就是大模型吗?包含在这个 point 内,那这个 point 会干嘛呀?看着这个 clip 连线,哎,他会经过 clip, 然后制定好一个框架,对吧?制定好一个 x y 坐标轴,哎,那制定好坐标轴之后, 我们输入的文本就会经过 clip 模型变为特征向量,对吧?那特征向量就会套用在咱们的这个 x y 轴上,而这一切套用的过程是在背后的 k 彩样器内发生的。 ok, 在 我们讲完了理论知识之后,我们来看一下实际操作吧, 两点难度低斜的我们把目光锁定在 k 采集器上,可以看到他有非常多的参数啊,比方说什么随机种运行后操作,什么步数? c, f、 g 的 采集器降噪,哎,一共有七种参数,那首先我们从随机种讲起, 这一个他就好像图片的身份证号,哎,比方说我现在把这个随机种给出一串数字吧,六六六。接着这个运行后操作。什么意思?就是我们每次升图之后啊,这个随机种是固定呢?还是变化?是增加还是减小?那这边我们把它给设置成固定好,接下来我们点击一下执行, ok, 我 们可以看到现在这张图片是长这个样子的,那如果说我们在不改变随机种以及其他任何参数的情况下,再次点击执行的话,大家可以发现工作流会压根不动,因为呢,他们所生成图片是完全一样的。那至于这个随机种是如何做到这一点,像一个身份证一样, 图片进行绑定,我们稍后会讲。接着我们看到下面的步数,那这个步数它代表的就是降噪的次数叠带一共分了多少步嘛?大家可以想象一下我们这个 digital fusion 它的生图的过程啊,就好像给一块脏玻璃用抹布进行擦拭,当然你擦拭的越多,那么图片也会越清晰,季节也会越多,对吧?那这边我们步数设置成二十,就相当于给这块暗藏的玻璃擦了二十下。 那如果说我们把步数给设置成五的话,我们来看一下此时又会发生什么样的变化。咱们可以看到这张图片怎么样啊?是不是细节明显比刚才少了很多?那如果说我们更低哎, 把这个步数设置成二的话,咱们再次点击执行,咱们可以看到图片是不是一片模糊啊?那反之同理,如果我们步数设置成四十,那么此时啊,咱们这一块玻璃就会被擦的非常干净,对吧?我们可以看到那细节纹理都会多非常多。 当然过高的步数总是好的,大家可以想象一下,咱们一块玻璃,你说擦一百次跟擦两百次有很大区别吗?没有啊,基本上所有的灰尘都被擦干净了吧。咱们康复语言也一样,步数一般到了四十步往上就不会有过多的变化。比方我们现在看一下,把步数设置成六十步吧,来点击牲口怎么样?是不是和刚才几乎没有区别,但是却增加了百分之五十的牲口时间, 因为他多了二十步嘛,我们原来是四十步,步数越多,那么升图时间也会越久。而我们一般升图把步数设置在二十到三十步之间即可,我这边就设置个二十五步。那下面的 c f 居址又是个新东西吧,它的作用主要是为了控制咱们最终图像与提示词的匹配程度,那比方说咱们 c f 居址越高,则代表着咱们最终生成的图像与关键词也就越匹配,哎,意思也就越相近。 那如果说我们 c f 居值过低的话,就会让 ai 有 更多的自由发挥空间,意思也就是与关键词匹配程度也会下降。比方我们把这个 c f 居值设置成四,来点击升图,咱们可以发现最终图像怎么样了,感觉整体色调变灰了,对吧?那这也是 c f 居值过低带来的负面影响。 由于我这边因为输入的元素不是很多,当我们输入提示词,比方说二十个、三十个的时候,那么 c f 居值的表现会更为明显,那此时如果我们继续把 c f 居值降低,比方说设置成一,我们来看一下会带来什么样不好的后果。大家可以看到整体图像变得更灰了, 并且图像多多少少都会有一些变形,当然我们 c f g 值过高也会有不好的影响,比方我们设置成十五吧,点击执行,大家可以看到这张图的出图质量怎么样,很糟糕 哎,感觉它清晰度远远比 c f g 值为七为八的时候要低得多,我们可以对比一下,咱们把此时的 c f g 值设置为七,也就是一个正常值,再次点击执行,那么现在咱们的这个紫色星云屏又恢复了原有的清晰度,对吧?我们的正常的升图过程中, c f g 值一般设置为五到八即可,大家可以稍微记一下。 ok, 接下来我们看到彩阳气与调度器, 这边我们一般选择的是采氧器,点开来看到 d p m p p 二 m 或者 d p m p p 二 m s d e 这两款采氧器是大家测试下来相对而言效果比较好的,咱们直接无脑选即可。 除了遇到某一些特别说明的大模型啊,就说我这款大模型只能用优乐采氧器,用某某调度器,确实是有这样大模型,但是我们一般情况下还是用 d p m p p 二 m, 好 吧,那调度器的话,我们一般选择的是这个叫做 tars, 至于下面的这个降噪,我们放在下节课图声图中会涉及到咱们之后再讲。那么现在我相信大家应该就有些疑问了,比方说这个彩样器跟调度器他们到底是干啥用的呀?还有为什么这个随机总可以像身份证号一样控制咱们的图像呢?为了解答这些问题,我们再来看一张图片, ok, 那 么这是一张更为详细的 ai 生图流程,刚才我们看的只是关于 clip 的 嘛,那现在这个是全流程,先看到左上角,那么这边我们再输入完 prompt, 也就是关键词之后会被发送到 clip 模型嘛?那么刚才具体流程已经传输过了之后,再由这个 clip 模型把咱们的文本转化为下面的这个 text in bedding 啊, 这个文本渐入这个特征向量,哎,那么这一组更易定到处理的数字信息就会被发送到这个叫做 u n 中,又是个新名词,对吧?但是其实啊,咱们看到这哎,这一边这一大块的所有内容其实都是属于我们的 k 彩 氧气,明白了吗?这一大块的所有内容啊,都是在 k 彩氧气内完成的。那首先我们看到这个特色项链被发送到 u 内之后,会进行什么操作呢?会降噪嘛?但是问题来了,我们的噪声从哪来?大家都知道咱们 step diffusion 用的叫做 diffusion 模型,也就是扩散模型, 而扩散模型的运行机制就是为造成图像不断的降噪,从而生成咱们的目标图像,也就是一个较为清晰的图像。好,那么现在我们就要考虑到这个造成的添加了,以及咱们这个画布的大小,对吧?我们看到上面有一个叫做 gatsby noise, 也就是高斯造成,那么这是一种无规律的造成,而这个所谓的高斯造成,他们具体的分布规律就由咱们的种子值,也就是随机种子来决定。 同的随机种子会添加不同的高斯造成,从而会影响到我们最终生成图像了。那么这就好像,哎,咱们在生孩子的时候啊,不同的精子与卵子结合之后,咱们生出来的比例,整个人生轨迹都会有非常大的不同, 对吧?也就好像蝴蝶效应一样。好的,那么现在我们这个噪音添加已经处理完了,我们就来看一下这花布大小吧,我们上节课是不是提到了空阶呢?哎,咱 们可以看到这个高斯声被发送到了下边的阶,而这个阶的大小我们可以在阶阶中设置,我们简单的把它给理解成花布大小就行, 比方说我这花不到角,我就规定了它是一个正方形,那么造成呢?也只会在这个正方形内添加,对吧? ok, 那 么之后啊,这个结合了高斯照射之后的雷腾图像就在这个 unit 中,与什么呀?与我们的特征向量进行结合, 而 unit 的 作用就是预测下一步降噪的图像以及减少造成。那么之后我们也看到了 unit 降噪完之后,被降噪的雷腾图像就发送到了这一步,而这一步如果说我们循环 p c 是 二十次的话,那么就将哎经过这一个循环循环个二十次,我们可以看到这一个代表就是调度器和传感器, 其中调度器的作用呢,就是控制降噪的方法,而采暖器的作用就是控制降噪的程度。 ok, 于是啊,我们就这样子降噪,降噪,降噪之后经过了我们设置的迭代步数, 比方说二十五次吧,那么就是降噪二十五次之后,咱们得出的这个 lin 图像就会被发送往 v a e, 而这个 v a e 就 好像一个转换插头,它可以把我们的 lin 图像变为像素空间图像,也就是我们肉眼可见的图像,那么最终哎就被解码出了咱们能看见的这个 logo 图片,对吧? ok, 那 么在这一整套工作流中,我们的 clip 模型,还有这个 u n 模型 以及 v a e, 一 般情况下都是由我们的大模型,也就是 diffusion 模型提供的。我们回到刚才的科普娱乐工作流, ok, 我 们来搜一搜这个这个快捷键,它是只有三个输出,分别是模型输出, clip 输出以及 v a e 输出, 这个模型输出指的就是什么?指的就是这个 unit 嘛,对吧?我们刚才介绍的 unit 模型,而这个 unit 模型呢,会在咱们的 k 测量器内配合我们的特征向量啊,咱们 clip 文本编码器输入进来的特征向量来进行降噪,之后再由这个 v a e 解码器,哎,这个转换插头输出成咱们能看见的像素空间图像, ok, 比方说现在我们来一个二次元系大模型吧,哎,选择这一个动漫 primax, 接着我们来书写一下提示词。咱们要注意的一点是,在我们书写提示词的时候,要先写这样词汇,再写主体,再写氛围词汇。那么啥是这样词汇啊? 方说,我们知道在正向提示词中,我们要输入的是我们想生成内容,对吧?但如果说我们输入的为高质量、高清壁纸,杰作极致的细节类似于这些词汇,那么咱们的楷模模型就会知道哦,你想要的是这一个范围内的词汇啊,比方说,哦,你想要的是非常 清晰并且具有丰富细节的词汇,对吧?然后他就会在这个范围内帮助你去寻找符合条件的。所以这边我们一起来输入吧,咱们先打开翻译器,然后输入杰作 高质量极致的细节。好了,接下来我们就来输入我们想要的主体内容。比方说一个女孩,双马尾,蓝色头发,校服,那输完主体之后,我们就来输入氛围词汇,或者说是环境词汇,比如教室背景,动漫风格, ok, 随后咱们翻译一下粘贴近我们的文尾编码器。那刚才我们也提到了,为什么是先输质量词汇,再输主体,再输氛围词汇呢?因为啊,我们越靠近的词汇,它的权重,它的比重也就越高,在整体内容的呈向上也会占比更大。好的,接下来我们来输一些反向质量词, 啥意思啊?如果说我们在反向提示词内输入的是模糊、混乱、低质量,类似于这些词汇传达的意思不就是我们不想要模糊,我们不想要低质量的图片,我们不想要混乱的图片,对吧?而这边有玩家把这些负面词汇都整合成了一个词组包,我们只需要输入 easy negative, 随后选择这个 embedding easy negative 即可。那我们来看下有这样的词汇,以及没听见这样的词汇差别有多么夸张。好的,我们回到刚才的内容,那么现在在我们输入完正负向提示词之后,咱们就点击执行吧。 ok, 我 们可以看到,现在图片完全变成了动漫风格,对吧? 造成这样的原因有两种,第一个当然就是我们关键词了,因为我们输入了动漫风格,而其二是我们的大模型,哎,这个动漫 primex 大 模型,它本身的训练集中绝大多数都是动漫数据集,而它所预测的降噪之后的图像也必然是和动漫有关的, 所以我们最终生成了图像呢,哎,才呈现出这种非常自然的动漫风格。而咱们的空 laten, 他 负责的就是限制了我们 laten 图片大小,比方说,哎,就这么大啊,是一张正方形尺寸的图片,之后在我们的随机种所对应的高斯照射,哎,给他添加上,对吧?比方说是这个样式的照射图像, 那么添加完之后,咱们的 u 念模型就会为这张图片来进行降噪,当然降噪的同时会结合着我们的克里文的编码器输入的特征向量,对吧?不然我们也不知道你想降噪之后生成的图像是啥?是一匹马呢?还是一个动漫女生?这个是由我们关键词决定的对吧?而 u 念只是为了让我们降噪的图片尽可能的往那个方向去靠拢。 ok, 好 的就好。这节课我们一起来学习图生图工作流搭建,以及它的背后运行逻辑。首先我们还是来到 comui 的 默认工作流,那接下来想如何去搭建最基本的图生图? 首先我们看到空阶怎么把它呀给删去,然后再就 k 采集器的编辑输入拖出来,然后选择 v a e 编码。随后呢,我们看一下这 v a e 编码,它一共有两个输入,分别是图像以及 v a e 模型。 那我们看看 v a e 连哪呀?哎,那么这一整个工作流里面是不是只有空有 v a e 的 输出,所以我们连到这那,接着这个图像我们拖出来加载一个加载图像节点。好的,那么至此咱们的纹身图工作流就这么完成了。其实和最基本的纹身图工作流就这么完成了,那接下来我们来看一下它具体该怎么使用吧。 方说,我这边上传一张金发充满为少女。接着我们把正向题诗词给稍微编写一下,记得先写这样词汇,比方说杰作高质量,然后再写主体,主体的话我们就来个 one girl 吧,一个女孩,好的,就写这么多副向题诗词,我们还是来一个 easy negative 这一个副向题诗词词组包。咱们把大模型先换成一个动漫类大模型, 选择动漫 primex, 当然其他的也行。接着我们直接点击生成,我们可以看到咱们这张图像吧,你说它和我们的上传图片有什么关系?其实近乎于没有关系,对吧?那么这是怎么一回事呢?这边我们就需要看到可以采用器内的降噪值,这个降噪值啊,就控制着原始造成添加的比例, 比方说现在降噪值为一吧,相当于什么呢?我们输入的这张图像,它上边会布满了降噪值,那大家可以想想,这和我们输入一张纯噪生图像有什么区别吗? 完全没区别。好,那反之如果我们降噪值为零的话,会发生什么现象?咱们先跑一次。哎,现在可以看到,此时啊,咱们的生成图像和原图是完全一致的,那么这是因为对于我们输入的图像因为降噪值为零的缘故,导致一个噪点都没添加。那大家可以想想 我们 diffusion 模型,对吧?咱们 diffusion 运行原理就是给图像不断的降噪,从而生成新的内容,但现在我们一个噪点都没有,咱们从哪去降噪啊? 所以说自然而然的就和我们原图完全一样了。但如果说我们把这个降噪值给设置成零点五的话,我们来看一下会发生什么样的神奇变化。哎,此时发现了没有,他和我们的原图怎么样啊?是不是非常的近似? 比方说像这个金色双马尾以及他的红色蝴蝶结,那么这就是降噪值所带来的影响。 ok, 现在我把随机种给固定一下,然后换一组种子纸,我们再跑一次试试。 ok, 那 么我们第二次生图还是和原图有非常多的相似之处,对吧?比方说整个人位的姿势,以及他的发型,发色,还有服装。而我们在正常的生图流程中,降噪值为零点三五到零点 六之间,咱们生成的图像就会和原图较为近似,而如果设置是零点六甚至是零点七五级以上,那么我们就将赋予 ai 更多的想象空间以及自由发挥空间,对吧?比方说我们把降噪的值设置成零点七,然后再次升图,咱们可以看到最终图像和原图是越来越不近似了。不过我们可能会发现一个小问题啊, 就是题外化。什么问题呢?大家发现没有,我们的升图怎么感觉总是灰蒙蒙的,比方说我现在在换一组种子值再次升成,哎,对吧? 感觉到这个色彩不是很鲜艳,怎么回事?这其实和我们的 ve 有 关。上节课我们提到了 ve, 一 般是由咱们大模型所提供,但有时候吧,大模型它匹配的 ve 啊,不是特别好,还不如一些这些玩家所发布的 ve。 比方说像这个 primex 吧, 我用的这款大模型,它自带的 ve 表现出的色彩不是那么的理想。那怎么办?我们先把 ve 解码以及 ve 编码的连线给断开,然后我们再随便一个 ve 解码或 ve 编码都行, ve 节点中拖出来加载一个 ve 模型加载器,哎, 那么现在我们可以看到这加载器里面我们可以自由的选择不同的 ve 模型,那这边因为我们生成的是动漫类图片嘛,所以选择这个 enemy ve 动漫 ve, 接着再把它和 ve 解码与 ve 编码相连,此时我们再跑一下, 大家可以发现是不是图片瞬间就变得鲜亮了?好,那么解决完这个小问题之后,我们继续来看一下降噪值,有的小伙伴可能会有点疑惑, 哎呀,这个降噪值,它究竟是怎么做到让生成图片与原图近似或不近似呢? ok, 那 么我们来看这张图生图的完整逻辑。在我们图生图工作流中,不同于文生图的是,他一共输入了两种信息,一种呢就是图片的信息,一种呢就是文本的信息。刚才我们不是编写的是句子吗?对吧?而在我们上节课所讲的文生图中,只有一种文本编码信息, ok, 那 么问题又来了,如何把咱们的图片信息给编码成异?于电脑处理的相关信息? ok, 那 么问题又来了,如何把咱们的图片信息给编码成异吗?我们可以看到这个绿色的三角形啊,意思是 v e 编码器,它的作用是可以把我们输入的图片给降为成浅空间图像,而这些浅空间图像不同于像素空间图像可能是看不见的,同时呢,尺寸也会更小, 更利于电脑去处理。那之后 v e 编码器会把这些编码之后的浅空间图像给发送到 k 采集器,在 k 采集器中,我们来看看它会干嘛呀?它会添加噪音,对吧? add noise, 而这一个添加噪声到底该添加多少呢?这边就是我们降噪值所控制的了, 我刚才所说,如果我们降噪值为一,就相当于为我们输入的这张浅空间图像直接造成加满,对吧?整张都是咱们所添加的造成,这也意味着在这种情况下,和一张纯造成图片没有任何区别。同时,如果造成值为零点五吧,那可能就会添加,造成的幅度就不会很大,对 吧,零零星星的。好的,在添加完造成之后啊,我们来看一看,这个 layer 图像就会被发送到咱们的 unit 模型中进行降噪嘛,那么这等同于纹身图的,而不是一个完全空白的 layer 图像,也就是浅空间图像。 上节课所运用到工作流的空内存一直就是,哎,直接输入一张没有任何内容的前空间图像,不过呢,尺寸是我们自己定嘛,对吧?好了,那我们来继续看这个图上的工作流,一张有内容的前空间图像被发送往了 u 内模型中心。降噪还需要什么元素啊?当然就是我们的特征向量嘛, test in bedding 会擦一脚,嘿,来指导咱们这个图像的生成,来指导降噪的走向,对吧?比方说我想生成的是一个紫色头发的女孩,那么他就会结合着我们输入的起空间图像一起来完成降噪,不断的去往这个紫发女孩的方向去靠, ok, 那 之后也是就进入到了我们上节课所介绍的降噪啊迭代流程。 经过咱们采用步数的自助迭代降噪之后,咱们的 u 点模型啊,就会把处理完的浅空间图像发往 v a e 解码器,因为我们是看不见浅空间图像的嘛,所以它必须要转换接头来把浅空间变成像素空间图像,那之后咱们的 v e 解码器就会把之前的所有信息内容解码成最终生成的 ai 图像。 不知道咱们听起来可能有点晕,咱们结合着康普 u i 工作流一起来看一看,比方说像这一套简单的工作流吧,咱们的图片书是啥?那当然就是加载图像的这张金发双马尾了,对, 而咱们的文本输入呢,就是咱们的正负相提示词,这两个啊,他们会经过 clip 模型给编码层蕴涵着很多信息的特征向量,对吧?这小盒子会被发送往 k 采集器,被发往采集器,而同时呢,这个小盒子将结合着我们这个原始图像经过 v e 编码之后,再加上噪生的图像,哎,对吧? 像素零点七加了一些噪声,然后一同在 k 采集器内进行降噪,最后我们可以看到 k 采集器有一个 later 输出,那么这个 later 输出就会把我们之前的 later 图像,也就是前空间图像发送到 v e 解码器,从而完成前空间到像素空间的转换。 ok, 比方说吧,我们现在关键词加一个粉色头发 pick here, 然后把降噪改成零点六五,步数设置为二十五步, c f g 值为六点五,然后一般采用用的是 d 片,加加而言也 d p n p p 二 n 路由器一般用的是 carras, 然后点击执行,我们可以看到啊,大家发现了吗?图片是不是尽量的往这个粉色头发女孩方向去靠,对吧?咱们再把这个降噪值往下调,比方说零点五,接着再次跑图,咱们就可以发现,因为降噪值较低的缘故,咱 们双层图片就会和原图更为近似的,所以改动的幅度不会过大。但是咱们细心观察还是会发现,像这张图片,他的头发确实蒙上了一层粉色,甚至是他的眼睛也 变成粉色了,对吧?那么这就是降噪值结合着文本与图像输入共同造就的结果。 ok, 那 接下来我们就把以上的理论知识给转换成一个有趣的动漫转真人小案例。怎么做呢?大家可以想一想,咱们降噪值是不是可以控制生成图像与原图的相似程度? 而我们的最终图片生成的整体风格是由什么决定的呀?一共有两种,第一种是提示词,而第二种是最为关键的大模型。要注意大模型的影响可比提示词要多得多,所以我们这边直接把大模型给选择一个写实大模型,然后我们在关键词结尾加上一个写实风格 realistic, 接着把 ve 加载器的 ve 给替换一下,换成这个 s d 叉 l ve, 随后开始生成。 ok, 我 们可以看到啊,图片的风格是发生了一些转变,但是程度还不够,并且我们得把刚才的这个粉色头发关键词给删去,不然会影响输出效果。那既然这个风格转变程度不够的话,我们就 提高降噪值嘛,让 ai 去发挥更多的想象力。咱们直接先设置为一个零点六五吧,然后 ctrl 下 enter 快 速生成。 ok, 那 么现在感觉又有点太过了对吧?它和原图相似度太低了,那么我们就继续去调整咱们的降噪值, 到为一个较为合适的数值为止。 ok, 就 这样我们成功把这张动漫图片通过简单的图升图降噪的方式,就变成了一张写实风格图片。那么这个方法也可以算是最简单最容易的一种风格转换方法。后续我们会学习更多细节内容,让图片变得更为可控。比方说像咱们生成图片的姿势、 mv 表情啊,它的线条、背景、深度关系等等,这些都是可以通过后续的 control 内来进行控 好的。那么以上就是关于本期的图像图教学,我们下节课一起来看一下咱们之前所用到的这一些模型去哪找,以及 ai g c 的 相关网站都有哪些。好,那我们就下期再见吧,拜拜。

57AI绘画妞妞 05:21查看AI文稿AI文稿

05:21查看AI文稿AI文稿方框正版海绵费内置的两百三十多个 ai 使用功能,可以做图像生成、视频生成、音频生成、三 d 镜模,你只需要下载安装即可使用。 嗯,说了这么多,我们接下来给大家讲一下怎么去安装 copyy, 嗯,首先我们打开 copyy 的 官网,王者是这个 打开桌面进来之后我们可以看到啊 comui 的 话,它现在有本地部署的,也有云端的,云端这个呢是要付费的,然后这个客户端的话是可以下载到电脑上去做本地部署,那我们这边的话呢就下载很多人就可以。那么点这个下载 进来之后呢,它这边有 windows 版本,还有这个 mac 的 版本,来我们这边的话是用这个 windows 电脑的话,也建议大家使用这个 windows 电脑的话,其实不太理想的。 嗯,然后你先看到,记得要是 m 卡,那这个键多会点一下就可以了。跟我这边已经下去过了,我就不再下了一个。嗯,这边的话给大家讲一下我们装的时候,嗯,其实 除了装对客户端,我们还需要装一下它的一个运行环境,一个是 jit 的 这个材质,还有个是喷嘴这个远环境卡,那这里这些我都下的好,如果大家有需要的话可以关注我的账号呢,在后台直接私信 com 以外,我会给大家去发。 呃,那嗯,这里呢,我们可以先按通这个双击,也是,然后呢我们点这个,这里只需要全部点下一步,下一步就可以了,你什么都不用管,还全部关呢, 然后点它安装,等它安装完就可以,好之后呢,把它取消掉,然后点完成,那这样我们装这个喷除, 这就我们勾一下下面这个,然后点这个安装,然后点这个,嗯,这些的话我们来装这个 comui 的 客户端,那装个客户端的时候呢,大家需要全程保持魔法上网的状态, 就是你要知道怎么去上 u c b, 如果你不知道怎么去魔法上网的话,可以关注我还是私信,然后魔法上网我会给你唱,那这里呢?当然我们在这里直接双击啊, 然后这个安装位置呢,大家尽可能的让它安装在你电脑的一个固态硬盘里面,因为后期读取大冒险的时候,如果你是 g t 硬盘的话呢,它加载速度会慢很多,所以,呃建议大家呢装到你的固态硬盘里面,我呢是 c 盘,我的摄像比较大,还是一 t 的, 所以说我直接装进去就可以了,它要这样装, 然后我们点完成看它运行, 它自动运行之后呢,我们这边可以点这个台词啊,然后这里呢会让我们安装一个英文单词的扩展程序,然后我们点这个下一步,然后这些你保持默认,点下一步,这个也保持默认哈,然后我们点下一步, 那这个时候呢,他会下载他需要的一些,呃,就是程序还有他的一些环境,这些东西他会自动补齐,那你只需要等就可以了。那这个过程当中呢,大家如果不开魔方上会要很久,所以大家一定要开,那开了之后呢,他就会很快, 然后这个还跟你们的网速有点关系啊,如果网速快的话可能几分钟,如果速度慢的话,可能要等半个小时, 你就等它自动转完,它会弹出一个界面, ok, 可以 看到啊,这个时候呢它就已经转好了,那转好的话呢,我们会可以看到,嗯,它这边已经积攒了非常多优秀的这种工作要给到我们。嗯,像这边的话我们可以图像生成的,看这里面有非常多,那这里面总共是有两百多个, 然后这还有视频生成的,像音频生成三 d 建模,那这些他其实都已经有了,现在市面上很多的融合的功能都可以集齐到这里面来去使用,非常好用哈。那这边的话,比如说我们要对准人生啊,我们随便选一个,比如说 这里有一个物体替换,你看这个是物体替换的,对吧?还有这个,还有这里的这些,其实他自己这些都有哈,我们随便选一个,我们选择这个, 那么他会进来,他会自动加载开工作流,然后呢还会自动弹出我们需要的一些缺少的一些模型啊,这些东西啊,那这些的话我们都需要去下载一下,就这样我们需要去下载一下。嗯,你用的时候你可以直接点的下载,他会帮你自动不弃。 这个是这样的,那我这边我就不下,因为这个时间会要的久一点。我们这个视频就先教大家安装,然后这个好的话,你可以把这个管家就得把工作流给他关了,嗯,删掉工作流, 这时候呢他会给到你一个嗯基础的这种嗯经验哈。就他这个是基础,就是加的积加的模型呢,这个是我们的,嗯文本,就我们需要深层什么质地,然后这个呢是,嗯,我们需要,嗯,工程上我们不需要的。 这个呢是修改尺寸,还有批量生成多少张?这个就是裁剪器啊。然后这个呢是把我们所有东西给它装盘的,你给它理解为圣,从最后的一页我去呈现到这个里面,给到我们这个就是这样的。 那具体这些怎么去使用的话呢?嗯,后期我会给大家拍个的去出教程,然后想学的话可以关注我的账号那。嗯,这个视频我们就到这里。

328嘻影AICG 01:41查看AI文稿AI文稿

01:41查看AI文稿AI文稿如何使用康费 u i? 大 部分人会在第一步环境上就被卡住,因为本地运行康费 u i 对 电脑的配置有较高的要求,今天就来教大家一种白嫖康费 u i 的 方法,亲测有效,基本逻辑就是使用腾讯云来云端部署康费 u i, 因为腾讯云每个月都有免费的额度,从而达到白嫖的目的。 话不多说,点个关注,现在让我们实操一遍。首先打开腾讯云 c b 官网,然后登录进去,我们首先要做的就是创建组织,名称可以随便起,也可以用系统推荐的完之后点击创建,回到主页,然后点击这里的搜索框, 现在我们需要把 comu 代码 fork 过来,考虑到有些非程序员的朋友不知道什么是 fork, 这里简单解释下, fork 就是 把别人的代码复制到你自己的组织里面,相当于白嫖别人的代码。 这里有很多 comfyui 相关仓库,推荐 fork, comfyui 一 点通,因为这个仓库内置了很多模型和节点,省得我们自己去安装了 fork 的 时候,选择 fork 整个仓库,然后回到自己的主页代码仓库,点击刚才白嫖过来的代码, 然后点击 ai 创作启动,这个时候云端开始自动安装环境和部署代码,我们只需要静静等待即可。环境和代码部署完成后,脚本会自动运行项目,当看到这个弹框的时候,说明 comfui 已经部署成功了,我们直接点击 open, 第一次加载 comfui 可能比较慢,稍等片刻即可。 当看到这个页面的时候,说明 comfui 已经运行成功,然后我们随便选择一个模型,然后我们直接点击运行来测试下按照现有的流程是否可以生成图片,图片生成成功,这个时候你就可以愉快的白嫖 comfui 了。 注意,在设置用量统计这里可以看到自己的免费额度使用量哦!关注我,了解更多最新资讯和实用技术。

65积极的阿灰 05:43查看AI文稿AI文稿

05:43查看AI文稿AI文稿今世之作来了,你用它就能玩遍所有叫得上名的国内外最新最前沿的 ai 功能,官方正版免费,简直是超级福利!重点是,官方他还帮你把他的两百三十个 ai 功能内置进去了, 全程不用你动手,你只需要三步就搞定一、下载二,解压三、双击打开,不用装插件,不用配环境,连模型也是一键自动下载,完全就是点开就能用,哪怕你完全不懂 ai 是 什么也没关系,照样能轻松玩起来。想画图点一下就行,想做视频再点一下就好, 想创作音乐还是点一下的事情,兄弟们,背我五十,就算要搞三 d 建模,也是点下的功夫。这可不是什么野鸡 top 网站,而是全球公认功能最全面、生态最丰富、还最贴近生产力的免费开源 ai 软件 comp your eye。 或许你早已听过他的名字,但今天值得重新认得他,因为他变了,变得比以前友好太多,他就是康菲尔!官方十二月份新推出的全新版本,变动大到有点超出预期,其中三点尤其厉害,我们中国用户特别贴心!首先,全中文官方界面啊, 大家注意,这不是第三方插件,是官方正版原声就支持中文的,比第三方插件权威多了,既能稳定可靠也更高。英文报的朋友入门地道凯,官方直接帮你摆平就超省心。 第二,内置了两百三十个开箱即用的模板,完全不用学新版 com 二、官方直接筛选两百三十个在 ai 纸上留过浓墨重彩的经典 ai 功能,做成模板,放进工作流预览那里了。从 ai 绘画的纹身图、图身图阔图高清放大,局部重绘 区域控制到 ai 视频的纹身视频,浮生视频,首尾真过度动画,甚至连三 d 建模音乐音效创作都有,真的应有尽有,这全是 comfuly 官方精选的新手入门软件,快速掌握时下最流行的 ai 技术,因为这就完了, 第三,官方还直接提供一键安装包,点一下运行就能直接用。那么接下来呢,我就带着大家来从 comfuly 最开始的部署开始,来部署到我们的本地电脑, 那我已经把咱们需要用到的安装包和操作文档都已经打包好了,同时的话呢,有一些主要的电脑配置要求也会给到大家,那如果你是第一次接触到 comfy 的 话,那就可以跟着我的视频一步一步来进行。那么在我们部署 comfy 之前呢,首先我们还需要去检查一下咱们系统的配置啊,我们可以通过右键点击 windows 的 菜单栏,然后的话呢,点击我们的任务管理器, 打开任务管理器之后,我们点击到性能的这一个列表当中,我们就可以看到自己设备的整个的一个情况啊,包括 gpu 的 显存,然后包括的话自己的内存 ok, 好 的,那么这个的话呢,是第一步我们要检查一下咱们的一个设备,这是 comfyi 的 推荐配置啊,那当然如果你想要跑的更好一些的话,内存的数量要更高,或者是显存的数量更高才可以, 同时的话呢,硬盘最好能够控于有三百 gb 以上的这样的一个空间啊。那么在检查完了系统配置之后,我们就来安装一下必要的软件哈,我这边推荐的是 comfy ui 官方的一键安装包,它是一款用拖拽节点的方式轻松创建图像、视频等生成工作流的 ai 工具,支持 windows、 mac 和 linux 多种系统和硬件环境。 我这边就以最简单的桌面版为例,带大家一步一步的安装到自己的本地电脑上。这里我就以 windows 电脑安装为例,给大家演示一下安装过程,非常适合新手朋友。打开我给大家准备好的 comu i 官方安装包文件夹,鼠标双击一下这个程序图标,接着按照提示一步一步的安装就可以, 它会弹出一个选定安装程序位置的弹窗,在这里我们选择一个宽裕一点的字盘进行安装就可以。以我这里为例,我就安装在 d 盘了。安装路径选好了之后,我们接着点击这里的安装,它就会显示 comfyui 正在安装,请稍等。最后等待它安装完毕,我们点击完成就可以了。 这个时候呢,我们来到电脑桌面,双击一下 comfyui 的 这个图标,它就会跳出一个 comfyui get started, 接着会出现这么一个窗口,我们选择 nvidia qda, 接着点击下一步, 这个时候我们还是选择刚刚安装 configui 程序的那个的位置路径到这里很多小伙伴们会疑惑,这是要安装什么呢?其实这一步就是要部署 configui 真正运行起来的环境依赖, 接着我们点击下一步,这里我们直接保持默认就可以,它就是一个保持程序自动更新和反馈你在使用软件过程中遇到的问题,方便 configui 官方改进产品, 其实就是对新手习惯的功能自动帮助更新,我们点击下一步到这里, ctrl u i 就 会自动帮你安装运行程序所要所有环境依赖,等待它安装完成就可以。在这里我要做个提醒一下哈,就是你的电脑全程要有魔法哈, 这样在安装过程中软件要用到的环境依赖才能顺利下载到你的电脑本地,否则可能会遇到下载失败或者卡住等问题。 最后安装完成之后会出现这么一个界面,这些都是 comfyui 官方在里面内置的一百多条经过社区和广大用户验证,拿到过巨大成果的工作流,其中包括图像、视频、音频、三 d 模型等等等等。那么到这里恭喜你,你已经把 comfyui 成功部署到你的本地电脑了,是不是很简单, cosui 部署成功之后,我们该怎么用起来呢?接着我们来到这边点击一下这个模板的图标,也就是一开始安装成功时弹出来的界面,我们点击视频生成,这里面很多都是通用万象视频开源模型的一些好用的经过广大社区大佬验证过的工作流, 我们选择其中一条来体验一下哈,这里我们找到万象二点二图升视频来带大家来体验一下,找到这个 one 二点二十四 b 图像到视频工作流点击一下,这时我们会看到一个缺失模型的一个提示弹窗,小伙伴们不要慌哈,我们挨个挨个的点击下载就可以了,你不用管它具体放置在哪里,直接点击下载就可以了,等待模型下载完成之后, 我们就可以愉快的玩耍了,怎么样,小伙伴们是不是 so easy? 这还没完哈,这次 com 还有个重大功能,升级官方签约 api。 简单说,你只需要注册一个 comfyui 官方账号,再充点值,就能在 comfyui 里直接调用所有付费 a p i 了。而且 comfyui 还承诺所有 a p i 费用和 openai、 nano banana 等各大官方平台的报价完全一致,没有任何中间商赚差价,用起来特方便,一点不麻烦。 时间有限,更多细节我就不展开说了哈。本期视频用到的安装包、电脑配置说明和操作文档我放在了评论区了,绝无套路,点进去就能下,要是实在找不到的话,我看到了就直接发给你。

788comfyui教程 01:22:04查看AI文稿AI文稿