二分之一阶导数是什么

粉丝9587获赞14.5万

相关视频

52:1982STEM

52:1982STEM 03:01查看AI文稿AI文稿

03:01查看AI文稿AI文稿我就直接告诉你了啊,我的想法是,如果你的计算跟不上怎么办呢?你跟不上是因为你的计算速度慢,你的计算速度慢,所以你要慢慢的把这个计算速度练上来。 再来一个。你看这个题目,他给了我一个函数,让我求二阶导数在这一点处的值,那这个东西实际上就是两阶导数在 x 等于零处的值,所以我先找到它就好说了。那么它怎么求呀?先求一阶导数。 这是我对这个题目的分析。那拿过来之后,先求一阶导数,他等于什么?就等于一的二 x 减一次方,他求导数,那这个显然是一个复合函数,两层复合,外层指数函数求导不变一的二 x 减一次方,再乘内层二 x 减一求导数, 那他两个求的,哎。这个括号一求导数二,那所以就是两倍的一的二 x 减一次方,这是一阶导。然后再看二阶导数, 二阶导数就是两倍的一的二 x 减一次方。扩起来的导数。注意,这个二叫长数,求导符号拦不住,所以它是两倍的一的二 x 减一次方。求导数。这个还需要算吗?不需要,上面刚算完超过来就好了。所以它是二乘二,变成四倍的一的二 x 减一次方。 嗯,对吧。哎,那拿过来往里套数呀。那故 f 的 两节导数在零这一点处的值,就是四倍的 e 的 二 x 减一次方,在 x 等于零处的值,所以它是四倍的 e 的 负一次方。写成它行不?非常好, 那你要不喜欢负指数,你可以写成什么?一分之四。这个好吧,也很好,两个结果都对,没有优劣之分。 那一分之四或者是四倍的一的负一次方都是可以的, ok, 是 吧?那么这个地方,哎,说你只是觉得这道题我算对了,但是我在做这道题的时候,我发现了那么一丢丢的东西。什么东西呢?说这个东西求导数,你看第一遍出来的是它, 然后求二阶导数的时候,这个东西依然没动,但是二变成四了,二变成四了,那么你想一想,哎,你看,坚持,坚持是不是跟不上? 坚,坚持,我真心的问一句,是不是我算的太快了,你总是跟不上?哎,我们说了,这个东西还需要算吗?不需要,这上面有结果呀,所以二乘以这个结果,二乘二当然变成四了, 对吧,对吧?哎,那所以坚持,我的想法是,我这句话我就直接告诉你了啊,我的想法是,如果你的计算跟不上怎么办呢?你这个地方说二为什么变成四呀? 你在,哎,你在这打个问号干嘛?下课自己去算一遍。你跟不上是因为你的计算速度慢,你的计算速度慢,所以你要慢慢的把这个计算速度练上来。

10叶子老师 02:51查看AI文稿AI文稿

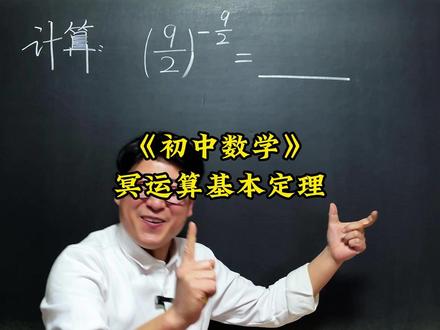

02:51查看AI文稿AI文稿各位好多同学啊,对于逆算啊,学的稀里糊涂的啊,这一道题如果说你能搞明白,你就算学好了啊。我们来看一下,二分之九的负二分之九次方等于多少?各位, 这个负号代表什么意思?负号代表倒数的意思啊,他应该等于什么?二分之九的二分之九次方的倒数分之一,这一步能不能看明白? 这个符号就是倒数的意思?好,那到了这一步怎么满?这个代表什么意思?二分之九代表什么意思?它代表的是什么?这还是倒数啊,它代表的是先进行九次方,然后再进行二分之一次方, 二分之一次方就是开开两次方,三分之一次方就是开三开三次方,这个是二分之一,那就是开开平方,带根号开平方,这一步能不能看明白啊?好,那下一步怎么办? 那就是啊,这个导数还不变啊?那这个九次方,上面的九次方根号下啊,上面九的九次方 对不对?下面呢?是二的九次方对不对?然后呢?他又等于什么?又等于什么?导数是不是分子分母导一下,也就说原式等于根号下二的九次方比上九的九次方, 这一步能不能看明白?好,到这一步怎么办?他又等于什么?上下开根号就是上面开根号,下面开根号, 对不对?好,那后面怎么办?到后面怎么办?这二的九次方是多少?二的九次方是不是二的八次方乘上二啊?然后再开方, 然后呢?这个三的这九的九次方,九九的九次方是多少啊?九的九次方不就三的平方吗?三的平方就是三的十八次方吗? 九十三的平方是不是三的十八次方?那他的应该应该等于多少给他开出来啊?二的八次方开出来,是不是剩下二的四次方了?二的四次方乘上根号二了, 对不对?二的八次方开方不是二的四次方吗?三的十八次方开方,不就三的九次方吗? 对不对?好,到了这一步怎么办?下一步啊?二的四次方多少?二的四四十六是不是十六倍跟上二啊?上面下面呢?三的九次方,三的九次方是不是九个三相乘啊?三个三相乘是多少?二十七。那不就是二十七乘二十七乘二十七吗? 九个九个三吗?什么等于这么一大坨啊?这个,这个成开啊,我不算了啊,这个,这个太复杂了,方法学会就行了,各位。

8342马老师数学课堂 05:25

05:25 06:09

06:09 02:15查看AI文稿AI文稿

02:15查看AI文稿AI文稿明白了不?哎,说高阶导数的求法,就是逐阶去求导,有一阶导,二阶导,再往后数,还有三阶导,四阶导,五阶导,一直往后数。那么,哎,我们把,我们把二阶以及二阶以上的导数, 哎,二阶及二阶以上的导数,通通称为高阶导数,通通称为高阶导数。 那你看,哎,说高阶导数的记号也有了这个记号,这个记号,或者是这个记号其实还有一串呀,是不是还有一串另外一串?我可以怎么写?可以写 d 哎, f 呀,把 y 通通换成 f 呀, 哎,但是这些常用吗?不常用,哎,就这个最常用,哎,这个次值,这两个用的多,写起来方便,写起来简单。这是记号的问题。然后看什么求法,高阶导数的求法, 高阶明。明白了,来高阶导数的求法。我刚才举过一个例子,说 y 的 一阶导,那就是 x 平方,它求导数应该等于二 x, 那如果让你求两节导数呢?实际上一节导继续求导呀,所以它就是二 x 这个函数再求导数变成二。那如果让你求三节导数呢?就是二,这个函数再求导数,它变成零呀。 那如果再让你求四节导数, y 的 四节导数实际上就是零,这个数再求导数依然是零,那往后再求,无论如何全部是零了。那通过这一个例子,我们就知道,高阶导数怎么求呀?就逐阶求。 哎,什么叫逐阶求呀?按照一、二、三、四、五的顺序,让你求二阶导,你得先求一阶,再求二阶。如果让你求四阶导,你得先把一阶、二阶、三阶求出来,找到三阶之后,在三阶的基础上再求导数,才会得到四阶。可以了,不 明白了不?哎,说高阶导数的求法就是逐阶去求导。

8叶子老师 05:10查看AI文稿AI文稿

05:10查看AI文稿AI文稿恋爱可以不谈,但高数必须每天都学。今天的每日一题是密指函数求导,这可是导数求导的高频坑点题,直接套公式必错,变形技巧才是关键,有想法的同学赶紧暂停算一算。接下来进入讲解环节。 同学们好,今天我们来做一道密指数求导题,很多同学第一眼看到这道题,想到的就是复合函数求导, 那复合函数怎么求导呢?先设 sine, x 等于 n, 然后套用基本公式, x 的 n 次方的导数等于 n 乘以 x 的 n 减一,所以 x 的 三 x 次方的导数就等于三 x 乘以 x 的 三 x 减一,这样做是完全不对的,为什么呢?因为这个公式是基本 初等函数的求导公式,而我们的 x 的 三 x 次方,它的底数和指数都是变量,属于密指数, 密指数是不等于初等函数的, 所以我们不可以通过基本出纳函数求导公式对它进行求解。那同学就会在想了,平常要么就直接用这个基本出纳函数接求导,要么就是变形,然后符合函数设 t, 设 n 啊什么什么的进行求导。 那现在这种情况,这些方法都不能用的,那我们该怎么办呢?我们可以用对数求导法进行求导。什么是对数求导法? 首先对数有个性质,比如 line 的 a 的 x 可以 把这个 x 拉下来提到前面,我们同样也可以把这个三引 x 拉下来提到前面,然后帮助我们计算。 哎,我们首先对两边取 line, 左边是 line y, 右边是 line 的 x 的 三引 x, 然后将这个三引 x 提到前面 line x, 然后我们就得到这个公式的,然后我们两边对 x 求导,尝试一下,看能不能求出来,然后我们看左边左边的 line y 的 导数,首先 是这个 line y 导数对 x 求导,它不好求,对吧?所以我们通过列式法则进行求导, 设它对外求导 一个列式, 然后就可以算出来左边这一部分,它就是乱 y 对 外求导,然后利用出的函数求导公式算出等于 y 分 之一,然后右边那就是 y 的 导数,左边求出来了,我们看右边, 右边是三 x 的 无穷 x 求导,然后我们利用乘积法则前导后不导,再加上前不 导后导,然后我们成功对两边对 x 求了个导,然后我们可以得到这个求导后的公式, y 的 导数等于 cos sine x sine x 加上, 然后我们把这个 y 分 之一乘到右边去, 这样我们求出了 y 的 导数。啊。同学看到这里就会疑惑,这里不是还有个 y 没有求完吗?难道我们要把它当做常微分方程继续进行求解吗? 大家想一想我们该怎么去掉这个 y? 没错,看题目,题目给了 y 的 结果,我们直接把这个原式回代到我们的公式里面 就可以了,然后带回去是 y 撇儿,等于 三 e x 考三 e x, 洛恩 x, 再加上三三 e x。 好, 这样我们就求完了。 这一题就讲完了,今天的视频就到这里结束了,欢迎大家留言评论投稿,也可以加入粉丝群一起学习,我们明天再见!

449瑨华(学习版) 14:30查看AI文稿AI文稿

14:30查看AI文稿AI文稿好,同学们,接下来我们来看一下二阶导的应用哈,二阶导应用,那么二阶导的应用在我们考试当中是让我们求凹凸区间以及拐点的。凹凸区间以及拐点的。 好,我们来看一下它的一些概念。首先是凹凸性认识一下,设函数 y 等于 f x, 在 这个区间上连续,在开区间内具有一阶和二阶导数哈,在 d 区间上连续啊,在这个开区间内具有一阶和二阶导数,也就说它可以求两次导了,那么它这个函数叫做凹函数,也可以叫做上凹函数, 也可以叫做上凹函数。好,那这里面来区分一下哈,除了 f x 叫做上凹之外呢,它还可以叫做什么呢?还可以叫做下凸或下凸,或者叫做下凸函数, 或者叫做下凸函数。下凸函数啊,除了叫做上凹或者是凹,凹就是上凹的意思啊,它也可以叫做下凸函数。好,另外一种,如果当二阶导小于零的话,那么这个函数叫做上凸 上凸,或者叫做凸函数,那你可以把它上省略掉,也可以连着叫上凸函数,或者叫做下凹函数,或者叫做下凹函数或下凹函数。 下凹函数。好,把它写一下啊,同学们,或者叫做下凹函数。 好,写好了之后,我们来看一下它的特点哈,也就是二记到大于零的时候,它就是凹函数。二记到小于零的时候,它就是什么数啊?凸函数,凸函数,所以大于零,凹函数,小于零,凸函数,所以就是四个字,大凹小凸。哈,大凹小凸大于零,凹函数,小于零,凸函数。 好,整理好了之后我就翻译了哈,来,我数五秒钟没有整理好的,暂停一下视频啊,继续看哈,五四三二一。好,那我就翻译了哈,没有整理好的,暂停一下视频 啊。接下来看一下凹凸区间,也就是凹凸函数的啊,它们区间的一个图形特征。好,来看一下这一个,你看它的图像特征是什么呢?是不是整个往下凹进去的呀?对不对?它一直往里凹,一直往里凹,所以你看,如果从上往下看, 这是上面,从上往下看的话,它是不是凹进去的呀?对不对?从上往下看,它是凹进去的,所以它叫做什么函数?上凹函数啊,上凹函数。然后那如果说从下往上看呢? 如果从下往上看,从下往上看,是不是凸出来了,所以叫做下凸,这就是下凸。所以上凹和下凸他们都指的什么函数?都指凹区间的意思哈, 都指凹区间的意思。那么什么情况下他才是凹区间呢?你看这里面呢,他的这个切线的斜率他应该怎么样呢?大于零还是小于零?这整个曲线在切线的上面啊,所以在这一点出的他的这个二阶导, f x 零的二阶导,他应该等于零啊, f x 零的二阶导,他应该大于零。 好,再来看另外一个图像,你还是这样的哈,这是上面,这是下面,从上往下看,从上往下看,他是不是凸出来的,所以是上凸,对不对?上凸,上凸看出,然后再来看,从下往上看,他是凹进去的, 你看从下面往上面看,他是凹进去的,所以他叫做上凹啊下凹啊下凹。说错了,下凹,从上往下看,是凸出来的,所以就是上凸。从下往上看,是凹进去,所以就叫做下凹。那么这两种情况他们都指什么区间?都指凸区间啊,凸区间,凸区间, 凸曲线。好,那你先来看它这个斜率是不是在这条切线在上面,而整个曲线的图像在切线的下面,说明它的二阶导 f x 零的二阶导,在这一点处。对,它求二阶导之后,它应该怎么样啊?它应该是小于零的,因为在整个切线的下面啊,因为在整个切线的下面。 好整理一下,整理好之后,哎,再给他举一个很形象的例子,怎么去理解凹曲线和凸曲线哈,凹曲线和凸曲线, 你就记住上凹从上往下看,凹进去的,下凸从下往上看,凸出来的啊,上凸从上往下看,凸出来的,下凹从下往上看,凹进去的。 好,五四三二一。我翻译了哈,大家没有整理好的,暂停一下视频哈。好,那现在来看一下这个东西是不是有两只猫啊?对不对?你看一下左边这只猫,他在伸懒腰啊,他睡了一天了,或者他早上第一件事要伸懒腰,那他伸懒腰,他是不是?你看他这里面要弯一下,对不对?那你看如果我从上往下看, 从上往下看,他是不是就是一个凹的一个形式,对不对?凹的形式。那如果说从下往上看呢?从下面往上看呢?他是不是凸出来的形式?所以你看他就是一个什么凹区间啊?凹区间。所以你记住,二阶导大于零的时候,他就是一个凹区间啊,二阶导大于零,他是一个凹区间。 凹函数来写的凹曲线或者叫做凹函数啊。好,再来看另外一只猫,你看这只猫是不是你惹它生气了,它发火了,毛都炸起来了,对不对?所以你看,从上往下看,它是凸出来一部分的,但是从下往上看呢,它就是凹进去的一部分,所以它的这个区间可以这样来表示哈,你看,从下往上看, 凹进去了,从上往下看,变凸出来了,所以它是一个什么区间啊?凸区间啊?凸区间。 那你备注一下,从上往下看,他是上凹嘛?从下往上看,他就是下凸嘛,对不对?下凸。然后这个呢?从上往下看, 上凸,从下往上看,下凹下凹哈,不是下凸了,下凹,从下面往上面看。哎,一直往上面看,俯看,他说凹进去一部分啊,所以他是下凹,所以就是下凹。那么二阶导小于零的时候,他就是 凸起尖啊,凸起尖,所以记住这四个字,大凹小凸就可以了哈,大凹小凸,大凹小凸啊,这四个字 好,记好之后我们来看一下哈,这个猫你就不用画了哈,接下来我们来看一下,求拐点哈,什么是拐点?拐点首先要知道它的定义就是凹凸性发生改变的点,要么是凹曲线变成了凸曲线,要么是凸曲线变成凹曲线,听到没有啊?然后存在的地方 拐点存在的地方是什么呢?就是二阶导等于零的点,或者是二阶导不存在的点。好,那这里面特别要说明一下,二阶导等于零的点是什么点呢? 二阶导等于零的点,二阶导等于零的点是拐点的横坐标啊,或者是二阶导不存在点,他们都是指的什么呀?拐点的横坐标啊 啊,这里面写到旁边哈,存在的地方,二阶导等于零的点,或者是二阶导不存在点,他们这两个点都是指横坐标。谁的横坐标啊?都是指拐点的横坐标。 拐点的横坐标也都是 x 哈,不是 y 哈,它只是一个横坐标,跟 y 纵坐标没有关系。听到没有?不管是二阶导等于零的点,还是二阶导不存在点,指的都是 y 点的横坐标。好,第三句话表示第三个东西表示方法, 拐点是一个坐标点,那你看他的横坐标是谁啊? x 零,对不对? x 零,那这个 x 零就是刚刚求出来的二阶导等于零的点,二阶导等于零的点,或者是二阶导不存在的点,或二阶导不存在的点。二阶导不存在点不存在的, 也就是它的不可到点哈。不可到点,那么它是横坐标,带进圆函数里面,就算出最后纵坐标了哈。所以你只要知道横坐标,你把横坐标带进哪里面呢?带进圆式啊,带入圆式,带入圆式,就可以得到我们的这个拐点的纵坐标了哈。拐点的纵坐标, 也就是拐点的纵坐标,就是我们的什么呀?函数值哈,就是等于最后我们的函数值。都要清楚一下,拐点的纵坐标就是最后我们求出来的函数值。谁的函数值啊?把拐点横坐标带入圆式的函数值。听到没有?好,把这些记一下。记好之后我们来看一下下面的东西。 看错了啊,这边是二阶导哈,两撇哈,你别写成一撇了哈。好,十秒钟哈,十九八七六五四三二一。没有整理好的,暂停一下视频啊,我就翻译了哈。好吧, 把这个,把这些也记下来哈。把拐点的横坐标求出来之后啊,我们再求谁啊?带入圆式,然后带入圆式,就可以得到我们拐点的纵坐标,拐点的纵坐标就是最后我们求出来的函数值啊。 好,接下来我就翻译了哈,我们来看一下凹凸曲线以及拐点的求解步骤。第一步还是要确定出函数的定义,把函数定义求出来。第二步,求出二阶导,等于零的点和二阶导不存在点。这两个点都是什么点?这两个点都是拐点的什么很坐标啊?备注上拐点很坐标, 来,把拐点横坐标求出来。好,拐点横坐标求出来之后,下一步我们对定义域划分为若干个区间,所以第三步就是分区列表。第四步就是写结论,它的高区间是谁?凸区间是谁?拐点是谁啊?拐点怎么算?就是把横坐标带入圆式,算出纵坐标值,它的函数值就是我们的纵坐标哈。好,来把这页记一下吧! 把这页记一下,记好之后我们继续哈。 记好之后我们继续啊,我们来做题了哈,做题了, 好,五四三二一应该都写好了吧?没有写好的暂停下视频哈,我就翻译了哈,三二一零。接下来看一下第一题,大家先把题目抄一下大家先把题目抄一下。 大家先把题目抄一下。好,抄好了之后,我们来看一下这道题怎么来做哈,按照刚刚那个求解步骤哦。出区间以及拐点的求解步骤,第一步先要看它的定义域。第一步,函数定义域。 函数定义域用大 d 来表示定义域,那么这里面 x 属于什么呢? x, 它的定义域是全指数。 e 的 负的 x 方呢? e 的 负的 x 方的这个图像之前我应该教过你们画过吧?我记得 它图像你看,因为 s 前面的系数为负了,所以它就变成了一个单调递递减的一个图像哈。单调递减的一个图像变成了原来单调递增图像,现在变成了单调递减。那么单调递减你看 s 的 范围是左边右边都是可以取到的呀,所以还是全体是负,所以还是负。无穷到正无穷还是全体是负 啊?这是 y 等于 e 的 负的 s 次等图像哈。嗯嗯,好,那么第二步,我们要对它求 导 f x 的 一阶导求出来 x 求导一,然后 e 的 负的 x 求导 e 的 负的 x, 它是一个复合函数,求导它求出来导应该等于什么呢?它等于 e 的 负的 x 啊。最外层求导,然后乘以负的 x 的 导, 乘以负的 x 的 乘以负的 x 的 啊,那个是负的 x 的 一撇,负的 x 求到等于多少负一,所以它就等于负的 e 的 负的 x 次方。这个角过很多遍了哈,不要写错了,这就是减去 e 的 负的 x 次方,然后我再给他求二阶导 f x 的 二阶导,再给他求导一减去来, 它求到负的 e 的 负的 x 次方。负负得正,所以就等于一加上 e 的 负的 x 次方,一加上 e 的 负的 x 次方,然后二阶导求出来之后,你令二阶导等于零啊,好,证明这个一没有了哈。不好意思,这个一是零了, 这个一在求导是零的哈。零呢?零减去一个负的就是正的嘛,对不对?负负的正,所以是 e 的 负的四次方,你可以把它写成 e 的 x 次方分之一啊,这样去写,然后你令二阶导等于零,令二阶导等于零,看看 x 可以 取什么。 那你看令它等于零, x 是 不是可以取任何的一个实数啊,对不对?有没有它二阶 x 是 不是可以取任何一个数?有没有二阶导等于零的点?有没有? 是不是?没有啊,对不对?没有哎。没有二阶导等于零的点,那说明他的整个区间都是一个区间了,他就没有拐点了。听到没有?没有拐点了,然后也没有二阶导不存在点,对不对?所以你可以写一句话,没有 二阶导等于零的点,没有二阶导等于零的点的意思就是它无拐点的意思啊,它全部都是一个区间啊。无拐点是全都为,要么全部都为凹区间,要么全部都为凸区间。然后也没有什么啊,也没有, 也没有二阶导不存在的点,也没有二阶导不存在的点,二阶导不存在的点, 也没有二 g 的 不存在的点,它不可导点,对,不可导点也没有啊。那你看它既没有二 g 的 点,零的点,也没有二 g 的 不存在的点,那没有二 g 的 不存在点,是不是也是无拐点呢?也没有拐点的意思哈,也没有拐点。 那你看它都没有拐点了,是不是它只能有一个区间的意思哈?既区间既它的区间只有一个既凹凸区间只有一个的意思哈? g 凹凸区间哈。 g 凹凸区间只能有一个啊只能有一个 只能有一个。嗯,要么只能有一个凹区间,要么只能有一个凸区间。那么现在也来看,我这个二技能已经求出来了,它是 e 的 x 四方乘一,它这个二等于零还是小于零?小于零,对不对?既然它是小于零,就说明它整个区间是怎么样的,大凹小凸,是凹的,是凹的,所以我把这段分析过程刚刚这个图像擦掉了呢,这只是我们 分析的思路。好,接着我们再来写啊,第二步可以得到这样一个形式啊,第三步,你可以写个结论。第三步,你可以写啊,又因为啊,又因为 f x 的 二阶导数,它算出来是 e 的 x 四方分之一,它是恒大于零的, 恒大于零的,那么既然它恒大于零,刚刚我们才说过二阶的大于零,它是什么区间?凹区间,它图像就是凹的啊,上凹下凸的啊,上凹下凸的啊,所以,所以这个函数 f x 的 图像, 它的图像在定义域内,它定义是什么?全体式数嘛,对不对?在负无穷到正无穷这个全体式数内, 在全体实数内怎么样啊?全是凹的啊,全是凹的,全是凹。函数啊,全是凹的。后面写个全是凹区间也可以啊,全是凹区间啊,凹区间啊,所以凹区间,为什么呀?啊?所以它的凹区间 就为全景实数,也就是它的这个定义。服务区的中求有没有凸区间呢?无凸区间,那备注一下,它是无凸区间的啊,没有凸区间。好,这是我们最后的这个结论。好,来看这道题有没有看懂啊? 好,我们用蓝色的空框把它圈出来啊,这是我们第三组啊,再来整理一下吧,整理一下,整理好之后我们来看第二期啊,第二期记得点赞关注哦。

32阿阳学长讲高数

猜你喜欢

- 1414Liu~