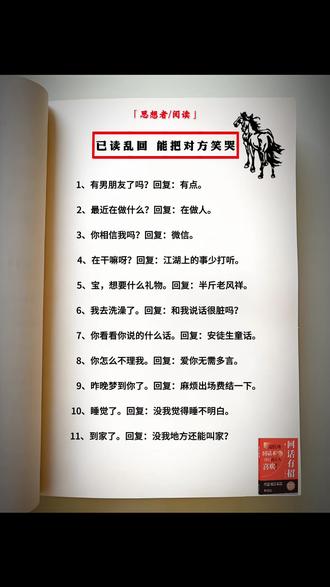

bubbly已读乱回怎么弄

今天我们探讨一个在大模型应用中直观重要的话题, r a g 技术。大家在使用大模型的时候,你们有没有遇到过模型一本正经的胡说八道的情况,我相信大家都有遇到过,这就是我们常说的幻觉问题。随着 r a g 的 发展,很多人在我们业界提出了高级 r a g, 就 有一种技术可以让大模型变得更靠 谱,解锁准确率从百分之五十提升到百分之九十以上。今天我们就来聊聊这个高级的技术。 r a g, 也就是解锁增强深层。我准备了十七种 r a g 方案的技术原理, 实现细节和性能对比,保证让大家听完就能上手实践。先问大家一个问题,为什么我们需要 r a g? 直接用大模型不行吗?这 就涉及到大模型的两个天生缺陷,一是知识截止问题,比如 g、 p、 t 四模型,模型训练知识截止到二零二三年十月,他不知道二零二四年之后发生的事。二是幻觉问题,模型会编造一些看似合理但实际上错误的信息。 rat 的 核心思想很简单,让大模型带着资料答题,就像考试时允许你查参考书一样,这样答案自然更准确。从技术角度看, rat 的 工作流程是这样的,把文档切成小块,把每块转换成像量。用户提问时找到最相关的文档块,把这些文档块和问题一起发给大模型, 大模型基于这些信息生成答案,这个过程看似简单,但里面藏着大学问。现在我想问问大家,你们在使用 rat 时遇到过哪些头疼的问题? 根据我多年的大模型落地经验及踩了好几年的坑积累的经验和实验,得出了数据,给大家做一个分享。原声 r g 主要有四大痛点,首先是解锁精度低,我们测试发现,原声 r g 的 top 五准确率只有百分之四十五至百分之六十,这意味着有一半的相关信息都没找到。 其次是分块,羽翼割裂,传统的固定长度分块会把完整的羽翼单元切成两半,导致关键信息丢失率高达百分之三十至百分之四十。 三个是计算效率问题,解锁延迟通常在两百到五百毫秒,这在实时应用中是不可接受的。最后是内存占用大,存储一百万文档的向量需要十到二十 gb 内存,对服务器是个不小的负担。这些问题不解决, r a g 在 生产环境中就很难真正发挥作用。 那怎么解决这些问题呢?我们先从分块开始说起。大家有没有想过同样一篇文章,不同的切法会影响解锁效果吗?答案是肯定的。 我们测试了五种分块策略,效果差异很大。第一种是简单分块,就是固定长度切分代码很简单,但问题也很明显,容易切断语义。第二种是语义分块,通过计算句子间的相似度来决定在哪里切分,这样可以保持语义完整性,准确率能提升百分之十五到百分之二十。 第三种是上下文增强分块,每个块都保留前后的一些 token 作为上下文,这样虽然增加了一些溶于,但能让模型更好的理解内容。第四种是快速标签分块,利用文档的标题、章节等结构信息。想象一下,在解锁时如果能同时看到第三张向量解锁原理,这样的信息 是不是更容易找到相关内容?我建议大家在实际应用中优先考虑域域分块,因为它在准确率和效率之间取得了最好的平衡。分块解决了,但解锁本身还有优化空间。我想问大家,如果用户的问题表述不清楚, r a g 还能准确找到相关信息吗?这时候就需要查询改写技术了。 简单来说,就是让 l m 把用户的问题改写成多个不同的表述方式,扩大解锁范围。我们测试发现,这个技术能提升百分之八到百分之十二的准确率。另一个关键技术是重排序。传统的向量解锁可能不够精确,我们可以用专门的 crossing code 模型对解锁结果进行精细排序。虽然这会增加百分之五十到百分之幺百零的延迟, 但准确率能提升百分之二十五到百分之三十五。还有一个很有意思的技术叫 hide, 也就是假设文档切入。他的思路很巧妙,先让模型根据问题生成一个假设的答案,然后用这个答案去解锁相关文档。为什么这样有效?因为假设答案包含了问题的语义结构,更接近理想的文档表示。对于更复杂的场景,我们还需要一些高级技术, 比如 self r a g, 让模型自己决定是否需要解锁外部知识,对于简单问题直接回答,对于复杂问题才进行解锁,这样可以节省百分之十到百分之二十的延迟。再比如知识图谱融合、向量剪辑,擅长语义匹配,但不擅长结构化推理。如果把知识图谱和向量剪辑结合起来,就能同时处理语义和结构信息,准确率能提升百分之三十至百分之四十。 还有相关片段提取技术,它能在长文档中精确定位最相关的几句话,而不是返回整个文档块,这对于处理长文档特别有用。最后我想问问大家,面对这么多方案,你们会怎么选择?我的建议是根据具体场景来决定。资源受限场景用语域分块加萨夫二一 g 加上下文压缩标准生产场景用语域分块加查询改写加重排序。 高精度场景用语音分块加重排序加 r s e 加 hide。 专业领域场景用知识图谱加多级缩影加 c r a g。 海量文档场景用多级缩影加结果融合加分布式解锁。记住一个原则,优先考虑准确率提升与资源消耗的平衡,避免过度工程化。今天我们一起探讨了十七种 r a g 方案的技术原理和实现细节。 reg 技术正在快速发展,新的方法不断涌现,我想留给大家一个思考题,在你们的业务场景中, reg 还有哪些潜力没有被充分挖掘?希望今天的分享能给大家带来一些启发,如果有任何问题,大家都可以在评论区留言。

粉丝1.5万获赞3459

相关视频

00:52查看AI文稿AI文稿

00:52查看AI文稿AI文稿过年在家如何以毒乱回外面。外面做什么?看见没有?城市循环,世界不稳。你不懂。跟你说这些你不懂。你有对象吗?有几个吧,准备什么时候结婚? 听你的,什么时候要小孩。晚上吧,中午也行。怎么感觉你不太爱说话?你这小子为什么不爱发红包?发也行,来把你的手机给我。 这要手机干嘛? mate 六零 e t b 的 还是全网美,然后刷屏到两千三。卖了给我发红包就行。那个还给还还还,我卖了我用什么?你应该趁着年轻赶紧生个孩子。有病啊,我想生个不认识的人。你小孩怎么说话呢?我们都是为了你好呀。你不结婚你老了怎么办? 老了我就死。老了我就像你一样到处问。什么时候结婚啊,什么时候生孩子。趁年轻多生几个啊。

1748爱回收的果果 00:29

00:29 00:58查看AI文稿AI文稿

00:58查看AI文稿AI文稿我妈又要教训,来个嬉皮笑脸。上课?我上啥课啊,听见没有?上课了,妈,口水巾有点湿了。不要拽你那口水巾了。上课了? 嗯,你今天的视频点赞怎么那么少啊?为什么? 为什么那么傻?我擦一下口水,口水好多。是不是你不够萌?我问你呢,我不萌谁萌呀?我问你呢,回答了你又不高兴,是不是你不够萌? 嗯,你不给我萌,那些姨姨不喜欢你是不是?嗯,我妈真难哄,是不是我姐呢?快来救我。我的战术就是扭过头去不看她。

11元宝弟弟 00:34查看AI文稿AI文稿

00:34查看AI文稿AI文稿又是逗我的电子男友的一天。宝宝今天会主动找我了。懂事懂事虽然每天都会主动找我。这衣服好看吗? 好看我不行了。哈哈哈我就这样以毒乱回。不我并没看到你发的衣服是不毒不回。哈哈哈哈我发了吗真的想发财了。哈哈哈他要质疑自己了。生气不好要生气了。只要我解释的快就什么都没发生。 我用的六 g。 哈哈哈这就叫解释?每天一逗乐趣多多。你无语了。没事我高兴就好哈哈哈。

732浮华 00:40查看AI文稿AI文稿

00:40查看AI文稿AI文稿我把头理了。你把头埋哪里了?埋你家里了。宝宝我到家了。注意安全。咋的你在我家埋地雷了? 我削土豆把手削出血了。手怎么出血了?跟土豆滴血认亲。 我上高铁了。好嘞慢点开,我开高铁 告状姐姐六十秒语音喊妈量极高。谁想听你家拐的好陪陪纯纯一敷衍哥烦死了救命。他是怎么做到事事有回应件件没着落的。

3.1万扎个啾啾 00:22查看AI文稿AI文稿

00:22查看AI文稿AI文稿这些是已读秒回的人!这些是已读不回的人! 这些是已读轮回的人!这些是已读乱回的人!

297尔尔11(MBTI 版) 00:38查看AI文稿AI文稿

00:38查看AI文稿AI文稿你家住哪?就住这附近。我是问你住在哪个小区?离这不远,骑车的话需要二十分钟,开车的话会很堵,也没有事情。你攒了多少压岁钱?攒的 再多没有花的快。你攒了多少?你爸妈是做什么工作的?爸爸妈妈 让我低调一点。你爸爸妈妈做什么工作啊?你爸爸妈妈是本地人吧?他们是哪里人啊?你为什么光问这个?你有事吗?没事,就是随便问问。我以为你有事呢。

151小乔努力变强 00:22查看AI文稿AI文稿

00:22查看AI文稿AI文稿领导,视频是上午拍还是下午拍啊?可以 把今天刚发的文件打印一下。单面还是双面啊?好, 领导,下周出差是坐飞机还是坐高铁啊?对的。

猜你喜欢

- 113攸肀

最新视频

- 1.1万幸仁Luu