ima知识库本地部署详细步骤

粉丝15.5万获赞29.2万

相关视频

01:15查看AI文稿AI文稿

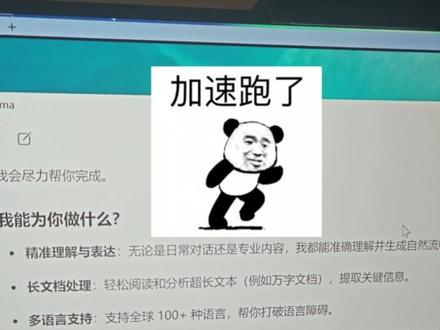

01:15查看AI文稿AI文稿就在刚刚,小龙虾已经开始和艾玛的知识库打通了,接通了之后龙虾就不只是和你聊天了,而是直接可以做知识的萃取和沉淀,把内容直接写进你的艾玛笔记里面,还可以读取知识库内容,还可以导入知识库,相当于给龙虾接入了。第二大脑。 第一步,先注册一个艾玛账号,第二个,先领养一只小龙虾。这一步如果你已经学会了,就直接跳过,任何大厂的小龙虾都可以接入。 第三步,进到这里,找到艾玛技能的安装地址和 api key 的 获取地址,你需要安装艾玛 skill, 然后去对应的页面获取 api key。 第四步,把请安装艾玛技能这段指令直接发到你龙虾的聊天窗口,龙虾就会自动的去安装了。 第五步,这里有一个我自己踩过的坑,有时候直接安装会失败,解决的办法很简单,不要直接从事直接去官方的这个共享的仓库下载对应的压缩包,也就是压缩文件,把这个压缩文件直接拖到龙虾的聊天窗口里面安装就可以解决了。 六步,安装完成之后,把你获取的 api 可以 全部复制给龙虾,龙虾就会自动的和艾玛完成配对。第七步,开始测试,你直接在龙虾的聊天窗口里面给他安排一个任务,比如说我让他把这段文字写进艾玛的笔记里面, 如果提示成功了,然后你就可以去电脑端和手机端的艾玛笔记里面去查看了,这时候你就会看到你新建的内容,到这里恭喜你,就说明你的龙虾已经成功连上了艾玛了。第二大脑连接成功。

115鹏哥撩工程 Ai 06:46查看AI文稿AI文稿

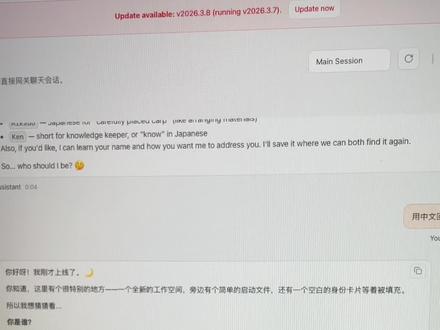

06:46查看AI文稿AI文稿部署本地的 openclaw 已经可以剪视频了,大家都知道了吧, 这个让硅谷大佬每日一封的 openclaw 阿月,我呢也是拉到本地试了几天,现在就带大家把本地部署和接入飞书每一步都走明白。为了防止偶然性啊,我呢也是连续测试了四台电脑,确保每一步都可行,接下来你们只要跟着做就可以。点好关注收藏, 我这里依旧用的是 windows 系统来操作,因为 macos 系统呢,环境相对比较简单,不像 windows 这么复杂。首先呢,我们要确认好 windows 的 安装环境,安装的时候呢,全部都点 next, 一 直到完成即可,建议呢,不要去变更中间的安装路径。 呃,安装完成后呢,我们可以检查一下环境,我们在命令提示符的窗口输入这两个指令,如果输入指令后跳出版本号,那就说明安装已经成功了。这里提到的两个环境文件呢,我在文档里面也全部都准备好了。 好,接下来呢,我们就开始全区安装 oppo 卡使用管理员 c m d 指令输入,这个指令安装完毕后呢,再输入这一条指令, 好开始了。 ok, 这一步跳出来的呢是风险提示,我们直接选择 yes。 然后呢我们选择 quickstart, 这一步呢是选择大模型,我这里呢用的是千万,因为他是国内的,如果大家有惯用的呢,也可以自己进行勾选好,然后我们这里模型选择默认的即可。 之后呢会跳转到大模型的首页进行授权验证,大家验证通过就可以了。那通过后呢,这里也同样有一个选项,我们直接选第一个默认的模型。 ok, 下一步呢,这里可以看到很多的应用选项,这其实呢就是指令输入的终端,因为这些都是国外的,所以我们先不管,选最后一个,跳过,后面呢我会给大家介绍如何接入国内的飞书。 ok, 继续,这里会问你需要配置什么 skills? 呃,我们也跳过,没问题,因为这个不着急,后面都可以手动去配置的。 好,这个也不用管我们用不上,直接跳过。好,然后我们稍等一会,会自动弹出一个网页,然后你会发现这个网页是打不开的,没关系,我们这个时候呢,再运行一个 c m d 的 指令, 好,这就是欧奔 cloud 的 兑换框了,我们来尝试和他打个招呼, ok, 他 回复我了,那到这里呢,其实基本上就成功了,还是比较简单的啊。然后呢,我们再来尝试为大家接入一下飞书,很多小伙伴呢,在这一步呢,其实就被劝退了,因为怎么样都接入不了这里,大家看好我怎么操作。 首先呢,我们进入飞书的开放平台,我这里呢用的是个人版,我们来创建一个企业自建应用, 进到这个凭证与基础信息界面,把你的 app id 和密钥保存下来,这个很重要啊,后面会用到的。然后 我们添加一个机器人,再到权限管理这一步,为他添加一些权限。这里的权限列表呢,其实官方呢是有指导文件的,但是呢就藏的比较深,我呢也是给你们找出来,直接放到文档里面了,你们直接一键复制过来就 ok。 好,然后我们需要配置一下这个事件回调功能,在这里的订阅方式选择长链接这一步呢是必须的,而且是绕不开的,也是大家碰到卡点最多的一步,很多小伙伴呢在这里呢就是一直报错,好,不用担心,我呢,已经整理了一份非常长的傻瓜教程,大家直接照做就 ok 了。 然后选择以后呢,我们添加事件,然后添加搜索接收消息, ok, 然后我们就去点击创建应用,然后再发布就 ok 了。 好了,配置工作完成之后呢,我们就要开始给欧邦克劳接入飞速杀键了。由于 windows 的 系统环境问题呢,所以大家的电脑情况都不太一样,所以会出现不一样的报错问题。网上的很多视频呢,也没有把这个问题针对性的讲清楚,我自己呢也试了三到四台电脑来做尝试,都非常有挑战。 如果你手边也报错的话呢,不用担心,我这里想到了一个邪修的办法。好,那既然 oppo klo 可以 控制我的电脑,那为什么他不能自己安装飞出插件呢?我们来试试看吧,直接和他对话。呃,你自己安装一下飞出插件,然后呢,他就会开始疯狂的工作,并自行去验证安装环境和插件配置 啊。五分钟左右后呢,他就会告诉我,他工作完成了,需要我提供给到他飞出机器人的 app id 和密钥。这个呢,其实我们在上一步已经有了,我们直接复制给他,让他呢继续去工作。这里的工作过程当中呢,我们的机器人可能会下线几次,原因呢是他需要去重启网关, 如果呢,你感觉他下线太久的话呢,我们可以用 open cloud get away 这个指令重新把它呼出来。最后呢,他会要求你在飞车上和他对话进行测试,并为你排除最终的一些故障。 ok, 全部搞定,已经可以在飞车上正确回复我了,并且呢,刚才在外部的对话记录他也全部都记得, 呃,我们这里呢,再用手机给他发一条消息试试看。好,他也同样接受成功了。好了,这里欧本卡接入飞书的配置呢,就完全对接成功,基本上都是他自己完成的,我呢只是配合他提供了一些必要的信息, 妥妥的全能小助理。接下来我们来看看他能为我们做一些什么吧。比如呢,我现在想要订一张机票,我就让他帮我查询一下最便宜的航班,他立刻就给我列了具体的信息,包括航班号,价格以及其他的一些航班信息。不过这一步呢,是需要接入 api 的, 大家可以自行去网上找免费的接入就可以。 好,那现在过年了嘛,马上大家呢也会送礼嘛,那我就让他去浏览电商的页面。呃,不过这里呢,需要先安装一个 oppo club 官方的浏览器插件,我们直接从官方渠道进行安装就可以了。具体的步骤呢,已经放在文档里了,大家直接照做就可以。我让他给我打开。 ok, 成功,呃,然后我继续让他为我搜索燕窝。好,也成功了。 好,那我们现在在拿最近小伙伴在学习的 ai 的 线上作业丢给欧本克,看他能不能帮忙完成。 首先我们要让他找到作业的本地目录,并让他完成里面的题目。他立刻就找到了,并且迅速告诉我,完成了。啊,这速度还是真的蛮快的啊,但是呢,人呢,还是比较懒的。如果呢,你抄作业都不想抄啊?没事,直接让他把填完的东西返回给我。好,他已经做完了,我们来看看啊。 呃,代码呢?全部都完成了,不过呢,我也是看不懂啊。看懂的高手可以来说说他完成的这个准确率怎么样。 好了,那这次安装说明就先讲到这里了,关于 open cloud 的 更多能力,有时间呢我们可以再去测一下。好,那既然已经部署成功了,有兴趣的同学呢,也可以再去深度探索一下 啊。对了,现在呢,各大厂呢,也出了针对 open cloud 的 云端部署,我这个呢,也可以跟大家快速的分享一起。好,这里是阿月,希望我的视频能够帮助到你,让你更了解呀,我们下期再见。

1.7万阿悦很严格 00:42查看AI文稿AI文稿

00:42查看AI文稿AI文稿利用上班的碎片时间,我用豆包搭了一个专属知识库。这段时间私有化部署特别火,早就想把自己的数据攥在手心里了,今天终于开干,发现很多人还在用在线 ai 文档,一上传核心机密就没了隐私保障。所以这次我专门花了三点五个小时,在本地成功部署了大模型, 搭建了一个完全属于自己的知识库。过程其实没那么难,我把关键步骤全梳理出来了,做成了一份小白也能看懂的实战教程, 手把手教你如何在电脑上一键部署大模型,从环境配置到知识库挂载,照着做就能落地,看十遍,不如实操一遍,真的超有成就感。如果你也想搭建一个自己的知识库,留下学习直接暴走!

155大模型星球【👀简介】 01:56查看AI文稿AI文稿

01:56查看AI文稿AI文稿使用欧拉玛可以一键部署本地大模型,我选择的模型是千万三点五九 b, 现在来演示一下, 可以看到 gpu 使用率向升,由于我这台电脑的显卡配置比较低,所以输出的比较慢。 好,终于输出完成了,接下来是 gg 教程。 首先肯定是要下载欧拉玛的这个软件,进入欧拉玛的官网之后,选择 windows 点击下载,当然这个下载起来会非常的慢, 我也给大家把安装的程序上传到了网盘下,下载后双击打开直接安装,安装完成之后就是这样一个界面,可以在这里点击你想要的大模型,比如说这些是云端大模型, 从这里开始就是本地大模型,这个是谷歌开源的本地大模型街吗? deepseek 千问三,还有其他的一些模型啊, 对于模型怎么挑选,得看电脑的配置,比如说我这台电脑 cpu c a m d 二五六零零两根 d d e 二四的一六 g 内存条, 显卡是一六六零 s 六 g 的 显存,这个已经是非常老的显卡了,后续我准备根据我的电源升级成四零六零 t 一 六 g 显存的,所以根据我的电脑配置 选择了比较小一点的模型。那你的电脑适合哪一个大模型?可以把配置发给豆包问问,让豆包帮你分析适合下载部署什么样的大模型。今天的教程就到这,关注我,评论私信。

292集集集集盒🌈 00:52查看AI文稿AI文稿

00:52查看AI文稿AI文稿朋友们,本地部署那个大模型还是可行的,我根据网友的建议去用了这个,用这个模型加载器,然后我现在在本地部署,在 mac mini m 四上部署的,然后我现在问他一下,他响应速度还行, 你看没这么快就响应量也还可以,你看响应速度非常棒。 然后就是这个拓展处理的话,拓展量非常大,如果说你本地绘画的话就还好,如果说你上 ag 的 话就得上这个模型, 不是这个模型这个容器吧,用这个加速就挺好的,可以部署本地的。

208神秘人类 11:50查看AI文稿AI文稿

11:50查看AI文稿AI文稿这是我刚收到的苹果新款 macbook neo, 用它养龙虾,你觉得靠不靠谱呢? 今天我就用它手把手教大家如何配置 macos 版的 open core, 本地部署步骤呢,很详细,需要一步一步往下看,保证成功。建议呢,先仔细看一遍,再跟着操作。第一步,安装 get 苹果自己家的开发者站点,仔细看,这里 搜索 command line force for xcode, 根据我们现在的系统版本,新的呢是 xcode。 二十六点三,点击箭头,点击安装包,下载到本地后,打开后按提示安装就可以, 直到安装成功。这个时候呢,我们点击右上角放大镜图标输入终端,打开后输入这串命令,看到版本号就是安装成功了。 第二步,安装 homebrew, 我 们需要在终端输入这一行安装命令,提醒一下。接下去呢,出现类似的命令,记得暂停视频,复制后可以在千问豆包等大模型工具问一下,以免复制的时候识别错误。 输入后呢,按回车,他会自动开始安装 homebrew 了,这里会问我们通过什么下载 homebrew, 我 们可以输入一,也就是清华大学这个敲回车,然后会要求我们需要输入开机密码, 输入后直接按回车就可以,这里会问我们是否删除之前这台机器安装的红不入,直接输入 y 回车,他会帮我们自动备份。再接下来呢,我们还要按一次回车开始安装红不入,安装成功后会需要我们再次输入密码,直接输入后回车就可以。 接下来会让我们选择哪个国内镜像,这里我是直接按他提示输入五回车,然后我们等待他安装完成,直到出现安装成功的提示后,我们先关闭一下终端界面,然后呢,在程序屋重新打开它,让配置生效。 这里有个提醒,如果你是 mac os 二六之前的版本,你呢也可以先按照第二步安装 homebrew, 安装完毕了之后呢,再安装 git 就 比较简单了,直接在现在重新打开的终端里输入 pro install git。 回车后呢,它就会帮你自动安装完成了。 第三步,安装 node js 仔细看 node js 官方界面左下角,点击 macos 安装程序,获取后呢,打开安装包,后面按提示安装,直到安装完成。 第四步,安装 open clone, 再次打开终端,输入这个命令回车就可以了,不用管它。再输入这条命令回车,只要输入正确,依然不用管它。之后我们再输入这行命令, 这个时候他会要求我们输入开机密码,回车后他就开始安装了,我们需要稍微等待一下,看到终端里有类似这样的提示,里面的具体数据呢,我们可能会有不同,不用在意。这说明欧邦克洛安装成功了,但是还没完。 第五步,配置 openclore 配置之前,我们需要先输入这行命令,这个命令的作用呢是删除我们本地已经安装过的飞书插件目录,以免后面引起冲突。输入后按回车就可以。接下来还需要输入 openclore on board, 启动 oppco 初识化配置向导,这个时候你就能够看到龙虾的 logo 了。这个呢,有一个官方风险提示,我们要继续只能选择 yes, 可以 用左箭头键选择按回车确认。这里我们只要保持 quick start 模式,直接回车就可以。 这里就是需要我们选择我们的 oppo colo 准备连接的大模型了,基本上覆盖了目前主流的大模型,如果你已经有创建过某个大模型的 api, 就 可以通过上下箭头键选择插播一个大模型 api 密钥配置。 我这里给没有创建过大模型 api 密钥的小伙伴演示一下我自己在用的 kimi 的 mojito ai api 密钥的创建过程。首先是 kimi 开放平台, 然后呢左侧选择 apikey 管理,之后在右侧点击新建给他取个名字,比如 opencore bot 项目,这里选择一个就可以了,然后点击确定,这个时候呢,我们就可以看到密钥了,这个密钥一定要保护好,不要让人看到,要不然被有心的人拿去的话,他用的就是你的额度了。这里不是点确定,而是点击右侧的这个复制按钮。 好,再次回来,我们可以点击程序屋上的终端,这里我们选择刚刚注册的 kimi, 也就是蒙秀的这个敲回车这个位置呢,我们根据实际情况,我们刚刚是注册的国内的,需要选择点 c n, 这个选择好后回车 这里我们因为是直接复制密钥的,所以直接在 face 的 api key 这里回车就可以。 ok command 加微把我们刚刚复制的密钥直接粘贴回车后,我们保持它默认的这个就可以直接回车。 这里会要求我们选择使用哪个聊天软件来通讯。目前呢,我们可以直接用向下箭头选择到最下面的 skip for now, 这里会涉及一些准备步骤,我们可以在视频后面再配置,选择 skip for now 后回车, 如果跳出设置 provide 后,依然先选择最下面的 skip for now。 先跳过回车,这个时候他会问我们是不是现在需要配置 skills 了,我们可以选择 yes 看一下,你用向下箭头键往下看,每一个的后面呢都有详细的场景说明, 如果有你需要的,可以选中它后敲一下空格键,再敲一下就是取消。这里我们依然先选择 skip for now, 反正后面呢还可以配置的空格键选择再敲。回车, 这里有一系列需要我们配置各种平台的密钥的,我们暂时也都可以先选择 no, 如果你的确已经有密钥了,当然也可以选择 yes, ok, 来到这里 hux, 我们也先用空格键选择 skip for now。 回车,这里会跳出一个窗口,我们先选择允许。然后呢,终端这里会问我们用什么方式起用 boot, 我 的建议是 web ui, 对我们普通用户来说也会更直观一点。选择后,回车,这个时候他会自动打开一个界面,这就是和 oppo cola 的 一个聊天界面了,我们可以先和他聊一下,比如我们可以用中文说一句你好,收到他的回复,呵呵,证明我们的配置已经成功了。 原则上来说,我们的小龙虾呢,已经养殖成功了,但是还有一步更重要的,才能够方便我们用聊天软件随时随地的给他下达干活指令。 也就是呢,即使我们在外面,也可以用手机上的聊天软件给他下指令。那么我们用目前口碑相对更好的飞书来举例。第六步,创建飞书机器人。 首先是飞书开放平台,我们可以准备一个个人账号,登录后点击右上角开发者后台,这里呢,点击创建企业自建应用,给他起一个名字描述,这里也随便填写一下, 选择一个图标,或者呢也可以自定义上传一个图标,然后点击右下角创建,这里我们点击添加机器人,暂时点击左侧的权限管理,点击开通权限 搜索框,这里我们输入 i m 冒号,注意这里的冒号呢,是需要切换到英文输入法的冒号的, 这里我们可以把全部都勾选,点击确认开通权限,这个位置有一个提醒,你看一下应用发布后,当前配置方可生效, 我们需要点击提醒这里的创建版本,这里我们输入版本号,按照他的提示,比如一点零点零更新说明,这里呢,我们也可以写上创始人版本下滑,点击保存,点击确认发布。 ok, 飞书机器人创建完毕。第七步,连接 oppo 克洛和飞书, 依然是在终端输入 open core config 回车,这里选择 local, 这里我们选择 channels 回车,然后是选择默认的这个 config link 回车, 这里呢,我们找到飞书回车这个位置,我们得选择 download from npm 回车安装飞书渠道插件这个位置,选择 yes 回车。稍等片刻后,需要输入飞书的 app, 先按一下回车, 之后再是飞书的开放平台左侧,点击凭证与基础信息,点击 app secret 这里的复制键,再是回到终端 command 加 v 粘贴回车,这个时候还要我们输入 app id, 再次在飞书开放平台点击这里的 app id 下面的复制键,然后呢,再到终端 command 加 v 粘贴回车,这里通讯方式选择 web socket 回车飞书这里我们选择 cn 的 这个就可以回车。 是否允许群聊使用?我的建议是选择下面的 open 回车,下一步可以直接用向下箭头键快速下滑到底部,选择 finished 确认配置完成,这里呢,问我们的是配置私信访问策略,这里需要选择 yes 回车之后这个位置,我们可以直接选择 perry 回车,这个菜单里我们可以选择到底部的 continue 回车。 ok, open core 和我们的飞书正式配置完毕。 最后环节,我们在终端输入 open core get away 启用它。再是在飞书开放平台选择左侧的事件与回调,点击订阅方式,这里的按钮 确认是这个默认的长连接,点击保存这里再是点击添加事件,搜索框里输入接收消息,将接收消息勾选,点击添加按钮,再是点击左侧的权限管理,点击开通权限。 搜索框里呢,输入通讯录,把这个获取通讯录基本信息勾选,点击确认开通权限,再次点击右下角的确认,这里依然会看到版本发布后当前修改方可生效的提醒。我们还是点击创建版本,输入新的版本号,比如一点零点一 更新说明,这里呢,我们可以是添加消息,接收能力,下滑到底部,点击保存,点击确认发布。 第八步,与 open core 对 话,我们可以尝试拿起手机飞书,点击开发者小助手下滑,找到我们前面命名的那个应用,点击打开,我们可以给他也发一句问候,比如你好, 这个时候呢,你会收到这样的一个安全配对提示,不是错误,是为了安全起见生成的配对码, 我们只要复制提示里最下面的这行命令,在终端里再次输入回车, ok, 显示配对完成后,回到手机飞书再给他发你好,很快呢,就能够收到他的回复了, 哦吼,正是在我们 mac 上部署完成了 open core, 同时呢,也可以用手机上的飞书,电脑上的飞书,随时随地的给他下指令了。 这就是完整的 macos open core 本地部署教程了,适用所有的苹果电脑 制作,不容易,有用记得点赞分享。接下去呢,还会有如何配置 skill, 如何省托坑等等的一些必备技巧分享,大家记得持续关注。如果大家还想了解如何一键云部署的话呢,也可以留言,需求多的话,我也来做一条详细的教程。

3579他们叫我小仙 03:32查看AI文稿AI文稿

03:32查看AI文稿AI文稿openclaw, 一 款能接管你的电脑,真正自己动手二十四小时替你干活的 ai 工具。因为 claw 这个单词有龙虾钳字的意思而被国内网友戏称为 ai 小 龙虾。为了用上这个小龙虾,有人甚至花几百块找人上门安装 openclaw, 腾讯还专门搞了个线下活动,免费帮你装龙虾。这期视频手把手教你学会 openclaw 的 本地步数。 一、前期准备工作,硬件要求不高,一台能联网的电脑, windows、 mac 系统都可以,只要不是特别卡都能流畅运行 openclaw。 如果你的电脑里有重要文件资料,建议把 openclaw 部署到虚拟机里运行。软件方面,我们需要先在电脑上安装 nodejs 和 git 这两款软件。首先来到 nodejs 官网版本,建议选择 vr 二 lts 稳定版,点击获取 windows 安装程序, 下载后打开软件安装包,勾选同一软件安装协议,然后一直点击 nex 的, 再点击 instyle 开始安装,稍等片刻, note gs 就 安装好了。然后进入 get 软件官网,点击下载,没反应的话可以到评论区看看安装选项,全部保持默认即可。 最后把这个 view release note 取消勾选,点击 finish 完成。二、安装 openclaw, 点击左下角开始菜单,输入 powershell, 选择以管理员身份运行,然后输入这一行命令,按下 enter 键运行, 系统会询问我们是否确认执行策略,更改输入 y, 按下回车键表示同意,然后再输入 openclaw 官方安装命令并执行, 剩下的就是耐心等待 openclock 完成部署。安装过程中你可能会遇到各种各样的错误提示,直接截图问 ai, 根据他们的回答逐步解决问题, 期间会有一个弹窗提醒,选择允许访问,随后会来到这个界面,表明你成功完成了 openclock 的 本地安装。接下来我们还需要对 openclock 进行配置,按下键盘上的左右方向键,切换到 yes 回车,确认出石化模式,选择 quickstar ai 大 模型。这里支持使用 gpt、 mini max、 kimi、 豆包、火山引擎、阿里千问、百度千帆等。这是国内主流 ai 的 api, 使用费用大家可以自行选择。 这里以 kimi 为例,依次选择 kimi apikey, 点 c paste、 apikeynow, 然后打开浏览器,搜索 kimi 开放平台,确保账户有余额。点击 apikey 管理,新建 apikey 名称,输入 opencloud 项目,选择默认复制这串密钥,并粘贴到刚才的窗口即可。 如果你喜欢用豆包,就选择这个火山引擎 pass 的 api k, 然后进入火山引擎控制台,点击这里的 api k 管理,创建一个 api k, 粘贴到 power shell 窗口中,返回 timi 的 配置界面, 按下 enter 确认执行模型版本,选择默认的即可。这一步是配置通讯频道,我们选择最后一个 skip, 包括后面的配置,搜索引擎配置、 skills、 自动化脚本全部选择,暂时跳过,等跑通了再回来配置即可。 最后一步选择 opens web ui 系统,会自动调用浏览器,打开 opencloud 的 聊天窗口,如果小龙虾可以回复您消息,恭喜您完成了 opencloud 的 本地部署。下期视频我们具体了解小龙虾的使用方法。

2.0万从头学电脑

猜你喜欢

- 2742我懂了

最新视频

- 2618橘子TV