大家好,欢迎来到 ai 新闻早班车。大家好,今天咱们聊三件大事,每一件都可能彻底改变 ai 行业格局。先从英伟达开始。这家芯片巨头刚刚宣布了一个疯狂的计划,我听说他们要投两百六十亿美元做开源 ai 模型,这数字是不是太夸张了? 确实夸张,要知道 openai 训练 gdp 四花了三十亿美元,英伟达这次的投资几乎是它的九倍,而且这两百六十亿美元是在未来五年内投入,专门用来开发开源大模型 等等。英伟达不是卖芯片的吗?怎么突然要自己做模型了?这就叫卖铲子的自己下场挖金子。他们向 s e c 提交的文件里明确说了,要从芯片制造转型成全站式 ai 顶尖实验室,而且第一天就发布了新一代开源模型 nemoto、 sunsuper、 demonet super。 有 什么特别之处?它有一千两百八十亿参数,原生支持一百万 tocan 的 超长上下文窗口。最厉害的是它专门为多智能体系统设计,在 openclaw 控制测试中排名第一。关键是开源免费,成本比币源模型低太多了。 那英伟达图什么?做开源不赚钱吧?这就是战略布局,他们要通过开源模型,从底层定义 ai 技术路线,让自家的硬件架构成为行业标准。分析师预测,如果能在基础模型市场拿到百分之十的份额,三年内每年能多赚五百亿美元。 懂了,这是用开源模型拉动芯片需求。那第二件大事是什么?马斯克刚刚宣布,特斯拉、 optimus 三人形机器人今年夏天就要启动生产了。 真的假的?之前不是还在演示阶段吗?这次是真的量产。在富足峰会上,马斯克说, optimus 三已经进入研发最后阶段,是全球最先进的机器人,没有竞品能匹敌。具体有什么升级? 全身自由度从之前的三十个增加到四十五个,手部就有二十二个自由度,操作精度达到零点零二毫米,行走速度一点二米,每秒能载二十公斤,续航八到十小时,而且深度附用了特斯拉 f s d 的 端到端神经网络,听起来像是真正的工业级机器人了。成本呢? 目标成本控制在两万美元以内,也就是不到十四万人民币。初期产能爬坡会比较慢,但二零二七年夏季就能实现大规模量产。远期目标是在德克萨斯建年产一千万台的产线。 这要是成了,工厂里的重复性工作都要被机器人取代了吧。马斯克说,这不是为了裁员,而是把人类从枯燥工作中解放出来,转向更有创造性的工作,而且每个人类的产出会变得高到离谱。 有意思,那第三件大事呢?字节跳动的 cds 二点零彻底把 ai 视频生成带入了分钟时代, 我刷到了好多用这个工具做的视频,效果跟电影一样。没错,它最颠覆的地方是十五秒视频成本只要十五元,成功率超过百分之九十。 好莱坞导演用二十分钟六十美元就生成了一段一分二十四秒的真人电影预告片,效果堪比大片,这成本简直是断崖式下跌。传统特效五秒要三千元,现在只要三元, 对效率提升了一千倍。 cds 二点零支持文本、图片、视频、音频四种模态输入,能用艾特语法精确控制每个素材的作用。比如艾特图片一作为主角表演,艾特视频一中的舞蹈动作, 那岂不是连分镜师、动画师的工作都要被替代了?确实如此,影视巨峰的 team 评价说, cds 二点零就像个真人导演,自动改变摄影机位置和视角。现在版权争议也很大,迪士尼已经发函指控字节跳动盗用星球大战漫威角色,但这对普通创作者来说是大好事啊! 冯继说的最到位,当前地表最强的视频生成模型,没有之一。我很庆幸,至少今天的 cins 二点零来自中国,他让视频创作彻底去智能化,变成人人可及的日常表达。 今天这三件事连起来看, ai 行业正在发生根本性转变。从算力竞争到模型竞争,从实验室演示到工业化量产,从专业工具到大众屏权。 总结的太好了。英伟达用两百六十亿美元赌开原生态特斯拉,让人形机器人走进工厂。字节跳动把电影及视频塞进手机。这就是二零二六年的 ai 浪潮,来的比我们想象的都快。明天同一时间, ai 新闻早班车继续为你追踪最新动态,再见!再见!

粉丝4035获赞6313

相关视频

04:25查看AI文稿AI文稿

04:25查看AI文稿AI文稿哎,大家好,我来这个新加坡出差哦,觉得必须要赶快 这个发声一下,就是此节的 c dance 两点零,虽然出来才短短的几天,但是不只是中国的自媒体,我们看到在硅谷,在推特上越来越多的人惊叹于 中国多模态的这个能力。之前呢,其实去年整个硅谷已经达成共识,中国在多模态其实是可 open i 和谷歌。是啊,就是没有代际差,就是非常接近,特别像可灵的这个 api, 都是很多这个内容创作者非常 啊积极使用的。但是这一次呢,字节的 cds 两点零是第一次让中国的 ai 站在世界的前沿,因为虽然去年 deepsea 出来的时候,大家都非常惊艳啊,应该说它是把开源模型做到第一, 但是 deepsea 还是基于大模型的最高的水平的蒸馏,所以 deepsea 在 智能的水平上应该说还是一个 follow 的 模型。但是 cds 两点零现在在很多效果上已经让硅谷开始惊呼,中国开始领先,在东摩太开始领先, 所以这是中国的 ai 前所未有的这样的一个高度。回到,其实我今天为什么这么感慨呢?这几天智普这啊, mini max 都上市了,那大家也都知道,我们二三年就看了智普,也看了 mini max, 所以 又有很多投资人问我说, 为什么你不投,他们还持续增持了字节前三年呢,其实字节 ai 能力一直是相对比较弱,甚至尽管豆包它已经是中国第一了,但是豆包的智能呢,或者豆包的底层模型其实一直还是落后于 口碑,还落后于谷歌很多啊,那,那为什么我坚定的相信自己,而就持续的在加仓,我们累积的五轮字节,其实加起来成本都已经啊,成本都已经接近两亿美金了啊,持续我们是从 啊,总共持续七年这样的一个持续加长字节,那很重要的就是,其实我早在二零二三年我就看到了字节肯定是中国最强的 ai 大 模型公司。五二啊,那为什么我会有这样的一个认知呢?其实很简单, 嗯,我们大模型其实靠的是算力,但是更重要的是数据啊。字节其实在中国已经有接近两亿的内容创作者,所以他非常朴实,他是把很多长尾 大家的内容全部上传到字节上,所以字节对整个世界的理解是全世界无奇。二 大伟问,那麦塔呢?麦塔 insgram 也也有很多,这个也是有很多的视频,对吧?但是麦塔的 insgram 还没有中国,就是麦塔和谷歌在中国都没有视频的积累。大家知道中国有两亿内容创作者,这是全世界单一最大的内容经济体, 所以中国人很勤奋,他用内容来变现,以及他用内容来表达自己的人生,这样的数据 是全世界最稀缺的数据员。所以回到刚才我讲的这个逻辑,就是为什么二零二三年我不去投其他的大模型公司,而聚焦自己,持续看好自己。虽然二三年自己的 ai 走了弯路,二四年也不够经验,二五年 直到今天,我们终于看到字节让中国的 ai 第一次登上了世界的头号排位。所以不只是字节,我觉得整个内容创作的整个产业链, 接下来我们都会看到中国会在全球领先,而且呢中国模式会 copy 到全球。那你会看到可能中国的内容电商在东南亚现在已经是第二了,对吧?字节已经是东南亚第二了。那美国和日本在 follow 欧中呢?前两年没那么顺,但是我觉得长期也是很有潜力,他有这么好的在中国实践下的玩法,他把其实对他来说只是 copy 一下,然后本土化,对吧?我觉得这个趋势是必然的,他只是时间问题。

202倩姐投 AI 06:17查看AI文稿AI文稿

06:17查看AI文稿AI文稿这是我做的一个 ai 分 镜神器,可以很方便的生成这种九宫格分镜啊,甚至是二十五宫格也没问题啊。更厉害的是呢,它可以快速切割分镜,单独调整任意一格内容,然后再合并输出, 就可以很好的控制视频走向,节省了积分,也省了很多抽卡的时间啊。而且这么一个工具啊,前后我只花了三天左右就做完了啊,主要用到了迷你 max m 二点五搭配 cloud code, 整体感受这是相当的不错啊,不愧是 openroot 上调量最高的模型。 本期视频呢,我会先讲一下这个 ai 分 镜神器要怎么用,然后分享一下这个工具的一些开发过程,最后教大家怎么修改这个程序,以此来满足一些你的个性化需求。那这个 ai 分 镜助手呢,是开源免费的,需要先去设置里配置一下密钥,因为说到底呢,我们这个还是在调用 banana 的 接口嘛。那 目前我只适配了一个供应商,如果你有自己的一些渠道,那么就可以去看看后面这部分内容。用 mini max m 二点五搭配 cloud code, 快 速适配一个供应商,一个新的模型,那也是相当简单的。那在你配置好密钥之后呢,就可以新建项目,然后进入画布, 双击一下鼠标左键,可以看到有这些节点可以用。那最重要的就是这个分镜生成了,这里你可以快速设置要生成多少个分镜,然后只要在每个格子里写上内容描述就可以了。如果需要上传一些参考图片,那就从左边这个蓝点拖出来, 选择上传图片节点,然后上传图片就可以了,可以多弄几个,在风景格里输入艾特,可以快速引用图片,然后点击生成,静静等待结果就 ok 了。那选中输出的风景结果,点击切割啊,基本上不用做什么设置,直接点应用就可以了。那这样呢,我们就可以把每个格子都切割出来了, 在切割结果这里,你可以拖拽排序啊,如果需要单独修改某个分镜,只需要点击这个按钮,把它分离出来,然后拖拽右侧的蓝点,选择 ai 图片节点,你就可以用 ai 来编辑图片了。那等你觉得编辑好了,再把编辑后的图片的输出接入切割结果的输入,接着点击 分镜格右下角的这个图标,就可以快速替换了。那如果你要上传本地图片来替换,那只需要连接上一个上传图片节点就可以了。 调整好之后呢,点击合并导出啊,然后你就可以下载或者复制这个分镜。分镜的描述文本呢,也是可以选中分镜生成或者切割结果的节点之后直接复制出来的。当你理解了整个逻辑之后呢,就会发现这个流程还是非常方便的,希望这个工具能够帮到各位。 不难看出,这个 ai 分 镜助手其实还是挺复杂的,但是有了强大的 ai 模型之后呢,开发起来难度并不大啊。这里我是订阅了 mini max 的 coding plan, 选择了 plus 套餐,完全够用啊,然后把它接入到了这个 cloud code。 那 我最开始开发的时候啊,其实就是给 mini max m 二点五这么一段话, 以及这样的一个草图,用来确定大致的 ui 布局。那在确定了一些细节之后呢,他就直接开始调研分析了,那 mini max m 二点我在编程方面的提升还是很明显的啊,一些步骤的规划,工具的调用啊,即便你没有明说,他也会自主的去执行,哎,这才叫智能吧。那经过详细的调研分析,制定计划之后,就开始全自动编写代码了, 遇到报错也能自己解决啊,最后也是自动启动程序,把结果摆在了我的眼前,可以看到已经是有模有样了。那对于这样一个比较复杂的项目来说,不要指望着 ai 能一步到位啊,很 多细节还是要慢慢改的,比如说,我想用自定义的标题来让迷你 max m 二点五很快就可以搞定了,哎,这样就更像一个正儿八经的应用了。然后呢,我又让它添加了设置页面,用于配置 a p i 密钥啊,它也是能够准确理解并执行我的指令,来测试一下能够正确调用接口,生成图片了。哎, 这时候我是有点激动的啊,说明咱们这个大方向没有问题,但是现在这个节点和我想象的呢,不太一样啊,所以我就去找了一些,哎,参考,哎,所以你们看到这个界面有点眼熟也很正常啊。那然后最重要的就是说清楚需求,那这么一大段内容,就是要明确告诉 ai 我 想要什么,最终 mini max m 二点五给我的这个结果啊,这 很合我意啊,此时此刻,我也是很有信心了。然后呢,就是开发分镜,生成节点依旧是草图, u i, 参考依旧是详细的文本说明。 b max m 二点五同样也是自主决策,自 主规划,自主编码,我可太喜欢这种 ai 自动办事的感觉了,瞬间觉得这个 qing plan 买的很划算啊。最终这个结果呢,虽然和我想象的不太一样吧,但是大方向是对的哎,不必担心啊,咱们继续让它修改, 这样就合理多了。然后再调整一下,把布局从列表转为这种表格的样式,会更贴合要生成的分镜图效果。那测试结果也是很合我心意啊。后面呢,为了稳定分镜生成的效果,我还做了些优化。首先就是用 mini max m 二点五 单独生成一个测试页面,用于生成这种网格图片。那这让我惊喜的是,这个 mini max m 二点五对 skills 的 支持非常好啊,在没有明确说明的时候呢,也能自动调用对应的 skills, 最终的页面呢,也是一 点 ai 味儿都没有啊。虽然说这只是一个测试页面,但是有这样的结果还是很能说明模型的水平的。然后在正式开发的时候呢,就让 ai 去参考这个测试页面,这样就可以确保我的要求能够完美实现。 这样每次生成分镜的时候呢,就会自动传递这样一张网格图哎,生成的结果会稳定很多,不然可能就会是各种各样的边框了。那除此之外呢,还有很多很多的细节我就不坠出了。总之呢,我这两天也是在高强度的使用 mini max m 二点五啊,这个四十九的套餐呢,我可以说是相当相当的够用啊。 有了这么强的模型之后呢,你去修改这个程序也是非常简单的,配置好 mini max m 二点五,接着在这个项目文件夹里启动 cloud code 或者其他任何一个 ai 编程工具吧,然后说人话就可以了。你 给 ai 的 信息越清晰全面,那么它的效果也就越好。比如说我要让它适配一个新的接口,那么只要和 ai 说一声,然后把接口文档给他,哎,接着回车发送,哎,它就会自动调用对应的 skills, 哎,接下来你要做的就只有等待了啊,等 结束之后就可以去测试了,没问题的话万事大吉,有问题也不要慌,说清楚是哪里的问题,让 ai 修改就可以了。 那这次用下来我最大的感受就是 mini max m 二点五已经具备了从零搭建复杂项目的能力,最明显的一点就是它的 spec 能力,会先像架构师一样,把你的想法写成一份清晰的规格说明,再按这份蓝图推进实现。前期花时间多想一点,后面少返工,哎,结果也更稳定, 所以我也愿意多等一会。那以前总听说编程会是一个人人都掌握的技能啊,现在看来这句话说的还真没错啊,所以非常推荐各位去试试。那么好了,以上就是本期视频的全部内容了,如果喜欢的话不要忘点关注,我们下期再见!拜拜!

3802痕继痕迹 02:03查看AI文稿AI文稿

02:03查看AI文稿AI文稿全开源,不排队,不收一分钱,没有任何云端审核限制,别当冤大头花钱排队等 c 单四二点零,最近的 stabble diffusion, 直接把好莱坞级别的 ai 大 脑免费塞进了你自己的电脑里,一张消费级独立显卡就能把这台猛兽彻底私有化!这波极其霸道的掀桌子,直接把咱们普通人 ai 生成的五大碰点按在地上狠狠摩擦。听 到这,很多人心里肯定开始犯嘀咕,又免费又能本地跑,那效果肯定很拉胯吧?是不是那种满屏塑料感的工业垃圾?说实话,刚看到消息的时候我也是这么想的, 竟全网都在吹那些死贵死贵的大厂模型,便宜没好货算是咱们的共识。但是当我真真切切看到它跑出来的画面时,我只想喊一句,真香!它不仅不拉垮,甚至把以前咱们花大价钱买的那些付费模型打的啪啪作响。离 谱的是,这个工具既不用花钱,还能无限生成普通电脑呢,也能轻松傻瓜式操作,你只需要写上提示词,点一下生成按钮,这样的爆款作品分分钟生成。等期视频,干货满满,建议大家先收藏再观看。这个工具的出现直接把专业设计师的门槛给干碎了,无论 是学生、特效师,还是对 ai 有 兴趣的小白,都可以轻松学会。关键是这个工具完全免费,每个人都可以尽情的发挥创意灵感,新手直接无脑抄作业就好。那么本节课所用到的 ai 工具和各种 ai 实战案例都打包好放在网盘了,六六六抱走吧!那下载完整合包之后呢?我们先来解压一下安装包啊, 那直接右键解压在当前的文件夹,那这个文件夹不建议是中文啊,我们要全英文的路径。解压完整之后呢,现在不需要安装任何东西啊,我们找到第一个 粉色图标,双击打开启动器,就可以进入到启动器的界面啊,然后呢,左下角会有一个启动器的标识的一个版本,我们再点击一下一键启动按钮,因为是第一次启动,我们需要等几分钟来进行部署,稍微耐心等一下就好了, 然后我们就进入了 s g 的 操作界面,那如果说把它比作房子的话呢,只能算做毛坯房,因为我们只有一个模型,什么也做不了。 那么这个时候我已经帮大家整理好并放置了各类型最常用并且好用的模型安装包,并且把模型的中文备注以及预览图一起的整理打包好。只需要在 s g 的 操作界面呢,就能够看清模型的样图和中文的名称,就不会和别人一样,只显示一串英文代码,风格根本就分不清,看了就头大。

9黎呼呼呀 00:31查看AI文稿AI文稿

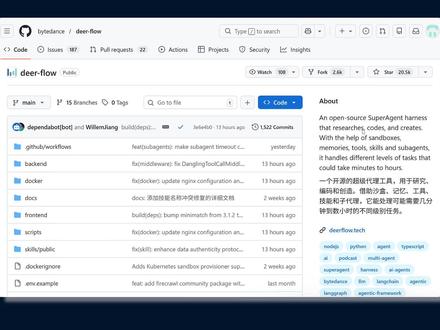

00:31查看AI文稿AI文稿他已拿下两万家新标字节跳动开源的深度研究家。多智能体框架 dear flow, 它不是一点零的升级版,而是从零开始的全新版本。它能帮你深度调研搜索网页、分析内容代码、执行、内容生成等几乎任何任务。 因为它内置了多智能体协助系统,能分工合作、并行执行,甚至能记忆你的偏好,让每一次请求更聪明高效。最关键的是,支持各种主流搜索引擎集成自定义工具和私有知识库,可以说是学习科研、自动化办公的全流程智能解决方案。

2041阿甘探AI 00:37查看AI文稿AI文稿

00:37查看AI文稿AI文稿如果我告诉你有一款开源软件,能把闭源的 cds、 二点零、香蕉等大模型和开源的 comfy 全部打通,还能直接连进 blend photoshop, 而且它完全免费。 top now 我 觉得是收费软件中做到最好的视频创作软件,我的目标就是超越它。整个软件呢,全程用 tree solo wipe coding 开发, 作为一个完全不懂代码的我,踩了很多坑,特别是性能问题,最终还是把它做出来了,它不完美,我会在接下来时间中不断的优化它,后面的视频我将进行功能演示,敬请期待。

02:40查看AI文稿AI文稿

02:40查看AI文稿AI文稿全开源,不排队,不收一分钱,没有任何云端审核限制,别当冤大头花钱排队等 cds 二点零了。最近的 stable diffusion 直接把好莱坞级别的 ai 大 脑免费塞进了你自己的电脑里, 一张消费级独立显卡就能把这台某兽彻底私有化。这波极其霸道的掀桌子,直接把咱们普通人 ai 生成的五大碰点按在地上狠狠摩擦。听到这,很多人心里肯定开始犯嘀咕,又免费又能本地跑,那效果肯定很拉胯吧?是不是那种满屏塑料感的工业垃圾? 说实话,刚看到消息的时候我也是这么想的,毕竟全网都在吹那些死贵死贵的大厂模型,便宜没好货算是咱们的共识。但是当我真真切切看到他跑出来的画面时,我只想喊一句,真香!他不仅不拉胯,甚至把以前咱们花大价钱买的那些付费模型 打的啪啪作响。为了方便大家学习教程附带的相关资料和学习案,我也给大家打包好放在网盘了, 敲六六六即可领取。下载完成之后,我们就会得到几个文件夹,那一般来说,我们选择这个压缩包的文件,右键把它解压一下,解压之后我们就会得到这样一个新的文件夹。当然,如果你的显卡是 emd 的, 那我们就解压这个里面的版本,如果不是这个就没有用了, 再点进去。开始之前我们还要把这个运行依赖双击安装一下,安装完成之后,现在我们是不是还剩下一个文件夹,就是这个 ctrl 了,那我们点进来再选到模型里面,直接一起选中 ctrl 加 c 或者 ctrl 加 x, 然后我们再回过来到刚刚解压完成的文件夹里面来,选到目录里面,然后这里有一个 config, 我 们直接 ctrl 加 v, 把所有的模型复制过来。好, ok, 那 接下来我们就可以直接启动了,再回到最开始这里来,点进刚刚这个文件夹, 往下面翻,这边有一个启动程序,我们直接双击就可以了。 这个安装包它的优势在哪里呢?就是你不需要去下载拍摄,也不需要自己再去配置环境变量了,跳过了一些复杂的流程,而且它在这里可以直接切换版本,也可以在这里去下载模型,安装扩展都是 ok 的。 好,我们可以点击一键启动, 启动成功之后就可以开始创作啦。这边可以选择对应的模型,输入对应的提示词,再点击生成,就可以开始生成你的第一张图片了。当然这些模型都是需要单独去下载的,大家也可以私信我,我都打包好啦。

575丝芙 03:01查看AI文稿AI文稿

03:01查看AI文稿AI文稿最近国产大模型 sims 更新从二月六号开始会读内测,预计本月十二号呢,能全量上线,还没有体验到的朋友也不必着急,可以先看看它本次都有哪些吸引人的亮点。首先是多模态参考,支持图片、视频、音频、 文本四种模态,一次性可以同时参考十二个文件。什么意思呢?就是在一个对话框中,我们既可以上传视频,还可以上传图片,还能上传音频, 直接一个对话,把音视频全部搞定。通过艾特图片或者视频的方式呢,调用你上传的文件,让图片作为我们视频生成的主体,让视频作为我们想要控制运镜的参考。对于普通人来说啊,什么推拉、摇移运镜,只要是你觉得这个视频效果好看的, 就可以参考使用复刻经典的剧情效果了。而且不仅支持视频参考,还可以一键 p 视频,支持 对视频元素的更替删减,增加风格转换,同时确保了整个主体的一致性。其他细节呢, 也都够保持不变。比如我参考最近热门的复古第一人称复古回忆视频,上传第一人称视角的图片,参考运镜视频, 然后把图片二三四换成参考视频中的上下左右场景,一个不需要剪辑的探索视频就生成了全新多模态参考,还支持风格特效。比如我上传一张自己的全身照,参考月神转场特效,把视频中的素人换成图片一中的女人 运镜参考视频,一女孩蹲下时,背后长出翅膀,翅膀挥动时略过镜头,实现转场。我们只需要简单的描述整个要参考的视频画面,他就能够生成丝滑的转场特效,对于小白用户真的是太友好了。 实现视频主体的一键替换,在此之前用 ai 做五大特效是比较难落地的。通过视频参考和运镜参考的方式, s 二点零多模态能够精准的参考视频中的五大动作,支持真人动漫 c 级风的五大参考,还能在打斗的过程中加入搏击特效,运动逻辑更加贴合真人运动。我上传的这个是绿幕素材, 建议大家在参考动作的时候尽量上传背景为纯绿色的动作视频,实现我们传统动捕功能,对于影视拍摄和游戏动作是非常实用的。 如果不会制作广告宣传片,这是根鸭绒,不会写广告文案,这是可爱鸭。可以参考短视频广告文案,这是能穿的极地可爱鸭,暖鸭绒羽绒服,只是替换了提示词,今年穿的暖,生活过的暖。还有这种汽车广告大片,我们只需要拍摄汽车的不同角度分镜 参考视频滤镜,就能一键复刻 cd 三二点零,对于文字主体的一致性理解非常强,节省了大量的剪辑时间。希望本期视频能够给大家带来灵感和参考,感谢观看!

37灵燚AI 00:50查看AI文稿AI文稿

00:50查看AI文稿AI文稿前面我们讲过 mars 二点零,今天我们来讲下开源世界的 mars open mars 号称三小时复刻核心功能,并且已经支持的 g i p o 强化学习微调。现在有很多的 mini 的 产品呢,喜欢弄邀请码和排队机制,但开源世界可不管这些, mini 的 团队基于 mini 的 框架,花了三个小时就复刻出了 mars 的 一些主要功能。并且呢,现在也引入了像 mars 二 l 和 g i p o 技术,能够让 a 的 自我进化。 它的原理和大部分的 ai 的 产品是一样的,就是通过一个指令,能够驱动多个 ai 的 协助区完成一个任务。你只需要在本地的部署 openbox 给他一个任务,他就能驱动多支你团队去完成你的任务。 openbox 这类产品呢,打破了 midi 的 封闭围墙,让更多的人能够免费体验到 ai 的 魅力,并且进行自己的 diy。 如果你懂一点拍摄的话, openbox 绝对是你能玩到的最酷的 ai 玩具,我是安迪,教你用 ai 解锁更多自由!

151AI酋长Andy 10:17查看AI文稿AI文稿

10:17查看AI文稿AI文稿只有一颗糖了,我应该自己吃还是应该送给他呢? 哦,真抱歉,我不是故意的, 一旦你跑呢? hello, 小 伙伴们大家好,那么今天开源社区可以说是一项非常重要的事啊,就是 ltx 二点零终于开源了,那么它是开源社区里边第一个支持真正的中文对话生成 这样一个视频模型啊。本来这个头衔应该是给到万象二点五的,但是结果就是,呃,他不开源了。那么现在开源社区第一个支持中文生成语音视频的这样一个模型,那就是 ltx 二点零了啊, 很很讽刺是吧?是个以色列的一个公司啊,人家做的模型实现了第一个开源社区的中文语音对话啊。 ok, 那 么这个模型呢?他是个一个十九 b 的 这样一个模型啊,他要求配置是比较高的。我先在这边跟大家说,我首先我本地的五零六零 t 十六 g 他 是跑不动啊, 他会报险存。那么另外一个好消息也是啊,就是我的五零九零 b 也很快要修好了,厂家那边呢,就是已经在测试了,因为问题比较简单啊,在测试了,没什么问题的话,应该这两天就给我发回来了,到时候就可以愉快的跑测试了。 好,那么它这个模型其实里边集成了一个 ve, 这个 ve 能解码这个音频,也能解码这个视频啊,那么它还需要一个 textencoder, textencoder 它用了一个十二 b 的 jama 三啊,用了一个十二 b 的 模型做做这个 textencoder, 这是非常庞大的,所以它是支持中文的哈,它是支持中文的,因为 jama 三它是支持中文的, 那么他这边的有几个功能啊?具体的来说下,第一个就是最简单的纹身视频纹身视频啊,第二个呢就是蒸馏版的纹身视频啊,第三个就是我们的图生视频啊, 还有就是我们的这个线稿控制视频生成,线稿控制视频生成,还有一个就是我们这个深度控制视频生成啊, ltx 二点零,这次可以说是他的野心非常大,而且做的准备非常全面,因为我们知道 ltx 之前 他一直是处于一个零点九七或者什么这个版本的一个状态啊,就说他的这个版本一直没有正式版的发布,那么直接出来就是一个二点零, 而且这次说实话效果我觉得非常不错,非常不错。那么我们就看一下这个工作流啊,工作流的 copy y 已经给提供了视力工作流,但是它是子图这么一个,呃,打包好的,那么我们需要把子图做一个解开哈, 啊,这些工作流呢,我都已经上传到 runninhabble 了,因为我在本地现在跑不动啊,所以说只能在跑的时候占的显存是超过二十四 g 的 哈,是超过二十四 g 的, ok, 我 们看一下他这个基本的一个工作流大概的一个分布哈,像我们这个工作流的纹身视频的工作流呢,就是这里加载我们的模型,对吧?包括我们这个 textencoder, 包括我们这个主模型, 还有呢,这里设置我们这个尺寸啊,尺寸他这边会做一个缩放啊,这个没关系啊,他后边会专门有一个什么呢?会有一个在细化和放大的啊,他还会有一套放大模型,很像浑源一点五的那个感觉,一点五的感觉 啊,他这次包括也发布了一整套的 lora, 包括运镜 lora, 包括蒸馏 lora 啊,包括一个细化 lora, 他 都发布了, 我们这边就画就是有一个细化的 lora。 ok, 那 么这里就正常输入我们提词词,用中文就可以了啊,他这个模型其实对的,对这个提词词要求是比较高的啊,不过官方给了这么一个提词词的一套规范啊, 一套说明在他的官方网页上啊,我到时候会把这个也给大家拿过来哈,就是一个视率啊,一个视率, ok, 那 我们接着讲这个工作流哈,然后呢,就没什么特殊的需要设置了,他能支持到幺零八零屁视频直接生成啊, 能直接生成幺零八零屁的视频,就是效果还是很惊艳的。幺零八零屁比七二零屁的话,他的质量还是好很多啊,特别是加了这个戏化模型以后啊,戏化 low 二以后啊, 同时他增配了很多这种呃,运镜模型,包括这个摇臂的,包括我们这个拉近拉远的这些啊,他这些基本的都有了,可以说准备很充分啊。 ok, 那 么普通版的这个纹身视频模型呢,就是没有蒸馏的呢,我们这边要设置成二十步啊 啊,设成二十步,这是专门的 comfy 新增了一个 l t x v 的 一个呃,调度器,这样一个哈,我们需要就是用这个来设置就可以了,其他的就没什么特别的一个东西了哈,它会分成两段儿采用。第一段儿呢,我们看看啊,它是把这块儿 这个输出呢,做一个基础的一个生成哈,基础的生成,那么还会有一个细化的步骤啊,还会有一个细化的步骤,那么第二步就是这里啊, sample, 我 们看这个标准的纹身图,纹身视频呢,他第一步是没有加载这个 蒸馏 ror 的 啊,没有加载这个蒸馏 ror, 那 么第二步才加载这个蒸馏 ror 啊,才加载了,就是说相当于有点像万向二点二的一个高噪模型和一个低噪模型这样一个区别啊,就是高噪负责生成基本的动态和光影,那么低噪去做一个细化强化哈, 那么直接生成这样一个幺零八零 p 的 视频,效果还是很不错的,特别是他带语音对话,对吧? ok, 我 们再来看看他这个蒸馏版的工作流啊,蒸馏版的工作流就是说可以直接加载我们蒸馏版的模型了哈,他会有一个模型四十 g 比较大啊,然后其他的呢?都是一样啊,都一样, 这里我还是跑的幺零二的幺幺零八零 p 的, 只不过呢,我们后边不需要再增加我们的这个。呃,那个蒸馏炉啊,我只增加了一个细节的啊,强化这个炉啊,得出来,我们看那个幺零八零 p 的 视频,精细度非常高啊,非常高啊, 这就是模型的一个好处,而且他速度其实挺快的啊,速度其实是不慢啊,不慢就说两段彩样,我们看一下,加在一起可能也就 两百秒左右啊。如果在 runnyhop 上用四十八 g 的 跑, ok, 我 们再来看看这个图上视频,图上视频我觉得他这个表现其实比较一般啊,只不过他能输出语音,能增加语音,就他动态什么的,还是也是有点慢动作的一个感觉啊, 或者半能座,我觉得它主要是针对这个纹身的话,纹身视频的 针对性多一些。为什么呢?因为之前 ltx 一 开始放它的视频模型时候,它就是要做一个导演类的模型啊,导演类的嘛,在这做运镜啊,做这种光影这种,它是比较偏向这方面的啊。 那么图层视频呢?就我感觉就相对差一些啊,相对差一些就是这个,这个我跑来视频会有点慢动作啊,其他的大家也可以自己试一试。那比较好玩的是他这两个,一个控制生视频啊,一个是线稿控制啊,一个是这个深度控制啊, 线杆控制呢,这里会有,他可以加载一张图片啊,相当于是图层视频了啊。这里的话,如果你想要加载图片的话,你需要把这个手针去做一个生成以后呢,然后把这两个点,把这两个给他打开啊, 如果把这两个关闭,那他就是正常的参考这个线稿图。然后呢去生成一段我们提示词写的这样一个视频了啊,是跟着提示词来的啊,得出来效果也非常好,非常自然啊,非常自然,包括这个角色这种形象非常好啊。 我们还有一个就是他这个深度控制,深度控制呢,我们可以看看啊,这边我是加载了原视频,然后通过这个尺寸缩放,然后再缩放以后呢,做了这样一个控制。他这边的话是专门需要一个深度生成模型的啊, 它跟我们的那个普通的那个深度不一样啊,它是专门需要一个生成模型的,这个模型要放在我们的 diffusion models 下边啊,这个反过来啊,它是个 unit 加载器,看到没有?它需要放在 diffusion models 下边,反而主模型放在 checkpoints 下边哈, 然后这里还有个 ve, ve 的 话,这个是对这个也是对它进行一个解码的啊,对这个图像进行一个解码的生成这个控制, 那么得出来的一个控制视频是这样的啊,那么我们再在这边写上对应的一个提示词,然后就能得出来这样的一段视频啊,他的清晰度是非常高的,我的清晰度是非常高的,就是说现在只是七二零 p 啊,他可以直接生成一个幺零八零 p 的, 那个清晰度是非常好的哈。 ok, 那 么简单就给大家聊一下啊,这几个工作流呢,我都已经上传到软件 app 上面了,全部都上传了,这五条全部上传了哈,就基本包含了他目前这些功能,当然大家也可以在你这个, 特别是在文绳和图绳视频上,可以再继续加载 roger, 加载这几个运镜, roger, 运镜 roger 也都上传了,也都上传好了哈。 ok, 咱们就给大家分享到这里啊,我很开心啊,这个模型其实效果非常棒,虽然他的配置要求有点高啊,正好赶上我的显卡还不在 那么就,但是我觉得在本地能用到这样一个模型啊,我觉得是非常非常好的,对吧?还是那句话,开源社区从来不缺好模型,好模型啊,你不开就有人会开啊。 ok, 那 么就给大家分享到这里啊,大家赶紧去玩一玩,试一试啊,真的很不错啊,速度又快啊。虽然它要求配置高,但是它速度是很快的,而且质量确实很棒啊,而且能生成中文语音对话,对吧?夫复何求? ok, 就 这样,拜拜。

06:53查看AI文稿AI文稿

06:53查看AI文稿AI文稿kimi 刚刚发的那个论文是彻底火了,不知道大家还记不记得,在一年前, deepsea 开源啊,然后英伟达一天之内蒸发了六千亿美元的市值,但是今天这次啊,直接轮到 kimi 了,那这篇论文呢,叫做 attention resilience, 那 么马斯克呢,看完之后直接发推点赞,而 open ai 的 推理模型之父 jerry 呢,更是直接惊呼说,我们应该重新考虑之前的一切,深度学习,二点零的时代即将到来, 那为什么他这么说呢?其实很简单,因为这篇论文呢,证明了在过去十年啊,所有的顶级的 ai 大 模型,其实啊,都建立在一个低效的地基上面,而 kimi 直接打破了这个地基,让 ai 对 算力的需求再一次的下降,而准确率却直接起飞, 绝对不是一个普通的论文发布。那今天这个视频,我尽量用每个人都听得懂的语言来给大家讲一讲。那要看懂 kimi 这篇论文到底有多牛,咱们首先得知道现在的 ai 大 模型到底出了什么问题,自从二零一五年开始啊,你听说过的所有的 ai, 其实啊,背后的神经网络都在用一种叫做残差连接的这么一个机制,听不懂没关系啊,我给你打个比方,大家知道啊,神经网络其实就像咱们的人的大脑一样,有很多层的神经,那每一个神经呢,都会接收信号,然后呢,处理之后,再把信号传到下一层的神经。 那残差连接呢,其实呢,就是一种深度的死板审批流。那比如说啊,网络有一百层,那第一层发现的时候呢,他就必须老老实实的传给第二层, 而第二层呢,就会加上自己的东西,然后再传给第三层,这样一路的叠加流转到第一百层,这种极其简单的输入,直接加到输出上面的逻辑啊,就陪伴了整个 ai 界整整十年。 但是啊,在这个大模型现在越做越深的时候,大家就发现啊,这种方式其实带来了两个致命的副作用。那第一个呢,就是信息的稀释,就像啊,你在一壶水里面泡了一片顶级的茶叶,然后呢,这个水啊,倒来倒去过了九十九个人的杯子,到最后一个人的嘴里,那你觉得他还有茶味吗? 这就导致啊,这个深层的网络根本就没有办法利用底层最原始的特征。而第二层啊,叫做隐藏状态爆炸,什么意思呢?就是为了防止这个信息被冲淡,后面的每一层啊,他都在拼命的放大自己的输出, 结果就是到了最后啊,整个模型的数据会无限的膨胀,就好比这个水压太高了,直接水管就炸掉了,它反应在这个千亿级的大模型的训练上面呢,就是梯度分布极其的不均匀,模型就极不稳定,甚至直接崩溃,所以这个几乎就是限制现在的大模型走向更深的一个物理学方面的魔咒。 而 kimi 的 这个论文呢,就直接把这件事情解决了,这就是他最天才的地方,用论文作者之一杜宇伦老师的话说,就是将注意力旋转了九十度,那这个猛一听呢,会觉得很诧异啊,这句话觉得有点奇怪,那注意力怎么旋转? 但是其实这句话真的非常的浪漫,而且还非常的硬核,因为 kimi 给他的每一层神经都搭建了一个智能筛选器。 什么意思呢?就是以前啊,每一层的神经都只能够合并一层信息,但是现在啊,每一层都会发出一个寻物启事, 去他前面的所有层里面去寻找相关的特征。你比如说啊,第五十层,他就可以给第二层分配零点八的超高的权重,他就可以直接越级的去提取最原始的特征,可以彻底的打败信息的稀释问题。 你看这是不是非常像扁平化的公司组织形式?但是这里啊,有一个巨大的工程辩论,就是你看大模型啊,动辄就几百层,那如果说每一层都去翻前面所有的层,那通信量就会瞬间爆炸,根本就没法训练,更别说最后的效果了。 那怎么样让这个天才的理论能跑得通呢?那 kimi 团队这次还设计了一个极其聪明的分块策略,他们把这个模型直接分成了几个大区,比如说每八层一个区, 在每个大区的内部呢,他会依然老老实实的去累加,然后总结出一个代表。但是在跨越这个大区的时候啊,他会启动这种大局的筛选调度,就是咱们刚才讲的这个东西,那这就会让他的这个内存的开销啊,就直接断崖式的下降,他的推理的延迟也只不过增加了不到百分之二。 所以有了这种设计呢,结果就是拿到了一个极其夸张的这个效果。你看在达到同样性能的情况下,他比传统的残差几乎可以节约百分之二十的计算量, 那你可能会觉得百分之二十也没多少,对吧?你完全想错了,你想一想啊,现在每一个这个 ai 公司要花几百万美元,还有上百人的 ai 团队去训练这个新模型,一般呢,这个新模型呢,也就比上代模型的能力提高个个位数的百分比而已。 而且啊,我们再算个账啊,现在最顶尖的大模型,每一次训练呢,动则就会用几万张瑞达的显卡,耗电量几乎就是一个小城市花费上亿美元。 而这百分之二十,就意味着直接省下了两三千万美金的真金白银。也就意味着你的训练周期甚至可以缩短几周到几个月。 更意味着啊,原来可能会崩溃,可能训练不下去的那种超大规模的模型,现在可以直接无比稳定的去收敛,而且更牛的是啊,因为有了这个更稳固的地基啊, kimi 他 自己实测了一下这个新的架构,在极其考验逻辑能力的 g p q a 这样的多步推理测试里面,它的性能啊,直接暴涨了七点五分, 代码能力也是巨大的提升。所以这篇论文出现之后啊,整个 ai 圈是直接炸了。那海外有一个资深的科技博主 toky 啊,他说出了大家的心声,他说 kimi 把 ai 运行成本大幅度的降低,而且还是免费开源,所以 ai 竞赛已经不再是中美之争,而是 b 源和开源之争,而 b 源正在输掉这场比赛。 说实话呀,这句话可能还是有点夸张,但是啊,从马斯克,从卡帕奇这样的点赞我们能看出来啊,这个大脑们啊,都在关注这个方向,因为这意味着更低的成本,还有更高的效率。而我自己看完这个论文呢,我最大的感慨是什么呢? 不是说哪一个技术指标有提升,而是说他有一种最硬核的底层创新。他狠狠地证明了中国的 ai 根本就不是一味的去追赶,而是穷则思变,想办法重新定义 ai 的 训练方向。 大家想一想啊,在过去的一两年里面,其实硅谷一直都在向全世界传递一种趋势,就是说你想搞 ai, 特别是 agi, 你 必须得拿几百亿美金去买几万块的英伟达的显卡,才能够大力出奇迹。但是,不管是一年前的 deepsea, 还是今天重写的十年参差逻辑的 kimi, 其实都在证明同一件事,那就是通往未来的路啊,它根本就不是只有暴力美学堆钱这一条路。 而且呢,你想想,中国团队,他不靠算力碾压,而是靠极其精妙的数学重构来超越对手,并且还大方的免费开源。在这种情况下,硅谷那种疯狂的堆叠算力,疯狂的建立极高资金壁垒的商业模式, 实际上是有巨大的、前所未有的挑战的。这就是这篇论文的原理背后的现实意义。那你觉得我讲明白了吗?评论区告诉我吧,我是 c 哥,如果对你有帮助,别忘了点赞关注,这对我非常重要。好了,咱们下期再见!

9287C哥聊科技