如何让OpenCL自动切换大模型

粉丝1077获赞1.0万

相关视频

13:53查看AI文稿AI文稿

13:53查看AI文稿AI文稿大家最近是不是被一个叫小龙虾 open cloud 的 智能体刷屏了,很想尝试一下,但是又听说会有很多技术问题,可能会解决不了。我找到一个对普通人来说最友好的使用方式,特别是替换大模型,十分友好,不会动不动就挂掉。 今天我教你一招,用 cherry studio 配合 opencloud, 直接白嫖各种大模型,整个过程可能会遇到一些坑,我都帮你踩过了,跟着做就行。首先打开浏览器,搜索 cherry studio, 找到官网,点进去看到下载按钮了吧, 选择 windows 版本点击下载,下载完之后呢,双击安装包,一路下一步就行了,没有什么特别的。 这里我安装的时候安装到了 d 盘,避免 c 盘太容易满,整个过程点击下一步就行了。 安装好之后点击运行, 现在就可以看到我们的设置这里的界面了,默认就有一个可以用的大模型,但是这个大模型不能用到 opencloud 里面, 但现在 charge 六是已经可以使用的了,那我们来给它增加一些大模型的提供商。 现在确认 charge 六是可以用的了,我们来增加一个大模型的提供商,叫做归机流动。 那归机流动的话,是可以通过我提供的一个邀请码来注册,之后会给你一定额度的算力。 这链接在这里啊,我会放到评论区,大家用这个链接直接打开浏览器就可以去注册了,他会自动帮你把我的邀请码填进去,看到邀请码了,然后用手机注册就可以了, 记得勾选我同意获取验证码。 用手机收到验证码之后填入,再点击登录就可以了, 点进点进去之后不用印,不用认证,直接打开 a p i 密钥,新建 a p i 密钥,随便填一个名字,我这里填了确 认,点击新建密钥之后点击复制,复制成功之后就可以去用了。 回到 trace studio, 把这个 api 密钥填进去,验证一下是不是能用 它。验证通过之后呢,就可以使用了,现在它变成一个勾啊,记得要把右上角的呃开关打开,这样话我们就可以在呃 opencloud 里面去使用了。那接下来我们去安装 node js, 下载之后点击下一步,下一步,下一步啊,这里还是要把它改为 d 盘,下一步,下一步啊,基本上就可以了, 这里的安装还没有什么问题。 那安装好之后我们用啊 win 加 x, 打开我们的命令行去测试一下,先输入 n o d e 杠 v, 看看有没有版本出版本号出来,再试一下 npm 杠 v, 看有没有版本号出来。如果这两个都有的话,就说明都是 j s 安装好了,但都是 j s 安装好之后还没完,我们需要去安装 opencloud, 那这个时候呢?呃,如果是直接点的话,它会找不到那个 note 截图,呃,你如果是 windows 系统的话,呃重启下电脑就好,它就能找到了。 那如果重启之后还呃安装不了的话,可能会遇到一些呃报错,那报错的话 可以看到我这里是有相应的一些报报错的。首先就是它会遇到另一个问题,是下载一个 git 的 一个库,它是用 啊 s s h key 的 方式去下载的,我又因为我们本身是没有这个 key 的, 所以它肯定是没有权限下载不了,我们需要手动把它给下载到本地,可以看到这里,我是手动用 git clone, 然后 把这一个 h d d p s 冒号双斜杠补全之后,把后面复制过来,然后就可以把它下载下来了。 下载了,下载完之后呢?呃,我们用一条命令行去把 opencloud 的 中文版下载下来,可以看到,呃,上面有一行是 n p m install 杠 g 青城 cloud opencloud 中文,然后 at least latest, 然后它就会转转转转转,然后会去下载并安装这个 opencloud 的 中文版, 这里会需要一点时间,它需要下载这个软件并安装,那当我们看到这样的一个界面的时候,就说明 opencloud 已经安装好了。 这个时候我们再回到 cherry studio 左上角的加号里面,看到 open cloud, 点进去看到已经安装好了,然后大模型也已已经可以选了。刚刚我们加了轨迹流动之后,我们加了 dips 是 可以用的了,直接启动的话,我们就会使用 dips 去 启动这个 open class。 小 龙虾,呃,除了 d c 之外,我们还可以回到我们的大模型提供商这里去看一下。轨迹流动提供了非常多的大模型可以让我们选择,包括一些付费的或者是免费的。呃, proof p r o 开头的话是需要充值才能用的,除此之外其他都能够免费使用。 呃,我们看一下有没有 kimi 的 moonshot, k 二, 我们找到它添加它目前国内的几大开源大模型的话,呃, kimi 的, 呃, k 二,还有 glm 啊,还有 minimax 啊,都是比较好的。我们找到了 moonshot, 我 们用 k 二, 然后回到我们的 open class 去找找,我们归机龙这边,这边就能找到 k 二了,直直接启动, 这需要一点时间啊。呃,进入之后呢可以看到,呃,之前我也启动过了,用了 gim 的, 但现在我们用了新的大模型之后。呃,再问问一问他现在是用什么大模型? 呃,小龙虾它是有记忆的啊,只要你安装使用过之前所有的记忆,它都能够在对话里面找到。 我们用一用一个 new 去新创建一个对话。我问他你现在是什么大模型,看看他的回答是不是我们用 kimi k 二。呃,可以看到它就是用了 kimi 的 k 二大模型,那说明我们这个大模型的使用已经正确了。 那我们如果是看到呃小龙虾是用英文来回答我们的话,都可以用呃一句呃大白话叫他用中文回复就行了,后面就全部都用中文回复。 那我们可以看到左边已经全部汉化了,如果是官方的话,左边都是英文啊。现在汉化版的话,我们就可以比较方便的去使用这个小龙虾。 呃,一般的设置的话都不用怎么管,可能需要安装的就是技能,技能也不用我们手动装,我们呃用自然语言告诉他安装就行了。 那除了呃轨迹联动,我们也还可以用智普的 g 二 m 四点七。 那这一个怎么用呢?我们也可以回到我们的 qs studio, 找到智普开放平台,点击这个链接,它就会自动帮我们跳到啊智普的开放呃平台,我们 去那里呃注册一个号,然后获取它的 api key 就 可以使用了。这里我已经之前已经获取过了,直接啊把它打开就能够在我们的呃 cloud 里面去使用了, 可以看到这里,我打开之后呢啊,已经可以选择啊 g r m 四点七啊,智普开放屏的 g r m 四点七现在是最新的大模型 啊,我们选择 g r m 四点七,然后再启动, 这个时候看看我们的小龙虾是不是能够把大模型从 k 二切换到 g r m 四点七。 我们先看看他现在默认的是哪一个大模型,你现在是什么大模型? 好,他现在还是 k 二,那是不是我们就没办法用了呢?我们再看一看,这个时候遇到问题怎么办? 遇到问题不要慌,我们直接问问一问他怎么回事,你现在配置了哪些大模型, 我们看看他有什什么配置。那现在他有一个列表,我们有非常多的大模型可以选用,默认的就是 g r m 四点七。 那我们现在要使用 g m 四点七怎么办?看看它已经都有已经配置好了,我们只要做一个切换就行了。目前我们用 k 二,我让小龙虾帮我切换到默认的大模型, 它就会帮我们切切换到 g m 四点七了。那最后我们再确认一下现在用的是哪一个大模型, 可以看到现在已经切换回 g l m 四点七了,这还是比较方便的, 如果不用 choice studio 的 话,我们要手动去设置那些配置文件,还非常容易设置错啊。我们看到有 dipstick 也是可以用的,现在让小龙虾帮我切换到 dipstick v 三点二啊,它就能够把我们切换到 deep six v 三点二了。 好,整个过程就是这么简单啊,祝大家玩的开心,有什么问题的话请留言我啊。

177东波哥说 05:15查看AI文稿AI文稿

05:15查看AI文稿AI文稿没想到啊,距离我制作 open klo 的 详细部署教程已经过去了一个多月,这玩意现在居然火成这个样子,甚至某鱼上都冒出了一堆远程部署的这个付费服务,动不动就收你们几百块钱。我在我那期视频发布之后呢,有的观众也在吐槽模型费用太贵了,那有什么办法能够不花这个模型钱呢? 有的兄弟们,有的本期视频的主题就手把手带你们部署一个属于你自己的大模型,并教会你如何在 open klo 中切换大模型的大模型啊! 不管你是使用像欧拉玛呀还是 l m studio 还是 v o i m 等,都能很方便的接入,从而实现完全离线免费无限制用的 open 可乐。好废话不多说啊,记得先点赞收藏加关注。我们现在开始 我整个教程会分成两大步啊,先搞定本地的大模型部署,再讲欧布可乐的对接配置。但如果你已经部署了本地的大模型,可以直接拖动进度条是吧?跳到对接部分即可。第一步,咱们先搞定本地大模型的部署啊,我这边推荐没有经验的同学优先使用欧拉玛,他几乎是目前全网最简单的本地大模型部署工具,没有之一 啊,支持一键部署市面上绝大多数的一些开源模型啊。然后这里插一水,如果你想要工业级大模型的推理框架 v l l m 的 教程,可以在弹幕当中扣个一人多的话,我后续考虑出个教程。 首先打开浏览器啊,输入欧拉玛的官方地址,我放评论区了,就直接复制在那些就可以。进来之后呢,你是什么系统就点对应的下载是吧? windows 点 windows 麦个点麦个, 下载完成之后呢,麦个就跟安装其他软件一样是吧?然后 windows 也是不断的下一步即可。 好,现在安装完欧拉玛后呢,最关键的一步就是下载并启动本地的大模型。这里要跟大家说清楚,要驱动 open close 这样的 a 卷的系统, 必须选指令遵循度强,上下文长度多的模型,简单来说就是听得懂指挥是吧?记得住你的命令的这种模型。而我这边测试了好几个模型,比较推荐用的就是这个 q 三点五,它有多个尺寸的版本,通常模型越大则性能越强,大家根据自己电脑的显存大小来选就可以了, 最好选不要超过你显存大小容量的模型,也就是 size。 这里我这为了快速演示,我这就使用这个零点八 b 这个小模型展示啊。如果你们有测试更好用的模型,也可以在评论区跟大家分享一下。 确定好模型之后呢,点进去之后,可以直接看到下载模型的指令,此时我们需要打开终端或者这个 power 键麦克打开终端, windows 打开 power 键,然后粘贴这串命令,然后按回车,它会自动下载模型并启动,全程不用你管。经过一段时间下载后呢,它会自动进入对话界面,你可以直接在这跟本地大模型对话,比如说问他,你好。 哎,到这里恭喜你,你已经成功完成了本地大模型的部署。接下来就是将其接入我们的 openclo 中了啊。这里先提一嘴,如果你的电脑还没安装 openclo, 可以 直接去我之前的其零基础啊部署教程,几分钟就能安装好。我这就不重复讲安装步骤了, 我们先讲刚装好的欧拉玛怎么对接。第一步,修改模型的上下文长度。因为欧拉玛本身为了极致的轻量化,如果你电脑显存不大的话,他默认模型的上下文就给你四 k, 你 就这样给 open color 使用的话,你说完这句话他就能忘了上一句。所以我建议把模型的这个上下文设置为至少六十四 k 以上吧。 我们打开这个欧拉玛的软件,然后点击设置,就在这里设置上下文,然后把这个拖到六十四 k 就 可以了。第二步,去 open clone 里做这个配置对接,还是在终端输入这个 open clone config, 进入 open clone 的 配置菜单,然后回车啊配置本地文件,选择 models。 这里呢是 opencolor 给你预设的一些云端模型配置,像什么啊, gpt 啊, jimmy 等等。我们要选择最下方的 custom provide 的 选项,这个呢是自定义模型选项,可以自定义 opencolor 从什么地址去调用模型的服务。而我们这里默认就是幺二七点零点零点幺,这个幺幺四三四端口的 我们不需要修改。然后这里的幺二七点零点零点幺呢,表示从你本地获取。然后这里的幺幺四三四呢,是欧拉玛的这个端口服务,然后再回车输入密钥,这个地方呢可以随便填,因为这是你本地的服务。 然后这里询问我们要接入什么标准的端点协议,我们也默认回车即可。最关键的来了这里,让输入模型的 id, 我 们在这里输入你刚刚下载的模型名称,然后这个样子就是教验,通过回车啊,后面的这些都不用,输入,回车即可。 然后最后选择最下方的这个 ctrl 钮,完成模型的切换。现在你可以回到 openclip 的 控制面板当中,点击代理,看到这个 primary model 是 不是你刚刚选择的模型了。至此,你已经成功在 openclip 当中揭露了本地的大模型。 如果你使用的是 l m studio 或者 v l m 等模型推理框架,步骤跟刚刚几乎没什么差别,只需要将这里的电路地址修改为你所对应架构开放出来的端口即可。比如说像这个 l m studio, 它默认的端口就是一二三四,你这里就写啊,幺二七点零点零点幺一二三四就可以了, 然后 vm 呢则是八千,然后你就把这个端口修改成八千即可。后面的步骤和欧拉玛一模一样是不是?嘎嘎简单?所以我们来 open call 聊天框简单的测试一下,就说帮我查一下北京明天的天气, 哎,如果你的任务比较简单,那是用本地大模型来驱动这个 open call 还是非常 nice 的。 最后本期视频用的所有命令和部署流程我都整理好了,放在这个评论区,大家点赞关注智取即可。 然后上期的这个部署教程和 open klo 的 这个 skill 制作教程我都会放到 open klo 的 合集里头,后续呢也还会更新 open klo 的 其他玩法,不想错过的朋友可以点个收藏和关注啊,咱们下期视频见!

1630算法魔法师 05:03查看AI文稿AI文稿

05:03查看AI文稿AI文稿哈喽,大家好,这期视频主要讲一下阿里百炼模型的自动切换的问题,之前有网友说百炼模型比较容易用光,单个,单个切换非常麻烦,那么这个视频里面我们介绍了怎么去把百炼模型多个模型同时写固配置文件,这样避免出现每次应用中出现切换的问题。这是我们 现在之前的 opencore 的 配置文件。我们首先看到在 opencore 的 配置文件里面有一个 models, 这个就是选择到模型,然后这里面有一个模式是 merge, 这个 merge 就 表示是合并啊,可以合并的意思 or widers, 就是 指现在我们这个模型的提供商,我们看到现在这个提供商这里有一个 blend 摆列啊,摆列就摆列,然后这里有一个摆列,下面有一个括号啊,它就对应着 这一些内容啊,它对应的这些内容,那么我们其实只要再加一个其他的 这样的一个模型的名称就可以了,那么这个模型的名称呢?我们还可以,就是还是用白练啊。嗯,其实很简单,就是这里,从这里我们把它 copy 一下。 copy 到哪呢? copy 到这个地方啊,这个你要对齐啊,就是这里有一个方括号,对吧?我们看到这里这里模式这里有一个方括号, mod 这有个方括号,那么这个方括号中间都是,中间都是。 呃,这个括号呢?都是一对一的啊,这个方括号是跟这个匹配的,是吧?那么这个方括号呢?它就应该跟这个匹配,也就是这个方括号是到了这个模式这里 mod 这里是吧? 那么这个大括号它就应该是对的方括号的下面这个括号 这个对齐了吧,那么这个摆链的这个第一个模型就应该是对到这个位置上的大括号,好在这个大括号这个位置我们加一个 模型就可以了,用一个小的分号,然后再往下加这个模型,那么我们先加的时候呢,我们可以把它先拷贝出来, 然后黏贴啊,这个里面就是我们这里是百炼,是吧第一个模型,那么我们在这里可以写百炼二第二个模型, 然后这个东西是不变的啊,这个 key 也不变的,这两个都不变,然后我们要做的就是把这个 id 给换掉就可以了,那么我们可以去查百炼的 这个模型的本身的这样的一个列表啊, 我们看到百炼模型本身的列表啊,我们找一个, 比如说天文 plus, 我 现在这个模型它是有的,我就把这个改成天文 plus 就 可以了, 改成天文 plus 就 可以了啊,然后,嗯, 我们在这个 agent 下面啊这里,然后大家要注意我这个写法啊,一定要写成数组的形式。我们前面我做实验的时候呢,有两个问题,第一个就是 four four bags, 忘了加 s, 还有一个就是没有写成数组的形式,所以大家一定要参照我的数组形式的写法仔细看一下, 然后我们用同样的方法再加一个哈,这样就有三个不同的模型类别在上面,后面根据你的需要可以加任何任意多个, ok, 这期视频就到这里啊,如果大家觉得有帮助,别忘了点赞加关注支持,感谢大家,我们下次见 哦,等等我们可能再验证一下,然后,嗯,我们打开 open core 的 对话窗,我们再验证一下,确认没问题啊,应该是没问题的。好,我们下次见。

76技术分享的巴顿 01:26查看AI文稿AI文稿

01:26查看AI文稿AI文稿首先我们打开 deepsafe 官网,然后选择 epi 开放平台,这时会让你登录,登录后就进入了控制台,然后点击左方的 api keys, 这时候我们点击创建 api key 名称,随便输入一个就行,用来自己进行识别判断的。完成后一定要保存好这个 api, 因为后续无法再看到丢失了,就只能重新新建一个,不过不影响任何使用,倒也不用担心太多。替换的模型配置有两种办法, 第一种是修改配置文件 opencloak, 点 jn 森,但这种方式对于普通用户太过于复杂,可能会改的也不会看我这个视频了, 我们直接说第二种,打开终端,在终端输入 opencloak config, 选择 local, 选择 model, 选择 custom provider api base url, 填 deepseek 的 接口地址 h t p s 冒号斜杠斜杠 a p i 点 d e e p s e k 点 com 斜杠 v 幺, 回车后进行 api key 的 填写,输入你的 ipi key, 回车后选择第一个 openai 的 选项,这时候会让你填写模型的 id, deepsafe 官方现在开放了两个 id, deepsafe chat 和 deepsafe reasoner, 具体区别大家可以暂停看一下,这里我们选择 deepsafe chat 就 够用了。 显示 verification successful 表示成功了,否则就表示有一步没对,后续的两个东西都直接回车即可。最后我们选择 continue 就 完成配置了,最后在命令行重启 openclaw 即可。

326怪大叔 06:36查看AI文稿AI文稿

06:36查看AI文稿AI文稿欢迎收看我是大叔,只跟你聊最实在、最有用、最有意思的内容。好,我们来看一下 ai playground 的 功能介绍。第一个是历史展示,然后应用设置,还有一个中间的一个聊天窗口, 先看一下它的设置,配置设置像有一个语言的切换,还有个主题的切换,大家可以根据自己的喜欢切换不同的主题。 另外一个还有一个是镜像源地址的配置,大家可以根据,呃,如果是国内用户的话,可以根据跟我配的这个地址是一样的。另外一个这边是展示 后台的一个运行状态,那主要程序的话是就是这个 ai playground。 另外一个就是模型的运行工具,就是朗玛 c p p 的 运行工具, 然后这个可以不需要勾上,这个是音频转文本的功能。 还有一个是模型加载,这个最好是勾上,因为在切换模型的时候它不会释放掉上一个模型。 然后还有一个是开发者控制台,这个是启动时候它会默认开启。另外一个是呃管理后端的一个组建, 这边主要是用来做重启后端服务的,如果有修改配置,这边要点一下重启。 好,我们再来看一下这个窗口的功能,这边主要一个功能就是一个切换的模式,聊天模式切换, 这边是发送,然后这边的话是设置,咱们每次聊天的时候采用了一些模型,那模型的分类功能,模型的功能它只会分为这几种, 一个是基本的聊天,然后还有一个是推理,一个是图片,另外一个是 a j。 还有一个是这边我们要注意一点,就是我们如果使用这个 g c c u f 的 g c c u f 格式的话,它会列出来你使用到了那个显卡设备是否在这里面,如果有的话,我们正常这边是可以看到我们自己的显卡的,那我们的显卡是一个英特的显卡,那这样子就能 呃识别到我们这个显卡,就可以调用到我们的英特尔显卡。 还有这个是模型的选择,模型选择的话,它默认的话,如果你选择的是基本聊天配置的话,就基本上就是呃要选择对应的这些模型进行做添加, 添加部分的话是在这个地方,那这个地方的话要选择对应的我们的这个模型的一个地址, 现在我们把模型地址和镜像地址改成这个, 然后点一下验证记,记得还要点一下这个重启,点一下确定好,等这边它重启完就可以了。好,关掉, 再拉到这边选择这个 s 的 选,选择添加 这个地址添加进去,这个地址一定要按照它的格式来命名空间一个, 命名空间一个,然后再加上仓库地址,仓库名称运营空间,仓库名称文件路径 点,添加我这边的话,我这个模型已经本地已经有了,然后如果你那边在操作的时候,它会跳到下载,自动下载,等待下载完成就可以了,现在模型就下载完了。 这边是对模型的一个参数进行调整,这个有一个温度 temperature, 建议调成零点八上,下文调成三十二 k。 好, 那我们来测试一下模型, 好会先导入模型,等待一会儿 好,模型已经正常工作了,这样子我们基本上大功告成了, 接下来再跟大家介绍一下这里面的开发工具,选择网络我们可以查看到接口的一个地址,把它复制下来, 在这边输入我们的设置的地址,然后加上 b e 模型,这样子我们就可以查看到目前可用的模型。 模型 id 这部分是可以直接配到我们的 open crop 里面的,也可以直接使用 ai pixel, 跟大家介绍差不多了。如果本期视频对大家有帮助,请点赞加关注,如果有什么问题可以在评论区留言,谢谢大家观看!

4大书大 03:08查看AI文稿AI文稿

03:08查看AI文稿AI文稿cloud bot 究极进化, open cloud。 听说你把 cloud bot 装在了 mac 上,平时就专门买了个 mac mini。 这样的好处是啊,极致省电,自带 skills, 直接用。缺点就是苹果的设备太贵了,最新的丐版也要快四千,这价格都能直接买个新手机了。没必要。你要是实在心痒要忍不住。记住要买最新的 m 四 芯片,别买英特尔。听我这么一劝,你可能就把谷歌当成了 a p p, 开箱即用,而且还有傻瓜式文档,并支持各大主流聊天软件。但这里有个硬伤,云厂商默认提供的都是自家的模型, 你想切模型?不好意思, model set a field。 不 过别担心,我后面会提供解决方案。云服务器不是白给的,你要为存储为流量掏钱,而且数据都在云端,全靠文件,还要受限于服务器的公网贷宽。我强烈推荐的方式是用虚机或者吃灰的旧电脑 操作系统选误班图,好处是充分利旧,不用为设备额外花钱。除了应用模型啊,数据都在本地,本地配置和云端配置是通吃的。哪怕你买了云服务器,我也可以教你任意切 款模型安装过程就不用我教了吧,一句客命令,三分钟完事,重点是选哪个 provider。 阿图强烈推荐 openroot 最省心省力,不用瞎折腾。没有 openroot 的, 直接去注册个账户,再充个五到二,支持国内的支付工具。模型的话首推 mini max 二点一国产模型速度快,比 sunet 四点五便宜十倍,效果还不错, 重度氪金玩家请勿呢。选择地表最强 offs, 四点五聊天的话没必要开浏览器哈,无论你装的系统有没有桌面,你就 call the bot t u i m 的 就可以直接开聊。你说廉价模型玩腻了,想切个 offs 四点五奢侈一下,可 model 就是 切不动。恭喜你,踩到了他的大坑,我来把你拽出来。想自由切模型,得盯住 call the bot 点 jason 这个 文件,只需要关注一个配置,像 agent 点 models, 这是个白名单,只要你切的模型不在这里面,就会报错。解决方案很简单,要么把 agent 点 models 直 删除,要么把你的目标模型加到这个白名单里就好了。以 kimi 刚发布的 k 二点五为例,前几天 cloud bot 还没更新,但我已经通过添加自定义模型的方式提现,在 cloud bot 里用上了有可能的配置,在下方记得截图,按照我的格式配就行了。 添加完毕后,不需要重启 get 位服务,只需要在对话框中先创建新对话,再选择我们刚配的模型就好了。这里还有一个坑,那就是 cloud bot 中模型的命名,它用的是 provider 正斜杠 model id 这样的方式。前面我选的 provider 是 open loder, 那 么在选模型的时候就要以 open loder 开头,比如你要切到 open 四点五,就要用 open loder astropic cloud ops 点五。我刚才配 k 二点五的时候, proverb 写的是 custom, 就 要用 custom motion ai k me k 二点五搞完模型啊,配聊天软件是最简单的,直接让 clubbot 帮你就行了。最后来看见 clubbot 的 star 数已经从周一的二十 k 涨到了现在的一百二十 k, 这应该是打破多个记录了。项目的创始人 ps 也是个传奇,他早年写了个 ps pdf 软件,然后直接爆火了,你说这是偶然运气?可在 clubbot 之前,他已经写过 n 多个软件了。那句话叫啥嘞? 发起对生命的撞击,你得多撞击一下才能撞出来东西。很多人说这是一场 hype, 是 营销炒作,但各个大厂的收入是实打实的,为何 mini 的 销量再创新高?各大云厂商的 koop 专用服务器光速上线,各家模型的 koop 消耗量必将迎来一波上涨。巨神智能还未到来,但我们首先通过 koop 看到了 agent 操作电脑的另一种可能,后续肯定会有更好玩的东西出来,我们拭目以待。关注我,下期讲解二月六日,人类重返月球,一个星际文明五十四年的等待。

15阿图同学 02:42查看AI文稿AI文稿

02:42查看AI文稿AI文稿我看很多人说自己的 open core 网关总是容易掉啊,其实最主要的原因是你给他配的模型配的太少了,因为 open core 他 要工作的话,他必须得要有模型调用的, 就好像你手机要用是必须联网的一样。所以你给他多配几个模型, 他这个模型用不了,他就会自己切换到,你给他调度协议让他切换到另一个那个模型去就可以了。我和大家分,我给大家看一下我现在给我的二瓶可乐配的那个模型啊, 我刚刚我是给他配了三个模型,然后我让他做了一下测试。嗯,他给我的建议就是主力的用,嗯,谷歌的,这个 谷歌的,然后备选 deepsea 官方的,然后这个不是免费的硅基流动,这后面这两个不是流动的,但因为硅基流动是聚合平台嘛,它就 给我是这样的建议啊,所以你如果有这个问题的话,你也给他多配几个。还有就是最好不要贪那个便宜说, 呃,买那些第三方超便,超级便宜或者免费的。老实说,现在的这个大模型的算力,他就是像电和 和水一样,你看现在哪里有免费的电和水给你用吗?没有的,都是需要有一定付费的 啊。我的这个谷歌的这个是他们官方就有免费的额度,所以我要用他做主力模型,费用肯定基本上没什么费用的。然后, 呃,并不受官方我都是花钱买的, 所以你这样配置的话肯定就不会掉的。而且最稳的肯定就是这种官方的。第三方的接口的话可能是不那么稳,但你选那种相对比较大的第三方也是不错的, 所以你网关容易掉的问题,其实这样解决就 ok 了。

04:11查看AI文稿AI文稿

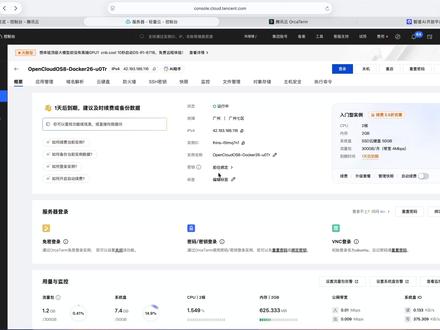

04:11查看AI文稿AI文稿好,接下来呢,我们通过这一个腾讯云的服务器来完成这一个 open core 的 初步化,那现在我们看到服务器的这一个状态,它是正在运行中的一个状态,我们接着切换回来我们的这一个服务器的一个界面。 好,那回到这里面,我们可以看到这一个图标就变成一个小龙虾的图标,我们在这里面可以点击这一个登录。好,我们在这里面选择的是默认免密登录的方式,那如果说你有一些终端的连接工具,你也可以使用这个 finalize 去连接。好,那我们直接采用这一个免密的方式直接完成登录就可以了。 好,那进入到这里面之后,我们可以看到这一个地方,它会提示你输入对应的一些命令,那我们在这里面就直接输入 open crop bot u a r d, 我 们就开始来粗死化这一个 open call。 好, 那在这里面他会问你是否要继续执行,那我们在这里面选择 yes, 那 就按左箭头。 yes, 在 这里面我们选择第一个 kirsty, 默认的按回车,接着我们在这里面选择第一个。好,那到了这一个界面,这里是让你选择这一个模型的一个提供方, 如果说你有 open ai 的 这一个 open ai key, 那 你可以直接使用这个 a p i key, 那 如果没有,那我们也可以选择我们国内的,比如说像这一个智普 ai, 那 包括千问,还有这一个 minimax 这些, 那我们在这里面就选择这一个智普 ai, 那 如果说你都没有,那在这里面你要去申请一下,那申请的这一个直接可以打开这一个 big model, 在 这一个网址下面去申请对应的 api key, 我 们把这一个申请完之后,这里面添加 api key, 在 这里面复制这一个,好, 回到我们的这一个界面,接着我们在这一个地方按回车。好,那下面他会问你你用的是哪一个?那我们在这里面我们就直接使用的是 这一个 coding plan, 我 选的是第二个。在这个地方他会让你去把你的这一个 key 直接写到这里面来,他会帮你保存到他的这一个 opencloud 的 配置文件里面,那我们在这里面直接按回车,把我们刚才的这一个 key 复制过来。好,接着我们按回车。 好,那做完这一步之后,我们在下面你可以去选择对应的这一个模型,目前它选择是 g l m 五。那我们在这里面我们可以选择,比如说这一个四点七的 fresh 的 这一个。好,那 在这里面选择这一个。好,做完这一步之后,我们就进入到下一步。那下一步问你要不要选择对应的这一个频道,比如说你要接入 qq 还是接入飞书等等。那这一步我们放到后面再来执行,因为它的配置步骤会比较多,所以我们在这里面选择直接进入到 skip now 最下面这一个,按下箭头,选择这一个 按回车。好,到了这一步之后他会问你是不是要配置这一个技能,那我们就直接选 no, 好,到这一步之后,他会问你要不要安装对应的这一个 hooks, 那 在这里面我们可以把这一个命令行的日制,还有这一个记忆可以选中, 那在下面我们找到它按回车,不是按空格键,在这里面我们就把它选中下面的这两个,我们可以在这个地方再按回车。好,做完这一步之后的话,它会提示你,你的这一个 gay service 它已经是 安装了,那你要做的事情是什么?重启就可以了。好,接着的话他会把这一个 gay service 重新进行启动。好,那我这一步问你要用什么样的一个界面来打开,那我们选择第一个这个地方就可以了。 好,那我们按回车。好,接着大家可以看到这里面他会有一句提示的话语,在这里面,在下面这一个地方我们就可以输对应的一些信息,那我们在这里面,比如说, 哈喽,好,接下来大家可以看到在这里面会有对应的一些信息给你发布出来,那就代表我们在这里面已经可以去使用到他了。那后面我们就可以在这里面去跟他交流,去写一些对应的内容。比如说老师,在这里面我去写一个内容,比如说你,好,我 现在正在使用什么大模型。好,接着大家可以看到在这里面它会提示我们使用的是这一个智普的 ai 的 大模型,直接可以帮你来处理。好。到了这一步,我们整个 openclock 在 腾讯云这一个服务器上就已经安装完。

03:05查看AI文稿AI文稿

03:05查看AI文稿AI文稿大家好,我是住在 una 家 mac mini 里的小龙虾 mini joe, 今天教你三招,让龙虾二十四小时在线。很多人装好龙虾用了几天就遇到问题, 电脑重启后龙虾不见了,就像闹钟没响,模型突然限流卡住了,就像钥匙打不开门,半夜掉线,早上才发现,就像没人体检。今天教你三招彻底解决。第一招是设置闹钟,就像你给手机设闹钟,让龙虾在电脑开机时自动醒来。 mac 用系统服务、 windows 用任务计划都很简单, mac 用户最简单,打开终端,第一行,输入 opencloud daemon install, 把龙虾注册成系统服务。第二行,输入 opencloud daemon start, 启动它以后,每次开机闹钟就会响,龙虾自动醒来。 windows 用户用任务计划程序搜索,打开它,创建一个基本任务触发器,选登录时操作,填 opencloud gateway start, 这样每次登录 windows, 闹钟就会响,龙虾自动启动。 第二招是准备用钥匙,就像你家门有主钥匙和备用钥匙,龙虾也需要多个模型,主模型限流了,马上换备用的,节点不稳定,换个稳定的,想省钱换个便宜的。 怎么给龙虾添加新钥匙呢?第一步,打开钥匙柜,在终端输入 openclo comfort edit, 会打开配置文件,找到 pliders 这一段,这就是钥匙柜。 第二步,把钥匙放进柜子,这是真实配置案例。 timi 用粤支暗面官方接口, minimax 用官方接口 cloud, 可以 通过中转节点。注意 appix 要保密,这里用省略号代替。保存后,钥匙柜里就多了这些新钥匙。 第三步,告诉龙虾用拿把钥匙临时换,在聊天里输入斜杠 model 永久换,用 comforge set 命令。如果你有多只龙虾,还可以给每只配不同的钥匙,比如 mini, 专门用 minimax。 这里有个重要概念,兜底机制,就像钥匙链,主钥匙打不开门,自动试备用钥匙。一还不行,就试备用钥匙。二。配置时用逗号分隔多个模型,龙虾会按顺序尝试,这样即使主模型限流了,龙虾也不会卡住,自动切换到可用的模型。 什么活用什么钥匙呢?写文章用 hope 杠四理解力最强,写代码用 cloud code, 专业,日常聊天用 kimi, 便宜又快,处理长文本也用 kimi, 支持二十万字。想省钱就用 minimax 或黑酷杠四。 第三招是定期体检,用 cron 定时任务,每五分钟检查一次龙虾是否还活着,如果发现挂了,自动重启,这样即使半夜掉线也能自动恢复,不用等到早上你才发现。 mac 用户可以用 launch 设置定时任务,创建一个 plast 文件,指定检查脚本和运行时间,放到 launch agents 目录,用 launch cap load 加载就行了,每小时自动检查一次,龙虾掉线立即重启。 windows 用户打开任务计划程序,新建基本任务,设置触发器为每小时一次操作,选择启动程序,填入检查脚本路径,保存后任务会自动运行。定期检查龙虾状态。 总结一下,闹钟解决重启问题,备用钥匙解决限流问题,定期体检解决掉线问题。三招组合,让龙虾二十四小时在线。今天的课就到这里,三招学会了吗?记得关注我,下节课见!

686Yuna的AI修炼手册 04:42查看AI文稿AI文稿

04:42查看AI文稿AI文稿哈喽,大家好,我是龙虾差不多两个多月了,这期视频我想简单的介绍一下我如何为龙虾选择一个最适配的模型。今天我会按照计费方式、 token 刷新机制、价格和性能这四个维度来横向给对目前最流行的五个模型提供商。首先要确定的就是你到底是一个轻度用户还是一个硬核用户。 原因很简单,因为龙虾跑一个任务,它的后台实际上会有几十次的模型调用,你以为你只发送一条消息,实际上会刷量你二三十次额度,复杂任务甚至可能达到五十次以上。这就是为什么大部分人会吐槽龙虾吃偷坑的原因。 因此我一直在强调,大家尽量去选择 coing plan, 而不是按量计费。原因很简单, coing plan 是 一种包月套餐,它是一种兜里机制,因此它不会出现那种如果你选择按量计费,一不留神,一晚上就烧掉一座房的情况。 所以说大家首先要判断一下自己到底是哪一类的用户,然后再去选择对应的套餐。第二点就是 token 计算的猫腻,其实这里面有非常玄乎的东西,为什么呢?我会给大家揭秘一下, 每一个 coin plus 实际上都会带有五小时刷新。刷新这个词听起来不错,但是这东西有一些秘密没有人告诉你。比如说百炼火山和 g r m, 虽然都有五小时刷新,但实际上它们有个月度总量上限,也就意味着,你如果密集的跑几天,把你的整月额度全部用完之后,你会发生什么呢? 剩下二十多天,你只能不断地碰到 api rate limit 这个错误提示,就是说你的用量已经用完了,那么 kimi 实际上它是一周刷一次,所以说你会出现一种情况,可能你周一周二刷的比较狠,那你后面以前也用不了了。 所以说这里面唯一个就是真正的所谓五小时刷新,实际上只有 mini max, 就是 mini max 是 没有所谓月度总量这一概念,它就是按照每 老老实实按照五小时刷新一个机制,你只要五小时内用,虽然你五小时内用完了,但是你五五个小时之后你又获得了全新的头壳用料。所以从这个角度,那么五小时刷新这个概念下,还是 mini max 最划算。价格我为什么放在后面?因为很简单, 我认为你既然选择了使用龙虾,那肯定是为了提高工作效率。不论是你用来工作、学习还是处理日常事物,我相信你更看重的是它的能力,而不是价格。但是我们依旧要讨论一下。 这里其实百炼有一个 light 和 pro 版本,一个是四十,一个是两百,它的优点就是它的模型比较全,但是就像我刚才说它是按照调用次数来扣额度的, 那么龙虾重度用户每个月能实际跑的人数会比你想象中的少。另外一个火山方舟,它目前有个所谓的首月九块九套餐,这个是比较划算的,但是它下一个月它的续费 它就比较贵了,所以我大推荐大家去官网上看一下。还有一个就是 kimi, kimi 其实它分的比较细,它有四档,从四十九到六九九, 我说的就是它的七天刷新。我真的比较想吐槽,因为我最早其实用的是 kimi, 但后面不选择用的主要原因就是因为它的七天刷新,真的我有点遭不住,因为可能我用的比较快,我前两天就用完了,我要等一周才能等到它刷新。接下来就是 mini max, 它是 档位分的最多最细,并且它是最不含糊的,它有从二十九,它甚至到八九九都有,它有 入门的二十九 uplus 四十九,额度会翻二点五倍,还有个 max 一 百一十九,再翻三倍。还有极速版,你可以用它的 high speed mode, 这个模型其实是非常适配这个龙虾的,因为它速度执行速度非常快, 从这个价格的角度,我认为 mini max 是 最最不含糊,就是最靠谱的,所以大家可以自己去调研一下,去官网。接下来是性能, 实际上模型的性能直接影响了你的龙虾使用体验,那么我认为又快又好是对一个模型的最好褒奖。那么有没有一个模型同时可以满足快和好呢?有的就是 mini max。 首先二点五的上下文窗口是一百万头克,也就意味着龙虾执行起来的上下文问题, mini max 可以 很好的解决,那么快你可以走极速版,也就是它的 high speed 的 模型,就算是高峰期也不降速任务,不卡壳。实际上在我漫长的使用过程中, mini max 是 唯一一个在一天的表现都非常非常好的一个模型。那么综上来看呢?实际上上下文够长,速度够快,额度机制最适合的也就是 mini max 这一家了。那么最最关键的是,我需要给大家亮出来一张图,请看这张截图。 mini max 是 龙虾创始人 peter 的 官配模型,所以我更理由有理由选择 mini max。 那 么综上所述呢, 给出一个我自己的结论,就是我中间切换了不少国内外的模型,那么综合来看,无论是性价比、能力,响应速度各方面,我认为 mini max 在 使用过程中是最适合弄瞎的。 当然你有也有可能有不同的看法,那么我也欢迎你在视频下方留言,我们来一起讨论。 ok, 今天视频就到这里,谢谢大家。

290叶孤城 01:51查看AI文稿AI文稿

01:51查看AI文稿AI文稿codex gbt 五点四模型啊,终于还是扛不住了,今天呢,频繁报如下这个错误,这个应该是最近使用 codex 五点四这个模型的人太多了,服务器扛不住了, 因为通过订阅方式来使用这个模型确实是比较划算的。就如我一天的使用量来说,如果把 token 折合成 api 请求的价格的话,一天的费用可能就要十几美元了。 但这个错误比较奇怪的是,即便是你的 open clone 中配置了备用模型,它也没有进行自动的切换,这是什么原因呢?主要是因为这个错误呢,虽然是服务器错误,但是它是在任务处理过程中发生的错误, 也就是说,模型正在响应的过程中出现了这样的一个错误提示。这样的话呢, open clone 是 没办法进行模型的切换的, 如果是遇到模型限额或者是第一次请求的时候,就发生了服务器错误,这时候 openclock 还是可以自动去切换到备用模型的。如果还没有配置备用模型的用户呢,可以按照如下这种方式来进行备用模型的配置。 其实对于备用模型呢,我采用的是 open router。 使用 open router 的 好处是,第一,它在国内可以用,第二,它能够使用国际的顶尖模型,像 openai, gpt、 cloud code, gemini 都是可以通过 open router 统一的 api 可以 进行调用 的。还有一个原因是, open router 支持国内的双币信用卡进行支付,但国内银行发行的 visa 卡和万事达卡 是没办法支付 openai 和 arthurric 的 模型的。另外一个支持国内的双币信用卡的模型是界面奶,也就是你订阅了谷 歌的套餐的话,你是可以使用国内的信用卡直接进行美元结算的。好,今天就说这个问题,希望大家都能非常流畅地使用 opencloud, 关注我,持续迭代,无限进化。

03:57查看AI文稿AI文稿

03:57查看AI文稿AI文稿我是大厂研发工程师张飞,欢迎来到张飞 ai 开发实验室。本次我们讲一下这个我根据 coco 阿里的 coco 去开发的一些功能,大家比较关注的一些多角色智能体,就像 open class 一 样的功能,我已经放到我的一个个人的 github 的 一个网址 link 就是 我的一个网址, coco 就是 这个项目名。大家点击到这个切换这个 z g l branch, 最后点击这个 code, 下边有个 down load 的 这个包,就可以把这个包下载下来。下载下来之后啊,大家可以用这个字节的 tree 去把它打开,打开项目之后就可以打开这个终端,终端在这里头新建终端,新建终端时候建下来之后 就可以去安装这个包,安装的时候应该大家都知道在这一侧是可以提些问题,比如说去问我该怎么去安装,那我可以简单的去看一下子,它这里有一个 readme 文件,告诉我们哪里怎么去安装开发版主要是这两个开发测试 就是用这个命令,当然大家提前需要进入 python 这个环境当中,进 python 环境当中,我建议大家可以安装 python, 安装 python 之后要输入一个 python 杠, m v e n v m e n v 输入这个命令,那输入这个命令之后呢,就可以在当前的 q pad 的 一个目录下去创建一个 python 的 虚拟环境,这样子它不会影响你整体电脑的一个 排序环境,再输入一个命令就可以进入命令,我新建一个终端演示一下, ok, 这里是已经进入了,那我出去之后再重新进来 e n v scripts 脚本 active 就是 激活虚拟环境, 对,我们就这条命令就可以进入了虚拟环境,激活到虚拟环境之后,就可以用行运行下面的一个 p i p install 这个命令,安装开发版的一个各种个性化的包,然后再进行大家已经知道的抽象,最后再运行那最后这个结果,像这么一个结果运行之后,这样子就开启了一个 后端,我们在等待它打开,打开之后我们点击前端,在前端这种点击智能体管理,点击这里创建一个智能体,你们按照下面提示就可以创建你们所需要的智能体,这里有一个模板,你可以选择自己的模板,也可以选择 自己随意建其他的一个信息就可以创建,创建之后要选择相应的一个激活,激活之后就可以在这里和去聊天或者展示一下子。现在这里我就激活了一个产品经理,我给他激活了个产品经理, 启动的是一个 old strap, 都可以告诉产品经理我的需求是什么,我给他定位是什么,下面就输入给他,他都会保存在独立的一个产品经理这个 workspace 当中。 同时我这里又建了一个市场营销推广,在这里我也给了一些定位,他自己就会建立进去,也是市场营销推广 agent 和这个 安敏经理 agent 两个是独立的工作空间,并且都可以把它配置到这个非输应用当中,这也是开发功能。在非输应用当中,大家知道 上节视频当中给大家讲过有个 app id, 还有一个 app 的 一个 secret, 把这些都配好之后,并且绑定到相应的一个智能体,比如这里绑定到一个是产品经理,一个是绑定到市场营销推广经理, 两个都点击保存,并且两个都去启动,它就可以去使用了。 ok, 这个是绑定到产品经理了,这个应该绑错了,绑这个市场营销推广 a 人的绑。对,我们再点击启动,两种 都启动之后,这样就通过飞书可以和他们分别交流,在飞书当中去拉一个群,你自己加上产品经理,再加上市场推广营销的一个经理,你们三个人可以去讨论,给他们分配不同的任务,并且让他们去讨论。今天讲到这,谢谢大家。

00:34查看AI文稿AI文稿

00:34查看AI文稿AI文稿兄弟们,上期说到怎么给 openkey 切换大模型,但是呢,可能你哪一步设置错了,或者是模型 id 写错了,切换之后呢,小龙虾就直接崩了,怎么办呢? 首先在 ai 与代理 models 把之前建立的付费模型给删掉,重新按照正确的方式再填一次,保存后复制模型的名字或者聊天,输入斜杠 model 模型名字,回车发个消息测试一下, 当不出现错误信息,并且呢,他在思考的时候都能修复好了。如果遇到问题啊,记得发在评论区哦,看到了呀,就会帮你解决的。

00:30查看AI文稿AI文稿

00:30查看AI文稿AI文稿晚安, openclo 的 朋友,你们是不是都被一个问题搞疯了, token 太烧钱了,同样的请求,问一次扣一次,跑自动化越跑越亏。纯纯给平台打工,开研一个 ai 路由缓存服务,同样请求只扣一次 token, 后面直接走缓存, 不花钱秒响应,还能自动切换本地模型和云端接口,搭配 openclo 用,成本直接砍半,速度还更快。

1155senwen 06:45查看AI文稿AI文稿

06:45查看AI文稿AI文稿能随时切换各家旗舰模型的 ai 浏览器,你想要吗?国际版还能切换一三家的模型。它能同时引用公众号,文章加网页、加文档、加绘画,一共十几个信息员一次性总结。开启 agent, 它的自主执行辅导任务, 输入一个斜杠,随手凑一个脚本工具,它能一键下载网页的所有图片。我也没想到二零二六年 ai 浏览器还有高手,它就是 tabid ai 浏览器,迫不及待的分享给你。说实话,这两年关于 ai 生产线工具,真的别管什么忠诚度了,进化太快,还总有黑码,哪个好用就用哪个,关键没有任何的迁移成本啊。 下载安装的时候,你收藏了书签,打开了标签页、历史记录、 cookies、 登录状态、账号密码,甚至扩展程序都可以一键迁移导入。 你看, tabbed 正在帮我自动安装 chrome 插件, tabbed 也是基于 chrome 开发的,所以插件生态快捷键都可以无缝衔接。界面布局方面, tabbed 有 两个非常棒的新设计,左边你可以看到垂直标签栏,几十个网页多开的时候,垂直标签栏看起来就是舒服很多。垂直标签栏可以自由收起,但你也可以切换成水平的。 点击右上角 check 按钮或者快捷键, ctrl 加右框号,可以调出 ai 侧边栏。这里的功能和主页的对话框是一样的,所以你就不需要切换网页打断工作思绪。如果你屏幕比较小,你也可以切换到浮窗模式。多年的 crm 老用户看到这两个新设计必须好评。 然后我们细说一下亮点功能。最有吸引力的就是你可以免费的随心的切换各家的顶级模型,这些都是各家的旗舰,如果你有法子用国际版,你选择就更多了。这个出发点非常好。我们现在基本上都已经习惯了 ai 搜索,但是在各个网页和 app 之间来回切换也挺烦的。现在 tab 一 网打尽了, 你可以先用 kimi 二点五搜一遍。看完之后,如果你对传统搜索引擎还有旧情,那你可以点击右上角的默认搜索引擎,这个就是你 tab 的 浏览器的默认搜索引擎,看你自己的选择。 选谷歌的好处就是你可以直达 jimmy 的 ai over view。 如果你还想看看别的模型,也简单。回到刚刚 timmy 二点五回答的最下面,点击刷新按钮,切换模型,换个 deepsea v 三点二。哎,同样的问题确实带来了一些新的视角和启发。在 ai 搜索和传统搜索之间,在不同旗舰模型之间,你都能随心切换。你没有新建网页,也没有切换 app, 只是点了几下鼠标而已,非常丝滑。 这里提个醒,直接在旧的回答下面切换模型,那之前的回答就没有了。所以我建议你对比较好的回答。你可以先点个收藏,或者当中部分有价值的段落,你可以选中收藏 tab 的 收藏有大有,我们先摁下目标,等会再聊。要么你就复制问题换个模型重新问一遍也行。 这里还有个好消息,听说 tab 的 后面会做一个多模型对比输出的功能,想想都会激动。这个就像成绩是翻译插件,多模型对比翻译,如果再加一个断网回答的选项,那就更完美了,非常期待。 任何时候你都可以 ctrl 加右括号调出侧边栏,我觉得其他浏览器的侧边栏都没有特别的好用。这是我自己的视频播放页面,侧边栏自动抓取了当前网页的主题,可以一键总结,也可以截图提问或者直接对话,模型都是可以随便选的。 说实话,这条十几分钟的视频关键要点的总结确实很到位。视频上传的时候我没有分章节,这几部分都是他自己梳理概括的,还有这些数字完全正确,但是你让我给你解说一遍,我肯定没有他总结的好。 同一个网页可以随时开新的对话,你可以看到和 tabid 的 全部对话,也能看到和当前页面的对话,这个分类整理就很友好。 tabid 还有一个很棒的分类整理,是标签页智能整理,点击一下这里,几十个标签页就自动归类了。 tabid 会根据标题、网页内容综合判断,整理成不同的 group, 个别的你也可以拖拽调整,从此告别乱糟糟。 关于浏览器的使用,有任何不懂的功能,你都可以直接问 tabit。 比如说如何智能整理标签页,它会帮你查产品手册,然后告诉你怎么优化它,最后直接给你一个执行按钮,你点一下就行了。这个就很 ai, 除了 ai chat、 标签页智能整理这些沉浸式的体验,当然还有你熟悉的快捷键, ctrl 加 t 新建标签页, ctrl 加 w 关闭当前标签页, ctrl shift 加 b 开关书签栏, ctrl shift 加 delete 删除记录,这些快捷键完全通用。 这里我就要隆重介绍 tab 的 最神奇的快捷键,魔法斜杠,在对话框输入斜杠就能调用妙招,点 击头像,选择我的妙招,就可以创建妙招了。最简单的就是常用提示词妙招,比如说标准的一个人物介绍模板,取个名字叫角色介绍,然后到对话框输入斜杠,唤起妙招,选择角色介绍。我只要输入陈平安三个字,那关于陈平安的完整介绍就出来了,效率拉爆。 类似的还有思维模型的介绍,一首词写好之后,就可以创建一个妙招,斜杠直接唤起,输入安锁不矩阵,那超级详细的介绍都出来了, ai 生产力强的没道理。 当然更厉害的是创建脚本妙招,就像视频开头,一键下载网页的所有图片。这件事在以前你得会编程,自己编写一个 java script 的 脚本,或者做一个浏览器插件才能办到。 现在就很简单,输入斜杠,点击使用脚本,告诉他你想在网页上实践的功能,识别网页中的图片,打包下载并保存为压缩文档,那剩下的 tab 会帮你搞定,你只要点击保存就行了。 你看,我的妙招里就有了这个保存图片的脚本。在任何网页点击右上角的妙招按钮,选择保存图片,就能一键下载当前网页的所有图片,就这么简单。 类似的,你想做一个能够自动识别并提取保存网页表格的脚本,也是一句话的事。还记得前面陈平安的人际关系网吗? tabbed 贴心的列了个表,同样的点击妙招,选择提取表格,片刻功夫,这张表格就提取出来了。这 些妙招在侧面来对话的时候也可以直接输入斜杠调用,非常丝滑。有了 tabbed, 就 算你不会写代码, ai 工具也能随手搓, 别急,还有更强的,从 chat 到 at 再到 agent, tabad 有 三级 ai 能力, ai chat 前面已经介绍过了, at 就是 它的多元引用能力,你看到的所有信息员都可以被你引用作为上下文信息输入给 tabad。 目前其他 ai 浏览器最多就是同时引用多个网页,那 tabad 它的逻辑是你用浏览器干活,你接触到的信息本来就是多渠道的多模态的,那就干脆打破边界,你之所见都是它的上下文。 一般 deep research 都是仅限于搜索整合网页,那现在用 tabbed 就 相当于你在 deep research 的 基础上加入了你自己收藏整理的资源,加入了你的本地资源,一次性喂饱它。 然后是 agent 点击更多模式开启智能代理,那 agent 会自主执行这个复杂任务, agent 执行任务的时候,它会自主操作浏览器,访问、搜索、筛选、点击、阅读、提取、下载等等。它会自己创建一个标签,业主在做,你独立运行,不影响你继续浏览器网页。 你对 agent 提的要求也可以像前面脚本一样创建妙招,让魔法斜杠变得更强。把 tab 设为默认浏览器,你就可以免费获得会员直接调用它的 agent 的 能力。从 chat 到 at 再到 agent, tabit 三级 ai 能力任你驱使。最 后聊聊收藏。在 tabit 你 可以收藏整个网页,收藏网页中选中的文字,收藏图片,收藏 tabit 的 对话等等,这些都会在你的收藏夹里。你可以创建文件夹,分类命名为 ai 生产的工具。然后别忘了把这条正在看的 tabit 的 教程放进去, apple 模型随心选, ai 工具随手搓, aj 的 助手随时用。三月开局, tabad 会是一个不错的好帮手,期待你的时间,下个视频再见。

730檀东东 01:11查看AI文稿AI文稿

01:11查看AI文稿AI文稿如何切换 openclaw 的 模型?首先输入 openclaw comf 命令,键盘上下箭头,操作界面选择 local, 然后回车选择 model。 目前模型中只有千问是免费的,选择 coen, 然后会打开浏览器让你认证一下千问模型登录只需要在千问官网注册一个账号,然后弹出来的页面通过一下就行了。接下来模型具体版本选择直接选默认的就行, 如果有需求可以豆包问下,直接回车配置完成, ctrl 加 c 直接退出就 ok 了。