在哪可以买ai的token

最近我收到最多的后台私信就是 token。 既然是个新的大众商品,那普通人能不能自己生产 token 自己卖?今天一条视频给你讲清楚。先说结论,能生产,但你算完账,你就不会干了。我们来算一笔账, deepstack 目前最火的大模型,它卖 token 的 价格是多少?输出,每百万个 token 三块钱。 一百万个 token 是 什么概念?大约相当于五十到七十万个中文字,一本书大概十万字,也就是说, ai 帮你能写将近七本书的内容,只收你三块钱。反过来说,你自己要生产这一百万 token, 至少得花几十万买个 gpu, 装一台服务器, 二十四小时不断电。就这样,你的一台机器大概需要十几个小时才能生产出这一百万个 token。 而且这个你还没有算你的工程师维护机房电费和宽带费。 deepsea 为什么能卖三块钱?因为它拥有几万张 gpu, 同时跑,一天处理上千亿个头梗,成本被摊到几乎为零。这就好比你自己在家养了一头牛,挤了奶想拿出去卖,一瓶卖五块, 你觉得能赚,但是你一算,买牛花了两万,饲料每月两千,一天只能挤几斤奶,隔壁蒙牛一天出几千吨,一瓶卖三块钱还能赚?你的奶不比它的差,但是你的成本是它的一百倍还要多。 这就是普通人生产 token 面临的问题,不是做不了,是做了一定亏。所谓普通人在 token 这门生意里的正确姿势,不是自己生产 token, 而是用便宜的 token 去创造贵的服务。 举个例子,你用 deepstack 花三块钱买一百万个 token, 让 ai 帮你写十篇小红书文案,通过小红书的文案带货去赚钱,那么你的成本就是三块钱。 你赚的不是 token 的 差价,是你知道怎么用 token, 而别人不知道的信息差。再举个例子,你用 ai 帮一个小型企业搭建一套 ai agent 的 token, 成本可能不到十块钱,但你收企业五千块钱的咨询费, 企业买的不是你那十块钱的 token, 而是你的判断力和方案。不要去跟巨头抢着生产 token, 要去想怎么用三块钱的 token 创造三千块钱的价值。生产 token 的 钱留给巨头去赚,用 token 去做赚钱的生意,才是留给普通人的机会。我是文思,关注我每天带你看懂 ai。

粉丝3.0万获赞35.2万

相关视频

00:51查看AI文稿AI文稿

00:51查看AI文稿AI文稿现在很多玩 open club 的 或者是一些 ai 的 新手玩家都想用一些免费的投坑,其实有不少平台都是有一些免费的额度的,你好比像阿里云百念上面他有很多个模型都是有这种免费的额度,一般都是一百万投坑这种 他的量都是不是很多,你如果说直接拿他去做一些 产品什么的,那肯定是不够的。你现在如果是说用让这种 ai 帮你去开发产品,你想要免费的,目前可能就吹这种, 他本身就是自带免费额度,可以让你无限制的使用的这种你想用那种付费平台那是肯定不可能的,不现实。

03:00查看AI文稿AI文稿

03:00查看AI文稿AI文稿大家好,我是你们的科普达人,今天咱们来聊聊个人开发者怎么低成本入门 tocan 生产。很多朋友可能觉得 ai 模型部署门槛高,成本贵,其实只要配置得当,咱们普通人也能玩转。先说说硬件怎么选, 如果预算在一万五以内,想先试试水,那 rtx 四零九零 d 或者四零九零显卡是首选。二十四 gb 或十三 b 的 模型,搭配 i 五或 r 五的 cpu、 三十二 gb 内存, e t b 的 nvme 固态硬盘,再加上一千瓦的电源和一套散热好的机箱,总价大概一万一到一万六就能稳定运行。模型 托肯吞吐量能到每秒两百到五百个,日常测试和小流量使用完全够了。要是预算能到两到四万,想搞小批量生产,那就可以考虑上双卡四零九零 b, 或者直接上 a 一 零零,内存加到六十四 gb, 这样吞吐量能到每秒八百到两千个,接下小 b 客户的需求也没问题。硬件搞定了,软件和模型怎么选呢?模型方面,七 b 规模的 q 文二七 b instruct 或者 lama 三七 b 就 很适合入门,显存占用小,延迟低, 聊天、写文案、生成代码都在行。十三 b 的 模型像 q d r 杠一三 b instruct, 复杂推理和行业知识库的应用效果更好。这里有个小技巧,优先用 i n t 四量画板,显存占用能降百分之七十五, 速度还能提升两到三倍,效果几乎没损失,性价比超高。推理框架推荐 v l l m 开源免费,吞吐量比原声 pie torch 高十倍以上,个人开发者首选。部署工具方面, fast api 或 flask 用来封装 api 接口, prometheus 和 grafana 监控性能, e l k stack 记录日记这些都是免费又好用的工具。大家最关心的成本问题来了,按三年折旧算,入门级硬件每月折旧大概四百一十七元。电费方面,单卡四零九零币,满载运行 每月电费差不多一百九十四元,总成本约六百一十一元。按每天产出两千五百九十二万 token 算,单位 token 成本约零点零零零零二三六元,也就是二点三六分。每千 token 对 比 openai 的 gpt 三点五 turbo, 成本只有它的四分之一,价格优势很明显,想快速上手, 一天内就能跑通,先装 uber 二二点零四 lts 系统,然后安装 cuda 十二点一 cuda n, 再装 python 三点一零和 vl l m。 接着用命令启动模型服务, 最后用 qiro 测试一下生成 token, 看看返回结果里的 usage 词段,统计 token 数就搞定了。最后给大家几个进阶优化建议,用 v l l m 的 批量请求功能提升吞吐量,尝试模型蒸馏,降低显存占用和延,使用 radis 做请求队列应对高流量 在整个数据库记录用户 token 消耗,实现自动计费。这样一套下来,你的 token 生产系统就既高效又经济了。怎么样,是不是觉得个人搞 token 生产没那么难?你最想先用这个系统来生成什么内容呢?评论区告诉我吧!

239桥哥正义分享社 02:30查看AI文稿AI文稿

02:30查看AI文稿AI文稿从最近的这个 token 的 市场来看,明显就是阿里和腾讯是不入字节的。像阿里啊, 阿里和腾讯字节他们卖头肯的套餐,他们最基础的那个套餐都是四十四十多块钱,四十九来着?还是还是多少来着?还是四十来着?嗯,阿里的这两个套餐完全就很多时候都售罄啊, 像那个腾讯的那个四十九的套餐根本也买不到,只能你要买腾讯的模型的话,只能直接上那个两百两百多的那个套餐, 但字节他那个四十九的套餐还放开了再买,这就反映了一个什么事情呢?就是字节他背后, 他因为欧印欧印的早,他就已经在算力上的部署早就部署完了。但 明显就是腾讯和阿里啊,他们其实很早就有自己的运营服务了,但他们因为 入场的晚,他的算力各方面就跟不上,所以他们的头肯是没办法放开卖的。但字节就能放开卖,而且现在从整个的这个生态来看,字节的不管是模型 的质量,还是他的整个用户的数量和体验,都比阿里和腾讯高上一大截。 所以真的就是大家如果呃也打算长期养一个呃,龙虾的话,呃,我也是推荐就是用自洁的这骚体系,因为自洁他的整个生态打通各方面要好很多,而且整个 从发展来看,明显啊就是字节他的,嗯,公司的进取心啊,各方面啊,是做的比另外两家巨头好很多的,另外两家巨头真的 大,公司病太严重了,字节毕竟是后来的后起之秀。嗯,这是我个人的体验分享,和大家说一下。

02:34查看AI文稿AI文稿

02:34查看AI文稿AI文稿现在就这个 token 贵啊,但到今年下半年 token 的 价钱肯定就会降了。为什么呢?因为现在 token 贵主要的原因是需求大爆发了。 嗯,现在不管是 openai 还是各种那个智能体出来就是需要消耗很多人用嘛,就需要消耗大量的 token, 因为现在 托肯已经算是生产力的一部分了。但是呢,就是以前的时候,大模型它主要是,嗯,构建大模型用的都是那个训练芯片,训练芯片 它是和产生透坑的这个推底芯片是不一样的。但训练芯片,呃,用了之后,你的大模型的预训练只是用一段时间,你的模型训练之后,你的那个模型基底是不变的, 然后那个个训练芯片的需求就不用那么大了。但现在社会上的这种透坑的需求很大。 呃,就是需要推理芯片了。推理芯片大概今年下半年的时候就能够大规模的嗯,上就是量产出来了, 而且英伟达最新的芯片它的吞吐量又那么大,所以托肯这个东西到后面肯定会降价的,而且时间会蛮快。因为现在这个市场其实竞争蛮大的。我们国国内的这些大模型啊, 都是国外,他们都是按照托肯算价钱的,像我们国内 都很多那些套餐都是按次算价钱的,所以我们的这个托坑的, 嗯,竞争优势还是蛮大的。但这个东西到后面那种推理芯片大规模上的时候,价钱肯定降的, 所以现在用不着,就是使劲的用啊,到后面用就行了。 但真的建议大家每个人都要养一只龙虾,龙虾肯定会是以后最好的个人助手。

03:23查看AI文稿AI文稿

03:23查看AI文稿AI文稿现随着 ai 应用的遍地开花, ai 的 talk 消耗量越来越大,甚至有人开玩笑,今天赚了多少个 talk, 还有一个应用场景,大家每天在使用 openclo 的 时候, 它的消耗量也是非常惊人,今天为大家分享一种方式,可以白嫖 talk, 而且它不是那种小模型,而是我们国内的 gim 五, 接下来我们看一下如何使用。哈喽,大家好,这里是二 pop openclock, 相信大家现在已经人手一只了吧,但是它的 talk 消耗量就非常大,今天我们分享一种可以免费获取 talk 的 办法,这就是互联网大善人英伟达免费开放的, 之前我也在公众号分享过,今天我们来手把手实操一下。我们打开英伟达官网的模型列表,大家可以看到这里有各种各样的模型,像千万三点五,还有智普五点零, 还有 kimi 二点五等等,这些都是可以免费试用的,使用方式也非常简单。我们先点击这里的注册,当然在这里注册的时候,我们要注意一点,我们要使用海外的邮箱,就比如 gmail 或者是微软的 outlook, 不要使用 qq 邮箱,这种是没法通过的,我已经给大家试验过了。 我这里粘贴我的谷歌邮箱,点击下一步,这里输入你觉得合适的密码,我们点击创建一个账户,这里他会给你的邮箱发送一个验证码,输入验证码,点击继续。这里是按选择是否接受通知,我们直接提交就可以, 没有任何影响。这里输入一个名字,这里也没有任何限制,直接输就行,这时候我们就注册完成了。回到了这个页面,大家可以看到最上边有一行,请验证你的获取 api, 我 们这里点击一下验证, 这里验证是需要输一个手机号的,这个手机号我们也试验过,输入国内的手机号,也就是加八六的,前面我们选择中国 china, 这里我们输入八六,这里我们选择中国。以后输入一个我个人的手机号,点击提交,这时候你的手机就会收到这样一条验证码, 是优速通发的,我们输入进去,点击验证,可以看到这里基本上是秒通过的,我们在这里随机选择一个模型,就比如智普的这个五点零, 然后点击这里的 welcome, 这里获取 api k, 可以 看到已经能拿到了,接下来我们验证这个 api k 到底可不可以用呢?在之前我分享过一个很好用的工具, cherry studio, 就是 这个樱桃的,它是一个开源项目,我们可以在 github 上直接下载到,然后在这里测试一下这个 api k 到底可不可用,我们点击左下角这个齿轮, 这里选择添加模型供应商,我就添英伟达下面供应商类型,我们选择 open ai, 点击确认,这里需要填密钥还有地址,我们粘贴 api k, 粘贴 url, 添加模型,这里要注意这是英伟达自定义的一个模型名称,就这个 z 杠 ai glm, 我 们拷贝过来,点击添加,这时我们打开对话试一下, 这里要注意模型切换,我们切换成刚才添加的,因为答的这个 z a i g m i 五,我们问它是什么模型,看一下它的反应,这里因为我的网络问题,可以看响应速度稍微有点慢,但是它是完全没问题的,可以看到它是由 z 点 ai 训练的大约模型,然后是 g a m, 这时我拿到这个模型大家就知道怎么用了吧,比如我们把它绑定到我们的小龙虾,或者是绑定到我们的 agent 上,这时候就可以无限的耗羊毛了, 而且我还没有碰到过说使用限流或者是 taco 被用完的情况。大家如果需要更多的账号,完全可以按照我这个方式注册几个谷歌账号,然后并且做一个手机绑定就可以了。更多 ai 和变现的方式我们一起来研究。

371JavaPub 01:57查看AI文稿AI文稿

01:57查看AI文稿AI文稿兄弟们可以先看看我的使用数据,两千万 token 花了三块一毛五,算下来一毛五分一百万,哈哈,太牛逼了!我现在真的觉得 api 价格打下来以后,很多玩法一下就通了, 而且这还是高智商 gpt 五点四万本,这性价比真的有点夸张。单说价格稳定性还有模型聪明程度, 对比我之前用的 kimi 真的 是舒服太多了。而且 gpt 五点四,你跟他多聊几轮就能感觉出来理解力、执行力,还有那种连续干活的稳定性,智商明显高出很多很多。 我接下来演示一下,看看让 openclaw 现场做一把 ppt 实际到底能烧多少托梗,但是我的模型没有接入图片视频,大模型只能作为参考。顺带问一句,有没有大佬懂 grog 怎么接入龙虾 纯小白,需要具体的流程,感激不尽,下面开始演示。用小龙虾做 ppt 能收多少钱,我目前已经用掉了三点一五元,现在我开始向他发送 ppt 制作指令。 ppt 已经制作完成了,经费已经跳到了三点三四元,总共花费是一毛九分钱, copy 一 项显示可能有延迟没力可调时间,总共花了五分钟左右。另外 ppt 的 制作质量我感觉还是可以的,反正比我做的好多了。 这份 ppt 后续只要继续微调,基本就可以使用了。后续我应该会继续沿用这套 api 方案,如果各位大佬找到有更便宜的可以推荐一下,非常感谢!

13AI天才派大星 04:13查看AI文稿AI文稿

04:13查看AI文稿AI文稿头肯太贵,白嫖免费。兄弟,你养龙虾了吗?现在全网都在讲养龙虾, 养龙虾就是在自己的电脑上或者云上部署一个 open klo, 让他替你去干活,号称真正的 ai 打工人。 养龙虾这个养字用的特别好,我见过养金毛的,我看见人家金毛吃的都比我吃的好好好几倍。 那养一只龙虾究竟要花多少钱?如果你没有算过经济账,千万别一时冲动听华仔给你算一算。首先是硬件,你可以用清亮云,一年四五千块钱, 现在打一折九十九块钱,或者六十八块钱一年。如果你想用自己的硬件, 现在最火爆的就是迈克迷你,最低配四千三,但现在已经全网卖断货了。 再就是安装,网上安装费从几百到几千不等,花五千块钱你就拿到养下资格证了。 接下来就是运维,运维是个无底洞,开汽车你用汽油,养龙虾你用头肯。 toker 是 ai 的 计费单位,一百万的 toker 费用是两块八,一百万 toker 输入是八毛,输出是两块,但是一百万 toker 讲几句话就没了,因为处理任务时,每一步都要把之前的所有信息读一遍,这比原来 电信通讯费用还要贵。我装了龙虾之后讲了几句话,第二天醒来一看龙虾就不跑了,因为一千万的 免费头更用完了。网友实测,一天四百块钱,六个小时一千一百七十二块钱。有开发者首月一点八亿头更的账单,两万 多的月薪,两万都不够养龙虾十五天。猎豹董事长、 ceo 富盛在直播间里说,使用了最贵的打磨性,一天也就两百美金。两百美金贵吗?真不贵,但我们都不是 ceo。 我 想问问有几个人 一天能挣到两百美金的?这可能是最讽刺的时代背了。你装个龙虾就是为了让他去替你打工,结果你拼命挣钱,打工还养不起他。 o p k l 像一台二十四小时运转的碎烧机,它运行时你无法监控它,等你发现跑偏,你想喊停,结果它烧掉了好几百块钱。我相信大魔性的费用后面一定会降下来。但目前现在 重点来了,一、如果你挣的没有龙虾烧的多,我建议你先想好再养。二、但因为龙虾确实是最好的技术 时代的风口,我们又不愿意错过这个最好的机会。我给你两个建议,一, 我们用大模型一定要有高低配,普通的任务我们用低配的大模型,复杂的任务我们用好的模型。二,就是你连购买大模型抠钉破烂的套餐的钱都不想出。我给你一个白嫖免费的方法, 哎,白白嫖的免费的,他就是香。我给大家免费的大魔性的。两、使用免费大魔性的两个方法,我放在评论区中,大家自己去去去设置,大家也把自己使用大魔星花费的 费用在评论区打出来给我看看。关注华仔,加入华仔趴,带你玩龙虾二十年 it 老教练带你龙虾玩的转,留下个爱心和关注吧,谢谢!

219华仔AI创富 01:57查看AI文稿AI文稿

01:57查看AI文稿AI文稿免费的头肯随便用,没有任何限制。最近使用了 oppo cola, 头肯是太费了,随便一用一下就用完了。 自己的这个 ai 开发软件,缺氧是免费,可以用各种模型,我就想这里能不能想点办法。然后借鉴了 oppo cola 的 思路,写了一个飞速机器人, 用手记上这个飞书啊,控制这个电脑上的翠。我现在给飞书机器人发一个消息啊,发一段指令。如何计算润年这个 new 呢?表示开启一个新的绘画啊,这里已经有四个绘画了,现在我们来发送, 你看啊。好,来了,产生了第五个新的绘画,现在他正在执行。 咨询完了以后呢,他会给我手机发送一个回复,是不是像 open core 一 样?差不多了, 接下来准备用 open core 去接入这个机器人,这样子有一些重型的写代码的工作就交给这个确认来做好了。这个确认呢,写本地的文件, 稍等片刻,瑞典已经即将完成, 现在马上要发送回来啊。这个呢,比调用 api 肯定是慢,因为这是个图形界面,但反正在手机上使用,不着急的话,我觉得也可以接受。 哇哦,不错呦,好消息来了,已经完成了日历的计算代码在哪里?怎么计算好?

17卖电脑的程序员 01:01查看AI文稿AI文稿

01:01查看AI文稿AI文稿推出了那个小龙虾嘛 opencloud, 之前那个 talk 就是 api 不 够用,现在我们重新注册一个,要想去注册英伟达的那个它可以免费无限使用,但是吧 它国内不让用了,要 他对中国进了这个就注册成功了,然后点这个控制台,看到没,直接下一步跳过就完事了。 这里就出现一个超算互联网,这个直接点立即体验, 然后点这个模型 api, 这里就有一个免费领取,领取成功时间就这就还有两周, 在这里可以看到用户量,你看这就一千个 tokyo 行。

01:12查看AI文稿AI文稿

01:12查看AI文稿AI文稿大龙虾没有 api, 就 像跑车,没加油,再强也跑不起来。今天教你用最低成本,合理配置,给他加满燃料。官网,二十美元一个月,太贵了,国内扣定 plan 只要一折,二十到四十块钱就能搞定。但有个关键点要注意,这些套餐都有每五小时的用量限制。什么意思? 就是每五小时刷新一次额度,还有些有每周限制。如果你像我一样白天上班,晚上集中写代码,那这个限制对你影响很大,可能刚写到信头上,额度没了,要等刷新。所以选套餐要看你自己的使用习惯,分散使用的话,五小时限制影响不大。集中使用的话,要选额度高的套餐。我们不单只是可以用在欧根可老大龙虾上, 一起使用这个套餐。 a p r 我 整理了七家平台的对比表,大家看图,价格、用量、模型都在这里,大家按需选择,大家可能纠结选哪个? 其实真不用纠结,各家的模型能力都差不多, mini max 二点五,英文语境表现好, d、 c 性价比高,天文代码能力强。 这些模型在宽的扣子上都能用,差异没你想象那么大。我的建议是先挑便宜的用,不满意再换。所以不用太纠结,先跑起来最重要。一般玩家买个包月套餐就够用了,省心。如果非要体验那种顶级模型的丝滑流畅,我这边也有稳定低成本的解决方案,放在了我的主页胖虎 ai 军火库里边,直接安排了兄弟们。

05:25查看AI文稿AI文稿

05:25查看AI文稿AI文稿一年发电九万亿度,全世界的 ai 都在向中国买电,而你每天玩 ai 用掉的 token, 正在为中国赚取二十倍的巨大利差。这笔钱,全世界只有中国能挣,没有夸张。这是两会提及的现实。今年我国一点五万亿的贸易瞬差,也有 ai 的 一份功劳。 一条视频告诉你,中国电力如何成为世界 ai 的 算力支柱。中国 ai 未来的算力中心不在杭州、深圳,甚至不在贵州,而是在内蒙古乌兰察布。 在大雪覆盖的戈壁滩上,成片的风车和光伏板正在发电,而一墙之隔,就是自洁华为的数据中心。在这里,电厂和机房之间只隔着一道围栏,这就是中国独有的戈壁经济。 电力刚刚出生,就直接变成算力。 ai 时代,中国正在把电力出口升级成算力出口。这种升级的底气很简单,中国是全世界最大的发电国。二零二五年,我国全年发电量超过九万亿度,几乎是美国、欧盟加印度的总和,占全球发电量的三分之一。 风电和光伏产业的装机量更是连续多年位居世界第一。在过去,电太多用不完,西电东输都仍有赋余。最后解决办法只有那么几个,要么降低发电功率,让部分风机停转,要么把电送往高能耗产业, 比如电铁、铝冶金,实在不行,就只能弃风吸光,让已经发出来的绿电白白浪费了。而现在,这些电有了一个全新的去处,把电变成算力,再把算力变成 token, 卖给全世界。 而就在这个月,两会正式给 token 定下了中文官方一名词源。这个名字看似学术,其实是在打直球。电力驱动算力,算力驱动模型,模型用词源计价, 全球 ai 都在靠中国的电力运算,每个人用 ai 打字、生图、写代码,本质就是在花费词源购买中国的算力。从制造业到 ai, 中国总有一种能力让高端技术不再昂贵。 所谓 token, 是 ai 大 模型处理文本的最小单位,我们调用大模型生成文本图像代码,本质就是消耗 token 购买算力。 通俗来讲呢,可以理解成畅玩 ai 的 点卡。对比起国外厂商的天价 token, dipstick v 三每百万 token 输出价一元,而一两元、千万三点五 plus 二到四元。这也就意味着使用国内大模型厂商的 api 价格比硅谷大厂至少便宜了十倍。 今年二月,全球前十模型总 token 消耗量超过二十八点七万亿,其中中国模型贡献了十四点六九万亿,占比百分之五十一点二,首次超越美国模型,而且这其中有百分之四十七的用户来自美国。这意味着中国 ai token 的 爆发式增长,不仅仅是靠国内市场撑起来的,这是全球开发者的功劳, 尤其是北美、欧洲的成全的选择,他们主动放弃 gpt 五、 cloud、 四点六等硅谷模型,集体倒戈国产大模型,在性能上丝毫不虚, mini max、 智普、 deepsea 等模型在各项榜单上追平甚至超越 gpt 和 cloud, 价格就只有美国同行的十分之一。在性价比这个领域,国产模型可以说是遥遥领先。 那么我们是怎么做到的呢? token 出海的本质是电力换皮出海,把我国西部戈壁滩上零点一八元一度的风光电能输入数据中心的 gpu 集群,把电力包装成可交易的 token, 再通过海底光缆交付,最终顺着网线发到美国成权的账户里。 所以,让几毛一度的电价翻倍的谜底就藏在谜面上。 ai 时代的能源出口不再只是石油和天然气,还有算力。而在这个赛道上,同时拥有超大规模电力、完整制造业产业链和互联网平台的国家,全世界只有一个。 先说电力,中国西北的风电和光伏,在风水期和大风期,经常会出现一个很反直觉的现象,电太多了,用不完。 理论上这是最理想的绿色能源,但现实却是,电网不一定接得住这么多电,于是就会出现气风气光现象,发出来的电用不掉,只能白白浪费。近年来,西北部分地区的气风气光率一度超过百分之十,也就是说,每十度绿电就一度要被浪费掉。 而 ai 数据中心恰恰是这部分绿电最完美的出口,只要有电,它就能把电变成算力,再把算力变成 token。 再说硬件,一台服务器里,从机柜、电源到高速模块,基本零部件多数出自中国制造。哪怕是核心 gpu 来自海外,整机的集成和规模化部署的成本也能被国内供应链压到最低。 在美国,新建大型数据中心往往要经历漫长的审批流程和社区听证,一来一回就要扯皮好几年。而在中国,得益于政策支持,从拿地到通电有时候只需要几个月。于是,一个非常独特的产业结构就出现了。中国西部的风光电供应全球最便宜的能源, 中国东部的制造业有着全球最完整的设备供应链,来自全国各地的工程团队建设速度全球最快。最后,北上广深的互联网公司把算力空装成 token 卖给全世界。 过去二十年,中国出口的是衣服、家电和手机,后来出口的是光伏板、锂电池和电动车。而现在,中国开始出口算力本身。当美国程序员调用 api 生成代码时,当欧洲创业者用模型训练克服机器人时,他们消耗的每一个 token 背后其实都是乌兰察布的风、宁夏的阳光和一套完整的工业体系。 从电力到算力,一度电在戈壁滩上只值几毛钱,但当他绕地球一圈,以 token 上只值几毛钱。但当他绕地球一圈,以 token 的 形式回到硅谷账户时,价格已经翻了二十倍。 好了,让我们回到最开始的问题,为什么这钱只有中国能挣呢?做到这一切需要什么?首先需要国家东数西算的百年战略决策,需要能源、工信、电网等几十家单位部门的协调调度,还需要上百家科研机构搞定 风光电存储一体化、液冷散热等高精线技术。再加上几百家下游配套企业,隆基的光伏板、金峰的风机、华为的升腾芯片、浪潮的服务器,最后才轮到数据中心把电力封禁,偷看通过海底光缆出口。

1.7万硬核的博哥 02:33查看AI文稿AI文稿

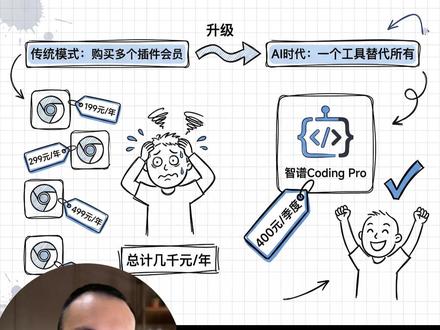

02:33查看AI文稿AI文稿现在真的是非常适合一个人公司,像我之前买了非常多的 chrome 浏览器的插件会员啊,光这些插件会员基本上一年也要几千块钱。但是我刚刚只花了十分钟,就让 opencolor 帮我做了一个插件,能够完成对网页的总结以及基于网页内容的实时问答。 我后面准备让 openclaw 帮我把之前买过会员的插件都重新做一遍,那这样的话,就等于说我只花了一个买 coding plan 会员的钱,像智普的 coding pro 啊, 一个季度才四百多,但是呢,它就能够实现我之前买过的所有这些插件功能了。所以呢,来回答网上很多人的一个问题,就是你买 token 的 钱, openclaw 能帮你赚回来吗? 其实很多人在算账的时候,往往落入了计算电费的陷阱,但是忽略了生产关系重构这个背后的巨大红利。 以前的生产模式里面,想把一个复杂的创业落地,最难的呢,不是没钱,而是凑齐人。而且呢,把事情说清楚的成本太高了。说一个不懂技术的投资者,他想做个自动化工具,就要花很长时间去招人,而且呢,工资还要开的高, 而且彼此建立信任也非常费劲。但是 open klo 带来的技术平权,说白了呢,就是把雇人的钱变成了算力的钱,一个人再加上足够的 token 呢,就能够顶得上一整个团队。这个变化一下子呢,就把创意到落地之间的坎儿给磨平了。 那你不用再花那些没法算清楚的精力去管人,也不用扛着社保公积金的压力,只需要付时时产生的算力的钱就行了。在技术越来越普惠的当下,这种能够让你实现梦想的入场券性价比确实是非常高的。 对我们个人用户而言,看来这种成本就不能只盯着软件花了多少钱呀,而更应该从机会成本和自己一个小时值多少钱来算 啊。在以前我们见过很多次工具会代替人的一些技能啊,但是 opencloe 引领了这波 agent 浪潮,把这种替代做到了极致,就是技术门槛彻底没了。现在呢, ai 能够帮你调试终端指令配置环境、写代码, 那以前那些困扰很多人的 know how 的 问题,现在变得特别简单,甚至不用怎么费心了。这就意味着,以前那些能够拿着高薪的编程技能运为经验已经不再是稀缺的香饽饽了,反而呢,变成了人人都能用到的基础配置。 对于我们每个人来说,已经不再是你要去学着适应机器,而是逼着你去直面自己创造力的上限了。

32傅里叶的猫AI 04:29查看AI文稿AI文稿

04:29查看AI文稿AI文稿ai 大 模型呢,为什么要按照托肯收费?同样是一百万的托肯呢?为什么价格能差三十倍?等等,你可能会说啊,我们平时用的豆包啊,元宝啊,也没交过钱啊。没错,咱们平时用的网页版或者 app 呢,确实是免费的,那是大厂为了抢占市场给的福利。 但如果你是专业用,或者是使用最近爆火的小龙虾,那就必须通过 api 接口来调用大模型,按量付费,烧起钱来也是非常吓人的。那这些钱到底烧在哪了? 当模型正式发布后呢?它的使用成本其实由两个部分组成。第一部分呢,是固定成本,也就是模型上线前已经砸下去的钱, 包括前期的研发与训练投入,还有算力基础设施的建设,像建机房,采购显卡,配齐内存和硬盘。最近大家可能也注意到了,显卡和内存价格是一路上涨,很大程度就是因为 ai 需求暴增呢,把硬件价格也推高了。但这些成本呢,有个特点,它是沉没的, 在模型发布前呢,就已经支出了,随着用户越来越多,这部分费用呢,会被不断贪薄,贪到每一次调用上呢,它的占比会越来越低,甚至低到可以忽略不计。 那第二部分呢,是动态成本,也就是每一次调用模型实打实消耗掉的东西,每次计算都要消耗电力,还需要占用内存, 数据在传输过程中呢,也需要消耗网络流量。而所有这些消耗呢,都和 token 的 数量呢,直接相关。这里呢,快速同步一个概念。到底什么是 token? token 的 中文呢,可以翻译为词源,可以是一个字,一个词,一个分词,甚至一个字节。在大模型中呢,被表达为一组数字序列,用于计算下一个 token。 token 越多呢,模型的计算的时间就越长,占用的算力和资源呢,自然就越多。所以,按照 token 数量收费,本质上是一个多用多付少用呢少付的计费方式, 非常直观呢,也非常合理。这像什么呢?就像我们每个月交的水电气一样。从这个角度看呢, ai 正悄悄完成一个转变,它正从一项技术、产品呢,演变成一种基础服务。我们想要获得智力呢,就需要购买算力。 说不定以后每个月的水电账单旁边呢,就会多出一行 token 费用。那既然都是按 token 收费呢,为什么不同大模型的价格差这么多?比如你输入一百万 token, deepsea v 三的收费呢,是零点二八美元,而 g p t 模型呢,要二点五美元。如果是输出 token 呢,差距更夸张, deepsea 呢是零点四二美元, g p t 呢是十五美元,整整差了三十多倍。 同样都是 token 呢,为什么价格能差出这么多?其实 token 的 价格呢,主要是由两个因素决定的。第一,电力和人工成本不同。在美国、中国、中东等不同地区,电价运为成本,人力成本差异非常大,而这些呢,最终都会反映到价格里。第二呢,算法不同。 好的算法呢,就像一台省油的发动机,同样是跑一百公里啊,有的车呢,只需要三升油,而有的车呢,却要烧掉十升。大模型也是一样,算法呢,设计的越巧妙呢,达到同样质量的输出,消耗,算力呢就越少。所以优化算法是模型研发人员最最重要的任务之一。 算法越高效,成本就越低,价格自然就更有优势。在这方面呢,有很多创新的工作,比如 deepstack 引入的 mo 机制,想了解的朋友可以翻看我之前的这期视频。 那为什么输出托管的价格比输入托管贵这么多?原因呢?很简单,输入和输出呢,干的活不一样。输入的托管呢,是你的提示词, 模型可以一次性全部读取参与计算,多一个少一个呢,对显卡的负担影响呢,是有限的。但输出 token 就 不一样了,它是一个接一个逐自生成的,每生成一个 token 呢,模型都要重新算一次。输的 token 是 配角,输出的 token 呢是主角,所以给出的片酬呢,就不一样。 具体的技术原理呢,也可以看我这期视频,理解注意力机制对托根计算量的影响。这里呢,再顺便澄清一个常见的误解,托根的发明初衷呢,不是为了计费。 托根是纯粹的算法创新和工程发明,是为了把人类的语言翻译成机械能听懂的数学坐标。 只是后来大家发现呢,托管的数量呢,恰好决定了计算量,这才顺理成章的用它来计费,绝不是因为要收钱才搞出来这么个复杂的概念。当这里可以像自来水一样按量计费,一个属于算力文明的时代就真正开始了。

950陈兴AI 04:01查看AI文稿AI文稿

04:01查看AI文稿AI文稿中国找到了一种新的出口方式,不出口一度电,不出口一块芯片。但全世界都在为中国的电力买单,听起来不可能,对吧?但这件事已经发生了,而且有一个专门的名字,叫做 token 出海。我之前那条五十四万播放的视频讲过, token 是 ai 时代的消耗品。 ai 每回答你一句话,每执行一个动作,背后都在燃烧 token。 黄仁勋刚刚在三万人面前说了同样的话, token 是 新时代的大宗商品。 那么现在问题来了,这些 token 是 哪里生产的?谁在为他买单?答案越来越多地指向中国。一个美国的程序员打开电脑,调用 deepsea 的 api 写代码。他敲下回车的瞬间,请求数据通过太平洋海底光缆到达中国西部的数据中心。中国的 gpu 集群消耗着中国的电力, 让他把代码跑出来,结果再传回美国。整个过程不到一秒钟,电没有离开中国,芯片没有离开中国。但是这个美国程序员这次的服务付了美元,他买的是什么?就是 token。 token 的 成本就是电,中国的电通过 token 这个主体,变成了美元收入。这就是 token 出海 规模到底有多大?我给你几个数字,你感受一下。二零二四年初,中国 ai 日军 togo 消耗量是一千亿,二零二五年中突破三十万亿。 二零二六年二月一百八十万亿,十八个月暴增了三百倍。在全球最大的 ai 模型平台 openroot 上, 中国模型的调用量已经占到了百分之六十一,前五名里,中国占四个。 mini max 上市前,百分之七十的收入来自海外。 kimi 的 海外 a p i 收入增长了四倍,已经超过国内。这些公司赚的是什么钱?是全世界的开发者调用中国大模型时,一个 token 一个 token 浮的费。 为什么全世界要买中国的 token, 而不买美国的?一个字,便宜。 mini max token 价格是每百万 token 零点三美元, cloud 同样的服务要五美元,差了近二十倍。能力差多少? mini max 的 代码能力测试拿了八十点二分, cloud 是 八十点八分, 只差零点六分,价格差了二十倍。你是开发者,你会怎么选?为什么中国能做到这么便宜?因为 token 的 成本百分之七十以上是电力和算力。 华泰证券说了一句话,中国低电价优势正在转化为全球 ai 服务的定价权。中国全社会用电量超过十万亿千瓦时,是美国的两倍多。新疆的绿电成本低到零点二元一度, 这些电大量闲置着,因为当地用不完。现在通过东数西算,把数据中心建在这些电力富裕的西部地区,用便宜的电生产 token, 再通过光缆卖给全世界。电没出境,钱进来了。这件事为什么现在爆发了?因为 ai 的 用法变了。 以前大家用 ai 就是 聊聊天,一个人一天消耗几千个 token。 现在 open cloud 火了, agent 火了, ai 从一问一答变成了自己干活,一个 agent 执行一个任务,可能从消耗上亿个 token。 有 人算过,从聊天模式切换到任务模式,人均 token 消耗量翻了一百倍。一百倍的需求增长,谁的 token 最便宜,谁就吃到最大的市场。中国模型的价格是美国的几十分之一。直接接触了这波需求爆发。你可能会问,这跟我有什么关系? 如果你是做生意的, tokyo 出海告诉你一件很重要的事, ai 的 使用成本在快速下降。如果你今天觉得用 ai 太贵,可能半年后就便宜到你用得起了。因为中国的 ai 公司正在用低成本的电力和钻力把全球的 ai 价格打下来,你的竞争对手可能很快就会用上几乎免费的 ai 工具来降本增效。 如果你关心中国经济的大方向, token 出海可能是继中国制造之后下一个出口引擎。过去三十年,中国出口的是衣服、鞋子、手机、汽车。以后中国出口的可能就是 token, 用中国的电,中国的芯片,中国的大模型,生产全世界需要的 a f 五、 政府工作报告里写的算电协同智能经济新形态落到产业层面就是这件事儿。 minnes 的 创始人算过一笔账,海外用户为软件付费的意愿是中国用户的五倍,再乘以七的汇率,就等于三十五倍大的市场。 token 出海就是吃这个三十五倍市场。 之前我说 token 是 ai 时代的石油,现在可以加一句, token 出海就是把中国的电变成全世界的石油。我是文思,关注我,每天带你看懂 ai。

2.3万文斯说AI 00:55查看AI文稿AI文稿

00:55查看AI文稿AI文稿很多人好奇 ai 买 token 到底是什么?今天一分钟给你讲明白!首先, token 官方叫词源,是 ai 处理文字的最小语义单位,不是字也不是 词,更像 ai 的 语言积木。中文一个字约零点六个 token, 英文标点数字也会单独计算。简单说,你向 ai 提问, ai 生成内容都会消耗 token 平台。按 token 数量计费, 买 token 就是 预购 ai 的 服务,与算力额度和手机充流量。加油!按生计费是一个道理。免费版通常有 token 上线次数少,次数受限。付费购买 token 能解锁更高额度、更快速度、更强模型与更长上下文,用多少扣多少,用完再续。 重点提醒, ai 买 token 是 买服务额度,不是买虚拟货币,别混淆概念。一分钟总结, ai 买 token 等于花钱买 ai 文字处理额度计量计费,按需使用,高效解锁 ai 全部能力。

6电脑知识 02:00查看AI文稿AI文稿

02:00查看AI文稿AI文稿最近很多人都在说 ai 开销太大了,头坑太贵了,真的吗?我们换个角度聊一下呢?我最近花了大概五百美金的头坑,开发了一套文档写作系统。你可能会说,写文档随便哪个 ai 一 句话的事情,你花五百美金,你傻吗? 但是我这套系统不是帮你写个文档那么简单,它可以多端同步管理我的所有文件,接入了我的自建知识库,有一套完整的多账号体系,而且支持多人协助头脑风暴,还有我自定义的多种工作模式, 一键切换就能产出完全不同的方案内容。你告诉我,市面上哪家 ai 能做到这种程度的定制化,还能随时按照我的想法迭代更新?没有, 因为这不是一个通用产品,这是一个完全按照我的工作流量身打造的系统,开发周期有多长?一周 甚至很多功能细节是我拿着手机在聊天框里完成迭代的。五百美金,大概三千多块钱人民币,这笔钱你能在市场上干点什么呢?你能请到两位技术大佬,一位前端,一位后端,帮你从零开始开发部署到云端,还是说能够保证七乘以二十四小时的运行呢? 比如说三千块、三万块钱,你都不一定搞得定这个事情。所以你看,五百美金的头壳,买到的不是五百美金的文字输出,买到的是一个完整的可持续运行、可以迭代的生产线系统。这笔账怎么算都不亏。 那什么才叫贵呢?如果啊,我,我是说如果你的龙虾背后挂载的是 cloud 四点六 opus, 然后你用他问今天天气怎么样,打开网易云音乐,放首歌,或者搜搜附近有什么好吃的,那才是真的贵。头啃从来不贵,用错地方才叫贵。

72游戏阿龙

猜你喜欢

- 5432TapTap