openclwa配置token

今天给大家上点硬货,组装完一台全新的主机,显卡直接上的英伟达的五零九零,整个配置拉满通电,点亮的那一刻真的太震撼了,成就感爆棚。今晚的任务呢,就是在这台新的主机上部署本地化的大模型,还有咱们的 open club, 等测试成功后以后生成短视频又 open clock, 再也不用担心 top 不 够了,而且也不用担心任何资料的泄密了,只要有电,想怎么照就怎么照,完全自由。这就是个人的本地化大模型的部署,后续的效果我会持续的跟大家分享。

粉丝89获赞365

相关视频

04:38查看AI文稿AI文稿

04:38查看AI文稿AI文稿大家好,今天给大家演示一下菲林的泊泊的。嗯,配置方法。嗯,这个,嗯,菲林的泊泊安装挺简单,就是在应用中心中。嗯,点安装就行了。我这个已经提前安装好了,它这个安装的时候会提示安装两个插件先。嗯,然后再安装。 然后我这个菲林是刚装的系统,里面也没什么数据,用的是惠普那个 t 四三零的那个小主机,能用菲林装主要是因为这个安装门槛非常低。 嗯,咱们下面打开这个 windows, 然后,嗯,再打开外部页面,大家可以看见这很轻松的就打开了,不像像其他的那个安装方式,还需要配置一下才能打开这个。嗯,外部窗口,这都是飞牛都提前配置好的。嗯,我们来使用就可以了。 所以说安装的口很低嘛。这个飞牛的配置主要就两项,这个模型配置跟消息渠道。咱们先配置一下模型,咱们这是选择自定义, 然后这个选择模型名称,咱们可使用的是。呃,轨迹流动的那个服务,需要大家先注册一下。呃,这个有两千万的那个免费 token, 而且模型广场中就是目前的主流模型都有,大家可以随便选择使用,我们选择这个 mini max。 二点五来演示,复制一下它的名称,粘贴到这下面,这里是添加那个。嗯,轨迹流动的服务地址,咱们到这个轨迹流动这去复制一下, 然后回来,然后粘贴。嗯,然后再往下这个地方就是需要配置它的认证密钥,就是 api 密钥。嗯,咱们也复制一下,然后再返回来粘贴。 哎,怎么不能确定?哦,上面这块是啊,上面这块要点击添加,然后再点保存,这样模型就添加成功了。嗯,然后下面需要去配置一下。呃,消息渠道,这个需要等它刷新一下,它这个默认是已经安装了飞书, 我们这次是,呃安装一下微信,这里直接点装安装微信就可以,这里需要大约等个两三分钟吧。嗯,他安装好了,我们就,嗯添加一下,扫一个二维码就可以使用了。 这个安装微信,有的小伙伴们可能会呃提示安装错误,呃,安装好几遍都是提示错误,这个时候大家可以刷新一下状态,它有可能已经装上去了,但是吧,呃,你扫码进入微信之后,呃说话,嗯,这个 openclaw 没有反应, 这个时候大家需要去把那个,呃,嗯,就是微信中那个插件里有一行这个微信机器人的代码,复制给外边端的那个聊天窗口,让龙虾自己去安装一下。啊,这样你就可以在微信跟龙虾进行对话了, 然后提示安装完成。啊,我需要重启一下才能使用。嗯,咱们先点那个添加渠道,嗯,渠道类型选择微信,然后生成二维码, 然后拿手机来扫一下这二维码,然后添加一下那个微信机型就完成了。好,我打开。

77挨踢民工 03:27查看AI文稿AI文稿

03:27查看AI文稿AI文稿哈喽,大家好,我是吴亦纶,最近大家应该都被这个叫做小龙虾的东西给刷屏了吧,各大官方都在进推,连央妈都被他震惊到,甚至一度将 mac mini 都炒到了新的价格线高度, 那普通大众也想去体验一下,他需要很高的成本。别着急,轮子找到了一个量化版的本地部署方式,让你我不想投入太多成本的人也可以感受一下这道小龙虾的味道。 ok, 话不多说,跟着轮子看 操作。首先打开这个网站 one club, 在这里咱们可以选择是 mac 还是 windows 系统,点击下载保存,打开咱们下载微键,直接点击运行。 好,这就是我咱们一个安装完成的一个页面,点击下一步这块需要咱们去配置服务商,这块咱们选择自定义,咱们选择 zai, 打开这个 big model 智谱的 ai 开放平台,在大模型语言模型里选择咱们的四点七 flash, 这个模型目前使用它的 api 调用头肯是免费的, 点击 apikey, 在 这里咱们创建一个新的 apikey, 给它随意起个名字就叫龙虾吧。好,创建成功,咱们复制 apikey, 回到刚才的页面, 在这里输入咱们 apikey 模型,选择四点七 flash, 验证 好了,这就是咱们现在目前一个配置完成的样子,点击启动好了,这就是咱们配置完成的一个完整的效果。咱们新建一个对话,跟他对话一下 这块他的名字是因为之前我已经配置过,所以给他起过名字了,我们最开始进来的时候,他会需要咱们给他起一个称呼,然后还有呃他的一个身份,包括你想要的一个习惯,咱们再做一个测试, 然后他制作完成了,咱们去看一下这个游戏的效果啊,在这里 整体效果看起来还是可以的。 那下期呢?轮子会带大家解锁更多的玩法,包括它的完整配置、 scale 使用之类的,那么这期就到这里,大家下期见。

136极客阿宁 02:13查看AI文稿AI文稿

02:13查看AI文稿AI文稿前两天有粉丝跟我吐槽说用龙虾太费偷啃了,平均一小时就要烧掉一百块,问我有没有节省偷啃的方法。今天就会分享我们在跟龙虾对话的过程中常用到的三个命令,把这三个命令用好,能帮你合理的节省偷啃用量。第一个命令就是杠 status, 这个命令的话呢,是用来指示检查偷啃消耗情况的,当我们发送了这个杠 status 这个命令之后呢, 他就会回复我们这几行信息。请重点看一下这个 context 当前上下文占用的比例,如果你发现下文已经快满了,就要让他去总结和记忆,那让他进行总结的话呢,我们就是会使用到第二个命令放 compact。 这里先给大家普及一个知识点,当我们在聊天界面跟龙虾对话的每一条消息,龙虾都会记下来,存到一个叫 scissor 的 文件里,当你输入一条新的消息给他的时候,龙虾就会把最新的一条消息加 scissor 里面保存的历史消息一并发给大母星,这样的话就会导致我们 to call 的 消耗会增加。那你使用 compact 这个命令是来压缩历史对话的,它压缩的话就是龙虾在 scissor 里保存的历史消息。 你看,当我发送完这条指令之后,他五九 k 的 对话内容压缩到了二点六 k, 就是 节约了很多上下文的空间。那第三个命令就是杠六,清空上下文,开启全新的对话。这个适合的场景就是当你的龙虾完成了任务一以后, 你又给他布置了任务二,这个时候的话呢,是其实是需要自己评估一下,如果任务一和任务二没有任何关系,你就可以使用杠六这个命令来清空一下上下文。 我不清空一下,龙虾在做第二个任务的时候,就会混着你任务一的对话记录一起传给大模型,那这样其实也是一种偷啃的消耗,浪费了你的偷啃,同时速度也会变慢。 当我发送了杠六这个命令之后的话,他给我反馈了这样的一条提示,就是告诉我可以开启一个全新的对话了。一个杠六的话,大家可能会担心,这样做我的龙虾不就失忆了吗?重要的信息我要让他保存下来,怎么办呢?那这个就需要 memory。 当我跟我的龙虾说了这样的一段非常重要的消息, 加上这样的一句话,以上内容存入 memory, 这样这条重要的消息呢就会存在 memory 里。存进去之后的话呢,你再使用前面的杠 compact 杠 new 命令,也不会对它产生任何影响了。最后建议大家还是要选择一个 ottoman 模型套餐来用,像是阿里云百联的 ottoman, kimi 的 ottoman, 评价都不错,性价比也挺高的。

542AI产品经理美洋 01:01查看AI文稿AI文稿

01:01查看AI文稿AI文稿三十天烧了十九亿头啃。分享这三个 open core 的 设置,解决卡顿问题,好多同学遇到过呀,问 open core 一 句, 他好久不反应,你都不知道他是卡死了还是在偷偷干活。所以第一步,先打开思考过程,用这两个命令瑞兹尼昂和沃尔堡昂开启后, open core 的 会把思考过程和工具调用的过程啊全部打印出来,这时候你只要看到屏幕还在刷内容,就说明他还没有卡死。 第二,很多人不知道 oppo qr 默认不是流逝输出,他会全部生成完一次返回。这时候只要执行这一句话, 开启之后,回答就会一边生成一边输出,你就能看到他回答到哪一步了。最后一步非常关键,如果你发现小龙虾越来越慢, 那就输入杠 status, 看这个指标 context, 如果它的上下文占比超过了百分之六十,那不用犹豫,直接执行 compact 压缩上下文,这样不仅更省 token, 而且速度会明显变快。所以你还遇到过哪些不好用的问题呢?

404建斌聊AI 06:54查看AI文稿AI文稿

06:54查看AI文稿AI文稿coding plan 是 啥?俗称虾粮,其实就是 token 的 套餐,因为龙虾在每一步都需要消耗 token 消耗量大,所以需要有套餐才不至于花费太高。目前很多厂商都推出了自己的 coding plan, 国内的主要有字节,阿里、腾讯、百度、智普、 mini max, kimi, 还有其他的一些公司,价格不一样,支持的模型也有区别,大家按需购买。那是不是大厂的云主机只能用自己的 coding plan 呢?不是,但如果你的云主机在部署的时候使用的是大厂提供的 open cloud 镜像,那么有的大厂的云主机只能配置自己家的 coding plan。 那 么遇到这种情况,如果你想用别人家的 coding plan, 就 需要我们自己去配置了。接下来我来演示整个配置过程。先说一下我的环境, 我用的是阿里云的清量服务器,然后呢,因为我没有其他的 coding plan, 所以 我还是用的阿里云的 coding plan, 你 们可以拿这个作为参考,其他的 coding plan 配置也是一样的。 咱先到 coding plan 的 界面,你也可以看到有一个套餐专属的 api key, 这个你把它复制下来你会用到。还有 base url 就 有两种,一种是支持 open ai 协议的,还有是支持 iso project 协议的,两种去任一种都可以优先,我们就选 open ai 的, 然后这个下面它是 coding plan 支持的模型,任选一个,把它的名字给 copy 下来,它这个名字就叫它的 model id。 好, 拿到这么几个信息之后,我们就可以去配置 coding plan 了。 来到云主机的管理台控制台,通常这个控制台呢,你看点开它的管理界面,它可以在 ui 上就直接配置,但是这里呢,你看到它不能配置其他厂家的 coding plan, 所以遇到这种情况呢,我们就需要跳入到这个系统里面去,登录到系统里面去,进入到远程连接登录, 先输入 opencloud config 命令, 进入到了 opencloud 的 一个配置的流程里面。首先选这个 getaway 的 配置 local, 这个直接默认就可以了。然后选择 model, 这里是配置模型的, 因为它原声支持很多模型,但是呢,我们用的是 code plan, 所以 我们直接选最下面,下面有一个叫做 customer provider 这个选项,选好之后,这个 api base url 就是 刚才我们复制的。把这个 url copy 进去, 好回车,接下来它需要 api key, 然后我们再把 api key 复制进去, 接下来他会问你是兼容哪一种模式协议,那么我们刚才使用的是 open ai 的, 所以我们就继续选择 open ai 的 这种兼容就可以了。 接下来 model id 就是 刚才我们选择其中一个模型的名字,一定要用复制好的这个 model id 填进去,不要填错了,这里我们直接填的是 kimi 连五, 好回车它就开始验证,看到验 refiification successful, 那 就通过了。好,后面有个 anonote id, 这里呢,因为我用的是阿里,所以就直接叫做百炼, 你也可以去根据你的 coding plan 里边看一下它的 endpoint id 是 啥。最后呢,是让你填写这个模型的别名,刚才我们是 kimi k 二点五,那我们这里的模型我随便取个名字就叫 kimi 二点五,当然你不填也是可以的,就空着也可以,然后这样模型就配置完成了。 continue 好, 最后把这个网关重新启动一遍。 open cloud restart getaway restart open cloud getaway restart。 好, 网关启动成功之后,我们可以先进入到 open cloud t u i 这个命令,进入到一个 t u i 的 界面,这个界面可以快速验证和它模型开始对话,跟龙虾开始对话, 问一下 hello, 看他是否有反馈。好,他回答我们了,那证明配置是成功的,那么你也可以看到,在这个右下角显示了是 k m 二点五, 那我们再问问他,是不是真的用了 k m 二点五这个模型。 哎,他反馈了,用的确实是 kimi 二点五。好了,这样的话呢,你的 coding plan 就 部署到云端了,那么接下来呢?因为 coding plan 里面支持好几种模型,那么我们如何把其他的模型也配置进去呢? 你可以看到啊,在一些 coding plan 里面的文档里面啊,它会告诉你配置这所有的模型,它会给你一个接收文件,你把这个接收文件啊全部给拷贝下来, 包括这个简短的说明啊,都可以一起考。然后把这一段全部丢给刚才这个模型,告诉他,你说请按照这个文本这段话,把这个所有的模型都配置进去。 好,接下来我们的龙虾就根据你提供的文档自己配置其他的模型, 这块要花点时间。当然了,这块除了在 tui 里面,你也可以在 web ui 里面,或者是你的飞书已经配好了,你甚至在飞书里面跟 openclaw 去对话,把这一段对话全部丢给它都好。最后配置完成,它自动重启了网关。 好,我们可以看到这个网关全部都已经更新了,配置也都更新了,我们再来跟他确认一下。先问一下, hello, 看他是不是有反馈。好,他有反馈,他并且告诉你,哎,我这些模型都已经配置成功了,那我们来尝试一下换一个模型,那么这里我们会换 mini max 二点五吧, 直接跟他说,请帮我们把模型更换为 mini max 二点五, 看它是否能更换过来。 诶,成功了?好,你再确认一下,看它是不是真的成功了。好,这里面右下角已经显示了它是用的 mini max 二点五。那我们再问问它是不是真的 啊?你现在用的什么模型?看它的反馈啊。他说,我现在用的就是 mini max 二点五。好,这次 coding plan 就 全部配置完成了,大家看看还有没有什么其他问题,欢迎在评论区交流。

89冯哥飞呀飞 01:02查看AI文稿AI文稿

01:02查看AI文稿AI文稿万万没想到,让当下最火爆的 open clone 帮我们赚钱,结果他却要我们先花钱给他充 talking! 本期视频就来教你白嫖上千万 talking 的 神操作!首先打开这个网站,下滑找到这个输入输出都是零元的 deep secret, 轻轻一点它就会弹出详情页,点击打开这个 a p i 文档后,直接在 post 栏下复制这串网站的域名 url, 然后我们打开电脑自带的命令提示, 以管理员身份运行后,我们下滑找到龙虾的 api 配置页面,把刚才的 url 域名复制到下面后,回车,龙虾就会问我们索要 apikey, 此时我们再回到刚才的网站,找到 apikey 秘钥栏,新建一个自己的 apikey 后,我们点击复制,然后粘贴到龙虾的 apikey 索要栏下,继续回车, 等它提示我们输入模型 id, 再回到 deepseki 的 详情页的最顶端,点击这个复制符号,模型 id 就 已经到手。 此时只用粘贴到输入窗口,然后回车,一个无限 talking 的 龙虾就已经配置完毕,此时随便给他发布什么任务,等他完成后,我们进入消耗后台,可以看到我们已经消耗了十二万的 talking, 却没有花一分钱。

4447讲ai的老韩 04:06查看AI文稿AI文稿

04:06查看AI文稿AI文稿呃,我现在演示一下那个怎么去。嗯,配那个 open call, 就是 如果用那个自定义的那个 open ai 的 那个端点的话,就这是一个空白的命令。行,然后我这个就是这个讯基已经安了, 就是你没安的话,其实步骤差不多,只不过我安装了的话,我用这个命令,然后我重新选择一下,如果你没有安装的话,你直接拿脚就是那个官方的脚本直接运行就可以, 就是弹出的画面差不就是一样的。然后我点继续,然后继续, 然后继续到这个模型提供商的时候,你选倒数第二个,就是这个用自定义的那个模型提供商,然后选择让他给你一个视例,然后你把它删了就行。 就是我这边是给了你一个,我应该是给了你一个端点,给他复制到这 一敲回车,然后他让你输入那个 api k, 然后把 api k 粘到这儿,然后继续, 然后他问你,呃,要这个兼容吗?啊,对对,就这个兼容的,这个这个组合的这个就选是就可以了,然后你输入一个模型 id, 你 比如说你用 gpt 五点二的话, 啊,这不要数错啊, gpt 五点二中间有一个杠,然后回车,他验证, 啊,这是验证成功了啊,这个回车就可以啊,这个别名回车,然后这这这我已经配过了,其实不用管我挑过 啊,这个也挑过,继续就可以,让我重启, ok, 他 让我,嗯,这个继续就行,打开那个 u i, 嗯,可以了, 它已经连接了, ok, 这就已经成功了, ok, 这是没有问题的。然后就是有一点要注意啊, 我先敲回车,就是如果它不行的话,就是配完不行的话你注意一下,你检查一下这个文件,就它的主配置文件, 就这个文件,然后点回车这边的话是 下面的是幺六三八四这个。

95高小卫软件 01:46查看AI文稿AI文稿

01:46查看AI文稿AI文稿你是不是天天刷龙虾的视频,焦虑的睡不着,但是一打开电脑呢,配置个三天偷啃烧了几百块,最后连个屁都没跑出来。这个叫什么?叫做龙虾溺水?不是说小龙虾不行啊,而是你还没学会游泳,你就往深水区里面去跳。说白了,配置这个东西啊,它其实就是个铲子陷阱,你在挖矿之前,你花了三个月的时间去造铲子, 结果最后矿也没挖到,产灾生锈了。而且更关键的是,你又会焦虑自己没有上小龙虾这趟车,没跑起来,你会去浪费自己的注意力和精力。你知道小龙虾的配置有多坑吗?上周我见了个兄弟,光是调试个 api key, 他 就花了一周的时间。而且最坑的还不是配置,是模型的选择。 你以为你选个便宜的就能省钱吗?我跟你说纯属扯淡,国产的模型它真的差点意思,它问题解决的能力不给力,你会卡在新手村反复的打转,反复的在这折腾,最后你就会发现,你的时间全部浪费在了一些很蠢的问题上。真正你要做的一件正事没有跑起来,全是在解决一些配置错误的问题。 有几个点也得清楚。第一,一定要用顶级的模型,不要去省那点钱,闭眼上 chad, gpt, cloud, ops, 如果这些进口的实在连不上,你就去用国产旗舰,像 mini max, 二点七,智普、五点零都可以,不要去贪图便宜的。第二个,各种云部署的龙虾大肠的那些啊, 没啥实用性,他就是个定时助手,手机日历都能解决这些问题,你真的想去尝尝鲜? ok, 可以 的,零基础的小白,你就当个老头来玩一玩就行了,不要拿来当做生产地。工具 发给你,看到那些引流视频,什么全自动一键解决问题的那种,还差着十万八千里,等以后这个工具真的成熟了,我们再去买解决方案就行。第三个,龙虾玩不溜不丢人, 我身边百分之九十的人都不知道龙虾是什么,还问我是十三香还是麻辣的。最后一个点啊,玩龙虾这件事情呢,先完成再完美,不要让工具的焦虑去绑架你,把注意力放到要解决的问题上才是对的。你现在卡在哪里?评论区聊聊。

02:31查看AI文稿AI文稿

02:31查看AI文稿AI文稿哈喽,大家好,最近一个礼拜比较忙,很多很体系的一些视频就没办法很好的去制作。今天先简单的来分享一个我觉得非常实用的一个技巧, 直接可以让你在使用 openclip 的 时候节省大约百分之九十五的头壳,而且配置也非常的简单,我们可以在它的官方文档里面,在 getaway and ops 的 这个章节里面找到 heartbeat, 拉到最下面有一节叫 cost awareness, 它就是讲 delete 的 一些花费上面的小技巧,大家尽量去看它的英文原版,因为其他的教程说明文档我目前没有看到这一节的详细说明,它配置起来是非常简单的, 那我看到的时候也在第一时间在我的分享群里面把我的这个小技巧在分享给了其他的群友。我们可以在配置文件里面写上 heartbeat 这一节,然后配置。最主要的配置是这两个字段,一个叫 light context, 还有一个叫 isolated session, 特别是这个字段比较重要,那这个字段的意思是说,我们 每次 hardbeat 去大模型拼接提示词的时候,只要关注 hardbeat 点 md 那 个配置文件就可以了,其他的 so agents memory 都不需要,那这样它就把提示词的 token 数就直接减少下来了。 第二这个字段的意思是说,我不需要更多的上下文,我是一个新的一个 session, 或者说叫独立的一个 session, 它设置了这个值之后,直接可以为你省掉百分之九十五的 token 数。 官方的是说可以直接把一百 k 左右头克直接变成了二到五 k, 所以 这个子弹也是相当的给力的,大家可以去试一试。另外一个如果你想配,也可以把这两个子弹一起考虑一下,第一个子弹就是把发力臂的心跳数节省,把那间隔拉长,减少它的心跳次数。 第二个你可以设置一个轻量级的模型,因为我配的是口袋,所以我就挑了一个比较轻量级的,但是其实这个不是特别重要,最重要的还是这个,如果你把这个省下来之后,这两个不改,问题不是很大。今天就分享这么一个小技巧,虽然还有很多的内容值得分享,因为最近其实也有很多的经验, 比如说我觉得这一节就非常的有用,网络抓取的能力和搜索,我把目前我觉得比较好的一些搜索能力都罗列了一下,但是也没有时间去很好的展开的一个讲解, 所以就只能过一下。因为我在最近去配置网络的时候,发现很多的一些问题,可能有些会被平台检测出来, 那不能用,所以我找了多个产品交叉式。今天的分享就到此结束,主要还是和大家分享一下怎么节省这个 token, 因为这个确实挺实用,而且也比较简单,大家直接拿去就可以分配了。好的,希望今天的分享对您有用,再见!

07:51查看AI文稿AI文稿

07:51查看AI文稿AI文稿如果你真的去用了 oppo, 那 你就会知道他有多难用。发完消息没声了,联网查点东西要配 a p i, 但有的时候他又能查到,这种时刻我就很惊喜,我说这可太好了,你刚是咋干的,记一下以后就这样搜,结果呢,没两天他就又忘了,然后跟我道歉,这期间压根就没记。 其实都不是什么大事,但官方的这个默认配置,它就用着各种不爽,这些坑我每踩一个就解决一个,然后让 ai 把经验总结一下,最终把它们汇总,形成了这一整套的 skill。 双击加关注啊,私信优化龙虾这四个字就能够自动获取。这个 skill 全程只用跟你的小龙虾对话,就能把整个的优化流程给做了。 简单去演示一下,然后官利回答一些弹幕的疑问,直接给你的小龙虾发送这条消息,他就会告诉你我们开启了一个 open cloud 配置优化向导。第一步是备份,他会备份你的整个 open cloud 程序,万一出了问题,那你就直接解压就能恢复,这个是最起码的保障。 整个 scale 分 为四层,那第一层是基础的优化,这几个功能我都很建议打开,比如说消息回执,原先你发了消息就只能干,等打开这个他处理的时候就首先会给你点个引猫记,直到他收到正在处理了,这个真的能够极大的缓解你的焦虑。这个记忆功能,如果你打开增强和每日规章,他就会在你上下文快满的时候强制去写入一次记忆, 并且在每天晚上的十一点钟最佳总结一次。第二轮他会根据你之前选择的渠道进行优化,然后是第三轮,我推荐了一些我自己觉得还不错的 scale 啊,大家就各取所需,这个具体就不展开说了。然后是最后一轮,我写了一个渠道的添加向导, 反正我个人是在用了飞书之后,就会好奇说其他的渠道他的体验什么样的啊?我就假定大家跟我一样就玩了一阵子,就想试一试其他的渠道,所以我就把我自己整个介入的过程都录了一下,并且总结成了一个非常详细的步骤,你去按照这个来做,同时把各种需要的信息去发挥,你的小龙虾他就会帮你自动配置好。 好了,这个 skill 我 们就先说这么多,接下来呢?啊,我来看看弹幕,有朋友说你 open cloud 推荐什么样的模型。嗯, 这个问题其实我可能跟其他的博主有点不太一样啊,我曾经也是一个盲目去崇拜大参数大模型的人,比如说 cloud 或者是真未来。 那用了小龙虾好像会发现没有必要,因为他更多的时候就是去啊调用各种工具去搜索,定时删改文件,那只要这个模型的 a 帧能力他够用,调用工具的时候能够准确的识别你的想法,那么在速度快价格低的情况下,我觉得世界知识或者说智商他差一点就是可以接受的。 当然了,如果你侧重的是生产力的编程场景,那其实大家都会去用那个 cloud code 或者是 codex 这样成熟的编程 agent 啊,他就需要去理解整个代码库的各种依赖嘛,然后与异的关联模型能力越强,他就越能做出正确的判断,就是编程这种场景,你还是去用最顶尖的模型去干吧,它能省不少的事儿。 我自己其实已经收集了有一百八十多家中转站啊,也确实是阅战无数。在这里呢,我会推荐一个我自己在用的比较稳定的 api 中转站,叫做接口 ai 这个平台,它是集合了各种顶尖的闭元模型,国 外的四大顶流模型它都有,需要写作,我还是推荐你找世界知识更强的 jimmy, 它就是有点慢,需要编程。那我还是推荐你用 cloud, 它就是有点贵。 而我刚刚所说给小龙虾用一些更快更清亮的小模型,比如说 mini, max, kimi, 还有质朴这边也是非常的齐全,只需要用他的一个请求地址填上密钥,你的钱软件就可以瞬间多上几百个模型,充一份钱,想用哪个就用哪个 好。第二个问题我,我看别人 u 盘卖了二十六万,但安装一单两百,我看的心痒痒,那你怎么看? 就是你心痒,谁不心痒呢?就这个事也能理解,但是最近也确实是有点太魔幻了,从线上到线下各种活动,到现在开始付费卸载,就在我的概念里,安装它不就是一行命令的事吗?那卸载也是一行命令的事啊, 我知道,就是电脑的环境,网络连接啊,命令行大家可能不习惯,这些都是一些门槛,但是玩过的就都知道,其实难的肯定不是安装这部分,而是在这个过程中的各种坑啊。就像我这些做的这种 scale, 其实就是结合了这么多坑的一个精华, 那在我看来,这些才是比较有价值的部分,从我自己的价值观来说,你去帮别人安装我觉得不太好,因为会给他增加一些这种安全隐患。 而且呢,啊,你装完对吧,你是去收了他的一笔费用,那他后续又去用了各种厂商的模型,钱又进入这些厂商的袋子里面,他呢,玩着玩着感觉好像也没啥劲,就放那不管了。那我觉得这种其实还是有点不负责任的, 大家也都关心说 oppo k o l 怎么变现啊,也确实,甚至有人发私信问说,哎呀,我不了解 a a, 但我想赚钱,你能教教我吗?可以,有偿。 那其实答案通常就写在明面上了,但是这种我就还是拒绝了代安装付费咨询,就这种有点割韭菜的快钱我还是不会去赚的,反正还没到这个饿死的程度。而且这期视频你别看我说什么三连关注啊,什么私信, 其实这个录屏里就已经有我那号命令了呀,你直接截个图就发给你小龙虾就可以了。这个 sky 我 也没有什么藏着掖着的,社会战前,其实我想象中有价值的变现方式,其实是用小龙虾去做一些比较成熟的解决方案,能够呃帮一些人或者说一些行业去解决一些问题。 这种卖解决方案肯定还是最高级的,但是目前他不太成熟,我也没有见过有做的特别成功的,再稍微低一点,我觉得我也能做的,其实是去卖课。说实话我不觉得这是贬义,就比起你那些单安装啊,实打实的去教会你这个东西是怎么回事,把它给讲透,这个肯定会负责的多。 嗯,但大家也不一定都有这个耐心去学,而且这个时间点其实也有点晚了,该学的也都学会了,不该学的可能他也不感兴趣。嗯,后续应该也会有各种厂商去做一些简化的安装步骤,或者说各种方案出来。嗯,所以这个可能我也不会去做了。 好,我们看第三个啊,看了你两期视频了。好,谢谢啊,上期视频你也看了?我还是感觉 open color 没有什么用。你到底用没用 啊?其实我确实是烧了不少啊,上一期的结论,或者说上一期我确实是想试图去总结这个,解答这个问题,但 阶段他解决的不是一些痛点,都是一些痒点。这个我也认同。我再来说一下我的想法啊,就是如果你是一些传统的重复性的工作,那其实你用 ai 模型其实是费力不讨好的,反倒因为模型会有幻觉,有可能会做错,这种我们就真还不如用传统的程序去批处理。 而真正去利用 ai 模型的创造力做的一些工作,我们也有了 cloud code code s 还有 open code 的 这样的一些成熟的编程 agent, 就 你给他一个需求,人家就先起一个 plan, 然后在分布中去跟你实现,期间去压缩上下文,它也稳定的多。如果你要干的是严肃的大火,那限阶段还得适用他们。 我依然是不推荐你啊,一边逛超市,一边去跟你的小龙虾去聊一些大的火。那小龙虾它自己适合的场景呢?啊,它的核心优势,我上期说了,它就是二十小时在线, 我呢会用它去维护我的网站,比如说我刚那个 a p i 的 中转站,我看到了一个新的站,以往我想去加我真的得脸我的福气,现在我就给他直接发个消息,很随意,这种突发性的小活就很合适。再比如我会突然想到一些点子,那就直接语音输入全部退给他,整理成结构,这种脏活累活就全都交给他。 它的另一个优势就还是在你的本地电脑上运行,比如说我远程连不上我的电脑了,我让他去帮我重启一下 todesk, 我 家的网络卡卡的,我也可以让他去直接重启我的路由器,甚至也可以去控制家里的开关,或者说电视投屏。 对啊,其实说来说去就这点事别的软件都能做,它还是一些洋点,但如果你把这东西全部串起来啊,都有一个入口来操纵的话,其实还挺爽的。 而且你要知道他现在还是一个初步的阶段,就之所以你现在觉得他没什么用,是因为他的生态还没有形成,而且他的出现其实已经在瓦解,各种互联网大厂去花了那么多年形成了一个壁垒了,我个人是依然看好的 他虽然有一些泡沫的成分,也有人说他去啊,是一些厂商去卖 taco 对 吧?故意的这么一个机会,就如果你保持理性啊,不想去参与这场闹剧,我觉得也没有关系,你这样大概去了解一下他的现状也就够了。 好,这期视频呢,我们就先录到这啊,我是大黑,希望以纯人工的方式向你去分享智能。那我们就下期再见。来吧,跟大家说再见,拜拜。

3521人工大黑 00:44查看AI文稿AI文稿

00:44查看AI文稿AI文稿open class 默认配置太烧钱了对吧?我前几天一看一听烧了二百多,后来改了这三个配置,现在控制 plan 完全够用。直接说方法,第一招,别让它老翻旧账。 open class 每次回复都会把之前的对话重新读一遍,有时候发你好也会烧掉五块。这五个指令必须掌握。 new 新任务应重新开始 status 随时查看状态 list, 清空当前的对话 compact 对 话长了压缩一下 top, 他 要是卡了或胡说赶紧停止。第二招,简单活用本地模型,本地跑个欧拉玛能省百分之八十。第三招,不同任务用不同模型,便宜模型干便宜活,贵模型干贵的活,懒人一键脚本 项目里已经写好了五个配置文件,上下文裁剪对话压缩提示词缓存,还有本地搜索好玩,一键脚本自动全配好,我是清晰带你硬好玩 ai。

28清溪AI 02:15查看AI文稿AI文稿

02:15查看AI文稿AI文稿只需三分钟即可搞定。整体分为三步。第一步,在 kimi klo 构建云端 open klo。 为什么选择 kimi klo? 之前我是单独配置 open klo 加单独配置模型的方式,对信手来说步骤比较繁琐。现在可以通过 kimi klo 一 站式将模型和 open klo 配齐。 只需一分钟,在 kimiclock 的 控制台点击 create 按钮,一分钟就可以配置成功,无需额外的复杂设置,非常方便。第二步,现在你已经是个初级老板了,现在给你的 kimiclock 赋予牛马使命。在 linux 中,我们可以使用 cron 来设定, cron 就是 linux 中用来定时自动执行特定命令或脚本的工具,因此这个指令最基本的版本可以是,你可以基于这个命令进行衍生。这儿给大家一个小技巧,本质上 color 运行在一个 linux 环境中, 因此如果你不熟悉一些 skill, 你 完全可以直接让克拉模仿你平时的动作。因为四 q 本身也是工作流。例如分析任务,你就可以改成设定一个空,让任务每隔二次时间打开浏览器,输入网址, 查看网站上的数据,形成数据分析报告,看完之后关掉浏览器。当你知道这件事之后,你完全可以忘记原来对于电脑操作的理解,享受老板的工作方式。假设安装一个软件, 可以说使用并搜索 wps 并且安装。第三步,将你的工作流与 kimi quir 沟通并固化为 skill。 我 们直接跟 kimi quir 沟通,我们可以根据 kimi quir 的 回复选定一个方向,让它给我们整理出完整的交易工作流程。你看这段 pro 是不是 p u a l 拉满,如果你觉得没有位,可能你已经是老板了。 kimi kala 会返回一个任务列表,这时克洛还不知道这些任务其实是他要执行的。我们接着让 kimi kala 把这些内容做成固定的 skill, 这样可以稳定方便地嵌入到矿例行任务中。 你可以让 kimi kala 打印出来具体的 skill 内容进行检查并叠代,最终固化的 skill 如视频所展示。当然,你也可以直接使用 kimi kala 官方哈布里现成的四 skill。 自己封装 skill 是为了让大家更好地理解什么是 skill 以及如何创建。如果你会建立自己的 skill, 那 么使用别人的 skill 也就轻而易举了。现在我们就可以修改第二部中的 chrome 命令,让它定时执行我们刚创建的这个 skill。 整个能够自动钉盘分析的框就配置完成了修改。 chrome 的 执行时间可以定时给你提醒。

16芝士芯AI 02:25查看AI文稿AI文稿

02:25查看AI文稿AI文稿hello, 大家好,今天教大家怎么使用这个中转来配置我们的 open clone, 点击这个进入,点进去之后呢,我们注册一个账号,注册一个账号,然后我这边有了,我就不注册了,然后点这个登录,登录进去之后, 这边可以看到我们的一个 token 的 使用量,然后右下角的话有更详细一点的,点击查看日期 啊。 ok, 来介绍一下我们这个拆的 gpt 五点四的一个模型输入跟输出的一个价格,官方的价格是二点五美金,输入输出的话是十五美金,都是一百万哦,然后 大多数的中转一人民币对应的是一美金,也就是两块五一百万输入,然后十五块一百万输出,我们的价格还是比较实惠的,输入输出都是一块人民币,然后我们订阅套餐的话会更划算一点,这边有我们的套餐, 充一百是送一百,然后充五十是送三十,然后这边订阅没办法直接去订阅的,我们要先去这边账单里面去充值,充值完之后才可以到这个余额,然后才可以去购买这个套餐。 ok, 接下来教大家怎么去配置到我们的 openclaw 里面,打开终端后,我们接到模型厂商配置,这里不要选择 openclaw, 要选择这个 c e u s t o m ok, 他 让我们输入 url 啊,把这个删除,这个不是我们的, 然后我们点击这个套餐,套餐下面的话有一个 url 套餐,这里 url 直接复制,复制上去,然后粘贴,然后回车,这是我们的 key, 购买完套餐之后,我们在这个密钥里面去生成一个 key, 这个名字无所谓啊,点击这个右上角有一个生成新密要,那这个无所谓啊,随便输入一个就好了,输入之后他会给你一串这个 key, 然后复制粘贴上去,然后我们选择第一个 ai, 然后 model it 这个是我们的模型名称, 然后我们点击这个模型,我们直接复制就好了,不要自己手打了。 ok, 我 们右键直接粘贴,然后回车, 这个输入完之后,它会再弹出来一个这个 model id, 我 们再重新输入一遍就好了,然后我们的配置就完成了。

8大苏Ai 01:22查看AI文稿AI文稿

01:22查看AI文稿AI文稿这是我的绘画记录,你看二月十日,一个一点七兆,一个一兆,封面几天更大?二月二十五日二点九八兆,二月二十六日二点四八兆,这些都是优化钱的。现在三月份的绘画将到几十到几百 kb, 我是 怎么做到的呢?问题出在哪?我的记忆文件有五千八百多字幅,全量加载要三千多 tokyo, 每次对话都加载一遍,这就好像在找资料把整个图书馆搬回家。第一招, qmd 模式。在 agent 点 markdown 文件里,我写好了记忆访问规范,核心原则是按需解锁,不全量加载。具体怎么用呢?我在 opencloud 里面配置了智普的 i'm betting three 模型,做向量化的解锁。选智普是因为中文友好,性价比高, opencloud 里面也支持 openai、 gemini 等其他的向量服务。用 opencloud 自带的 memory search 输入关键词,系统会在 memory 点 macdunk 文件和所有的日期文件里面进行搜索,找到最相关的片段,最 后再用 memory 点 get 精确的读取,不用全量加载,就可以省掉百分之八十到百分之九十的 token。 第二招,精简记忆。你看,这里有二十多个日历文件,我在 agent 点 macdunk 里面设置了定时任务,每天结束后自动沉淀一份日历,定期合成到主记忆的文件里面, 这样 memory 点 markdown 就 不会越来越臃肿。总结一下, q m d 模式是向量解锁加精确读取清剪记忆可以定时的归档,保持精剪使用。这两招可以省掉百分之八十到百分之九十的 token。 关注我,后续讲解更多 open klo 玩法,这里是 ai 共生格,我们下期见。

434AI共生阁 03:15查看AI文稿AI文稿

03:15查看AI文稿AI文稿近期,太原 ai 智能体欧本科奥龙下凭借本地部署自主操控电脑的能力,成为 ai 辅助开发的热门工具,但底层参数配置一旦出错,就会造成巨大资源浪费。本次核心任务是对应的 tree s d k。 二 python s d k 进行全维度梳理,形成标准化文档与测试脚本。 实际执行中, ai 只完成了目录创建,后续工作全面中断,陷入执行中断、重试的死循环,没有任何有效成果, 却在夜间消耗了超百万级无效 token, 严重耽误进度。问题根源并不是模型性能或工具缺陷,而是两处核心参数被不合理手动配置。一是 context window 上下文窗口手动设为一万六千,远低于模型原声上限。二是 max tokens 单次最大输出 token 手动设为四千零九十六,限制了单次输出长度。配置的初衷是想降低 token 消耗,却忽略了工程化分析最大容量上下文的需求。 s d k 分 析需要读取多文件源码, 记忆目录结构,留存历史结论。过小的窗口反而成了性能瓶颈。 context window 代表模型的总上下文容量,可以理解为模型的短期记忆。一万六千的容量太小,系统会自动压缩数据,导致核心信息丢失,模型记不住项目进度, 只能反复从头开始。 max tokens 控制单次推理的最大输出长度,四千零九十六的限制无法满足工程文档和完整代码块的生成,输出会被强制截断,无法生成完整文件或使模型不断重复请求,这样就形成恶性循环。 上下文不足导致记忆丢失,输出截断导致任务无法完成,两者叠加引发无限重试,最终 token 疯狂消耗, 任务却毫无进展。解决方案非常简单, openclaw 本身具备模型参数自动适配能力,没有手动配置时会自动使用。模型的最大上限,我们只需要删除配置文件里的 context window 和 max tokens 这两个限制参数,保存重启后重新下发任务即可, 效果非常明显,任务效率大幅提升。 ai 可以 快速完成全部工作,精准判断底层通信架构,生成完整的架构分析报告,整理全部 api 接口文档,输出对应的拍丧测试脚本,完成统一配置文件参数。缩线并不是不能用,而是要看场景。适合缩线的场景 轻量级交互,比如简单查询单行代码修改普通问答,或是硬件资源有限的环境,可以降低消耗,提高速度。不适合缩线的场景 工程开发、项目分析、长文档生成、批量代码编辑等复杂任务,这些对上下文和输出长度有硬性要求,强行限制一定会崩溃。核心原则, 简单任务适度缩线控成本,复杂任务放开限制保效率,不要一刀切,给大家一个实用的配置。建议复杂任务直接删掉 context window 和 max tokens, 让系统自动适配。手动配置可以参考 常规工程 context window 不 低于八万,大型项目拉满到模型上线, max tokens 建议设为一万六千三百八十四。如果遇到 ai 失忆,输出截断,任务卡住, token 消耗异常,优先检查这两个参数。最后提醒大家, token 成本要看有效产出率,一次完整执行的成本远低于无数次无效重试的总和,提升效率本身就是在节约成本。

14叶老师讲AI 02:58查看AI文稿AI文稿

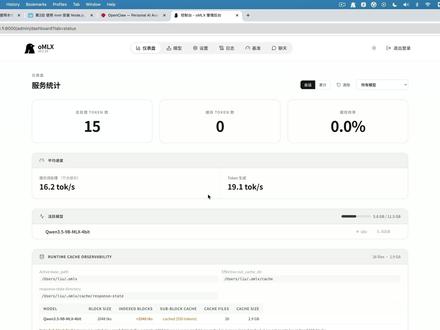

02:58查看AI文稿AI文稿上节课我们在本地部署了千万三点五 ai 大 模型,这节课我们继续部署 open core, 并让 open core 对 接上本地 ai 大 模型,彻底告别头肯焦虑,让大家零成本养龙虾。现在看 open core 官网,里面有很多种安装方式, 我们这里啊,使用 n p m 方式,一键安装,运行之前需要先有 node js 环境才能使用 n p m 命令。 node js 安装好后,打开终端运行 n p m i 杠 g 二分 q, 安装完成,运行命令,开始配置,复制过来粘贴。 先问我们啊,是否继续,当然要继续了,用键盘左右方向键选择 yes, 接着选啊,快速开始。这里问要对接什么模型, 这些选项啊,大部分都是对接云端 ai 模型的,因为我们要对接本地 ai 模型,所以要选择自定义。接着问模型的 api 地址,这个地址啊,在 o m x 的 仪表盘里,大家看这里, 复制一下,将这个删掉粘贴我们这里啊,要填的是幺二七点零点零点一,冒号八千斜杠 v 一。 继续啊问模型的 api k, api k 在 管理面板的设置权限设置里, 默认的 key 是 默认一二三一二三,我们不做修改,就填这个,先按回车粘贴过来,兼容性选择 open ai。 接着问模型 id, 模型 id 啊,在管理面板的模型管理器里面,将名字直接复制了,粘贴过来,确定 end point id, 保持默认就行,这个是模型的别名,可以不填,直接下一步。接着问啊,要对接什么聊天工具列表里啊,默认只有飞书。我这里出现的 open code 微信是我后面装的,大家初次安装并没有这个关于微信的对接,我们下节课再来讲, 这里直接选跳过接着问搜索服务现在没有,也先跳过,继续出来。技能的选择,直接按回车。 出来的技能选择,这里推荐只选 clonehub, 按空格,选中按回车键安装,其他的先不要选,可以避免网络有问题一直卡住。其他的有需要啊,后面可以再来安装。我这里列表中没有看到 clonehub, 是 因为我之前已经安装过了,所以看不到,我就直接选跳过。 后面的几个 api 啊,也都是收费的啊,暂时都没有,全都选 no no no no 还是 no 霍克时啊,也选跳过先按空格再回车。到了最后一步了,问我们运行方式,推荐的是在终端中运行,选择后,现在就可以和他直接发消息了。好,我们发个消息, 它会直接在动态中进行回复,当然也可以使用 word 界面进行访问,大家打开幺二七点零点零点一冒号幺八七八九,在这里也可以一样聊天,还可以做各种设置。总结下,安装 open core 需要 load 机制环境,在装好 load 机制后,使用 n p m 命令,可以一键安装 open core, 安装好后,运行命令开始配置文字版,内容请看课程讲英文档, iphone 可乐,现在出来聊天还可以操控你的电脑了,在下节课的对接微信里,我继续演示给你看。

172刘东-长乐未央 08:14查看AI文稿AI文稿

08:14查看AI文稿AI文稿大家好,呃,我是一个完全看不懂代码,又喜欢用 ai 编程工具来去开发 ai 智能体的一个爱好者。 那经过我很多天的去深度体验, open glo 就是 养龙虾,我来给大家分享一下我深度使用一个星期之后我的一些感受,然后给一些想去体验或者深度使用的人的一些建议。如果你只是想去体验一下,喜欢折腾的话, 我觉得可以去尝试一下。但是如果你之前没有深度去接触过 ai 的 一些工具,或者说对开发这方面从来没有接触过,特别是对一些,呃, secure 啊, api 终端命令这些东西你从来都没听过,那你要去用好它,我觉得它是有一定的门槛的,就目前阶段来说,而且如果说你要把它用到你的业务场景里面去提升你的工作效率, 我觉得这个 open clone 它目前对于技术小白来说真的是有定的难度的。那首先第一个你要解决的是一个安装的问题,那安装现在也有一些呃,原服务器,它会配套的去帮你安装好,但实际安装完之后 你还要面对一个就是配置问题,那配置,配置些什么呢?它要配置模型,还要配置社交工具,比如说这个飞书, 你要有一个飞书来去命令他去做什么东西,给他下达任务指令,你还要给他配置一些权限啊,你没有权限的话,他是不能随意去控制你电脑或者给你安装东西,这东西你都要去做, 那如果你从来没有接触过的,你不知道怎么去配置的,你就要看着教程一步一步来去操作,要花很长的时间,你完成了安装之后,也配置好了权限模型,包括社交工具,比如说飞书、微信这些, 那才刚刚开始,他还不具备任何的帮你干活,帮你做事的这些能力。这个叫 agent, 也就是代理, 有主代理,直代理,那这些代理是干什么的呢?就是给他下单,工作职责,工作任务,让他去帮你做事情。每一个代理他的权限不一样, 你都需要去创建,都需要给他配置。比如说我想让一个智能体去帮我每天获取全球的热点资讯,每天多少条获取之后定时发给我,或者说准成语音之后再发给我 啊。就像我是这个智能体一样,他每天会定时把语音这些发给我,那你要他具备这个能力的,也是需要自己去配置,去创建。你如果说你没有去给他配置和创建的他这个智能体,他啥也不会干,只是跟你接他聊天,那你要去给他配置,那也涉及到你要给他去 安装技能,叫做 skills, 安装这些技能之后,他才知道他要去干什么就做什么,他的流程是什么。那这些 skills 有 的是网上有,你直接下载安装,有些他内部自带了, 但是你的任务场景他不一定完全匹配你,那你就需要你自己让 ai 去开发一个这样的技能, 根据你的需求去开发一个,那这个对一般的普通人来说也是一个门槛,如果你都没有接受过 ai 编程,那这个任务可以说很难去完成。所以说为什么现在叫做养龙虾?其实就是说你创建了这些智能体, 你需要自己去不断地去更新迭代我刚刚说的业务场景,让他每天给我去获取 ai 资讯,每天发给我转成语音播报。还有一些其他的业务场景, 比如说让 ai 去帮你扒取一些知识或者说一些资料,让他帮你转化成一篇文章,然后让他自动定时的发布到公众号。也还有一种是你通过一些简单的文本发给他,让他帮你做个封面, 他去调用模型去帮你深图。这里涉及到两个方面,第一个是他可能需要先装好这个技能,你要先创建一个这样的技能,这个技能是告诉他整个流程怎么走。另外一个他需要帮你对接一个 ai 深图的模型,所以这个模型你需要用到脚本去驱动,然后再通过它帮你做好提示词,按照这个 ai 深图模型的这个接口的能力表参数,再推送给 ai 深图的模型,去把这个图片生成好再发给你。 所以这整个流程下来,你的业务场景越复杂,你需要给他配置的这个技能,这个 agent 智能体的 这项自动化的工作流就越复杂。你这样一个技能,这样一个工作职责的 ai 智能体,你可能在创建的时候都需要不停的去优化迭代, 让他越来越好用,所以这叫养龙虾。那目前作为一个技术小白,你从来没接触过这些东西, 我个人的建议目前来说不是很好用,除非你是那种非常喜欢折腾的,不然的话,像你们没接触过的人去这样去做这件事情,他的效率其实是非常差的,而且他的 token 消耗其实是非常大的。你如果是多几个 ai 智能体,每天定时去给你做一些业务的话, 他每天可能高达一两百块钱的 token 消耗。我个人觉得这个 还不如我让 ai 编程工具直接帮我做一个 sequence, 下达一个任务指令,它就可以帮我完成我需要做的东西。比如说这个 nt gravity。 如果是你一些简单的需求, 用 ai 编程工具它还更简单了,其实就是 ai 编程工具,它不需要你任何配置,只是你只需要安装这样一个软件,打开它 新建你的文件夹,或者打开你之前新建好的文件夹,在这个目录下去跟 ai 对 话,让他给你创建个什么技能,这个技能要一些什么样的任务效果, 包括让他帮你做测试,你什么都不需要配置,你连这个中端命令里面需要做什么你都不需要,你都可以让 ai, 你 告诉他你要帮我在中端做什么简单的文本操作,他都可以帮你做好,帮你跑起来。 后续你要用,你也可以打开这个软件,再打开这个目录文件夹,这里面就有他的你跟他的对话记录,或者是你新开一个对话,直接下到命令。另外一个就是后期,因为现在很多大厂,你像呃阿里,包括 openai 啊,还有可乐这个公司啊,他们已经 很快有新的产品上线,不需要像龙虾那样那么复杂的配置。他们的新产品上线之后,据我了解是非常简单的一个智能体操作就可以了,你就文本, 你告诉他我有什么业务需求,业务场景,他直接帮你创建好这样一个智能体 a j 的。 所以我觉得暂时没必要去折腾,而且用起来我个人觉得他不是非常好用, 现在问题还比较多,经常更新。如果你一定要用,我有个建议就是用 ai 编程工具打开这个本地安装的这个 open class, 然后在这里让他帮你配置。你自己不知道怎么配置的话,可以让 ai 帮你配置,你让他重启或让你帮你配置什么。呃, api 啊,就是模型的这些东西,帮你创建技能都可以让 ai 来,根据这个目录, 他会去读取,会去了解 opencloud 的 整个操作方式,他会帮你配置好, 这也是个方法。所以我的建议,如果你是没有接触过这一类的 ai 工具,我的建议是再等一等,很快就会有更好的这类型的 ai 工具上线,然后你一定要玩,我更倾向于推荐你去玩 webkit, 就是 ai 编程工具。好了,我的今天的分享就到这里, 感谢大家的点赞和关注,我将持续为大家分享更多 ai 工具的使用心得,谢谢大家!

18AI创研社-华哥

猜你喜欢

- 2.2万王高兴