火山服务器怎么部署openclaw

ai 元年来了,尤其是最近最火的 oppo cola, 个人企业为了不被市场淘汰都在使用,我按照网站的教程怎么弄都弄不好,明明是开源免费的工具,找博主问一下就要我好多钱,烦死了,我一分钱都没花,点两下就安装好了呀。 oppo cola 就 点两下你就安装成功了, 一分钱都没有花?你一个连服务器都没摸过的人说这种话我怎么就不信呢?不仅如此,我还接入了微信和 qq 等通讯工具,已经用起来了。那我又是配置环境,又是改代码,又跑不起来,这算什么情况吗? 算你选错了平台。我用这个应用系统放 open call, 傻瓜式点两下的操作,全面适配中文环境,全面可塑化能力,小白一眼就能看懂,而且还能持续迭代, 真正跨入 ai 新时代。那我连技术还有点笨也能安装吗?别慌,这个应用系统有技术在线帮你解答,这个总要花点钱吧?分文不要立刻马上告诉我这个应用系统叫什么名字,傻瓜,是部署 opencloud, 这就是 gnsh。

粉丝3818获赞6.6万

相关视频

04:08查看AI文稿AI文稿

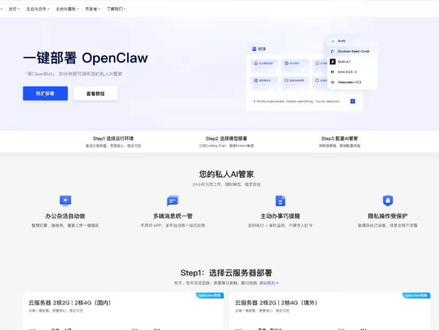

04:08查看AI文稿AI文稿这可能是二零二六开年超火的 ai 工具,连续三次改名, github 上超过十万新,号称电脑里的贾维斯。 openclaw 是 一款开源自托管的个人 ai 助手,不光能聊天,还能真正接管本地设备,打通聊天平台、浏览器和各类应用,实现跨平台自动化操作。 今天这条视频教大家如何快速部署 openclo, 并把它集成到飞书里,打造一个随叫随到的 ai 员工,小白也能学会。建议先收藏。详细的文字版教程已经整理好了,视频结尾可以自取。一、 打开清亮应用服务器,并安装 openclo 镜像,进入这个界面,点击应用镜像,选择 mode 时长,这里可以根据自己的需求选择。目前有活动六十八,能用一年。点击这里, 然后点击这里,进入管理后台。二、配置 openclaw 接下来我们配置 openclaw, 打开阿里云百链,点击左侧导航栏的密钥管理单机创建 apikey, 然后回到云服务器界面,点击实力 id, 进入服务器概览页面,点击应用详情,开始配置 openclaw, 先点击这里的一键放通, 然后点击执行命令,复制粘贴阿里云百炼深层的 a p i t, 点击下一步。接下来点击执行命令就可以获取 openclaw 对 话的地址,先打开这个地址,等下还会用到。 点击执行命令,可以查看 token 配置,然后切换到 open kala 的 对话界面,点击左侧导航栏的 config, 点击该退,切换至 h t t p 页签,在 responses 区域将 enable 切换至开启,如果已经开启就不用再设置了。到这一步,我们已经可以正常和 open kala 对 话了, 接下来我们还可以进一步把 open kla 集成到飞书。三、创建并配置飞书应用进入飞书开发者后台,点击创建企业自建应用,填写应用信息后单机创建。在左侧导航栏中选择添加应用能力,选择按能力添加,找到机器人卡片,点击添加。 在左侧导航栏中点击权限管理,点击开通权限,搜索并添加屏幕上的这五个 api, 权限完成后进行下一步。点击左侧导航栏的凭证与基础信息, 查看并复制 app id 和 app secret, 点击左侧导航栏的事件与回调,点击加密策略 重置,生成一个新 encrypt key, 之后再复制 encrypt key 和 verification token 到粘贴版。四、创建飞书连接流打开阿里云 app 福洛模板中心的飞书 openklo 模板,点击立即使用添加一个新的飞书凭证, 填写凭证名称,剩下的四栏分别填入前面复制下来的信息,之后在下拉框中选中创建好的凭证。接下来创建 open kla 凭证 token, 这里填入前面获取的 open klo 凭证,填写完成后点击确定,并在下拉框中选中创建好的凭证。点击下一步。这里我们需要前往服务器详情页获取服务器公网地址, 并按页面提示填入公网 ip 端口号默认为一八七八,点击下一步,直到完成配置。配置完成后点击发布,复制并保存 weboker。 五、配置飞书机器人 返回飞书开发者后台事件与回调界面,点击事件配置,然后配置订阅方式,选择将事件发送至开发者服务器,填写上一步复制的 webhooker, 点击保存 已添加事件区域,点击添加事件搜索并添加接收消息。事件填写完成后,点击左侧的版本管理与发布,点击创建版本,填写相关信息后保存并提交审批。我们就把 open club 在 飞书里配置完成了。接下来返回飞书,在群机器人中找到 open club 并添加, 然后艾特机器人发送消息就可以实现对话,也可以让 open club 在 飞书里帮我们执行更多任务。 到这里,一个接入飞书二十四小时在线,还能帮你自动处理繁琐工作的 ai 员工就部署完成了。详细的文字版教程我已经整理好了,有需要的朋友直接在评论区扣 open club 就 能领取。以上就是本期全部内容,我们下期见。

9714摸鱼的AI笔记 02:27查看AI文稿AI文稿

02:27查看AI文稿AI文稿大龙虾这波热度呢,让所有云厂商都卷了起来,基本上都出了自己的云端部署方案,今天我就用阿里云带你跑一遍,十分钟拎包入住云端版的贾维斯 open club。 说实话,本地装不是不行,但你得折腾环境配依赖,还得自己对接模型 a p p。 对 普通人来说呢,直接劝退 好。首先,我们打开阿里云的清凉应用服务器页面,在镜像这里呢,直接选择 multi boot, 他 已经把运行环境打包好了,你不用自己装任何东西。 配置的话,镜像要求最低是两盒两 gb。 地域呢,随便选,国内国外都行,国内因为有网络 bgp 优化会贵的,这里我选择国际型。确认好我们的地域, 这里我选择新加坡,因为我不是新用户啊,新户价格首次还会更便宜,最低九块九,一个月六十八块钱呢,就能直接包一年, 或者像我这样直接想尝尝鲜啊,先购买一个月,确认这些都没问题之后,点击立即付款。付款后呢,等服务器启动,服务器起来之后,进控制台,你就可以看到我们买的服务器了。点击进入我们的服务器详情页,你可以看到这里面一共需要三步,我们挨个执行就可以。第一步啊,放通端口,页面上有个一键放通,点一下就可以。 这要是你自己部署啊,这一步我估计会卡住很多人。第二步,配置我们的 api key, 还有生成 token, 这里需要跳转到阿里云百联平台,在密钥管理里创建一个 openclaw 专用的 key, 复制过来粘贴执行。 第三步,获取专属链接,点执行命令,它就会给你分配一个专属的链接,记住这个链接啊,后面点进去就能直接进入 opencloud 控制台了。到这一步啊,整个部署呢,就算完成了。看到了吗?就这么简单,一共三步,除了等服务器创建的那几分钟啊,实际动手操作呢,用不了五分钟, 完全不用碰触任何的命令。行,你就可以拥有一个自己专属的大龙虾,而且只花了一顿饭钱,这比你去买 mac mini 简直省太多了,也不用担心关机断电这些问题。那怎么验证跑起来了?你可以直接在控制台里跟他对话, 也可以像我这样呢,接入钉钉,做一个钉钉的机器人,直接在手机上艾特他,因为模型默认是帮你接入了千问三 max 的 最新版本,推理更强,都是对话呢,你的 ai 助理呢,依然会在后台帮你联网查找资料, 整理信息。那怎么能玩一些更复杂的自动化任务呢?网上其实已经有不少博主做了详细的教程,阿里云官方呢,也写了教程文档,想要的呢,我可以发给你,感兴趣的可以自己去研究。 成本上还要说一下,模型调用呢,是单独计费的,轻度玩玩呢,基本是可以忽略的。但如果你想做一些复杂的任务呢,还是建议去百炼平台购买这种扣丁 plan, 也就是固定月费可用的 token 额度呢,会更多,也更划算。所以以后这种拎包入住的云端化,才是未来 ai 普及的正确姿势,你们觉得呢?快去试试吧!

2.4万赛脖古 03:50查看AI文稿AI文稿

03:50查看AI文稿AI文稿不用买 mac mini, 不 用自己的电脑,也不需要复杂的代码配置,九块九就能一键部署你的 open clone, 也就是最近大火的 clone bot, 这是我接入好的,已经开始为我去赚钱了。屁话不多说,跟着我这个教程跑起来。首先打开火山引擎,薅一个羊毛,拿上我视频下方的邀请链接,注册并关联一下子,你这一下子我就能赚一块钱,咱俩平分怎么也得对半分呢?如果你有账号了,也可以登录并关联啊。 然后打开第二个链接,下单九块九的一键部署服务,填写一个简单又复杂的密码,再点开高级设置。 重点来了,我们要做的核心动作就是填上这几个 k, 下面一定要按我说的操作,因为我发现全网都没人教怎么去薅这波火山的羊毛, 包括火山官方的配置文档也是一塌糊涂,我还做了一份详细的配置教程,文档链接放在视频下方,如果觉得我写的好,记得赏个关注,谢谢了。保持这个页面不要关闭,我们打开这个链接, 然后打开开通管理界面,根据这个步骤选择要开通的大模型,建议呢?开通一个升图的模型,然后打开 api k 管理,这个 api 就 可以不用去复制它。 然后回到这个界面,模型选择就能看到自己已经配置过的模型,下面的 api k 就 能直接选择出我们的 k, 那 模型的配置就完成了。 下面我们开始把飞书接入进来,首先要访问飞书开放平台,点击右上角的开发者后台,选择创建企业自建应用, 填写应用名称,写上描述,点击创建,然后点击凭证与基础信息,复制这个 id 和 app 密钥, 再回到这个界面,填写上飞书的两个选项,再点击页面下方的创建,点击确定,至此我们的实力创建完成,让它开始运行。 回到飞出的开放平台,打开权限管理页面,点击批量导入导出,然后到我的教学配置文档当中去复制这个代码,全替换进去,点击 下一步,再点击申请开通,然后在左侧的事件与回调点选一下,选择事件配置页签啊,单机订阅方式旁边的这个编辑小按钮, 然后选择使用长链接接收事件,并单机保存在已添加事件区域,单机添加事件按钮,在添加事件对话框中选择应用身份订阅页签,并勾选接收消息, 如果找不到的话,你就先搜索接收消息,然后点击确认添加按钮, 然后我们向上看,点击页面顶部的这个创建版本这四个字,按照这个需要的配置内容呢,我们写上版本号及更新说明啊,随便填几个字就行了。翻到页面底部,点击保存按钮,然后单机页面个人发布按钮,完成应用的发布。 这个时候你就去看一下你的飞书是不是多了一个机器人,让你去审核,然后点击审核通过你的机器人就可以去用了,这个时候打开手机的飞书或者是桌面端的飞书,找到我们这个机器人,发送一个任意消息,比如说你好, 首先它会出现一个等待表情,如果出现等待的表情,那 ok, 说明正在调用你的模型,那我们的配置就成功了, 等他回复你的时候,你就知道新的世界已被打,已经被打开。如果你想通过浏览器去访问 open、 cloud、 web 这些界面的话,你可以参考一些官方的文档,更多的玩法大家可以自己去探 索。如果觉得我的教程比较详细,比较明确,那大家可以给我点一个关注,谢谢大家!再见。

2597AI李探长 05:37查看AI文稿AI文稿

05:37查看AI文稿AI文稿嗨,大家好,今天给大家分享下基于 openclo 搭建本地 ai 员工的部署教程,不用花一分钱托肯, 这次我们基于汪派能用为面板来搭建搭建完全本地化的 ai 员工助理,核心是部署欧拉曼本地服务以及 gpt 模型,再搭配 openclo 作为交互入口, 数据全程保存在自己的服务器,既省钱又安全,不管是日常办公还是个人使用都超方便。话不多说,咱们直接上实操。整个实操过程分为六步, 第一,准备 gpu 服务器。第二,运维面板万帕诺安装。第三, gpu 资源配置。第四,奥尔玛模型平台安装。第五,完成 gpt 模型加载。第六, open club 个人员工构建。 我们先来完成第一步,基于腾讯云申请一台带 gpu 的 云服务器,这里选择创建一个竞价实力进行操作演示。首先我们保证服务器为 gpu 架构,为本地模型提供算力。其次,磁盘记得设置为一百 g, 方便大模型下载到本地 并开通公网 ip, 方便后续访问。最后记得提前开通应用的默认访问端口,欧乐玛应用端口、 one panel 应用端口、 openquad 应用端口。服务器创建好以后,我们直接登录腾讯云服务器,默认会享 gpu 相关驱动。安装好首次登录需要耐心等待下,登录后,首先我们通过 sudio 命令切换到 root 用户下, 然后到 one panel 在 线文档中获取一键安装命令,直接复制执行即可。进入安装过程时,先检测完成 dawk 的 安装,需要确认安装目录并下载安装 dawk, 安装完成后,开始设置镜像加速器和面板访问参数,其中输入 yes, 完成镜像加速器配置, 面板端口号输入我们已开通的端口号,最后获取面板账号及面板密码即可。登录 one panel, 登录后我们确认下 gpu 卡的驱动情况,紧接着配置好面板访问地址,方便应用直接跳转访问。配置完成后,我们进入终端开始 gpu 资源配置,首先再次输入命令行,确认英伟达显卡驱动,然后逐个输入命令,完成英伟达容器镜像安装 配置 dolphin 镜像使用英伟达的 gpu 资源配置完成后重启 dolphin 镜像,这样我们就完成了 gpu 资源使用的配置。 到这里我们基本准备好了我们的资源,接下来我们开始欧拉玛的安装,我们进入应用商店,选择 ai 就 可以快速看到欧拉玛应用,点击安装输入相关参数即可。 这里我们需要确认好版本,零点一五点四当前最新版本端口号一一四三四开启端口外部访问,最后一定记得勾选开启 gpu 支持,其他保持默认,点击确认开始安装。这里安装包含镜像拉取以及应用安装两部分,大概需要一分钟左右, 这里我们快记下。安装完成后我们到已安装应用中确认欧拉玛已经正常运行, 点击链接地址页面显示欧莱玛 is running 即可。到这里我们就完成了欧莱美开源模型管理平台安装。下面我们急于欧莱玛完成开源模型 g p t 杠 o s 二零 b 模型的加载, 大家跟上节奏,在 one panel 中找到 ai 管理,进入模型管理,点击创建模型,在模型配置页面点击快速跳转进入欧莱玛官网, 输入 gpt 杠 o s 快 速搜索到模型,点击获取模型 id。 然后我们再回到 one pan 面板,输入获取到模型 id, 点击确认开始模型下载,该模型下载大概需要十到二十分钟,这里我们快速跳过模型,加载完成后,我们就为我们的个人 ai 员工准备好大脑了,我们通过模型先验证下能否正常对话,太棒了,可以对话哦, 这样我们就为 ai 员工准备好了大脑。下面我们同样基于 one panel 来安装我们最近特别火爆的 openclaw, 进入应用商店找到 openclaw 应用,点击安装完成参数配置确认,默认端口号已经开通,下拉选择欧拉曼模型供应商并输入相关参数,具体参见如图所示。其中 gptos 二零 b 对 应我们下载的本地模型 a p i t 输入任意字母 base u r i o 对 应我们部署的欧拉姆地址。最后同样记得开通端口外部访问, 其他参数保持默认,点击确认即开始安装。安装大概一分钟左右,我们同样快速跳过,安装完成后通过安装目录获取 opencloud 访问 token, 获取后与 ip 端口 token 等于 token 值,拼接后输入 web 访问地址中, 最后点击跳转,直接选择带 token 的 访问地址就可以体验啦。让 ai 助手帮忙创建一个文件清单,到服务器对应目录查看,完成操作啦。 接着我们让他网上查询一些信息,他也可以轻松帮我们搞定。到这里我们就完整构建了一个本地的 ai 员工啦,大家速来体验呀!完全可以用 one panel 作为 ai 员工的管理员,本地,重点是本地!本地就等于安全! 同时再也不用为 token 着急上火啦!小伙伴们快来快速构建,抓紧体验啦!

4.0万OpenClaw开源社区 04:46查看AI文稿AI文稿

04:46查看AI文稿AI文稿今天我们要聊的呢,是火山引擎最近推出的一个非常有意思的活动啊,就是 open claw, 也就是 motboat, 现在可以用九点九元的价格一键部署。这个套餐其实还挺划算的,就是你只需要花 九点九元就可以体验到 openclaw, 也就是 motbot 的 一键部署。嗯,然后还可以使用它的全部的功能。对于国内的用户来说,在部署和使用这个 openclaw 的 时候遇到的网络问题怎么解决?因为这个项目它本来是要调用 ospec 的 a p i 的 嘛?对,所以国内直连肯定是不行的, 但是我们可以通过两种方案来优化。第一个呢是模型中转方案 openclaw, 它是支持 openai 格式的 a p i 的, 所以我们可以用 deepseek 通一千问零一万物这些国产的大模型。嗯,这样做的话,响应速度很快,成本也很低,最重要的是你不需要魔法上网。 那要是想通过飞书机器人来远程控制,这个具体怎么配置呢?这个就需要用到飞书接入方案了, 你得先去飞书开放平台上面创建一个机器人应用,然后开启事件订阅,把你的回调 u r r 填好。 这一步你可能需要用 sapolar 或者 cloudfly tunnel 把你本地的端口映射出去,才能让外网访问。最后把你的 app id 和 app secret 填到 opencloud 的 配置文件里面就可以了,这样即使你人在外面,也可以通过飞书收到指令的回传结果了。懂了, 那我们接下来要聊的就是这个 opencloud 的 部署方式了。我们先说最简单的一种,怎么通过火山引擎的应用模板 一键部署 openclog, 其实很简单,你只要打开火山引擎的云服务器控制台,然后在创建实力的时候找到 openclog modbot 这个模板,接着按照你的需求选择包年包月或者按小时付费。地域建议选华东二上海。那部署完了之后, 还需要做哪些配置才能让 openclock 真正地跑起来呢?配置完成后,你要先去火山方舟大模型服务那里获取你的 apiq 和 model id, 然后配置飞书机器人。这一步你得创建一个企业自建应用,给这个应用添加机器人的能力,还要设置一下权限,之后发布这个应用 发布完了,你还要配置非书的事件订阅,这里建议你选长连接接收事件,把需要的事件都加上,最后再新建一个机器人的版本发布出去,等管理员审核通过就可以用了。明白了, 那如果我自己已经有云服务器了,还想部署 open club, 这个过程会有哪些不一样?要是你自己有云服务器,就不需要再选什么模板了,你只要登录到你的服务器实体里面,然后用这个命令 openclog configure set 去修改你的配置,再用这个 openclog models set, arc model underscore name greater than 的 指定一下你要用的模型,最后用这个 openclog gateway restart 重启一下网关服务就可以了。这么说,配置完成之后,怎么知道 openclog 是 不是真的跑起来了? 这个也很简单,你只要用这个命令 system setup user status, open claw dash, gateway dot service, 然后看一下它的状态是不是 active running 就 可以了,如果是的话,就说明服务已经正常启动了 哦。那 open claw 有 什么比较厉害的进阶玩法可以帮我们提升效率的?比如说它的长期记忆功能,它会自动把重要的信息保存下来,而且是用 markdown 格式,你可以随时去查看或者编辑这些文件。 这样就相当于你给 ai 做了一个认知矫正,它会越来越懂你的需求,这就很方便了。那还有其他的吗?当然有,它的自然语言定时任务也很强大。除了前面说的那些,它还可以监听你的邮件,要是有紧急两个字的邮件进来,它还可以马上截图发给你。 对,然后还有就是它的 m c p skills 扩展,你可以通过接入不同的 m c p 服务端,让它可以读写字数据库,连接搜索引擎,执行本地脚本。扩展之后真的是无所不能, 听起来就很厉害。那 openclaw 在 实际项目里面到底能做什么?举个例子,火山引擎的文档里面有一个任务,是让它先通过 image generated 的 工具生成四张春节主题的分镜图片,然后再用 video generated 工具把这四张图片合成为一个视频, 这个就很完整地展示了它从创意到执行的全流程能力。好的,说到这里,其实今天我们从 openclaw 的 基本原理 聊到了他的实际的部署,再到最后我们讲了一些很有意思的进阶用法和未来的展望。大家应该已经能够感受到 ai agent 这个东西正在悄悄地改变我们的工作方式。好的,那这期节目咱们就到这里了,感谢大家的收听,咱们下次再见,拜拜!拜拜!

263雷特人工智能企业定制 09:321384跟着阿亮学AI

09:321384跟着阿亮学AI 07:07查看AI文稿AI文稿

07:07查看AI文稿AI文稿前面几期视频我们已经带领大家部署了小龙虾的本地安装,那么我们也说过小龙虾能借助很多的即时通讯工具,比如说 discord, imessage、 whatsapp 等等,在国内它支持飞书、企业微信、钉钉等等即时通讯工具。 前面在部署云端的时候已经演示过如何接入企业微信,那么今天我们就演示一下如何将本地部署的小龙虾接入飞书开放平台。 首先我们先登录飞书开放平台,我们输入这个网址, open 飞书点 cn, 我 们点击右上角开发者后台,点击企业自建应用, 填写一些应用信息,应用描述小龙虾,然后头像背景,大家凭自己的喜好来选择,点击创建,创建完成后, 我们就来到我们应用的配置页面,我们可以看到左边的凭证与基础信息, 这里是应用凭证, app id 还有 secret, 这些都是我们稍后会用到的东西。现在我们给这个应用添加机器人,我们点击添加应用能力, 重新打开一个页面,然后添加应用机器人,你们会发现这里多了一个机器人的菜单。接下来我们点击权限管理,然后点击开通权限,我们在搜索框中输入 i m, 也就是按 message 的 前面两个字母, 然后在弹出来的列表中,我们点击这个权限名称前面的选择框,把所有的权限都依次勾出来 全选,然后点击确认开通权限,这时我们可以看到在最上面的这个小龙虾的名称旁边黄色的这个注意事项,我们点击创建版本,我们在弹出的界面中应用版本号,我们输入一个版本, 他这里有格式,我们按照一点零点零来输入更新说明,自己写开通创建机器人, 创建小龙虾做面端的能力就机器人,我们需要注意的是可能我这是首次创建机器人,或者是我是新账号,他这里说首次发布免审核,如果你是已经创建过机器人或者是 怎么样,他可能会需要审核,那么我们就需要去后台审核这个机器人,我们点击保存啊,我们在可用范围部分成员这里,我们编辑一下,如果你有很多的成员,就选择哪些成员可以使用,我这里因为就我一个人,所以我就直接确定 在可用范围内,你可以编辑一下自己的哪些成员可以使用这个机器人,如果,然后我们点击保存,他这里说本次发布免审自动上线,如果不免审的话,我们需要到后台去进行审批, 我们点击发布,如果你们是需要审核,在管理权限这一边有一个申请上线发布,点击了以后 就要打开飞速的客户端,不管你是客户端还是网页版,进入了以后点击消息,然后他这里会弹出一个审批,在这里会有一个审批的通知,你们审批就可以了,审批完过后,他就会在 这里就变成了当前修改与发布,和现在当前是一样的,那在当前修改与发布以后,现在我们到终端 进行小龙虾的飞书插件安装,我们输这一行命令,下载小龙虾的插件。小龙虾他新版本自带了有飞书的插件,但是不是特别好用,有点问题好像,所以我们重新来安装, 这里已经安装完毕,我们输入这一个命令,小龙虾 open cloud, 哎呀, 错了, open curl config 在 local, 我 们直接选择 local。 在 第二步 sections, 我 们选择 channels, 在 channels, 我 们选择第一个 config。 找到这里有小龙虾,在这里找到有飞书的插件,我们在这里选择 use local plug in path, 用本地插件的路径,我们选择这一条。 回车就让我们输入飞书 app id, 飞书的 app id 是 在这里,我们把它复制下来,然后 secret 是 这里, 我们也把它复制下来,我们回车,输入 app secret, 我 们回车,它这里给出了一些信息,飞书 connections test connected 就 已经连上了。 which 飞书 the may, 我 们就选第一个 china 回车就可以了。 group chat policy, 我 们选择 open, 第一个是 allow list, 就 需要你去允许,第二个就 open, 就 our groups, 我 们选择这一个,不然第一个啊,你还得去添加清单就麻烦。我们选择这一个,这里就 finish, 我 们跳出,刚刚我们设置完成,在飞出那一部分,我们跳到这个选择 channel, 这一部分,我们选择 finish, 其他的都还是一样 在飞速 dm policy, 我 们就选择 open。 下一步 sections, 我 们选择 continue, 就 设置完成,我们重启一下服务器,我要先把我的服务给停掉。暂停服务器的命令是 open cloud gateway, stop, 重启就直接 open gateway 就 好了。现在我们重启网关 open cloud gateway 啊,我们我们可以看到它飞速插件已经配置成功,网关已经启动了, 那么我们现在回到飞速,在飞速这里点击事件回调,点击订阅方式,我们看这订阅方式,这里使用长链接接收事件,点击保存,再添加事件,点击一下 弹出来的搜索栏里面,我们输入 receive, 就是 接收消息,然后把它勾选上添加确认,然后我们回到飞书中刚刚的开发者小助手这里,他已经我们可以看到有很多的通知,这里有个打开应用,我们点击它 就会跳到我们刚刚建立的小龙虾机器人,我们给他发一条消息,你好,不说你好了,我们不要那么礼貌,你是谁?他这里就给我回复了,问我要帮他设置一些设定,你是我的 秘书,叫小可爱,你叫我主人,其他的你们就随便定义了。好,那次我们小龙虾接入飞速机器人的教程到这里就全部结束,大家可以根据教程自己去部署实践一下。 文字教程我已经整理完毕,大家如果想要文字教程可以来找我要。好,那么我们下期见。

328林浩Ai工具库 05:02查看AI文稿AI文稿

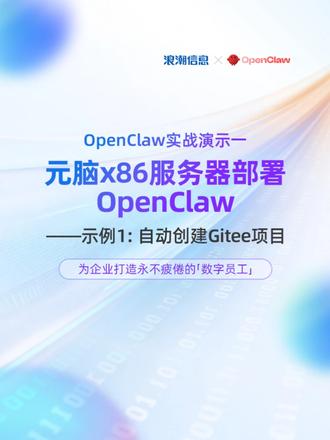

05:02查看AI文稿AI文稿好的,那我们现在验证一个实操实利啊,在我们的 git 上进行呃,让它自主去创建一个项目。首先我们需要先问问它是否能够使用我们的 git 令牌来去创建一个项目, 这里它告诉我们它是可以使用私人令牌来创建和管理项目的。那么我们接下来就告诉它一个新的 quarry, 这个块的内容就是你可以帮我创建一个静态网页,是关于我们叉八六服务器的一个宣传网页,主要内容就包括性能、规格、场景、联系我们等, 具体内容可以使用站位符代替,页面样式要新颖一些。我的私人令牌是这个,请你为我创建一个项目,它的名字就叫 serverpromote, 并推送到我的服务器上,推送到我的这个 get 中, 我们可以看一下它能否帮我们创建成功。我们稍作等待,它这边还在频繁的去对我们的工作环境中的一些目录进行读写, 因为我们的 open cloud 在 这个外部端和我们的服务器端它的联通是有一定的呃延迟的,所以它有时候在这个数据传输的时候,会因为一些数据的丢失,导致它没有办法完全实时的把这个数据给它刷新回来。所以我们就可以 切换一下把,看他有没有具体流程一个执行。我们可以看一下我们的工作目录中是否已经创建好了一个 项目。这个就是我们创建的一个刚刚根据提示词生成一个项目,它里面已经把我们所需要的一些文件都已经给它创建成功了。 这个过程比较慢,因为它在呃自己需要构建去理清逻辑,然后反复的调用我们的 l i m 做一个执行,然后具体的工序调用的话,它也会在这个过程中进行思考。 好了,你看我们可以看到它已经完成了很多个文件的创建, 我们再刷新一下, 构建的好慢, 咳咳咳,这个 css 文件已经创建了,进来看一下, 又写完了一个文件 内存,估计是创建不了了, 现在在做 get 的 配置,他需要知道我的 get 物名,尝试推送。 好的,我们可以看到它已经在我们的仓库中构建好了, 可以直接看到它的一个具体的信息, 我们甚至可以把它克隆到本地, 它是没有什么样式的,但它已经把我们基本内容都给完善好了,后续我们可以自己去添加。 ok 了,可以了。

496元脑服务器 06:37查看AI文稿AI文稿

06:37查看AI文稿AI文稿hello, 老板们好,今天给老板们带来 open claw, 也就是大家常说的 claw bots 全套实操教程。重点强调一点,无需任何魔法,用国内网就能直接操作,全程一步一步录屏,新手也能跟着上手, 咱们不玩虚的。重点演示,一个前置部署加四个核心实操,先做基础部署,再接入飞书,对接火山方舟多款国产模型,比如杜邦 seed code、 智普四点七、 deep seek v 三点二和 kim k 二 thinking 等。 最后微信和 qq 的 接入教程也会安排上,每一步都讲清楚,看完直接能用。现在呢,我们先打开网页,这个网页链接我会发在评论区或视频简介下方。打开后,其实有教程的,我也是按照教程一步一步来的, 基本上半个小时左右就搞好了,真的很快,用起来很爽,直接进入沉浸式实操。现在直接进入部署阶段,直接购买一个云端服务器,一个月九点九元,我觉得很划算了。

1062小思 04:58查看AI文稿AI文稿

04:58查看AI文稿AI文稿前两期视频我们介绍了用国内的服务器来接入 opencolor, 并且跟飞速联通,但是我知道有的朋友是不满足的,因为咱们都还想用 jammer 或者用 cloud 的 来作为它的底层模型。所以这期视频就给大家介绍一下如何快速的用 opencolor 接入 jimmy 三,然后再导入到飞速里面进行使用。 这里是整个的流程图,其实并不复杂,我们涉及到这么几个部分,首先在终端里面安装并且配置 openclo, 其次呢,在飞速的界面去安装一个专属于 openclo 的 应用和机器人,那最后再是把这个飞速的机器人跟 openclo 那 么合起来就 ok 了。我们先来看 第一拍,就是在中端里面直接安装 openclo, 其实非常简单,咱们直接打开 openclo 的 官网,他就会告诉你,你只要在终端里面输入这一行命令就够了。这行命令 你输入完成了之后,那就按照它的持影一步一步操作就好了。那首先的话它会弹出来一些让你确认的问题,比如说这个地方你就直接点 yes 就 可以了。再比如这个地方直接点 quick start 就 可以了。接下来就让你去配置模型了,这个地方有很多模型可以给你选,就是咱们特别喜欢的什么 cloud, open ai 还有 gemina 三应有尽有,然后像 timi 这些也都有,大家按照需求自己选择就好了。像我喜欢用 gemina, 我 就选了 gemina。 在 这个地方我们需要选一下你用 gemina 怎么样去接入它,我就直接选用 a p i k 接入就好了。 选完之后你还需要再继续选一下用 jimmy 的 哪款模型,我直接就选的是最喜欢的这个模型,大家也是按需选择就好了。那再接下来是配置,聊天软件也有很多功能配置,我直接选的是飞书,但是我自己配置飞书在这一步没有太成功,后面我们会继续再讲哈,然后接下来它就会引导你继续配置。 skills 这个地方可以选的 skill 非常多,这个也是我觉得我们可乐非常好的一点,我在里面都选了好多,大家也是按需选择就好。记得这个地方它是多选啊,选择的时候是空格,把它选中,然后回车确认,确认完了之后就会自己开始安装了,安装可能需要几分钟时间,咱们可以稍微等待一下,等它安装完 skill 之后就再来到下一步,它会提醒你要不要配置 hook 地方,我没有配置啊,这个地方有点技术难度,我就觉得决定等我使用过一段时间之后,如有需求我再来配置。再接下来咱们就来到了去配置使用界面,他这个地方会让你选择三个选项,第一个选项是 在 terry 里面使用,第二个选项是在网页里面使用,我直接选了网页,配置成功之后呢,由于我选的是网页,他就会直接弹出来一个网页,就直接可以在这个网页里面跟儿童可老对话了。 ok, 那 直到这个地方呢,其实看起来都非常的顺畅,那就是其实我发现当我接入 kimi 模型的时候, 你就直接在这个网页里对话是很 ok 的, 很顺利的。但是如果我接的是 gemini 的 话,其实我第一次对话是不够顺利的,其实就是因为请求 gemini 其实需要配置一下咱们的网络,那这个地方呢?我就直接让 cloud code 协助我修改了一下 opencloud 的 配置文件,把我的网络地址配置进去就可以了。 接下来咱们就开始在飞书里面创建机器人,直接打开飞书的开发者后台,在这点一下创建,创建完了之后呢,你就会在这个界面看到一个有很多卡片的页面,直接选这个地方的机器人,就能直接创建好一个机器人了。那创建完了机器人之后,关键是我们要配置一些权限,好让机器人可以在群里发消息啊,接受消息 直接点最左边的这个地方有一个权限管理,然后在这个地方两种方式都可以,一个是可以开通权限,你可以把那个消息和群组下面的权限都开通出来,也可以是批量导入权限,批量导入的话就把这一大段 jason 完全的输入进去就可以 配置权限。完成了之后,咱们再点一下左上角的凭证信息,点进去之后就能看到 app id 和 app secret 这两个信息,一定要把它复制一下,这个是我们后面把飞书跟 openclo 打通的一个关键的字段。 完事之后咱们接下来开始继续在 openclo 里面配置文件里面增加飞书,那有两个方式哈,第一个方式我们直接可以打开 openclo 的 一个网页,就刚才咱们出现的那个网页,这地方有 config, 再点一下 raw, 你 在这个 command 下面找到这一段 jason 把这一段就是跟飞书相关的这段直接复制进去,然后你复制的时候记得一定要改一下 app id 和 app secret, 这个就是我们刚才从 飞速开发者后台获取的那两个字段。第二种方式我们还是可以让卡的扣子直接帮我改,我用的就这种方式,你就直接告诉卡的扣子,你让他帮你干什么就好了。 另外一个小提示就是我通常不会把我的各种 appc 直接告诉卡的,我会让他改完配置文件之后,直接打开这个配置文件,然后我手动把这两个最关键的需要保密的信息填到配置文件里, 这样来操作的。以上都配置完了之后,咱们就需要在飞速机器人里面再配置最后一个东西,叫事件与回调,还是来到飞速的开发者后台, 点一下左边的这个事件,你回到这里,然后你发现这下面会有三个 tab, 咱们先点第一个 tab, 点完之后呢,在这个地方你点一下长链接保存就可以。还是在这个 tab 下右下角会有一个添加事件,你点一下把这个接收消息相关的事件添加进去,这个接收消息的事件它的名称叫做这个 message receive, 这个事件 添加完了之后,我们再点第二个 tab, 叫做回调这个 tab, 这个 tab 下你也是点一下长链接,然后再保存就可以了。它其实看上去繁琐,但是每一个操作其实都并不复杂。那最后你配置完了之后呢,我们就可以在 飞书里面跟这个小龙虾对话了,你直接艾特他,他就可以直接给你回复了,就很方便。那以上就是所有的安装流程并不复杂,大家如果想要这份文档的话,可以在评论区扣一。今天的 open 就 先分享到这了,祝大家新年快乐,下期见!

2969哈哈du(AI版) 02:00查看AI文稿AI文稿

02:00查看AI文稿AI文稿首先创建一台轻量应用服务器,目前可以通过官网活动抢购特惠, l s 实力,仅需支付零点零一元即可获得一个月使用资格。特惠实力默认配置 open claw 二零二六点二点二杠三镜像。 步骤二,实力创建完成后,进入实力详情页,点击应用管理。应用配置,需要开通千帆大模型云助手运维编排 o o s 产品服务,点击一键开通即可开通相关服务。 步骤三,访问 opencloud 官网网站,需要通过幺八七八九端口访问,点击一键放行,放行防火墙。 步骤四,点击模型配置,在模型选择处下拉选择模型,可以选择自己想要的模型,点击应用后,系统会自动创建千帆 apikey 进行时域内配置。步骤五, 如果需要将 openclaw 接入飞书等 i m 软件,可以点击消息平台配置,选择目标消息平台,输入对应的信息,点击应用,具体接入过程可以参考输入框右侧参考文档。 步骤六,点击 skills 配置 l s 默认提供百度搜索、百度百科等 skills 配置,可以按需选择并点击应用。若您想要配置其他 skills, 可清空输入框内容,自行输入 skills, 等待执行成功后, openclaw 服务就已经配置完成。步骤七,如果想要在 openclaw 官网与 openclaw 聊天,可以点击获取网站地址,点击网站地址跳转至 openclaw 的 官网网站,即可体验与 openclaw 的 对话。 完成 openclaw 部署后,即可快速接入飞书、钉钉、企业微信等主流 i m 应用体验。七,乘二十四小时专属 ai 助理。

35百度智能云 04:40查看AI文稿AI文稿

04:40查看AI文稿AI文稿二十分钟搭建性价比最高的 open clock 组合,厉害!哈喽大家好,我是姚路星。 最近 open clock 可太火了,但各种配置教程都太复杂了,今天给大家来一个最简版,上手指难教你用火山云服务器加上 k m k 二点五大模型,加上飞速机器人,二十分钟快速搭建一个属于自己的 ai 智能助手 open clock。 为什么选择火山云加上 k m k 二点五加上飞书呢?火山云是自觉云服务信任优惠力度大且配置简单,两盒两 g 云服务器,每个月九块九够用了,一年也才不过四十八块。 无需自主安装 opencloud 云服务,直接就安装好了 opencloud, 你 只需要配置渠道和模型即可。预制二面出品的 kimi k 二点五专门针对代码和技术场景优化,不仅代码理解和生成能力强,而且便宜,性价比非常高,速度也很快。 飞书办公场景完美集成,创建机器人简单,全线清晰,而且火山云和飞书都是字节系的,配合更顺,套餐直接打通。 接下来我来讲一下如何搭建。步骤一,购买火山云服务器一点一注册账号,如果已有账号可以跳过这步,地址如下,一点二,购买云服务器 ecs open cloud 套餐直达地址如下, 地域的话可以选择离自己近的,如果想买海外的云服务,也可以选择雅加达,如果预优惠价受庆,可以尝试切换其他地域。规格的话,两盒两 g 就 够用,两盒四 g 也可以,会更加流畅一些。 接下来设置好 root 密码,这个自己要记住,后面要用。接下来就是购买支付,如果账户里没钱的话,要充值一下,等待触视话即可。 步骤二,配置 kimi k 二点五和飞书二点一,获取 kimi api 蜜柚,打开 kimi code 注册登录账号买包月套餐,四块九毛九就可以试用七天。地址如下, 进入 api 蜜柚界面,点击创建新蜜柚,复制 api key, 注意 api key 只显示一次,复制保存到安全的地方后面也要用。 二点二,创建飞速机器人打开飞速开放平台,点击创建企业自建应用,填写应用名称和描述地址如下, 添加应用能力找到机器人添加有些权限依赖机器人能力。进入凭证和基础信息页面,复制凭证 app id 和 app secret。 二点三,配置 open cloud 因为云服务套餐已经安装并启动好 open cloud 的 服务,我们只需要将 kimi 和飞速的配置接入即可。我们先远程连接云服务,这个时候就用上了上面的一个 root 密码,地址如下, 可以更换区域,找到自己的一个服务器地址,运行以下命令进入配置界面。接着我们先配置一下 kimi coding 模型,选择 moonshot ai, 选 kimi code api key 套餐配置的是这个, 将刚才的 key 贴进去即可。配置完成 kimi 后呢,我们继续执行配置飞书,选择 channels 找到飞书,找到飞书,配置好 app id 和 app secret, 然后按照流程完成配置即可。二点四,配置飞书权限接着我们在应用后台进入权限管理界面,搜索并开通以下权限。 二点五,配置事件订阅这里非常重要,这里为什么先配置 open cloud 再配置事件呢?因为如果不先配置 open cloud 的 话,无法配置飞速机器人长连接事件,进入事件和回调页面。事件和回调配置方式选择使用长连接接收事件, 添加事件,订阅搜索并开通以下事件,如果漏掉这一步,机器人能发消息,但接收不到消息。 步骤三,可以开始使用了。方式一,飞叔私聊也更推荐这种方式。方式二,飞叔群聊艾特机器人发消息。 总结一下,先分析一下实际成本,大概也就一杯奶茶钱不需要你是技术大牛,不需要你花大价钱,只需要二十分钟加二十元试错成本加一颗愿意尝试的心, 快去试试搭建你的专属助理吧!感谢大家!三连谢谢大家,记得关注再走!

713我姚学AI 00:26查看AI文稿AI文稿

00:26查看AI文稿AI文稿不用编程,不用买服务器,一句话就可以部署自己的 openclaw。 kimi 最新上线了 kimi claw, 就 算是小白,也能轻松拥有自己的小龙虾。来到主页,选择左边的 kimi claw, 直接点击部署,不需要做额外操作就能完成部署。在右边设置里,你还可以自定义小龙虾的名字,打开终端等操作。如果你想把机器人接入非书,它也有详细的教程, 一步一步跟着做。你也能快速拥有专属的 ai 助理,不管是收集资讯、帮你写文章,还是写提示词等等,就真的太方便了!

365段老湿AI实操日记 11:06查看AI文稿AI文稿

11:06查看AI文稿AI文稿我们本次的部署方式采用的是原码构建的方式,同时我们也能够指定 open cloud 平台默认之外的模型,这一点对我们企业用户来说是十分重要的。 今天我们的部署呢一共分为三步走,第一步我们需要克隆项目,配置一些环境变量,搭建一个基础的环境。第二步,我们需要构建专属的 open cloud 容器,保证安全隔离。第三步,配置专属大模型,让 open cloud 真正的动起来。 首先我们需要将 opencloud 从 github 上进行源码克隆,大家可以如果在遇到网络问题的时候,可以直接在我们的 open, 在 我们的 github 上将 opencloud 直接下载下来,解压后上传到我们服务器即可。我这边已经提前给大家把项目给它克隆下来了, 这里我准备了一个我们今天所要用到的所有的操作指令,大家跟着我一步一步来就可以。首先我们需要创建一个我们自己专有的 opencloud 的 一个工作环境, ok, 在 创建完工作环境之后,我们需要给它部署一个呃,给它赋予一个我们用户组和所有者。 这一步也很关键,因为呃在我们容器的构建过程中,我们使用的 uid 为一百的非 root 用户来构建和运行服务, 避免我们的容器以 root 身份运行带来一些安全风险,同时呢也方便我们与数据库进行映设。然后我们之前刚刚提到这个 open cloud 杠 data, 还有这个 workspace, 这个目录也是非常关键的,这是我们区分不同用户之间的一个关键目录。 好的,接下来我们继续执行,我们导入几个关键的环境变量,这个环境是我们构建 opencloud 的 一个最基础的一个支撑。 ok, 到此为止,我们的所有的准备环境都已经做好了,接下来我们就可以真正的去构建专属于我们自己的 opencloud 容器了。我们首先给我们的执行脚本赋予一定的执行权限,接下来我们直接执行 dock setup 这个脚本。 ok, 我 们可以看到它已经在构建我们的镜像了。当然大家在构建我们的镜像的时候,可能会遇到一些网络连接的问题, 这个镜像在构建时受网络影响环境还是比较大的,在实际部署时,大家拉取基础镜像或者下载 note 相关依赖的时候,可能会遇到网络连接失败的问题。所以在在这里建议大家在构建之前,先对我们的这个镜像进行换原,使用国内的镜像仓库来完成构建, 能够大幅的提升我们构建镜像的一个稳定性和成功率。 ok, 我 们现在可以看到我们的界面已经进入到了 opencloud 的 一个配置界面,我们接下来就按照以下步骤,大家跟着我走,我们就可以快速的先把我们 opencloud 的 一个配置文件给它,给它布置好。 我们首先要同意我们的风险,然后选择 quickstar, 在 这里在这个模型提供厂商这里,我们可以按照自己的需求去选择,因为这里我们使用的是 deepstack 这个 呃,这样一个平台,这在这里没有显示。我们这这一步就先跳过,大家有条件的话可以按照自己的这个需求去配配置自己的 atik, 这个地方我也选择默认的就可以,然后到了这个 china 这一阶段,我们可以看到它提供的很多 china 都是 呃像 telegram、 whatsapp、 whatsapp 这这种,呃国外的一些呃这种渠道,呃对于我们国内的用户来说使用不是特别友好。在后面第二部分实际案例子讲解时,我会给大家专门的去讲解我们如何将 opencloud 与我们的企业微信做一个对接。 这一步我们就暂且先跳过。 ok, 接下来到我们的配置 skill 的 这一个阶段,我们在首次使用的时候可以先选上这样一个啊配置项,但是,呃, 但是在下面的这个具体的 skill 中,我们可以不用去选择,大家可以按照自己的需要去填充这些 skill, 我 们可以后续也可以自己进行扩展。这里我就直接跳过了,对于这些 apik, 大家有需要的话可以按照我们的需求自己去部署去配置。 好的,我们现在稍作等待啊,它现在呃需要等待网关服务启动之后才就可以通过我们的 web ui 去快速访问我们的 open cloud 了,它现在正在安装部署。我们大家稍微等一下, ok, 到这一步我们使用我们使用 ctrl 加 d 退出这样一个容器环境,我们可以看到我们的容器实际上已经呃构建完成了。 好的,到这一步,实际上我们的 open cloud 已经完成了基本的雏形,我们可以在左侧的这个配置文件中看到我们自己的专有的工作目录,以及它在这个工作环境下, 工作环境下去已经创建好了我们的这个 open cloud。 点 json, ok, 我 们看一看是不是有一些步骤有遗漏, ok, 没有,没有问题。呃,当然啊,这个我们直播环境也是非常的呃,可能会带来一些问题,但是这个问题既是困难也是挑战,我们共同去克服它。 好了,我们现在要去配配置我们专属的大模型,这样的配置能否呃也是我们 open cloud 能否真正运行起来的关键一步。下面我将给大家按照步骤去演示我们如何去 呃,真正的把我们的 open cloud 给它运行起来。在这里我们可以看到,呃,我们的 open cloud 叫 json, 有 很多的配置项,我们主要配置的是它的模型和它的一个 呃, model 和它的 agent 的 这样一个 json。 呃,如果大家的这个服这个 模型是不如在本页的话,大家可以在这个 bash 中进行替换,然后 api k 选择使用自己的 api k, 然后这些模型大家可以随意的替换,这样我就直接把它贴到我们的 open cloud 点 json 中。 好的,下一步我们配置我们的网关服务。首先第一步的话,我们需要去创建这个 tsl 这个配置脚本, 这个配置关乎到我们如何我们后续把它从 http 升级到 http s 服务。这样的升级有一个非常大的好处,就是可以在我们的传输过程中对我们的数据进行加密,防止中间人进行攻击和数据窃听,保证我们的数据安全可靠。下一步的话,我们需要 去呃给它配置 control ui 这个关键参数,这个参数可以呃会直接影响到我们能否在服务器上,能否在外部端进行预览,去访问到我们的 open cloud。 ok, 接下来是 browser 这个浏览器插件,我们也给它配置上,因为 openclaw 在 执行 agent 的 过程中会很大程度依赖我们的浏览器。大家在配置的时候一定要注意一下这些缩进问题,因为可能很多时候会因为缩进问题导致这个我们的配置不成功。 ok, 我 现在保存一下,到此为止,我们的基本的所有的内容都已经部署完成了。下面导播老师切一画面,我配置一下我们专有专属使用的这个 open deepsea 的 一个 api k。 好 了,我这边已经完成了我的呃配置文件的一个更新。接下来的话,我们只需要重启一下网关服务,就可以把我们的新配置给它刷新上去。 ok, 我 们可以看到我们的网关已经呃重启了,我们看一下具体的一个 log, 检查一下它有没有重启。 ok, 我 们现在检查一下我们的外部端是否能够去使用。大家可以在我们的浏览器中输入您的首先用 http 进行包裹,输入您的 ip 和端口号,然后进行访问。 当我们看到您的这个链接不是专用链接时,就说明我们已经能够通过外部端进行访问了,这样我们无视它的风险,继续去访问。 ok, 我 们可以看到我们当前这个环境似乎没有真正的配好,因为它出现了一个 disconnect, 这应该是我们在配置环境变量的时候,我的麦,我的那个 token 没有按需要正确的配置。这样我导播老师,我们再切一下画面,我这边再对它进行第二次重新修正。 我们这边啊,一不小心把我们的 token 写成了 my token, 实际上是 my test。 我 这边再次重启一下我们的服务, ok, 现在服务起起来了。嗯,那么其实呢,我们在日常的配置过程中呢,或多或少都会遇到一些问题, 那这里呢,李老师也是帮我们做了一些复现,然后也是展示了一下我们应该如何在遇到问题的时候去解决这些问题,非常感谢李老师。哎,好, 那我们再继续这些步骤吧。我们确实在这个正真正的这个开发环境中,我们很容易会因为这些配置问题导致我们很多小白在部署我们的 open cloud 出现很大的问题,大家很可能就卡在这一步。当然我们刚刚经过刚刚的检查,我们再一次把我们的 open cloud 给它启动起来了,我们可以看它的这个右上角的状态已经是 chaos ok 了。那么我们接下来就需要做一个所有小白在部署完 opencloud 的 第一个要问的问题,那就是今天的天气怎么样? 我们稍作等待,因为我们刚刚已经部署已经启动了 scale 这样一个技能工具,那么它在真正使用的时候,它会优先地选择我们的 weather scale 来去查询我们济南的天气。 如果大家在一开始配置的时候没有使用 scale, 那 么它会就用我们我们这个平台中的呃网络解锁工具 brave, 或者是使用 web search 或者 browser 等工具来解锁天气,这样我们稍作等待,看一下它能不能把我们天气真正给它获取出来。 好的,我们已经看到结果了,当前的体感温度是零摄氏度,但它实际温度是五摄度,这和我们当前在这个直播间的环境中感受是一样的。

420元脑服务器 05:17查看AI文稿AI文稿

05:17查看AI文稿AI文稿本教程分为三个部分,第一个是使用 qq 开放平台构建 qq 机器人,第二个是使用火山引擎购买大模型的 ipad, 第三个是使用云云电脑 的部署 cloud bot。 呃,下面是第一个部分,然后如果你没有注册的话,需要点击这个立即注册来完成一个, 按照他的步骤完成一个一步一步的注册。然后我建议你是使用这样的一个呃 qq 邮箱进行注册,然后注注册完成之后,其实你就可以通过这样的一个呃 qq 扫码来完成登录,登录之后的话就点击机器人,然后创建你自己想要的一个 机器人,创建完成之后,返回刚才的这样的一个机器人列表,找到你刚才创建的一个机器人,点击他的呃沙箱配置啊,在这个消息列表配置中添加成员,将你自己的这样的一个 qq 添加到这个成员当中 之后再回到这样的一个呃开发管理部部分,把你的这样的一个 app id 复制下来,和你的这样的一个集成密钥复制下来。呃,备用 在下面的这个 ip 白名单,等一会会配置好我们的一个云服务器之后再把它加上去,这一部分的配置目前就是已经配置好了。然后第二个部分就是通过火山引擎来定义你的这样的一个大模型,然后我使用的是他的一个方舟的固定片, 他这个其实非常便宜,也就呃第一个也就是八块九,基本上也是足够使用的。然后有一个好处就是你不用晚上布置一个任务,发现第二天起来房子没了的一个情况,然后你订阅之后,通过他的这样的一个快速开始, 快速开始来找到他的这边的一个呃配置编程工具中的一个其他工具, 然后找到它的一个接口协议,把接口协议复制下来,并且我们使用的模型我推荐使用这样的 g m 四点七, 然后的话就是通过这个获取 api key, 来就是来就是构建你自己的一个 api key, 但是这个 key 你 要记住一定要保存好,然后也把这个复制过去,然后这部分的配置也就完成了。 最后就来到了我们的微云电脑配置的一个环节,首先你登录进来之后可以找到活动专区,然后这有一个新人专属的免费试用活动,大概是两天的一个云电脑的试用时间, 你也可以先尝试一下这个,当然你后续继续想,你可以选择自己去订阅,完成之后回到刚才的界面就会发现这边多了一个云电脑,但是他现在的镜像还不是我们所需要的镜像,通过管理 呃镜像和变更镜像的方式来选择我们需要的这样的一个 mailbox 这样镜像,然后确认关机并变更 之后,就等待它变更成功。等系统镜像变更完成之后,就可以连接云电脑进入它的一个桌面, 点击这个 mailbox config 来完成一个配置。首先是切换到这样的一个通文达模型,然后把刚才的这样的一个相关的呃 u r l 你 自己的 api, 还有就是模型的名称全部复制到这里。呃,首先你可以测试一下连接连接,测试成功说明这个是可以用,然后保存配置。呃,虽然他这边也有一个通道设置中有 qq 的 这样的一个通道, 但是他不是很好用,所以我们需要自己的配置一个 qq 通道的插件,打开他的这样的一个 term, 通过通过 get 下载它的一个插件,下载完成之后,将刚才的机器人的 id 和这样的一个密钥好了,现在就配置完成了。配置完成之后,需要先重启一下网关好了,现在网关也设置好了 之后的话,需要用命令找到爱云电脑的一个 ip 地址,将这个 ip 地址拷贝下来之后,再去 qq 服务平台完成整个的一个机群的配置,同时回到 qq 机群平台,然后在 开发管理中把你的 ip 白名单填入之后,来到使用范围和成员这个地方,扫 右边这个码,将你的集成添加到你的这样一个聊天界面,然后就可以进进行这样的一个呃连接和测试了。嗯,好的,扫码,扫码完成之后,你就发现你添加了这样的一个集成到列表,现在你就可以给他发送消息后,再回到我们的桌面上,就可以看到刚才已经下载的 照片,然后整个教程就已经完成了。可以看到本教程的话,其实只花了十块钱不到十块钱就能够体验到整体的一个完整的一个呃,体验。最后我也将所有的这样的一个教程整理成了 pdf, 有 需要的可以后台滴滴。

142把AI讲明白

猜你喜欢

- 9561人工大黑