Ollama编辑代码使用如何

我们先来做代码生成和校验器的处理,那这一部分呢,三个依赖我们先导入进来, 就是欧拉玛的几个啊,第一个呢是欧拉玛啊,这个 non key 的 几个,第一个是欧拉玛,第二个呢是 non graph, 第三个呢是 core, 三个先导进来。欧拉玛的话,我们对应的是它的 chat 模型,就直接 chat 欧拉玛 olama, 这个应该没问题吧,我们来试一下啊,直接 const lm 等于 chatolama new 一个 chatolama 啊, 结果传进去第一个是模型选择,那刚才给大家看了,千问零点,千问三,零点六 b 啊,这个模型它的温度的话,大家注意啊,这个温度一定要调低一点, 温度调节,虽然现在气温有点低啊,但是在做这个场景的时候,你的温度要达到最低啊,零,达到零, temperature, temperature, 哎,一下短路了。 temperature, 哎,这怎么卡住了,等一下啊, temperature 啊,温度打到零啊,温度打到零, 保证它的确定性输出。那还有什么?还有很多,什么 topkey 给多少多少多少啊,还有 topkey 给多少多少,这些其实都我们在后续给大家去介绍这个大模型开发的时候都有啊,项目实战里面都有。 好,我们把这个抽象出来 chat alama, 得到这个结果以后呢,我们待会来看一下啊,最终啊,我们得到这个模型,如果要去输出的话,效果怎么样?那么假设呢?现在先 function invoke 一下试试, 直接调用 l m 点 invoke, 结果的话就传一个东西进去吧,就比如说 生成公式,但我直接瞎写的啊,我瞎写的,然后这里的话直接 a wait const r e s 等于它,然后这个上面的话我们直接 a sync。 好, 我们来调用一下 invoke 试一试。 进的话我们就改一下啊,一个是调用公式,还一个呢是调用 invoke agent 啊,我们就直接 node agent 点 j s 来试一下, 直接偏偏 invoke 什么呢? agent 回车啊,请你报个错误。报的什么错误啊?报的他找不到啊?我,我刚,我可能没装,不好意思,可能没装, 把依赖安装一下,安装好之后我们再来一次直接 agent 回车哦,完美输出了吧。啊,但我这里没有打印出来啊,我来打印一下。打印 r e s。 呐,这就是你最终输出的结果啊,你没有提供你的背景,也没有告诉我是要什么函数,所以我生成不了。好,那接下来我就来告诉你,我需要生成什么。生成什么呢?先把我的提示词注意了啊, 大家不要小瞧这个题诗词啊,很多同学呢,可能会觉得啊,题诗词这多简单,但是我告诉你,你可以自己去写一写题诗词并不是,大家知道吗?就是我认识的有朋友就是专门做题诗词和题诗词优化的。别人一个题诗词能卖两万,什么概念?就比如说,当然我这个肯定卖不到两万啊,我这二十块钱,我这个题诗词二十块钱还是值的。 只给大家例子,真正的提日词啊,在各个行业,他在做的一些工作流上面,能够去真正帮企业去提升效率。比如说你本来写文案,你的文案助手,你的这个提日词写出来的文案能够爆的几率很大, 你觉得值不值钱,对吧?所以呢,我们在开发 a 境的时候,第一关就是能够写出完美的就是或者是趋于完美的提示词。好,那假设我现在就是这样一句提示词吧,你是一个专业的,什么 face、 excel 公式生成助手,干嘛干嘛呢?我给他写这么一段,来告诉他不能用什么,能用什么好,写好这提示词就有了, 接下来我们要去做验证,再做整个执行的一个过程。好,那这一部分呢?因为时间关系,这个呢,在我们给大家去讲解的这个 vip 的 内容中间有具体的实现,我就不一个给大家去讲了啊。最终的 nonchain 的 话,它的节点和边和执行,我通过编排组装这个图的方式来整个给它组装好。 组装好以后来我给大家举个例子啊,接下来我假设用户输入了一段话,请帮我计算薪资,加上五百之后,再除以年龄帮我输出他的公式。好来,很厉害了啊,那。

粉丝1382获赞8908

相关视频

07:04查看AI文稿AI文稿

07:04查看AI文稿AI文稿嘿,大家好,今天我们来聊点特别酷的东西,你想没想过在自己的电脑上就能跑一个超强的人工智能,建一个完全属于你自己的 ai 工作室?没错,今天我们就来解锁这个技能,咱们马上开始。 哎,我先问大家一个问题啊,如果有一个 ai 助手,功能超强大,而且还完全免费,最关键的是你的所有数据都百分之百安全私密,你会不会心动啊?是不是听起来就觉得特别棒? 你看啊,咱们平时用的那些云端 ai, 比如说 chat gpt 对 吧?多半都要花钱订阅,而且说实话,咱们的数据都得传到别人的服务器上,心里总有点不踏实。但是今天的主角奥拉玛就给我们提供了一个全新的思路,在本地跑 ai, 这到底意味着什么呢?这么说吧,他不仅一分钱不花,你所有的数据,所有的对话,都老老实实的待在你自己的电脑里,哪也不去,绝对安全,而且怎么玩完全你说了算。 好,那咱们怎么才能进入这个 ai 的 新乐园呢?别担心,我们就这开始,你马上就会发现,这事比你想象的要简单太多了。 所以,欧拉玛到底是个啥玩意儿?这么跟你说吧,它就是一个特别神奇的工具箱,而且还是免费开源的, 有了它,你就能特别轻松地把那些很厉害的大语言模型,就是像 chat gpt 背后那种超级大脑,直接下载到你自己的电脑上,还能管理它们,让它们为你工作。 它的安装过程啊,我跟你说,简直不能再简单了,就三步,闭着眼睛都能搞定。第一步,打开浏览器,去它的官网 alma dot com, 找到那个大大的下载按钮。 第二步,看看你用的是 windows、 mac 还是 linux, 选对应的版本。第三步,下载下来之后,直接双击安装就行了。装完之后,它就在后台默默运行了,你桌面上啥也看不到,特别干净。 好嘞,安装搞定!现在啊,见证奇迹的时刻到了。打开你的终端或者 windows 上的命令提示符,准备好,输入你的第一条魔法咒语,欧拉玛 run 拉玛 two。 对, 你没看错,就这么一行 敲下回车,它就会自动帮你把那个大名鼎鼎的 lama two 模型下得下来,并且直接运行起来。当你看到类似这样的欢迎信息,就说明成功了。你现在已经进入了对话模式。这意味着什么呢?你现在正和一个完完全全百分之百在你电脑上运行的 ai 聊天儿, 赶紧试试感受一下那种几乎零延迟的丝滑对话体验吧,超爽的啊!当然了,光会聊天还不够,有几个常用的命令你也得知道。比如说,你想看看自己都下载了哪些模型,就输入奥拉玛 list。 诶,玩腻了那么速,想换个口试试 msdraw, 简单,奥拉玛 run msdraw 就 行,万一哪天硬盘满了,用奥拉玛 r m 加上模型名字就能把它删掉。最后聊完了,想退出,输入斜杠加 by 就 搞定了。 好在终端里聊天已经很酷了,对吧?但真正的魔法还得使用代码来驱动它。接下来咱们就进阶一下,看看怎么通过 a p i 让你自己的程序也能用上这个 ai 大 脑。 这里的核心秘密是啥呢?就是欧拉玛在你电脑上悄悄地开了一个本地服务器,还提供了一个 api 接口, 你可以把这个 api 接口想象成一条专线电话。你写的任何程序,不管是用拍放还是用 java script, 只要拨通这个电话,就能直接跟你本地的 ai 模型开始对话了。 那这个电话号码是多少呢?如果你是开发者,这个数字你的记忆下,一一四三四,这就是奥拉玛默认的端口号,你的代码就是要连接到这个端口才能跟 ai 搭上话。 那具体到用 python 怎么调用呢?嗯,当然了,你可以用最原始的方法自己写一堆网络请求代码,但那样又麻烦又复杂,估计得写个十几行。 幸运的是,人家官方早就想到了,他们提供了一个超级好用的奥拉马库。你只需要一条命令, piping store 奥拉马。把它装上之后啊,可能就三行代码,所有事就都搞定了,简直是懒人福音。 你看看这行代码就这么简单,一个逻码,点 chat 函数,告诉他用哪个模型把你想说的话传进去,然后 bam 回应就来了。这一下就把整个开发流程简化了不知道多少倍。你完全可以把精力放在你的应用本身,而不用去操心那些底层的破事。 ok, 到目前为止,我们已经学会了怎么使用现成的 ai, 但是接下来才是最最激动人心的部分,创造一个完全属于你自己的 ai 角色。 没事儿,咱们现在就来看看怎么把一个标准的模型变成任何你想要的样子。实现这个魔法的关键就靠一个叫 model file 的 文件。这个词你可能第一次听,但别怕,把它想象成一份给 ai 的 人设说明书或者角色设定卡就行了。 你就在这个文件里写几句简单的指令,告诉奥拉玛,喂,我要基于某个现有模型给我捏一个新角色出来。幸果要这样这样,说话要那样那样。 咱们来看个例子,比如要创造一个马里奥,你看这个 model file 就 两行,超级简单。第一行 from lama two, 意思很明白,就是告诉他咱们要基于 lama two 这个模型来改造第二行 system, 后面跟着的就是给他的核心人设,你就是超级马里奥兄弟里的马里奥。只能以马里奥助手的身份回 答清楚明白。好,咱们的人设说明书写好了,怎么让他生效呢?还是用一条命令,在终端里输入 alama create, 然后给你的新角色起个名字,比如 mario。 最后用杠 f 参数告诉他说明书在哪儿,回车一敲,欧拉玛就会立刻按照你的指示端一下,一个全新的马里奥模型就诞生了。 这一下最有意思的时刻来了,你现在运行欧拉玛 run mario, 然后跟他打个招呼试试, 他真的会用马里奥呢标志性的口吻来回答你, it's me mario! 哇,这个感觉真的太奇妙了!这就证明了你现在真的有能力去创造任何你能想象出来的 ai 角色了。好,那我们来快速总结一下今天 get 到的新技能。其实就三点, 第一,你现在知道了怎么用欧拉玛在自己电脑上免费又安全地玩转强大的 ai 模型。 第二,你学会了两种跟他互动的方式,一种是直接在终端里聊天,另一种是用简单的拍森代码。第三,也是最酷的一点,你掌握了用 model file 这个神器去创造独一无二的 ai 角色。 那么一个终极问题留给大家,既然你现在已经拥有了创造任何 ai 人格的超能力,你的第一个作品会是谁呢? 是想复活一位历史名人?还是想把你最爱的游戏角色带到现实?这个原则权现在可就完完全全掌握在你手里了。

16安的0扇区 10:47查看AI文稿AI文稿

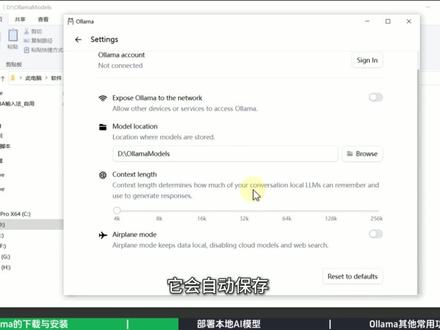

10:47查看AI文稿AI文稿大家好,我是知了这期视频,我们来看一下如何本地部署 ai。 之所以要讲这个,是因为我们在之后我们的 vba 输入法打开设置在 ai 助手这里,我们会添加 ai 补全功能,它使用的就是本地的 ai 模型, 这个功能过几天就会上线,目前还在内测。我们先来看第一步就是如何部署本地的 ai 模型。首先我们需要下载欧拉玛这个软件, 我们直接去它的官网点击这里,或者是直接在网页里边输入欧拉玛点 com, 然后就能打开。打开之后我们在右上角这里选择 download, 然后在这儿我们选择 windows 版本,然后再点击下载就可以了。注意这里必须是 win 十以上的系统啊, 我已经下载完了,所以我跳过了刚才下载的过程。下载完之后这就是软件的安装包,大家如果刚才官网打不开的话,我也提供了一个网盘链接,可以在我的公众号知了微微里回复欧拉玛就可以收到下载链接。 下载完之后我们先别着急的安装,因为直接双击安装的话,它的安装路径是在 c 盘,我们可以看一眼 现在我的 c 盘已经快满了,对吧?所以我们需要把它安装到其他盘里边,比如说我要安装到 d 盘,如果你的 c 盘空间很大,你也可以选择直接安装到默认的 c 盘里边。 我这里演示一下如何安装到其他盘里。我们先在 d 盘创建两个文件夹,一个是欧拉玛,一个是欧拉玛 models 这两个, 这两个文件夹待会我来介绍一下它有什么作用。我们先把安装包放到刚才欧拉玛这个文件夹里边,然后打开之后我们把鼠标放到文件路径这里,然后输入 cmd, 再按回车, 这个时候它就是在当前的文件路径里边运行了 cmd, 现在我们在运行这个软件,我们就可以输入就是这个名字哈,我们可以直接把它复制下来, 把它复制下来,然后粘贴进来,按空格,再输入一个斜杠,然后再输入大写的 d i r 等于,然后我们再把刚才的这个文件的路径放过来,也就是 d 盘冒号反斜杠,然后是 olama, 就是这个样子,它的意思就是我们要运行这个软件,把它装到现在这个文件里边,注意这个文件名最好大家要使用英文的,并且这个路径当中不要有空格。输入完之后,我们现在按回车, 然后它就会进入到安装的步骤,我们点击 install, 现在大家可以看到它安装的路径,就是在我们 d 盘设置的这个文件夹里边,然后我们就静静地等待它安装就可以了。 好,安装完以后,现在欧拉玛它自带了一个 ui 界面,这个界面我们先不管它,我们先把后边这个把它关掉,然后现在我们在这这有一个侧边栏,把它展开,展开之后这有一个设置, 选择设置这个时候它下边有一个 module location, 也就是模型的文件夹,它有一个默认的文件夹啊,默认的好像也是在 c 盘,所以我们需要修改一下, 这里我们就选择刚才我们在 d 盘创建的这个文件,我们就把所有的模型放到这里就行了,然后我们再打开这个界面, 再选择刚才的文件,它在 d 盘选择这个文件夹,点击确定 它会自动保存,这样在之后我们下载的 ai 模型它就会放到 d 盘,因为这个模型本身也挺大的, 所以我们放到其他的盘比较好一些。接下来我们再来说一下如何下载模型,我们先打开欧拉玛的官网,然后在这里点开之后,这里就有所有的模型都是可以下载的, 我们这次主要用到的是千问二点五,可以搜一下 千问二点五, 然后找到千问二点五 code, 点击在这里我们可以看到它有零点五 b, 一 点五 b, 还有三 b、 七 b 等等。 模型的参数越大,它的文件当然也是越大的,肯定也是越智能的,但是我们现在就使用这个一点五 b 的 就够用了,它一共有九百多兆,我们点击这里 点开之后,这儿有一个这个字母串,我们把它复制下来,点击复制,然后现在我们再运行 win 加 r, 打开运行窗口,然后我们输入 cmd 按回车, 现在我们再把刚才复制的这个字幕串,把它粘贴进来,然后再按回车,这个时候它就会下载模型,把这个模型下载到我们刚才的文件夹里边,这个过程大家等一下就行,速度还是比较快的 好,下载完之后它就自动进入了这个对话的模式,所以你可以直接在这里问它,你好,它就会马上的回复你,或者是我们可以在它的 ui 界面里边 打开之后,我们在这儿选择刚才已经下载过的模型,这儿已经有了切换到这个模型,在这里也是可以对话的, 到这一步说明大家已经部署完成了。然后在后边我们在 vba 输入法接入 ai 模型的时候, 你就可以把服务器地址写到这里,因为我们的模型是部署在自己电脑上的,所以这个地址固定的就是这个。 然后下边的模型根据大家的选择,如果你下载的是一点五 b 的, 就输入这个,如果你下载的是三 b 或者是七 b 的, 把这里改一改就可以,然后保存就可以使用了。关于 ai 代码补全这个用法,我们会在后边的视频给大家介绍, 然后我们再来介绍一下欧拉玛它的其它用法。我们先打开 cmd, 按 win 加 r, 在 运行窗口输入 cmd, 打开之后,我们可以直接输入欧拉玛,按回车,它就会把它的所有 命令给列出来,对吧?然后这里我们比较常用的第一个 run, 这个命令它可以下载模型,并且直接运行,其实这个 pull 它也可以直接下载,但是它只是下载,然而它不会运行。然后在下边比较常用的有一个 list, 可以列出我们所有的模型,还有一个是瑞幕 r m, 就是 移除模型,我现在来演示一下,比如说我们先来演示这个 pool, 我 们在这里搜索一个 deep seek, 然后按回车,我们找到 deep seek r 一, 在这儿比如说我们要下载一点五 b 的 deepsafe r e, 我 们点击它,这不是有这个命令吗?我们不使用这个命令,比如说我现在先把这部分复制下来,然后在这儿我输入 欧拉玛库,也就是说我们只下载一点五 b 的 deepsea 二一,然后我们按回车,这个时候它就会把这个模型下载下来。 好,下载完之后你看它和刚才就不一样了,它没有直接进入对话的模式,因为我们没有运行这个模型。然后我们可以通过 list 来获取所有的模型列表。 输入 olama list, 按回车,它就会把我们当前的所有模型都列出来。假如说我不想要这个模型了,我们删除的时候就可以直接输入 olama, 然后 remove r m 空格,再把这个名称复制下来,它就会删除。删除完之后,我们再看一眼这个列表,它就只剩一个了。这就是欧拉玛的简单的使用方法。 然后是最后一个问题,假如说大家不知道自己的电脑能否运行欧拉玛,并且是不是支持一点五 b 的 模型,甚至是其他的模型,你可以随便打开一个 ai 豆包也好,或者是 deepsea 也好,你把自己的电脑配置发送给他,然后他会告诉你你的电脑是不是可以运行。现在一点五 b 其实算是比较小的模型了,大多数电脑都是支持的 好的。以上就是本期视频的全部内容, vba 输入法,现在大家可以下载体验所有的功能,下载方式可以在我的公众号资料 vba 里回复输入法就可以收到下单链接, ai 助手的代码补全这个功能我也会尽快的退出。目前已经到了内测的阶段了,感谢大家的观看,我们下期视频再见。

22刘知了zZ 01:05查看AI文稿AI文稿

01:05查看AI文稿AI文稿本地部署 ai 模型真的太香了,不用联网,不花一分钱,隐私全可控!今天教你在 windows 十一电脑上零门槛部署一个属于你的纯本地 ai。 打开你的 h 浏览器,输入欧莱玛,点 com, 认准这只小羊驼,然后点击这里复制这段代码,再按文件输入 powershell, 打开后直接点击右键代码就自动粘贴上去了。回车确认,自动开始下载。安装完成后,再输入欧拉玛杠 v, 只要屏幕上弹出一行版本号数字,那么恭喜你,框架搭好了。有了工作环境后,我们再接入需要的 ai 模型, 直接输入这串代码下载。这个轻量模型中文理解能力非常好,而且才七币,普通的 win 十一轻薄本也能带得飞起,完全不卡顿。 出现这个符号后,你的私人 ai 就 上线了,可以直接对话了,比如梳理一份工作总结模板,你看这个出词速度刷刷的,而且全程不用联网,要退出的话,输入斜杠拜回车就好, 下次起用就再输入一次这串代码,一秒唤醒,直接开聊。这么香的用法,今晚就给你的电脑安排上吧!

1073微软 10:41查看AI文稿AI文稿

10:41查看AI文稿AI文稿hello, 小 伙伴们大家好,欢迎回来。在完成了 python 的 环境部署之后呢,我们现在可以左手通过 python 对 欧拉玛进行编程的开发了,所以本小节让我们来学习关于欧拉玛库的基础 api 的 使用。 首先我们想要通过 python 代码呢去操作欧拉玛,那么大家要做的第一件事情就是确保欧拉玛已经启动了,那可以通过这样的一条命令去把我们欧拉玛给启动起来。 然后如果我们想要通过 python 去操作欧拉玛,那最重要的第一步操作就是要获取到欧拉玛的客户端对象,那它可以通过欧拉玛这个库里面提供了一个叫可令特的一个方法,然后传入一下欧拉玛的主机地址,比如我们 local house 下的幺幺四三四这个端口, 通过这一段代码就可以得到一个叫可令特的对象。哎,那这个对象就是整个欧拉玛运行所用的一个客户端了,我们可以通过这个可令特对象对欧拉玛进行后续的操作。好,那首先我们把这个重要代码呢先给大家钉到屏幕上 好了,钉起来之后,我们再来看看我们这个可令特里面到底有哪些方法,哪些 api 供我们用呢?那其实本质上欧拉玛他的操作 api 并不多,我们呢挑选了几个比较常用的给大家去展示一下。那比如第一个方法叫做历史的方法, 通过客户端调用一个点 list 的 方法呢,就可以把我们当前欧拉玛里面可用的模型去列出来。那第二个是秀,就是显示指定模型的详细信息。第三个呢叫 ps, 查看正在运行的模型,那以及第四个叉特,哎,这是一个最为重要的方法,可以与模型进行对话, 那所以我们主要有这四个 ipa 供我们去使用,那所以我们把这个 ipa 呢给大家去盯起来,然后呢去回到代码里面去尝试着练一练,用一用它。好, ok, 我 们把这个图给它缩小一下,然后打开我们的代码编辑器。 好的,回到了我们的拍叉母中呢,那我们首先要做的第一件事情呢,就是来创建一个新的代码文件了。好,我们右键创建一个新的拍摄文件,然后给它起名叫做欧拉玛 test。 好, 进来之后呢,我们首先先写上一个引泡,去导包啊,导我们的欧拉玛这个包。 好。导完包之后呢,刚刚我们说过要做的第一件事情,是不是要把这个客户端对象先给它创建出来呀?好,我们来获得欧拉玛的客户端对象。 好,那客户端对象可以通过欧拉玛这个库里面有叫可令特的一个方法,通过这个方法就可以获取到了。我们来写上欧拉玛,然后点上可令特,这都要注意这个 c 啊,可令特的 c 是 大写的,然后在里面给他传参,只需要传一个 house 的 这个参数就可以啊,它的参数内容呢是 house 的 ittp 冒号斜杠,斜杠,然后 local house 的 幺幺四三四端口。好, ok, 想要这个代码,我们可以在前面通过一个叫了可令特的幺幺四三四端口。好, ok, 想要这个代码,我们可以在前面通过一个叫了可令特的幺幺四三四端口。好, ok, 想要这个变量去接收就可以了。 好,那这样的话我们相当于得到一个客户端对象,那有了这个对象,后面可以通过他对奥拉玛进行操作了。那在进行其他操作之前,首先我们先来右键运行看一看啊,因为如果说这个客户端对象你获取成功和不成功,我们运行就能够得到结果了。来运行 好可以看到他没有报错,那就说明我们的运行呢,是成功了。如果说你报错的话,那大家要做的第一件事情就是看看你的奥拉玛是否启动了,可以通过速度 s y t e m c t l 然后 s t i t u s 欧拉玛,好,通过这条命令去查看欧拉玛当前的运行状态。那大家可以看到我当前的是 xt 五正在运行中,如果说你们的没有运行的话,就把这个 stata 四换成 stata, 就 可以把欧拉玛给启动了。 好,那确认奥拉马启动之后呢,并且已经获得到了客户端对象,那我们可以对它进行后续的操作了。比如第一个事情叫 list, 这是列出有哪些可用模型,好,我们直接通过 pos 的 语句啊,把这个 list 的 结果直接展示一下,我们可以通过 clint 啊这个客户端对象,然后点上一个 list 啊,然后就可以列出来有哪些模型呢?我们可以右键运行,直接跑好运行,可以看到。哎,是不是把我们可做模型列出来了,那这是一个数组,对吧?这里面表示它,我们有几个模型就都给你放里面。但在目前我们只有一个模型叫做 deep sec r e 七 b 参数啊, ok, 这是它的完整输出啊,那对于我们来说,其实只需要关心一下模型的名称叫做 deep sec r e 七 b 就 可以,好,这是 list, 那 再来还有个叫 show, 这是展示 模型的详细信息啊,同样我们通过谱写语句,直接把它的结果给输出一下,可令特,然后点上一个秀。好,那这里面需要传的参数呢?就有一个模型啊,是一个字不串类型,所以我们把模型的名字给它,第一坡 c 杠 r 一 冒号七 b。 好,把模型的名字给他之后来右键运行一下,他会把模型的详细信息啊,就在这里啊,这一堆详细信息就给我们输出了,可以看到东西呢,还是比较多的啊,比较多的。好,那再来第三个,我们还有一个叫做 ps, 这个方法可以去列出哪些,有哪些模型 在运行中。好,我们直接通过 print 啊,直接通过 print 把它的结果给输出一下,好,写上 ps。 好,来,同样右键运行看一下。好,那可以看到最后一个输出是一个空的,那就说明当前呢,没有任何一个模型在运行中,哎,这是因为我们可能欧拉玛刚启动,还没有启动任何的模型,对吧?那比如我们回到这边给大家验证一下,哎,如果我们这边通过命令,比如我们写上欧拉玛叫 r, 然后写上 d 坡 c 可杠 r 一, 冒号七 b。 好, 如果我们在这边把模型运行起来之后呢?然后我们先不在这里面输入,回到代码这边来,右键运行一下。 好,那可以看到正在运行的模型是不是就有了啊?有一个叫 deep space r e 的 模型正在运行中啊,所以说通过这个 ps 可以 看到啊,有哪些模型正在运行? 那这三个都是一些基本操作性的代码啊,跟我们的对话没有太多的关系,那我们有了模型之后,其实最核心的是要完成对话,对吧?所以说我们通过一个叫叉的方法和模型进行对话。好,那首先我们写上可令特,然后写上一个叫点叉特。 好,那它就表明我们要和模型进行对话,然后它里面需要传的参数还是比较多的,但是呢,我们组装传两个参数就可以,第一个参数叫做 model 啊,这表表表明的是你的对话选择的模型是什么,我们可以选择叫第一坡 c 杠 r 一 冒号七 b。 好, 这样的话就可以去选择模型,那第二个参数呢?叫做啊 message 啊,就是你到底要跟他聊天,你要聊天的内容是什么?我们写上 message 啊,在这个 message 呢,它在里面写的是有点特殊的啊,你要按照这个模式写,比如先写一个列表,然后在列表里面再写上一个字典啊,这个字典我们需要提供两个 k, 第一个 k 呢叫做 role, 就是 它的角色啊,冒号,然后给它起个角色名叫优势啊,这表示用户提问,那第二个呢? 它的 k 叫做 content, 表示内容啊,在这个双引号这个字五串里面,其实就要大家去填,你到底要问的问题是什么呢?比如我们写上你是 谁就可以。好,这样的话就相当于跟我们的模型呢去进行了一个提问,这个提问的意思就是 ruler, 就是 角色用户, 然后提问的内容你是谁,它就表明用户向模型提问,提问的问题是你是谁?等待模型回答,那模型就是 deepsea r e 七 b 这个模型好,它的回答怎么获取呢?我们可以首先找一个变量去接收它的返回值啊,给它起名叫 response。 好,那有了这个变量之后呢,它相当于运行完这个代码,你就能拿到模型给予的返回结果了,我们可以通过 print n f 语句把它的结果输出一下。那最 boss 呢?是一个综合型的一个类型啊,它里面东西很多,我们主要关心模型的回答就可以,那我们可以通过去取它里面一个叫做 message key 好, 然后再来 message key 里面再取到一个叫做 content 的 key 好, 通过取两次 key 就 可以得到模型给我们的回答内容了。那我们来尝试着运行跑一下瞧一瞧吧。来运行 好,可以看到是不是我们模型的回答,就在这里面给我们提供出来了。好,那这样的话我们就完成了通过 tag 和模型对话的功能。 ok, 那 么完成了这一小步之后呢,我们可以把代码呢稍微的改装一下,把它变成一个持续运行的程序,可以和我们的模型持续的进行对话。 那比如我们可以去写一个 while 循环啊,然后给他写上一个处,让他无限循环一下。好,那在下面的话,我们把这些格式组装一下好,首先的话我们写上一个音符的语句啊,提示用户输入就是请输入问题好,然后呢找一个字母串接收它 好,接下来之后呢,我们可以把这个用户输入的内容啊,去给他替换到这个 content 中啊,这样的话就表明我们像模型提问了,然后模型提问会给出我们回答,然后由于是无限循环,问完之后呢,又再次让我们去输入问题,好,所以简单的改动一下,你看一个基于代码的小聊天机器人就有了, 请输入问题,我们说你是谁,然后回车给予之后呢?那么稍事等待一会,你看模型的回答就有了,然后再来你看,又让我们提示请输入问题,我们再来提问一下啊,用 python 输出一杠十好回车,我们的问题呢就发过去了,那么稍事等待一会,等他给予我们对应的答案就可以, 那这个过程中呢,其大家也可以去监控下,那通过这个监控可以看到刚刚我们这个 cpu 是 不是瞬间飙升到这个百分百啊?好比如说我们再来去问一下啊,我说二点一一和二点九二啊,谁大 好。当你提出来这个问题之后呢,那我们再来回到这个任务管理器里面,可以看到我们的 c 这个 gpu 是 不是它的使用率就刷了一下上去了呀?那也说明我们当前这个 python 代码去调用的这个欧拉玛呢,也是能够去利用到这个扩大加速的,也是可以让我们的 gpu 跑起来,这样的话它的性能呢会更好。 好了,那这样的话,我们就完成了 python 的 一个基本使用啊,通过 python 代码我们可以完成对欧拉玛的一个快速编程,其实本质上它没有太多的 ip 啊,就这几个就够我们用了啊。一个历史的列出有哪些模型,一个秀 展示模型的详细信息, ps, 列出哪些模型在运行中,那这三个其实本质上来说都是运维相关的,我们在代码里面其实不用写都行,在这个外面我们自己手动操作都可以。那所以对于欧拉玛编程啊,最核心的一个 ip 呢,是这个叫叉特的, 通过这个方法我们可以去向模型提问,并且呢去获取到模型给我们的结果,那这样我们就可以方便的去对欧拉玛进行编程的调用了。 好的,那么完成了这些之后呢,我们就有了通过 python 代码对欧拉玛进行基础编程的能力了。好完成这些学习,那下一步我们就要去通过 python 去构建可以用的前端网页了。那所以下一个视频 我们再去写一写 steamlit 的 相关代码吧。好的,那么让我们保存一下视频,下一个视频再见。

01:35178Dash的AI笔记

01:35178Dash的AI笔记 01:21查看AI文稿AI文稿

01:21查看AI文稿AI文稿今天给大家分享一个企业级的 ai 代码屏审以及优化平台,我用了三个月时间从零到一完整开发,这个项目的技术含量非常高啊,为什么这么说呢?首先的话,后端我们采用的是 spring 不 3, 加上 java 的 二十一以及 webflex 响应式编程。前端的话我们采用了 v o e 三,再加上 type script a。 集成的话我们支持多引擎架构,其中包含了通用千分的 api 调用以及饿狼马本地大模型,后续我们还引入了 deepsea、 gpt 等等大模型平台。 认证系统话我们采用的是 superbase 认证,支持邮箱密码以及 get 哈的认证。目前 superbase 认证的话是非常火的,这个系统有什么用呢?它可以帮我们秒集完成 专业级的项目代码的审查,而且可以从多个维度去分析我们代码的问题。更厉害的是它可以自动生成优化后的完整代码。这个项目的话目前是完全开源的, 代码质量已经达到了生产阶标准啊,非常适合学习全在开发和 ai 集成的成员。最后关于这个项目的详细的开发文档,以及这个项目的前后段的详细的源代码 都给大家准备好了,大家可以自己抱走回家在本地去部署测试一下。今天关于这个项目的整体介绍就先到这里,从下节课开始的话,我会详细带大家去讲一讲我们这个项目的具体实现是什么样的。

47伯乐说技术 02:31查看AI文稿AI文稿

02:31查看AI文稿AI文稿首先我们第一步安装欧拉玛,大家下去之后呢,可以看这个视频回放来操作啊,因为我可能讲解的速度呢,相对来说快一些,所以大家如果说跟不上的话,可以稍后下去之后再来去看。 呃, olamar 的 安装比较简单,直接大家打开 olamar 点 com 官网点击下载,点这个 download 就 可以了啊。如果说你是呃 windows 的 同学也是点这啊,因为它不管是苹果系统, linux 或者是 windows 都是完全支持的啊,你直接点一下 download 就 可以了。点 download 之后,我这边呢就直接可以打开这个 olamar, 我那么打开以后呢,在这啊,就是一个羊驼的图标,现在我是我是已经安装好并且打开了。打开了之后呢,我们接下来就想要去安装模型,模型的选择大家可以点一下这个 models, 点 models 之后,大家可以看到排的第一的就是 deepsea 二一啊,我们今天用的呢也是它,并且大家可以看到它的热度,这是九点四兆 plus, 拿取的人非常多啊,我们也就选用这个,大家直接点进去看这个地方呢,有一个选择。呃,具体的这个 选择呢,我们可以选择稍微小一点的啊,就比如说七 b 或者一点五 b, 反正你就选择一下之后去用一下啊,正常情况下,满血版的六七六百七十一 b 的 这个呢?四百多 g, 这个一般同学们的电脑是不用不用去试的啊,基本上试不了的, 你可以点一下这个 view wall, 下面这些呢,其实都是他的啊,对应那些模型 tag 啊,打的 tag, 我 们可以选择七 b 或者是 nattest, 我 们现在呢就选择 nattest 啊,选择这个 nattest, 然后我们打开这个命令行工具,因为我们其实已经安装了 alama, alama 安装好之后,你就可以直接在这 搜索啊,或者说去看 alama 有 哪些命令,比如说杠 h 回车,你就能够看到所有关于 alama 的 提供给大家的一些命令啊,比如说有 serve, create, show, run 等等。其他这些命令呢,我不跟大家去介绍了,我们直接来把 deep seek 跑起来啊,那么我们这里跑呢,就直接 deep seek r e 冒号 nast 回车,这个其实跑起来比较简单呢,就是几行命令的事情, 好,启动的时候相对比较慢哎,大家可以看到现在就启动好了啊,现在启动好以后,其实我现在就可以对他呃发送命令,他就可以帮我去回答了,比如说你好,或者说给我的给我直播间的同学前端同学打个招呼, 好,这 sink 的 这一部分呢,其实就是它的思考,然后后面就提示出来了啊,你好呀,直播间的前的同学们,呃,很高兴能够在直播间见到大家啊,大家新年快乐,如果有任何问题和想法的随时跟我互动啊,这样就这个模型其实就已经跑起来了啊,完整课间评论区扣八八八,免费领取!

猜你喜欢

- 7355大话编程