wan-animate动作迁移教程

今天给大家带来 one animate 的 一种高阶玩法,先看效果,视频转会、 真人变,动漫跳舞, 角色动作。我有我自己的原则,我不想一辈子让人踩在脚下, 你以为我是臭脚贩子?这是一个基于 animate 动作迁移的工作流,它不仅免费无限制,而且能够实现无限时长的视频生成。工作流和各种插件我都打包好了, 暗号直接长长操作,非常简单。这里上传一段人物动作模仿视频,再上传一张参考图片,调整好参数后,直接点击运行 段,人物模仿动作姿势的视频就出来了。整体的视频都是比较丝滑的,人物动作自然协调。如果你也想创作这样的视频,多学一个技能,暗号暴走开练!

粉丝9840获赞2.7万

相关视频

03:53查看AI文稿AI文稿

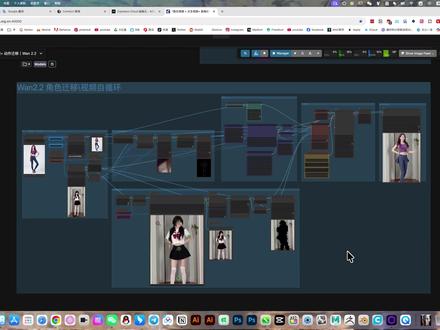

03:53查看AI文稿AI文稿那么刚才这些视频呢,都是通过我们最新的 one animate 动作迁移工作流生成的,可以看到人物动作保持一致, 整体的效果还是很不错的,那这个模型也出了很久了,但是因为有一些小伙伴们的显卡没有那么好,所以一直不能够唱完,那今天这套工作就非常适合我们低显存的小伙伴们使用,那么我们来正式的介绍一下如何使用这款工作流。我们先看一下生成的结果怎么样, 首先这是输入的图像以及一个参考视频, 最后是我们生成出来的视频,那么效果还是很不错的,人物的面部包括服装背景都保持了一致性。具体的生成原理是这样的,首先我们需要加载一下我们的大模型, 这里面我们选择用 k s 的 g g u f 模型,这样子可以有有效的缓解我们显存的压力。再加载了两个 raw, 分 别用来提速和增加视频质量,再增加一个克里普模型。 然后我们需要给我们的题词文本里面输入一下我们想要的画面内容,但是其实这个题词对于我们生成的结果影响并不大, 主要还是看我们的参考视频中提供的姿势控制来决定生成的。这里面就要提到一个非常重要的部分,就是姿态处理的部分,那么我们分别需要两个姿态域处理器来检测我们的面部和姿势。 大家也可以看到在我们的主要的动画短视频这里面有一个面部视频和一个姿势视频, 那么就是通过这两个姿态预处理器来进行处理的,然后在这个动画转视频这里面,我们将我们的条件输入进来,同时增加一些 ve 可离谱视觉输出以及我们的参考视频,就可以进行到我们的彩样阶段,最后也就可以生成视频, 那么下面我们要着重的强调一些我们要修改的参数,那么首先我们要导入一张想要替换的人物图像,以及一个用来控制姿势的人物视频,然后通过调整我们上传视频的尺寸来决定。最后我们生成视频的一个尺寸,在这里面已经有设置了, 我们在这个地方设置它的宽高,同时在这地方输入它的秒数,也就是我们最后要生成视频的长度,我们着重需要调整的就这两个部分, 其他的参数大家按照我设置的就可以了,效果是非常不错的,那么通过实测,可能你八 g 显存或者十二 g 显存都可以流畅的跑起来,当然你的显卡性能越好, 你就可以把这个尺寸数调高一点,那么效果也会更好。同时在上面的这个模型这里面我们也可以不用 g g u f 模型,我们可以选择用更大参数量的模型。那么就要来介绍一下如何配置这款工作流, 那么这个是这个工作流所需要的模型以及工作流文件,包括插件我都在我的网盘里面整理好了,大家可以在评论区里面自取。那么首先是所需要的模型,包括我们的大模型以及其他的模型, 那么大家只需要按照这个设置放置到我们的 model 文件夹里面就可以了,需要的插件也在这一块以及我们的工作流文件,那么最后能得到一个这样的结果,个人觉得还是很不错的。那么这节视频就到这里了, 如果对你有帮助的话,不妨点赞加关注支持一下,不要忘记去领取我们的资料,我们下个视频见。

2506AI绘画-君君 01:03查看AI文稿AI文稿

01:03查看AI文稿AI文稿超强视频人物替换,动作迁移工作流终于来了,先看效果,这是我用最新的忘二点二 any mate 模型生成的效果,可以看到替换的人物效果非常完美,动作迁移非常流畅,人物的表情保持的很一致。无论你是想生成这种 i s f w 的 美女跳舞, 还是这种整活的视频,都能轻松生成工作流模型我都整理打包好了。举手手,三三三拿去试试。那么首先 我们要导入一张想要替换的人物图像,以及一个用来控制姿势的人物视频,然后通过调整我们上传视频的尺寸来决定。最后我们生成视频的一个尺寸,在这里面已经有设置了, 我们在这个地方设置他的宽高,同时在这地方输入他的秒数,也就是我们最后要生成视频的长度。我们着重需要调整的就这两个部分, 其他的参数大家按照我设置的就可以了,效果是非常不错的。那么通过实测,可能你八 g 显存或者一二 g 显存都可以流畅地跑起来。

2592comfyui工作流冠锐 13:21查看AI文稿AI文稿

13:21查看AI文稿AI文稿今天分享的是呃视频的人物替换,比如说我有一个这样的视频,我想把里边的人物替换成这张图,那用这个工作没有就可以轻松的 把这个视频中的人物替换,只替换人物背景包没有声音也一样。 然后第二个是其实两个工作一模一样,只不过是第二个,不单只是替换人物,把背景都替换了,等于是我只是参考人物动作跟声音,把这张图完全替换掉, 最终的效果就会是这样子的,就全部替换,上面是只替换视频中的人物,所以这两个工作没有基本上是一样的, 功能不同而已。然后这个比方说有个小技巧,就是参考的时候最好是呃全身的,比如说这个是全身的,那你 要转视频的这张图片也要是全身的,不然的话他会自动生成其他部分,他会根据你上传的那张图片自动生成他的下装啊什么的, 等下我再详细介绍。首先介绍一下,我这边用的是端脑云的在线镜像,大家不想本地部署的话,直接打开我的镜像就可以 直接使用,你现在看到我能用的你就能用,因为我现在用的就是在线进行这个工作,没有放在最外面,在这。 然后这里边还有很多工作没有最外边是最新的,比方说什么二五幺二纤维或者酶酶全套的,还有 mpx 二点零的纹身图及 手绘真视频等等,全套最新的都在外边。然后里边是有视频类、图像类、语音类,视频类就是比较长远的,以往的我都会放在这里边, 图像类也是以往的所有的工作没有比较实用的,我都放在了有三百个工作人员类的,残余的我放在外边就是 并无提取。纹身或者是深层音乐纹身语音或者是一句话声音克隆,或者是一句话声音克隆加歌曲变声就比较常用的,放在这 目前最常用的应该是外面这些吧,而且这每一个视频都对应的一个,每一个公众都对应的一个视频教程,这样子就方便大家现学现用。 用空投 u i 镜像的好处就是不用部署,即开即用,你看到我能用你就能用,而且可以一键复刻,我这所有的工作没有变成你自己的。而且镜像的好处就是可以自行的安装模型或者修改模型, 等于是一站式搞定,所有的工作没有都在这一个空 for ym 一 点,你可以自由组合使用,更适合专业设计师用户吧,而且每个视频都配有视频教程,等于是可以现学现用,边学边用。 然后如果嫌本地不熟的呢,可以点开我的笔记,点导航上 com 一 百教程就会跳转到工作内位置,最下面就有工作内位置,把这个图像给收起来,这个工作没有放在视频内里边,视频内里边,呃,这个就是万二点二图声视频什么什么 点开里边有安装教程,这个工作没有里边所有用到的模型啊及下载链接,还有下载的一个截图,还有安装的位置啊,都都有总结, 所以想本地部署的人可以直接使用这个查看,这些安装部署 全部都有,还有这些罗拉的安装部署放置位置底下就是工作的截图,每个工作的截图都可以看清上面的参数,这样子就方便有时候不需要打开。呃, 整个工作没有屏幕,这一个工作没有一个完整的截图,这个是看不到参数,但底下我都会截取能看到参数的。 呃,部分截图,每个截图组合起来截进去就可以看清这个参数,有时候可能我们只需要看清参数,不需要打开工作门,每个工作门的截图都有,这样子就方便查看使用,而且最低 这个就是呃,视频人物替换的,这个就是视频参考人物动作生成视频的,这个是能看清楚参数的截图,底下就有视频教程,最底下就是工作没下载,这个就更适合本地部属的人去看了。 好了,回到我们这个工作没有上面去。首先是呃,我们需要一张图,就是你想要替换的一张人物的图片,再提供一个想要参考的视频动作丢进去, 然后设置一下尺寸长宽视频的尺寸,最后还要设置一下循环的帧数,屏幕这边是七十七帧, 呃,这边是幺五四,等于是呃,七十七的满倍,呃,不懂设置的话可以看着这样子就等于是七十七乘以二等于幺五四就 免费的自循环帧数每秒是二十四帧,这个就都不用变,只是在这边设置一下你要提取的视频长度,你就以七十七为准,乘以二或者乘以三,当然不能超过这个视频的最长度, 这样子去设置这个就可以了,然后不懂的话看这个设置循环帧数在这等于是自循环两次,这个你可以自己试验一下循环每次或者循环更多的, 然后上面这一部分是表情和动作的提取,这个就默念就可以了,这都是二十帧,不用去改。 底下是遮罩的一个提取。呃,也默问设置就可以了。这边有个就是你要生成的时候,有时候第一针,呃,他提取的 图片可能不够完整,你想要保留的或者不想保留的,他提取不到这张图,你就可以选择帧数,比如说我觉得二十帧的图像比较好,那你这边选二十帧, 然后记得提取这张二十帧的图像的时候,只要右键点这个只运行这个节点,然后提取 他就只跑这一步的节点,这样子就提取出来这个节点,然后在这边选择要遮罩的一个范围,比如说这个头部药、手药、身体药、 脚药,这个主要是提取遮罩,就是像这边这样子,黑色的一个遮罩, 绿色就是要的部分,然后只提取人物的动作,所以背景是不要的,你把这个红色不要的放在背景上就可以了。这样子先做这一步, 之后再去运行生成,他就可以直接把人物替换成你需要的这个人物。 这一步只是提取遮罩,然后这个只是提取遮罩的这个块的大小,默问就可以了。 好,这边有个小细节,就是动作反推,最好是用第三个,这个就是前后都反推,如果是选择前面,那就是向前反推,这个是向后反推,这个就是前后都反推,动作自己去反推, 毕竟这个模型是动作迁移的模型,所以。嗯,这个要设置一下,这个是动作迁移的模型,这个 v 二版本的他可以呃低选存,也可以运行,就是一些低配置的就可以运行,这个默认就可以了。 然后这个 logo 也是四个 moment 就 可以了,第一个是呃就是人物动作面部提取,第二个就是人物身体的动作提取,第三个是修复的视频修复的一个 logo, 第四个是视频增强的一个 logo, 反正这四个配合上就可以了,这些都不用去改。 第四次也是没有控球性。然后这个就可以精准的把这个人物替换到视频中的这个人物,而且表情跟动作都完美的替换输出。 好,上面这个说完了,这个只是提取一张帧数,然后控制想要和不想要的部分, 提取的时候最好选择一针凸线是纹路比较完整的,不要纹路都跑掉。那那那就不行,所以先要右键运行一下,选择一个针数,然后右键运行一下这个针,选择好了再去 整个工作,没有变形好,这个就结束了,静安掉。然后底下这个区别其实只不过是底下这个呃门幕门板 不提交上去而已,这边插了一个人物门板没提交在这上面,所以他就不是一个上面这个,比如他把这个人物的门板自动门板提取进去,所以他会把人物扣出来,把这个替换进去。 而底下这个我只是要生成这个文武的视频,只是参考他的动作,所以文武门板这个是不需要的,所以他就把这个链接断开,如果需要的话把它接进去就可以就变成上面的工作了, 所以底下的这一步就可以就变成上面的工作了,所以底下的这一步就可以了,也可以, 然后这边也是一样设置尺寸,然后设置呃总帧数,然后提取的帧数,你可以提取一百五十七帧,这边也改成一百五十 啊,上面说错了,这边也可以提取帧数一百五十四帧这样子对应, 然后其他都一样,就是那他自循环,这边是提取他的表情,提取他的动作,面部动作跟身体动作。最后参考这个视频,直接把这张图片转成 这个 直,直接等于是动作迁移到这张图线上,这个就比较简单,上面这个等于是多了一个地下制造,只是单纯的把这个纹路给提取出来,再融合进这个背景, 只是替换而物。其他的部分我上几期都有介绍过,可以看上几期的视频,要使用的话可以看上几期的视频, 然后如果不用的话,就要记得在最大的这个群主,不是在这小群主上面,右键在最大的群主上面,整个界面想要用哪个工具,你就右键打开哪个工具去使用就可以了。 好了,这期就是更新增加这么一个节点,呃人物视频,替换人物,然后凸现,参考视频生成视频。好了,大家去玩吧。

7吴杨峰 01:04查看AI文稿AI文稿

01:04查看AI文稿AI文稿今晚谁和我一起睡啊?我渴了,去买瓶可乐还是我们一起?我饿了,去买手抓饼,我叫了外卖,马上就到。我尿急上厕所了。走吧,我们去洗澡。 喂,这里就我们三个人,洗干净点。人在江湖,身不由己。 哼哼哼,今晚玩个痛快。像这种影视二创是如何制作的呢?手把手教会你。准备好视频和人物白底图,在剪映里把镜头切换处分割, 打开 com 上传视频和人物,填写人物外貌提示词,选择需要替换的人物, 点击运行就 ok 了。我回来了,我渴了,去买瓶可乐,冰箱里有。呃,我饿了,去买手抓饼,我叫了外卖,马上就到。哎呀,我尿急。哎呀,我们一起去隔壁上厕所吗?嗯。

01:53查看AI文稿AI文稿

01:53查看AI文稿AI文稿大家好,针对 one animate 项目做了更新,针对之前只能生成十二秒以内的视频做了改进,通过循环生成方式,目前可生成任意长度的视频了。程序支持角色替换和动作迁移两种模式,这个是目前动作最丝滑的动作迁移程序了。 进入程序界面,上传一个图片以及一个跳舞的视频,看一下这个视频有十五秒,其他参数使用缺省的就可以点击生成。视频 显存最好大于十六 g 以上,如果只有八 g, 那 只能生成短点的视频,并且分辨率也要调低。整个生成时间大概几分钟。看看最后生成的效果, 可以看到完美支持十二秒以上的视频了。 我们换个图片,选择动作迁移功能,看看最后生成的效果。 可以看到女孩完全模仿视频中的动作了,但背景没变。我把软件的获取办法放到简介里了。今天的视频就到这里,我们下期再见。

22Ai剪辑助手 12:28查看AI文稿AI文稿

12:28查看AI文稿AI文稿哈喽,大家好,我是香酥万象。今天这期视频给大家带来 one enemy 的 合集,一个是角色替换,还有一个是动作迁移,一共两个工作流啊,这个模型其实出来很长时间了,好几个月了,为什么今天的做视频呢?主要原因有两个, 第一个是我更新康复 ui 相关的内容时间比较晚,十二月初才开始吗?第二个就是我感觉看我视频的很多朋友都是才刚接触康复 ui, 那今天这个工作流就是比之前的生图工作流要稍微复杂一些。那借着这个机会跟大家讲一下康美 u i 工作流相关的一些东西啊。关于这个康美 u i 工作流啊,很多新手朋友肯定一看到这些密密麻麻的节点就头就晕了。 但实际上,不管是什么工作流,他的核心就是三块,一块输入,一块采样,一块输出,你只要把这三块搞明白了,那其他的对你来说都不难了。那咱们就先从这个角色替换工作流开始看,艾利曼呢,他本身的核心功能就两个,一个是角色替换,一个是动作迁移。 角色替换就是把你上传的图片替换到视频里面去,单人也好,多人也好,那动作迁移就是让你上传的图片去模仿视频里面的动作。像这个工作流,我把它分成了几个块,这样看起来会更直观一些。 然后也用了 get 和 set 的 这些节点,就是让线看起来不那么乱,包括这边我都做了颜色的区分, 这些就是模型加载跟提示词输入啊。这两个老软,这个就是他的四步加速的老软啊,这个是 item 的 重打光的老软, 这个老软就是为了让替换的人物光影更加融合一些,然后这个强度也不用开太高,零点五就差不多了,如果开到一的话,他有时候就是手帧图会有偏色的情况,然后这两个就是 k g 的 加速减电,如果你运行的时候遇到赛者胎神报错, 你把这两个节点屏蔽了就行。然后这里这个节点就是工作流的核心,那他需要输入很多参数,那这些参数哪来的?肯定就是我们上传的素材处理之后得到的这些参数,对吧?那我们就一个一个看这些东西都是从哪来的。 首先克里普视觉,克里普视觉就是在这我们上传的图片经过缩放之后,他经过这个节点传输出来的,这里要选模型的啊,然后就是参考图像,那顾名思义参考图像就是就是这个 他经过缩放之后的传输过来,在这下一个面部视频,面部视频那就是我们上传视频经过这个缩放节点之后,到这个节点检测出来的面部数据,就是你需要替换的人物的面部数据, 在这里大家可以看一下面部图像啊这个节点,然后就是姿态视频,姿态视频是经过这个节点之后,那从这传输过来之后,在这里绘制姿态,就是人物的骨骼图在这里 这个节点出来的。那接下来这两个背景视频和角色遮罩就是我们上面这一块处理出来的东西,我们这用到一个 get 节点,把这个三个视频传输上来,经过 sim 三的视频分割之后得到的角色遮罩和背景视频, 像这个视频分割啊,最开始用的是 sim 二呀, s e、 c 那 些就是它是通过那个点编辑器,通过画红点、绿点来来分割这个视频。而现在乱神的这个 sim 三,它这个是语义分割,那所谓语义分割就是通过你的提示词来分割视频里面的对象, 那像这个提示词我写的是左边的女孩,他得到的就是这个角色的褶皱,左边这个女孩的角色褶皱,那如果你要想换右边女孩的褶皱,那我们就把提示改成右边的女孩就可以了,咱们看一下, 你看他现在就是右边这个女孩的褶皱,咱们再看一下这个你看, 所以他这个羽翼分割就很精准,也很省事,就是比之前的那个画红点、绿点的那种要更加简单一些,更加便捷。那如果你上传的视频是单人的话,需要做单人的角色替换,那你就直接在这写污慢或者慢就行了。咱们再上传个视频,再看一下, 咱们在这直接输入慢看一下效果。咱们也可以连一个这个节点来看看 sim 三格式化图像连到这,然后对象遮罩连过来,这里再接个合并为视频,它是从头到尾切换镜头也可以,就是直接把这个人物遮罩住了。咱们再预览一下这个节点, 你看这就是它的一个效果,非常非常的方便。这是它的 guitarham 项目页,大家记得给他点个 star, 回头我会把这个地址也放到视频下面,大家直接在这去下载就行了。然后这个是这个是乱神的这个介绍视频,大家也可以关注一下他, 看一下他这个视频里面都有讲详细介绍。那为什么这个角色遮罩是这么抽象的马赛克呢?就是因为通过这样的遮罩来让模型有更大的发挥空间,如果你要用精确的角色遮罩的话,那出来的效果肯定不行,就是有尾影啊,那些就是通过这个数值把它变成马赛克的, 一般写三十二就可以。那接下来就是背景视频,因为我们要把这个左边的小姐姐换成我们上传的图吗?那这个角色遮照,把它转成图像之后,再把它画到我们这个视频背景里面,通过这个节点,然后就出来的这个值。这两个节点是预览,要不要都可以 放在这里,看上去会比较直观一些。那我们从这得到了角色遮照,从这得到了背景视频, 然后我们在下面这里把它获取到传进去就 ok 了。那这个宽和高就是视频的宽和高,这个没什么可讲的,你配置好就是分辨率大一些,配置差就分辨率小一些,就这两个值,那这个就是视频的总帧数,那总帧数就是通过这个节点 视频信息,我们获取到这个总帧数之后,把它传送到这里来,保证生成的视频和你上传的视频帧数一样。 那这个节点所需要输入的这些东西我们就都已经搞清楚从哪来的,只要把这个节点这些东西都搞定了,那剩下的就简单了,经过 k 测量器, 然后这个步数你要想效果好点呢,就是六步或者八步,用四步也可以,测量器跟调度器就不用管了,就用这两个就可以了,他经过测量之后到这里输出, 输出这里还要借一个音频,如果你要想用原视频的音频,那咱们是从这获取的值,获取到之后,在这里输入帧率也是一样, 那这个帧率就是你这里写的,如果你这里写的是十六,那他传输过来这就是十六,如果你这里写二十四,那他这里就是二十四,省的一个个去改。这边也是一样,就是加了一个图像拼接,就是把原视频和生成的视频做一个对比, 其实说难吧,也就这些东西,只要把这些东西搞明白了,也就没啥了。那像这个 p 四大小正常一就可以了,就是他同时处理的这个 p 四数量 改大一点,他生成时间可能快一点,但是非常容易爆显存。然后这两个值他是做长视频拼接的,就不用去管了,大家有兴趣下来自己研究一下。另外就是这里再跟大家说一下,在这里除了可以设置帧率之外,还可以设置他的帧读取上限。 比如说十六针,我们想跑五秒的话,那这里输个八十一,那这个视频就是五秒。这里就是跳过,跳过前面多少针, 如果是零的话,他就是从第一针开始,如果这里输三十二,那就是跳过前面三十二针,再读取八十一针,那这个工作流到这里也就讲完了。其实拆开这么看的话,说难他也不难,对吧?只要大家理解了就都简单了。另外这里的姿态 也是可以有替换节点的,用 dwpos 或者 sdpos 都可以。但是这个面部图像的话,最好还是直接用他这个图像,用他这个脸部的图像做参考,而不是用那个面部的轮廓就做参考。 其实你要想知道这里出来的东西长什么样,你完全可以拉一个预览视频的节点看一下,咱们在这里换一个单人视频吧,这样看着更直观一些。就是姿态图,咱们单独运行一下,你看他在这加载,经过这两个节点处理之后, 他出来就是就是他一个骨骼图,因为我这里没有让他绘至头部,所以他只有身体的一个骨骼图, 因为面部参考我们是用是用的,这里这里也可以看一下,你看就单独提取他的那个面部数据作为一个参考,他的表情会更同步一些,就是比那个面部轮廓他表情会更好一些。好的,那到这里这个工作就讲完了,其实这么拆开来看的话, 就会更加有条理一些。那我们接下来看动作迁移,只要你把前面角色替换的工作流搞明白了,那这个动作迁移就更简单了。这个工作流除了不需要背景视频和角色遮罩之外,剩下的所有东西都跟上一个视频是一样的。 那动作迁移就很简单啊,就是你上传图片,让他模仿你这个上传视频里面的动作就行了,视频转会,说白了他也是一个动作迁移。咱们换个视频看一下,比如说咱们换这个视频,咱们通过单独运行这个节点获取到这个视频的第一帧, 然后复制图像,直接把它放到我们之前的 ai 工作里,将参考图绘制成二次元动漫风格,这个图出来之后,我们再复制这个图给它粘贴到这,咱们在这清一下缓存 好的这个视频出来了,我们看一下效果,那这个就是视频转绘, 实际上用 adamant。 想要达到最完美的效果,最好的办法就是根据你的参考,视频的第一帧去作图,就是把它的姿势啊、景别啊什么的都保持一致,那它出来的效果肯定就是最好的。 你像那些做影视二创的,基本上都是这么个逻辑,就是分别把那些需要替换的人物做出各种视角的图片,然后分批次去替换。如果你要想做影视二创的话,我推荐大家可以看一下金鱼大佬的这个视频。我这个视频呢,一来是给大家讲解一下这个 animate 的 基础用法, 第二呢就是希望能给大家提供一些思路,不管是拆解工作流也好,或者搭工作流也好,那今天视频到这里也就差不多了。两个工作流对比之前的生图工作流肯定是要更复杂的,但实际上我们只要把它拆开来看,搞懂这三块,输入,彩样输出, 只要把这三块理明白了,也就那样。咱们最后再看一下网盘吧,网盘里面所有的东西都在里面。老软这个是加速,老软这个是重打光的。 sim 三的模型有三个,我是用的这个点 p t 的, 我测试下的这三个都能用,这个 f p 十六就是半精度的,你看它容量也小一点,大家可以自己去测试。然后这个这两个就是这里用到的模型,这里, 那这个就是大模型,大模型我用的是 q 四的,如果你配置好,你可以用 f p 八呀, f p 十六都可以,这个就是 kubrick 这个模型这里用的 啊。另外这两个工作流我也同步部署到 rng 汉堡上面了,大家如果想要好,更好的清晰度,更高的质量,可以到 rng 汉堡来跑,那其他的就没什么呢?大家有什么问题给我留言或者发私信,我看到的都会及时回复。我是乡村幻想,咱们下期再见。

27像素幻想Lab 00:52查看AI文稿AI文稿

00:52查看AI文稿AI文稿今天我们玩点特别的,先看成片,阿伟已经死了,你挑的嘛偶像 段坤我吃定了,耶稣也留不住他。我说的这是我刚刚用 one animat 生成的角色动作迁移的工作流,把渣渣辉替换成黑豹生成小片段,大家也可以发挥自己的想象力去创作一些比较好玩的。首先我们用豆包帮我们替换一下角色 提示词,可以参考一下我这个。接着打开我的工作流模型,插件我都整理好了,宝子们对应安装就可以了。这个工作流主要用到了动作迁移模型, 载入图像调节尺寸,和原视频一致,提取人物姿态和动作彩样器的参数,可以保持默认,这就是最终生成的视频了。工作流模型已经给大家准备好了,有需要的小伙伴四五六验验牌。

04:05查看AI文稿AI文稿

04:05查看AI文稿AI文稿好,我们今天来讲个动作迁移工作流。呃,这次是用那个 one 二点二模型,动作迁移工作流的话,比我们之前用的那个 s d 一 点五的那个模型呃,动作迁移要方便很多啊,这个模型的差距非常的大。 呃,看一下,上一次这个是之前我们那个动作转会,那个时候还是用 sd 一 点五的模型,然后把这个视频放进去了以后,一帧一帧去拆解他的这个动作动态,然后根据他的骨骼来生成视频, 非常非常的麻烦,那个时候还剩下几百张图,对吧?现在就比较方便啊。这次这个万二点二的工作,他这个动作迁移就是直接传视频传图片就可以一键迁移了啊。先来看一下原片啊 i 就 这样的一个视频, 然后我们随便传张图,比如说我们这边放了一张女超人。好,然后我们这边直接点运行就可以了。 那这个视频转会啊,这个动作转会要用到的这个模型稍微多了一点。首先这边 clip 要有个 clip vision h 啊这样一个模型,然后加载器加载的是 unit animate one 二点二的 y 二点二的模型,然后 laura 用的是 light iv, 这个的话是专门用来呃提高你的这个视频质量的。最后,然后 one animate raylight 这个是重新打光啊,会让你的这个深沉的视频光线更加好一点。 呃,然后 clip 加载器的话是 f p 八 skill 的, 这个以前我们应该经常会有啊,所以这个模型还是经常会用到的。然后基本上就可以了啊,这个是这个不需要啊,这个多余了。嗯, e a e 加载器的话用 one 二点一就可以了,提示词的话,那就很简单,让这个角色跳舞就可以了。负面提示词的话可以看一下,也是我们很普通的,基本上大众用的这个负面提示词。 好,那这个视频的长度就是在这里调啊,我这边的话是十六帧,十六帧,十六帧一秒,那我们这边的话七十七帧生成的视频大概就是四点八秒左右。好,然后我们点运行就可以了, 这边点了运行以后会自动识别它的动作和面部表情啊,这个节点还是很智能的。 d w 姿态玉处理器啊,这个节点非常的神奇。 好,现在的话这个视频效果就出来了。 好,这个姿势还原的还是非常好啊,我们看一下它这两个对比的节点 好,它不管是动作手势的细节,还有这个服装啊,甚至这个服装的扭动, 它这个披风的扭动都是很符合物理原理的,而且背景音乐也会自动合成,所以这个视频就很方便很方便,比我们之前的动作迁移这个生成视频要方便很多很多。 好,那需要这个工作流和模型的小伙伴,我把这个资源都放在视频下面哈,嗯,大家自取。

12会画画的猿猿酱 16:34查看AI文稿AI文稿

16:34查看AI文稿AI文稿真指望日本人帮你成事啊,日本人这方面比较有经验。不是把溥仪给弄上去了吗?我得提醒你啊,他们利用了溥仪,嗯,现在要利用你,这里都是局,你可不能让他把你给害了。 hello, 大家好,我是乡村幻想。今天这期视频再给大家带来一期 anim 的 工作流,对比上一期视频里面的这两套工作流, 那今天的这套工作流就是更加完善一些。上一期为了给大家做一个入门的教程,做的是一个官方工作流, 也没有做那个长视频的拼接,所以这套工作流跑长视频的话会有裂化,会有尾影。今天这期视频呢,就给大家做一个进阶和补全。这期的工作流我是把动作迁移和角色替换做到了一起, 包括也支持了长视频,也支持运镜。然后这边也加入了 sd 的 一个姿态检测,就比如说我们跑一些视频的时候,可能用这个 vip 效果不太好,那我们就可以开这个 sd pos 来跑, 那同时这套工作流也更加的吃配置,我十二 g 显存,六十四 g 内存,勉勉强强能跑四八零 p, 那 如果你本地跑起来很费劲的话,这三个开关可以开一下, 一个是 uni 三 c 这边的 ve 分 块把它打开,还有一个就是这里的给它打开,还有一个就是解码的这个这三个 ve 分 块, 这三个开关都打开的话,能有效的降低显存占用,但是速度会非常慢。那大家如果电脑配置不好的话,也可以到 running haub 来玩,这段工作里我也不守到 running haub, rnghub 也是我平时常用的在线云平台,本地跑不动的工作流啊,模型什么的,我都会在 rnghub 来跑,同时它模型更新的速度也非常快,那今天通过视频下方的链接来注册会免费送一千点, r hb 每天登录也会送一百点。 那在 rnghub 这边我们可以用到容量更大的模型,以及跑更高的分辨率,你看这边可以直接跑七二零乘幺二八零的,它的清晰度啊,质量各方面都会比我本地跑出来的要好。 那我们回到工作流这边,还跟之前一样,咱们从头看起,那本地这边用到的模型是 q 四的,然后这边是他的一个分块,我开到了四十,大家如果电脑配置好,可以把这个分块降低,或者说不开,这个根据你自己的配置来看。 然后就是老软,老软这边用到了三个,第一个就是二点一的这个加速四步加速老软, 然后第二个这个 logo, 大家看名字应该大概能知道是个什么意思啊,就是增加动效的,我只能这么跟大家去解释。然后这个就是他的一个重打光的 logo, 重打光 logo 正常,我开是零点五的权重,这个 logo 开太高的话,他画面可能有点偏色,这个大家自己去试就行了。 然后 ve 就 还是二点一的 ve 模型家在这边就这些东西,大家看到这工作就跟之前一样,也是给它按照功能给它分成的块,我们按照每个块来讲的话,这样会更加容易理解一些, 也用到了很多的 get 和塞特节点,就是避免有太多的线有点看不清楚。那还是那句话,大家如果对这个模型,对这个工作流不是那么熟悉,我建议大家耐心把这个视频看完, 这样一来能避免你很多不必要的报错,二来对你的搭工作流以及拆解这些,你们的工作流也能多多少少有点帮助吧。好吧, 那我们首先就从参数讲起,参数里面需要修改的东西就这些,实际上这个工作流啊,提示词并不重要,因为我跑素材的时候,提示词压根就没写过,因为这套工作流的控制节点非常多,所以说你写不写这个提示词都可以 啊,但是我还是把它放到这里,你要写的话你就在这写就行了,你在这里把提示词写了,然后这边传出去,上面用那宽高,这里我需要多说两句,正常我们常用的九比十六的竖屏就是四八零八三二五七六幺零二四以及七二零幺二八零, 那如果是横屏的话,你把他们调个二就可以了,好吧。然后就帧率,那帧率本地这边只有一个节点,软件汉堡这边是有两个,因为软件汉堡这边的这个节点,这个加载视频的节点和输出视频的节点用到的帧率的数据类型不一样, 大家可以看到一个是整数,一个是浮点数,那我们本地这边只用到一个浮点数就可以了, 所以软件汉堡这边两个,到时候你如果在线上跑的话,这两个写一样就可以了,那本地这边只需要这一个就 ok 了,你十六针也好,二十四针也好,在这里输入就可以了,这个大家需要注意一下。 好了,这个就是遮罩开关,下面我也做了注,是如果你只跑动作迁移,你就把这个遮罩处理给它关上,然后把上面这个节点的角色遮罩和背景图像的连线给它断掉。后边讲到那个区域了,我会再强调一遍,这个就是自态选择, 正常你跑单人中景的那种就是很清晰的,你用这个 v i t 是 没问题的,但如果你感觉用 v i t 跑出来的效果不好,那你就可以用 sd pos 啊, 这也是给大家多一个选择,大家知道就可以了。那这个就是运镜的开关,用你三 c, 如果你的三个视频有运镜效果,你把这个打开 可以了,如果没有把它关上,好吧,这个跟上期的 sky 是 一样的,所以说整个工作流里面你需要动的就这块的区域,然后我们到这里参考视频,这边下面放了一个接受帧率的 在这上传视频,然后经过这个节点缩放缩放,然后这边输出了三个参数,一个是帧数就是你视频的总帧数,一个就是参考视频,一个就是音频, 那这个总帧数也就是时长,你可以在这里来输入。举个例子啊,比如说前面我们输入的帧率是十六帧,从这传进来之后,他这个视频的强制帧率就是十六帧,我们要跑五秒,那就是五乘以十六加一,你这里写八十一就可以了。 所以说你要通过这个帧读取上限来控制时长的话,就是帧率乘以秒数加一写在这里就可以了。好吧, 包括这里也可以有跳过前面多少帧,你想从第二秒开始,那你设置的帧率是十六的话,你就这写三十二,就是跳过两秒,如果你帧率设置的是二十四,你这里就写四十八,然后这边我特意接了个预览图像出来,如果要想动作牵引的效果好,我之前也说过啊, 你最好根据你的视频的第一针去做图,咱们不管是用 z 妹子呀,二五幺幺这些都可以。咱们获取到视频的第一针之后,咱们复制图像,比如说到这个 z 妹子的喜图,这咱们给他把这个视频第一针粘进去, 通过这边的反推,咱们把提示词拿到之后放到这里,根据你的需求去修改。比如说你把它改成动漫风格的呀,改成什么机器人啊,什么这那的都可以。 那如果说你非要用某张图片来跑这个动作迁移或者角色替换的话,那也有办法。那比如说咱们用之前发过的二五幺幺 a i o 这个工作流或者可怜的工作流都行,有姿势参考就可以。 比如说我就非要用这张图来跑这个动作迁移,那 ok, 把视频首页图传到这里,然后这张图传到图一这里写,让图一的女人摆出图二的姿势, ok, 那 出来的图你看是不是就能用了?所以说这个参考图的处理啊,这一步最好咱们还是不要省略, 想要跑出完美的效果,你前面必须得手动去做一些东西,不要搞的他视频手身图是全身的,你搞个半身的,那出来之后的效果肯定会不那么好。那这一点我已经说过好几遍了啊,每个动作牵引的工作流的视频我都说一遍,大家不要怕麻烦啊。然后下面这个就是上传图片, 上面图片跟上面一样啊,也是经过一个缩放节点,然后到这个可立普视觉,这里是需要一个模型的啊,然后这边我们传出来的参数,一个是可立普视觉,一个就是参考图, 紧接着就到这个自态处理,这里自态处理上面这一块是 sdpos, 下面这两个是 vip, 然后面部参考的话,我们最好还是用这个面部图来做参考, 不要用那个面部轮廓去做参考,用这个做参考他表情同步的会更好一些。那这边也是用到两个模型,这些都会在网盘里面, 这边就是我们前面获取到的参考视频,一个传到这边,一个传到这边 sdpos 这边,这用到一个模型,这也用到一个模型,这些都会在网盘里面,然后这些数值大家就不要去动它了,好吧? 同样下面这个是 v i t 姿态,然后下面这个就不用多讲了,跟上一期用到的是一样的,然后在这块区域我们输出的一个是面部图像,还有就是姿态图,这里是 sdpos 输出的,这里是 v i t 输出的,这两个我们二选一 啊,在这里就能用到。我们经过这个节点做一个切换之后,你看就传到他这个自带图像里面,这个自带图那这里这个注视大家也看到了,如果大家只跑动作迁移,就把这两个一个遮罩,一个背景, 把这两个给它断掉,如果要连的话,我们点一下这里就能连上,因为这两个值也是上面的这个遮罩区域获取到的。上一期视频里面其实我讲的已经很清楚了,一会我们再讲一遍啊,那这个节点就是我们安尼姆特的核心节点, 所有在前面处理之后输出的参数从这里传,通过这个节点再传到磁场器, 那这个可利普视觉就是参考图,这里传出来的参考图,顾名思义这个就是参考图。然后这个姿态图像就是前面的 sdpos 跟 vip 处理之后的姿态图,就是骨骼图,它是传到这里的 面部图就是这里出来的面部图。下面这两个就是刚才我们断掉的,是做角色替换需要用到的, 一会我们再讲。下面就是宽高跟帧数,宽高就不用多讲了,那帧数这里需要说一下帧数,这里就是我们前面获取到的你上传视频的总帧数,大家可以看到这个总帧数我同时传给了这个帧数和帧窗口大小啊。之前我们用 k g 流做循环的时候,在帧窗口这 要么是手动填,要么经过一系列的计算,自动填写这个针窗口是该写多少。那我们这次用到的方法是把这个总针数同时传给针数和针窗口,然后从这边拉一个上下文选项出来,让他从这去做循环。 大家看这个节点就能看到这是八十一,就是每一批次处理八十一针,然后这边就是重叠针,就是八十一跟八十一之间他有二十四针的重叠,所以我们就不用跟之前一样去算了,算出来之后往这填, 这样就更方便一些。然后到这里就是他的文本编码器前面我们写的提示词,通过这个节点连到这里给它输入。这里用到的这个模型跟上一期 sky 视频用到的是一样的啊,是 e n c 的 这个模型, 下面这块就是 uni 三 c 的 一个运镜控制,因为运镜控制我们是要用到视频的,我这边是直接把参考视频传到这里的,那如果你自己要传其他的运镜视频,那在这里也可以上传其他的视频,就是带运镜效果的视频都可以在这传。这里也需要一个模型 uni 三 c 的 模型, 然后这一系列结束之后,他经过采样,然后结满,然后再输出采样。这里大家如果想要效果好的话,可以跑六步或者八步, 因为我这边是需要跑素材测试,所以我一直跑的是四步。那好的,我们再看一下遮罩处理,这边遮罩处理一样用的还是这个 sim 三,只不过我这次把这个真编辑器也加进来了,那这个真编辑器就是把你的视频传上来之后,你通过鼠标的左右键去打红点、绿点, 选出你想要替换的区域以及不替换的区域。比如说在这里我们可以通过鼠标左键来把这个人物选出来,在他的手上、脚上以及身体各部位打上绿点, 然后这边的背景用鼠标右键去打上红点,然后经过这边的处理来得到角色遮照和背景图像, 这是上一期视频里面讲过的内容。另外需要跟大家说一下的,就是这个打点跟这个提示词不可以同时存在,如果你这边打了点,你这边提示词就清空,如果你这边要写提示词,你把这个打点点击这个图标给它删除,我们可以看一下通过这个打点出来的效果。 这边三个是预览窗口,咱们可以看一下,那这边就先让他处理,我们到软件汉堡这边看一下, 我说你看不?这边我处理了五个人的,刚好是用的这个羽翼分割,咱们可以看一下啊,这边提示词我写的就是 person, 然后他通过这边处理之后,你看得到的遮罩,你看 id, 你 看这是人物的精确遮罩,然后经过这边的处理之后,把它变成马克一样的这个块, 这边就是把它再画到背景里面,大家也可以看下这边的效果。我测试的是五个人的,那总的来说这五个人还是数量有点多,他的这个肢体还是有点不太对的地方,所以说大家最好就还是人物的数量少一些,不要整太多。本身这个原视频人都站到一起去了,他这个肢体 可能就识别的不精确,那正常两个人三个人肯定是没问题的,那五个人的话可能就效果不太好了啊,大家知道这个就好。 好的,那我们回到这边看,这边也出来了,那刚才 ryan 哈巴那边用的是提示词,那这边我们用的是打点,你看他一样很精准的把人物抠出来,包括他身后的这个飘带,你看那这边就是我们需要用到的两个东西,还是跟前面一样啊,这三个窗口是预览窗口,你要不要都可以, 最主要的是我们为了获取这个角色遮罩和这个背景图像,那获取到这两个值之后,我们在这传到这里就可以了。那关于真编辑器还有两点需要跟大家说一下,咱们补录一下这段。首先本地这边我们是可以通过单独运行这个节点来把视频加载上来, 通过打红点绿点的方式来选出想要替换以及不替换的区域。前面我们是整个人物替换,那同样我们也可以只把头部用绿点点出来,身体其他部位用红点, 那我们就会得到这样的遮罩,头部的遮罩,然后你在下面传你想要的图片, 就可以实现一个换图的效果。大家可以看一下这个,那身体的话也是一样,就是反过来用绿点把身体标出来,红点把头部标出来,那这样就可以实现换身体,所以说这个工作流的玩法还是挺多的。那第二点就是 rng 汉堡这边, rng 汉堡这边的真编辑器是有点问题的,他这里出不来头像,那在 rng 汉堡这边就没法再通过这个打点的方式来来选区域。 一开始我以为是我这边出 bug 了,后面我问了一下朋友,他们都说这个 runny 汉堡这边的这个真编辑器他出不来头像,那后面应该也会修复。 如果在线上玩的话,那那大家就先通过这个语义分割写提示词的方式来获取这个遮罩。最后一块就是输出了,这边是个保存视频的节点,这边是一个对比视频,就是我把这个参考图啊 参考视频以及骨骼图放到这边,就做一个对比。好的,那工作流就这些东西该讲的也都讲差不多了,如果大家对这些基础的东西还有不了解的,可以翻一翻,我上一期给你们的视频里边讲的非常非常详细啊 啊,这两期视频如果都能看完啊,再对比一下官方工作流和 k g 工作流的这个区别,那这个 animat 的 玩法基本上也就都掌握的差不多了。那我们最后再看一下网盘,网盘里面用到的模型比较多, control light 就是 unity 三 c 用到的这个, 下面的 deepex 就是 这里用到的这个。 o n n x 这个检测器用到的 d f o r, 这个没什么多讲的。大模型 q 四 lora 用到了三个 lora, 然后 sim 三的模型,这是 sd pos 的 模型, 这个就是文本编码器,这个是 ve, 然后这个就是优龙模型,优龙模型就是这里用到的。正常我们用这个十一 x 就 可以,实际上单人的话,你这个可以不开啊, 其他的就没什么了,就这些东西。感谢你看到这里,如果感觉本期视频对你有帮助,请不要吝啬你手中的三连,我是香酥幻想,咱们下期再见!

39像素幻想Lab

猜你喜欢

最新视频

- 353静香