token api中转教程

我一直有个梦想,就是实现脱坑自由,虽然财富自由不能实现脱坑自由,我想应该是很简单的,但是被狠狠的打脸了。事情的起因是这样的,最近不是 oppo core 的 很火吗?我自己也跑了一个 oppo core 的, 但是由于 oppo 呢,然后虽然是包月的,我试着想用自己的模型去支持 oppo core 的 去跑。 我看中了那个 mini max m 二点五的,它的全量参数呢是两百三十 b 的, 然后它的模型的大小呢,是接近五百 g, 就是 四百多个 g, 我 试着让它量化, 本想着量化到英特斯的这种精度损失会比较小,到英特斯的时候它也有一百三十多 g, 因为我的电脑的显存只有十六 g, 内存只有六十四 g。 后来呢,我想了另外一个方法,可以量化成 q 二的,量化成 q 二的之后,他的模型的大小只有八十 g。 我 一开始我选择的方案是奥拉玛进行跑这个服务, 模型呢,我去下载下来了,通过电话之后,它是有三个文件,我那个奥拉玛不好跑,我就用拉玛这个服务让它合并成一个文件,一个尾注为 g g u f 的 这个文件。我试着用奥拉玛的启动它,但是奥拉玛一启动就不错了,然后我改了方案,用拉玛 c p p 这个服务器启动这个项目, 拉玛 c p p 设置的它的参数,我一开始设置加载二十层网络的器启动,但是也报那个 o m 了,就是内存不够和显卡不够。 后来我把它改成五层,五层是可以加载进去的,可以顺利启动,但是我感觉这样会比较慢,我就会损失很多进度,我就把它改为十层、四层照样也可以启动, 启动之后,但是我测试了一下,他那个测试速度是非常慢的,由于这计算速度太慢了,我本地的显卡比较小,所以说本地部署模型这条路是行不通的,除非我要升级这个机器,但是升级这个机器这个钱我就可以买很多页的这种模型了,特别是 mini max 的 这个。

粉丝358获赞3714

相关视频

02:07查看AI文稿AI文稿

02:07查看AI文稿AI文稿open cloud、 token 还有 api 到底是怎么工作的?相信大家最近养龙虾应该没少接触这两个概念, open cloud 呢,我们可以把它简单理解成拓展屋,就单纯一个 open cloud, 本身是没有办法执行任何工作的。 嗯,大模型呢,我们可以把它理解成手机就是手机呢,大模型呢,才是这个 openclaw 的 大脑,然后通过这个大模型给 openclaw 指定让它去调用各种接口,就是各种 api。 api 呢,我们可以把它理解成链接线,我们通过这个 openclaw 来调用 api, 可以 使这个手机 或者是大模型有执行更复杂任务的可能性。就比如说我们要搭建一个户外直播的场景,我们需要补光灯,收音设备, 充电宝或者提字器等等,单纯手机是没有办法完成这些工作的。当我们给它配置了一个拓展屋以后,再通过调用不同的 a p i 接口连接不同的设备,就使一个手机 增加了很多的功能,就能够完成一整个户外直播的需求。 token 呢,就有点类似于消耗的电力,但实际上这个 token 的 消耗远高于是手机意义上对于电力的一个消耗。 大家要知道 token 的 这个原理呢,其实就是给大模型去输出你的需求,然后大模型给反馈的解决方案,来来回回的这个字体的传输就是消耗的就是 token。 openclaw 为什么消耗的 token 量特别大?很大一部分原因呢是 openclaw 增加了一个记忆功能, 就是你每次给他上传 token, 然后他再输出 token, 都是要把历史的 token 重新再输入输出一遍,所以这个 token 的 积累啊就越来越多, 现在也是有很多帮助大家节省 token 的 一些方式方法,包括有的 token 便宜,有的 token 贵得基于不同的这个大模型, 有的可能这个大模型训练花费的比较贵,所以呢,它的 token 就 比较贵,哎,有的呢,可能训练的便宜点,加电费便宜点,所以它 token 就 比较便宜。这里边呢,我们中国的这个 token 大模型也是通过这次 open cloud 呢脱颖而出,很大一部分原因就取决于我们中国优秀的电力基础设施,还有我们优秀的这些大模型从业人员,对于这个 api, 对 于 token 消耗量从代码层面的一个极致的压缩。

18小王来了 01:09查看AI文稿AI文稿

01:09查看AI文稿AI文稿别再让你的 ai 订阅吃灰了,今天教你一招,把 cloud 和 openai 订阅直接变成全能 api, 还能带人拼车回血! 这就是由微少开发的开源神器萨尔 api, 它的核心功能就一个字,强!它能把你手里昂贵的 ai 订阅一键转化成标准的 api 接口,不管你是想分给朋友用,还是想多设备同步,它都能帮你搞定。最牛的是它自带精准计费和智能调度,支持多账号轮询,谁用了多少头肯,现在的 订发是多少,后台看的清清楚楚。而且它完美适配原声工具,拿来就能用,完全不需要复杂磨改。目前这个项目在 github 已经拿下了两千四百多个星,妥妥的订阅管理天花板。 想实现 ai 自由高效分担成本的老铁们,这个项目绝对不容错过!赶紧去 github 搜索傻不二 api 试试吧!如果你的网络环境无法使用 github 大 路中转站九幺 git, 无需网络环境配置,只需要输入仓库名称, 可以帮你打包好原码和 app, 大 陆用户可以直接下载使用。如果你仍然觉得很麻烦,那我已经帮你总结好了全部资料,关注我,带你发现更多免费优质项目!

103CYBER炼丹师 03:48

03:48 04:06查看AI文稿AI文稿

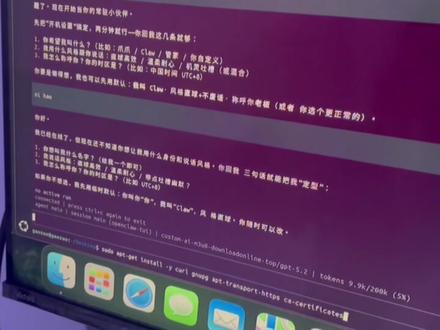

04:06查看AI文稿AI文稿呃,我现在演示一下那个怎么去。嗯,配那个 open call, 就是 如果用那个自定义的那个 open ai 的 那个端点的话,就这是一个空白的命令。行,然后我这个就是这个讯基已经安了, 就是你没安的话,其实步骤差不多,只不过我安装了的话,我用这个命令,然后我重新选择一下,如果你没有安装的话,你直接拿脚就是那个官方的脚本直接运行就可以, 就是弹出的画面差不就是一样的。然后我点继续,然后继续, 然后继续到这个模型提供商的时候,你选倒数第二个,就是这个用自定义的那个模型提供商,然后选择让他给你一个视例,然后你把它删了就行。 就是我这边是给了你一个,我应该是给了你一个端点,给他复制到这 一敲回车,然后他让你输入那个 api k, 然后把 api k 粘到这儿,然后继续, 然后他问你,呃,要这个兼容吗?啊,对对,就这个兼容的,这个这个组合的这个就选是就可以了,然后你输入一个模型 id, 你 比如说你用 gpt 五点二的话, 啊,这不要数错啊, gpt 五点二中间有一个杠,然后回车,他验证, 啊,这是验证成功了啊,这个回车就可以啊,这个别名回车,然后这这这我已经配过了,其实不用管我挑过 啊,这个也挑过,继续就可以,让我重启, ok, 他 让我,嗯,这个继续就行,打开那个 u i, 嗯,可以了, 它已经连接了, ok, 这就已经成功了, ok, 这是没有问题的。然后就是有一点要注意啊, 我先敲回车,就是如果它不行的话,就是配完不行的话你注意一下,你检查一下这个文件,就它的主配置文件, 就这个文件,然后点回车这边的话是 下面的是幺六三八四这个。

78高小卫软件 01:43查看AI文稿AI文稿

01:43查看AI文稿AI文稿春节期间,海外大模型聚合平台发布了全球大模型排行榜,数据显示,中国模型在全球排名前十的大模型 token 总用量中占比很高,这引发了国内对国产 ai 全球变现的关注,也催生了 token 出海的新趋势。今天我们来聊聊 token 出海目前落地的三种商业模式。 第一种是模型聚合平台上的 api 调用,这是目前最直接的出海方式,也是资本市场认可的模式。 海外开发者通过全球模型聚合平台调用中国大模型的 api 推理过程,在国内数据中心完成,海外用户按实际使用的 token 付费,中国大模型企业从中受益, 核心优势是电力核算力不出镜,但价值出镜。第二种是海外版 ai 应用,这类产品面向海外普通用户, 属于 c 端 token 出海。国内比较成功的有字节跳动的豆包海外版和 mini max 的 ai 陪伴应用。前者在东南亚、墨西哥等国的免费 ai 应用市场表现突出,日活超千万。后者吸引了近两百万海外付费用户,是 mini max 的 核心变现产品。这些应用依靠国内 i d c 服务的性价比 推理服务用国内平台,但变现方式是订阅、广告等 c 端模式,不是直接卖 token 给开发者。第三种是开源权重出海,这是长期抢占生态的打法, 中国公司将模型权重免费开源,海外推理算力平台在本地部署这些开源模型。不过这种模式下,海外开发者的 token 消耗在当地平台, 中国大模型公司无法直接受益。严格来说和 token 出海没有直接关系,但开源模型能抢占全球开发者心智,后期可通过高性能闭源模型导流到自家 api, 实现真正的 token 出海。总结来说,这三种商业模式本质还是国产算力的趋势, token 出海更像是给国产算力套了个新马甲,大家要注意其中的炒作风险。

82云罗CEO王涛 02:25查看AI文稿AI文稿

02:25查看AI文稿AI文稿大家好,今天我们用最直白最核心的方式把 taco 出海这件事讲透。 首先先分清一个最关键的概念,我们现在说的 taco 出海绝对不是虚拟币,不是加密货币,那个在国内是严禁的,大家一定要先划清界限。 我们讲的 token 是 ai 行业的计价单位,简单说,一个 token 大 概等于半个汉字,四分之三个英文单词,是 ai 大 模型收费的最小单位。那什么是 token 出海? 我给大家一句话总结,中国 ai 算力,跨境卖服务赚外汇,也就是海外的公司开发者 app 调用我们中国的大模型 api, 我 们用国内的算力、电力、 gpu 把 ai 服务做好,再把结果传回海外, 按 token 收费,用美元结算。这就是 token 出海。它的核心逻辑其实就四步, 第一步,海外请求调用。第二步,数据跨境传输。第三步,国内算力处理。第四步,按 token 收费,外汇回流。说白了就是电力不出境,价值跨境流,是 ai 时代全新的数字贸易。 那我们中国做 token 出海优势到底在哪?三个核心优势记住就够了。第一,成本碾压 我们的绿电便宜,算力规模大,单位 token 成本只有欧美十分之一到二十分之一, 价格优势非常明显。第二,规避壁垒,我们不出口芯片,不出口服务器,只出口 api 服务,完美绕开硬件管制。第三,合规红利, wto 框架下电子传输免征关税,毛利高,空间大。当然 tucker 出海也不是没有挑战,目前最现实的问题就这几个, 跨境网络延迟数据出境合规、外汇结算、海外本地话合规。最后我们再用一句话收尾, token 出海,就是中国把绿电加蒜粒打包成 ai 服务卖给全世界。这是新一代的数字丝绸之路,也是中国 ai 走向全球的核心路径。

3仟帆 02:19查看AI文稿AI文稿

02:19查看AI文稿AI文稿现在使用 openclaw 终于不用担心脱贫告急了,顺带给大家更新了一下项目文档,居然都是 openclaw 全程自己更新的。 从上一个纷飞的白嫖几家大模型 a p i 调用提供商,然后到现在有二十四家,从深度解锁的七十多个平台脱颖而出。然后第一家就是我的老朋友危机流动 注册就送十四元的全平台调用费额,然后还可以邀请好友十六元吗?可以无限量叠加。 最近还有一个开工就可以领取的十八元代金券,也属于是点点鼠标即送,像这样的平台现在有二十四个, 欢迎大家提交自己的医学和 pr, 可以 随便提交自己的使用体验, 然后 opencloud 会自己进行处理和回复大家的同时也收集了各家的一个编程套餐的情况。我现在用的编程套餐是阿里云百炼的首月七块九, 因为它是首月最低的,虽然摩尔县城有首月免费体验,但还没有具体的用。阿里云百炼这七块九我现在体验下来的话,嗯,将就能用,但感觉不是全量的。 然后其他家的话目前还没有怎么用,后期可以出一个详细的对比, 然后后面有一个各家编程订阅的横向对比,大家需要开通可以简单看一下。最后祝大家养虾愉快!

03:49查看AI文稿AI文稿

03:49查看AI文稿AI文稿token 出海是什么意思?我们一起来看一下,先和大家讲一下什么是 token。 token 其实就是 ai 服务的一个计费单位啊, 既然是计费单位哈,我们通俗的来讲,就换成英文单词或者是中文的这个汉字,一个 token 大 概等于零点七五个英文单词,或者约等于一点三五个中文汉字,每个国家都有,每个国家的这个语言和文字是大家是不通的啊,那么最公平 最公开的一个方式呢,就把这个文字呢转换成 token, 比如说你问 ai, 今天天气怎么样啊?这么简单的一句话,那么 实际上呢,会对 ai 来讲哈,它就是变成了若干个 token。 那 么 ai 回答你啊,今天的天气晴啊,这个温度是二十度。回答出来,这个文字呢,也是转换成 token 啊,不管你送哪个国家的这个文字都一样的,都转换成 token。 token 出海这个词听上去好像很高大上,其实是什么意思呢?其实就是让外国人,让鬼佬来用中国的这个 app, 用中国的这个大模型,用中国的 ai 服务,这个就叫 token 出海。 第一啊,我们先说一下模型层啊,什么叫模型层,就是呃大模型层面的啊,然后呃它的体现形式,可能是 app, 也可能是提供这个 api 的 这个接口啊,就直接地卖 token, 也就说直接赚鬼佬的钱,可能是包月包年啊,怎么样的 直接面向鬼佬来提供这个 ai 服务的啊?我列了这五家,一家 mini max, 它是呃港股的龙头啊,全球的。这个钓用量呢,应该是第一,海外的收入就是占比了百分之七十几啊。 第二呢是呃制服 ai 啊,它是面向东南亚和中东比较多一些。第三呢是 kimi, kimi 就是 月字暗面啊,它的这个优势在于它的这个长文本的这个模型啊,在海外还是很受欢迎的,并且它海外的这个收入也超过了国内。 第四个呢是 deepsea 啊,大家很熟悉啊,用,而且只有 open ai 的 大概十分之一左右。第五个是昆仑万维啊,昆仑万维有一个叫天宫大模型,这个海外的这个收入占比也是逐步在提升的, 这是模型层啊,模型的背后是什么呢?是算力啊,就在背后提供算力的啊,比较核心的我列了这三家啊, 第一,宏博股份,它对应的是这家啊, minmax, 它是 minmax 的 这个独家的这个双利提供商,而且呢,在那个美国,呃,有自建这个数据中心啊,打算这个海外做交付。 第二呢是手足在线啊,手足在线对应的是这个智普 ai 啊,是智普 ai 背后的这个算力提供商。第三个润泽科技啊,这个呃是字节的这个核心的这个算力合作伙伴啊,呃,主要主打这个东南亚的算力项目, 还有一些做呃,跨境的这个算力的啊,火烈了这四家,其中网速科技呢,是做全球的这个 c、 d、 n 加速的,并且它也有做这个边缘计算。中北通信主要是呃海外算力和这个跨境网络两个布局啊,服务于这个东南亚和中东的一些模型出。海 利通电子呢,主要是跟英伟达做一个合作哈,然后呢,自己呢,布局这个国内和东南亚的这个算力的这个租赁。回到最开始的这个标题哈,电力加算力 token 出海啊,因为中国的这个电力呢,相对来讲是比较便宜的,那我们的算力呢,是比较厉害的, 所以呢,这个在背后做支持,我们就可以 token 出海。很多人搞不懂 token 出海是什么意思,因为有不少媒体把简单的事情复杂化,显得自己高深莫测,其实 token 出海就是这么简单,我们下期见。

1.5万飞歌同学 01:01查看AI文稿AI文稿

01:01查看AI文稿AI文稿推出了那个小龙虾嘛 opencloud, 之前那个 talk 就是 api 不 够用,现在我们重新注册一个,要想去注册英伟达的那个它可以免费无限使用,但是吧 它国内不让用了,要 他对中国进了这个就注册成功了,然后点这个控制台,看到没,直接下一步跳过就完事了。 这里就出现一个超算互联网,这个直接点立即体验, 然后点这个模型 api, 这里就有一个免费领取,领取成功时间就这就还有两周, 在这里可以看到用户量,你看这就一千个 tokyo 行。

03:30查看AI文稿AI文稿

03:30查看AI文稿AI文稿嗯,好的朋友们,接下来我带给大家如何去申请这个英伟达免费的这个 a p i 以及如何配置使用。先打开新标签页, 输入这个网址,我们打开这个网址之后,能看到左边有简单的这些 model 模型, gpu 这边有一个注册,然后我们需要先使用这个谷歌账号,或者是无论是 qq, 邮箱等注册一个嗯, 自己的账号,随便给大家举一个例子,比如,哎 qq 点 c o m, 然后我们进行接下来的一个登录, 如图所示,我们登录上去之后呢,接下来就这样的一个界面,然后现在我们点击右上角,然后去点击到我们的这一个 k, 放件自己的一个新的英文达的一个新 k, 在 下面输入我们的一个大概的一个这个随便去选哈。嗯,我们输入一个自己的一个名字,比如 d f, 然后点击创建我们的一个 k 就 生成了。 接下来我们需要去我会给大家介介绍 open klo 如何去配置这一个 k, 使我们的大模型得到使用。 嗯,好的朋友们,我们打开我们的一个 power show, 就是 一个终端控终端控制器,然后我们输入 open 小 龙虾的线 open klo config, 这里就会到了一个我们经典的一个龙虾的一个配置界面,选择本地,我们选 model, 这里的话配置地址,我们输入这个,然后回车 进入下一步,然后点击这个 api 的 一个现在的一个配置,然后我们呢输入我们自己的一个 api k, 这里我们一个随便的 api k 去举例子, 到了下一步,然后我们选择这个 open ai, 然后这里面是我们模型的呃,一个数字杠 m 二点五距离去配置,正常情况下他这边会显示配置成功, 输入指令之后将会到了达这个界面,然后我们接下来将打开这一个 open 格式接送文件,找到这个名字,然后 然后下面的内幕也要给它复制改上去,然后后面留下这一个 custom pose, 然后把这些都做完之后, ctrl 加 s 保存关闭,我们再打开 open close, 我 们的大模型就已经替换完了。同理我们需要别的模型,就可以在这面实时进行一个替换。

50bzybox 01:29查看AI文稿AI文稿

01:29查看AI文稿AI文稿如何免托肯本地装小龙虾?最近这个 openclock 非常火,我也在我的本地装了一个小龙虾,但是装小龙虾最难的一个地方就是他的托肯啊,非常好这个托肯,但是我装的这个版本的话,他是一个免托肯版本,他是一个。怎么逻辑呢?就是你不要去配这个 apikey 啊,你 配的是什么?配的就是他网页的这个接口啊,就是说你通过这个网页的接口来调用这个模型的能力啊,比如说你可以去配这个 智谱的模型啊, deepsea 的 模型啊,啊, kimi 的 模型,豆包的这些模型,只要你的网页能够访问去抓这个网页的接口, 你就把这个接口的这个模型的能力去给你的这个小龙虾用,这样的话你相当于就不用再去配 apis key 了,就相当于不用再花费自己的这个托肯了。我现在的话本地已经配好了,我就问他一下你是什么模型?因为我连的是这个 deepsea, 它相当于已经帮我连上这个 deepsea 了 啊,现在这个非常好用,就不需要再配这个托克了。这个的话就是我的这个 open cloud 他的一个配置的文件。给你们看一下他访问的这个接口啊,接口的 url 的 话就是 deepsea 的 官网模型的话, deepsea chat, 然后 deepsea 的 推理模型 就是这么配的,就说你不需要再去配那个 api key 的 那个接口了,直接去掉网页的接口来配你的这个本地的小龙虾,也是可以用的,如果你们感兴趣的话可以后台戳我。

21阿鲲正在飞 01:06查看AI文稿AI文稿

01:06查看AI文稿AI文稿我以前对于 a p i 这种中转站是相当有偏见的,相当有那啥的,就是如果不是因为迫不得已,我是更不会用 a p i 这种中转站的。 像我之前一开始用 g p i 的 时候是走 g c p, 走谷歌云那种白嫖的金额吗?一开始不知道,应该可能很多人是这样一个开始,但是你发现官方这些东西他都会收紧收缩,你就很难找到这样东西, 然后慢慢了解,你就会去了解到 apa 中转这个东西一开始的时候都是带着偏见的,因为你会觉得这个东西会不会降脂啊?会不会说是他给你缩水啊?会怎么样的?是其实 我发现很多时候你愿意尝试是很重要的,其实甚至你会发现这个东西尝试一下可能就几分钱几角钱,但是大部分人他都不愿意去尝试,你花一颗也花个一块钱,你就知道这东西到行不行了, 对不对?但是,所以,所以其实你可以用很极低的成本去把你想要的一些认知啊,想要的一些效果其实就可以测出来,但是就是这个是可以执行的。

236赛博jack 02:26查看AI文稿AI文稿

02:26查看AI文稿AI文稿如何本地部署 openclog? 无需付费,无需 api, 可调用多种大模型,适合想尝试但是分币不花的同学。今天嘴对嘴教会你,记得一键三连鼓励一下。第一步,环境准备,我们先来安装 get, 点击电脑开始菜单,这边输入 powershell, 然后右击以管理员身份打开,输入上面这一段代码,注意空格,然后按下确认键,等待安装即可。这边已经提示我们安装成功了。第二步,安装 elama, 进入欧拉玛官网,点击右上角的下载,这边有三个系统版本可供选择,大家根据自己的系统自行选择,然后复制上面这段代码,打开之前的 power shell, 把刚才的这段话复制进去,等待下载安装 已经提示安装成功了,我们点击开始菜单,找到刚才安装的欧拉玛,打开欧莱曼以后,我们发现这边有很多模型可供选择,我们也可以自行选择模型,比如我选择最近刚发布的千问三点五模型。第三步,安装模型, 大家根据自己的配置找到合适的参数进行下载,复制上面这一段代码,然后点击开始菜单,输入 cmd, 把刚才复制的代码复制进去,等待下载安装即可。 由于模型比较大,大家需要耐心等待,我这边直接跳过了,我们显示已经安装成功了,我这边输入你是谁,他会跳出思考过程,然后说我是通一千问系列最新的模型。接下来我们回到奥拉玛,点击左上角的设置菜单,打开 expose alama to the network 这个选项, 然后往下拉,找到 context list 这个选项,把上下文长度设置六十四 k 到一百二十八 k 之间,如果你显存高,可以调高。第四步,安装 openclaw, 我们进入 openclaw 官网复制上面这段代码,记得不要看错了,它有 mac os 版本的。然后重新打开 powershell, 把刚才复制的代码复制进去,跟之前一样等待安装即可。这边显示已经安装,我们点击允许我们输入 alama launch openclaw, 然后点击确认键。 接下来可以通过 tab 键来选择你想要的模型,因为之前我们下载了快三点五模型,所以我们直接选择这个。安装好以后,我们复制上面这个链接到浏览器打开即可。 看到这里就恭喜你成功安装了 openclaw, 下一期我会教大家如何链接 qq, 实现全自动工作,小伙伴们别忘记点波关注哦,咱们下期再见!

128七兆赫

猜你喜欢

最新视频

- 1055酌沧